ما هو الذكاء الاصطناعي ذو الصندوق الأسود؟ شرح مشكلة الصندوق الأسود

في أبريل 2026، أصدرت شركة Vectara تقريرًا مخيبًا للآمال حول دقة نماذج اللغة. فقد انخفضت نسبة أخطاء نماذج اللغة الرائدة إلى أقل من 4% في اختبارها الأساسي. لكن نماذج "الاستدلال" الجديدة من GPT-5، وClaude Sonnet 4.5، وGrok-4، وGemini-3-Pro، تجاوزت نسبة أخطائها 10% في مجموعة البيانات الجديدة. ووصلت نسبة أخطاء Grok-4-fast-reasoning إلى 20.2%. إن أذكى النماذج، تلك التي "تفكر" قبل الإجابة، هي الأسوأ في إخبارك عندما لا تعرف الإجابة.

هذه هي مشكلة الصندوق الأسود باختصار. لقد بنينا أنظمة ذكاء اصطناعي تُنتج في كثير من الأحيان مخرجات مفيدة، ولا يستطيع أحد، حتى مُصمميها، تفسيرها تفسيراً كاملاً. فهي دقيقة دون أن تكون مُعايرة، وسلسة دون أن تكون صادقة، وواثقة دون أن تكون صحيحة.

لاحظ المنظمون ذلك. يفرض قانون الذكاء الاصطناعي في الاتحاد الأوروبي الآن غرامات تصل إلى 35 مليون يورو أو 7% من إجمالي الإيرادات العالمية على الاستخدامات المحظورة، مع دخول قواعد الأنظمة عالية المخاطر حيز التنفيذ في 2 أغسطس 2026. وأبلغ مكتب الحماية المالية للمستهلك في الولايات المتحدة البنوك بوضوح أنه لا يمكنها استخدام الخوارزميات المعقدة إذا كانت هذه الخوارزميات تمنعها من تفسير رفض الائتمان. أما مجال الذكاء الاصطناعي القابل للتفسير، الذي كان موضوعًا متخصصًا قبل خمس سنوات، فقد أصبح الآن سوقًا يُقدّر حجمه بما بين 9 مليارات و13 مليار دولار في عام 2026.

يشرح هذا الدليل ماهية الذكاء الاصطناعي ذي الصندوق الأسود، ولماذا تتحول حتى نماذج الذكاء الاصطناعي البسيطة ظاهريًا إلى صناديق سوداء، وما هي المشاكل التي تحدث عند حدوث ذلك، وأين يظهر في مجال العملات الرقمية والتكنولوجيا المالية، وكيف تحاول أدوات الذكاء الاصطناعي القابلة للتفسير (SHAP، LIME، التحليلات المضادة للواقع) كشف غموضها، وما يجب معرفته عن النظام التنظيمي الجديد في الاتحاد الأوروبي والولايات المتحدة. كما يتضمن الدليل توضيحًا موجزًا لمشكلة شائعة: مساعد البرمجة Blackbox AI على blackbox.ai يختلف عن هذا المفهوم.

ما هو الذكاء الاصطناعي ذو الصندوق الأسود ولماذا هو مهم؟

يشير مصطلح الذكاء الاصطناعي ذو الصندوق الأسود إلى أي نظام ذكاء اصطناعي تكون آلياته الداخلية غامضة للمستخدمين، وغالبًا للمطورين الذين قاموا ببنائه. المدخلات والمخرجات مرئية، لكن المسار بينهما مخفي داخل طبقات من الأوزان والأنماط المُتعلمة وتحويلات التعلم الآلي التي لا يستطيع أي إنسان قراءتها بالكامل. وينطبق الأمر نفسه سواءً كان النموذج يتعامل مع بيانات جدولية أو صور أو مهام معالجة اللغة الطبيعية مثل الترجمة والمحادثة.

يُعدّ مصطلح "الصندوق الأسود" أقدم من التعلم العميق الحديث. فقد استخدمه المهندسون منذ ستينيات القرن الماضي على الأقل لوصف أي نظام يمكن فحصه من الخارج دون فك أجزائه. ويشير علماء الأحياء إلى أن الدماغ البشري نفسه يُعتبر صندوقًا أسود، لكن هذه المقارنة محدودة: فالذكاء الاصطناعي لا يعمل كالإنسان، والافتراض بأنه كذلك هو من أسرع الطرق لسوء فهم المقصود بمصطلح "الصندوق الأسود" في الذكاء الاصطناعي. ما تغيّر في العقد الماضي هو الحجم. إذ يمكن لنموذج لغوي حديث ضخم أن يحمل مئات المليارات من المعاملات. وتنشر الشبكة العصبية العميقة النموذجية "المعرفة" عبر آلاف الطبقات وملايين رؤوس الانتباه، حيث تقوم الخلايا العصبية الفردية بتشفير أنماط متعددة غير مترابطة في آن واحد. ويُطلق الباحثون على هذه الخاصية الأخيرة اسم "تعدد الدلالات"، وهي أحد أسباب بقاء التفسير الآلي في مراحله الأولى.

لماذا ينبغي لأي شخص خارج المختبرات البحثية أن يهتم؟ لأن الذكاء الاصطناعي المُبهم بات يُسيّر قرارات مصيرية. فهو يُوافق على الائتمان ويرفضه، ويُقيّم المدعى عليهم، ويُصنّف المعاملات على أنها احتيالية، ويُدير حصة كبيرة من حجم التداول في جميع منصات تداول العملات الرقمية الرئيسية. وعندما يُخطئ، يُصبح من شبه المستحيل معرفة السبب، أو إصلاح الخطأ، أو محاسبة أي شخص.

يُعدّ هذا الأمر بالغ الأهمية أيضاً لأنّ حوكمة الذكاء الاصطناعي لم تعد تعتبر الغموض مشكلةً تخصّ المطورين. فالاتحاد الأوروبي يتعامل معه الآن كمسألة تتعلق بالوصول إلى السوق، بينما يتعامل معه المنظمون الأمريكيون كمسألة تتعلق بالإقراض العادل. وقد واجه كلّ مسؤول تنفيذي وافق على مبادرة ذكاء اصطناعي منذ عام ٢٠٢٤ المعضلة نفسها: ما الذي يفعله هذا النظام فعلياً، ولماذا؟ لم يعد فهم الذكاء الاصطناعي ذي الصندوق الأسود أمراً اختيارياً، ولا يمكن حلّ مشكلة الصندوق الأسود بمجرد استخدام مزوّد خدمة مختلف.

لماذا تصبح نماذج الذكاء الاصطناعي صناديق سوداء؟

ليست كل أنظمة الذكاء الاصطناعي صندوقًا أسود. فشجرة القرار البسيطة شفافة تمامًا. ويُخرج نموذج الانحدار الخطي معاملاتٍ يُمكن قراءتها. حتى نظام الذكاء الاصطناعي القائم على القواعد من تسعينيات القرن الماضي، من حيث المبدأ، قابلٌ للتدقيق سطرًا بسطر.

إذن كيف تتحول نماذج الذكاء الاصطناعي الحالية إلى صناديق سوداء؟ يحدث ذلك لأربعة أسباب متداخلة.

أولاً، الحجم. تعمل نماذج التعلم العميق التي تحتوي على ملايين أو مليارات المعاملات في فضاءات عالية الأبعاد لا يستطيع البشر تصورها. يمكنك وصف نموذج يحتوي على 200 مليار معامل رياضياً، لكن لا يمكن لأحد استيعابه ذهنياً.

ثانيًا، التمثيلات الموزعة. في الشبكة العصبية العميقة، لا تخزن أي خلية عصبية منفردة "مفهوم القطة" أو "قاعدة رفض القرض". تنتشر المفاهيم عبر آلاف الخلايا العصبية، وتشارك كل خلية عصبية في العديد من المفاهيم في آن واحد. إن استخلاص تفسير واضح هو مشروع بحثي، وليس مجرد استفسار.

ثالثًا، الاعتماد على بيانات التدريب. يتشكل سلوك النموذج بناءً على بيانات التدريب الخاصة به، والتي عادةً ما تكون ملكية خاصة، وضخمة، وأحيانًا تنطوي على مخاطر قانونية. حتى عندما ينشر المطور أوزان النموذج، نادرًا ما تتم مشاركة البيانات. لذا، يغيب جزء أساسي من "السبب" وراء ذلك.

رابعًا، النية. ثمة أسباب عملية لاستخدام أساليب الصندوق الأسود عن قصد. فبعض مطوري ومبرمجي الذكاء الاصطناعي يُخفون تفاصيل النموذج الداخلية عمدًا لحماية الملكية الفكرية، ومن الأسباب الأخرى لاستخدام تصميمات الصندوق الأسود شروط الترخيص والمزايا التنافسية. حتى النموذج ذو الأوزان المفتوحة يُمكن أن يُصبح صندوقًا أسودًا حول قراراته، لأن معظم النماذج الحديثة تعتمد على أنماط ناشئة لا تُوثّقها أي وثائق. فالشركة التي استثمرت 100 مليون دولار في نموذج ما، لن تكون حريصة على نشر بنيته وإجراءات تدريبه. كما أن نماذج الذكاء الاصطناعي مفتوحة المصدر التي تُشارك شفرتها البرمجية الأساسية تُعتبر في نهاية المطاف صناديق سوداء أيضًا، لأن المستخدمين لا يزالون غير قادرين على فحص الأوزان المُتعلمة بأي تفسير ذي معنى.

والنتيجة هي أن حتى نماذج الذكاء الاصطناعي المتقدمة، التي تبدو بسيطة ظاهريًا، بما في ذلك نماذج التعلم الموجه ونماذج الذكاء الاصطناعي التوليدية، تتحول إلى صناديق سوداء افتراضيًا. فالنماذج الشفافة هي الاستثناء، وليست القاعدة. يمكن للصناديق السوداء المعقدة أن تحقق دقة مذهلة، ولهذا السبب تستمر الفرق في نشرها رغم غموضها. وينطبق الأمر نفسه على نماذج الذكاء الاصطناعي ذات الصناديق السوداء المدربة على بيانات غنية ومعقدة: فالتحسن مقارنةً بنماذج الذكاء الاصطناعي القائمة على القواعد غالبًا ما يكون كبيرًا بما يكفي لتجاوز مخاوف قابلية التفسير إلى أن يحدث خلل ما. معظم نماذج الذكاء الاصطناعي الحديثة ذات الصناديق السوداء هي في نهاية المطاف صناديق سوداء لأن المستخدمين لا يزالون غير قادرين على فحص الأوزان المُتعلمة. تشارك نماذج الأوزان المفتوحة شفرتها البرمجية الأساسية، ويمكن للمستخدمين قراءة بنيتها، لكن الشفرة البرمجية الأساسية تظل في نهاية المطاف صناديق سوداء عندما تسأل "لماذا قال النموذج ذلك؟".

مشكلة الصندوق الأسود في التعلم العميق

مشكلة الصندوق الأسود هي ما ينتج عن تراكم هذه الأسباب الأربعة. يعمل النموذج، وغالبًا ما يكون أداؤه مثيرًا للإعجاب. لكنه يعمل بطريقة تقاوم ثلاثة أمور في آن واحد: التفسير، والتحقق، والتصحيح.

لنأخذ المثال الكلاسيكي: نموذج تعلّم عميق مُدرّب على التعرّف على الباندا. يحقق النموذج نسبة نجاح 99% على مجموعة الاختبار. يبدو الأمر رائعًا. ثم يقوم أحدهم بتشغيل أداة تحليل البيانات ويكتشف أن النموذج لا يُركّز على الباندا نفسها، بل على نبات الخيزران. تحتوي معظم صور الباندا في بيانات التدريب على الخيزران أيضًا. لقد تعلّم النموذج اختصارًا. عند عرض صورة باندا بدون خيزران، يفشل النموذج.

يُعدّ هذا النوع من "التعلم المختصر" شائعًا في مجال التعلم العميق. إذ يكتشف النموذج نمطًا إحصائيًا لا يتطابق مع المفهوم الأساسي، ولكن لا يُلاحظ ذلك إلا عندما يبدو الواقع مختلفًا قليلًا عن مجموعة التدريب. وتُعدّ الأزمة المالية لعام 2008 مثالًا تاريخيًا يُحتذى به هنا. فقد عملت نماذج القيمة المعرضة للخطر، المبنية على افتراضات التوزيع الطبيعي، بكفاءة عالية في الأسواق العادية، ثم انهارت في ظروف استثنائية، لأنها تعلمت اختصارات لم يدرك مصمموها أنها اختصارات.

تشترك نماذج التعلم العميق الحالية في نفس نمط الفشل هذا، مع عدد أكبر من المعاملات ومستوى ثقة أعلى. وقد بدأ باحثون في مجال التفسير الآلي، بما في ذلك فرق من شركتي أنثروبيك وأوبن إيه آي، في إعادة هندسة أجزاء صغيرة من نماذج اللغة، خلية عصبية تلو الأخرى. يُظهر عملهم أن بنية نموذج اللغة أقرب إلى الدوائر المتشابكة منها إلى المنطق المنظم. لا توجد نقطة يمكنك عندها تحديد مكان الحل بدقة. إن مشكلة الصندوق الأسود ليست خللًا برمجيًا يُمكن إصلاحه، بل هي مشكلة بنيوية.

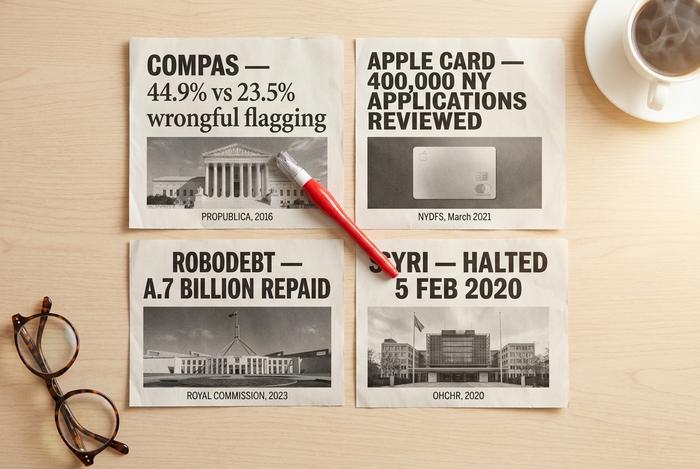

أمثلة على الذكاء الاصطناعي ذي الصندوق الأسود: COMPAS، وبطاقة Apple Card، وRobodebt، وSyRI

هل تريد أن ترى كيف يبدو الذكاء الاصطناعي المعقد عندما ينهار؟ الحالات الأربع التي يستشهد بها الجميع تُخبرك بمعظم ما تحتاج معرفته. تشمل هذه الحالات العدالة الجنائية، والخدمات المصرفية، والرعاية الاجتماعية. جميعها ألحقت الضرر بأناس حقيقيين. ولم تفشل أي منها بنفس الطريقة.

لنبدأ بنظام COMPAS. طورته شركة نورثبوينت للتنبؤ باحتمالية عودة المتهم إلى ارتكاب الجريمة، وقد اعتمدته المحاكم الأمريكية على نطاق واسع. ثم قامت بروبابليكا بتحليله بدقة. ففي عام 2016، أجرت تدقيقًا شمل أكثر من 7000 موقوف في مقاطعة بروارد، وكانت النتيجة كارثية: فقد صُنِّف المتهمون السود خطأً على أنهم عاليي الخطورة في 44.9% من الحالات، بينما بلغت النسبة 23.5% فقط للمتهمين البيض. وفي دراسة لاحقة نُشرت عام 2024، ازداد الوضع سوءًا. إذ تساوت دقته مع 137 معيارًا (العمر والسوابق الجنائية). لذا، لم يُضف هذا التعقيد أي قيمة إضافية، ولكنه جعل اكتشاف التحيز أكثر صعوبة. هذا هو النموذج التقليدي الذي يُقيّم الأفراد بدلًا من المنتجات. وينطبق الأمر نفسه على نموذج تقييم المتقدمين للوظائف، الذي تخلت عنه أمازون عام 2018.

ثم بطاقة آبل، أواخر عام ٢٠١٩. قال ووزنياك إن زوجته حصلت على حد ائتماني أقل بعشر مرات من حده. وأكد ديفيد هاينماير هانسون الأمر نفسه. انتشرت القصة انتشارًا واسعًا. تعاملت إدارة الخدمات المالية في نيويورك مع الأمر بجدية، حيث راجعت ما يقارب ٤٠٠ ألف طلب. في مارس ٢٠٢١، خلصت إلى عدم وجود تمييز قانوني على أساس الجنس. لكنها كتبت أيضًا، وهذا هو الأهم، أن غموض تجربة العملاء كان بحد ذاته مشكلة ثقة. اتضح أن الضرر الناتج عن هذا الغموض يتعلق بالنتائج والتصورات. ولا يمكن لبيان صحفي أن يُصلح جانب التصورات.

الديون الآلية هي الوجه الآخر للعملة. لا علاقة لها بالشبكات العصبية العميقة. طبقت أستراليا قاعدة متوسط الدخل على سجلات الرعاية الاجتماعية بين عامي 2016 و2019، واتهمت نحو 400 ألف مستفيد بالاحتيال، ولم تستطع تقديم تفسير منطقي للحسابات لأي شخص تلقى الرسالة. وفي وقت لاحق، وصفت لجنة ملكية المخطط بأنه غير قانوني. سددت الحكومة 1.7 مليار دولار أسترالي بالإضافة إلى 112 مليون دولار أسترالي أخرى كتعويض. العبرة: لا يشترط أن يكون النظام متطورًا تقنيًا ليكون صندوقًا أسود، بل يكفي أن يكون غير خاضع للمساءلة.

تُعدّ قضية "توسلاجين أفيير" الهولندية ومشروع "سيري" (SyRI) بمثابة خاتمة أوروبية. ففي 5 فبراير/شباط 2020، أمرت محكمة هولندية بالوقف الفوري لمشروع "سيري"، معتبرةً أن غموضه ينتهك المادة 8 من الاتفاقية الأوروبية لحقوق الإنسان. وقد طالت فضيحة إعانات رعاية الأطفال المرتبطة بها أكثر من 20 ألف أب وأم اتُهموا زوراً بالاحتيال. واستقالت حكومة روته على إثر ذلك في يناير/كانون الثاني 2021. ويُعتبر هذا الحكم الآن مرجعاً أساسياً في دوائر السياسة الأوروبية لتوضيح أن الذكاء الاصطناعي غير الشفاف في بيئات بالغة الأهمية ليس مجرد قضية أخلاقية هامشية، بل قضية قانونية.

أربع حالات. قطاعات مختلفة، تقنيات مختلفة، دول مختلفة. نفس النمط: نظام مبهم، قرار مصيري، وأشخاص متضررون لا يملكون وسيلة حقيقية للاعتراض.

مخاطر الذكاء الاصطناعي ذي الصندوق الأسود في أنظمة الذكاء الاصطناعي في العالم الحقيقي

بمجرد البدء في تصنيف مخاطر الذكاء الاصطناعي ذات الصندوق الأسود في أنظمة الذكاء الاصطناعي الواقعية، يظهر نمط معين. تتكرر نفس المخاطر الخمسة مرارًا وتكرارًا، بغض النظر عما إذا كان النموذج عبارة عن مقيّم ائتماني، أو روبوت محادثة، أو نظام تداول خوارزمي.

| مخاطرة | كيف يبدو | لماذا يمكن توسيع نطاقها |

|---|---|---|

| التحيز الخفي | يعامل النموذج المجموعات المحمية بشكل مختلف | تحمل بيانات التدريب أنماطًا تاريخية |

| هلوسة | النموذج يختلق الحقائق أو الاستشهادات | يركز برنامج ماجستير القانون على الطلاقة، وليس على الحقيقة. |

| التعلم المختصر | يعتمد النموذج على ارتباطات غير ذات صلة | أسهل في التعلم من المفهوم الحقيقي |

| الهشاشة العدائية | تغيير بسيط في المدخلات يقلب المخرجات | حدود القرار عالية الأبعاد |

| تفاصيل التدقيق | لا يمكن إعادة بناء السبب | لا توجد حالة داخلية قابلة للتفسير |

تتفاقم هذه المخاطر في أنظمة الذكاء الاصطناعي ذات الصندوق الأسود المستخدمة في مجالات التمويل والتوظيف والرعاية الصحية والعملات الرقمية. فعمليات التعلم العميق المعقدة داخلها تجعل من الصعب التنبؤ بمكان حدوث الفشل التالي، كما أن أدوات الذكاء الاصطناعي التقليدية لضمان الجودة لم تُصمم للتعامل مع نماذج تحتوي على مئات المليارات من المعاملات.

يحظى التحيز الخفي باهتمام إعلامي واسع، لكن هشاشة النظام أمام الهجمات الإلكترونية وفشل عمليات التدقيق هما المشكلتان الأكبر على المدى الطويل. يمكن على الأقل قياس التحيز المستقر وتصحيحه. أما النموذج الذي يفشل بشكل مختلف في كل مرة يتم تشغيله (كما هو الحال مع ChatGPT، في حوالي 42% من مهام تقييم العقود الذكية وفقًا لدراسة أجرتها ACM TOSEM عام 2024) فيصعب اعتماده للاستخدام الخاضع للتنظيم.

أحدث المنضمين إلى هذه القائمة هو ما يسميه الباحثون "مخاطر الذكاء الاصطناعي الوكيل". فعندما يتم ربط نموذج التعلم الآلي بالأدوات، وتزويده بالذاكرة، والسماح له باستدعاء واجهات برمجة التطبيقات، يتضاعف الغموض. يصبح القرار الواحد سلسلة من استدعاءات النموذج، والمستندات المسترجعة، واستدعاءات الأدوات، وكل منها غامض جزئيًا. الوكلاء المعاصرون عبارة عن صناديق سوداء داخل صناديق سوداء.

الذكاء الاصطناعي ذو الصندوق الأسود في العملات المشفرة والتكنولوجيا المالية

من بين جميع الصناعات التي تستخدم الذكاء الاصطناعي ذي الصندوق الأسود، تُعدّ العملات الرقمية والتكنولوجيا المالية من أكثر المجالات التي تتصادم فيها جوانب التطبيق والمخاطر. المخاطر كبيرة، والوقت قصير، والإفصاح محدود، واللوائح التنظيمية، وخاصة في مجال العملات الرقمية، لا تزال غير مكتملة. والنتيجة هي بيئة تُشجع على التطبيق أولاً ثم كتابة الوثائق لاحقاً.

التداول الخوارزمي. ساهم التداول الخوارزمي بنسبة تتراوح بين 70 و80% من حجم تداول العملات الرقمية في عام 2025، وهي نسبة أعلى من النسبة المسجلة في أسواق الأسهم الرئيسية والتي تتراوح بين 60 و70%. فعلى سبيل المثال، تُجري منصة Wintermute وحدها عمليات تداول تتجاوز 15 مليار دولار أمريكي عبر أكثر من 60 منصة تداول يوميًا، مع تسجيل رقم قياسي بلغ 2.24 مليار دولار أمريكي في يوم واحد عام 2025. وتعتمد الاستراتيجيات الكامنة وراء هذه التدفقات على أنظمة تعلم عميق يصعب على أي مراقب خارجي مراجعتها. ويُعد انهيار Alameda/FTX في نوفمبر 2022 خير مثال على هذا الخطر: فقد انخفضت القيمة السوقية الإجمالية للعملات الرقمية من أكثر من تريليون دولار أمريكي إلى أقل من 800 مليار دولار أمريكي في غضون شهر تقريبًا، وكان مبلغ 14.6 مليار دولار أمريكي المُدرج في ميزانية Alameda غير مرئي حتى لحظة ظهوره.

تقييم مكافحة غسل الأموال ومعرفة العميل. بلغ حجم سوق برامج مكافحة غسل الأموال العالمي 4.13 مليار دولار أمريكي في عام 2025، ومن المتوقع أن يصل إلى 9.38 مليار دولار أمريكي بحلول عام 2030 (MarketsandMarkets). ويشهد الامتثال لقوانين مكافحة غسل الأموال ومعرفة العميل في مجال العملات الرقمية نموًا ملحوظًا بمعدل نمو سنوي مركب قدره 13.8%. وتستخدم شركات مثل ComplyAdvantage وChanalysis Reactor وElliptic Navigator نماذج التعلم الآلي ذات الصندوق الأسود لتقييم مخاطر المحافظ الرقمية. ويُعد استخدام هذه النماذج واسع الانتشار وفعالًا بما يكفي لتطبيقها في معظم منصات التداول الرئيسية، كما أنها تتسم بالغموض لدرجة أن مسؤولي الامتثال غالبًا ما يعجزون عن تحديد سبب حظر محفظة معينة.

تدقيق العقود الذكية. هنا تظهر حدود الذكاء الاصطناعي بوضوح. قيّمت دراسة نُشرت عام 2024 على موقع arXiv نموذج GPT-4 في الكشف عن ثغرات العقود الذكية. حقق النموذج دقة بلغت 96.6%، لكن نسبة استرجاعه لم تتجاوز 37.8%، ما يعني إغفاله ما يقارب ثلثي الثغرات الحقيقية. كما أن مخرجات ChatGPT غير مستقرة في 42% من العقود (ACM TOSEM 2024). أما الأدوات الهجينة مثل GPTScan، التي تجمع بين GPT والتحليل الثابت، فتتجاوز دقتها 90% ونسبة استرجاعها 70% تقريبًا في عقود الرموز (arXiv 2308.03314). يراقب CertiK Skynet حاليًا أكثر من 17,000 مشروع بقيمة سوقية تقارب 494 مليار دولار، لكن لا يزال كل فريق تدقيق مسؤول يُشرك الذكاء الاصطناعي مع مُراجع بشري.

المستشارون الآليون. تدير شركة Betterment أكثر من 56 مليار دولار أمريكي موزعة على أكثر من 900 ألف حساب. أما شركة Wealthfront فتدير 42.9 مليار دولار أمريكي. وقد تجاوز حجم الأصول المُدارة عالميًا في قطاع المستشارين الآليين تريليون دولار أمريكي. وتعتمد عمليات إعادة توازن المحافظ، وجني الخسائر الضريبية، وتقييم المخاطر، جميعها على نماذج التعلم الآلي التي لا تُفصح عن تفاصيل قراراتها في أي وثيقة موجهة للأفراد.

تقييم الجدارة الائتمانية وكشف الاحتيال. يستخدم 90% من المقرضين في الولايات المتحدة نظام FICO، ويعالج نظام FICO Falcon أكثر من 65 مليار معاملة سنويًا بمعدلات كشف احتيال تتجاوز 95%. أظهرت دراسة أجراها بنك إنجلترا عام 2024 على 50 مؤسسة بريطانية أن نماذج مخاطر الائتمان القائمة على التعلم الآلي قللت من حالات التصنيف الخاطئ بنحو 25% مقارنةً بالانحدار اللوجستي. إن تحسن الدقة حقيقي. لكن في المقابل، وبموجب تعميمي مكتب الحماية المالية للمستهلك رقم 2022-03 و2023-03، لا يمكن للمقرضين الأمريكيين استخدام نماذج مبهمة بما يكفي لمنع تفسيرات محددة للإجراءات السلبية بموجب قانون تكافؤ فرص الائتمان.

النمط نفسه يتكرر في النماذج الخمسة جميعها. النموذج أكثر دقة من النموذج الأساسي الشفاف. إن الغموض مرتبطٌ ارتباطًا وثيقًا بالدقة. والجهات التنظيمية تواكب التطورات بوتيرة أسرع من أدوات التفسير.

ملاحظة حول الذكاء الاصطناعي ذي الصندوق الأسود: ماجستير قانون البرمجة

توضيح سريع: عندما يبحث المستخدمون عن "الذكاء الاصطناعي ذي الصندوق الأسود"، فإنهم غالبًا ما يقصدون المشكلة المفاهيمية التي تتناولها هذه المقالة. وفي بعض الأحيان، يقصدون شركة Blackbox AI، ومقرها blackbox.ai. Blackbox.ai عبارة عن منصة برمجية مصممة لإحداث نقلة نوعية في طريقة كتابة المطورين للبرامج. يتكامل هذا المنتج مع VS Code كمساعد برمجي، ويقترح أكوادًا، وينافس أدوات مثل Claude Code وGitHub Copilot وCursor. يُعد Blackbox من أبرز تقنيات الذكاء الاصطناعي المتقدمة في مجال برمجة الذكاء الاصطناعي، وهو مبني على نماذج ذكاء اصطناعي متعددة، وتغطي الأكواد التي يقترحها Blackbox كل شيء بدءًا من إعادة هيكلة الكود وصولًا إلى إنشاء هياكل الاختبار. يدمج Blackbox توليد الأكواد والدردشة والبحث في سير عمل واحد، ويصفه معظم المستخدمين بأنه أفضل مساعد ذكاء اصطناعي جربوه داخل محرر النصوص الخاص بهم.

غالبًا ما يختلط المعنيان في نتائج البحث. منتج Blackbox AI ليس موضوع هذه المقالة. نحن نتناول الخصائص البنيوية لأنظمة الذكاء الاصطناعي المبهمة، وليس أي مساعد برمجة بعينه. إذا كنت تبحث عن المنتج، فستجد وثائقه وأسعاره الخاصة لدى الشركة. أما إذا كنت تبحث عن المفهوم، فتابع القراءة.

أدوات الذكاء الاصطناعي القابل للتفسير وأدوات التفسير

الذكاء الاصطناعي القابل للتفسير، أو اختصارًا XAI، هو مجال يسعى إلى تبسيط نماذج الذكاء الاصطناعي المعقدة دون المساس بدقتها. وهو سوق حقيقي بالفعل، إذ تتراوح التوقعات لعام 2026 بين 9 و13 مليار دولار أمريكي عالميًا، مع اختلاف طفيف بحسب تعريف XAI المعتمد. الهدف هو جعل نماذج الذكاء الاصطناعي أكثر قابلية للتفسير دون إجبار الفرق على العودة إلى نماذج أبطأ أو أقل دقة. تقوم الفرق المتميزة بتشغيل هذه الأدوات على أدوات الذكاء الاصطناعي قبل إطلاقها، وتُرفق النتائج بوثائق يسهل على المراجع البشري قراءتها.

هناك ثلاث عائلات من تقنيات XAI تستحق المعرفة.

أولها SHAP، اختصارًا لـ SHapley Additive exPlanations. وهي مستوحاة من نظرية الألعاب التعاونية: لكل تنبؤ، تُخصص SHAP درجة مساهمة لكل خاصية مُدخلة. فرق تقييم الجدارة الائتمانية تُفضلها، وفرق كشف الاحتيال تُفضلها أيضًا، بينما يتحملها مُصممو نماذج مخاطر الرعاية الصحية. SHAP دقيقة نظريًا، لكنها تُشكل عبئًا حسابيًا كبيرًا على البيانات الجدولية الضخمة.

أما الثاني فهو LIME، وهو اختصار لـ Local Interpretable Model-agnostic Explanations. يبني LIME نموذجًا بديلًا بسيطًا وقابلًا للتفسير حول تنبؤ واحد، ويستخدمه لتفسير التنبؤ الأصلي. وهو أسرع من SHAP، ويعمل على النصوص والصور والجداول. لكن المشكلة تكمن في أن LIME مصمم ليكون محليًا، لذا قد يُضلل المستخدم إذا افترض أن تفسيرًا واحدًا يُعمم النتائج.

أما النوع الثالث فهو التفسيرات الافتراضية. فبدلاً من شرح سبب موافقة النموذج، تُبيّن التفسيرات الافتراضية أصغر تغيير في المدخلات كان من شأنه أن يُغيّر الإجابة إلى الرفض. وهذا تحديداً ما يرغب طالب الائتمان أو المعاملة المُعلّمة بمعرفته: "ما الذي عليّ تغييره؟". وتكتسب التفسيرات الافتراضية رواجاً سريعاً في إشعارات الإجراءات السلبية تحديداً لأنها تتوافق تماماً مع توقعات الجهات التنظيمية.

إلى جانب هذه العناصر الثلاثة، ستجد مخططات أهمية الميزات، وتصور الانتباه لطبقات المحولات، وGrad-CAM لمصنفات الصور. ويُعدّ التفسير الآلي، أي الهندسة العكسية للخلايا العصبية ودوائر الانتباه، من أحدث التقنيات في هذا المجال. وقد نشرت كلٌّ من Anthropic وOpenAI وعدد قليل من المختبرات الأكاديمية دوائر جزئية، لكن هذا العمل لم يُترجم بعد إلى منتج يُمكن لفريق الامتثال في المؤسسات استخدامه.

كن صادقًا بشأن النتائج النهائية. تشير الأبحاث الصناعية التي نشرتها شركة بالو ألتو نتوركس وغيرها إلى أن الذكاء الاصطناعي القابل للتفسير (XAI) يعمل بكفاءة مع مصنفات الصور والنماذج الجدولية المنظمة، ولكنه يعمل جزئيًا فقط مع نماذج اللغة. يتغير المنطق داخل نموذج اللغة بتغير موضع الرمز المميز ونافذة السياق، لذا قد تُضلل درجات إسناد الميزات بطرق لا يُشير إليها الشرح نفسه. تُعد أدوات التفسير التي تُشارك شفرتها البرمجية الأساسية مفيدة، لكنها ليست حلاً نهائيًا لمشكلة الصندوق الأسود.

تنظيم الذكاء الاصطناعي ذي الصندوق الأسود: قانون الاتحاد الأوروبي للذكاء الاصطناعي، المعهد الوطني للمعايير والتكنولوجيا، مكتب الحماية المالية للمستهلك

لم يتوقع معظم موردي الذكاء الاصطناعي أن تتحرك الجهات التنظيمية بهذه السرعة، لكنها فعلت. إن نهج "الإطلاق الآن، والتوثيق لاحقًا" القديم في طريقه إلى الزوال، ويعود السبب في ذلك إلى عدد قليل من القواعد.

سبقت أوروبا الجميع بإصدار قانون الذكاء الاصطناعي للاتحاد الأوروبي. ويُطبّق هذا القانون تدريجيًا على مدار الفترة من 2025 إلى 2027، وليس دفعة واحدة. أصبحت الممارسات المحظورة سارية المفعول اعتبارًا من 2 فبراير 2025، ودخلت قواعد الذكاء الاصطناعي العامة حيز التنفيذ في 2 أغسطس 2025. أما التزامات الأنظمة عالية المخاطر فتبدأ في 2 أغسطس 2026، بينما يُطبّق توسيع نطاق المنتجات الخاضعة للتنظيم بعد عام، أي في 2 أغسطس 2027. والغرامات ليست رمزية، إذ تبلغ 35 مليون يورو أو 7% من إجمالي الإيرادات العالمية لأخطر الانتهاكات، و15 مليون يورو أو 3% لبقية الانتهاكات (DLA Piper، 2025). وتشمل قائمة حالات الاستخدام عالية المخاطر مجموعة واسعة من التطبيقات المعقدة: تقييم الجدارة الائتمانية، والتوظيف، والتعليم، وإنفاذ القانون، والهوية البيومترية. ويتطلب كل منها الآن توثيقًا وشفافية وإشرافًا بشريًا بشكل افتراضي.

الوضع في الولايات المتحدة أكثر تعقيدًا، ولكنه يسير في الاتجاه نفسه. يُعدّ إطار إدارة مخاطر الذكاء الاصطناعي الصادر عن المعهد الوطني للمعايير والتكنولوجيا (NIST) أقرب ما يكون إلى معيار أمريكي. صدر هذا الإطار في يناير 2023، وتم توسيعه ليشمل عامي 2024 و2025، وأصبح تدريجيًا المرجع الذي تعتمده الشركات الكبرى لتحديد مدى التزامها التقني به. وفي ديسمبر 2025، أصدر المعهد الوطني للمعايير والتكنولوجيا (NIST) مسودة IR 8596، وهي المسودة الأولية لملف تعريف الذكاء الاصطناعي السيبراني، مع ورشة عمل لاحقة في 14 يناير 2026. وقد بدأت العديد من الفرق بالفعل في تبنيه.

كان مكتب حماية المستهلك المالي أكثر صراحةً. فقد نصّت التعميمات 2022-03 و2023-03 على ذلك بوضوح: لا يجوز للدائن استخدام خوارزمية معقدة إذا كان تعقيدها يمنعه من تقديم الأسباب المحددة لاتخاذ إجراء سلبي بموجب قانون تكافؤ فرص الائتمان (ECOA) واللائحة (ب). اقرأ ذلك بعناية. إنه ليس حظرًا على استخدام التعلم الآلي في الإقراض، بل هو حظر على استخدام التعلم الآلي المبهم لدرجة أنه لا يمكنك إخبار مقدم الطلب المرفوض بما ارتكبه من خطأ. وهذا، في الواقع، حظرٌ مبهمٌ على الائتمان الاستهلاكي.

تواجه البنوك متطلباً أقدم ولكنه لا يزال أكثر صرامة. إذ يُلزم قرار مجلس الاحتياطي الفيدرالي رقم 11-7، الساري منذ عام 2011، البنوك بإثبات فهمها لأي نموذج يُستخدم في اتخاذ قرار جوهري. وتواجه أنظمة التعلم العميق الحديثة صعوبة في تجاوز هذا الشرط دون مساعدة، كما أن نشرة مكتب مراقب العملة رقم 2011-12 تُطبّق النهج نفسه.

النتيجة النهائية: لم يعد لدى أي جهة خاضعة للتنظيم في الولايات المتحدة أو الاتحاد الأوروبي أي مبرر لاعتبار الغموض حلاً وسطاً مقبولاً مقابل الدقة. إما أن تُدمج قابلية التفسير في التصميم منذ المراجعة الأولى، أو أن يتم بناء نظام هجين حيث يتولى الإنسان شرح ما لا يستطيع النموذج تقديمه. لا يوجد خيار ثالث يصمد أمام إجراءات الإنفاذ.

كيفية تدقيق نظام الذكاء الاصطناعي ذي الصندوق الأسود

إذن، كيف سيبدو النشر المسؤول لنظام الذكاء الاصطناعي ذي الصندوق الأسود في عام 2026؟ إن الدليل العملي أقصر مما يدعيه البائعون.

تبدأ بالبيانات. وثّق مصدر بيانات التدريب، ومن قام بتصنيفها، والمجموعات الفرعية المُمثلة فيها. نصف مشاكل التحيز التي ستواجهها لاحقًا مُضمنة هنا، والنصف الآخر الذي لا يمكنك تتبعه هو النصف الذي لا يمكنك إصلاحه.

ثم تقوم باختبار النموذج باستخدام فريق اختبار الاختراق. اختبره بمدخلات معادية، وحقن بيانات فورية، وحالات استثنائية، وأمثلة خارجة عن التوزيع. تنشر الآن كل من أنثروبيك، وأوبن إيه آي، ومايكروسوفت أدلة إرشادية لهذا العمل يمكنك تكييفها دون الحاجة إلى ابتكار منهجية جديدة.

طبّق تقنية الذكاء الاصطناعي القابل للتفسير (XAI) على جميع النماذج المستخدمة في الإنتاج، وليس فقط النماذج الرئيسية. استخدم SHAP لمعالجة البيانات الجدولية. استخدم LIME لمعالجة النصوص والصور. استخدم التحليلات الافتراضية لأي قرار يعود إلى المستخدم. لا توجد أداة مثالية من بين هذه الأدوات، ولكن غيابها يُعدّ مؤشرًا سلبيًا لأي مدقق يراجع نظامك.

انتبه للانحرافات. تصبح النماذج قديمة أسرع مما تتوقع معظم الفرق. تتبع توزيعات المدخلات، وتوزيعات المخرجات، والنتائج اللاحقة. فعّل التنبيهات لكل منها، وتعامل مع التحولات غير المبررة على أنها حوادث، وليست مجرد فضول.

أنشئ مسار التصعيد قبل الحاجة إليه. يجب أن يتضمن كل قرار مهم في النموذج آلية للتدخل البشري وقناة استئناف موثقة يمكن للعميل استخدامها فعليًا. إذا كان فريق الدعم هو قناة الاستئناف، فدوّن ذلك أيضًا.

أخيرًا، حدد الإطار الذي ينطبق عليك. إطار إدارة مخاطر الذكاء الاصطناعي الصادر عن المعهد الوطني للمعايير والتكنولوجيا (NIST AI RMF) إذا كنت في الولايات المتحدة. متطلبات قانون الذكاء الاصطناعي للاتحاد الأوروبي (EU AI Act) للمخاطر العالية إذا كنت في أوروبا. تعميمات مكتب الحماية المالية للمستهلك (CFPB) رقم 2022-03 و2023-03 إذا كنت تتعامل مع الائتمان الاستهلاكي. القيام بذلك مبكرًا وبمُسبقًا أقل تكلفة بكثير من التعديل اللاحق بعد تلقيك إجراءات إنفاذ القانون.

لن تتمكن من إزالة الصندوق الأسود، وهذا أمر طبيعي. المهم هو جعله قابلاً للمراقبة والمساءلة والتحديد. هذا هو المعيار الذي يطبقه المنظمون بالفعل، وهو ما سيبدو عليه التطبيق الناضج بحلول عام 2026.