Apa Itu AI Kotak Hitam? Penjelasan Masalah Kotak Hitam

Pada April 2026, papan peringkat halusinasi Vectara memberikan vonis yang kurang menyenangkan. Model bahasa teratas sekarang mengalami halusinasi kurang dari 4% dari waktu pada tes intinya. Tetapi varian "penalaran" baru dari GPT-5, Claude Sonnet 4.5, Grok-4, dan Gemini-3-Pro semuanya mengalami halusinasi lebih dari 10% pada dataset baru. Grok-4-fast-reasoning mencapai 20,2%. Model-model terpintar, yang "berpikir" sebelum menjawab, adalah yang terburuk dalam memberi tahu Anda ketika mereka tidak tahu.

Itulah masalah kotak hitam dalam satu paragraf. Kita telah membangun sistem AI yang sering menghasilkan keluaran yang bermanfaat dan yang tidak seorang pun, termasuk penciptanya, dapat sepenuhnya menjelaskannya. Sistem tersebut tepat tanpa dikalibrasi, lancar tanpa jujur, dan percaya diri tanpa benar.

Regulator telah memperhatikan hal ini. Undang-Undang AI Uni Eropa kini mengenakan denda hingga EUR 35 juta atau 7% dari omset global untuk penggunaan yang dilarang, dengan aturan sistem berisiko tinggi yang mulai berlaku pada 2 Agustus 2026. Biro Perlindungan Konsumen Keuangan AS secara tegas menyatakan kepada bank bahwa mereka tidak dapat menggunakan algoritma kompleks jika algoritma tersebut menghalangi mereka untuk menjelaskan penolakan kredit. Dan bidang AI yang dapat dijelaskan, yang merupakan topik khusus lima tahun lalu, kini menjadi pasar yang diperkirakan bernilai antara $9 miliar dan $13 miliar pada tahun 2026.

Panduan ini akan membahas apa sebenarnya AI kotak hitam itu, mengapa bahkan model AI yang tampak sederhana pun menjadi kotak hitam, apa yang salah ketika hal itu terjadi, di mana mereka muncul di dunia kripto dan fintech, bagaimana toolkit AI yang dapat dijelaskan (SHAP, LIME, counterfactuals) mencoba untuk memecahkannya, dan apa yang perlu Anda ketahui tentang rezim regulasi baru di Uni Eropa dan AS. Ada juga sedikit penjelasan untuk mengklarifikasi kebingungan yang berulang: Blackbox AI, asisten pengkodean di blackbox.ai, adalah hal yang berbeda.

Apa Itu AI Kotak Hitam dan Mengapa Itu Penting?

AI kotak hitam merujuk pada sistem AI apa pun yang penalaran internalnya tidak terlihat oleh pengguna dan, seringkali, oleh pengembang yang membangunnya. Input dan output terlihat. Jalur di antara keduanya tersembunyi di dalam lapisan bobot, pola yang dipelajari, dan transformasi pembelajaran mesin yang tidak dapat sepenuhnya dipahami oleh manusia. Hal yang sama berlaku apakah model tersebut menangani data tabular, gambar, atau tugas pemrosesan bahasa alami seperti terjemahan dan obrolan.

Istilah ini lebih tua daripada pembelajaran mendalam modern. Para insinyur telah menggunakan istilah "kotak hitam" setidaknya sejak tahun 1960-an untuk sistem apa pun yang dapat Anda periksa dari luar tetapi tidak dapat Anda buka sekrupnya. Otak manusia sendiri, menurut para ahli biologi, juga merupakan kotak hitam, tetapi perbandingan ini hanya berlaku sampai batas tertentu: AI tidak bekerja seperti manusia, dan menganggapnya demikian adalah salah satu cara tercepat untuk salah menilai apa yang dimaksud dengan AI kotak hitam. Yang berubah dalam dekade terakhir adalah skalanya. Model bahasa besar modern dapat membawa ratusan miliar parameter. Jaringan saraf dalam yang khas menyebarkan "pengetahuan" di ribuan lapisan dan jutaan kepala perhatian, dengan neuron tunggal mengkodekan banyak pola yang tidak terkait sekaligus. Para peneliti menyebut sifat terakhir ini sebagai polisemantisitas, dan ini adalah salah satu alasan mengapa interpretasi mekanistik masih dalam tahap awal.

Mengapa orang di luar laboratorium penelitian harus peduli? Karena AI kotak hitam sekarang mendorong keputusan-keputusan penting. Ia menyetujui dan menolak kredit. Ia memberi skor kepada terdakwa. Ia menandai transaksi sebagai penipuan. Ia menjalankan sebagian besar volume perdagangan di setiap bursa kripto utama. Ketika ia melakukan kesalahan, ketidaktransparansiannya membuat hampir mustahil untuk mengetahui alasannya, memperbaikinya, atau meminta pertanggungjawaban siapa pun.

Hal ini juga penting karena tata kelola AI tidak lagi menganggap ketidaktransparansian sebagai masalah pengembang. Uni Eropa sekarang menganggapnya sebagai masalah akses pasar. Regulator AS menganggapnya sebagai masalah pemberian pinjaman yang adil. Setiap eksekutif yang telah menyetujui inisiatif AI sejak tahun 2024 telah menghadapi kendala yang sama: apa sebenarnya yang dilakukan oleh hal ini, dan mengapa? Memahami AI kotak hitam bukan lagi pilihan, dan Anda tidak dapat menyelesaikan masalah kotak hitam hanya dengan menggunakan vendor yang berbeda.

Mengapa Model AI Menjadi Kotak Hitam

Tidak semua AI adalah kotak hitam. Pohon keputusan sederhana sepenuhnya transparan. Model regresi linier menghasilkan koefisien yang dapat Anda baca. Bahkan sistem AI berbasis aturan dari tahun 1990-an, pada prinsipnya, dapat diaudit baris demi baris.

Jadi, bagaimana model AI saat ini bisa menjadi kotak hitam? Hal ini terjadi karena empat alasan yang saling tumpang tindih.

Pertama, skala. Model pembelajaran mendalam dengan jutaan atau miliaran parameter beroperasi di ruang berdimensi tinggi yang tidak dapat divisualisasikan oleh manusia. Anda dapat menggambarkan model dengan 200 miliar parameter dalam matematika, tetapi tidak ada yang dapat membayangkannya dalam pikiran mereka.

Kedua, representasi terdistribusi. Dalam jaringan saraf dalam, tidak ada satu neuron pun yang menyimpan "konsep kucing" atau "aturan untuk menolak pinjaman." Konsep-konsep tersebar di ribuan neuron, dan neuron individual berpartisipasi dalam banyak konsep secara bersamaan. Menemukan penjelasan yang jelas adalah proyek penelitian, bukan sekadar pertanyaan.

Ketiga, ketergantungan pada data pelatihan. Perilaku model dibentuk oleh data pelatihannya, yang biasanya bersifat rahasia, sangat besar, dan terkadang bermasalah secara hukum. Bahkan ketika pengembang mempublikasikan bobot model, data tersebut jarang dibagikan. Jadi, bagian penting dari "mengapa" hilang.

Keempat, niat. Ada alasan praktis untuk menggunakan pendekatan kotak hitam secara sengaja. Beberapa pengembang dan pemrogram AI sengaja menyembunyikan internal model untuk melindungi kekayaan intelektual, dan alasan lain untuk menggunakan desain kotak hitam termasuk ketentuan lisensi dan keunggulan kompetitif. Bahkan model bobot terbuka pun secara efektif dapat membuat kotak hitam di sekitar keputusannya, karena sebagian besar model modern bergantung pada pola yang muncul yang tidak terdokumentasi. Perusahaan yang telah menginvestasikan $100 juta dalam sebuah model tidak ingin mempublikasikan arsitektur dan prosedur pelatihannya. Model AI sumber terbuka yang membagikan kode dasarnya pada akhirnya juga merupakan kotak hitam, karena pengguna tetap tidak dapat memeriksa bobot yang dipelajari dengan interpretasi yang berarti.

Akibatnya, bahkan model AI canggih yang tampaknya sederhana, termasuk LLM dan model AI generatif, secara default menjadi kotak hitam. Model transparan adalah pengecualian, bukan aturan. Kotak hitam yang kompleks dapat memberikan akurasi yang mengesankan, itulah sebabnya tim terus menerapkannya meskipun kurang transparan. Hal yang sama berlaku untuk model AI kotak hitam yang dilatih pada data yang kaya dan berantakan: peningkatan dibandingkan model AI berbasis aturan seringkali cukup besar untuk mengesampingkan kekhawatiran tentang kemampuan menjelaskan hingga terjadi kesalahan. Sebagian besar AI kotak hitam modern pada akhirnya adalah kotak hitam karena pengguna masih tidak dapat memeriksa bobot yang dipelajari. Model bobot terbuka membagikan kode dasarnya, dan pengguna dapat membaca arsitekturnya, tetapi kode dasarnya pada akhirnya adalah kotak hitam ketika Anda bertanya "mengapa model mengatakan itu".

Masalah Kotak Hitam dalam Pembelajaran Mendalam

Masalah kotak hitam adalah apa yang Anda dapatkan ketika keempat alasan tersebut saling berkaitan. Model ini bekerja, seringkali sangat mengesankan. Tetapi cara kerjanya menolak tiga hal sekaligus: penjelasan, validasi, dan koreksi.

Ambil contoh klasik: sebuah model pembelajaran mendalam yang dilatih untuk mengidentifikasi panda. Model ini mendapatkan skor 99% pada set data uji. Kelihatannya bagus. Kemudian seseorang menjalankan alat interpretasi dan menemukan bahwa model tersebut sebenarnya tidak benar-benar memperhatikan panda. Model tersebut memperhatikan bambu. Sebagian besar foto panda dalam data pelatihan juga mengandung bambu. Model tersebut mempelajari jalan pintas. Pada foto panda tanpa bambu, model tersebut gagal.

Jenis "pembelajaran jalan pintas" ini ada di mana-mana dalam pembelajaran mendalam. Model menemukan keteraturan statistik yang tidak sesuai dengan konsep dasarnya, tetapi Anda hanya menyadarinya ketika dunia tampak sedikit berbeda dari himpunan data pelatihan. Krisis keuangan 2008 adalah analogi historis di sini. Model Value-at-Risk yang dibangun berdasarkan asumsi Gaussian bekerja dengan sangat baik di pasar normal dan meledak dalam kondisi ekstrem, karena mereka telah mempelajari jalan pintas yang tidak disadari oleh para pembuat model.

Model pembelajaran mendalam saat ini memiliki mode kegagalan yang sama persis, dengan lebih banyak parameter dan kepercayaan diri yang lebih tinggi. Para peneliti interpretasi mekanistik, termasuk tim di Anthropic dan OpenAI, telah mulai merekayasa balik bagian-bagian kecil dari model bahasa neuron demi neuron. Pekerjaan mereka menunjukkan bahwa bagian dalam LLM lebih mirip sirkuit yang saling terkait daripada logika yang rapi. Tidak ada titik di mana Anda dapat menunjuk dan mengatakan "di sinilah jawabannya berada." Masalah kotak hitam bukanlah bug yang perlu diperbaiki; itu bersifat struktural.

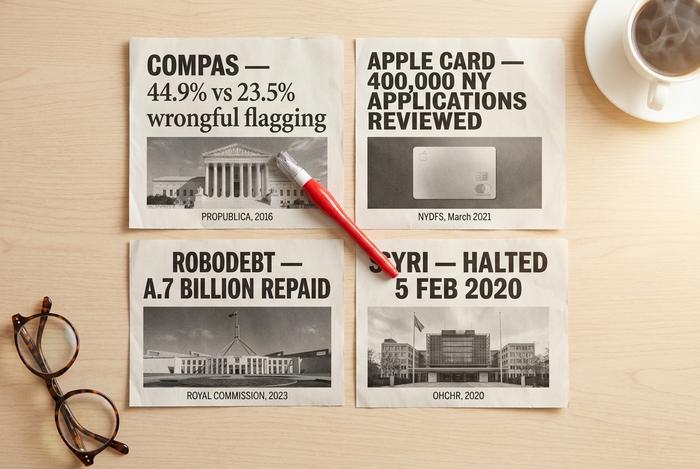

Contoh AI Kotak Hitam: COMPAS, Apple Card, Robodebt, SyRI

Ingin melihat seperti apa AI kotak hitam ketika gagal? Empat kasus yang terus-menerus dikutip ini memberi tahu Anda sebagian besar hal yang perlu Anda ketahui. Kasus-kasus ini mencakup bidang peradilan pidana, perbankan, dan kesejahteraan sosial. Semuanya merugikan orang-orang nyata. Dan tidak ada dua kasus yang gagal dengan cara yang sama persis.

Mari kita mulai dengan COMPAS. Northpointe membangunnya untuk memprediksi apakah seorang terdakwa akan melakukan pelanggaran lagi, dan pengadilan AS menerapkannya secara luas. Kemudian ProPublica meneliti lebih dalam. Audit mereka pada tahun 2016 menjalankan lebih dari 7.000 orang yang ditangkap di Broward County melalui data tersebut dan hasilnya mengerikan: Terdakwa kulit hitam secara salah ditandai sebagai berisiko tinggi dalam 44,9% kasus, sementara angka untuk terdakwa kulit putih hanya 23,5%. Sebuah makalah lanjutan tahun 2024 memperburuknya. Dua fitur (usia dan riwayat hukuman sebelumnya) sesuai dengan akurasi 137 fitur COMPAS. Jadi, kompleksitas tersebut secara harfiah tidak memberikan sinyal tambahan, tetapi membuat bias jauh lebih sulit untuk dideteksi. Itulah model kotak hitam kanonik yang mengevaluasi orang, bukan produk. Model kotak yang mengevaluasi pelamar kerja, yang dibatalkan Amazon pada tahun 2018, memiliki bentuk yang sama.

Kemudian Apple Card, akhir tahun 2019. Wozniak mengatakan istrinya mendapatkan batas kredit 10 kali lebih rendah daripada miliknya. David Heinemeier Hansson mengatakan hal yang sama. Kisah itu menjadi viral. Departemen Layanan Keuangan New York menanggapinya dengan serius: mereka memeriksa sekitar 400.000 aplikasi dan menelitinya. Maret 2021, mereka kembali dengan putusan bahwa tidak ada diskriminasi gender menurut undang-undang. Tetapi mereka juga menulis, dan ini bagian yang penting, bahwa ketidaktransparan pengalaman pelanggan merupakan masalah kepercayaan tersendiri. Kerugian akibat praktik kotak hitam, ternyata, setengahnya berkaitan dengan hasil dan setengahnya lagi tentang persepsi. Siaran pers tidak memperbaiki sisi persepsi.

Robodebt adalah sisi lain dari koin tersebut. Tidak ada jaringan saraf dalam yang terlibat. Australia menjalankan aturan rata-rata pendapatan terhadap catatan kesejahteraan antara tahun 2016 dan 2019, menuduh sekitar 400.000 penerima melakukan penipuan, dan tidak dapat menjelaskan perhitungan tersebut secara koheren kepada siapa pun yang menerima surat tersebut. Komisi Kerajaan kemudian menyatakan skema tersebut melanggar hukum. Pemerintah membayar kembali A$1,7 miliar ditambah A$112 juta lagi sebagai kompensasi. Pelajaran: sebuah sistem tidak perlu canggih secara teknis untuk menjadi kotak hitam. Sistem tersebut hanya perlu tidak dapat dipertanggungjawabkan.

Skandal penipuan di Belanda dan SyRI merupakan contoh nyata di Eropa. Pada 5 Februari 2020, pengadilan Belanda memerintahkan penghentian segera SyRI, dengan memutuskan bahwa ketidaktransparansiannya melanggar Pasal 8 Konvensi Hak Asasi Manusia Eropa. Skandal tunjangan penitipan anak yang terkait menyeret lebih dari 20.000 orang tua yang secara salah dituduh melakukan penipuan. Pemerintah Rutte mengundurkan diri karena hal itu pada Januari 2021. Putusan tersebut kini menjadi titik acuan standar di kalangan pembuat kebijakan Uni Eropa untuk menjelaskan mengapa AI yang tidak transparan dalam lingkungan berisiko tinggi bukanlah masalah etika yang ringan, melainkan masalah hukum.

Empat kasus. Sektor berbeda, teknologi berbeda, negara berbeda. Pola yang sama: sistem yang tidak transparan, keputusan yang berdampak besar, dan orang-orang yang menerima dampaknya tanpa cara nyata untuk melawan.

Risiko AI Kotak Hitam dalam Sistem AI Dunia Nyata

Begitu Anda mulai mengkatalogkan risiko AI kotak hitam dalam sistem AI dunia nyata, sebuah pola akan muncul. Lima risiko yang sama muncul berulang kali, terlepas dari apakah model tersebut adalah penilai kredit, chatbot, atau sistem perdagangan algoritmik.

| Mempertaruhkan | Beginilah penampakannya | Mengapa hal ini dapat diukur |

|---|---|---|

| Bias tersembunyi | Model ini memperlakukan kelompok yang dilindungi secara berbeda. | Data pelatihan mengandung pola historis. |

| Halusinasi | Model tersebut mengarang fakta atau kutipan. | Program LLM (Limited Liability Management) mengutamakan kefasihan, bukan kebenaran. |

| Pembelajaran jalan pintas | Model tersebut bergantung pada korelasi yang tidak relevan. | Lebih mudah dipelajari daripada konsep sebenarnya. |

| Kerapuhan yang bersifat antagonis | Perubahan kecil pada input dapat mengubah output. | Batas keputusan berdimensi tinggi |

| Rincian audit | Tidak dapat merekonstruksi alasannya. | Tidak ada keadaan internal yang dapat diinterpretasikan. |

Risiko-risiko ini semakin besar pada sistem AI kotak hitam yang digunakan di bidang keuangan, perekrutan, perawatan kesehatan, dan kripto. Proses pembelajaran mendalam yang kompleks di dalamnya membuat sulit untuk memprediksi di mana kegagalan berikutnya akan terjadi, dan alat AI tradisional untuk penjaminan mutu tidak dirancang untuk model dengan ratusan miliar parameter.

Bias tersembunyi memang menjadi sorotan utama, tetapi kerapuhan yang merugikan dan kegagalan audit adalah masalah jangka panjang yang lebih besar. Bias yang stabil setidaknya dapat diukur dan dikoreksi. Model yang gagal dengan cara berbeda setiap kali dijalankan (seperti yang dilakukan ChatGPT, pada sekitar 42% tugas evaluasi kontrak pintar menurut studi ACM TOSEM tahun 2024) jauh lebih sulit untuk disertifikasi untuk penggunaan yang diatur.

Pendatang terbaru dalam daftar ini adalah apa yang disebut para peneliti sebagai "risiko AI agenik." Ketika Anda menghubungkan LLM ke dalam alat, memberinya memori, dan membiarkannya memanggil API, Anda memperparah ketidaktransparansiannya. Satu keputusan kini menjadi rangkaian pemanggilan model, dokumen yang diambil, dan panggilan alat, yang masing-masing sebagian tidak transparan. Agen modern adalah kotak hitam di dalam kotak hitam.

AI Kotak Hitam di Kripto dan Fintech

Dari semua industri yang menggunakan AI kotak hitam, kripto dan fintech adalah tempat di mana sisi implementasi dan sisi risiko berbenturan paling keras. Taruhannya besar. Latensinya singkat. Pengungkapan informasinya minim. Regulasi, terutama di bidang kripto, masih tambal sulam. Hasilnya adalah lingkungan yang memberi penghargaan kepada implementasi terlebih dahulu dan penulisan dokumentasi setelahnya.

Perdagangan algoritmik. Perdagangan algoritmik mendorong sekitar 70-80% volume kripto pada tahun 2025, lebih tinggi daripada pangsa 60-70% di pasar ekuitas utama. Wintermute sendiri memindahkan lebih dari $15 miliar di lebih dari 60 tempat perdagangan setiap harinya, dengan volume harian tertinggi mencapai $2,24 miliar pada tahun 2025. Strategi di balik arus tersebut adalah kumpulan pembelajaran mendalam yang tidak dapat diaudit oleh pengamat luar. Keruntuhan Alameda/FTX pada November 2022 adalah ilustrasi paling jelas dari risiko tersebut: total kapitalisasi pasar kripto turun dari lebih dari $1 triliun menjadi kurang dari $800 miliar dalam waktu sekitar satu bulan, dan eksposur FTT sebesar $14,6 miliar pada neraca Alameda tidak terlihat sampai saatnya terungkap.

Penilaian AML dan KYC. Pasar perangkat lunak anti pencucian uang global mencapai $4,13 miliar pada tahun 2025 dan diperkirakan mencapai $9,38 miliar pada tahun 2030 (MarketsandMarkets). Kepatuhan AML/KYC kripto khususnya tumbuh dengan CAGR 13,8%. Vendor seperti ComplyAdvantage, Chainalysis Reactor, dan Elliptic Navigator kini menggunakan model pembelajaran mesin black box untuk penilaian risiko dompet. Penggunaan pembelajaran mesin black box di sini cukup luas dan efektif untuk diterapkan di sebagian besar bursa utama, dan cukup buram sehingga petugas kepatuhan seringkali tidak dapat merekonstruksi mengapa dompet tertentu diblokir.

Audit kontrak pintar. Di sinilah keterbatasan AI terlihat jelas. Sebuah studi arXiv tahun 2024 mengevaluasi GPT-4 pada deteksi kerentanan kontrak pintar. Hasilnya mencapai presisi 96,6% tetapi hanya 37,8% recall, melewatkan hampir dua pertiga dari kelemahan sebenarnya. Output ChatGPT tidak stabil di seluruh proses pada 42% kontrak (ACM TOSEM 2024). Alat hibrida seperti GPTScan, yang menggabungkan GPT dengan analisis statis, melampaui presisi 90% dan ~70% recall pada kontrak token (arXiv 2308.03314). CertiK Skynet sekarang memantau lebih dari 17.000 proyek dan sekitar $494 miliar nilai pasar, tetapi setiap tim audit yang bertanggung jawab masih menggabungkan AI dengan peninjau manusia.

Robo-advisor. Betterment mengelola lebih dari $56 miliar di lebih dari 900.000 akun. Wealthfront mengelola $42,9 miliar. Industri robo-advisor telah melampaui $1 triliun dalam AUM global. Penyeimbangan ulang portofolio, pengurangan kerugian pajak, dan penilaian risiko semuanya didorong oleh model ML yang keputusan spesifiknya tidak diungkapkan dalam dokumen apa pun yang ditujukan untuk investor ritel.

Penilaian kredit dan deteksi penipuan. FICO digunakan oleh 90% pemberi pinjaman di AS, dan FICO Falcon memproses lebih dari 65 miliar transaksi per tahun dengan tingkat deteksi penipuan yang dilaporkan lebih dari 95%. Sebuah studi Bank of England terhadap 50 lembaga di Inggris pada tahun 2024 menemukan bahwa model risiko kredit berbasis pembelajaran mesin (ML) mengurangi kesalahan klasifikasi sekitar 25% dibandingkan dengan regresi logistik. Peningkatan akurasi ini nyata. Namun, konsekuensinya adalah, berdasarkan Surat Edaran CFPB 2022-03 dan 2023-03, pemberi pinjaman di AS tidak dapat menggunakan model yang cukup buram untuk mencegah penjelasan tindakan merugikan tertentu berdasarkan ECOA.

Pola di kelima hal tersebut sama. Model ini lebih akurat daripada model dasar yang transparan. Opasitas secara struktural tidak dapat dipisahkan dari akurasi. Dan regulator mengejar ketertinggalan lebih cepat daripada alat penjelasnya.

Catatan tentang Blackbox AI: Program Magister Hukum (LLM) Pemrograman

Sebagai klarifikasi singkat. Ketika orang mencari "blackbox AI", mereka sering kali merujuk pada masalah konseptual yang dibahas dalam artikel ini. Terkadang mereka merujuk pada Blackbox AI, perusahaan di blackbox.ai. Blackbox.ai adalah LLM (Learning Learning Module) pengkodean yang dirancang untuk mengubah cara pengembang menulis kode. Produk ini terintegrasi dengan VS Code sebagai agen pengkodean, menyarankan kode, dan bersaing dengan alat-alat seperti Claude Code, GitHub Copilot, dan Cursor. Ini adalah salah satu teknologi AI canggih yang lebih dikenal di bidang pengkodean AI, dibangun di atas beberapa model AI, dan kode yang disarankan Blackbox mencakup semuanya, mulai dari refaktor hingga kerangka pengujian. Blackbox mengintegrasikan pembuatan kode, obrolan, dan pencarian ke dalam satu alur kerja, dan sebagian besar pengguna akan menyebutnya sebagai asisten AI terbaik yang pernah mereka coba di dalam editor mereka.

Kedua makna tersebut seringkali bercampur aduk dalam hasil pencarian. Produk Blackbox AI bukanlah subjek artikel ini. Kita sedang membahas properti struktural dari sistem AI yang buram, bukan asisten pengkodean tunggal. Jika Anda mencari produk tersebut, perusahaan tersebut memiliki dokumentasi dan harga sendiri. Jika Anda mencari konsepnya, silakan lanjutkan membaca.

AI yang Dapat Dijelaskan dan Alat Penjelasan

Kecerdasan Buatan yang Dapat Dijelaskan, yang biasanya disingkat menjadi XAI, adalah bidang yang mencoba mengungkap model AI yang buram tanpa mengurangi akurasinya. Ini juga merupakan pasar nyata saat ini. Perkiraan untuk tahun 2026 berkisar antara $9 miliar hingga $13 miliar secara global, dengan selisihnya bergantung pada definisi XAI mana yang Anda terima. Tujuannya adalah untuk membuat model AI lebih mudah dijelaskan tanpa memaksa tim kembali ke model dasar yang lebih lambat atau kurang akurat. Tim yang cerdas menjalankan alat-alat ini pada alat AI sebelum merilisnya, dan mereka memasangkan hasilnya dengan dokumentasi yang dapat dibaca oleh peninjau manusia.

Tiga keluarga teknik XAI patut diketahui.

Yang pertama adalah SHAP, singkatan dari SHapley Additive exPlanations. Metode ini dipinjam dari teori permainan kooperatif: untuk setiap prediksi, SHAP memberikan skor kontribusi kepada setiap fitur input. Tim penilai kredit menyukainya. Tim deteksi penipuan menyukainya. Pemodel risiko perawatan kesehatan mentolerirnya. SHAP secara teoritis ketat, tetapi secara komputasi sangat berat pada data tabular yang besar.

Yang kedua adalah LIME, Local Interpretable Model-agnostic Explanations. LIME membangun model pengganti yang sederhana dan mudah diinterpretasikan di sekitar satu prediksi dan menggunakannya untuk menjelaskan yang asli. Lebih cepat daripada SHAP. Bekerja pada teks, gambar, dan tabel. Kekurangannya adalah LIME dirancang secara lokal, sehingga dapat menyesatkan Anda jika Anda berasumsi bahwa satu penjelasan dapat digeneralisasikan.

Yang ketiga adalah penjelasan kontrafaktual. Alih-alih memberi tahu Anda mengapa model tersebut mengatakan ya, penjelasan kontrafaktual memberi tahu Anda perubahan input terkecil yang akan mengubah jawabannya menjadi tidak. Itulah tepatnya yang ingin diketahui oleh pemohon kredit atau transaksi yang ditandai: "Apa yang harus saya ubah?". Penjelasan kontrafaktual semakin populer dalam pemberitahuan tindakan yang merugikan justru karena penjelasan tersebut sesuai dengan harapan regulator.

Selain ketiga hal tersebut, Anda akan melihat plot kepentingan fitur, visualisasi perhatian untuk lapisan transformer, dan Grad-CAM untuk pengklasifikasi gambar. Interpretasi mekanistik, praktik rekayasa balik neuron dan sirkuit perhatian tertentu, berada di garis terdepan bidang ini. Anthropic, OpenAI, dan beberapa laboratorium akademis telah menerbitkan sirkuit parsial, tetapi pekerjaan tersebut belum diterjemahkan menjadi sesuatu yang dapat dikirimkan oleh tim kepatuhan perusahaan.

Jujurlah tentang di mana semua ini bermuara. Riset industri yang diterbitkan oleh Palo Alto Networks dan lainnya mencatat bahwa XAI bekerja dengan baik untuk pengklasifikasi gambar dan model tabular terstruktur, dan hanya sebagian untuk LLM. Logika di dalam model bahasa bergeser seiring perubahan posisi token dan jendela konteks, sehingga skor atribusi fitur dapat menyesatkan dengan cara yang tidak diperingatkan oleh penjelasan itu sendiri. Alat penjelasan yang membagikan kode dasarnya berguna. Namun, alat tersebut bukanlah solusi lengkap untuk masalah kotak hitam.

Mengatur AI Kotak Hitam: Undang-Undang AI Uni Eropa, NIST, CFPB

Sebagian besar vendor AI tidak menyangka regulator akan bergerak secepat ini. Tapi mereka melakukannya. Sikap lama "luncurkan sekarang, dokumentasikan kemudian" akan segera berakhir, dan segelintir peraturan adalah alasannya.

Eropa lebih dulu menerapkan Undang-Undang AI Uni Eropa. Ini adalah peluncuran bertahap sepanjang tahun 2025 hingga 2027, bukan perubahan sekaligus. Praktik terlarang mulai berlaku pada 2 Februari 2025. Aturan AI untuk tujuan umum mulai berlaku pada 2 Agustus 2025. Kewajiban sistem berisiko tinggi mulai berlaku pada 2 Agustus 2026, dan perluasan produk yang diatur berlaku satu tahun setelah itu, pada 2 Agustus 2027. Denda yang dikenakan bukan sekadar formalitas. EUR 35 juta atau 7% dari omset global untuk pelanggaran paling serius, EUR 15 juta atau 3% untuk sisanya (DLA Piper, 2025). Dan daftar kasus penggunaan berisiko tinggi seperti daftar tokoh-tokoh penting dalam penerapan sistem "kotak hitam": penilaian kredit, perekrutan, pendidikan, penegakan hukum, identitas biometrik. Setiap kasus tersebut sekarang membutuhkan dokumentasi, transparansi, dan pengawasan manusia secara default.

Gambaran di Amerika Serikat lebih rumit tetapi bergerak ke arah yang sama. Kerangka Kerja Manajemen Risiko AI NIST adalah hal yang paling mendekati standar acuan AS. Dirilis pada Januari 2023, diperluas sepanjang tahun 2024 dan 2025, dokumen ini secara diam-diam telah menjadi acuan bagi perusahaan-perusahaan besar, terlepas dari apakah mereka secara teknis wajib atau tidak. Desember 2025 menghadirkan NIST IR 8596, draf awal Profil AI Siber, dengan lokakarya lanjutan pada 14 Januari 2026. Banyak tim yang sudah mengadopsinya.

Biro Perlindungan Keuangan Konsumen (Consumer Financial Protection Bureau) telah lebih terus terang. Surat Edaran 2022-03 dan 2023-03 menyatakannya secara langsung: kreditor tidak dapat menggunakan algoritma kompleks jika kompleksitas tersebut mencegah kreditor memberikan alasan spesifik untuk tindakan yang merugikan berdasarkan ECOA dan Peraturan B. Bacalah itu dengan saksama. Ini bukan larangan terhadap pembelajaran mesin dalam pemberian pinjaman. Ini adalah larangan terhadap pembelajaran mesin yang begitu buram sehingga Anda tidak dapat memberi tahu pemohon yang ditolak apa kesalahan mereka. Itu, pada intinya, adalah larangan kotak hitam untuk kredit konsumen.

Bank menghadapi persyaratan yang lebih lama tetapi tetap lebih ketat. SR 11-7 Federal Reserve, yang berlaku sejak 2011, memaksa bank untuk menunjukkan bahwa mereka memahami model apa pun yang mendorong keputusan penting. Sistem pembelajaran mendalam modern kesulitan untuk memenuhi standar tersebut tanpa bantuan, dan Buletin OCC 2011-12 memberlakukan pendekatan yang sama.

Hasil akhirnya: setiap entitas yang diatur di AS atau Uni Eropa telah kehabisan alasan untuk memperlakukan ketidaktransparanan sebagai kompromi yang dapat diterima demi akurasi. Entah interpretasi direkayasa sejak tinjauan desain pertama, atau Anda membangun hibrida di mana manusia memberikan penjelasan yang tidak dapat diberikan oleh model. Tidak ada jalan ketiga yang dapat bertahan dari tindakan penegakan hukum.

Cara Mengaudit Sistem AI Kotak Hitam

Jadi, seperti apa sebenarnya penerapan sistem AI kotak hitam yang bertanggung jawab di tahun 2026? Panduan praktisnya lebih singkat daripada yang diklaim oleh para vendor.

Anda mulai dengan data. Dokumentasikan dari mana data pelatihan berasal, siapa yang memberi label, dan subkelompok mana yang diwakili. Kira-kira setengah dari masalah bias yang akan Anda temui nanti sudah terkode di sini, dan setengah yang tidak dapat Anda lacak adalah setengah yang tidak dapat Anda perbaiki.

Kemudian Anda melakukan pengujian tim merah pada model tersebut. Uji model tersebut dengan input yang merugikan, injeksi cepat, kasus-kasus ekstrem, dan contoh di luar distribusi. Anthropic, OpenAI, dan Microsoft kini menerbitkan buku panduan untuk pekerjaan ini yang dapat Anda adaptasi tanpa perlu menciptakan metodologi baru.

Terapkan XAI pada setiap model yang sedang diproduksi, bukan hanya yang utama. SHAP untuk alur kerja tabular. LIME untuk teks dan gambar. Kontrafaktual untuk setiap keputusan yang kembali ke pengguna. Tidak satu pun dari alat-alat tersebut yang sempurna. Namun, ketiadaan alat-alat tersebut merupakan tanda bahaya bagi auditor mana pun yang memeriksa sistem Anda.

Waspadai penyimpangan. Model menjadi usang lebih cepat daripada yang diperkirakan sebagian besar tim. Lacak distribusi input, distribusi output, dan hasil hilir. Atur peringatan pada masing-masing, dan perlakukan pergeseran yang tidak dapat dijelaskan sebagai insiden, bukan sekadar keingintahuan.

Bangun jalur eskalasi sebelum Anda membutuhkannya. Setiap keputusan model yang berdampak besar harus memiliki wewenang untuk diubah oleh manusia dan saluran banding yang terdokumentasi yang benar-benar dapat digunakan oleh pelanggan. Jika tim dukungan Anda adalah saluran banding, catat juga hal itu.

Terakhir, sesuaikan diri Anda dengan kerangka kerja yang berlaku. NIST AI RMF jika Anda berada di AS. Persyaratan risiko tinggi Undang-Undang AI Uni Eropa jika Anda berada di Eropa. Surat Edaran CFPB 2022-03 dan 2023-03 jika Anda terlibat dalam kredit konsumen. Melakukan ini sekali, sejak awal, jauh lebih murah daripada melakukan penyesuaian setelah tindakan penegakan hukum sampai di meja Anda.

Anda tidak akan menghilangkan kotak hitam. Itu tidak masalah. Tugasnya adalah membuatnya dapat diamati, dipertanggungjawabkan, dan dibatasi. Itulah standar yang sudah diterapkan oleh regulator, dan itulah gambaran implementasi yang matang pada tahun 2026.