¿Qué es la IA de caja negra? El problema de la caja negra explicado.

En abril de 2026, la clasificación de Vectara sobre alucinaciones arrojó un veredicto incómodo. Los mejores modelos de lenguaje ahora alucinan menos del 4 % de las veces en su prueba principal. Pero las nuevas variantes de "razonamiento" de GPT-5, Claude Sonnet 4.5, Grok-4 y Gemini-3-Pro alucinan más del 10 % en el nuevo conjunto de datos. Grok-4-fast-reasoning alcanzó el 20,2 %. Los modelos más inteligentes, los que "piensan" antes de responder, son los peores a la hora de decir cuándo no saben.

Ese es el problema de la caja negra, resumido en un párrafo. Hemos creado sistemas de IA que a menudo producen resultados útiles que nadie, ni siquiera sus creadores, puede explicar del todo. Son precisos sin estar calibrados, fluidos sin ser honestos y seguros sin estar en lo cierto.

Los reguladores lo notaron. La Ley de IA de la UE ahora impone multas de hasta 35 millones de euros o el 7 % de la facturación global por usos prohibidos, y las normas para sistemas de alto riesgo entraron en vigor el 2 de agosto de 2026. La Oficina de Protección Financiera del Consumidor de EE. UU. les comunicó claramente a los bancos que no pueden usar algoritmos complejos si estos les impiden explicar una denegación de crédito. Y el campo de la IA explicable, un tema especializado hace cinco años, es ahora un mercado estimado entre 9.000 y 13.000 millones de dólares en 2026.

Esta guía explica qué es realmente la IA de caja negra, por qué incluso los modelos de IA aparentemente simples se convierten en cajas negras, qué falla cuando esto sucede, dónde se manifiestan en las criptomonedas y las fintech, cómo el conjunto de herramientas de IA explicable (SHAP, LIME, contrafactuales) intenta desentrañarlas y qué debes saber sobre el nuevo marco regulatorio en la UE y EE. UU. También se incluye una breve aclaración sobre una confusión recurrente: Blackbox AI, el asistente de codificación de blackbox.ai, es algo distinto.

¿Qué es la IA de caja negra y por qué es importante?

La IA de caja negra se refiere a cualquier sistema de IA cuyo razonamiento interno es opaco para los usuarios y, a menudo, también para los desarrolladores que lo crearon. Las entradas y salidas son visibles, pero la ruta entre ellas está oculta tras capas de ponderaciones, patrones aprendidos y transformaciones de aprendizaje automático que ningún ser humano puede comprender por completo. Esto se aplica tanto si el modelo maneja datos tabulares, imágenes o tareas de procesamiento del lenguaje natural, como la traducción y el chat.

La etiqueta es anterior al aprendizaje profundo moderno. Los ingenieros han utilizado el término "caja negra" desde al menos la década de 1960 para referirse a cualquier sistema que se pueda examinar desde el exterior pero no desmontar. El cerebro humano, como suelen señalar los biólogos, también es una caja negra, pero la comparación tiene sus límites: una IA no funciona como un humano, y asumir que sí lo hace es una de las maneras más rápidas de malinterpretar a qué se refiere la IA de caja negra. Lo que cambió en la última década es la escala. Un modelo de lenguaje moderno y de gran tamaño puede contener cientos de miles de millones de parámetros. Una red neuronal profunda típica distribuye el "conocimiento" a través de miles de capas y millones de nodos de atención, con neuronas individuales que codifican múltiples patrones no relacionados a la vez. Los investigadores denominan a esta última propiedad polisemántica, y es una de las razones por las que la interpretabilidad mecanicista aún está en sus inicios.

¿Por qué debería importarle a alguien fuera de los laboratorios de investigación? Porque la IA opaca ahora toma decisiones trascendentales. Aprueba y deniega créditos. Califica a los acusados. Marca las transacciones como fraudulentas. Gestiona una gran parte del volumen de operaciones en todas las principales plataformas de intercambio de criptomonedas. Cuando comete un error, su opacidad hace casi imposible averiguar por qué, corregirlo o exigir responsabilidades.

También es importante porque la gobernanza de la IA ya no considera la opacidad un problema exclusivo de los desarrolladores. La UE ahora la trata como una cuestión de acceso al mercado. Los reguladores estadounidenses la consideran una cuestión de préstamos justos. Todos los ejecutivos que han aprobado una iniciativa de IA desde 2024 se han topado con el mismo obstáculo: ¿qué hace realmente este sistema y por qué? Comprender la IA de caja negra ya no es opcional, y no se puede solucionar el problema de la caja negra simplemente cambiando de proveedor.

¿Por qué los modelos de IA se convierten en cajas negras?

No todas las IA son cajas negras. Un árbol de decisiones simple es totalmente transparente. Un modelo de regresión lineal genera coeficientes legibles. Incluso un sistema de IA basado en reglas de la década de 1990 es, en principio, auditable línea por línea.

¿Cómo es que los modelos de IA actuales se convierten en cajas negras? Sucede por cuatro razones que se superponen.

En primer lugar, la escala. Los modelos de aprendizaje profundo con millones o miles de millones de parámetros operan en espacios de alta dimensionalidad que los humanos no pueden visualizar. Se puede describir matemáticamente un modelo de 200 mil millones de parámetros, pero nadie puede comprenderlo completamente.

En segundo lugar, las representaciones distribuidas. En una red neuronal profunda, ninguna neurona almacena «el concepto de gato» ni «la regla para rechazar un préstamo». Los conceptos se distribuyen entre miles de neuronas, y cada neurona participa en muchos conceptos simultáneamente. Obtener una explicación clara es un proyecto de investigación, no una simple consulta.

En tercer lugar, la dependencia de los datos de entrenamiento. El comportamiento del modelo está determinado por sus datos de entrenamiento, que suelen ser de propiedad exclusiva, de gran volumen y, en ocasiones, conllevan problemas legales. Incluso cuando un desarrollador publica los pesos del modelo, los datos rara vez se comparten. Por lo tanto, falta una parte fundamental del "por qué".

En cuarto lugar, la intención. Existen razones prácticas para utilizar deliberadamente enfoques de caja negra. Algunos desarrolladores y programadores de IA ocultan intencionadamente los detalles internos de los modelos para proteger la propiedad intelectual, y otras razones para utilizar diseños de caja negra incluyen los términos de licencia y las ventajas competitivas. Incluso un modelo con ponderación abierta puede convertirse en una caja negra en torno a sus decisiones, ya que la mayoría de los modelos modernos se basan en patrones emergentes que no se documentan. Una empresa que ha invertido 100 millones de dólares en un modelo no está interesada en publicar su arquitectura ni su procedimiento de entrenamiento. Los modelos de IA de código abierto que comparten su código subyacente también son, en última instancia, cajas negras, porque los usuarios siguen sin poder examinar las ponderaciones aprendidas con una interpretación significativa.

El resultado es que incluso los modelos de IA avanzados aparentemente simples, incluidos los LLM y los modelos de IA generativos, se convierten en cajas negras por defecto. Los modelos transparentes son la excepción, no la regla. Las cajas negras complejas pueden ofrecer una precisión impresionante, razón por la cual los equipos siguen implementándolas a pesar de su opacidad. Lo mismo ocurre con los modelos de IA de caja negra entrenados con datos ricos y desordenados: la mejora con respecto a los modelos de IA basados en reglas suele ser lo suficientemente grande como para superar las preocupaciones sobre la explicabilidad hasta que algo falla. La mayoría de las IA modernas de caja negra son, en última instancia, cajas negras porque los usuarios aún no pueden inspeccionar los pesos aprendidos. Los modelos de pesos abiertos comparten su código subyacente, y los usuarios pueden leer la arquitectura, pero el código subyacente es, en última instancia, una caja negra cuando se pregunta "¿por qué el modelo dijo eso?".

El problema de la caja negra en el aprendizaje profundo

El problema de la caja negra surge cuando se combinan esos cuatro factores. El modelo funciona, a menudo de forma impresionante. Pero funciona de una manera que se resiste a tres cosas a la vez: explicación, validación y corrección.

Consideremos el ejemplo clásico: un modelo de aprendizaje profundo entrenado para identificar pandas. Obtiene una puntuación del 99 % en el conjunto de prueba. Parece excelente. Luego, alguien ejecuta una herramienta de interpretabilidad y descubre que el modelo en realidad no está observando al panda, sino el bambú. La mayoría de las fotografías de pandas en los datos de entrenamiento también contienen bambú. El modelo aprendió un atajo. Ante una fotografía de panda sin bambú, el modelo falla.

Este tipo de "aprendizaje por atajos" es común en el aprendizaje profundo. El modelo encuentra una regularidad estadística que no coincide con el concepto subyacente, pero solo se percibe cuando el mundo se ve ligeramente diferente al del conjunto de entrenamiento. La crisis financiera de 2008 sirve como analogía histórica. Los modelos de Valor en Riesgo (VaR) basados en supuestos gaussianos funcionaron a la perfección en mercados normales y colapsaron en condiciones extremas, porque habían aprendido atajos que los modeladores no reconocieron como tales.

Los modelos de aprendizaje profundo actuales comparten ese mismo modo de fallo, con más parámetros y mayor confianza. Investigadores de interpretabilidad mecanicista, incluidos equipos de Anthropic y OpenAI, han comenzado a aplicar ingeniería inversa a pequeñas partes de los modelos de lenguaje, neurona por neurona. Su trabajo demuestra que el interior de un modelo de lenguaje de programación se asemeja más a circuitos entrelazados que a una lógica ordenada. No existe un punto exacto donde se pueda señalar y decir: «Aquí reside la respuesta». El problema de la caja negra no es un error que deba corregirse; es estructural.

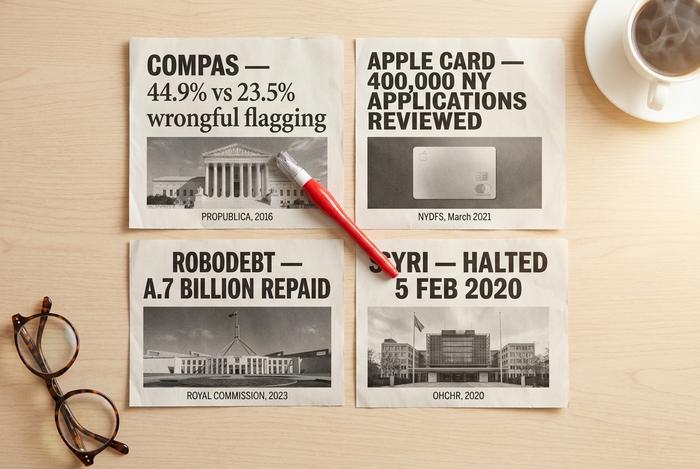

Ejemplos de IA de caja negra: COMPAS, Apple Card, Robodebt, SyRI

¿Quieres ver cómo es la IA de caja negra cuando falla? Los cuatro casos que todo el mundo cita te dan la mayor parte de la información que necesitas. Abarcan el sistema de justicia penal, la banca y el bienestar social. Todos perjudicaron a personas reales. Y ninguno falló exactamente igual.

Comencemos con COMPAS. Northpointe lo creó para predecir si un acusado reincidiría, y los tribunales estadounidenses lo implementaron ampliamente. Luego, ProPublica lo analizó en detalle. Su auditoría de 2016 analizó los datos de más de 7000 detenidos del condado de Broward, y el resultado fue desalentador: los acusados negros fueron erróneamente clasificados como de alto riesgo en el 44,9% de los casos, mientras que la cifra para los acusados blancos fue de solo el 23,5%. Un informe de seguimiento de 2024 empeoró aún más la situación. Dos características (edad y antecedentes penales) coincidieron con la precisión de las 137 de COMPAS. Por lo tanto, la complejidad no aportó ninguna información adicional, pero sí hizo que el sesgo fuera mucho más difícil de detectar. Este es el modelo clásico de caja negra que evalúa a las personas en lugar de los productos. El modelo de caja que evalúa a los solicitantes de empleo, el que Amazon descartó en 2018, se ajusta a la misma estructura.

Luego, la Apple Card, a finales de 2019. Wozniak dijo que su esposa obtuvo un límite de crédito diez veces menor que el suyo. David Heinemeier Hansson dijo lo mismo. La historia se viralizó. El Departamento de Servicios Financieros de Nueva York se lo tomó en serio: revisaron aproximadamente 400.000 solicitudes. En marzo de 2021, emitieron un veredicto de que no existía discriminación de género legal. Pero también escribieron, y esta es la parte importante, que la opacidad en la experiencia del cliente era un problema de confianza en sí mismo. El daño causado por la falta de transparencia, al parecer, tiene que ver tanto con los resultados como con la percepción. Un comunicado de prensa no soluciona el problema de la percepción.

Robodebt es la otra cara de la moneda. No hay redes neuronales profundas involucradas. Australia aplicó una regla de promedio de ingresos a los registros de asistencia social entre 2016 y 2019, acusó a aproximadamente 400.000 beneficiarios de fraude y no pudo explicar coherentemente el cálculo a nadie que recibió la carta. Posteriormente, una Comisión Real declaró ilegal el programa. El gobierno devolvió 1.700 millones de dólares australianos más otros 112 millones en compensación. Lección: un sistema no necesita ser técnicamente sofisticado para ser una caja negra. Solo necesita ser irresponsable.

El caso holandés de la IA opaca y el de SyRI constituyen el eje europeo. El 5 de febrero de 2020, un tribunal holandés ordenó la paralización inmediata de SyRI, dictaminando que su opacidad infringía el artículo 8 del Convenio Europeo de Derechos Humanos. El escándalo relacionado con las prestaciones por guarderías afectó a más de 20.000 padres que fueron acusados injustamente de fraude. El gobierno de Rutte dimitió en enero de 2021 a raíz de este suceso. Dicha sentencia se ha convertido en el referente estándar en los círculos políticos de la UE para explicar por qué la IA opaca en entornos de alto riesgo no es una cuestión ética, sino legal.

Cuatro casos. Sectores distintos, tecnologías diferentes, países distintos. El mismo patrón: un sistema opaco, una decisión trascendental y personas perjudicadas sin posibilidad real de oponerse.

Riesgo de la IA de caja negra en los sistemas de IA del mundo real

Una vez que se empieza a catalogar el riesgo de la IA de caja negra en sistemas de IA del mundo real, aparece un patrón. Los mismos cinco riesgos se repiten una y otra vez, independientemente de si el modelo es un calificador crediticio, un chatbot o un sistema de negociación algorítmica.

| Riesgo | Cómo se ve | Por qué es escalable |

|---|---|---|

| sesgo oculto | El modelo trata de manera diferente a los grupos protegidos. | Los datos de entrenamiento contienen patrones históricos. |

| Alucinación | El modelo inventa hechos o citas. | Los másteres en Derecho (LLM) priorizan la fluidez, no la veracidad. |

| Aprendizaje abreviado | El modelo se basa en correlaciones irrelevantes. | Más fácil de aprender que el concepto real. |

| Fragilidad adversaria | Un pequeño cambio en la entrada invierte la salida. | Límites de decisión de alta dimensión |

| Desglose de la auditoría | No se puede reconstruir el por qué | No hay estado interno interpretable |

Estos riesgos se acumulan en los sistemas de IA de caja negra utilizados en finanzas, contratación, atención médica y criptomonedas. Los complejos procesos de aprendizaje profundo que contienen dificultan predecir dónde se producirá el próximo fallo, y las herramientas de IA tradicionales para el control de calidad no fueron diseñadas para modelos con cientos de miles de millones de parámetros.

Los sesgos ocultos acaparan los titulares, pero la fragilidad adversarial y las deficiencias en las auditorías representan problemas a largo plazo más importantes. Un sesgo estable, al menos, puede medirse y corregirse. Un modelo que falla de forma diferente cada vez que se ejecuta (como ocurre con ChatGPT en aproximadamente el 42 % de las tareas de evaluación de contratos inteligentes, según un estudio de ACM TOSEM de 2024) es mucho más difícil de certificar para su uso regulado.

El elemento más reciente en esta lista es lo que los investigadores denominan "riesgo de la IA de agentes". Al integrar un modelo de lógica descriptiva (LLM) en herramientas, dotarlo de memoria y permitirle llamar a API, se incrementa la opacidad. Una sola decisión se convierte en una cadena de invocaciones del modelo, documentos recuperados y llamadas a herramientas, cada una de ellas parcialmente opaca. Los agentes modernos son cajas negras dentro de otras cajas negras.

Inteligencia artificial de caja negra en criptomonedas y tecnología financiera.

De todos los sectores que utilizan IA de caja negra, las criptomonedas y las fintech son donde la implementación y el riesgo chocan con mayor intensidad. Hay mucho en juego. La latencia es mínima. La transparencia es escasa. La regulación, especialmente en el ámbito de las criptomonedas, aún es fragmentaria. El resultado es un entorno que premia la implementación temprana y la documentación posterior.

Negociación algorítmica. La negociación algorítmica impulsó entre el 70 % y el 80 % del volumen de criptomonedas en 2025, una cifra superior al 60 %-70 % de los principales mercados de valores. Solo Wintermute mueve más de 15.000 millones de dólares en más de 60 plataformas en un día promedio, con un volumen récord de 2.240 millones de dólares en un solo día registrado en 2025. Las estrategias detrás de esos flujos son conjuntos de aprendizaje profundo que ningún observador externo puede auditar. El colapso de Alameda/FTX en noviembre de 2022 es la ilustración más clara del riesgo: la capitalización total del mercado de criptomonedas cayó de más de 1 billón de dólares a menos de 800.000 millones de dólares en aproximadamente un mes, y la exposición subyacente de 14.600 millones de dólares a FTT en el balance de Alameda fue invisible hasta el momento en que dejó de serlo.

Puntuación AML y KYC. El mercado global de software contra el lavado de dinero alcanzó los 4.130 millones de dólares en 2025 y se prevé que llegue a los 9.380 millones de dólares en 2030 (MarketsandMarkets). El cumplimiento de AML/KYC en criptomonedas, en particular, crece a una tasa de crecimiento anual compuesta (CAGR) del 13,8 %. Proveedores como ComplyAdvantage, Chainalysis Reactor y Elliptic Navigator utilizan ahora modelos de aprendizaje automático de caja negra para la puntuación de riesgo de las carteras. El uso de aprendizaje automático de caja negra en este ámbito está muy extendido y es lo suficientemente eficaz como para implementarse en la mayoría de las principales plataformas de intercambio, y lo suficientemente opaco como para que los responsables de cumplimiento a menudo no puedan reconstruir por qué se bloqueó una cartera específica.

Auditoría de contratos inteligentes. Aquí es donde las limitaciones de la IA se hacen evidentes. Un estudio de arXiv de 2024 evaluó GPT-4 en la detección de vulnerabilidades de contratos inteligentes. Alcanzó una precisión del 96,6%, pero solo una exhaustividad del 37,8%, pasando por alto casi dos tercios de los fallos reales. Las salidas de ChatGPT son inestables entre ejecuciones en el 42% de los contratos (ACM TOSEM 2024). Las herramientas híbridas como GPTScan, que combinan GPT con análisis estático, superan el 90% de precisión y una exhaustividad de aproximadamente el 70% en contratos de tokens (arXiv 2308.03314). CertiK Skynet ahora monitorea más de 17.000 proyectos y aproximadamente 494 mil millones de dólares en valor de mercado, pero cada equipo de auditoría responsable aún combina la IA con un revisor humano.

Asesores robóticos. Betterment administra más de 56 mil millones de dólares en más de 900 000 cuentas. Wealthfront gestiona 42,9 mil millones de dólares. La industria de los asesores robóticos ha superado el billón de dólares en activos bajo gestión a nivel mundial. El reequilibrio de cartera, la optimización fiscal y la evaluación de riesgos se basan en modelos de aprendizaje automático cuyas decisiones específicas no se divulgan en ningún documento dirigido a inversores minoristas.

Calificación crediticia y detección de fraude. FICO es utilizado por el 90 % de los prestamistas estadounidenses, y FICO Falcon procesa más de 65 mil millones de transacciones al año con tasas de detección de fraude superiores al 95 %. Un estudio del Banco de Inglaterra realizado en 2024 con 50 instituciones del Reino Unido reveló que los modelos de riesgo crediticio basados en aprendizaje automático redujeron las clasificaciones erróneas en aproximadamente un 25 % en comparación con la regresión logística. La mejora en la precisión es real. La desventaja radica en que, según las Circulares 2022-03 y 2023-03 de la CFPB, los prestamistas estadounidenses no pueden utilizar modelos lo suficientemente opacos como para evitar explicaciones específicas de acciones adversas en virtud de la ECOA.

El patrón se repite en los cinco casos. El modelo es más preciso que el modelo de referencia transparente. La opacidad es estructuralmente inseparable de la precisión. Y los reguladores se están adaptando más rápido que las herramientas de explicabilidad.

Nota sobre IA de caja negra: El máster en codificación

Una aclaración rápida. Cuando la gente busca "IA de caja negra", a menudo se refiere al problema conceptual que trata este artículo. A veces se refieren a Blackbox AI, la empresa blackbox.ai. Blackbox.ai es un LLM de codificación diseñado para transformar la forma en que los desarrolladores escriben código. El producto se integra con VS Code como agente de codificación, sugiere código y compite con herramientas como Claude Code, GitHub Copilot y Cursor. Es una de las tecnologías de IA avanzadas más conocidas en el ámbito de la codificación con IA, construida sobre múltiples modelos de IA, y el código que sugiere Blackbox abarca desde refactorizaciones hasta la creación de estructuras de pruebas. Blackbox integra la generación de código, el chat y la búsqueda en un único flujo de trabajo, y la mayoría de los usuarios lo consideran el mejor asistente de IA que han probado dentro de su editor.

Los dos significados suelen confundirse en los resultados de búsqueda. El producto Blackbox AI no es el tema de este artículo. Nos centramos en la estructura de los sistemas de IA opacos, no en ningún asistente de programación en particular. Si buscaste el producto, la empresa mantiene su propia documentación y precios. Si buscaste el concepto, continúa leyendo.

IA explicable y herramientas de explicabilidad

La IA explicable, generalmente abreviada como XAI, es el campo que busca desvelar los modelos de IA opacos sin comprometer su precisión. Actualmente, constituye un mercado real. Las previsiones para 2026 sitúan el mercado global entre 9.000 y 13.000 millones de dólares, dependiendo de la definición de XAI que se adopte. El objetivo es lograr que los modelos de IA sean más explicables sin obligar a los equipos a recurrir a métodos más lentos o menos precisos. Los equipos más avanzados prueban estas herramientas en sistemas de IA antes de su lanzamiento y complementan los resultados con documentación que un revisor humano pueda comprender.

Hay tres familias de técnicas de IA explicable que vale la pena conocer.

La primera es SHAP, acrónimo de SHApley Additive exPlanations (Explicaciones Aditivas con SH). Se basa en la teoría de juegos cooperativos: para cada predicción, SHAP asigna una puntuación de contribución a cada característica de entrada. A los equipos de calificación crediticia les encanta. A los equipos de detección de fraude les encanta. Los modeladores de riesgos en el sector salud lo toleran. SHAP es teóricamente riguroso, pero computacionalmente es una bestia con grandes conjuntos de datos tabulares.

La segunda es LIME, Explicaciones Locales Interpretables e Independientes del Modelo. LIME crea un modelo sustituto simple e interpretable a partir de una sola predicción y lo utiliza para explicar la original. Es más rápido que SHAP. Funciona con texto, imágenes y tablas. El inconveniente es que LIME es local por diseño, por lo que puede inducir a error si se asume que una explicación es generalizable.

La tercera opción son las explicaciones contrafactuales. En lugar de explicar por qué el modelo dio como resultado afirmativo, las explicaciones contrafactuales indican el cambio mínimo en los datos de entrada que habría revertido la respuesta a negativo. Esto es precisamente lo que un solicitante de crédito o una transacción marcada quiere saber: "¿Qué tendría que cambiar?". Las explicaciones contrafactuales están ganando terreno rápidamente en las notificaciones de acciones adversas precisamente porque se ajustan perfectamente a las expectativas de los reguladores.

Además de estos tres ejemplos, verá gráficos de importancia de características, visualización de la atención para capas transformadoras y Grad-CAM para clasificadores de imágenes. La interpretabilidad mecanicista, la práctica de la ingeniería inversa de neuronas y circuitos de atención específicos, se encuentra a la vanguardia del campo. Anthropic, OpenAI y algunos laboratorios académicos han publicado circuitos parciales, pero este trabajo aún no se ha traducido en algo que un equipo de cumplimiento empresarial pueda implementar.

Seamos honestos sobre las consecuencias. Investigaciones del sector, publicadas por Palo Alto Networks y otras empresas, señalan que la IA explicable (XAI) funciona bien para clasificadores de imágenes y modelos tabulares estructurados, pero solo parcialmente para modelos de lenguaje natural (LLM). La lógica interna de un modelo de lenguaje cambia a medida que varían la posición del token y la ventana de contexto, por lo que las puntuaciones de atribución de características pueden inducir a error de maneras que la propia explicación no advierte. Las herramientas de explicabilidad que comparten su código subyacente son útiles, pero no constituyen una solución definitiva al problema de la caja negra.

Regulación de la IA de caja negra: Ley de IA de la UE, NIST, CFPB

La mayoría de los proveedores de IA no esperaban que los reguladores actuaran con tanta rapidez. Pero lo hicieron. La antigua estrategia de "lanzar ahora, documentar después" está quedando obsoleta, y la razón se debe a un pequeño grupo de normas.

Europa fue pionera con la Ley de IA de la UE. Se trata de una implementación gradual entre 2025 y 2027, no de un cambio repentino. Las prácticas prohibidas se hicieron exigibles el 2 de febrero de 2025. Las normas generales de IA entraron en vigor el 2 de agosto de 2025. Las obligaciones para sistemas de alto riesgo se aplican desde el 2 de agosto de 2026, y la extensión para productos regulados llega un año después, el 2 de agosto de 2027. Las multas no son una mera formalidad. 35 millones de euros o el 7 % de la facturación mundial para las infracciones más graves, 15 millones de euros o el 3 % para el resto (DLA Piper, 2025). Y la lista de casos de uso de alto riesgo parece un quién es quién de implementaciones de caja negra: calificación crediticia, contratación, educación, aplicación de la ley, identificación biométrica. Cada una de ellas ahora requiere documentación, transparencia y supervisión humana por defecto.

El panorama estadounidense es más complejo, pero avanza en la misma dirección. El Marco de Gestión de Riesgos de IA del NIST es lo más parecido a una referencia en EE. UU. Publicado en enero de 2023 y ampliado en 2024 y 2025, se ha convertido discretamente en el documento de referencia para las grandes empresas, independientemente de si están obligadas técnicamente a adoptarlo o no. En diciembre de 2025 se publicó el NIST IR 8596, el borrador preliminar del Perfil de IA Cibernética, con un taller de seguimiento el 14 de enero de 2026. Muchos equipos ya lo están adoptando.

La Oficina de Protección Financiera del Consumidor ha sido más directa. Las circulares 2022-03 y 2023-03 lo afirman sin rodeos: un acreedor no puede utilizar un algoritmo complejo si dicha complejidad le impide proporcionar las razones específicas de una acción adversa conforme a la Ley de Igualdad de Oportunidades en el Empleo (ECOA) y el Reglamento B. Léalo con atención. No se trata de una prohibición del aprendizaje automático en los préstamos. Se trata de una prohibición tan opaca que no se puede explicar a un solicitante rechazado qué hizo mal. En efecto, es una prohibición de caja negra para el crédito al consumo.

Los bancos se enfrentan a un requisito más antiguo, pero aún más exigente. La norma SR 11-7 de la Reserva Federal, vigente desde 2011, obliga a los bancos a demostrar que comprenden cualquier modelo que impulse una decisión importante. Los modernos sistemas de aprendizaje profundo tienen dificultades para superar este obstáculo sin ayuda, y el Boletín 2011-12 de la OCC impone el mismo enfoque.

Resultado final: ninguna entidad regulada en EE. UU. o la UE tiene ya excusas para considerar la opacidad como una compensación aceptable por la precisión. O bien la interpretabilidad se incorpora desde la primera revisión del diseño, o bien se crea un sistema híbrido donde un humano proporciona la explicación que el modelo no puede. No existe una tercera opción que resista una acción coercitiva.

Cómo auditar un sistema de IA de caja negra

Entonces, ¿cómo será realmente el despliegue responsable de un sistema de IA de caja negra en 2026? El plan práctico es más breve de lo que los proveedores pretenden.

Empieza por los datos. Documenta de dónde provienen los datos de entrenamiento, quién los etiquetó y qué subgrupos están representados. Aproximadamente la mitad de los problemas de sesgo que encontrarás más adelante ya están codificados aquí, y la otra mitad, que no puedes rastrear, es la que no puedes solucionar.

Luego, se somete el modelo a pruebas de penetración. Se le ponen a prueba con entradas adversarias, inyecciones de comandos, casos extremos y ejemplos fuera de la distribución. Anthropic, OpenAI y Microsoft publican ahora guías prácticas para este trabajo que se pueden adaptar sin necesidad de inventar una nueva metodología.

Aplique XAI a todos los modelos en producción, no solo a los principales. SHAP para flujos de trabajo tabulares. LIME para texto e imágenes. Contrafactuales para cualquier decisión que involucre al usuario. Ninguna de estas herramientas es perfecta. Su ausencia, por otro lado, es una señal de alerta para cualquier auditor que revise su infraestructura.

Esté atento a las desviaciones. Los modelos se vuelven obsoletos más rápido de lo que la mayoría de los equipos esperan. Monitoree las distribuciones de entrada, las distribuciones de salida y los resultados posteriores. Configure alertas para cada una y trate los cambios inexplicables como incidentes, no como meras curiosidades.

Establezca el protocolo de escalamiento antes de que sea necesario. Cada decisión importante del modelo debe contar con una intervención humana y un canal de apelación documentado que el cliente pueda utilizar. Si su equipo de soporte es el canal de apelación, indíquelo también.

Por último, adáptese al marco normativo aplicable. Si se encuentra en EE. UU., consulte el Marco de Gestión de Riesgos (RMF) de IA del NIST. Si se encuentra en Europa, consulte los requisitos de alto riesgo de la Ley de IA de la UE. Si trabaja con crédito al consumo, consulte las Circulares 2022-03 y 2023-03 de la CFPB. Hacer esto una sola vez, con anticipación, resulta mucho más económico que realizar ajustes posteriores a la notificación de una acción coercitiva.

No se eliminará la caja negra. No hay problema. El objetivo es hacerla observable, responsable y delimitada. Ese es el estándar que los reguladores ya están aplicando, y así es como se verá una implementación madura en 2026.