O que é IA de caixa preta? O problema da caixa preta explicado.

Em abril de 2026, o ranking de alucinações da Vectara apresentou um veredito curioso. Os melhores modelos de linguagem agora apresentam alucinações em menos de 4% das vezes em seu teste principal. Mas as novas variantes de "raciocínio" do GPT-5, Claude Sonnet 4.5, Grok-4 e Gemini-3-Pro apresentam alucinações em mais de 10% das vezes no novo conjunto de dados. O Grok-4-fast-reasoning atingiu 20,2%. Os modelos mais inteligentes, aqueles que "pensam" antes de responder, são os piores em dizer quando não sabem.

Esse é o problema da caixa preta em um parágrafo. Construímos sistemas de IA que frequentemente produzem resultados úteis e que ninguém, nem mesmo seus criadores, consegue explicar completamente. Eles são precisos sem serem calibrados, fluentes sem serem honestos e confiantes sem serem corretos.

Os reguladores perceberam. A Lei de IA da UE agora impõe multas de até 35 milhões de euros ou 7% do faturamento global para usos proibidos, com regras para sistemas de alto risco entrando em vigor em 2 de agosto de 2026. O Departamento de Proteção Financeira do Consumidor dos EUA (CFPB) deixou claro para os bancos que eles não podem usar algoritmos complexos se esses algoritmos os impedirem de explicar uma recusa de crédito. E o campo da IA explicável, um nicho de mercado há cinco anos, agora é estimado entre US$ 9 bilhões e US$ 13 bilhões em 2026.

Este guia explica o que é, de fato, a IA de caixa preta, por que até mesmo modelos de IA aparentemente simples se tornam caixas pretas, o que dá errado quando isso acontece, onde elas aparecem em criptomoedas e fintechs, como o conjunto de ferramentas de IA explicável (SHAP, LIME, contrafactuais) tenta decifrá-las e o que você precisa saber sobre o novo regime regulatório na UE e nos EUA. Há também um breve parêntese para esclarecer uma confusão recorrente: a IA de caixa preta, o assistente de programação em blackbox.ai, é algo diferente.

O que é IA de caixa preta e por que ela é importante?

A Inteligência Artificial de Caixa Preta refere-se a qualquer sistema de IA cujo raciocínio interno é opaco para os usuários e, frequentemente, até mesmo para os desenvolvedores que o criaram. As entradas e saídas são visíveis. O caminho entre elas está oculto em camadas de pesos, padrões aprendidos e transformações de aprendizado de máquina que nenhum ser humano consegue decifrar completamente. O mesmo se aplica tanto a modelos que lidam com dados tabulares, imagens ou tarefas de processamento de linguagem natural, como tradução e bate-papo.

O termo é mais antigo que o aprendizado profundo moderno. Engenheiros usam "caixa preta" desde pelo menos a década de 1960 para qualquer sistema que possa ser examinado externamente, mas não desmontado. O próprio cérebro humano, como biólogos gostam de ressaltar, também é uma caixa preta, mas a comparação tem seus limites: uma IA não funciona como um humano, e presumir que sim é uma das maneiras mais rápidas de interpretar erroneamente o que significa IA de caixa preta. O que mudou na última década foi a escala. Um modelo de linguagem moderno e abrangente pode conter centenas de bilhões de parâmetros. Uma rede neural profunda típica distribui "conhecimento" por milhares de camadas e milhões de núcleos de atenção, com neurônios individuais codificando múltiplos padrões não relacionados simultaneamente. Pesquisadores chamam essa última propriedade de polissemanticidade, e é uma das razões pelas quais a interpretabilidade mecanicista ainda está em seus primórdios.

Por que alguém fora dos laboratórios de pesquisa deveria se importar? Porque a inteligência artificial de caixa preta agora está tomando decisões importantes. Ela aprova e nega crédito. Ela avalia réus. Ela sinaliza transações como fraudulentas. Ela processa uma grande parte do volume de negociação em todas as principais corretoras de criptomoedas. Quando ela erra, a falta de transparência torna quase impossível descobrir o motivo, corrigir o problema ou responsabilizar alguém.

Isso também é importante porque a governança da IA não trata mais a opacidade como um problema exclusivo dos desenvolvedores. A UE agora a considera uma questão de acesso ao mercado. Os reguladores dos EUA a tratam como uma questão de empréstimos justos. Todos os executivos que aprovaram uma iniciativa de IA desde 2024 se depararam com o mesmo obstáculo: o que essa tecnologia realmente faz e por quê? Compreender a IA de caixa preta não é mais opcional, e você não pode resolver o problema da caixa preta simplesmente trocando de fornecedor.

Por que os modelos de IA se tornam caixas-pretas

Nem toda IA é uma caixa preta. Uma árvore de decisão simples é totalmente transparente. Um modelo de regressão linear gera coeficientes que você pode ler. Mesmo um sistema de IA baseado em regras da década de 1990 é, em princípio, auditável linha por linha.

Então, como os modelos de IA atuais se tornam caixas-pretas? Isso acontece por quatro razões interligadas.

Primeiro, a escala. Modelos de aprendizado profundo com milhões ou bilhões de parâmetros operam em espaços de alta dimensionalidade que os humanos não conseguem visualizar. Você pode descrever um modelo com 200 bilhões de parâmetros matematicamente, mas ninguém consegue retê-lo na mente.

Em segundo lugar, representações distribuídas. Em uma rede neural profunda, nenhum neurônio individual armazena "o conceito de gato" ou "a regra para rejeitar um empréstimo". Os conceitos se espalham por milhares de neurônios, e neurônios individuais participam de muitos conceitos simultaneamente. Extrair uma explicação clara é um projeto de pesquisa, não uma simples consulta.

Terceiro, a dependência dos dados de treinamento. O comportamento do modelo é moldado pelos seus dados de treinamento, que geralmente são proprietários, gigantescos e, às vezes, sujeitos a questões legais. Mesmo quando um desenvolvedor publica os pesos do modelo, os dados raramente são compartilhados. Assim, uma parte fundamental do "porquê" fica faltando.

Em quarto lugar, a intenção. Existem razões práticas para usar abordagens de caixa preta deliberadamente. Alguns desenvolvedores e programadores de IA ocultam propositalmente o funcionamento interno dos modelos para proteger a propriedade intelectual, e outras razões para usar designs de caixa preta incluem termos de licenciamento e vantagens competitivas. Mesmo um modelo de pesos abertos pode efetivamente criar uma caixa preta em torno de suas decisões, porque a maioria dos modelos modernos depende de padrões emergentes que nenhuma documentação captura. Uma empresa que investiu US$ 100 milhões em um modelo não está ansiosa para publicar sua arquitetura e procedimento de treinamento. Modelos de IA de código aberto que compartilham seu código subjacente também são, em última análise, caixas pretas, porque os usuários ainda não podem inspecionar os pesos aprendidos com qualquer interpretação significativa.

O resultado é que até mesmo modelos de IA avançados aparentemente simples, incluindo LLMs e modelos de IA generativos, tornam-se caixas-pretas por padrão. Modelos transparentes são a exceção, não a regra. Caixas-pretas complexas podem oferecer precisão impressionante, e é por isso que as equipes continuam a implantá-las apesar da opacidade. O mesmo se aplica a modelos de IA de caixa-preta treinados com dados complexos e desorganizados: a vantagem em relação aos modelos de IA baseados em regras costuma ser grande o suficiente para superar as preocupações com a explicabilidade até que algo dê errado. A maioria das IAs de caixa-preta modernas são, em última análise, caixas-pretas porque os usuários ainda não podem inspecionar os pesos aprendidos. Modelos de peso aberto compartilham seu código subjacente, e os usuários podem ler a arquitetura, mas o código subjacente é, em última análise, uma caixa-preta quando se pergunta "por que o modelo disse isso".

O Problema da Caixa Preta no Aprendizado Profundo

O problema da caixa preta surge quando esses quatro motivos se combinam. O modelo funciona, muitas vezes de forma impressionante. Mas funciona de uma maneira que resiste a três coisas simultaneamente: explicação, validação e correção.

Considere a ilustração clássica: um modelo de aprendizado profundo treinado para identificar pandas. Ele obtém uma pontuação de 99% no conjunto de teste. Parece ótimo. Então, alguém executa uma ferramenta de interpretabilidade e descobre que o modelo não está realmente olhando para o panda. Ele está prestando atenção ao bambu. A maioria das fotografias de pandas nos dados de treinamento também contém bambu. O modelo aprendeu um atalho. Em uma fotografia de panda sem bambu, o modelo falha.

Esse tipo de "aprendizado por atalhos" está por toda parte no aprendizado profundo. O modelo encontra uma regularidade estatística que não corresponde ao conceito subjacente, mas você só percebe quando o mundo parece ligeiramente diferente do conjunto de treinamento. A crise financeira de 2008 é a analogia histórica aqui. Os modelos de Valor em Risco (VaR) construídos com base em suposições gaussianas funcionaram perfeitamente em mercados normais e entraram em colapso em condições extremas, porque aprenderam atalhos que os modeladores não perceberam que eram atalhos.

Os modelos de aprendizado profundo atuais compartilham exatamente esse modo de falha, com mais parâmetros e mais confiança. Pesquisadores de interpretabilidade mecanística, incluindo equipes da Anthropic e da OpenAI, começaram a fazer engenharia reversa de pequenas partes de modelos de linguagem, neurônio por neurônio. Seu trabalho mostra que o interior de um modelo de linguagem é mais parecido com circuitos emaranhados do que com lógica organizada. Não há um ponto específico em que se possa apontar e dizer "aqui está a resposta". O problema da caixa preta não é um bug a ser corrigido; é estrutural.

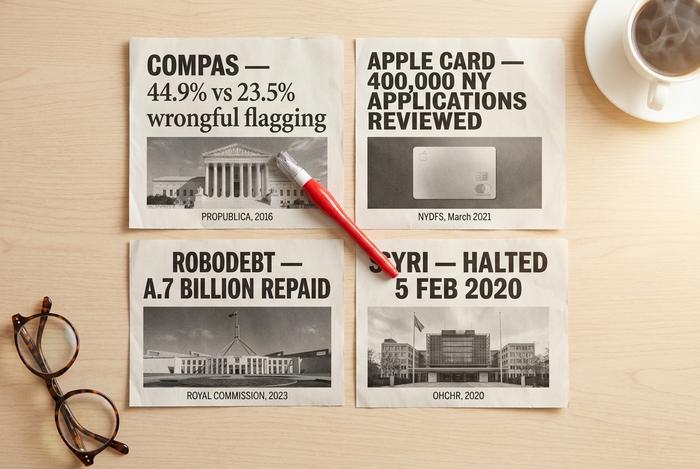

Exemplos de IA de caixa preta: COMPAS, Apple Card, Robodebt, SyRI

Quer ver como a IA de caixa preta se comporta quando falha? Os quatro casos que todos citam dizem muito do que você precisa saber. Eles abrangem o sistema judiciário criminal, o setor bancário e a assistência social. Todos prejudicaram pessoas reais. E nenhum deles falhou exatamente da mesma maneira.

Comecemos pelo COMPAS. A Northpointe o desenvolveu para prever se um réu voltaria a cometer crimes, e os tribunais dos EUA o implementaram amplamente. Em seguida, a ProPublica analisou o sistema em detalhes. Sua auditoria de 2016 utilizou os dados de mais de 7.000 pessoas presas no Condado de Broward, e o resultado foi alarmante: réus negros foram erroneamente classificados como de alto risco em 44,9% dos casos, enquanto o índice para réus brancos foi de apenas 23,5%. Um estudo subsequente de 2024 piorou a situação. Duas variáveis (idade e condenações anteriores) apresentaram a mesma precisão que o COMPAS, que apresentou 137%. Portanto, a complexidade não trouxe nenhum sinal adicional, mas tornou o viés muito mais difícil de detectar. Esse é o modelo clássico de caixa preta que avalia pessoas em vez de produtos. O modelo de caixa preta que avalia candidatos a emprego, o mesmo que a Amazon abandonou em 2018, tem o mesmo formato.

Então veio o Apple Card, no final de 2019. Wozniak disse que sua esposa recebeu um limite de crédito 10 vezes menor que o dele. David Heinemeier Hansson disse o mesmo. A história viralizou. O Departamento de Serviços Financeiros de Nova York levou o caso a sério: analisou cerca de 400 mil solicitações. Em março de 2021, concluiu que não havia discriminação de gênero prevista em lei. Mas também escreveram, e esta é a parte importante, que a falta de transparência na experiência do cliente era um problema de confiança por si só. O dano da "caixa preta", como se vê, é metade resultado e metade percepção. Um comunicado à imprensa não resolve o problema da percepção.

O Robodebt é o outro lado da moeda. Sem nenhuma rede neural complexa envolvida. A Austrália aplicou uma regra de média de renda aos registros de assistência social entre 2016 e 2019, acusou cerca de 400.000 beneficiários de fraude e não conseguiu explicar o cálculo de forma coerente a ninguém que recebeu a notificação. Uma Comissão Real posteriormente considerou o esquema ilegal. O governo devolveu A$ 1,7 bilhão, além de outros A$ 112 milhões em indenizações. Lição: um sistema não precisa ser tecnicamente sofisticado para ser uma caixa-preta. Basta ser irresponsável.

O caso holandês "toeslagenaffaire" e o SyRI representam os extremos europeus. Em 5 de fevereiro de 2020, um tribunal holandês ordenou a suspensão imediata do SyRI, alegando que sua falta de transparência violava o Artigo 8º da Convenção Europeia dos Direitos Humanos. O escândalo relacionado aos benefícios de assistência infantil envolveu mais de 20.000 pais que foram acusados injustamente de fraude. O governo Rutte renunciou em janeiro de 2021 em decorrência disso. Essa decisão tornou-se o ponto de referência padrão nos círculos políticos da UE para demonstrar por que a inteligência artificial opaca em contextos de alto risco não é uma questão ética superficial, mas sim uma questão legal.

Quatro casos. Setores diferentes, tecnologias diferentes, países diferentes. O mesmo padrão: um sistema opaco, uma decisão com consequências e pessoas que sofrem as consequências sem ter como se defender.

Riscos da IA de caixa preta em sistemas de IA do mundo real

Ao começar a catalogar os riscos de IA de caixa preta em sistemas de IA do mundo real, um padrão surge. Os mesmos cinco riscos aparecem repetidamente, independentemente de o modelo ser um avaliador de crédito, um chatbot ou um sistema de negociação algorítmica.

| Risco | Como é a aparência? | Por que é escalável |

|---|---|---|

| Viés oculto | O modelo trata os grupos protegidos de forma diferente. | Os dados de treinamento carregam padrões históricos. |

| Alucinação | O modelo inventa fatos ou citações. | Os LLMs priorizam a fluência, não a verdade. |

| Aprendizagem rápida | O modelo se baseia em correlações irrelevantes. | Mais fácil de aprender do que o conceito real. |

| Fragilidade adversária | Uma pequena alteração na entrada inverte a saída. | limites de decisão de alta dimensão |

| Análise detalhada da auditoria | Não consigo reconstruir o porquê. | Nenhum estado interno interpretável |

Esses riscos se acumulam em sistemas de IA de caixa preta usados em finanças, recrutamento, saúde e criptomoedas. Os complexos processos de aprendizado profundo que esses sistemas possuem dificultam a previsão de onde ocorrerá a próxima falha, e as ferramentas tradicionais de IA para controle de qualidade não foram projetadas para modelos com centenas de bilhões de parâmetros.

O viés oculto ganha as manchetes, mas a fragilidade adversarial e a falha na auditoria são os maiores problemas a longo prazo. Um viés estável pode, pelo menos, ser medido e corrigido. Um modelo que falha de maneira diferente a cada execução (como acontece com o ChatGPT, em aproximadamente 42% das tarefas de avaliação de contratos inteligentes, segundo um estudo da ACM TOSEM de 2024) é muito mais difícil de certificar para uso regulamentado.

A mais recente adição a essa lista é o que os pesquisadores chamam de "risco da IA agética". Quando você integra um modelo de aprendizagem de linguagem (LLM) a ferramentas, fornece memória a ele e permite que ele acesse APIs, você aumenta a opacidade. Uma única decisão agora é uma cadeia de invocações de modelos, documentos recuperados e chamadas de ferramentas, cada uma delas parcialmente opaca. Os agentes modernos são caixas-pretas dentro de caixas-pretas.

Inteligência Artificial de Caixa Preta em Criptomoedas e Fintech

De todos os setores que utilizam IA de caixa preta, o de criptomoedas e o de fintech são aqueles em que a implementação e os riscos se chocam com mais força. Os investimentos são altos. A latência é curta. A transparência é escassa. A regulamentação, especialmente no setor de criptomoedas, ainda é fragmentada. O resultado é um ambiente que recompensa a implementação imediata e a documentação posterior.

Negociação algorítmica. Estima-se que a negociação algorítmica tenha impulsionado de 70% a 80% do volume de criptomoedas em 2025, uma participação superior aos 60% a 70% dos principais mercados de ações. Somente a Wintermute movimenta mais de US$ 15 bilhões em mais de 60 plataformas em um dia comum, com um volume recorde de US$ 2,24 bilhões em um único dia registrado em 2025. As estratégias por trás desses fluxos são conjuntos de aprendizado profundo que nenhum observador externo consegue auditar. O colapso da Alameda/FTX em novembro de 2022 é a ilustração mais clara do risco: a capitalização total do mercado de criptomoedas caiu de mais de US$ 1 trilhão para menos de US$ 800 bilhões em aproximadamente um mês, e a exposição subjacente de US$ 14,6 bilhões ao FTT no balanço patrimonial da Alameda permaneceu invisível até o momento em que deixou de ser.

Avaliação de AML e KYC. O mercado global de software anti-lavagem de dinheiro atingiu US$ 4,13 bilhões em 2025 e a previsão é de que chegue a US$ 9,38 bilhões em 2030 (MarketsandMarkets). A conformidade com AML/KYC em criptomoedas, especificamente, cresce a uma taxa composta de crescimento anual (CAGR) de 13,8%. Fornecedores como ComplyAdvantage, Chainalysis Reactor e Elliptic Navigator agora utilizam modelos de aprendizado de máquina de caixa preta para avaliação de risco de carteiras. O uso de aprendizado de máquina de caixa preta é tão difundido e eficaz que pode ser implementado na maioria das principais corretoras, além de ser suficientemente opaco para que os responsáveis pela conformidade muitas vezes não consigam reconstruir o motivo do bloqueio de uma carteira específica.

Auditoria de contratos inteligentes. É aqui que as limitações da IA se tornam evidentes. Um estudo de 2024 publicado no arXiv avaliou o GPT-4 na detecção de vulnerabilidades em contratos inteligentes. Ele atingiu 96,6% de precisão, mas apenas 37,8% de recall, deixando de detectar quase dois terços das falhas reais. Os resultados do ChatGPT são instáveis entre execuções em 42% dos contratos (ACM TOSEM 2024). Ferramentas híbridas como o GPTScan, que combinam o GPT com análise estática, ultrapassam 90% de precisão e cerca de 70% de recall em contratos de tokens (arXiv 2308.03314). O CertiK Skynet agora monitora mais de 17.000 projetos e aproximadamente US$ 494 bilhões em valor de mercado, mas toda equipe de auditoria responsável ainda utiliza a IA em conjunto com um revisor humano.

Robôs-consultores. A Betterment administra mais de US$ 56 bilhões em mais de 900.000 contas. A Wealthfront possui US$ 42,9 bilhões. O setor de robôs-consultores ultrapassou US$ 1 trilhão em ativos sob gestão (AUM) globais. O rebalanceamento de portfólio, a otimização fiscal e a avaliação de risco são todos impulsionados por modelos de aprendizado de máquina (ML) cujas decisões específicas não são divulgadas em nenhum documento voltado para o público em geral.

Análise de crédito e detecção de fraudes. O FICO é utilizado por 90% dos credores dos EUA, e o FICO Falcon processa mais de 65 bilhões de transações por ano, com taxas de detecção de fraudes superiores a 95%. Um estudo do Banco da Inglaterra, realizado em 2024 com 50 instituições do Reino Unido, constatou que os modelos de aprendizado de máquina para avaliação de risco de crédito reduziram as classificações incorretas em cerca de 25% em comparação com a regressão logística. O ganho em precisão é real. A contrapartida é que, de acordo com as Circulares 2022-03 e 2023-03 do CFPB (Consumer Financial Protection Bureau), os credores dos EUA não podem usar modelos suficientemente opacos para evitar explicações específicas de ações adversas sob a ECOA (Economic Opportunity Commission).

O padrão observado nos cinco casos é o mesmo. O modelo é mais preciso do que a linha de base transparente. A opacidade é estruturalmente inseparável da precisão. E os órgãos reguladores estão acompanhando o ritmo mais rapidamente do que as ferramentas de explicabilidade.

Nota sobre Blackbox AI: O Mestrado em Direito de Programação

Uma breve ambiguidade. Quando as pessoas pesquisam por "blackbox AI", geralmente se referem ao problema conceitual abordado neste artigo. Às vezes, estão se referindo à Blackbox AI, a empresa do site blackbox.ai. A Blackbox.ai é uma plataforma de aprendizado de máquina para programação (LLM) projetada para transformar a maneira como os desenvolvedores escrevem código. O produto se integra ao VS Code como um agente de codificação, sugere código e compete com ferramentas como Claude Code, GitHub Copilot e Cursor. É uma das tecnologias de IA avançadas mais conhecidas no espaço de codificação com IA, construída sobre múltiplos modelos de IA, e o código sugerido pela Blackbox abrange tudo, desde refatorações até a criação de testes. A Blackbox integra geração de código, chat e busca em um único fluxo de trabalho, e a maioria dos usuários a considera o melhor assistente de IA que já experimentaram em seu editor.

Os dois significados frequentemente se confundem nos resultados de busca. O produto Blackbox AI não é o foco deste artigo. Estamos analisando a propriedade estrutural de sistemas de IA opacos, não um assistente de programação específico. Se você pesquisou pelo produto, saiba que a empresa mantém sua própria documentação e tabela de preços. Se você pesquisou pelo conceito, continue lendo.

IA explicável e ferramentas de explicabilidade

A Inteligência Artificial Explicável, geralmente abreviada para XAI, é a área que busca desvendar a opacidade dos modelos de IA sem comprometer sua precisão. Trata-se de um mercado consolidado. As previsões para 2026 apontam para um valor global entre US$ 9 bilhões e US$ 13 bilhões, com a variação dependendo da definição de XAI adotada. O objetivo é tornar os modelos de IA mais explicáveis sem forçar as equipes a retornarem a métodos mais lentos ou menos precisos. Equipes inteligentes executam essas ferramentas em sistemas de IA antes de lançá-las e acompanham os resultados com documentação que um revisor humano possa de fato compreender.

Vale a pena conhecer três famílias da técnica XAI.

O primeiro é o SHAP, abreviação de SHapley Additive exPlanations (Explicações Aditivas SHapley). Ele foi emprestado da teoria dos jogos cooperativos: para cada previsão, o SHAP atribui uma pontuação de contribuição a cada variável de entrada. Equipes de análise de crédito adoram. Equipes de detecção de fraudes adoram. Modeladores de risco na área da saúde o toleram. O SHAP é teoricamente rigoroso, mas computacionalmente é um monstro quando se trata de grandes volumes de dados tabulares.

O segundo é o LIME, Local Interpretable Model-agnostic Explanations (Explicações Locais Interpretáveis e Agnosticas ao Modelo). O LIME constrói um modelo substituto simples e interpretável em torno de uma única previsão e o utiliza para explicar a previsão original. É mais rápido que o SHAP. Funciona com texto, imagens e tabelas. A desvantagem é que o LIME é local por natureza, então pode induzir a erros se você assumir que uma explicação se generaliza.

A terceira são as explicações contrafactuais. Em vez de explicar por que o modelo disse sim, as explicações contrafactuais mostram a menor alteração nos dados de entrada que teria alterado a resposta para não. É exatamente isso que um solicitante de crédito ou uma transação sinalizada quer saber: "O que eu teria que mudar?". As explicações contrafactuais estão ganhando terreno rapidamente em notificações de ações adversas justamente porque se alinham perfeitamente às expectativas dos reguladores.

Além desses três, você verá gráficos de importância de recursos, visualização de atenção para camadas Transformer e Grad-CAM para classificadores de imagem. A interpretabilidade mecanística, a prática de engenharia reversa de neurônios e circuitos de atenção específicos, está na vanguarda da área. A Anthropic, a OpenAI e alguns laboratórios acadêmicos publicaram circuitos parciais, mas o trabalho ainda não se traduziu em algo que uma equipe de conformidade empresarial possa implementar.

Sejamos honestos sobre as consequências disso tudo. Pesquisas do setor, publicadas pela Palo Alto Networks e outras, observam que a IA explicativa (XAI) funciona bem para classificadores de imagens e modelos tabulares estruturados, e apenas parcialmente para modelos de linguagem lógica (LLMs). A lógica dentro de um modelo de linguagem muda conforme a posição do token e a janela de contexto se alteram, portanto, as pontuações de atribuição de recursos podem induzir a erros de maneiras que a própria explicação não alerta. Ferramentas de explicabilidade que compartilham seu código subjacente são úteis. Elas não são uma solução definitiva para o problema da caixa preta.

Regulamentação da IA de Caixa Preta: Lei de IA da UE, NIST, CFPB

A maioria dos fornecedores de IA não esperava que os reguladores agissem tão rapidamente. Mas agiram. A antiga postura de "lançar agora, documentar depois" está com os dias contados, e um pequeno conjunto de regras é o motivo.

A Europa saiu na frente com a Lei de IA da UE. Trata-se de uma implementação faseada entre 2025 e 2027, não uma mudança repentina. As práticas proibidas tornaram-se aplicáveis em 2 de fevereiro de 2025. As regras gerais de IA entraram em vigor em 2 de agosto de 2025. As obrigações relativas a sistemas de alto risco passaram a vigorar a partir de 2 de agosto de 2026, e a extensão para produtos regulamentados entra em vigor um ano depois, em 2 de agosto de 2027. As multas não são para inglês ver: 35 milhões de euros ou 7% do faturamento mundial para as violações mais graves, e 15 milhões de euros ou 3% para as demais (DLA Piper, 2025). E a lista de casos de uso de alto risco é como um guia de implantações de "caixa preta": análise de crédito, recrutamento, educação, aplicação da lei, identificação biométrica. Cada um desses casos agora exige documentação, transparência e supervisão humana por padrão.

O cenário americano é mais complexo, mas caminha na mesma direção. O Framework de Gestão de Riscos de IA do NIST é o que mais se aproxima de uma base de referência para os EUA. Lançado em janeiro de 2023 e expandido ao longo de 2024 e 2025, tornou-se discretamente o documento que as grandes empresas utilizam como referência, independentemente de serem ou não tecnicamente obrigatórias. Em dezembro de 2025, foi lançado o NIST IR 8596, a versão preliminar do Perfil de IA Cibernética, com um workshop de acompanhamento em 14 de janeiro de 2026. Muitas equipes já o estão adotando.

O Departamento de Proteção Financeira do Consumidor (CFPB, na sigla em inglês) foi mais direto. As circulares 2022-03 e 2023-03 afirmam isso claramente: um credor não pode usar um algoritmo complexo se essa complexidade o impedir de fornecer as razões específicas para uma ação adversa, conforme previsto na Lei de Igualdade de Oportunidades de Crédito (ECOA, na sigla em inglês) e no Regulamento B. Leia com atenção. Não se trata de uma proibição do uso de aprendizado de máquina em empréstimos. Trata-se de uma proibição de aprendizado de máquina tão opaco que impede que um solicitante com pedido negado explique o que fez de errado. Ou seja, na prática, trata-se de uma proibição de caixa-preta para crédito ao consumidor.

Os bancos enfrentam uma exigência mais antiga, porém ainda mais rigorosa. A Resolução SR 11-7 do Federal Reserve, em vigor desde 2011, obriga os bancos a demonstrarem que compreendem qualquer modelo que oriente uma decisão relevante. Os modernos sistemas de aprendizado profundo têm dificuldade em atender a essa exigência sem auxílio, e o Boletim 2011-12 do OCC reforça a mesma abordagem.

Conclusão: qualquer entidade regulamentada nos EUA ou na UE ficou sem desculpas para tratar a opacidade como uma troca aceitável pela precisão. Ou a interpretabilidade é incorporada desde a primeira revisão do projeto, ou se cria um modelo híbrido em que um humano fornece a explicação que o modelo não consegue. Não existe uma terceira via que sobreviva a uma ação fiscalizatória.

Como auditar um sistema de IA de caixa preta

Então, como será, na prática, a implementação responsável de um sistema de IA de caixa preta em 2026? O passo a passo é mais curto do que os fornecedores fazem parecer.

Comece pelos dados. Documente a origem dos dados de treinamento, quem os rotulou e quais subgrupos estão representados. Aproximadamente metade dos problemas de viés que você encontrará mais tarde já estão codificados aqui, e a metade que você não consegue rastrear é a metade que você não consegue corrigir.

Em seguida, você realiza um teste de intrusão no modelo. Sonda-o com entradas adversárias, injeções de prompts, casos extremos e exemplos fora da distribuição. A Anthropic, a OpenAI e a Microsoft agora publicam manuais para esse trabalho que você pode adaptar sem precisar inventar uma nova metodologia.

Aplique XAI em todos os modelos em produção, não apenas nos principais. SHAP para fluxos de trabalho tabulares. LIME para texto e imagens. Contrafactuais para qualquer decisão que envolva um usuário. Nenhuma dessas ferramentas é perfeita. A ausência delas, por outro lado, é um sinal de alerta para qualquer auditor que analise sua infraestrutura.

Fique atento a desvios. Os modelos se tornam obsoletos mais rápido do que a maioria das equipes espera. Monitore as distribuições de entrada, as distribuições de saída e os resultados subsequentes. Configure alertas para cada um deles e trate mudanças inexplicáveis como incidentes, não como curiosidades.

Crie o processo de escalonamento antes que ele seja necessário. Toda decisão importante do modelo deve ter uma versão de aprovação humana e um canal de apelação documentado que o cliente possa efetivamente utilizar. Se a sua equipe de suporte for o canal de apelação, documente isso também.

Por fim, identifique a estrutura aplicável. Consulte o NIST AI RMF se estiver nos EUA. Utilize os requisitos de alto risco da Lei de IA da UE se estiver na Europa. Consulte as Circulares 2022-03 e 2023-03 do CFPB se sua empresa lida com crédito ao consumidor. Fazer isso uma vez, logo no início, é consideravelmente mais barato do que ter que se adaptar depois que uma notificação de fiscalização for recebida.

Você não vai eliminar a caixa preta. E tudo bem. O trabalho é torná-la observável, passível de responsabilização e delimitada. Esse é o padrão que os órgãos reguladores já estão aplicando, e é assim que uma implementação madura se parecerá em 2026.