什么是黑箱人工智能?黑箱问题详解

2026年4月,Vectara的“幻觉”排行榜给出了一个令人尴尬的结果。顶级语言模型在其核心测试中的幻觉率现在低于4%。但GPT-5、Claude Sonnet 4.5、Grok-4和Gemini-3-Pro的全新“推理”版本在新数据集上的幻觉率均超过10%。Grok-4快速推理版甚至达到了20.2%。最聪明的模型,那些在回答问题前会“思考”的模型,反而最不擅长告诉你它们不知道答案。

这就是黑箱问题的简要概括。我们构建的人工智能系统常常能产生有用的输出,但包括其创造者在内,没有人能够完全解释这些输出。它们精准却未经校准,流畅却不诚实,自信却不正确。

监管机构注意到了这一点。欧盟《人工智能法案》规定,对于违规使用人工智能,最高可处以3500万欧元或全球营业额7%的罚款,高风险系统规则将于2026年8月2日生效。美国消费者金融保护局明确告知各银行,如果复杂的算法会妨碍他们解释拒贷原因,则不得使用这些算法。五年前还只是小众领域的“可解释人工智能”如今已发展成为一个市场,预计到2026年市场规模将达到90亿至130亿美元。

本指南将深入探讨黑箱人工智能的本质,解释为何看似简单的AI模型也会变成黑箱,分析黑箱出现时会出错的原因,以及它们在加密货币和金融科技领域的应用,并介绍可解释人工智能工具包(SHAP、LIME、反事实分析)如何尝试破解黑箱,以及您应该了解的欧盟和美国的新监管体系。此外,本指南还简要澄清一个常见的误解:blackbox.ai 上的编码助手 Blackbox AI 与黑箱人工智能是不同的概念。

什么是黑箱人工智能?它为何如此重要?

黑箱人工智能指的是任何内部推理过程对用户乃至开发者都不透明的人工智能系统。输入和输出是可见的,但它们之间的路径却隐藏在层层权重、学习模式和机器学习转换之中,任何人都无法完全解读。无论模型处理的是表格数据、图像,还是翻译和聊天等自然语言处理任务,情况都是如此。

“黑箱”这个标签比现代深度学习的历史还要悠久。早在20世纪60年代,工程师们就开始用“黑箱”来指代任何可以从外部窥探但无法彻底拆解的系统。生物学家喜欢指出,人脑本身也是一个黑箱,但这种类比并不完全恰当:人工智能的运作方式与人类截然不同,假设它像人类一样运作是误解“黑箱人工智能”真正含义的最快方法之一。过去十年发生的变化在于规模。一个现代大型语言模型可以承载数千亿个参数。一个典型的深度神经网络将“知识”分布在数千层和数百万个注意力头上,单个神经元可以同时编码多个不相关的模式。研究人员将这种特性称为多语义性,这也是机制可解释性仍处于发展初期的原因之一。

为什么研究实验室以外的人应该关注这个问题?因为黑箱人工智能现在正在左右一些影响深远的决策。它决定着信贷的审批和拒绝,它给被告打分,它把交易标记为欺诈,它掌控着各大加密货币交易所的大量交易量。一旦它出错,由于其不透明性,几乎不可能查明原因、修复错误或追究任何人的责任。

这一点也至关重要,因为人工智能治理不再将不透明性视为开发者的问题。欧盟现在将其视为市场准入问题,美国监管机构则将其视为公平贷款问题。自2024年以来,每一位批准人工智能项目的高管都遇到了同样的难题:这东西到底在做什么?为什么?理解黑箱人工智能已不再是可选项,而仅仅更换供应商也无法解决黑箱问题。

为什么人工智能模型会变成黑匣子?

并非所有人工智能都是黑箱。简单的决策树是完全透明的。线性回归模型会输出可读的系数。即使是上世纪90年代的基于规则的人工智能系统,原则上也是可以逐行审计的。

那么,如今的人工智能模型为何会变成黑箱呢?这主要由四个相互关联的原因造成。

首先是规模。拥有数百万甚至数十亿参数的深度学习模型在高维空间中运行,这是人类无法想象的。你可以用数学描述一个拥有2000亿参数的模型,但没有人能把它完全记在脑子里。

其次,是分布式表征。在深度神经网络中,没有哪个神经元会单独存储“猫的概念”或“拒绝贷款的规则”。概念会跨越成千上万个神经元,单个神经元也可能同时参与多个概念的构建。因此,提取出一个清晰的解释是一项研究课题,而非简单的查询。

第三,训练数据依赖性。模型的行为取决于其训练数据,而这些数据通常是专有的、庞大的,有时还涉及法律纠纷。即使开发者公布了模型权重,数据也很少共享。因此,“为什么”的关键部分就缺失了。

第四,意图。刻意采用黑盒方法有其实际原因。一些人工智能开发者和程序员会故意隐藏模型内部结构以保护知识产权,而采用黑盒设计的其他原因还包括许可条款和竞争优势。即使是开放权重的模型,其决策过程也可能被有效地封闭起来,因为大多数现代模型依赖于涌现模式,而这些模式无法被文档记录。一家在模型上投资1亿美元的公司不会急于公开其架构和训练流程。开源人工智能模型虽然共享底层代码,但最终也仍然是黑盒,因为用户仍然无法对学习到的权重进行任何有意义的解读。

结果是,即使是看似简单的先进人工智能模型,包括逻辑学习模型(LLM)和生成式人工智能模型,默认情况下也会变成黑盒。透明模型是例外,而非普遍现象。复杂的黑盒模型可以达到惊人的准确率,这也是为什么团队尽管不透明却仍然不断部署它们的原因。对于基于丰富且杂乱的数据训练的黑盒人工智能模型来说,情况也是如此:与基于规则的人工智能模型相比,其性能提升通常足以掩盖可解释性的担忧,直到出现问题为止。大多数现代黑盒人工智能最终仍然是黑盒,因为用户仍然无法检查学习到的权重。开放权重模型共享其底层代码,用户可以阅读架构,但当你问“为什么模型会给出这样的结果”时,底层代码最终仍然是黑盒。

深度学习中的黑箱问题

黑箱问题正是这四个原因叠加起来的结果。这个模型确实有效,而且往往效果显著。但它的运作方式同时阻碍了三件事:解释、验证和修正。

举个经典的例子:一个深度学习模型经过训练来识别熊猫。它在测试集上取得了 99% 的准确率,看起来很棒。但随后有人运行了一个可解释性工具,发现模型实际上并没有关注熊猫,而是关注了竹子。训练数据中的大多数熊猫照片都包含竹子。模型学会了一条捷径。当遇到没有竹子的熊猫照片时,模型就识别失败了。

这种“捷径学习”在深度学习中无处不在。模型会发现一些与底层概念不符的统计规律,但只有当现实世界与训练集略有不同时,你才会注意到这些规律。2008 年的金融危机就是一个典型的例子。基于高斯假设构建的风险价值(VaR)模型在正常市场中表现良好,但在极端情况下却会崩溃,因为它们学习了一些建模者自己都没有意识到的捷径。

如今的深度学习模型也存在同样的失效模式,而且参数更多,置信度更高。包括 Anthropic 和 OpenAI 团队在内的机制可解释性研究人员已经开始逐个神经元地对语言模型的小部分进行逆向工程。他们的研究表明,语言模型的内部结构更接近于纠缠的电路,而非整齐的逻辑。你无法指出某个关键点,并断言“答案就在这里”。黑盒问题并非需要修复的漏洞,而是结构性问题。

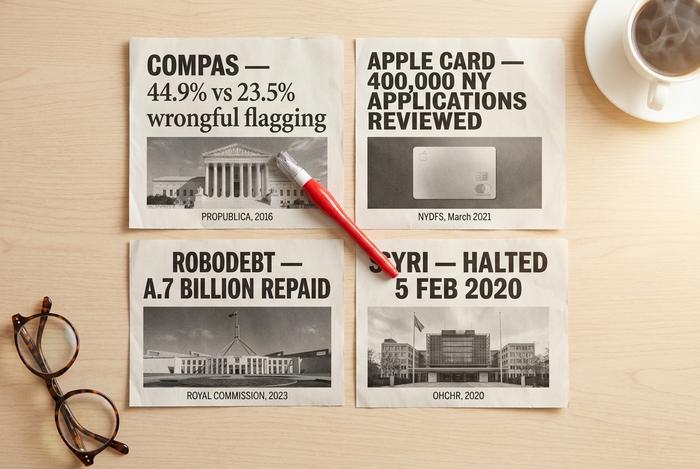

黑盒人工智能示例:COMPAS、Apple Card、Robodebt、SyRI

想看看黑箱人工智能崩溃时是什么样子吗?大家经常提到的这四个案例就能告诉你大部分答案。它们分别涉及刑事司法、银行业和福利领域,都给真实的人造成了伤害,而且没有两个案例的失败方式完全相同。

先说说COMPAS。Northpointe公司开发这款系统是为了预测被告是否会再次犯罪,美国法院也广泛采用了它。之后,ProPublica对其进行了深入调查。他们在2016年对布劳沃德县7000多名被捕者的数据进行了分析,结果令人震惊:黑人被告被错误地标记为高风险的案例高达44.9%,而白人被告的这一比例仅为23.5%。2024年的一篇后续论文更是雪上加霜。其中两项特征(年龄和前科)的准确率与COMPAS的137项特征不相上下。因此,这种复杂性实际上并没有带来任何额外的信息,反而使偏见更难被发现。这就是典型的黑箱模型,它评估的是人而不是产品。亚马逊在2018年弃用的用于评估求职者的黑箱模型也符合同样的模式。

随后是2019年末的苹果信用卡事件。沃兹尼亚克说他妻子的信用卡额度比他低10倍。大卫·海涅迈尔·汉森也证实了这一点。此事迅速传播开来。纽约州金融服务部对此高度重视:他们调取了大约40万份申请进行调查。2021年3月,他们得出结论,认为不存在法定的性别歧视。但他们也指出(这一点至关重要),客户体验的不透明本身就是一个信任问题。事实证明,黑箱操作造成的伤害一半在于结果,一半在于感知。一份新闻稿并不能解决感知方面的问题。

机器人债务系统是硬币的另一面。它不涉及深度神经网络。澳大利亚在2016年至2019年间对福利记录实施了一项收入平均规则,指控约40万福利领取者存在欺诈行为,但却无法向收到信件的人清晰地解释计算过程。皇家委员会后来认定该计划违法。政府偿还了17亿澳元,并额外支付了1.12亿澳元的赔偿金。教训是:一个系统并不需要多么复杂的技术才能成为一个黑匣子。它只需要缺乏问责机制即可。

荷兰的“托斯拉根事件”(Toeslagenaffaire)和SyRI项目是欧洲此类事件的典型代表。2020年2月5日,荷兰一家法院下令立即停止SyRI项目,裁定其信息不透明违反了《欧洲人权公约》第八条。相关的儿童福利丑闻导致超过2万名家长被错误地指控欺诈。2021年1月,鲁特政府因此辞职。如今,该裁决已成为欧盟政策圈的标杆,它表明在高风险环境下使用不透明的人工智能并非无关紧要的伦理问题,而是一个法律问题。

四个案例。不同行业,不同技术,不同国家。模式相同:不透明的系统,影响深远的决策,以及最终承受后果却无力反抗的人们。

现实世界人工智能系统中的黑箱人工智能风险

一旦你开始对现实世界人工智能系统中的黑箱人工智能风险进行分类,就会发现一种模式。无论模型是信用评分系统、聊天机器人还是算法交易系统,这五种风险都会反复出现。

| 风险 | 它看起来像什么 | 为什么它具有可扩展性 |

|---|---|---|

| 隐性偏见 | 该模型对受保护群体采取不同的对待方式。 | 训练数据包含历史模式 |

| 幻觉 | 模型捏造事实或引文 | 法学硕士追求的是流畅性,而不是真理。 |

| 学习捷径 | 该模型依赖于无关的相关性 | 比真正的概念更容易理解 |

| 对抗性脆弱性 | 输入的微小变化就能改变输出 | 高维决策边界 |

| 审计细分 | 无法重现原因 | 无可解释的内部状态 |

这些风险在金融、招聘、医疗保健和加密货币等领域使用的黑箱人工智能系统中不断累积。这些系统内部复杂的深度学习过程使得预测下一次故障发生的位置变得困难,而传统的质量保证人工智能工具并非为拥有数千亿参数的模型而设计。

隐性偏见虽然频频登上新闻头条,但对抗脆弱性和审计失效才是更严重的长期问题。稳定的偏见至少可以被测量和纠正。而每次运行都会出现不同错误(根据2024年ACM TOSEM的一项研究,ChatGPT在约42%的智能合约评估任务中都会出现这种情况)的模型,则更难获得监管用途的认证。

最新加入这一行列的是研究人员所谓的“智能体人工智能风险”。当你将逻辑逻辑模型(LLM)连接到工具中,赋予它内存,并让它调用API时,不透明性就会加剧。现在,一个决策会变成一系列模型调用、文档检索和工具调用,而每一步都存在部分不透明性。现代智能体就像是黑箱中的黑箱。

加密货币和金融科技领域的黑箱人工智能

在所有使用黑箱人工智能的行业中,加密货币和金融科技领域的部署和风险冲突最为严重。风险巨大,延迟极短,信息披露却十分薄弱。监管,尤其是在加密货币领域,仍然处于零散状态。其结果是,这种环境鼓励先部署,后编写文档。

算法交易。预计到2025年,算法交易将占加密货币交易量的70-80%,高于主要股票市场60-70%的份额。仅Wintermute一家,平均每天在60多个交易场所处理超过150亿美元的交易,2025年单日交易量就创下22.4亿美元的纪录。这些交易背后的策略是深度学习集成,任何外部观察者都无法审计。2022年11月Alameda/FTX的崩盘最能说明这种风险:加密货币总市值在一个月内从超过1万亿美元暴跌至不足8000亿美元,而Alameda资产负债表上高达146亿美元的FTT敞口在崩盘前一直不为人知。

反洗钱 (AML) 和了解你的客户 (KYC) 评分。全球反洗钱软件市场在 2025 年达到 41.3 亿美元,预计到 2030 年将达到 93.8 亿美元(MarketsandMarkets)。加密货币反洗钱/了解你的客户合规性尤其以 13.8% 的复合年增长率增长。ComplyAdvantage、Chainalysis Reactor 和 Elliptic Navigator 等供应商目前使用黑盒机器学习模型进行钱包风险评分。黑盒机器学习的应用十分广泛且有效,足以部署在大多数主流交易所,并且其隐蔽性使得合规官通常无法还原特定钱包被冻结的原因。

智能合约审计。人工智能的局限性在这里显露无疑。2024 年 arXiv 的一项研究评估了 GPT-4 在智能合约漏洞检测方面的表现。其精确率达到 96.6%,但召回率仅为 37.8%,漏掉了近三分之二的真实缺陷。ChatGPT 在 42% 的合约中运行结果不稳定(ACM TOSEM 2024)。像 GPTScan 这样将 GPT 与静态分析相结合的混合工具,在代币合约上的精确率超过 90%,召回率约为 70%(arXiv 2308.03314)。CertiK Skynet 目前监控着超过 17,000 个项目,总市值约为 4940 亿美元,但所有负责任的审计团队仍然会将人工智能与人工审核员相结合。

智能投顾。Betterment管理着超过 560 亿美元的资产,涉及 90 多万个账户。Wealthfront 的资产规模为 429 亿美元。智能投顾行业的全球资产管理规模已突破 1 万亿美元。投资组合再平衡、税损收割和风险评分均由机器学习模型驱动,而这些模型的具体决策并未在任何面向零售客户的文件中披露。

信用评分和欺诈检测。90 %的美国贷款机构使用FICO评分系统,而FICO Falcon每年处理超过650亿笔交易,据报道其欺诈检测率超过95%。英国央行2024年对50家英国金融机构进行的一项研究发现,与逻辑回归相比,机器学习信用风险模型可将错误分类率降低约25%。准确率的提升是实实在在的。但需要注意的是,根据美国消费者金融保护局(CFPB)2022-03号和2023-03号通告,美国贷款机构不能使用过于晦涩的模型,以免违反《平等信贷机会法》(ECOA),从而导致贷款机构被追究采取不利行动的责任。

这五个案例的模式相同。该模型比透明基线模型更准确。不透明度与准确性在结构上密不可分。而且,监管机构的应对速度比可解释性工具的开发速度更快。

关于黑盒人工智能的说明:编码LLM

简单澄清一下。当人们搜索“黑盒AI”时,他们通常指的是本文探讨的概念性问题。有时,他们指的是Blackbox AI,也就是blackbox.ai这家公司。Blackbox.ai是一款编码语言学习工具(LLM),旨在革新开发者编写代码的方式。该产品作为编码助手集成到VS Code中,提供代码建议,并与Claude Code、GitHub Copilot和Cursor等工具展开竞争。它是AI编码领域较为知名的先进AI技术之一,基于多种AI模型构建,Blackbox提供的代码建议涵盖从代码重构到测试框架的方方面面。Blackbox将代码生成、聊天和搜索功能集成到一个工作流程中,大多数用户都认为它是他们在编辑器中体验过的最佳AI助手。

这两个含义在搜索结果中经常混淆。本文并非讨论 Blackbox AI 这款产品。我们关注的是不透明人工智能系统的结构特性,而非任何具体的编码助手。如果您搜索的是该产品,该公司有自己的文档和定价信息。如果您搜索的是相关概念,请继续阅读。

可解释人工智能和可解释性工具

可解释人工智能(通常简称为 XAI)致力于在不降低人工智能模型准确性的前提下,揭开其晦涩难懂的本质。如今,它已成为一个蓬勃发展的市场。据预测,到 2026 年,全球 XAI 市场规模将在 90 亿美元至 130 亿美元之间,具体差距取决于你采用的是哪一方对 XAI 的定义。其目标是在不迫使团队退回到速度更慢或准确性更低的基准模型的前提下,提升人工智能模型的可解释性。优秀的团队会在发布人工智能模型之前,先使用 XAI 工具进行测试,并将测试结果与可供人工审阅者阅读的文档相结合。

XAI技术有三种类型值得了解。

第一种是SHAP,全称为SHapley Additive exPlanations(沙普利加性解释)。它借鉴了合作博弈论:对于每个预测,SHAP会为每个输入特征分配一个贡献分数。信用评分团队喜欢它,欺诈检测团队也喜欢它,医疗风险建模人员也勉强接受它。SHAP在理论上非常严谨,但在处理大型表格数据时,计算量却非常庞大。

第二种方法是 LIME,即局部可解释模型无关解释。LIME 围绕单个预测构建一个简单、可解释的代理模型,并用它来解释原始预测。它比 SHAP 更快,并且适用于文本、图像和表格。需要注意的是,LIME 的设计是局部的,因此如果您假设一种解释可以推广到其他情况,它可能会误导您。

第三种是反事实解释。反事实解释并非直接告诉你模型为什么给出“是”的结论,而是告诉你只需做出最小的输入更改就能使结论变为“否”。这正是信贷申请人或被标记的交易想要了解的:“我需要做出哪些更改?”。反事实解释在不利行动通知中正迅速普及,正是因为它们与监管机构的预期高度吻合。

除了以上三点,您还会看到特征重要性图、Transformer 层的注意力可视化以及用于图像分类器的 Grad-CAM。机制可解释性,即对特定神经元和注意力回路进行逆向工程,是该领域的前沿技术。Anthropic、OpenAI 和一些学术实验室已经发布了部分回路,但这些成果尚未转化为企业合规团队可以交付的产品。

要坦诚面对这一切的最终结果。Palo Alto Networks 等公司发布的行业研究指出,XAI 在图像分类器和结构化表格模型方面表现出色,但在语言模型 (LLM) 方面则效果有限。语言模型内部的逻辑会随着词元位置和上下文窗口的变化而变化,因此特征归因得分可能会产生误导,而解释本身却不会对此发出警告。能够共享底层代码的可解释性工具固然有用,但它们并非解决黑盒问题的最终方案。

监管黑箱人工智能:欧盟人工智能法案、美国国家标准与技术研究院 (NIST)、消费者金融保护局 (CFPB)。

大多数人工智能供应商没想到监管机构会行动如此迅速。但他们确实预料到了。过去那种“先交付,后审批”的模式正在走向终结,而这背后的原因就在于少数几项规则。

欧洲率先通过了欧盟人工智能法案。该法案分阶段实施,从2025年到2027年逐步生效,而非一次性完成。禁止行为于2025年2月2日开始强制执行。通用人工智能规则于2025年8月2日生效。高风险系统义务自2026年8月2日起生效,受监管产品的扩展条款则于一年后的2027年8月2日生效。罚款并非儿戏。对于最严重的违规行为,罚款金额高达3500万欧元或全球营业额的7%;对于其他违规行为,罚款金额为1500万欧元或3%(DLA Piper,2025)。高风险用例清单几乎囊括了所有黑箱部署的典型案例:信用评分、招聘、教育、执法、生物识别身份识别。所有这些应用现在都默认要求提供文档、保持透明度并接受人工监督。

美国的情况更为复杂,但发展方向相同。NIST 的人工智能风险管理框架是目前最接近美国基准标准的框架。该框架于 2023 年 1 月发布,并在 2024 年和 2025 年进行了扩展,如今已悄然成为大型企业无论技术上是否必须遵循的参考文件。2025 年 12 月,NIST 发布了网络人工智能概况的初步草案 NIST IR 8596,并于 2026 年 1 月 14 日举办了后续研讨会。许多团队已经开始采用该概况。

美国消费者金融保护局(CFPB)的措辞更为直白。2022-03 号和 2023-03 号通告明确指出:如果复杂的算法导致债权人无法根据《平等信贷机会法》(ECOA)和 B 条例给出不利行动的具体理由,则债权人不得使用该算法。请仔细阅读。这并非禁止在贷款中使用机器学习,而是禁止使用过于晦涩难懂的机器学习算法,以至于无法告知被拒申请人其具体错误。实际上,这相当于对消费信贷实施了“黑箱”禁令。

银行面临着一项由来已久但更为严格的要求。美联储自2011年起实施的SR 11-7号准则要求银行证明其理解任何影响重大决策的模型。现代深度学习系统在没有帮助的情况下难以达到这一标准,而美国货币监理署(OCC)的2011-12号公告也强调了同样的做法。

最终结果:美国或欧盟任何受监管的实体都已无法再以牺牲准确性为代价来换取信息不透明。要么从最初的设计评审阶段就将可解释性纳入考量,要么构建一个混合系统,由人来解释模型无法解释的部分。没有第三条路能够经受住执法部门的审查。

如何审核黑箱人工智能系统

那么,在2026年,负责任地部署黑箱人工智能系统究竟是什么样子呢?实际操作指南比供应商声称的要简洁得多。

首先要从数据入手。记录训练数据的来源、标注者以及包含哪些子群体。之后你会遇到的偏差问题,大约有一半已经在这里埋下了伏笔;而剩下的一半你无法追溯,也就无从解决。

然后,你需要对模型进行红队攻击。使用对抗性输入、提示注入、极端情况和分布外样本来探测模型。Anthropic、OpenAI 和微软现在都发布了这方面的操作指南,你可以直接使用,而无需发明新的方法。

对生产环境中所有模型都应用 XAI,而不仅仅是那些核心模型。SHAP 用于表格数据管道。LIME 用于文本和图像。反事实分析用于任何需要用户参与的决策。这些工具都不是完美的。但另一方面,缺少它们对于任何进入你技术栈的审计人员来说都是一个危险信号。

注意模型偏差。模型失效的速度比大多数团队预期的要快。跟踪输入分布、输出分布和下游结果。针对每一项设置警报,并将无法解释的偏差视为事件,而不是异常现象。

在需要之前就建立好升级流程。每一个影响深远的模型决策都应该有人工干预机制和客户实际可以使用的、记录在案的申诉渠道。如果你的支持团队就是申诉渠道,也应该记录下来。

最后,请根据自身情况选择合适的框架。如果您在美国,请参考 NIST AI RMF;如果您在欧洲,请参考欧盟 AI 法案的高风险要求;如果您涉及消费信贷,请参考 CFPB 2022-03 和 2023-03 号通告。尽早完成这些工作,远比在执法行动到来后再进行补救要划算得多。

你不可能彻底消除黑箱。这没关系。关键在于使其可观察、可问责且有界限。这正是监管机构已经开始强制执行的标准,也是2026年成熟部署应有的样子。