Τι είναι η Τεχνητή Νοημοσύνη του Μαύρου Κουτιού; Εξήγηση του Προβλήματος του Μαύρου Κουτιού

Τον Απρίλιο του 2026, ο πίνακας κατάταξης παραισθήσεων της Vectara κατέληξε σε μια αμήχανη ετυμηγορία. Τα κορυφαία γλωσσικά μοντέλα έχουν πλέον παραισθήσεις σε λιγότερο από 4% του χρόνου στο βασικό τεστ. Αλλά οι νέες παραλλαγές «συλλογιστικής» των GPT-5, Claude Sonnet 4.5, Grok-4 και Gemini-3-Pro έχουν όλες παραισθήσεις σε ποσοστό άνω του 10% στο νέο σύνολο δεδομένων. Η γρήγορη συλλογιστική της Grok-4 έφτασε το 20,2%. Τα πιο έξυπνα μοντέλα, αυτά που «σκέφτονται» πριν απαντήσουν, είναι τα χειρότερα στο να σας πουν πότε δεν ξέρουν.

Αυτό είναι το πρόβλημα του μαύρου κουτιού σε μία παράγραφο. Έχουμε κατασκευάσει συστήματα Τεχνητής Νοημοσύνης που συχνά παράγουν χρήσιμα αποτελέσματα και τα οποία κανείς, συμπεριλαμβανομένων των δημιουργών τους, δεν μπορεί να εξηγήσει πλήρως. Είναι ακριβή χωρίς να είναι βαθμονομημένα, εύχρηστα χωρίς να είναι ειλικρινή και σίγουρα χωρίς να είναι σωστά.

Οι ρυθμιστικές αρχές το παρατήρησαν. Ο νόμος της ΕΕ για την τεχνητή νοημοσύνη επιβάλλει πλέον πρόστιμα έως και 35 εκατομμύρια ευρώ ή το 7% του παγκόσμιου κύκλου εργασιών για απαγορευμένες χρήσεις, με τους κανόνες συστήματος υψηλού κινδύνου να τίθενται σε ισχύ στις 2 Αυγούστου 2026. Το Γραφείο Χρηματοοικονομικής Προστασίας Καταναλωτών των ΗΠΑ δήλωσε ξεκάθαρα στις τράπεζες ότι δεν μπορούν να χρησιμοποιούν πολύπλοκους αλγόριθμους εάν αυτοί οι αλγόριθμοι τις εμποδίζουν να εξηγήσουν μια άρνηση πίστωσης. Και ο τομέας της εξηγήσιμης τεχνητής νοημοσύνης, ένα εξειδικευμένο θέμα πριν από πέντε χρόνια, αποτελεί πλέον μια αγορά που εκτιμάται μεταξύ 9 δισεκατομμυρίων και 13 δισεκατομμυρίων δολαρίων το 2026.

Αυτός ο οδηγός παρουσιάζει τι είναι στην πραγματικότητα η τεχνητή νοημοσύνη (black box AI), γιατί ακόμη και τα απλά μοντέλα τεχνητής νοημοσύνης γίνονται μαύρα κουτιά, τι πάει στραβά όταν συμβαίνει αυτό, πού εμφανίζονται στα κρυπτονομίσματα και τις χρηματοοικονομικές τεχνολογίες, πώς το εξηγήσιμο κιτ εργαλείων τεχνητής νοημοσύνης (SHAP, LIME, αντιπαραδείγματα) προσπαθεί να τα αποκρυπτογραφήσει και τι πρέπει να γνωρίζετε για το νέο κανονιστικό καθεστώς στην ΕΕ και τις ΗΠΑ. Υπάρχει επίσης μια σύντομη παράκαμψη για να ξεκαθαριστεί μια επαναλαμβανόμενη σύγχυση: Η Blackbox AI, ο βοηθός κωδικοποίησης στο blackbox.ai, είναι κάτι διαφορετικό.

Τι είναι η Τεχνητή Νοημοσύνη του Μαύρου Κουτιού και γιατί έχει σημασία

Η τεχνητή νοημοσύνη (ΤΝ) σε μαύρο κουτί αναφέρεται σε οποιοδήποτε σύστημα ΤΝ του οποίου η εσωτερική συλλογιστική είναι αδιαφανής για τους χρήστες και, συχνά, για τους προγραμματιστές που το κατασκεύασαν. Οι είσοδοι και οι έξοδοι είναι ορατές. Η διαδρομή μεταξύ τους είναι κρυμμένη μέσα σε επίπεδα βαρών, μαθησιακών μοτίβων και μετασχηματισμών μηχανικής μάθησης που κανένας άνθρωπος δεν μπορεί να διαβάσει πλήρως. Το ίδιο ισχύει ανεξάρτητα από το αν το μοντέλο χειρίζεται δεδομένα σε μορφή πίνακα, εικόνες ή εργασίες επεξεργασίας φυσικής γλώσσας, όπως η μετάφραση και η συνομιλία.

Η ετικέτα είναι παλαιότερη από τη σύγχρονη βαθιά μάθηση. Οι μηχανικοί χρησιμοποιούν τον όρο «μαύρο κουτί» τουλάχιστον από τη δεκαετία του 1960 για οποιοδήποτε σύστημα που μπορείτε να εξετάσετε από έξω αλλά όχι να ξεβιδώσετε. Ο ίδιος ο ανθρώπινος εγκέφαλος, όπως επισημαίνουν οι βιολόγοι, είναι επίσης ένα μαύρο κουτί, αλλά η σύγκριση φτάνει μόνο μέχρι εκεί: μια Τεχνητή Νοημοσύνη δεν λειτουργεί όπως ένας άνθρωπος, και η υπόθεση ότι λειτουργεί είναι ένας από τους πιο γρήγορους τρόπους για να κρίνουμε λανθασμένα τι αναφέρεται στην Τεχνητή Νοημοσύνη μαύρου κουτιού. Αυτό που άλλαξε την τελευταία δεκαετία είναι η κλίμακα. Ένα σύγχρονο μοντέλο μεγάλης γλώσσας μπορεί να μεταφέρει εκατοντάδες δισεκατομμύρια παραμέτρους. Ένα τυπικό βαθύ νευρωνικό δίκτυο διαδίδει «γνώση» σε χιλιάδες επίπεδα και εκατομμύρια κεφαλές προσοχής, με μεμονωμένους νευρώνες να κωδικοποιούν πολλαπλά άσχετα μοτίβα ταυτόχρονα. Οι ερευνητές ονομάζουν αυτή την τελευταία ιδιότητα πολυσημασιολογία, και είναι ένας από τους λόγους για τους οποίους η μηχανιστική ερμηνευσιμότητα βρίσκεται ακόμη στα πρώτα της βήματα.

Γιατί να ενδιαφέρει οποιονδήποτε εκτός ερευνητικών εργαστηρίων; Επειδή η τεχνητή νοημοσύνη (ΤΝ) σε μαύρο κουτί λαμβάνει πλέον επακόλουθες αποφάσεις. Εγκρίνει και απορρίπτει την πίστωση. Βαθμολογεί τους κατηγορούμενους. Επισημαίνει τις συναλλαγές ως απάτη. Διαχειρίζεται ένα μεγάλο μερίδιο του όγκου συναλλαγών σε κάθε μεγάλο χρηματιστήριο κρυπτονομισμάτων. Όταν κάτι κάνει λάθος, η αδιαφάνεια καθιστά σχεδόν αδύνατο να ανακαλύψει κανείς το γιατί, να το διορθώσει ή να θεωρήσει οποιονδήποτε υπεύθυνο.

Έχει επίσης σημασία επειδή η διακυβέρνηση της Τεχνητής Νοημοσύνης δεν αντιμετωπίζει πλέον την αδιαφάνεια ως πρόβλημα του προγραμματιστή. Η ΕΕ την αντιμετωπίζει πλέον ως ζήτημα πρόσβασης στην αγορά. Οι ρυθμιστικές αρχές των ΗΠΑ την αντιμετωπίζουν ως ζήτημα δίκαιης χρηματοδότησης. Κάθε στέλεχος που έχει εγκρίνει μια πρωτοβουλία για την Τεχνητή Νοημοσύνη από το 2024 έχει συναντήσει το ίδιο δίλημμα: τι κάνει στην πραγματικότητα αυτό το πράγμα και γιατί; Η κατανόηση της Τεχνητής Νοημοσύνης ως μαύρου κουτιού δεν είναι πλέον προαιρετική και δεν μπορείτε να λύσετε το πρόβλημα του μαύρου κουτιού απλώς χρησιμοποιώντας έναν διαφορετικό προμηθευτή.

Γιατί τα μοντέλα τεχνητής νοημοσύνης γίνονται μαύρα κουτιά

Δεν είναι κάθε Τεχνητή Νοημοσύνη ένα μαύρο κουτί. Ένα απλό δέντρο αποφάσεων είναι πλήρως διαφανές. Ένα γραμμικό μοντέλο παλινδρόμησης εμφανίζει συντελεστές που μπορείτε να διαβάσετε. Ακόμη και ένα σύστημα Τεχνητής Νοημοσύνης που βασίζεται σε κανόνες από τη δεκαετία του 1990 είναι, κατ' αρχήν, ελέγξιμο γραμμή προς γραμμή.

Πώς, λοιπόν, τα σημερινά μοντέλα τεχνητής νοημοσύνης γίνονται μαύρα κουτιά; Αυτό συμβαίνει για τέσσερις αλληλεπικαλυπτόμενους λόγους.

Πρώτον, η κλίμακα. Τα μοντέλα βαθιάς μάθησης με εκατομμύρια ή δισεκατομμύρια παραμέτρους λειτουργούν σε χώρους υψηλών διαστάσεων που οι άνθρωποι δεν μπορούν να απεικονίσουν. Μπορείτε να περιγράψετε ένα μοντέλο 200 δισεκατομμυρίων παραμέτρων στα μαθηματικά, αλλά κανείς δεν μπορεί να το κρατήσει στο μυαλό του.

Δεύτερον, κατανεμημένες αναπαραστάσεις. Σε ένα βαθύ νευρωνικό δίκτυο, κανένας μεμονωμένος νευρώνας δεν αποθηκεύει «την έννοια της γάτας» ή «τον κανόνα απόρριψης ενός δανείου». Οι έννοιες διαχέονται σε χιλιάδες νευρώνες και μεμονωμένοι νευρώνες συμμετέχουν σε πολλές έννοιες ταυτόχρονα. Η εξαγωγή μιας σαφούς εξήγησης είναι ένα ερευνητικό έργο, όχι ένα ερώτημα.

Τρίτον, η εξάρτηση από τα δεδομένα εκπαίδευσης. Η συμπεριφορά του μοντέλου διαμορφώνεται από τα δεδομένα εκπαίδευσης, τα οποία συνήθως είναι ιδιόκτητα, γιγαντιαία και μερικές φορές νομικά επιβαρυμένα. Ακόμα και όταν ένας προγραμματιστής δημοσιεύει τα βάρη του μοντέλου, τα δεδομένα σπάνια κοινοποιούνται. Έτσι, λείπει ένα βασικό μέρος του «γιατί».

Τέταρτον, πρόθεση. Υπάρχουν πρακτικοί λόγοι για να χρησιμοποιούνται σκόπιμα οι προσεγγίσεις του μαύρου κουτιού. Ορισμένοι προγραμματιστές και προγραμματιστές τεχνητής νοημοσύνης αποκρύπτουν σκόπιμα τα εσωτερικά στοιχεία του μοντέλου για να προστατεύσουν την πνευματική ιδιοκτησία, και άλλοι λόγοι για να χρησιμοποιούνται σχέδια μαύρου κουτιού περιλαμβάνουν τους όρους αδειοδότησης και τις ανταγωνιστικές τάφρους. Ακόμη και ένα μοντέλο ανοιχτού βάρους μπορεί αποτελεσματικά να δημιουργήσει ένα μαύρο κουτί γύρω από τις αποφάσεις του, επειδή τα περισσότερα σύγχρονα μοντέλα βασίζονται σε αναδυόμενα μοτίβα χωρίς καταγραφή τεκμηρίωσης. Μια εταιρεία που έχει επενδύσει 100 εκατομμύρια δολάρια σε ένα μοντέλο δεν είναι πρόθυμη να δημοσιεύσει την αρχιτεκτονική και τη διαδικασία εκπαίδευσής της. Τα μοντέλα τεχνητής νοημοσύνης ανοιχτού κώδικα που μοιράζονται τον υποκείμενο κώδικά τους είναι τελικά και αυτά μαύρα κουτιά, επειδή οι χρήστες εξακολουθούν να μην μπορούν να ελέγξουν τα βάρη που έχουν μάθει με οποιαδήποτε ουσιαστική ερμηνεία.

Το αποτέλεσμα είναι ότι ακόμη και τα φαινομενικά απλά προηγμένα μοντέλα Τεχνητής Νοημοσύνης (ΤΝ), συμπεριλαμβανομένων των LLM και των μοντέλων γενετικής ΤΝ, γίνονται εξ ορισμού μαύρα κουτιά. Τα διαφανή μοντέλα αποτελούν την εξαίρεση, όχι τον κανόνα. Τα σύνθετα μαύρα κουτιά μπορούν να προσφέρουν εντυπωσιακή ακρίβεια, γι' αυτό και οι ομάδες συνεχίζουν να τα αναπτύσσουν παρά την αδιαφάνεια. Το ίδιο ισχύει και για τα μοντέλα ΤΝ τύπου μαύρου κουτιού που έχουν εκπαιδευτεί σε πλούσια, ακατάστατα δεδομένα: η αύξηση των μοντέλων ΤΝ που βασίζονται σε κανόνες είναι συχνά αρκετά μεγάλη ώστε να παρακάμψει τις ανησυχίες για την επεξήγηση μέχρι να χαλάσει κάτι. Τα περισσότερα σύγχρονα ΤΝ τύπου μαύρου κουτιού είναι τελικά μαύρα κουτιά επειδή οι χρήστες εξακολουθούν να μην μπορούν να ελέγξουν τα βάρη που έχουν μάθει. Τα μοντέλα ανοιχτού βάρους μοιράζονται τον υποκείμενο κώδικά τους και οι χρήστες μπορούν να διαβάσουν την αρχιτεκτονική, αλλά ο υποκείμενος κώδικας είναι τελικά μαύρα κουτιά όταν ρωτάτε "γιατί το είπε αυτό το μοντέλο;".

Το πρόβλημα του μαύρου κουτιού στη βαθιά μάθηση

Το πρόβλημα του μαύρου κουτιού είναι αυτό που προκύπτει όταν αυτοί οι τέσσερις λόγοι συνδυάζονται. Το μοντέλο λειτουργεί, συχνά εντυπωσιακά. Αλλά λειτουργεί με τρόπο που αντιστέκεται σε τρία πράγματα ταυτόχρονα: εξήγηση, επικύρωση και διόρθωση.

Πάρτε το κλασικό παράδειγμα: ένα μοντέλο βαθιάς μάθησης εκπαιδευμένο να αναγνωρίζει πάντα. Βαθμολογείται με 99% στο σύνολο δοκιμών. Φαίνεται υπέροχο. Στη συνέχεια, κάποιος εκτελεί ένα εργαλείο ερμηνείας και ανακαλύπτει ότι το μοντέλο δεν κοιτάζει πραγματικά το πάντα. Δίνει προσοχή στο μπαμπού. Οι περισσότερες φωτογραφίες πάντα στα δεδομένα εκπαίδευσης περιέχουν επίσης μπαμπού. Το μοντέλο έμαθε μια συντόμευση. Σε μια φωτογραφία πάντα χωρίς μπαμπού, το μοντέλο αποτυγχάνει.

Αυτό το είδος «μάθησης με συντομεύσεις» υπάρχει παντού στη βαθιά μάθηση. Το μοντέλο βρίσκει μια στατιστική κανονικότητα που δεν ταιριάζει με την υποκείμενη έννοια, αλλά το παρατηρείτε μόνο όταν ο κόσμος φαίνεται ελαφρώς διαφορετικός από το σύνολο εκπαίδευσης. Η οικονομική κρίση του 2008 είναι η ιστορική αναλογία εδώ. Τα μοντέλα Value-at-Risk που βασίζονται σε Γκαουσιανές υποθέσεις λειτούργησαν άψογα σε κανονικές αγορές και εξερράγησαν σε συνθήκες ουράς, επειδή είχαν μάθει συντομεύσεις που οι δημιουργοί του μοντέλου δεν συνειδητοποίησαν ότι ήταν συντομεύσεις.

Τα σημερινά μοντέλα βαθιάς μάθησης μοιράζονται ακριβώς αυτόν τον τρόπο αποτυχίας, με περισσότερες παραμέτρους και μεγαλύτερη εμπιστοσύνη. Οι ερευνητές μηχανιστικής ερμηνευσιμότητας, συμπεριλαμβανομένων ομάδων της Anthropic και της OpenAI, έχουν ξεκινήσει την αντίστροφη μηχανική μικρών τμημάτων γλωσσικών μοντέλων νευρώνα προς νευρώνα. Η εργασία τους δείχνει ότι το εσωτερικό ενός LLM είναι πιο κοντά σε εμπλεγμένα κυκλώματα παρά σε τακτοποιημένη λογική. Δεν υπάρχει σημείο στο οποίο μπορείτε να βάλετε το δάχτυλό σας και να πείτε «εδώ βρίσκεται η απάντηση». Το πρόβλημα του μαύρου κουτιού δεν είναι ένα σφάλμα που πρέπει να διορθωθεί. είναι δομικό.

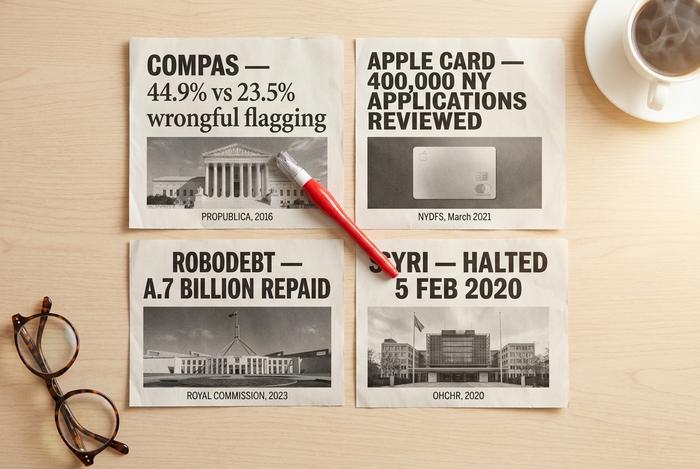

Παραδείγματα Τεχνητής Νοημοσύνης Μαύρου Κουτιού: COMPAS, Apple Card, Robodebt, SyRI

Θέλετε να δείτε πώς μοιάζει ένα μαύρο κουτί τεχνητής νοημοσύνης όταν πέφτει; Οι τέσσερις υποθέσεις που όλοι αναφέρουν σας λένε τα περισσότερα από όσα πρέπει να γνωρίζετε. Καλύπτουν την ποινική δικαιοσύνη, τις τράπεζες και την κοινωνική πρόνοια. Όλες πλήγωσαν πραγματικούς ανθρώπους. Και καμία δεν απέτυχε με τον ίδιο τρόπο.

Ξεκινήστε με το COMPAS. Το Northpointe το κατασκεύασε για να προβλέψει εάν ένας κατηγορούμενος θα υποτροπιάσει, και τα αμερικανικά δικαστήρια το εφάρμοσαν ευρέως. Στη συνέχεια, η ProPublica εξέτασε το θέμα. Ο έλεγχός τους το 2016 εξέτασε τα δεδομένα σε πάνω από 7.000 συλληφθέντες από την κομητεία Broward και το αποτέλεσμα ήταν άσχημο: Οι μαύροι κατηγορούμενοι χαρακτηρίστηκαν λανθασμένα ως υψηλού κινδύνου στο 44,9% των περιπτώσεων, ενώ το ποσοστό για τους λευκούς κατηγορούμενους ήταν μόλις 23,5%. Μια συμπληρωματική εργασία του 2024 το έκανε χειρότερο. Δύο χαρακτηριστικά (ηλικία και προηγούμενες καταδίκες) ταίριαζαν με την ακρίβεια του 137 του COMPAS. Έτσι, η πολυπλοκότητα δεν αγόρασε κυριολεκτικά κανένα επιπλέον σήμα, αλλά έκανε την προκατάληψη πολύ πιο δύσκολο να εντοπιστεί. Αυτό είναι το κανονικό μοντέλο μαύρου κουτιού που αξιολογεί τους ανθρώπους αντί για τα προϊόντα. Το μοντέλο κουτιού που αξιολογεί τους αιτούντες εργασία, αυτό που η Amazon απέσυρε το 2018, ταιριάζει στο ίδιο σχήμα.

Έπειτα, η Apple Card, στα τέλη του 2019. Ο Wozniak είπε ότι η σύζυγός του είχε πιστωτικό όριο 10 φορές χαμηλότερο από το δικό του. Ο David Heinemeier Hansson είπε το ίδιο. Η ιστορία έγινε viral. Το Υπουργείο Οικονομικών Υπηρεσιών της Νέας Υόρκης το πήρε σοβαρά: συγκέντρωσαν περίπου 400.000 αιτήσεις και τις εξέτασαν. Τον Μάρτιο του 2021, επέστρεψαν με μια ετυμηγορία ότι δεν υπήρχε καμία νομοθετική διάκριση λόγω φύλου. Αλλά έγραψαν επίσης, και αυτό είναι το κομμάτι που έχει σημασία, ότι η αδιαφάνεια της εμπειρίας του πελάτη ήταν ένα πρόβλημα εμπιστοσύνης από μόνο του. Η ζημιά στο μαύρο κουτί, όπως αποδεικνύεται, σχετίζεται κατά το ήμισυ με τα αποτελέσματα και κατά το ήμισυ με την αντίληψη. Ένα δελτίο τύπου δεν διορθώνει την πλευρά της αντίληψης.

Το Robodebt είναι η άλλη όψη του νομίσματος. Δεν εμπλέκεται κανένα βαθύ νευρωνικό δίκτυο. Η Αυστραλία εφάρμοσε έναν κανόνα υπολογισμού του μέσου όρου εισοδήματος σε σχέση με τα αρχεία κοινωνικής πρόνοιας μεταξύ 2016 και 2019, κατηγόρησε περίπου 400.000 δικαιούχους για απάτη και δεν μπόρεσε να εξηγήσει με συνεκτικό τρόπο τον υπολογισμό σε κανέναν που έλαβε την επιστολή. Μια Βασιλική Επιτροπή αργότερα χαρακτήρισε το σχέδιο παράνομο. Η κυβέρνηση επέστρεψε 1,7 δισεκατομμύρια δολάρια Αυστραλίας συν άλλα 112 εκατομμύρια δολάρια Αυστραλίας σε αποζημίωση. Μάθημα: ένα σύστημα δεν χρειάζεται να είναι τεχνικά εξελιγμένο για να είναι ένα μαύρο κουτί. Απλώς πρέπει να είναι μη λογοδοτήσιμο.

Η ολλανδική υπόθεση toeslagenaffaire και το SyRI αποτελούν το ευρωπαϊκό θησαυροφυλάκιο. Στις 5 Φεβρουαρίου 2020, ένα ολλανδικό δικαστήριο διέταξε την άμεση διακοπή του SyRI, κρίνοντας ότι η αδιαφάνειά του παραβίαζε το Άρθρο 8 της Ευρωπαϊκής Σύμβασης για τα Δικαιώματα του Ανθρώπου. Το σχετικό σκάνδαλο με τα επιδόματα παιδικής φροντίδας σάρωσε πάνω από 20.000 γονείς που κατηγορήθηκαν άδικα για απάτη. Η κυβέρνηση Ρούτε παραιτήθηκε εξαιτίας αυτού τον Ιανουάριο του 2021. Η απόφαση αυτή αποτελεί πλέον το τυπικό σημείο αναφοράς στους πολιτικούς κύκλους της ΕΕ για το γιατί η αδιαφανής Τεχνητή Νοημοσύνη σε περιβάλλοντα υψηλού διακυβεύματος δεν είναι ένα ήπιο ζήτημα ηθικής, αλλά ένα νομικό.

Τέσσερις περιπτώσεις. Διαφορετικοί τομείς, διαφορετικές τεχνολογίες, διαφορετικές χώρες. Το ίδιο μοτίβο: ένα αδιαφανές σύστημα, μια επακόλουθη απόφαση και άνθρωποι που δέχονται την επίθεση χωρίς πραγματικό τρόπο να αντιδράσουν.

Κίνδυνος Τεχνητής Νοημοσύνης σε Συστήματα Τεχνητής Νοημοσύνης του Μαύρου Κουτιού σε Πραγματικά Συστήματα Τεχνητής Νοημοσύνης

Μόλις ξεκινήσετε την καταγραφή του κινδύνου τεχνητής νοημοσύνης στο μαύρο κουτί σε συστήματα τεχνητής νοημοσύνης πραγματικού κόσμου, εμφανίζεται ένα μοτίβο. Οι ίδιοι πέντε κίνδυνοι εμφανίζονται ξανά και ξανά, ανεξάρτητα από το αν το μοντέλο είναι ένα σύστημα αξιολόγησης πιστοληπτικής ικανότητας, ένα chatbot ή ένα αλγοριθμικό σύστημα συναλλαγών.

| Κίνδυνος | Πώς μοιάζει | Γιατί κλιμακώνεται |

|---|---|---|

| Κρυφή προκατάληψη | Το μοντέλο αντιμετωπίζει τις προστατευόμενες ομάδες διαφορετικά | Τα δεδομένα εκπαίδευσης φέρουν ιστορικά μοτίβα |

| Παραίσθηση | Το μοντέλο επινοεί γεγονότα ή παραπομπές | Τα LLM βελτιστοποιούν την ευχέρεια, όχι την αλήθεια |

| Μάθηση με συντομεύσεις | Το μοντέλο βασίζεται σε άσχετες συσχετίσεις | Πιο εύκολο να το μάθεις από την πραγματική ιδέα |

| Ετερματικότητα | Μικρή αλλαγή εισόδου αντιστρέφει την έξοδο | Όρια αποφάσεων υψηλής διάστασης |

| Ανάλυση ελέγχου | Δεν μπορώ να ανακατασκευάσω το γιατί | Δεν υπάρχει ερμηνεύσιμη εσωτερική κατάσταση |

Αυτοί οι κίνδυνοι επιδεινώνονται σε όλα τα συστήματα τεχνητής νοημοσύνης (ΤΝ) που χρησιμοποιούνται στα χρηματοοικονομικά, τις προσλήψεις, την υγειονομική περίθαλψη και τα κρυπτονομίσματα. Οι πολύπλοκες διαδικασίες βαθιάς μάθησης που εμπεριέχουν καθιστούν δύσκολη την πρόβλεψη της επόμενης αποτυχίας, και τα παραδοσιακά εργαλεία ΤΝ για τη διασφάλιση ποιότητας δεν έχουν κατασκευαστεί για μοντέλα με εκατοντάδες δισεκατομμύρια παραμέτρους.

Η κρυφή προκατάληψη γίνεται πρωτοσέλιδο, αλλά η αντιφατική ευθραυστότητα και η κατανομή του ελέγχου είναι τα μεγαλύτερα μακροπρόθεσμα προβλήματα. Μια σταθερή προκατάληψη μπορεί τουλάχιστον να μετρηθεί και να διορθωθεί. Ένα μοντέλο που αποτυγχάνει διαφορετικά κάθε φορά που το εκτελείτε (κάτι που κάνει το ChatGPT, σε περίπου 42% των εργασιών αξιολόγησης έξυπνων συμβάσεων σύμφωνα με μια μελέτη ACM TOSEM του 2024) είναι πολύ πιο δύσκολο να πιστοποιηθεί για ρυθμιζόμενη χρήση.

Η νεότερη προσθήκη σε αυτήν τη λίστα είναι αυτό που οι ερευνητές ονομάζουν «κίνδυνος τεχνητής νοημοσύνης πρακτόρων». Όταν συνδέετε ένα LLM σε εργαλεία, του δίνετε μνήμη και το αφήνετε να καλεί API, αυξάνετε την αδιαφάνεια. Μια ενιαία απόφαση είναι πλέον μια αλυσίδα κλήσεων μοντέλων, ανακτημένων εγγράφων και κλήσεων εργαλείων, καθεμία από τις οποίες είναι μερικώς αδιαφανής. Οι σύγχρονοι πράκτορες είναι μαύρα κουτιά μέσα σε μαύρα κουτιά.

Μαύρο Κουτί Τεχνητής Νοημοσύνης σε Κρυπτονομίσματα και Fintech

Από κάθε κλάδο που χρησιμοποιεί την Τεχνητή Νοημοσύνη (black box AI), τα κρυπτονομίσματα και η χρηματοοικονομική τεχνολογία (fintech) είναι εκείνα όπου η πλευρά της ανάπτυξης συγκρούονται περισσότερο με την πλευρά του κινδύνου. Τα διακυβεύματα είναι μεγάλα. Η καθυστέρηση είναι σύντομη. Η γνωστοποίηση είναι περιορισμένη. Η ρύθμιση, ειδικά στα κρυπτονομίσματα, εξακολουθεί να είναι ένα συνονθύλευμα. Το αποτέλεσμα είναι ένα περιβάλλον που ανταμείβει την ανάπτυξη πρώτα και τη σύνταξη της τεκμηρίωσης στη συνέχεια.

Αλγοριθμικές συναλλαγές. Οι αλγοριθμικές συναλλαγές οδήγησαν περίπου στο 70-80% του όγκου των κρυπτονομισμάτων το 2025, υψηλότερο από το μερίδιο 60-70% στις μεγάλες χρηματιστηριακές αγορές. Μόνο το Wintermute διακινεί περισσότερα από 15 δισεκατομμύρια δολάρια σε πάνω από 60 χώρους σε μια μέση ημέρα, με ρεκόρ 2,24 δισεκατομμυρίων δολαρίων σε μια μέρα που αναφέρθηκε το 2025. Οι στρατηγικές πίσω από αυτές τις ροές είναι σύνολα βαθιάς μάθησης που κανένας εξωτερικός παρατηρητής δεν μπορεί να ελέγξει. Η κατάρρευση της Alameda/FTX τον Νοέμβριο του 2022 είναι η πιο ξεκάθαρη απεικόνιση του κινδύνου: η συνολική κεφαλαιοποίηση της αγοράς κρυπτονομισμάτων μειώθηκε από πάνω από 1 τρισεκατομμύριο δολάρια σε λιγότερο από 800 δισεκατομμύρια δολάρια σε περίπου ένα μήνα και η υποκείμενη έκθεση σε FTT ύψους 14,6 δισεκατομμυρίων δολαρίων στον ισολογισμό της Alameda ήταν αόρατη μέχρι τη στιγμή που δεν ήταν.

Βαθμολογία AML και KYC. Η παγκόσμια αγορά λογισμικού για την καταπολέμηση της νομιμοποίησης εσόδων από παράνομες δραστηριότητες έφτασε τα 4,13 δισεκατομμύρια δολάρια το 2025 και προβλέπεται να φτάσει τα 9,38 δισεκατομμύρια δολάρια έως το 2030 (MarketsandMarkets). Η συμμόρφωση με τα κρυπτονομίσματα AML/KYC αυξάνεται συγκεκριμένα με CAGR 13,8%. Προμηθευτές όπως οι ComplyAdvantage, Chainalysis Reactor και Elliptic Navigator χρησιμοποιούν πλέον μοντέλα μηχανικής μάθησης μαύρου κουτιού για τη βαθμολόγηση κινδύνου πορτοφολιού. Η χρήση μηχανικής μάθησης μαύρου κουτιού εδώ είναι αρκετά διαδεδομένη και αποτελεσματική ώστε να αναπτυχθεί στα περισσότερα μεγάλα χρηματιστήρια, και αρκετά αδιαφανής ώστε οι υπεύθυνοι συμμόρφωσης συχνά να μην μπορούν να αναπαραστήσουν γιατί ένα συγκεκριμένο πορτοφόλι μπλοκαρίστηκε.

Έλεγχος έξυπνων συμβολαίων. Εδώ είναι που τα όρια της Τεχνητής Νοημοσύνης φαίνονται ξεκάθαρα. Μια μελέτη arXiv του 2024 αξιολόγησε το GPT-4 στην ανίχνευση ευπαθειών σε έξυπνα συμβόλαια. Έφτασε σε ακρίβεια 96,6%, αλλά μόνο σε ανάκληση 37,8%, χάνοντας σχεδόν τα δύο τρίτα των πραγματικών ελαττωμάτων. Οι έξοδοι του ChatGPT είναι ασταθείς σε όλες τις εκτελέσεις στο 42% των συμβολαίων (ACM TOSEM 2024). Υβριδικά εργαλεία όπως το GPTScan, τα οποία συνδυάζουν το GPT με στατική ανάλυση, υπερβαίνουν την ακρίβεια 90% και την ανάκληση ~70% σε συμβόλαια token (arXiv 2308.03314). Το CertiK Skynet παρακολουθεί πλέον πάνω από 17.000 έργα και περίπου 494 δισεκατομμύρια δολάρια σε αγοραία αξία, αλλά κάθε υπεύθυνη ομάδα ελέγχου εξακολουθεί να συνδυάζει την Τεχνητή Νοημοσύνη με έναν ανθρώπινο κριτή.

Ρομποτικοί σύμβουλοι. Η Betterment διαχειρίζεται περισσότερα από 56 δισεκατομμύρια δολάρια σε περισσότερους από 900.000 λογαριασμούς. Η Wealthfront ανέρχεται σε 42,9 δισεκατομμύρια δολάρια. Ο κλάδος των ρομποτικών συμβούλων έχει ξεπεράσει το 1 τρισεκατομμύριο δολάρια σε παγκόσμια AUM. Η αναδιάρθρωση χαρτοφυλακίου, η συλλογή φορολογικών ζημιών και η βαθμολόγηση κινδύνου καθοδηγούνται από μοντέλα μηχανικής μάθησης (ML) των οποίων οι συγκεκριμένες αποφάσεις δεν αποκαλύπτονται σε κανένα έγγραφο που απευθύνεται σε λιανική πώληση.

Βαθμολογία πιστοληπτικής ικανότητας και ανίχνευση απάτης. Το FICO χρησιμοποιείται από το 90% των Αμερικανών δανειστών και το FICO Falcon επεξεργάζεται πάνω από 65 δισεκατομμύρια συναλλαγές ετησίως με αναφερόμενα ποσοστά ανίχνευσης απάτης άνω του 95%. Μια μελέτη της Τράπεζας της Αγγλίας σε 50 βρετανικά ιδρύματα το 2024 διαπίστωσε ότι τα μοντέλα πιστωτικού κινδύνου ML μείωσαν τις λανθασμένες ταξινομήσεις κατά περίπου 25% σε σχέση με τη λογιστική παλινδρόμηση. Το κέρδος στην ακρίβεια είναι πραγματικό. Το συμβιβασμό είναι ότι, σύμφωνα με τις Εγκυκλίους CFPB 2022-03 και 2023-03, οι Αμερικανοί δανειστές δεν μπορούν να χρησιμοποιούν μοντέλα που είναι αρκετά αδιαφανή για να αποτρέψουν συγκεκριμένες εξηγήσεις δυσμενών ενεργειών στο πλαίσιο του ECOA.

Το μοτίβο και στα πέντε είναι το ίδιο. Το μοντέλο είναι πιο ακριβές από τη διαφανή γραμμή βάσης. Η αδιαφάνεια είναι δομικά αδιαχώριστη από την ακρίβεια. Και οι ρυθμιστές καλύπτουν το χαμένο έδαφος ταχύτερα από ό,τι τα εργαλεία εξηγησιμότητας.

Σημείωση για το Blackbox AI: The Coding LLM

Μια γρήγορη αποσαφήνιση. Όταν οι χρήστες αναζητούν "blackbox AI", συχνά εννοούν το εννοιολογικό πρόβλημα που αφορά αυτό το άρθρο. Μερικές φορές εννοούν την Blackbox AI, την εταιρεία της blackbox.ai. Το Blackbox.ai είναι ένα πρόγραμμα LLM κωδικοποίησης που έχει σχεδιαστεί για να μεταμορφώσει τον τρόπο με τον οποίο οι προγραμματιστές γράφουν κώδικα. Το προϊόν ενσωματώνεται με το VS Code ως παράγοντα κωδικοποίησης, προτείνει κώδικα και ανταγωνίζεται εργαλεία όπως το Claude Code, το GitHub Copilot και το Cursor. Είναι μια από τις πιο γνωστές προηγμένες τεχνολογίες AI στον χώρο του κωδικοποίησης AI, βασισμένη σε πολλαπλά μοντέλα AI, και ο κώδικας που προτείνει το Blackbox καλύπτει τα πάντα, από αναδιαμορφώσεις έως σκαλωσιές δοκιμών. Το Blackbox ενσωματώνει τη δημιουργία κώδικα, τη συνομιλία και την αναζήτηση σε μία ροή εργασίας και οι περισσότεροι χρήστες θα το αποκαλούσαν τον καλύτερο βοηθό AI που έχουν δοκιμάσει μέσα στον επεξεργαστή τους.

Οι δύο έννοιες συχνά μπερδεύονται στα αποτελέσματα αναζήτησης. Το προϊόν Blackbox AI δεν αποτελεί αντικείμενο αυτού του άρθρου. Εξετάζουμε τη δομική ιδιότητα των αδιαφανών συστημάτων AI, όχι κάποιον μεμονωμένο βοηθό κωδικοποίησης. Εάν αναζητήσατε το προϊόν, η εταιρεία διατηρεί τη δική της τεκμηρίωση και τιμολόγηση. Εάν αναζητήσατε την έννοια, συνεχίστε να διαβάζετε.

Εξηγήσιμη Τεχνητή Νοημοσύνη και Εργαλεία Εξηγησιμότητας

Η εξηγήσιμη Τεχνητή Νοημοσύνη, που συνήθως συντομεύεται ως XAI, είναι ο τομέας που προσπαθεί να αποσπάσει αδιαφανή μοντέλα Τεχνητής Νοημοσύνης χωρίς να υπονομεύσει την ακρίβειά τους. Είναι επίσης μια πραγματική αγορά πλέον. Οι προβλέψεις για το 2026 κυμαίνονται μεταξύ 9 και 13 δισεκατομμυρίων δολαρίων παγκοσμίως, με το χάσμα να εξαρτάται από το ποιον ορισμό της XAI αποδέχεστε. Ο στόχος είναι να γίνουν τα μοντέλα Τεχνητής Νοημοσύνης πιο εξηγήσιμα χωρίς να αναγκάζονται οι ομάδες να επιστρέψουν σε πιο αργές ή λιγότερο ακριβείς βασικές γραμμές. Οι έξυπνες ομάδες εκτελούν αυτά τα εργαλεία σε εργαλεία Τεχνητής Νοημοσύνης πριν τα κυκλοφορήσουν και συνδυάζουν το αποτέλεσμα με τεκμηρίωση που μπορεί πραγματικά να διαβάσει ένας ανθρώπινος κριτής.

Αξίζει να γνωρίζουμε τρεις οικογένειες τεχνικών XAI.

Το πρώτο είναι το SHAP, συντομογραφία του SHapley Additive exPlanations. Είναι δανεισμένο από τη θεωρία συνεργατικών παιγνίων: για κάθε πρόβλεψη, το SHAP αποδίδει μια βαθμολογία συνεισφοράς σε κάθε χαρακτηριστικό εισόδου. Οι ομάδες βαθμολόγησης πιστοληπτικής ικανότητας το λατρεύουν. Οι ομάδες ανίχνευσης απάτης το λατρεύουν. Οι κατασκευαστές μοντέλων κινδύνου υγειονομικής περίθαλψης το ανέχονται. Το SHAP είναι θεωρητικά αυστηρό, αλλά υπολογιστικά είναι ένα θηρίο για μεγάλα πινακοποιημένα δεδομένα.

Το δεύτερο είναι το LIME, Local Interpretable Model-agnostic Explanations (Επεξηγήσεις που δεν εξαρτώνται από το τοπικό ερμηνεύσιμο μοντέλο). Το LIME δημιουργεί ένα απλό, ερμηνεύσιμο υποκατάστατο μοντέλο γύρω από μια μόνο πρόβλεψη και τη χρησιμοποιεί για να εξηγήσει την πρωτότυπη. Ταχύτερο από το SHAP. Λειτουργεί σε κείμενο, εικόνες και πίνακες. Το πρόβλημα είναι ότι το LIME είναι τοπικό εκ σχεδιασμού, επομένως μπορεί να σας παραπλανήσει αν υποθέσετε ότι μια εξήγηση γενικεύει.

Το τρίτο είναι οι εξηγήσεις με βάση τα αντιπαράδειγμα. Αντί να σας πουν γιατί το μοντέλο είπε ναι, τα αντιπαράδειγμα σας λένε τη μικρότερη αλλαγή εισόδου που θα είχε μετατρέψει την απάντηση σε όχι. Αυτό ακριβώς θέλει να μάθει ένας αιτών πίστωση ή μια συναλλαγή με σημαία: «Τι θα έπρεπε να αλλάξω;». Τα αντιπαράδειγμα κερδίζουν γρήγορα έδαφος στις ειδοποιήσεις αρνητικών ενεργειών, ακριβώς επειδή αντιστοιχούν ξεκάθαρα στις προσδοκίες των ρυθμιστικών αρχών.

Πέρα από αυτά τα τρία, θα δείτε γραφήματα σπουδαιότητας χαρακτηριστικών, οπτικοποίηση προσοχής για επίπεδα μετασχηματιστών και Grad-CAM για ταξινομητές εικόνας. Η μηχανιστική ερμηνευσιμότητα, η πρακτική της αντίστροφης μηχανικής συγκεκριμένων νευρώνων και κυκλωμάτων προσοχής, βρίσκεται στην αιχμή του δόρατος του τομέα. Η Anthropic, η OpenAI και μια χούφτα ακαδημαϊκά εργαστήρια έχουν δημοσιεύσει μερικά κυκλώματα, αλλά η εργασία δεν έχει ακόμη μεταφραστεί σε κάτι που μπορεί να παρουσιάσει μια ομάδα συμμόρφωσης επιχειρήσεων.

Να είστε ειλικρινείς σχετικά με το πού καταλήγουν όλα αυτά. Η έρευνα του κλάδου που δημοσιεύτηκε από την Palo Alto Networks και άλλους φορείς σημειώνει ότι το XAI λειτουργεί καλά για ταξινομητές εικόνων και δομημένα μοντέλα σε μορφή πίνακα, και μόνο εν μέρει για LLM. Η λογική μέσα σε ένα γλωσσικό μοντέλο μεταβάλλεται καθώς αλλάζει η θέση του διακριτικού και το παράθυρο περιβάλλοντος, επομένως οι βαθμολογίες απόδοσης χαρακτηριστικών μπορούν να παραπλανήσουν με τρόπους για τους οποίους η ίδια η εξήγηση δεν σας προειδοποιεί. Τα εργαλεία εξηγησιμότητας που μοιράζονται τον υποκείμενο κώδικά τους είναι χρήσιμα. Δεν αποτελούν μια ολοκληρωμένη λύση στο πρόβλημα του μαύρου κουτιού.

Ρύθμιση της Τεχνητής Νοημοσύνης του Μαύρου Κουτιού: Νόμος της ΕΕ για την Τεχνητή Νοημοσύνη, NIST, CFPB

Οι περισσότεροι προμηθευτές τεχνητής νοημοσύνης δεν περίμεναν οι ρυθμιστικές αρχές να κινηθούν τόσο γρήγορα. Και το έκαναν. Η παλιά νοοτροπία «αποστολή τώρα, έγγραφο αργότερα» οδεύει προς την κατάργησή της και ο λόγος είναι μια μικρή χούφτα κανόνων.

Η Ευρώπη έφτασε πρώτη εκεί με τον Νόμο της ΕΕ για την Τεχνητή Νοημοσύνη. Πρόκειται για μια σταδιακή εφαρμογή από το 2025 έως το 2027, χωρίς καμία αλλαγή. Οι απαγορευμένες πρακτικές τέθηκαν σε ισχύ στις 2 Φεβρουαρίου 2025. Οι κανόνες γενικής χρήσης για την Τεχνητή Νοημοσύνη τέθηκαν σε ισχύ στις 2 Αυγούστου 2025. Οι υποχρεώσεις συστήματος υψηλού κινδύνου ισχύουν από τις 2 Αυγούστου 2026 και η επέκταση των ρυθμιζόμενων προϊόντων πραγματοποιείται ένα χρόνο αργότερα, στις 2 Αυγούστου 2027. Τα πρόστιμα δεν είναι θεαματικά. 35 εκατομμύρια ευρώ ή 7% του παγκόσμιου κύκλου εργασιών για τις πιο σοβαρές παραβιάσεις, 15 εκατομμύρια ευρώ ή 3% για τα υπόλοιπα (DLA Piper, 2025). Και η λίστα με τις περιπτώσεις χρήσης υψηλού κινδύνου μοιάζει με μια λίστα με τις εφαρμογές μαύρου κουτιού: πιστωτική αξιολόγηση, προσλήψεις, εκπαίδευση, επιβολή του νόμου, βιομετρική ταυτότητα. Κάθε ένα από αυτά απαιτεί πλέον τεκμηρίωση, διαφάνεια και ανθρώπινη εποπτεία εξ ορισμού.

Η αμερικανική εικόνα είναι πιο μπερδεμένη, αλλά κινείται προς την ίδια κατεύθυνση. Το Πλαίσιο Διαχείρισης Κινδύνων Τεχνητής Νοημοσύνης του NIST είναι το πιο κοντινό σε ένα βασικό σενάριο των ΗΠΑ. Κυκλοφόρησε τον Ιανουάριο του 2023, επεκτάθηκε κατά τη διάρκεια του 2024 και του 2025 και έχει γίνει σιωπηλά το έγγραφο με το οποίο οι μεγάλες επιχειρήσεις χαρτογραφούν τον εαυτό τους, ανεξάρτητα από το αν τεχνικά πρέπει ή όχι. Τον Δεκέμβριο του 2025, το NIST IR 8596, το προκαταρκτικό προσχέδιο του Προφίλ Κυβερνο-Τεχνητής Νοημοσύνης, πραγματοποιήθηκε με ένα εργαστήριο παρακολούθησης στις 14 Ιανουαρίου 2026. Πολλές ομάδες το υιοθετούν ήδη.

Το Γραφείο Προστασίας Χρηματοοικονομικών Καταναλωτών ήταν πιο απότομο. Οι εγκύκλιοι 2022-03 και 2023-03 το αναφέρουν ευθέως: ένας πιστωτής δεν μπορεί να χρησιμοποιήσει έναν πολύπλοκο αλγόριθμο εάν η πολυπλοκότητα τον εμποδίζει να δώσει τους συγκεκριμένους λόγους για μια δυσμενή ενέργεια βάσει του ECOA και του Κανονισμού Β. Διαβάστε το προσεκτικά. Δεν πρόκειται για απαγόρευση της μηχανικής μάθησης στον δανεισμό. Είναι μια απαγόρευση της μηχανικής μάθησης τόσο αδιαφανής που δεν μπορείτε να πείτε σε έναν αιτούντα του οποίου η αίτηση απορρίφθηκε τι έκανε λάθος. Αυτό είναι, στην πραγματικότητα, μια απαγόρευση τύπου "μαύρου κουτιού" για την καταναλωτική πίστη.

Οι τράπεζες αντιμετωπίζουν μια παλαιότερη αλλά ακόμη πιο αυστηρή απαίτηση. Το SR 11-7 της Ομοσπονδιακής Τράπεζας, που ισχύει από το 2011, αναγκάζει τις τράπεζες να αποδείξουν ότι κατανοούν οποιοδήποτε μοντέλο που οδηγεί σε μια ουσιώδη απόφαση. Τα σύγχρονα συστήματα βαθιάς μάθησης προσπαθούν να ξεπεράσουν αυτό το όριο χωρίς βοήθεια, και το Δελτίο 2011-12 της OCC επιβάλλει την ίδια προσέγγιση.

Καθαρό αποτέλεσμα: οποιαδήποτε ρυθμιζόμενη οντότητα στις ΗΠΑ ή την ΕΕ έχει ξεμείνει από δικαιολογίες για να αντιμετωπίζει την αδιαφάνεια ως αποδεκτό συμβιβασμό για την ακρίβεια. Είτε η ερμηνευσιμότητα ενσωματώνεται από την πρώτη αναθεώρηση σχεδιασμού, είτε δημιουργείτε ένα υβρίδιο όπου ένας άνθρωπος φέρει την εξήγηση που το μοντέλο δεν μπορεί. Δεν υπάρχει τρίτο μονοπάτι που να επιβιώνει μετά από μια ενέργεια επιβολής.

Πώς να ελέγξετε ένα σύστημα τεχνητής νοημοσύνης μαύρου κουτιού

Πώς, λοιπόν, θα μοιάζει στην πραγματικότητα η υπεύθυνη ανάπτυξη ενός συστήματος τεχνητής νοημοσύνης «μαύρου κουτιού» το 2026; Το πρακτικό εγχειρίδιο είναι συντομότερο από ό,τι ισχυρίζονται οι προμηθευτές.

Ξεκινάτε με τα δεδομένα. Καταγράψτε από πού προήλθαν τα δεδομένα εκπαίδευσης, ποιος τα ονόμασε και ποιες υποομάδες αντιπροσωπεύονται. Περίπου τα μισά από τα προβλήματα μεροληψίας που θα αντιμετωπίσετε αργότερα έχουν ήδη κωδικοποιηθεί εδώ και τα μισά που δεν μπορείτε να εντοπίσετε είναι τα μισά που δεν μπορείτε να διορθώσετε.

Στη συνέχεια, ομαδοποιείτε το μοντέλο με κόκκινο χρώμα. Ερευνήστε το με αντίπαλες εισροές, άμεσες εισροές, ακραίες περιπτώσεις και παραδείγματα εκτός διανομής. Οι Anthropic, OpenAI και Microsoft δημοσιεύουν πλέον εγχειρίδια για αυτήν την εργασία, τα οποία μπορείτε να προσαρμόσετε χωρίς να εφεύρετε νέα μεθοδολογία.

Εφαρμόστε XAI σε κάθε μοντέλο που βρίσκεται σε παραγωγή, όχι μόνο στα κύρια. SHAP για πίνακες pipeline. LIME για κείμενο και εικόνες. Αντιπαραδείγματα για οποιαδήποτε απόφαση που επιστρέφει σε έναν χρήστη. Κανένα από αυτά τα εργαλεία δεν είναι τέλειο. Η απουσία τους, από την άλλη πλευρά, αποτελεί κόκκινη σημαία για οποιονδήποτε ελεγκτή μπαίνει στη στοίβα σας.

Προσέξτε για τυχόν μετατοπίσεις. Τα μοντέλα παλαιώνονται πιο γρήγορα από ό,τι αναμένουν οι περισσότερες ομάδες. Παρακολουθήστε τις κατανομές εισροών, τις κατανομές εξόδων και τα κατάντη αποτελέσματα. Ορίστε ειδοποιήσεις για το καθένα και αντιμετωπίστε τις ανεξήγητες μετατοπίσεις ως περιστατικά και όχι ως περιέργειες.

Δημιουργήστε τη διαδρομή κλιμάκωσης πριν τη χρειαστείτε. Κάθε απόφαση μοντέλου που προκύπτει από επακόλουθες αλλαγές θα πρέπει να έχει μια ανθρώπινη παράκαμψη και ένα τεκμηριωμένο κανάλι ένστασης που μπορεί να χρησιμοποιήσει ο πελάτης. Εάν η ομάδα υποστήριξής σας είναι το κανάλι ένστασης, σημειώστε το και αυτό.

Τέλος, αντιστοιχίστε τον εαυτό σας στο πλαίσιο που ισχύει. NIST AI RMF εάν βρίσκεστε στις ΗΠΑ. Απαιτήσεις υψηλού κινδύνου του Νόμου περί Τεχνητής Νοημοσύνης της ΕΕ εάν βρίσκεστε στην Ευρώπη. Εγκύκλιοι CFPB 2022-03 και 2023-03 εάν αγγίζετε καθόλου την καταναλωτική πίστη. Το να το κάνετε αυτό μία φορά, νωρίς, είναι δραματικά φθηνότερο από την ανακαίνιση μετά την άφιξη μιας δράσης επιβολής του νόμου στο γραφείο σας.

Δεν θα εξαλείψετε το μαύρο κουτί. Αυτό είναι εντάξει. Η δουλειά είναι να το κάνετε παρατηρήσιμο, υπεύθυνο και οριοθετημένο. Αυτό είναι το πρότυπο που ήδη επιβάλλουν οι ρυθμιστικές αρχές και έτσι θα μοιάζει η ώριμη ανάπτυξη το 2026.