ब्लैक बॉक्स एआई क्या है? ब्लैक बॉक्स समस्या की व्याख्या

अप्रैल 2026 में, वेक्टारा के मतिभ्रम लीडरबोर्ड ने एक चौंकाने वाला निष्कर्ष दिया। शीर्ष भाषा मॉडल अब अपने मुख्य परीक्षण पर 4% से भी कम बार मतिभ्रम का शिकार होते हैं। लेकिन GPT-5, क्लाउड सॉनेट 4.5, ग्रोक-4 और जेमिनी-3-प्रो के नए "तर्क" संस्करण नए डेटासेट पर 10% से अधिक मतिभ्रम का शिकार होते हैं। ग्रोक-4-फास्ट-रीजनिंग 20.2% तक पहुंच गया। सबसे बुद्धिमान मॉडल, जो उत्तर देने से पहले "सोचते" हैं, यह बताने में सबसे खराब हैं कि उन्हें कब पता नहीं है।

एक पैराग्राफ में यही ब्लैक बॉक्स समस्या है। हमने ऐसे एआई सिस्टम बनाए हैं जो अक्सर उपयोगी परिणाम देते हैं, लेकिन जिन्हें उनके रचनाकारों सहित कोई भी पूरी तरह से समझा नहीं सकता। वे कैलिब्रेटेड न होते हुए भी सटीक हैं, ईमानदार न होते हुए भी धाराप्रवाह हैं, और सही न होते हुए भी आत्मविश्वास से भरे हैं।

नियामक संस्थाओं ने इस पर ध्यान दिया। यूरोपीय संघ के कृत्रिम बुद्धिमत्ता अधिनियम के तहत प्रतिबंधित उपयोगों के लिए 35 मिलियन यूरो तक या वैश्विक कारोबार के 7% तक का जुर्माना लगाया जा सकता है, और उच्च जोखिम प्रणाली संबंधी नियम 2 अगस्त 2026 से प्रभावी होंगे। अमेरिकी उपभोक्ता वित्तीय संरक्षण ब्यूरो ने बैंकों को स्पष्ट रूप से कहा है कि वे जटिल एल्गोरिदम का उपयोग नहीं कर सकते यदि वे एल्गोरिदम उन्हें ऋण अस्वीकृति का कारण बताने से रोकते हैं। और व्याख्या योग्य कृत्रिम बुद्धिमत्ता का क्षेत्र, जो पांच साल पहले एक विशिष्ट विषय था, अब 2026 में 9 बिलियन डॉलर से 13 बिलियन डॉलर के बीच का बाजार बनने का अनुमान है।

यह गाइड आपको विस्तार से समझाएगी कि ब्लैक बॉक्स एआई वास्तव में क्या है, सरल दिखने वाले एआई मॉडल भी ब्लैक बॉक्स क्यों बन जाते हैं, ऐसा होने पर क्या गड़बड़ होती है, क्रिप्टो और फिनटेक में इनकी क्या भूमिका है, व्याख्या योग्य एआई टूलकिट (SHAP, LIME, काउंटरफैक्चुअल्स) इन्हें कैसे सुलझाने का प्रयास करते हैं, और यूरोपीय संघ और अमेरिका में नए नियामक तंत्र के बारे में आपको क्या जानना चाहिए। साथ ही, एक आम भ्रम को दूर करने के लिए एक संक्षिप्त स्पष्टीकरण भी दिया गया है: ब्लैकबॉक्स एआई, जो blackbox.ai पर कोडिंग सहायक है, एक अलग चीज़ है।

ब्लैक बॉक्स एआई क्या है और यह क्यों महत्वपूर्ण है?

ब्लैक बॉक्स एआई से तात्पर्य किसी भी एआई सिस्टम से है जिसका आंतरिक तर्क उपयोगकर्ताओं और अक्सर इसे बनाने वाले डेवलपर्स के लिए भी अस्पष्ट होता है। इनपुट और आउटपुट तो दिखाई देते हैं, लेकिन उनके बीच का पथ भार, सीखे गए पैटर्न और मशीन लर्निंग रूपांतरणों की परतों के भीतर छिपा होता है जिसे कोई भी मनुष्य पूरी तरह से नहीं समझ सकता। यही बात मॉडल द्वारा सारणीबद्ध डेटा, छवियों या अनुवाद और चैट जैसे प्राकृतिक भाषा प्रसंस्करण कार्यों को संभालने पर भी लागू होती है।

यह शब्द आधुनिक डीप लर्निंग से भी पुराना है। इंजीनियर कम से कम 1960 के दशक से ही "ब्लैक बॉक्स" शब्द का इस्तेमाल किसी भी ऐसे सिस्टम के लिए करते आ रहे हैं जिसे बाहर से छुआ तो जा सकता है लेकिन खोला नहीं जा सकता। जीवविज्ञानी अक्सर यह बताते हैं कि मानव मस्तिष्क भी एक ब्लैक बॉक्स है, लेकिन यह तुलना पूरी तरह सही नहीं है: एक AI मानव की तरह काम नहीं करता, और ऐसा मान लेना कि वह करता है, ब्लैक बॉक्स AI के अर्थ को गलत समझने का सबसे तेज़ तरीका है। पिछले दशक में जो बदलाव आया है, वह है इसका पैमाना। एक आधुनिक बड़े भाषा मॉडल में सैकड़ों अरब पैरामीटर हो सकते हैं। एक सामान्य डीप न्यूरल नेटवर्क हजारों परतों और लाखों अटेंशन हेड्स में "ज्ञान" फैलाता है, जिसमें एकल न्यूरॉन एक साथ कई असंबंधित पैटर्न को एन्कोड करते हैं। शोधकर्ता इस अंतिम गुण को पॉलीसेमेंटिसिटी कहते हैं, और यही एक कारण है कि यांत्रिक व्याख्यात्मकता अभी भी अपने शुरुआती चरण में है।

रिसर्च लैब के बाहर किसी को इसकी परवाह क्यों करनी चाहिए? क्योंकि ब्लैक बॉक्स एआई अब महत्वपूर्ण निर्णय ले रहा है। यह क्रेडिट को मंज़ूरी देता है और अस्वीकार करता है। यह आरोपियों को स्कोर देता है। यह लेन-देन को धोखाधड़ी के रूप में चिह्नित करता है। यह हर प्रमुख क्रिप्टो एक्सचेंज पर ट्रेडिंग वॉल्यूम का एक बड़ा हिस्सा नियंत्रित करता है। जब यह कुछ गलत करता है, तो अपारदर्शिता के कारण यह पता लगाना लगभग असंभव हो जाता है कि गलती क्या हुई, उसे ठीक करना या किसी को जवाबदेह ठहराना।

यह इसलिए भी महत्वपूर्ण है क्योंकि एआई प्रशासन अब अस्पष्टता को केवल विकासकर्ताओं की समस्या नहीं मानता। यूरोपीय संघ अब इसे बाजार पहुंच का मुद्दा मानता है। अमेरिकी नियामक इसे निष्पक्ष ऋण देने का मुद्दा मानते हैं। 2024 के बाद से एआई पहल को मंजूरी देने वाले हर अधिकारी को एक ही समस्या का सामना करना पड़ा है: यह वास्तव में क्या कर रहा है और क्यों? ब्लैक बॉक्स एआई को समझना अब अनिवार्य हो गया है, और आप केवल किसी दूसरे विक्रेता का उपयोग करके ब्लैक बॉक्स की समस्या का समाधान नहीं कर सकते।

एआई मॉडल ब्लैक बॉक्स क्यों बन जाते हैं?

हर एआई एक ब्लैक बॉक्स नहीं होता। एक साधारण डिसीजन ट्री पूरी तरह से पारदर्शी होता है। एक लीनियर रिग्रेशन मॉडल ऐसे गुणांक देता है जिन्हें आप पढ़ सकते हैं। यहां तक कि 1990 के दशक का एक नियम-आधारित एआई सिस्टम भी, सिद्धांत रूप में, पंक्ति दर पंक्ति ऑडिट करने योग्य होता है।

तो आज के एआई मॉडल ब्लैक बॉक्स कैसे बन जाते हैं? इसके पीछे चार परस्पर संबंधित कारण हैं।

सबसे पहले, आकार की बात करते हैं। लाखों या अरबों पैरामीटर वाले डीप लर्निंग मॉडल उच्च-आयामी स्थानों में काम करते हैं जिन्हें मनुष्य कल्पना नहीं कर सकते। आप 200 अरब पैरामीटर वाले मॉडल का गणितीय वर्णन तो कर सकते हैं, लेकिन कोई भी उसे अपने दिमाग में नहीं रख सकता।

दूसरा, विकेंद्रीकृत निरूपण। एक गहन तंत्रिका नेटवर्क में, कोई भी एक न्यूरॉन "बिल्ली की अवधारणा" या "ऋण अस्वीकार करने का नियम" जैसी जानकारी संग्रहित नहीं करता है। अवधारणाएँ हजारों न्यूरॉन्स में फैली होती हैं, और प्रत्येक न्यूरॉन एक साथ कई अवधारणाओं में भाग लेता है। एक स्पष्ट व्याख्या प्राप्त करना एक शोध परियोजना है, कोई प्रश्न नहीं।

तीसरा, प्रशिक्षण डेटा पर निर्भरता। मॉडल का व्यवहार उसके प्रशिक्षण डेटा द्वारा निर्धारित होता है, जो आमतौर पर गोपनीय, विशाल और कभी-कभी कानूनी रूप से विवादास्पद होता है। यहां तक कि जब कोई डेवलपर मॉडल के भार प्रकाशित करता है, तब भी डेटा शायद ही कभी साझा किया जाता है। इसलिए, इसके पीछे के एक महत्वपूर्ण पहलू का पता नहीं चल पाता।

चौथा, उद्देश्य। जानबूझकर ब्लैक बॉक्स दृष्टिकोण अपनाने के व्यावहारिक कारण हैं। कुछ एआई डेवलपर और प्रोग्रामर बौद्धिक संपदा की रक्षा के लिए जानबूझकर मॉडल के आंतरिक भाग को छिपाते हैं, और ब्लैक बॉक्स डिज़ाइन का उपयोग करने के अन्य कारणों में लाइसेंसिंग शर्तें और प्रतिस्पर्धी लाभ शामिल हैं। यहां तक कि एक ओपन-सोर्स मॉडल भी अपने निर्णयों के इर्द-गिर्द एक ब्लैक बॉक्स बना सकता है, क्योंकि अधिकांश आधुनिक मॉडल उभरते पैटर्न पर निर्भर करते हैं जिनका कोई दस्तावेज़ीकरण नहीं होता है। एक कंपनी जिसने किसी मॉडल में 100 मिलियन डॉलर का निवेश किया है, वह उसकी संरचना और प्रशिक्षण प्रक्रिया को प्रकाशित करने के लिए उत्सुक नहीं होगी। ओपन-सोर्स एआई मॉडल जो अपना अंतर्निहित कोड साझा करते हैं, वे भी अंततः ब्लैक बॉक्स ही होते हैं, क्योंकि उपयोगकर्ता अभी भी सीखे गए भारों का किसी सार्थक व्याख्या के साथ निरीक्षण नहीं कर सकते हैं।

इसका नतीजा यह है कि दिखने में सरल लगने वाले उन्नत एआई मॉडल, जिनमें एलएलएम और जनरेटिव एआई मॉडल शामिल हैं, भी स्वाभाविक रूप से ब्लैक बॉक्स बन जाते हैं। पारदर्शी मॉडल अपवाद हैं, नियम नहीं। जटिल ब्लैक बॉक्स मॉडल प्रभावशाली सटीकता प्रदान कर सकते हैं, यही कारण है कि अपारदर्शिता के बावजूद टीमें उन्हें तैनात करती रहती हैं। समृद्ध, अव्यवस्थित डेटा पर प्रशिक्षित ब्लैक बॉक्स एआई मॉडल के लिए भी यही सच है: नियम-आधारित एआई मॉडल की तुलना में इनका प्रदर्शन अक्सर इतना बेहतर होता है कि कुछ गड़बड़ होने तक व्याख्यात्मकता संबंधी चिंताओं को नजरअंदाज किया जा सकता है। अधिकांश आधुनिक ब्लैक बॉक्स एआई अंततः ब्लैक बॉक्स ही होते हैं क्योंकि उपयोगकर्ता अभी भी सीखे गए भारों का निरीक्षण नहीं कर सकते। ओपन-वेट मॉडल अपना अंतर्निहित कोड साझा करते हैं, और उपयोगकर्ता आर्किटेक्चर को पढ़ सकते हैं, लेकिन जब आप पूछते हैं कि "मॉडल ने ऐसा क्यों कहा", तो अंतर्निहित कोड अंततः ब्लैक बॉक्स ही होते हैं।

डीप लर्निंग में ब्लैक बॉक्स समस्या

ब्लैक बॉक्स समस्या तब उत्पन्न होती है जब ये चारों कारण एक साथ जुड़ जाते हैं। मॉडल काम करता है, अक्सर प्रभावशाली ढंग से। लेकिन यह इस तरह से काम करता है कि एक साथ तीन चीजों का विरोध करता है: स्पष्टीकरण, सत्यापन और सुधार।

एक क्लासिक उदाहरण लीजिए: एक डीप लर्निंग मॉडल को पांडा पहचानने के लिए प्रशिक्षित किया गया है। परीक्षण सेट पर इसका स्कोर 99% है। यह बहुत अच्छा लगता है। फिर कोई व्यक्ति एक व्याख्यात्मकता उपकरण चलाता है और पता चलता है कि मॉडल वास्तव में पांडा को नहीं देख रहा है। यह बांस पर ध्यान दे रहा है। प्रशिक्षण डेटा में पांडा की अधिकांश तस्वीरों में बांस भी मौजूद है। मॉडल ने एक शॉर्टकट सीख लिया है। बांस के बिना पांडा की तस्वीर पर, मॉडल विफल हो जाता है।

डीप लर्निंग में इस तरह की "शॉर्टकट लर्निंग" हर जगह देखने को मिलती है। मॉडल एक ऐसी सांख्यिकीय नियमितता खोज लेता है जो मूल अवधारणा से मेल नहीं खाती, लेकिन आपको इसका पता तभी चलता है जब दुनिया ट्रेनिंग सेट से थोड़ी अलग दिखती है। 2008 का वित्तीय संकट इसका ऐतिहासिक उदाहरण है। गॉसियन मान्यताओं पर आधारित वैल्यू-एट-रिस्क मॉडल सामान्य बाजारों में तो बहुत अच्छे से काम करते थे, लेकिन अप्रत्याशित परिस्थितियों में बुरी तरह विफल हो गए, क्योंकि उन्होंने ऐसे शॉर्टकट सीख लिए थे जिन्हें मॉडल बनाने वालों को खुद भी नहीं पता था।

आज के डीप लर्निंग मॉडल में ठीक यही विफलता पैटर्न देखने को मिलता है, बस उनमें पैरामीटर और कॉन्फिडेंस लेवल बढ़ जाता है। एंथ्रोपिक और ओपनएआई जैसी टीमों सहित मैकेनिस्टिक इंटरप्रेटेबिलिटी शोधकर्ताओं ने भाषा मॉडल के छोटे-छोटे हिस्सों को न्यूरॉन दर न्यूरॉन रिवर्स-इंजीनियरिंग करना शुरू कर दिया है। उनके काम से पता चलता है कि एलएलएम का आंतरिक भाग टाइडी लॉजिक की तुलना में एंटैंगल्ड सर्किट के अधिक करीब है। ऐसा कोई बिंदु नहीं है जहां आप उंगली रखकर कह सकें कि "यहीं पर उत्तर छिपा है।" ब्लैक बॉक्स की समस्या कोई बग नहीं है जिसे ठीक किया जा सके; यह संरचनात्मक समस्या है।

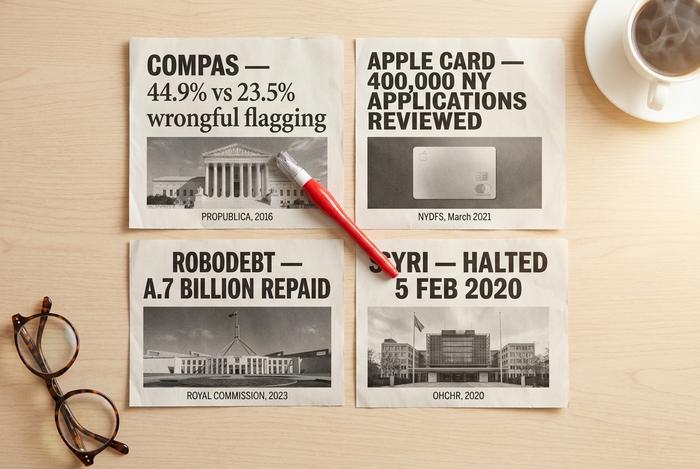

ब्लैक बॉक्स एआई के उदाहरण: COMPAS, Apple Card, Robodebt, SyRI

क्या आप देखना चाहते हैं कि जब ब्लैक बॉक्स एआई विफल हो जाता है तो उसका क्या हाल होता है? वे चार मामले जिनका बार-बार ज़िक्र किया जा रहा है, आपको वह सब कुछ बता देंगे जो आपको जानना ज़रूरी है। ये मामले आपराधिक न्याय, बैंकिंग और कल्याणकारी योजनाओं से जुड़े हैं। इन सभी से आम लोगों को नुकसान पहुंचा है। और इनमें से कोई भी दो मामले एक जैसे विफल नहीं हुए।

COMPAS से शुरुआत करते हैं। नॉर्थपॉइंट ने इसे इस बात का अनुमान लगाने के लिए बनाया था कि क्या कोई प्रतिवादी दोबारा अपराध करेगा, और अमेरिकी अदालतों ने इसे बड़े पैमाने पर लागू किया। फिर प्रोपब्लिका ने इसकी गहराई से जांच की। उनके 2016 के ऑडिट में ब्रॉवर्ड काउंटी के 7,000 से अधिक गिरफ्तार लोगों के डेटा का विश्लेषण किया गया और परिणाम चौंकाने वाला था: 44.9% मामलों में अश्वेत प्रतिवादियों को गलत तरीके से उच्च जोखिम वाले के रूप में चिह्नित किया गया, जबकि श्वेत प्रतिवादियों के लिए यह आंकड़ा केवल 23.5% था। 2024 के एक अनुवर्ती शोध पत्र ने स्थिति को और भी खराब कर दिया। दो विशेषताएं (आयु और पूर्व दोषसिद्धि) COMPAS की 137 विशेषताओं की सटीकता से मेल खाती थीं। इसलिए जटिलता से वास्तव में कोई अतिरिक्त संकेत नहीं मिला, लेकिन इसने पूर्वाग्रह को पहचानना बहुत मुश्किल बना दिया। यह वह मानक ब्लैक बॉक्स मॉडल है जो उत्पादों के बजाय लोगों का मूल्यांकन करता है। नौकरी के आवेदकों का मूल्यांकन करने वाला बॉक्स मॉडल, जिसे अमेज़ॅन ने 2018 में बंद कर दिया था, भी इसी तरह का है।

फिर आया एप्पल कार्ड, 2019 के अंत में। वोजनियाक ने बताया कि उनकी पत्नी को उनसे 10 गुना कम क्रेडिट लिमिट मिली। डेविड हेनेमेयर हैंसन ने भी यही बात कही। यह कहानी वायरल हो गई। न्यूयॉर्क के वित्तीय सेवा विभाग ने इसे गंभीरता से लिया: उन्होंने लगभग 400,000 आवेदनों की जांच की। मार्च 2021 में, उन्होंने फैसला सुनाया कि इसमें कोई वैधानिक लिंगभेद नहीं है। लेकिन उन्होंने यह भी लिखा, और यही महत्वपूर्ण बात है, कि ग्राहक अनुभव की अस्पष्टता अपने आप में एक विश्वास की समस्या थी। ब्लैक बॉक्स से होने वाला नुकसान, जैसा कि पता चला है, आधा परिणामों से और आधा धारणा से जुड़ा है। एक प्रेस विज्ञप्ति धारणा संबंधी समस्या को हल नहीं करती।

रोबोडेब्ट इस सिक्के का दूसरा पहलू है। इसमें किसी डीप न्यूरल नेटवर्क का इस्तेमाल नहीं हुआ। ऑस्ट्रेलिया ने 2016 से 2019 के बीच कल्याणकारी योजनाओं के रिकॉर्ड के आधार पर आय औसत निकालने का नियम लागू किया, लगभग 400,000 लाभार्थियों पर धोखाधड़ी का आरोप लगाया और जिन लोगों को भी यह पत्र मिला, उन्हें गणना का कोई स्पष्ट कारण नहीं बता सका। बाद में एक रॉयल कमीशन ने इस योजना को गैरकानूनी घोषित कर दिया। सरकार ने 1.7 अरब ऑस्ट्रेलियाई डॉलर और मुआवजे के तौर पर 112 मिलियन ऑस्ट्रेलियाई डॉलर वापस किए। सबक: किसी सिस्टम को ब्लैक बॉक्स होने के लिए तकनीकी रूप से परिष्कृत होना जरूरी नहीं है। बस उसे जवाबदेही से मुक्त होना चाहिए।

डच टोस्लागेन मामला और SyRI यूरोपीय संघ के लिए एक महत्वपूर्ण घटना है। 5 फरवरी 2020 को, एक डच अदालत ने SyRI को तत्काल बंद करने का आदेश दिया, यह फैसला सुनाते हुए कि इसकी अपारदर्शिता यूरोपीय मानवाधिकार सम्मेलन के अनुच्छेद 8 का उल्लंघन करती है। इससे संबंधित बाल देखभाल लाभ घोटाले में 20,000 से अधिक माता-पिता फंस गए, जिन पर धोखाधड़ी का गलत आरोप लगाया गया था। रुट्टे सरकार ने जनवरी 2021 में इस मुद्दे पर इस्तीफा दे दिया। यह फैसला अब यूरोपीय संघ के नीतिगत हलकों में एक मानक संदर्भ बिंदु बन गया है, जो यह बताता है कि उच्च जोखिम वाले मामलों में अपारदर्शी कृत्रिम बुद्धिमत्ता एक सामान्य नैतिक मुद्दा नहीं है, बल्कि एक कानूनी मुद्दा है।

चार मामले। अलग-अलग क्षेत्र, अलग-अलग तकनीकें, अलग-अलग देश। एक ही पैटर्न: एक अपारदर्शी प्रणाली, एक महत्वपूर्ण निर्णय, और पीड़ित लोग जिनके पास विरोध करने का कोई वास्तविक तरीका नहीं है।

वास्तविक दुनिया की एआई प्रणालियों में ब्लैक बॉक्स एआई जोखिम

जब आप वास्तविक दुनिया के एआई सिस्टम में ब्लैक बॉक्स एआई जोखिमों का वर्गीकरण करना शुरू करते हैं, तो एक पैटर्न सामने आता है। वही पांच जोखिम बार-बार दिखाई देते हैं, चाहे मॉडल क्रेडिट स्कोरर हो, चैटबॉट हो या एल्गोरिथम ट्रेडिंग सिस्टम हो।

| जोखिम | क्या ऐसा लग रहा है | यह क्यों स्केल करता है |

|---|---|---|

| छिपा हुआ पूर्वाग्रह | यह मॉडल संरक्षित समूहों के साथ अलग तरह से व्यवहार करता है | प्रशिक्षण डेटा में ऐतिहासिक पैटर्न मौजूद होते हैं। |

| माया | मॉडल तथ्यों या उद्धरणों का आविष्कार करता है | एलएलएम पाठ्यक्रम धाराप्रवाह बोलने पर केंद्रित होते हैं, सत्य पर नहीं। |

| शॉर्टकट लर्निंग | मॉडल अप्रासंगिक सहसंबंधों पर निर्भर करता है | वास्तविक अवधारणा की तुलना में इसे सीखना आसान है। |

| प्रतिकूल नाजुकता | इनपुट में थोड़ा सा बदलाव आउटपुट को उलट देता है | उच्च-आयामी निर्णय सीमाएँ |

| ऑडिट विश्लेषण | कारण का पता नहीं चल पा रहा है | कोई व्याख्या योग्य आंतरिक स्थिति नहीं |

वित्त, भर्ती, स्वास्थ्य सेवा और क्रिप्टोकरेंसी में उपयोग होने वाले ब्लैक बॉक्स एआई सिस्टम में ये जोखिम और भी बढ़ जाते हैं। इनमें मौजूद जटिल डीप लर्निंग प्रक्रियाओं के कारण यह अनुमान लगाना मुश्किल हो जाता है कि अगली विफलता कहाँ होगी, और गुणवत्ता आश्वासन के लिए पारंपरिक एआई उपकरण सैकड़ों अरब मापदंडों वाले मॉडल के लिए नहीं बनाए गए थे।

छिपे हुए पूर्वाग्रह सुर्खियाँ बटोरते हैं, लेकिन प्रतिकूलता और ऑडिट में विफलता कहीं अधिक गंभीर दीर्घकालिक समस्याएँ हैं। एक स्थिर पूर्वाग्रह को कम से कम मापा और सुधारा जा सकता है। एक ऐसा मॉडल जो हर बार चलाने पर अलग-अलग तरह से विफल होता है (जैसा कि चैटजीपीटी लगभग 42% स्मार्ट-कॉन्ट्रैक्ट मूल्यांकन कार्यों में करता है, जैसा कि 2024 के एसीएम टीओएसईएम अध्ययन में बताया गया है), उसे विनियमित उपयोग के लिए प्रमाणित करना बहुत कठिन है।

इस सूची में सबसे नया नाम "एजेंटिक एआई रिस्क" का है, जिसे शोधकर्ता इसी नाम से पुकारते हैं। जब आप किसी एलएलएम को टूल्स से जोड़ते हैं, उसे मेमोरी देते हैं और उसे एपीआई कॉल करने देते हैं, तो अस्पष्टता और बढ़ जाती है। अब एक निर्णय मॉडल इनवोकेशन, रिट्रीव्ड डॉक्यूमेंट्स और टूल कॉल्स की एक श्रृंखला बन जाता है, जिनमें से प्रत्येक आंशिक रूप से अस्पष्ट होता है। आधुनिक एजेंट ब्लैक बॉक्स के अंदर ब्लैक बॉक्स की तरह होते हैं।

क्रिप्टो और फिनटेक में ब्लैक बॉक्स एआई

ब्लैक बॉक्स एआई का उपयोग करने वाले सभी उद्योगों में, क्रिप्टो और फिनटेक ऐसे क्षेत्र हैं जहां तैनाती और जोखिम के पहलू सबसे ज्यादा टकराते हैं। दांव बड़े हैं। विलंबता कम है। पारदर्शिता अपर्याप्त है। विनियमन, विशेष रूप से क्रिप्टो में, अभी भी अधूरा है। इसका परिणाम यह है कि पहले तैनाती करने और बाद में दस्तावेज़ीकरण लिखने को प्राथमिकता दी जाती है।

एल्गोरिथमिक ट्रेडिंग। 2025 में क्रिप्टो वॉल्यूम का अनुमानित 70-80% हिस्सा एल्गोरिथमिक ट्रेडिंग से आया, जो प्रमुख इक्विटी बाजारों में 60-70% हिस्सेदारी से कहीं अधिक है। अकेले विंटरम्यूट ही औसतन एक दिन में 60 से अधिक प्लेटफॉर्मों पर 15 अरब डॉलर से अधिक का लेनदेन करता है, और 2025 में एक दिन में रिकॉर्ड 2.24 अरब डॉलर का लेनदेन दर्ज किया गया। इन लेनदेन के पीछे की रणनीतियाँ डीप-लर्निंग पर आधारित हैं, जिनका कोई बाहरी पर्यवेक्षक ऑडिट नहीं कर सकता। नवंबर 2022 में अलामेडा/एफटीएक्स का पतन इस जोखिम का सबसे स्पष्ट उदाहरण है: कुल क्रिप्टो बाजार पूंजीकरण लगभग एक महीने में 1 ट्रिलियन डॉलर से घटकर 800 अरब डॉलर से भी कम हो गया, और अलामेडा की बैलेंस शीट पर अंतर्निहित 14.6 अरब डॉलर का एफटीटी एक्सपोजर तब तक अदृश्य रहा जब तक कि वह स्पष्ट नहीं हो गया।

एएमएल और केवाईसी स्कोरिंग। वैश्विक मनी लॉन्ड्रिंग रोधी सॉफ्टवेयर बाजार 2025 में 4.13 बिलियन डॉलर तक पहुंच गया और 2030 तक 9.38 बिलियन डॉलर तक पहुंचने का अनुमान है (मार्केट्सएंडमार्केट्स)। क्रिप्टो एएमएल/केवाईसी अनुपालन विशेष रूप से 13.8% सीएजीआर की दर से बढ़ रहा है। कॉम्प्लाईएडवांटेज, चेनैलिसिस रिएक्टर और एलिप्टिक नेविगेटर जैसे विक्रेता अब वॉलेट जोखिम स्कोरिंग के लिए ब्लैक बॉक्स मशीन लर्निंग मॉडल का उपयोग करते हैं। यहां ब्लैक बॉक्स मशीन लर्निंग का उपयोग व्यापक और इतना प्रभावी है कि इसे अधिकांश प्रमुख एक्सचेंजों पर तैनात किया जा सकता है, और यह इतना अपारदर्शी है कि अनुपालन अधिकारी अक्सर यह पता नहीं लगा पाते कि कोई विशिष्ट वॉलेट क्यों अवरुद्ध हुआ।

स्मार्ट-कॉन्ट्रैक्ट ऑडिटिंग। यहीं पर AI की सीमाएं स्पष्ट रूप से सामने आती हैं। 2024 के एक arXiv अध्ययन में स्मार्ट-कॉन्ट्रैक्ट की कमजोरियों का पता लगाने के लिए GPT-4 का मूल्यांकन किया गया। इसने 96.6% परिशुद्धता हासिल की, लेकिन केवल 37.8% रिकॉल ही प्राप्त हुआ, जिससे लगभग दो-तिहाई वास्तविक खामियों का पता नहीं चल पाया। 42% कॉन्ट्रैक्ट्स में ChatGPT के आउटपुट अस्थिर हैं (ACM TOSEM 2024)। GPTScan जैसे हाइब्रिड टूल, जो GPT को स्टैटिक विश्लेषण के साथ जोड़ते हैं, टोकन कॉन्ट्रैक्ट्स पर 90% परिशुद्धता और लगभग 70% रिकॉल प्राप्त करते हैं (arXiv 2308.03314)। CertiK Skynet अब 17,000 से अधिक प्रोजेक्ट्स और लगभग 494 बिलियन डॉलर के बाजार मूल्य की निगरानी करता है, लेकिन प्रत्येक जिम्मेदार ऑडिट टीम अभी भी AI के साथ एक मानव समीक्षक को भी शामिल करती है।

रोबो-एडवाइजर। बेटरमेंट 900,000 से अधिक खातों में 56 बिलियन डॉलर से अधिक का प्रबंधन करता है। वेल्थफ्रंट का प्रबंधन 42.9 बिलियन डॉलर का है। रोबो-एडवाइजर उद्योग ने वैश्विक एयूएम में 1 ट्रिलियन डॉलर का आंकड़ा पार कर लिया है। पोर्टफोलियो रीबैलेंसिंग, टैक्स-लॉस हार्वेस्टिंग और रिस्क-स्कोरिंग जैसी सभी प्रक्रियाएं मशीन लर्निंग मॉडल द्वारा संचालित होती हैं, जिनके विशिष्ट निर्णय किसी भी खुदरा विक्रेता को बेचे जाने वाले दस्तावेज़ में प्रकट नहीं किए जाते हैं।

क्रेडिट स्कोरिंग और धोखाधड़ी का पता लगाना। अमेरिका के 90% ऋणदाता FICO का उपयोग करते हैं, और FICO Falcon प्रति वर्ष 65 अरब से अधिक लेनदेन संसाधित करता है, जिसमें धोखाधड़ी का पता लगाने की दर 95%+ बताई गई है। बैंक ऑफ इंग्लैंड द्वारा 2024 में 50 यूके संस्थानों पर किए गए एक अध्ययन में पाया गया कि ML क्रेडिट-जोखिम मॉडल ने लॉजिस्टिक रिग्रेशन की तुलना में गलत वर्गीकरण को लगभग 25% तक कम कर दिया। सटीकता में यह वृद्धि वास्तविक है। लेकिन इसका नुकसान यह है कि CFPB के परिपत्र 2022-03 और 2023-03 के तहत, अमेरिकी ऋणदाता ऐसे मॉडल का उपयोग नहीं कर सकते जो इतने अपारदर्शी हों कि ECOA के तहत विशिष्ट प्रतिकूल कार्रवाई स्पष्टीकरणों को रोका जा सके।

इन पाँचों में एक ही पैटर्न देखने को मिलता है। यह मॉडल पारदर्शी आधार रेखा से कहीं अधिक सटीक है। अपारदर्शिता और सटीकता का संरचनात्मक संबंध अटूट है। और नियामक, व्याख्यात्मक उपकरणों की तुलना में कहीं अधिक तेज़ी से इस स्थिति को समझ रहे हैं।

ब्लैकबॉक्स एआई पर टिप्पणी: कोडिंग एलएलएम

एक त्वरित स्पष्टीकरण। जब लोग "ब्लैकबॉक्स एआई" खोजते हैं, तो उनका अक्सर मतलब इस लेख में वर्णित वैचारिक समस्या से होता है। कभी-कभी उनका मतलब ब्लैकबॉक्स एआई से होता है, जो blackbox.ai नामक कंपनी है। ब्लैकबॉक्स.एआई एक कोडिंग एलएलएम (लॉन्ग-लॉन्ग लर्निंग प्रोग्राम) है जिसे डेवलपर्स के कोड लिखने के तरीके को बदलने के लिए डिज़ाइन किया गया है। यह उत्पाद वीएस कोड के साथ एक कोडिंग एजेंट के रूप में एकीकृत होता है, कोड का सुझाव देता है और क्लाउड कोड, गिटहब कोपायलट और कर्सर जैसे टूल्स के साथ प्रतिस्पर्धा करता है। यह एआई कोडिंग क्षेत्र में सबसे प्रसिद्ध उन्नत एआई तकनीकों में से एक है, जो कई एआई मॉडलों पर आधारित है, और ब्लैकबॉक्स द्वारा सुझाया गया कोड रिफैक्टर से लेकर टेस्ट स्केफोल्डिंग तक सब कुछ कवर करता है। ब्लैकबॉक्स कोड जनरेशन, चैट और सर्च को एक ही वर्कफ़्लो में एकीकृत करता है, और अधिकांश उपयोगकर्ता इसे अपने एडिटर में अब तक का सबसे अच्छा एआई असिस्टेंट मानते हैं।

खोज परिणामों में अक्सर इन दोनों अर्थों में भ्रम हो जाता है। ब्लैकबॉक्स एआई उत्पाद इस लेख का विषय नहीं है। हम अपारदर्शी एआई प्रणालियों के संरचनात्मक गुण पर विचार कर रहे हैं, न कि किसी एक कोडिंग सहायक पर। यदि आपने उत्पाद खोजा है, तो कंपनी अपने दस्तावेज़ और मूल्य निर्धारण स्वयं उपलब्ध कराती है। यदि आपने अवधारणा खोजी है, तो पढ़ना जारी रखें।

व्याख्या योग्य एआई और व्याख्यात्मकता उपकरण

व्याख्यायोग्य कृत्रिम बुद्धिमत्ता (एक्सएआई), जिसे आमतौर पर एक्सएआई के रूप में संक्षिप्त किया जाता है, वह क्षेत्र है जो अस्पष्ट कृत्रिम बुद्धिमत्ता मॉडलों की सटीकता को प्रभावित किए बिना उन्हें समझने योग्य बनाने का प्रयास करता है। यह अब एक वास्तविक बाज़ार भी है। 2026 के लिए वैश्विक स्तर पर इसके 9 अरब डॉलर से 13 अरब डॉलर के बीच होने का अनुमान है, यह अंतर इस बात पर निर्भर करता है कि आप एक्सएआई की किस परिभाषा को स्वीकार करते हैं। इसका लक्ष्य कृत्रिम बुद्धिमत्ता मॉडलों को अधिक व्याख्यायोग्य बनाना है, बिना टीमों को धीमी या कम सटीक आधारभूत तकनीकों पर वापस जाने के लिए मजबूर किए। कुशल टीमें इन उपकरणों को जारी करने से पहले कृत्रिम बुद्धिमत्ता उपकरणों पर चलाती हैं, और वे आउटपुट को ऐसे दस्तावेज़ों के साथ जोड़ती हैं जिन्हें मानव समीक्षक आसानी से पढ़ सकता है।

XAI तकनीक के तीन परिवारों के बारे में जानना महत्वपूर्ण है।

पहला तरीका है SHAP, जिसका पूरा नाम है SHapley Additive exPlanations। यह कोऑपरेटिव गेम थ्योरी से लिया गया है: प्रत्येक भविष्यवाणी के लिए, SHAP प्रत्येक इनपुट फीचर को एक योगदान स्कोर प्रदान करता है। क्रेडिट स्कोरिंग टीमें इसे पसंद करती हैं। धोखाधड़ी का पता लगाने वाली टीमें भी इसे पसंद करती हैं। स्वास्थ्य सेवा जोखिम मॉडलर इसे स्वीकार करते हैं। SHAP सैद्धांतिक रूप से सटीक है, लेकिन गणना के लिहाज से यह बड़े सारणीबद्ध डेटा पर बेहद जटिल है।

दूसरा है LIME, यानी लोकल इंटरप्रिटेबल मॉडल-एग्नोस्टिक एक्सप्लेनेशंस। LIME एक ही भविष्यवाणी के आधार पर एक सरल, व्याख्या योग्य सरोगेट मॉडल बनाता है और उसका उपयोग मूल भविष्यवाणी की व्याख्या करने के लिए करता है। यह SHAP से तेज़ है। यह टेक्स्ट, इमेज और टेबल पर काम करता है। लेकिन इसमें एक कमी यह है कि LIME का डिज़ाइन ही लोकल है, इसलिए यदि आप यह मान लें कि एक व्याख्या सभी पर लागू होती है, तो यह आपको गुमराह कर सकता है।

तीसरा तरीका है काल्पनिक स्पष्टीकरण। मॉडल ने 'हाँ' क्यों कहा, यह बताने के बजाय, काल्पनिक स्पष्टीकरण आपको वह सबसे छोटा इनपुट परिवर्तन बताते हैं जिससे उत्तर 'नहीं' में बदल जाता। क्रेडिट आवेदक या संदिग्ध लेनदेन ठीक यही जानना चाहता है: "मुझे क्या बदलना होगा?" प्रतिकूल कार्रवाई नोटिस में काल्पनिक स्पष्टीकरण तेजी से लोकप्रिय हो रहे हैं, क्योंकि वे नियामकों की अपेक्षाओं से पूरी तरह मेल खाते हैं।

इन तीनों के अलावा, आपको फ़ीचर-महत्व प्लॉट, ट्रांसफ़ॉर्मर लेयर्स के लिए अटेंशन विज़ुअलाइज़ेशन और इमेज क्लासिफ़ायर के लिए ग्रेड-कैम देखने को मिलेगा। मैकेनिस्टिक इंटरप्रेटेबिलिटी, जो विशिष्ट न्यूरॉन्स और अटेंशन सर्किट की रिवर्स-इंजीनियरिंग का अभ्यास है, इस क्षेत्र में सबसे उन्नत तकनीक है। एंथ्रोपिक, ओपनएआई और कुछ अकादमिक प्रयोगशालाओं ने आंशिक सर्किट प्रकाशित किए हैं, लेकिन यह काम अभी तक किसी ऐसे उत्पाद में तब्दील नहीं हुआ है जिसे कोई एंटरप्राइज़ कंप्लायंस टीम उपयोग में ला सके।

इस सब के निष्कर्ष के बारे में स्पष्ट रहें। पालो अल्टो नेटवर्क्स और अन्य द्वारा प्रकाशित उद्योग अनुसंधान से पता चलता है कि XAI इमेज क्लासिफायर और संरचित सारणीबद्ध मॉडल के लिए अच्छा काम करता है, लेकिन LLM के लिए आंशिक रूप से ही। टोकन की स्थिति और संदर्भ विंडो में बदलाव के साथ भाषा मॉडल के भीतर का तर्क भी बदलता रहता है, इसलिए फ़ीचर-एट्रिब्यूशन स्कोर उन तरीकों से गुमराह कर सकते हैं जिनके बारे में स्पष्टीकरण स्वयं आपको चेतावनी नहीं देता है। अंतर्निहित कोड साझा करने वाले व्याख्यात्मक उपकरण उपयोगी होते हैं। वे ब्लैक बॉक्स समस्या का पूर्ण समाधान नहीं हैं।

ब्लैक बॉक्स एआई का विनियमन: यूरोपीय संघ एआई अधिनियम, एनआईएसटी, सीएफपीबी

अधिकांश एआई विक्रेताओं को नियामकों से इतनी तेजी से कार्रवाई की उम्मीद नहीं थी। लेकिन उन्होंने ऐसा कर दिखाया। "पहले उत्पाद तैयार करो, बाद में दस्तावेज़ बनाओ" वाली पुरानी नीति अब खत्म हो रही है, और इसके पीछे कुछ ही नियम जिम्मेदार हैं।

यूरोपीय संघ के एआई अधिनियम के साथ यूरोप ने सबसे पहले यह उपलब्धि हासिल की। यह 2025 से 2027 तक चरणबद्ध तरीके से लागू किया जाएगा, न कि एकमुश्त। प्रतिबंधित प्रथाएं 2 फरवरी 2025 से प्रभावी हो गईं। सामान्य-उद्देश्यीय एआई नियम 2 अगस्त 2025 से लागू हुए। उच्च जोखिम वाली प्रणालियों के लिए दायित्व 2 अगस्त 2026 से लागू होंगे, और विनियमित उत्पादों का विस्तार इसके एक वर्ष बाद, 2 अगस्त 2027 को लागू होगा। जुर्माना नाममात्र का नहीं है। सबसे गंभीर उल्लंघनों के लिए 35 मिलियन यूरो या वैश्विक कारोबार का 7%, और बाकी के लिए 15 मिलियन यूरो या 3% (डीएलए पाइपर, 2025)। और उच्च जोखिम वाले उपयोग मामलों की सूची ब्लैक बॉक्स तैनाती के दिग्गजों की तरह है: क्रेडिट स्कोरिंग, भर्ती, शिक्षा, कानून प्रवर्तन, बायोमेट्रिक आईडी। इनमें से प्रत्येक के लिए अब दस्तावेज़ीकरण, पारदर्शिता और मानवीय निगरानी अनिवार्य है।

अमेरिका में स्थिति थोड़ी जटिल है, लेकिन प्रगति उसी दिशा में हो रही है। NIST AI रिस्क मैनेजमेंट फ्रेमवर्क अमेरिका के लिए एक आधारभूत मानक के सबसे करीब है। जनवरी 2023 में जारी और 2024 और 2025 में विस्तारित यह फ्रेमवर्क चुपचाप एक ऐसा दस्तावेज़ बन गया है जिसका उपयोग बड़ी कंपनियाँ अपने लिए करती हैं, चाहे तकनीकी रूप से यह आवश्यक हो या नहीं। दिसंबर 2025 में NIST IR 8596 जारी हुआ, जो साइबर AI प्रोफाइल का प्रारंभिक मसौदा है, और इसके बाद 14 जनवरी 2026 को एक कार्यशाला आयोजित की गई। कई टीमें पहले से ही इसे अपना रही हैं।

उपभोक्ता वित्तीय संरक्षण ब्यूरो ने इस मामले में और भी स्पष्ट रुख अपनाया है। परिपत्र 2022-03 और 2023-03 में यह बात सीधे तौर पर कही गई है: कोई भी ऋणदाता किसी जटिल एल्गोरिदम का उपयोग तब तक नहीं कर सकता जब तक कि उसकी जटिलता ECOA और विनियमन B के तहत प्रतिकूल कार्रवाई के विशिष्ट कारणों को बताने में बाधा उत्पन्न करती है। इसे ध्यान से पढ़ें। यह ऋण देने में मशीन लर्निंग पर प्रतिबंध नहीं है। यह ऐसी मशीन लर्निंग पर प्रतिबंध है जो इतनी अपारदर्शी हो कि आप अस्वीकृत आवेदक को यह न बता सकें कि उसने क्या गलती की है। संक्षेप में, यह उपभोक्ता ऋण के लिए एक तरह का ब्लैक बॉक्स प्रतिबंध है।

बैंकों को एक पुरानी लेकिन अभी भी अधिक कठिन आवश्यकता का सामना करना पड़ता है। फेडरल रिजर्व का SR 11-7, जो 2011 से लागू है, बैंकों को यह प्रदर्शित करने के लिए बाध्य करता है कि वे किसी भी ऐसे मॉडल को समझते हैं जो किसी महत्वपूर्ण निर्णय को संचालित करता है। आधुनिक डीप-लर्निंग सिस्टम बिना किसी सहायता के इस मानदंड को पूरा करने के लिए संघर्ष करते हैं, और OCC का बुलेटिन 2011-12 भी इसी दृष्टिकोण को लागू करता है।

कुल मिलाकर नतीजा यह है कि अमेरिका या यूरोपीय संघ में किसी भी विनियमित संस्था के पास अस्पष्टता को सटीकता के बदले स्वीकार्य समझौता मानने का कोई बहाना नहीं बचा है। या तो पहले डिज़ाइन समीक्षा से ही व्याख्यात्मकता को शामिल किया जाए, या फिर एक ऐसा हाइब्रिड मॉडल बनाया जाए जिसमें मॉडल की व्याख्या करने की क्षमता कम हो जाए और कोई दूसरा रास्ता कानूनी कार्रवाई से बच सके।

ब्लैक बॉक्स एआई सिस्टम का ऑडिट कैसे करें

तो 2026 में ब्लैक बॉक्स एआई सिस्टम की ज़िम्मेदार तैनाती वास्तव में कैसी दिखेगी? व्यावहारिक रणनीति विक्रेताओं के दावों से कहीं अधिक सरल है।

आप डेटा से शुरुआत करते हैं। प्रशिक्षण डेटा कहाँ से आया, इसे किसने लेबल किया और इसमें कौन-कौन से उपसमूह शामिल हैं, इन सब बातों का दस्तावेज़ीकरण करें। बाद में आने वाली लगभग आधी पूर्वाग्रह संबंधी समस्याएं पहले से ही यहाँ दर्ज हैं, और जिन आधी समस्याओं का आप पता नहीं लगा सकते, उन्हें आप ठीक नहीं कर सकते।

फिर आप मॉडल का गहन विश्लेषण करते हैं। इसमें प्रतिकूल इनपुट, प्रॉम्प्ट इंजेक्शन, एज केस और आउट-ऑफ-डिस्ट्रीब्यूशन उदाहरणों का उपयोग करके इसकी जांच करें। एंथ्रोपिक, ओपनएआई और माइक्रोसॉफ्ट अब इस कार्य के लिए प्लेबुक प्रकाशित करते हैं जिन्हें आप नई कार्यप्रणाली विकसित किए बिना अपना सकते हैं।

उत्पादन में मौजूद हर मॉडल पर XAI लागू करें, न कि केवल मुख्य मॉडलों पर। सारणीबद्ध पाइपलाइनों के लिए SHAP का उपयोग करें। टेक्स्ट और छवियों के लिए LIME का उपयोग करें। उपयोगकर्ता से संबंधित किसी भी निर्णय के लिए काउंटरफैक्चुअल का उपयोग करें। इनमें से कोई भी उपकरण परिपूर्ण नहीं है। दूसरी ओर, इनकी अनुपस्थिति किसी भी ऑडिटर के लिए खतरे की घंटी है जो आपके सिस्टम की जांच कर रहा है।

परिवर्तन पर नज़र रखें। मॉडल अधिकांश टीमों की अपेक्षा से कहीं अधिक तेज़ी से पुराने हो जाते हैं। इनपुट वितरण, आउटपुट वितरण और आगे आने वाले परिणामों पर नज़र रखें। प्रत्येक पर अलर्ट सेट करें और अस्पष्ट परिवर्तनों को जिज्ञासावश नहीं, बल्कि एक घटना के रूप में लें।

आवश्यकता पड़ने से पहले ही समस्या निवारण प्रक्रिया तैयार कर लें। हर महत्वपूर्ण निर्णय में मानवीय हस्तक्षेप और ग्राहक द्वारा उपयोग किया जा सकने वाला लिखित अपील चैनल होना चाहिए। यदि आपकी सहायता टीम ही अपील चैनल है, तो इसे भी लिख लें।

अंत में, अपने लिए लागू ढांचे का आकलन करें। यदि आप अमेरिका में हैं, तो NIST AI RMF का पालन करें। यदि आप यूरोप में हैं, तो EU AI अधिनियम की उच्च-जोखिम संबंधी आवश्यकताओं का पालन करें। यदि आप उपभोक्ता ऋण से संबंधित किसी भी मामले में शामिल हैं, तो CFPB परिपत्र 2022-03 और 2023-03 का पालन करें। इसे एक बार में, शुरुआत में ही कर लेना, प्रवर्तन कार्रवाई होने के बाद उसे संशोधित करने की तुलना में कहीं अधिक सस्ता पड़ता है।

आप ब्लैक बॉक्स को खत्म नहीं कर सकते। यह ठीक है। काम है इसे अवलोकन योग्य, जवाबदेह और सीमित बनाना। यही वह मानक है जिसे नियामक पहले से ही लागू कर रहे हैं, और 2026 में परिपक्व कार्यान्वयन ऐसा ही दिखेगा।