Was ist Black-Box-KI? Das Black-Box-Problem erklärt

Im April 2026 lieferte Vectaras Halluzinations-Rangliste ein überraschendes Ergebnis. Die besten Sprachmodelle halluzinieren im Kerntest nun in weniger als 4 % der Fälle. Die neuen Varianten von GPT-5, Claude Sonnet 4.5, Grok-4 und Gemini-3-Pro, die auf logisches Denken setzen, halluzinieren jedoch im neuen Datensatz in über 10 % der Fälle. Grok-4-Fast-Reasoning erreichte sogar 20,2 %. Die intelligentesten Modelle, die vor dem Antworten „nachdenken“, sind am schlechtesten darin, ihre Unsicherheiten zu erkennen.

Das ist das Black-Box-Problem in einem Absatz. Wir haben KI-Systeme entwickelt, die oft nützliche Ergebnisse liefern, die aber niemand, nicht einmal ihre Entwickler, vollständig erklären kann. Sie sind präzise, ohne kalibriert zu sein, fließend, ohne ehrlich zu sein, und selbstsicher, ohne korrekt zu sein.

Die Aufsichtsbehörden haben reagiert. Der EU-Gesetzentwurf zur künstlichen Intelligenz sieht nun Bußgelder von bis zu 35 Millionen Euro oder 7 % des weltweiten Umsatzes für verbotene Nutzungen vor. Die Regelungen für Hochrisikosysteme treten am 2. August 2026 in Kraft. Das US-amerikanische Consumer Financial Protection Bureau (CFPB) hat Banken unmissverständlich untersagt, komplexe Algorithmen einzusetzen, wenn diese die Begründung einer Kreditablehnung verhindern. Und der Bereich der erklärbaren KI, vor fünf Jahren noch ein Nischenthema, ist heute ein Markt, dessen Volumen bis 2026 auf 9 bis 13 Milliarden US-Dollar geschätzt wird.

Dieser Leitfaden erklärt, was Black-Box-KI eigentlich ist, warum selbst scheinbar einfache KI-Modelle zu Black Boxes werden, welche Probleme dabei auftreten, wo sie in der Krypto- und Fintech-Branche vorkommen, wie das Toolkit für erklärbare KI (SHAP, LIME, Kontrafaktuale) versucht, sie zu entschlüsseln, und was Sie über die neuen regulatorischen Rahmenbedingungen in der EU und den USA wissen sollten. Außerdem gibt es einen kurzen Exkurs, um ein häufiges Missverständnis auszuräumen: Blackbox AI, der Programmierassistent von blackbox.ai, ist etwas anderes.

Was ist Black-Box-KI und warum ist sie wichtig?

Black-Box-KI bezeichnet jedes KI-System, dessen interne Funktionsweise für Nutzer und oft auch für die Entwickler selbst undurchsichtig ist. Eingaben und Ausgaben sind zwar sichtbar, der Zusammenhang zwischen ihnen liegt jedoch verborgen in Schichten von Gewichtungen, gelernten Mustern und Transformationen des maschinellen Lernens, die für Menschen nicht vollständig nachvollziehbar sind. Dies gilt unabhängig davon, ob das Modell tabellarische Daten, Bilder oder Aufgaben der natürlichen Sprachverarbeitung wie Übersetzung und Chat verarbeitet.

Der Begriff ist älter als das moderne Deep Learning. Ingenieure verwenden den Begriff „Black Box“ seit mindestens den 1960er-Jahren für jedes System, das man von außen untersuchen, aber nicht öffnen kann. Auch das menschliche Gehirn selbst, so betonen Biologen gern, ist eine Black Box, doch der Vergleich hinkt: Eine KI funktioniert nicht wie ein Mensch, und die Annahme, sie tue es, ist einer der schnellsten Wege, die Bedeutung von „Black Box KI“ falsch einzuschätzen. Was sich im letzten Jahrzehnt verändert hat, ist der Umfang. Ein modernes, großes Sprachmodell kann Hunderte von Milliarden Parametern verarbeiten. Ein typisches tiefes neuronales Netzwerk verteilt „Wissen“ über Tausende von Schichten und Millionen von Aufmerksamkeitsköpfen, wobei einzelne Neuronen mehrere unabhängige Muster gleichzeitig kodieren. Forscher bezeichnen diese Eigenschaft als Polysemanz, und sie ist einer der Gründe, warum die mechanistische Interpretierbarkeit noch in den Anfängen steckt.

Warum sollte das irgendjemanden außerhalb von Forschungslaboren interessieren? Weil intransparente KI heute weitreichende Entscheidungen trifft. Sie entscheidet über Kreditvergabe, bewertet Angeklagte, kennzeichnet Transaktionen als betrügerisch und wickelt einen Großteil des Handelsvolumens an allen großen Kryptobörsen ab. Wenn sie einen Fehler macht, ist es aufgrund ihrer Intransparenz nahezu unmöglich, die Ursache zu finden, den Fehler zu beheben oder jemanden zur Rechenschaft zu ziehen.

Das ist auch deshalb relevant, weil die KI-Governance Intransparenz nicht länger als Problem der Entwickler betrachtet. Die EU sieht darin nun eine Frage des Marktzugangs, US-Regulierungsbehörden eine Frage der fairen Kreditvergabe. Jede Führungskraft, die seit 2024 eine KI-Initiative genehmigt hat, ist auf dasselbe Problem gestoßen: Was genau bewirkt diese Technologie, und warum? Das Verständnis von Black-Box-KI ist unerlässlich, und das Problem lässt sich nicht einfach durch die Wahl eines anderen Anbieters lösen.

Warum KI-Modelle zu Black Boxes werden

Nicht jede KI ist eine Blackbox. Ein einfacher Entscheidungsbaum ist vollkommen transparent. Ein lineares Regressionsmodell liefert nachvollziehbare Koeffizienten. Selbst ein regelbasiertes KI-System aus den 1990er-Jahren ist prinzipiell Zeile für Zeile überprüfbar.

Wie kommt es also, dass die heutigen KI-Modelle zu Blackboxes werden? Das geschieht aus vier sich überschneidenden Gründen.

Erstens: Skalierung. Deep-Learning-Modelle mit Millionen oder Milliarden von Parametern operieren in hochdimensionalen Räumen, die für Menschen nicht vorstellbar sind. Man kann ein Modell mit 200 Milliarden Parametern mathematisch beschreiben, aber niemand kann es sich im Kopf vorstellen.

Zweitens: verteilte Repräsentationen. In einem tiefen neuronalen Netzwerk speichert kein einzelnes Neuron „das Konzept der Katze“ oder „die Regel zur Ablehnung eines Kredits“. Konzepte verteilen sich auf Tausende von Neuronen, und einzelne Neuronen sind gleichzeitig an vielen Konzepten beteiligt. Eine eindeutige Erklärung zu finden, ist ein Forschungsprojekt, keine einfache Frage.

Drittens: Abhängigkeit von den Trainingsdaten. Das Verhalten des Modells wird maßgeblich von seinen Trainingsdaten bestimmt, die in der Regel proprietär, umfangreich und mitunter rechtlich problematisch sind. Selbst wenn ein Entwickler die Modellgewichte veröffentlicht, werden die Daten selbst selten geteilt. Ein wesentlicher Teil des „Warum“ fehlt somit.

Viertens, die Absicht. Es gibt praktische Gründe für den bewussten Einsatz von Black-Box-Ansätzen. Manche KI-Entwickler und Programmierer verschleiern die internen Abläufe ihrer Modelle absichtlich, um geistiges Eigentum zu schützen. Weitere Gründe für Black-Box-Designs sind Lizenzbedingungen und Wettbewerbsvorteile. Selbst ein Modell mit offengelegten Gewichten kann seine Entscheidungen effektiv intransparent gestalten, da die meisten modernen Modelle auf emergenten Mustern basieren, die in der Dokumentation nicht erfasst werden. Ein Unternehmen, das 100 Millionen Dollar in ein Modell investiert hat, wird dessen Architektur und Trainingsverfahren kaum veröffentlichen wollen. Auch Open-Source-KI-Modelle, die ihren Quellcode offenlegen, sind letztendlich Black Boxes, da die Nutzer die gelernten Gewichte nicht sinnvoll interpretieren können.

Das Ergebnis ist, dass selbst scheinbar einfache, fortgeschrittene KI-Modelle, darunter LLMs und generative KI-Modelle, standardmäßig zu Blackboxes werden. Transparente Modelle sind die Ausnahme, nicht die Regel. Komplexe Blackboxes können beeindruckende Genauigkeit liefern, weshalb Teams sie trotz ihrer Intransparenz weiterhin einsetzen. Dasselbe gilt für Blackbox-KI-Modelle, die mit umfangreichen, unstrukturierten Daten trainiert wurden: Der Vorteil gegenüber regelbasierten KI-Modellen ist oft so groß, dass die Bedenken hinsichtlich der Erklärbarkeit in den Hintergrund treten, bis ein Fehler auftritt. Die meisten modernen Blackbox-KIs bleiben letztendlich Blackboxes, da die Benutzer die gelernten Gewichte nicht einsehen können. Modelle mit offenen Gewichten legen ihren zugrundeliegenden Code offen, und Benutzer können die Architektur lesen, aber der Code bleibt letztendlich eine Blackbox, wenn man fragt: „Warum hat das Modell das gesagt?“

Das Black-Box-Problem beim Deep Learning

Das Black-Box-Problem entsteht, wenn diese vier Gründe zusammenwirken. Das Modell funktioniert, oft sogar beeindruckend. Aber es funktioniert auf eine Weise, die sich drei Dingen gleichzeitig widersetzt: Erklärung, Bestätigung und Korrektur.

Nehmen wir das klassische Beispiel: Ein Deep-Learning-Modell wurde darauf trainiert, Pandas zu erkennen. Es erzielt im Testdatensatz 99 %. Das sieht vielversprechend aus. Doch dann analysiert jemand die Daten und entdeckt, dass das Modell gar nicht den Panda selbst erkennt, sondern den Bambus. Die meisten Panda-Fotos in den Trainingsdaten zeigen nämlich auch Bambus. Das Modell hat sich eine Abkürzung angeeignet. Bei einem Panda-Foto ohne Bambus versagt es.

Diese Art von „Abkürzungslernen“ ist im Deep Learning allgegenwärtig. Das Modell findet eine statistische Regelmäßigkeit, die nicht dem zugrundeliegenden Konzept entspricht, was aber erst auffällt, wenn die Realität geringfügig vom Trainingsdatensatz abweicht. Die Finanzkrise von 2008 dient hier als historisches Beispiel. Value-at-Risk-Modelle, die auf Gaußschen Annahmen basierten, funktionierten in normalen Märkten hervorragend, versagten aber in Extremsituationen schlagartig, weil sie Abkürzungen gelernt hatten, die den Modellierern selbst nicht als solche bewusst waren.

Heutige Deep-Learning-Modelle weisen genau diesen Fehler auf, allerdings mit mehr Parametern und höherer Zuverlässigkeit. Forscher im Bereich der mechanistischen Interpretierbarkeit, darunter Teams von Anthropic und OpenAI, haben damit begonnen, kleine Teile von Sprachmodellen Neuron für Neuron zu analysieren. Ihre Arbeit zeigt, dass das Innere eines LLM eher verschränkten Schaltkreisen als geordneter Logik ähnelt. Es gibt keinen Punkt, an dem man sagen könnte: „Hier liegt die Lösung.“ Das Black-Box-Problem ist kein Fehler, der behoben werden muss; es ist strukturell bedingt.

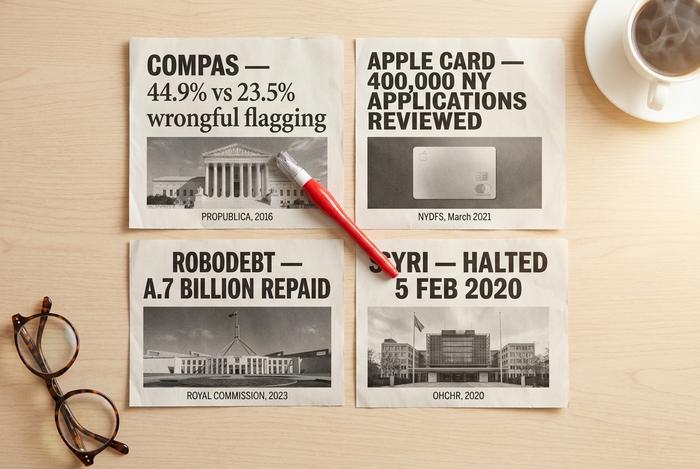

Beispiele für Black-Box-KI: COMPAS, Apple Card, Robodebt, SyRI

Wollen Sie sehen, wie eine Blackbox-KI aussieht, wenn sie versagt? Die vier immer wieder zitierten Fälle liefern Ihnen die wichtigsten Informationen. Sie betreffen Bereiche wie Strafjustiz, Bankwesen und Sozialwesen. Sie alle haben realen Menschen geschadet. Und kein Fall verlief auf exakt dieselbe Weise.

Beginnen wir mit COMPAS. Northpointe entwickelte das System, um die Rückfallwahrscheinlichkeit von Angeklagten vorherzusagen, und US-Gerichte führten es flächendeckend ein. ProPublica nahm das System genauer unter die Lupe. Ihre Prüfung aus dem Jahr 2016 analysierte die Daten von über 7.000 Festgenommenen im Broward County, und das Ergebnis war erschreckend: Schwarze Angeklagte wurden in 44,9 % der Fälle fälschlicherweise als Hochrisikofälle eingestuft, während der Anteil bei weißen Angeklagten nur 23,5 % betrug. Eine Folgestudie aus dem Jahr 2024 verschärfte die Situation. Zwei Merkmale (Alter und Vorstrafen) erreichten die Genauigkeit von COMPAS mit seinen 137 Kriterien. Die Komplexität lieferte also keinerlei zusätzliche Informationen, erschwerte aber die Erkennung der Verzerrung erheblich. Dies ist das klassische Black-Box-Modell, das Menschen statt Produkte bewertet. Das von Amazon 2018 abgeschaffte Modell zur Bewertung von Bewerbern folgt demselben Muster.

Dann die Apple Card, Ende 2019. Wozniak berichtete, dass seine Frau ein zehnmal niedrigeres Kreditlimit als er selbst erhalten habe. David Heinemeier Hansson bestätigte dies. Die Geschichte verbreitete sich rasant. Das New Yorker Finanzaufsichtsamt nahm den Fall ernst: Es prüfte rund 400.000 Anträge. Im März 2021 kam es zu dem Ergebnis, dass keine gesetzliche Diskriminierung aufgrund des Geschlechts vorliege. Doch es hieß auch – und das ist der entscheidende Punkt –, dass die Intransparenz der Kundenerfahrung an sich ein Vertrauensproblem darstelle. Der Schaden durch intransparente Prozesse hängt, wie sich herausstellt, zur Hälfte mit den tatsächlichen Ergebnissen und zur Hälfte mit der öffentlichen Wahrnehmung zusammen. Eine Pressemitteilung kann die öffentliche Wahrnehmung nicht verbessern.

Robodebt ist die andere Seite der Medaille. Hier kommt kein tiefes neuronales Netzwerk zum Einsatz. Australien wandte zwischen 2016 und 2019 eine Einkommensdurchschnittsregel auf Sozialhilfedaten an, beschuldigte rund 400.000 Leistungsempfänger des Betrugs und konnte die Berechnung den Empfängern der Schreiben nicht verständlich erklären. Eine Untersuchungskommission erklärte das System später für rechtswidrig. Die Regierung zahlte 1,7 Milliarden australische Dollar zurück und zusätzlich 112 Millionen australische Dollar Entschädigung. Fazit: Ein System muss nicht technisch ausgefeilt sein, um eine Blackbox zu sein. Es muss lediglich nicht nachvollziehbar sein.

Die niederländische Toeslagenaffäre und SyRI bilden den europäischen Rahmen für ähnliche Fälle. Am 5. Februar 2020 ordnete ein niederländisches Gericht die sofortige Einstellung von SyRI an und urteilte, dass dessen Intransparenz gegen Artikel 8 der Europäischen Menschenrechtskonvention verstoße. Der damit verbundene Skandal um Kinderbetreuungsgelder riss über 20.000 Eltern mit sich, die fälschlicherweise des Betrugs beschuldigt wurden. Die Regierung Rutte trat im Januar 2021 deswegen zurück. Dieses Urteil gilt in EU-Politikkreisen seither als Referenzpunkt dafür, warum intransparente KI in sensiblen Bereichen keine Frage der Ethik, sondern ein juristisches Problem darstellt.

Vier Fallbeispiele. Unterschiedliche Branchen, unterschiedliche Technologien, unterschiedliche Länder. Dasselbe Muster: ein undurchsichtiges System, eine folgenreiche Entscheidung und Menschen, die die Konsequenzen tragen müssen und keine wirkliche Möglichkeit haben, sich zu wehren.

Black-Box-KI-Risiko in realen KI-Systemen

Sobald man beginnt, die Risiken von Black-Box-KI in realen KI-Systemen zu erfassen, zeichnet sich ein Muster ab. Dieselben fünf Risiken tauchen immer wieder auf, unabhängig davon, ob es sich bei dem Modell um einen Kreditscorer, einen Chatbot oder ein algorithmisches Handelssystem handelt.

| Risiko | So sieht es aus | Warum es skaliert |

|---|---|---|

| Versteckte Voreingenommenheit | Das Modell behandelt geschützte Gruppen anders | Die Trainingsdaten enthalten historische Muster |

| Halluzination | Das Modell erfindet Fakten oder Zitate. | LLMs optimieren auf Sprachgewandtheit, nicht auf Wahrheit |

| Abkürzungslernen | Das Modell basiert auf irrelevanten Korrelationen. | Leichter zu lernen als das eigentliche Konzept |

| Feindseligkeit | Kleine Eingangsänderung kehrt den Ausgang um | Hochdimensionale Entscheidungsgrenzen |

| Aufschlüsselung der Prüfung | Warum lässt sich das nicht rekonstruieren? | Kein interpretierbarer interner Zustand |

Diese Risiken verstärken sich bei intransparenten KI-Systemen, die in den Bereichen Finanzen, Personalwesen, Gesundheitswesen und Kryptowährungen eingesetzt werden. Die komplexen Deep-Learning-Prozesse in diesen Systemen erschweren es, den nächsten Fehler vorherzusagen, und herkömmliche KI-Tools für die Qualitätssicherung wurden nicht für Modelle mit Hunderten von Milliarden Parametern entwickelt.

Versteckte Verzerrungen sorgen zwar für Schlagzeilen, doch die Anfälligkeit gegenüber Angriffen und das Versagen von Audits stellen langfristig größere Probleme dar. Eine stabile Verzerrung lässt sich zumindest messen und korrigieren. Ein Modell, das bei jeder Ausführung unterschiedliche Fehler aufweist (wie ChatGPT bei etwa 42 % der Smart-Contract-Evaluierungsaufgaben laut einer ACM-TOSEM-Studie von 2024), ist deutlich schwieriger für den regulierten Einsatz zu zertifizieren.

Der neueste Eintrag auf dieser Liste ist das, was Forscher als „agentisches KI-Risiko“ bezeichnen. Wenn man ein LLM in Tools integriert, ihm Speicher zuweist und es APIs aufrufen lässt, verstärkt sich die Intransparenz. Eine einzelne Entscheidung wird so zu einer Kette von Modellaufrufen, abgerufenen Dokumenten und Tool-Aufrufen, die jeweils nur teilweise transparent sind. Moderne Agenten sind Black Boxes in Black Boxes.

Black-Box-KI in Krypto und Fintech

Von allen Branchen, die Black-Box-KI einsetzen, prallen Implementierung und Risiko im Krypto- und Fintech-Bereich am stärksten aufeinander. Es geht um viel. Die Reaktionszeiten sind kurz. Die Transparenz ist gering. Die Regulierung, insbesondere im Kryptobereich, ist noch immer lückenhaft. Das Ergebnis ist ein Umfeld, in dem die Implementierung im Vordergrund steht und die Dokumentation erst im Nachhinein erstellt wird.

Algorithmischer Handel. Schätzungen zufolge werden 2025 70–80 % des Kryptovolumens auf algorithmischen Handel zurückzuführen sein – mehr als die 60–70 % an den wichtigsten Aktienmärkten. Allein Wintermute bewegt durchschnittlich täglich über 15 Milliarden US-Dollar an mehr als 60 Handelsplätzen, wobei 2025 ein Rekordvolumen von 2,24 Milliarden US-Dollar an einem einzigen Tag verzeichnet wurde. Die Strategien hinter diesen Geldflüssen basieren auf Deep-Learning-Systemen, die von außen nicht überprüft werden können. Der Zusammenbruch von Alameda/FTX im November 2022 verdeutlicht dieses Risiko am besten: Die gesamte Marktkapitalisierung des Kryptomarktes fiel innerhalb von etwa einem Monat von über einer Billion US-Dollar auf unter 800 Milliarden US-Dollar, und die zugrunde liegende FTT-Position von 14,6 Milliarden US-Dollar in Alamedas Bilanz blieb bis zu dem Zeitpunkt unsichtbar, als sie plötzlich offenkundig wurde.

AML- und KYC-Bewertung. Der globale Markt für Anti-Geldwäsche-Software erreichte 2025 ein Volumen von 4,13 Milliarden US-Dollar und wird bis 2030 voraussichtlich auf 9,38 Milliarden US-Dollar anwachsen (MarketsandMarkets). Die Einhaltung der AML/KYC-Vorschriften im Kryptobereich verzeichnet ein jährliches Wachstum von 13,8 %. Anbieter wie ComplyAdvantage, Chainalysis Reactor und Elliptic Navigator nutzen mittlerweile Black-Box-Machine-Learning-Modelle zur Risikobewertung von Wallets. Der Einsatz von Black-Box-Machine-Learning ist weit verbreitet und effektiv genug, um bei den meisten großen Börsen implementiert zu werden. Gleichzeitig ist die Methode so intransparent, dass Compliance-Beauftragte oft nicht nachvollziehen können, warum eine bestimmte Wallet gesperrt wurde.

Smart-Contract-Auditierung. Hier zeigen sich die Grenzen der KI deutlich. Eine arXiv-Studie aus dem Jahr 2024 evaluierte GPT-4 hinsichtlich der Erkennung von Schwachstellen in Smart Contracts. Die KI erreichte eine Präzision von 96,6 %, jedoch nur eine Trefferquote von 37,8 % und übersah damit fast zwei Drittel der tatsächlichen Schwachstellen. Die Ergebnisse von ChatGPT sind bei 42 % der Verträge über mehrere Durchläufe hinweg instabil (ACM TOSEM 2024). Hybrid-Tools wie GPTScan, die GPT mit statischer Analyse kombinieren, erreichen bei Token-Verträgen eine Präzision von über 90 % und eine Trefferquote von ca. 70 % (arXiv 2308.03314). CertiK Skynet überwacht mittlerweile über 17.000 Projekte mit einem Marktwert von rund 494 Milliarden US-Dollar, doch jedes verantwortungsvolle Audit-Team kombiniert die KI weiterhin mit einem menschlichen Prüfer.

Robo-Advisors. Betterment verwaltet über 56 Milliarden US-Dollar in mehr als 900.000 Konten. Wealthfront kommt auf 42,9 Milliarden US-Dollar. Die Robo-Advisor-Branche hat weltweit die Marke von einer Billion US-Dollar an verwaltetem Vermögen überschritten. Portfolio-Rebalancing, Verlustverrechnung und Risikobewertung basieren auf KI-Modellen, deren konkrete Entscheidungen in keiner öffentlich zugänglichen Dokumentation offengelegt werden.

Kreditwürdigkeitsprüfung und Betrugserkennung. FICO wird von 90 % der US-Kreditgeber genutzt, und FICO Falcon verarbeitet jährlich über 65 Milliarden Transaktionen mit einer gemeldeten Betrugserkennungsrate von über 95 %. Eine Studie der Bank of England aus dem Jahr 2024, die 50 britische Institute untersuchte, ergab, dass maschinelles Lernen bei Kreditrisikomodellen Fehlklassifizierungen im Vergleich zur logistischen Regression um etwa 25 % reduzierte. Der Genauigkeitsgewinn ist also real. Der Nachteil besteht darin, dass US-Kreditgeber gemäß den CFPB-Rundschreiben 2022-03 und 2023-03 keine Modelle verwenden dürfen, die so intransparent sind, dass bestimmte Begründungen für negative Maßnahmen gemäß ECOA vermieden werden.

Das Muster ist bei allen fünf Modellen identisch. Das Modell ist genauer als die transparente Vergleichsbasis. Die Intransparenz ist strukturell untrennbar mit der Genauigkeit verbunden. Und die Regulierungsbehörden reagieren schneller als die Entwicklung von Instrumenten zur Erklärbarkeit.

Anmerkung zu Blackbox AI: Der LLM-Studiengang Programmierung

Kurz zur Klarstellung: Wenn nach „Blackbox-KI“ gesucht wird, ist oft das in diesem Artikel beschriebene konzeptionelle Problem gemeint. Manchmal ist aber auch Blackbox AI, das Unternehmen hinter blackbox.ai, gemeint. Blackbox.ai ist ein Programmier-Tool, das die Art und Weise, wie Entwickler Code schreiben, revolutionieren soll. Das Produkt integriert sich als Programmierassistent in VS Code, schlägt Code vor und konkurriert mit Tools wie Claude Code, GitHub Copilot und Cursor. Es zählt zu den bekanntesten fortschrittlichen KI-Technologien im Bereich KI-gestütztes Programmieren und basiert auf mehreren KI-Modellen. Der von Blackbox vorgeschlagene Code deckt alles ab, von Refactoring bis hin zu Testgerüsten. Blackbox integriert Codegenerierung, Chat und Suche in einen einzigen Workflow und gilt für die meisten Nutzer als der beste KI-Assistent, den sie je in ihrem Editor verwendet haben.

Die beiden Bedeutungen vermischen sich oft in Suchergebnissen. Das Produkt Blackbox AI ist nicht Gegenstand dieses Artikels. Wir betrachten die strukturellen Eigenschaften von intransparenten KI-Systemen, nicht einen bestimmten Programmierassistenten. Falls Sie nach dem Produkt gesucht haben, finden Sie die Dokumentation und Preisinformationen des Unternehmens auf dessen Website. Falls Sie nach dem Konzept gesucht haben, lesen Sie bitte weiter.

Erklärbare KI und Erklärbarkeitswerkzeuge

Erklärbare KI, meist XAI genannt, ist ein Forschungsgebiet, das versucht, undurchsichtige KI-Modelle transparenter zu machen, ohne deren Genauigkeit zu beeinträchtigen. Sie ist mittlerweile ein etablierter Markt. Prognosen für 2026 gehen von einem globalen Volumen zwischen 9 und 13 Milliarden US-Dollar aus, wobei die genaue Spanne von der jeweiligen Definition von XAI abhängt. Ziel ist es, KI-Modelle erklärbarer zu gestalten, ohne Entwickler zu langsameren oder ungenaueren Vorgehensweisen zu zwingen. Kompetente Teams wenden diese Tools auf KI-Tools an, bevor sie diese veröffentlichen, und ergänzen die Ergebnisse durch eine Dokumentation, die auch für menschliche Prüfer verständlich ist.

Drei Familien von XAI-Techniken sind es wert, kennengelernt zu werden.

Das erste Verfahren ist SHAP, kurz für SHapley Additive exPlanations. Es stammt aus der kooperativen Spieltheorie: Für jede Vorhersage ordnet SHAP jedem Eingabemerkmal einen Beitragswert zu. Kreditbewertungsteams und Betrugserkennungsteams schätzen es. Risikomodellierer im Gesundheitswesen kommen damit zurecht. SHAP ist theoretisch fundiert, aber rechentechnisch eine enorme Herausforderung bei großen tabellarischen Datenmengen.

Das zweite Verfahren ist LIME (Local Interpretable Model-agnostic Explanations). LIME erstellt ein einfaches, interpretierbares Ersatzmodell basierend auf einer einzelnen Vorhersage und erklärt damit die ursprüngliche Vorhersage. Es ist schneller als SHAP und funktioniert mit Texten, Bildern und Tabellen. Der Haken dabei ist, dass LIME von Grund auf lokal arbeitet und daher irreführend sein kann, wenn man annimmt, eine Erklärung sei verallgemeinerbar.

Die dritte Möglichkeit sind kontrafaktische Erklärungen. Anstatt zu erklären, warum das Modell „Ja“ gesagt hat, zeigen kontrafaktische Erklärungen die kleinste Änderung der Eingabeparameter auf, die zu einem „Nein“ geführt hätte. Genau das möchte ein Kreditantragsteller oder eine beanstandete Transaktion wissen: „Was müsste ich ändern?“ Kontrafaktische Erklärungen gewinnen in Ablehnungsbescheiden schnell an Bedeutung, gerade weil sie den Erwartungen der Aufsichtsbehörden genau entsprechen.

Neben diesen drei Aspekten werden Sie Feature-Importance-Plots, Aufmerksamkeitsvisualisierungen für Transformer-Layer und Grad-CAM für Bildklassifikatoren sehen. Die mechanistische Interpretierbarkeit, also das Reverse Engineering spezifischer Neuronen und Aufmerksamkeitsschaltkreise, ist ein Spitzenforschungsgebiet. Anthropic, OpenAI und einige akademische Labore haben Teilschaltungen veröffentlicht, doch diese Arbeiten lassen sich noch nicht in eine für Compliance-Teams in Unternehmen nutzbare Lösung umsetzen.

Seien Sie ehrlich, was die tatsächliche Leistungsfähigkeit dieser Ergebnisse angeht. Branchenstudien von Palo Alto Networks und anderen zeigen, dass XAI gut für Bildklassifikatoren und strukturierte Tabellenmodelle geeignet ist, für LLMs jedoch nur bedingt. Die Logik innerhalb eines Sprachmodells ändert sich mit der Tokenposition und dem Kontextfenster, sodass Merkmalszuordnungswerte irreführend sein können, ohne dass die Erklärung selbst davor warnt. Erklärbarkeitswerkzeuge, die ihren zugrunde liegenden Code offenlegen, sind zwar hilfreich, stellen aber keine endgültige Lösung für das Black-Box-Problem dar.

Regulierung von Black-Box-KI: EU-KI-Gesetz, NIST, CFPB

Die meisten KI-Anbieter hatten nicht mit einem so schnellen Vorgehen der Regulierungsbehörden gerechnet. Doch genau das ist passiert. Die alte Strategie „Erst liefern, dann dokumentieren“ hat ausgedient, und eine Handvoll Regeln ist der Grund dafür.

Europa war mit dem EU-KI-Gesetz Vorreiter. Die Einführung erfolgt schrittweise von 2025 bis 2027, nicht abrupt. Verbotene Praktiken wurden am 2. Februar 2025 durchsetzbar. Die allgemeinen KI-Regeln traten am 2. August 2025 in Kraft. Die Pflichten für Hochrisikosysteme gelten ab dem 2. August 2026, und die Ausweitung auf regulierte Produkte folgt ein Jahr später, am 2. August 2027. Die Strafen sind nicht zu unterschätzen: 35 Millionen Euro oder 7 % des weltweiten Umsatzes für die schwerwiegendsten Verstöße, 15 Millionen Euro oder 3 % für alle anderen (DLA Piper, 2025). Die Liste der Hochrisiko-Anwendungsfälle liest sich wie ein Who’s Who der Black-Box-Systeme: Kreditwürdigkeitsprüfung, Personalbeschaffung, Bildung, Strafverfolgung, biometrische Identifizierung. Für all diese Anwendungen sind nun standardmäßig Dokumentation, Transparenz und menschliche Aufsicht erforderlich.

Die Lage in den USA ist komplexer, aber die Entwicklung geht in dieselbe Richtung. Das NIST AI Risk Management Framework kommt einer US-amerikanischen Vergleichsgrundlage am nächsten. Es wurde im Januar 2023 veröffentlicht und in den Jahren 2024 und 2025 erweitert. Seitdem hat es sich stillschweigend zu dem Dokument entwickelt, an dem sich große Unternehmen orientieren, unabhängig von einer formalen Verpflichtung. Im Dezember 2025 erschien NIST IR 8596, der vorläufige Entwurf des Cyber AI Profile, gefolgt von einem Workshop am 14. Januar 2026. Zahlreiche Teams setzen es bereits ein.

Das Consumer Financial Protection Bureau hat sich deutlicher geäußert. In den Rundschreiben 2022-03 und 2023-03 heißt es unmissverständlich: Ein Kreditgeber darf keinen komplexen Algorithmus verwenden, wenn dieser ihn daran hindert, die konkreten Gründe für eine Ablehnung gemäß ECOA und Verordnung B anzugeben. Lesen Sie dies aufmerksam. Es handelt sich nicht um ein generelles Verbot von maschinellem Lernen im Kreditwesen. Es ist vielmehr ein Verbot von maschinellem Lernen, das so intransparent ist, dass man einem abgelehnten Antragsteller nicht mitteilen kann, was er falsch gemacht hat. Dies entspricht faktisch einem Verbot von Blackbox-Verfahren im Verbraucherkreditbereich.

Banken stehen vor einer älteren, aber immer noch anspruchsvolleren Anforderung. Die seit 2011 geltende Richtlinie SR 11-7 der Federal Reserve verpflichtet Banken, nachzuweisen, dass sie jedes Modell verstehen, das einer wesentlichen Entscheidung zugrunde liegt. Moderne Deep-Learning-Systeme haben ohne Unterstützung Schwierigkeiten, diese Hürde zu überwinden, und das Bulletin 2011-12 des OCC verfolgt denselben Ansatz.

Das Ergebnis: Regulierte Unternehmen in den USA und der EU haben keine Ausrede mehr, Intransparenz als akzeptablen Kompromiss für Genauigkeit zu betrachten. Entweder wird Interpretierbarkeit von Anfang an in die Designprüfung integriert, oder man entwickelt ein Hybridmodell, bei dem der Mensch die Erklärung liefert, die das Modell nicht leisten kann. Ein dritter Weg ist vor behördlichen Maßnahmen nicht sicher.

Wie man ein Black-Box-KI-System prüft

Wie sieht also der verantwortungsvolle Einsatz eines Black-Box-KI-Systems im Jahr 2026 tatsächlich aus? Der praktische Leitfaden ist kürzer, als die Anbieter behaupten.

Man beginnt mit den Daten. Dokumentieren Sie, woher die Trainingsdaten stammen, wer sie gekennzeichnet hat und welche Untergruppen vertreten sind. Etwa die Hälfte der später auftretenden Verzerrungsprobleme ist bereits hier angelegt, und die andere Hälfte lässt sich nicht beheben.

Anschließend testen Sie das Modell mit einem Red-Team. Untersuchen Sie es mit fehlerhaften Eingaben, Prompt-Injections, Grenzfällen und Beispielen außerhalb der üblichen Verteilung. Anthropic, OpenAI und Microsoft veröffentlichen mittlerweile Anleitungen für diese Vorgehensweise, die Sie anpassen können, ohne neue Methoden entwickeln zu müssen.

Wenden Sie XAI auf jedes Modell in der Produktion an, nicht nur auf die wichtigsten. Nutzen Sie SHAP für tabellarische Pipelines. LIME für Text und Bilder. Führen Sie Kontrafaktualisierungen für jede Entscheidung durch, die einen Benutzer betrifft. Keines dieser Tools ist perfekt. Ihr Fehlen hingegen ist ein Warnsignal für jeden Auditor, der Ihre Systeminfrastruktur prüft.

Achten Sie auf Abweichungen. Modelle veralten schneller als die meisten Teams erwarten. Verfolgen Sie die Verteilungen der Eingangsdaten, der Ausgangsdaten und die daraus resultierenden Folgen. Richten Sie für jedes dieser Elemente Warnmeldungen ein und behandeln Sie unerklärliche Abweichungen als Vorfälle, nicht als Kuriositäten.

Erstellen Sie den Eskalationspfad, bevor Sie ihn benötigen. Jede wichtige Modellentscheidung sollte eine menschliche Korrekturmöglichkeit und einen dokumentierten Beschwerdekanal haben, den Kunden tatsächlich nutzen können. Wenn Ihr Support-Team als Beschwerdekanal dient, dokumentieren Sie dies ebenfalls.

Abschließend sollten Sie sich an den jeweils geltenden Rahmenbedingungen orientieren. In den USA gilt dies für das NIST AI RMF, in Europa für die Anforderungen des EU AI Act für Unternehmen mit hohem Risiko und bei allen Tätigkeiten im Bereich Verbraucherkredite für die CFPB-Rundschreiben 2022-03 und 2023-03. Eine frühzeitige und umfassende Anpassung ist deutlich günstiger als eine nachträgliche Korrektur, nachdem bereits eine behördliche Maßnahme gegen Sie eingeleitet wurde.

Die Blackbox lässt sich nicht eliminieren. Das ist in Ordnung. Die Aufgabe besteht darin, sie beobachtbar, nachvollziehbar und begrenzt zu machen. Diesen Standard setzen die Regulierungsbehörden bereits durch, und so sieht ein ausgereifter Einsatz im Jahr 2026 aus.