ปัญญาประดิษฐ์แบบกล่องดำคืออะไร? ปัญหาของกล่องดำ อธิบายโดยละเอียด

ในเดือนเมษายน 2026 ผลการจัดอันดับความผิดพลาดในการประมวลผลข้อมูลของ Vectara กลับให้ผลลัพธ์ที่น่าประหลาดใจ โมเดลภาษาชั้นนำในปัจจุบันผิดพลาดในการประมวลผลข้อมูลน้อยกว่า 4% ในการทดสอบหลัก แต่โมเดล GPT-5, Claude Sonnet 4.5, Grok-4 และ Gemini-3-Pro เวอร์ชัน "การให้เหตุผล" ใหม่ กลับผิดพลาดในการประมวลผลข้อมูลมากกว่า 10% ในชุดข้อมูลใหม่ โดย Grok-4-fast-reasoning ผิดพลาดถึง 20.2% โมเดลที่ฉลาดที่สุด โมเดลที่ "คิด" ก่อนตอบ กลับเป็นโมเดลที่แย่ที่สุดในการบอกคุณว่าเมื่อใดที่พวกมันไม่รู้คำตอบ

นั่นคือปัญหาของกล่องดำในย่อหน้าเดียว เราได้สร้างระบบ AI ที่มักให้ผลลัพธ์ที่เป็นประโยชน์ แต่ไม่มีใคร รวมถึงผู้สร้างเอง สามารถอธิบายได้อย่างครบถ้วน ระบบเหล่านี้มีความแม่นยำโดยไม่ต้องปรับเทียบ มีความคล่องแคล่วโดยไม่ต้องซื่อสัตย์ และมีความมั่นใจโดยไม่ถูกต้อง

หน่วยงานกำกับดูแลได้สังเกตเห็นเรื่องนี้แล้ว ปัจจุบันกฎหมาย AI ของสหภาพยุโรปกำหนดโทษปรับสูงสุดถึง 35 ล้านยูโร หรือ 7% ของยอดขายทั่วโลก สำหรับการใช้งานที่ต้องห้าม โดยกฎเกณฑ์สำหรับระบบที่มีความเสี่ยงสูงจะมีผลบังคับใช้ในวันที่ 2 สิงหาคม 2569 สำนักงานคุ้มครองผู้บริโภคทางการเงินของสหรัฐฯ ได้แจ้งธนาคารอย่างชัดเจนว่าไม่สามารถใช้อัลกอริทึมที่ซับซ้อนได้ หากอัลกอริทึมเหล่านั้นทำให้ธนาคารไม่สามารถอธิบายเหตุผลการปฏิเสธสินเชื่อได้ และสาขา AI ที่อธิบายได้ ซึ่งเมื่อ 5 ปีก่อนเป็นเพียงหัวข้อเฉพาะกลุ่ม ปัจจุบันเป็นตลาดที่มีมูลค่าประมาณ 9,000 ถึง 13,000 พันล้านดอลลาร์ในปี 2569

คู่มือนี้จะอธิบายว่า AI แบบกล่องดำคืออะไร ทำไมโมเดล AI ที่ดูเรียบง่ายจึงกลายเป็นกล่องดำ เกิดอะไรขึ้นเมื่อเป็นเช่นนั้น AI แบบกล่องดำปรากฏให้เห็นในวงการคริปโตและฟินเทคอย่างไร เครื่องมือ AI ที่อธิบายได้ (SHAP, LIME, counterfactuals) พยายามไขปริศนาเหล่านี้อย่างไร และสิ่งที่คุณควรรู้เกี่ยวกับระบอบการกำกับดูแลใหม่ในสหภาพยุโรปและสหรัฐอเมริกา นอกจากนี้ยังมีส่วนเพิ่มเติมสั้นๆ เพื่อชี้แจงความสับสนที่เกิดขึ้นซ้ำๆ: AI แบบกล่องดำ ซึ่งเป็นผู้ช่วยเขียนโค้ดที่ blackbox.ai นั้นแตกต่างจาก AI แบบกล่องดำ

ปัญญาประดิษฐ์แบบกล่องดำคืออะไร และทำไมจึงสำคัญ

ปัญญาประดิษฐ์แบบกล่องดำ หมายถึงระบบปัญญาประดิษฐ์ใดๆ ที่กระบวนการคิดภายในนั้นไม่โปร่งใสต่อผู้ใช้ และบ่อยครั้งก็โปร่งใสต่อผู้พัฒนาที่สร้างมันขึ้นมาด้วย ข้อมูลนำเข้าและข้อมูลส่งออกนั้นมองเห็นได้ แต่เส้นทางระหว่างข้อมูลเหล่านั้นถูกซ่อนอยู่ภายในชั้นของน้ำหนัก รูปแบบที่เรียนรู้ และการแปลงข้อมูลด้วยการเรียนรู้ของเครื่อง ซึ่งมนุษย์ไม่สามารถอ่านได้อย่างสมบูรณ์ หลักการเดียวกันนี้ใช้ได้กับโมเดลที่จัดการกับข้อมูลตาราง รูปภาพ หรืองานประมวลผลภาษาธรรมชาติ เช่น การแปลและการสนทนา

คำว่า "กล่องดำ" นั้นมีมานานกว่าการเรียนรู้เชิงลึกสมัยใหม่เสียอีก วิศวกรใช้คำนี้มาอย่างน้อยตั้งแต่ทศวรรษ 1960 สำหรับระบบใดๆ ก็ตามที่คุณสามารถตรวจสอบจากภายนอกได้ แต่ไม่สามารถถอดชิ้นส่วนได้ สมองของมนุษย์เอง นักชีววิทยาชอบชี้ให้เห็นว่าเป็นกล่องดำเช่นกัน แต่การเปรียบเทียบนั้นมีขอบเขตจำกัด เพราะ AI ไม่ได้ทำงานเหมือนมนุษย์ และการสมมติว่ามันทำงานเหมือนมนุษย์นั้นเป็นหนึ่งในวิธีที่เร็วที่สุดที่จะเข้าใจผิดเกี่ยวกับความหมายของ AI กล่องดำ สิ่งที่เปลี่ยนไปในทศวรรษที่ผ่านมาคือขนาด โมเดลภาษาขนาดใหญ่สมัยใหม่สามารถรองรับพารามิเตอร์ได้หลายแสนล้านตัว เครือข่ายประสาทเทียมเชิงลึกทั่วไปจะกระจาย "ความรู้" ไปทั่วหลายพันชั้นและหัวรับความสนใจหลายล้านหัว โดยเซลล์ประสาทแต่ละเซลล์เข้ารหัสรูปแบบที่ไม่เกี่ยวข้องกันหลายรูปแบบพร้อมกัน นักวิจัยเรียกคุณสมบัติสุดท้ายนี้ว่าความหมายหลายนัย และเป็นหนึ่งในเหตุผลที่การตีความเชิงกลไกยังอยู่ในช่วงเริ่มต้น

ทำไมคนนอกห้องวิจัยถึงควรสนใจ? เพราะปัญญาประดิษฐ์แบบกล่องดำ (AI) กำลังขับเคลื่อนการตัดสินใจที่มีผลกระทบสำคัญ มันอนุมัติและปฏิเสธสินเชื่อ มันให้คะแนนจำเลย มันระบุธุรกรรมว่าเป็นฉ้อโกง และมันควบคุมปริมาณการซื้อขายจำนวนมากในตลาดแลกเปลี่ยนคริปโตเคอร์เรนซีหลักทุกแห่ง เมื่อมันทำผิดพลาด ความไม่โปร่งใสทำให้แทบเป็นไปไม่ได้เลยที่จะหาต้นตอ แก้ไข หรือเอาผิดใครได้

เรื่องนี้สำคัญเพราะการกำกับดูแล AI ไม่ได้มองว่าความไม่โปร่งใสเป็นปัญหาของนักพัฒนาอีกต่อไปแล้ว สหภาพยุโรปมองว่าเป็นประเด็นเรื่องการเข้าถึงตลาด ขณะที่หน่วยงานกำกับดูแลของสหรัฐฯ มองว่าเป็นประเด็นเรื่องการให้สินเชื่อที่เป็นธรรม ผู้บริหารทุกคนที่อนุมัติโครงการ AI ตั้งแต่ปี 2024 ต่างก็เจอปัญหาเดียวกันคือ: สิ่งนี้กำลังทำอะไรอยู่ และทำไม? การทำความเข้าใจ AI แบบกล่องดำจึงไม่ใช่เรื่องที่เลือกได้อีกต่อไป และคุณไม่สามารถแก้ปัญหาแบบกล่องดำได้ด้วยการใช้ผู้ให้บริการรายอื่นเพียงอย่างเดียว

เหตุใดโมเดล AI จึงกลายเป็นกล่องดำ

ไม่ใช่ว่า AI ทุกตัวจะเป็นกล่องดำ แผนผังการตัดสินใจแบบง่ายๆ นั้นโปร่งใสอย่างสมบูรณ์ แบบจำลองการถดถอยเชิงเส้นจะให้ค่าสัมประสิทธิ์ที่คุณสามารถอ่านได้ แม้แต่ระบบ AI ที่ใช้กฎเกณฑ์จากยุค 1990 ก็สามารถตรวจสอบได้ทีละบรรทัดในทางทฤษฎี

แล้วทำไมโมเดล AI ในปัจจุบันจึงกลายเป็นกล่องดำ? สาเหตุหลักๆ มีอยู่สี่ประการที่เกี่ยวข้องกัน

ประการแรกคือเรื่องขนาด โมเดลการเรียนรู้เชิงลึกที่มีพารามิเตอร์หลายล้านหรือหลายพันล้านตัวทำงานในพื้นที่มิติสูงที่มนุษย์ไม่สามารถมองเห็นได้ คุณสามารถอธิบายโมเดลที่มีพารามิเตอร์ 200 พันล้านตัวด้วยคณิตศาสตร์ได้ แต่ไม่มีใครสามารถจดจำมันไว้ในหัวได้

ประการที่สอง การแสดงผลแบบกระจาย ในโครงข่ายประสาทเทียมเชิงลึก ไม่มีเซลล์ประสาทใดเซลล์เดียวที่เก็บ "แนวคิดเรื่องแมว" หรือ "กฎสำหรับการปฏิเสธสินเชื่อ" แนวคิดต่างๆ กระจายไปทั่วเซลล์ประสาทหลายพันเซลล์ และเซลล์ประสาทแต่ละเซลล์มีส่วนร่วมในหลายแนวคิดพร้อมกัน การดึงคำอธิบายที่ชัดเจนออกมานั้นเป็นโครงการวิจัย ไม่ใช่การสอบถามข้อมูล

ประการที่สาม การพึ่งพาข้อมูลการฝึกฝน พฤติกรรมของแบบจำลองถูกกำหนดโดยข้อมูลการฝึกฝน ซึ่งโดยปกติแล้วเป็นข้อมูลที่เป็นกรรมสิทธิ์ มีขนาดใหญ่มาก และบางครั้งก็มีปัญหาทางกฎหมาย แม้ว่าผู้พัฒนาจะเผยแพร่ค่าถ่วงน้ำหนักของแบบจำลองแล้ว แต่ข้อมูลก็แทบจะไม่ถูกแบ่งปัน ดังนั้นส่วนสำคัญของ "เหตุผล" จึงขาดหายไป

ประการที่สี่ คือ เจตนา มีเหตุผลเชิงปฏิบัติในการใช้แนวทางแบบกล่องดำโดยเจตนา นักพัฒนาและโปรแกรมเมอร์ AI บางคนจงใจปกปิดกลไกภายในของโมเดลเพื่อปกป้องทรัพย์สินทางปัญญา และเหตุผลอื่นๆ ในการใช้การออกแบบแบบกล่องดำ ได้แก่ ข้อกำหนดด้านลิขสิทธิ์และข้อได้เปรียบในการแข่งขัน แม้แต่โมเดลแบบเปิดเผยน้ำหนักก็สามารถทำให้การตัดสินใจของมันกลายเป็นกล่องดำได้อย่างมีประสิทธิภาพ เพราะโมเดลสมัยใหม่ส่วนใหญ่อาศัยรูปแบบที่เกิดขึ้นเองโดยธรรมชาติซึ่งไม่มีเอกสารใดบันทึกไว้ บริษัทที่ลงทุน 100 ล้านดอลลาร์ในโมเดลหนึ่งๆ ก็ไม่กระตือรือร้นที่จะเผยแพร่สถาปัตยกรรมและขั้นตอนการฝึกอบรม โมเดล AI แบบโอเพนซอร์สที่แบ่งปันโค้ดพื้นฐานก็เป็นกล่องดำในท้ายที่สุดเช่นกัน เพราะผู้ใช้ยังไม่สามารถตรวจสอบน้ำหนักที่เรียนรู้มาได้อย่างมีความหมาย

ผลที่ตามมาคือ แม้แต่โมเดล AI ขั้นสูงที่ดูเหมือนเรียบง่าย รวมถึง LLM และโมเดล AI แบบสร้างข้อมูล ก็กลายเป็นกล่องดำโดยปริยาย โมเดลโปร่งใสเป็นข้อยกเว้น ไม่ใช่กฎ โมเดลกล่องดำที่ซับซ้อนสามารถให้ความแม่นยำที่น่าประทับใจ ซึ่งเป็นเหตุผลว่าทำไมทีมต่างๆ จึงยังคงใช้งานพวกมันต่อไปแม้ว่าจะมีความไม่โปร่งใสก็ตาม เช่นเดียวกับโมเดล AI กล่องดำที่ฝึกฝนด้วยข้อมูลที่หลากหลายและยุ่งเหยิง: ความก้าวหน้าเหนือโมเดล AI ที่ใช้กฎมักจะมากพอที่จะเอาชนะข้อกังวลเรื่องความสามารถในการอธิบายได้ จนกว่าจะมีอะไรผิดพลาด AI กล่องดำสมัยใหม่ส่วนใหญ่เป็นกล่องดำในท้ายที่สุด เพราะผู้ใช้ยังไม่สามารถตรวจสอบน้ำหนักที่เรียนรู้ได้ โมเดลแบบเปิดเผยน้ำหนักจะแบ่งปันโค้ดพื้นฐาน และผู้ใช้สามารถอ่านสถาปัตยกรรมได้ แต่โค้ดพื้นฐานก็ยังคงเป็นกล่องดำในท้ายที่สุดเมื่อคุณถามว่า "ทำไมโมเดลถึงพูดแบบนั้น"

ปัญหา "กล่องดำ" ในการเรียนรู้เชิงลึก

ปัญหาแบบกล่องดำเกิดขึ้นเมื่อเหตุผลทั้งสี่ประการนั้นรวมกัน โมเดลนี้ใช้งานได้ผล และบ่อยครั้งก็ประสบความสำเร็จอย่างน่าประทับใจ แต่การทำงานในลักษณะที่ต่อต้านสามสิ่งพร้อมกัน ได้แก่ การอธิบาย การตรวจสอบความถูกต้อง และการแก้ไข

ลองพิจารณาตัวอย่างคลาสสิก: โมเดลการเรียนรู้เชิงลึกที่ฝึกฝนให้ระบุแพนด้า มันทำคะแนนได้ 99% ในชุดทดสอบ ดูดีมาก แต่แล้วก็มีคนใช้เครื่องมือวิเคราะห์ผลลัพธ์และพบว่าโมเดลไม่ได้มองไปที่แพนด้าจริงๆ มันกำลังให้ความสนใจกับต้นไผ่ต่างหาก ภาพถ่ายแพนด้าส่วนใหญ่ในข้อมูลการฝึกฝนก็มีต้นไผ่อยู่ด้วย โมเดลจึงเรียนรู้ทางลัด ในภาพถ่ายแพนด้าที่ไม่มีต้นไผ่ โมเดลจึงล้มเหลว

การเรียนรู้แบบ "ลัดขั้นตอน" ประเภทนี้พบได้ทั่วไปในการเรียนรู้เชิงลึก โมเดลจะค้นพบความสม่ำเสมอทางสถิติที่ไม่ตรงกับแนวคิดพื้นฐาน แต่คุณจะสังเกตเห็นก็ต่อเมื่อโลกดูแตกต่างจากชุดข้อมูลฝึกฝนเล็กน้อย วิกฤตการณ์ทางการเงินปี 2008 เป็นตัวอย่างทางประวัติศาสตร์ที่ชัดเจน โมเดล Value-at-Risk ที่สร้างขึ้นบนสมมติฐานแบบเกาส์เซียนทำงานได้ดีเยี่ยมในตลาดปกติ แต่กลับล้มเหลวในสภาวะตลาดผันผวน เนื่องจากโมเดลได้เรียนรู้ทางลัดที่ผู้สร้างโมเดลไม่รู้ตัวว่าเป็นทางลัด

โมเดลการเรียนรู้เชิงลึกในปัจจุบันมีรูปแบบความล้มเหลวแบบเดียวกัน เพียงแต่มีพารามิเตอร์มากขึ้นและมีความมั่นใจมากขึ้น นักวิจัยด้านการตีความเชิงกลไก รวมถึงทีมงานจาก Anthropic และ OpenAI ได้เริ่มทำการวิเคราะห์ย้อนกลับส่วนเล็กๆ ของโมเดลภาษาทีละเซลล์ประสาท งานของพวกเขาแสดงให้เห็นว่าภายในของ LLM นั้นใกล้เคียงกับวงจรที่พันกันมากกว่าตรรกะที่เป็นระเบียบ ไม่มีจุดใดที่คุณสามารถชี้นิ้วและบอกได้ว่า "นี่คือที่ที่คำตอบอยู่" ปัญหาของกล่องดำไม่ใช่ข้อผิดพลาดที่จะต้องแก้ไข แต่เป็นปัญหาเชิงโครงสร้าง

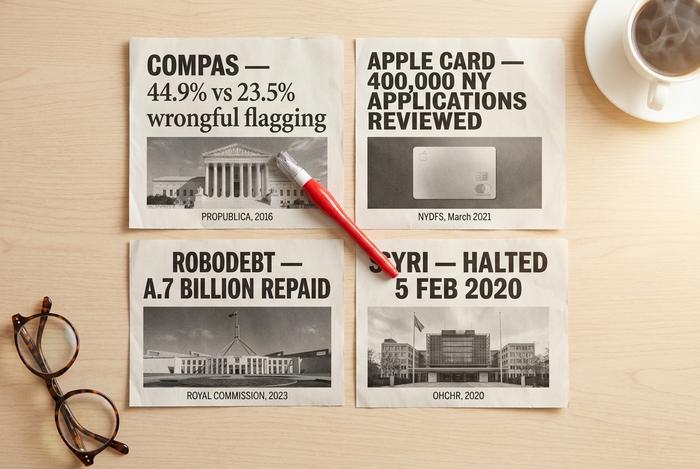

ตัวอย่าง AI แบบกล่องดำ: COMPAS, Apple Card, Robodebt, SyRI

อยากเห็นไหมว่า AI แบบกล่องดำจะมีหน้าตาเป็นอย่างไรเมื่อมันล้มเหลว? สี่กรณีที่ทุกคนยกมาพูดถึงนั้นบอกเล่าสิ่งที่คุณจำเป็นต้องรู้ได้เกือบทั้งหมด กรณีเหล่านั้นครอบคลุมทั้งกระบวนการยุติธรรมทางอาญา การธนาคาร และสวัสดิการ ทั้งหมดนี้ล้วนส่งผลกระทบต่อผู้คนจริงๆ และไม่มีสองกรณีใดที่ล้มเหลวในลักษณะเดียวกันเลย

เริ่มจาก COMPAS บริษัท Northpointe สร้างมันขึ้นมาเพื่อทำนายว่าจำเลยจะกระทำผิดซ้ำหรือไม่ และศาลในสหรัฐฯ ก็ได้นำไปใช้กันอย่างแพร่หลาย จากนั้น ProPublica ก็ตรวจสอบอย่างละเอียด การตรวจสอบในปี 2016 ของพวกเขาได้นำข้อมูลของผู้ถูกจับกุมในเขต Broward County กว่า 7,000 คน มาวิเคราะห์ และผลลัพธ์ที่ได้นั้นแย่มาก: จำเลยผิวดำถูกระบุว่าเป็นผู้มีความเสี่ยงสูงอย่างผิดพลาดใน 44.9% ของกรณี ในขณะที่ตัวเลขสำหรับจำเลยผิวขาวอยู่ที่เพียง 23.5% เท่านั้น รายงานติดตามผลในปี 2024 ยิ่งแย่ลงไปอีก คุณลักษณะสองอย่าง (อายุและประวัติการกระทำผิด) มีความแม่นยำเท่ากับ 137 คุณลักษณะของ COMPAS ดังนั้นความซับซ้อนจึงไม่ได้ให้สัญญาณเพิ่มเติมใดๆ เลย แต่กลับทำให้การตรวจจับอคติทำได้ยากขึ้นมาก นั่นคือแบบจำลองกล่องดำแบบดั้งเดิมที่ประเมินผู้คนแทนที่จะเป็นผลิตภัณฑ์ แบบจำลองกล่องที่ใช้ประเมินผู้สมัครงาน ซึ่ง Amazon ยกเลิกไปในปี 2018 ก็มีรูปร่างเดียวกัน

จากนั้นก็เป็นเรื่องของ Apple Card ในช่วงปลายปี 2019 วอซเนียกกล่าวว่าภรรยาของเขาได้รับวงเงินเครดิตต่ำกว่าเขาถึง 10 เท่า เดวิด ไฮเนไมเออร์ แฮนส์สันก็กล่าวเช่นเดียวกัน เรื่องนี้กลายเป็นไวรัล หน่วยงานบริการทางการเงินของนิวยอร์กจึงให้ความสำคัญกับเรื่องนี้อย่างจริงจัง พวกเขาดึงใบสมัครประมาณ 400,000 ใบมาตรวจสอบ ในเดือนมีนาคม 2021 พวกเขาสรุปว่าไม่มีการเลือกปฏิบัติทางเพศตามกฎหมาย แต่พวกเขาก็เขียนไว้ด้วยว่า (และนี่คือส่วนที่สำคัญ) ความไม่โปร่งใสของประสบการณ์ลูกค้าเป็นปัญหาด้านความไว้วางใจในตัวมันเอง ความเสียหายจากกล่องดำนั้น ครึ่งหนึ่งเกี่ยวกับผลลัพธ์ และอีกครึ่งหนึ่งเกี่ยวกับความรับรู้ การออกแถลงข่าวไม่สามารถแก้ไขด้านความรับรู้ได้

Robodebt คืออีกด้านหนึ่งของเหรียญ ไม่มีโครงข่ายประสาทเทียมที่ซับซ้อนเข้ามาเกี่ยวข้อง ออสเตรเลียใช้กฎการคำนวณรายได้เฉลี่ยกับบันทึกสวัสดิการระหว่างปี 2016 ถึง 2019 กล่าวหาผู้รับสวัสดิการประมาณ 400,000 รายว่าฉ้อโกง และไม่สามารถอธิบายการคำนวณได้อย่างชัดเจนแก่ผู้ที่ได้รับจดหมาย ต่อมาคณะกรรมการสอบสวนระดับสูงได้ประกาศว่าโครงการนี้ผิดกฎหมาย รัฐบาลจ่ายเงินคืน 1.7 พันล้านดอลลาร์ออสเตรเลีย และจ่ายค่าชดเชยอีก 112 ล้านดอลลาร์ออสเตรเลีย บทเรียน: ระบบไม่จำเป็นต้องซับซ้อนทางเทคนิคถึงจะเป็นกล่องดำ เพียงแค่ต้องตรวจสอบไม่ได้ก็พอ

กรณีอื้อฉาวเรื่องสวัสดิการเด็กของเนเธอร์แลนด์และ SyRI ถือเป็นตัวอย่างที่ชัดเจนในเวทีโลก เมื่อวันที่ 5 กุมภาพันธ์ 2020 ศาลเนเธอร์แลนด์มีคำสั่งให้ยุติการใช้งาน SyRI ทันที โดยวินิจฉัยว่าความไม่โปร่งใสของ SyRI ละเมิดมาตรา 8 ของอนุสัญญาสิทธิมนุษยชนแห่งยุโรป เรื่องอื้อฉาวเกี่ยวกับสวัสดิการเด็กที่เกี่ยวข้องนี้ส่งผลกระทบต่อผู้ปกครองกว่า 20,000 คนที่ถูกกล่าวหาว่าฉ้อโกงอย่างไม่ถูกต้อง รัฐบาลของนายรูทเทอลาออกจากตำแหน่งในเดือนมกราคม 2021 คำตัดสินดังกล่าวกลายเป็นมาตรฐานอ้างอิงในแวดวงนโยบายของสหภาพยุโรปในปัจจุบัน ว่าทำไม AI ที่ไม่โปร่งใสในสถานการณ์ที่มีความเสี่ยงสูงจึงไม่ใช่ประเด็นทางจริยธรรมที่อ่อนแอ แต่เป็นประเด็นทางกฎหมาย

สี่กรณีศึกษา จากภาคส่วนต่างๆ เทคโนโลยีต่างๆ และประเทศต่างๆ แต่มีรูปแบบเดียวกัน คือ ระบบที่ไม่โปร่งใส การตัดสินใจที่มีผลกระทบ และผู้ที่ได้รับผลกระทบโดยไม่มีทางที่จะโต้แย้งได้

ความเสี่ยงของ AI แบบกล่องดำในระบบ AI ในโลกแห่งความเป็นจริง

เมื่อคุณเริ่มจัดทำรายการความเสี่ยงของ AI แบบกล่องดำในระบบ AI ในโลกแห่งความเป็นจริง คุณจะเห็นรูปแบบบางอย่าง ความเสี่ยงทั้งห้าประการนี้ปรากฏขึ้นซ้ำแล้วซ้ำเล่า ไม่ว่าโมเดลนั้นจะเป็นระบบประเมินเครดิต แชทบอท หรือระบบซื้อขายแบบอัลกอริทึมก็ตาม

| เสี่ยง | มันมีลักษณะอย่างไร | เหตุผลที่มันปรับขนาดได้ |

|---|---|---|

| อคติที่ซ่อนเร้น | แบบจำลองนี้ปฏิบัติต่อกลุ่มที่ได้รับการคุ้มครองแตกต่างกัน | ข้อมูลการฝึกอบรมมีรูปแบบทางประวัติศาสตร์อยู่ด้วย |

| ภาพหลอน | แบบจำลองสร้างข้อเท็จจริงหรือแหล่งอ้างอิงขึ้นมาเอง | หลักสูตร LLM มุ่งเน้นที่ความคล่องแคล่ว ไม่ใช่ความถูกต้องแม่นยำ |

| การเรียนรู้แบบลัด | แบบจำลองนี้อาศัยความสัมพันธ์ที่ไม่เกี่ยวข้อง | เรียนรู้ได้ง่ายกว่าแนวคิดที่แท้จริง |

| ความเปราะบางที่เป็นปฏิปักษ์ | การเปลี่ยนแปลงอินพุตเล็กน้อยสามารถพลิกเอาต์พุตได้ | ขอบเขตการตัดสินใจที่มีมิติสูง |

| การตรวจสอบวิเคราะห์ | ไม่สามารถระบุสาเหตุได้ | ไม่มีสถานะภายในที่สามารถตีความได้ |

ความเสี่ยงเหล่านี้ทวีความรุนแรงขึ้นในระบบ AI แบบกล่องดำที่ใช้ในด้านการเงิน การสรรหาบุคลากร การดูแลสุขภาพ และคริปโตเคอร์เรนซี กระบวนการเรียนรู้เชิงลึกที่ซับซ้อนภายในระบบเหล่านี้ทำให้ยากต่อการคาดการณ์ว่าความล้มเหลวครั้งต่อไปจะเกิดขึ้นที่ใด และเครื่องมือ AI แบบดั้งเดิมสำหรับ QA ไม่ได้ถูกสร้างขึ้นมาเพื่อรองรับโมเดลที่มีพารามิเตอร์หลายแสนล้านตัว

อคติที่ซ่อนเร้นมักเป็นข่าวพาดหัว แต่ความเปราะบางจากการโจมตีและความล้มเหลวในการตรวจสอบเป็นปัญหาใหญ่กว่าในระยะยาว อคติที่คงที่อย่างน้อยก็สามารถวัดและแก้ไขได้ แต่แบบจำลองที่ล้มเหลวแตกต่างกันทุกครั้งที่ใช้งาน (ซึ่ง ChatGPT เป็นเช่นนั้น โดยประมาณ 42% ของงานประเมินสัญญาอัจฉริยะ ตามการศึกษาของ ACM TOSEM ปี 2024) นั้นยากต่อการรับรองสำหรับการใช้งานภายใต้กฎระเบียบมากกว่า

สิ่งที่นักวิจัยเรียกว่า "ความเสี่ยงของ AI ตัวแทน" คือสิ่งที่เพิ่งเข้ามาอยู่ในรายการนี้ เมื่อคุณเชื่อมต่อ LLM เข้ากับเครื่องมือต่างๆ ให้มันมีหน่วยความจำ และปล่อยให้มันเรียกใช้ API คุณจะยิ่งเพิ่มความไม่โปร่งใสเข้าไปอีก การตัดสินใจเพียงครั้งเดียวกลายเป็นห่วงโซ่ของการเรียกใช้โมเดล การดึงเอกสาร และการเรียกใช้เครื่องมือ ซึ่งแต่ละขั้นตอนนั้นไม่โปร่งใสบางส่วน ตัวแทนสมัยใหม่จึงเป็นกล่องดำซ้อนกล่องดำ

ปัญญาประดิษฐ์แบบกล่องดำในโลกคริปโตเคอร์เรนซีและฟินเทค

ในบรรดาอุตสาหกรรมทั้งหมดที่ใช้ AI แบบกล่องดำ อุตสาหกรรมคริปโตเคอร์เรนซีและฟินเทคเป็นอุตสาหกรรมที่ด้านการใช้งานและด้านความเสี่ยงปะทะกันอย่างรุนแรงที่สุด เดิมพันสูง ระยะเวลาตอบสนองสั้น การเปิดเผยข้อมูลน้อย และกฎระเบียบ โดยเฉพาะในด้านคริปโตเคอร์เรนซี ยังคงกระจัดกระจาย ผลที่ตามมาคือสภาพแวดล้อมที่ให้รางวัลแก่ผู้ที่ใช้งานก่อนแล้วค่อยเขียนเอกสารทีหลัง

การซื้อขายด้วยอัลกอริทึม การซื้อขายด้วยอัลกอริทึมขับเคลื่อนปริมาณการซื้อขายคริปโตเคอร์เรนซีประมาณ 70-80% ในปี 2025 ซึ่งสูงกว่าส่วนแบ่ง 60-70% ในตลาดหุ้นหลัก Wintermute เพียงแห่งเดียวมีการซื้อขายมากกว่า 15 พันล้านดอลลาร์ในกว่า 60 แพลตฟอร์มต่อวันโดยเฉลี่ย โดยมีปริมาณการซื้อขายสูงสุดในวันเดียวที่ 2.24 พันล้านดอลลาร์ในปี 2025 กลยุทธ์ที่อยู่เบื้องหลังการไหลเวียนเหล่านั้นคือกลุ่มโมเดลการเรียนรู้เชิงลึกที่ไม่มีผู้สังเกตการณ์ภายนอกสามารถตรวจสอบได้ การล่มสลายของ Alameda/FTX ในเดือนพฤศจิกายน 2022 เป็นตัวอย่างที่ชัดเจนที่สุดของความเสี่ยง: มูลค่าตลาดรวมของคริปโตเคอร์เรนซีลดลงจากกว่า 1 ล้านล้านดอลลาร์เหลือต่ำกว่า 800 พันล้านดอลลาร์ในเวลาประมาณหนึ่งเดือน และความเสี่ยงจาก FTT มูลค่า 14.6 พันล้านดอลลาร์ในงบดุลของ Alameda นั้นมองไม่เห็นจนกระทั่งถึงช่วงเวลาที่มันปรากฏออกมา

การให้คะแนน AML และ KYC ตลาดซอฟต์แวร์ป้องกันการฟอกเงินทั่วโลกมีมูลค่าถึง 4.13 พันล้านดอลลาร์ในปี 2025 และคาดการณ์ว่าจะสูงถึง 9.38 พันล้านดอลลาร์ในปี 2030 (MarketsandMarkets) การปฏิบัติตามกฎระเบียบ AML/KYC ในด้านคริปโตเคอร์เรนซีเติบโตในอัตรา CAGR 13.8% ผู้ให้บริการอย่าง ComplyAdvantage, Chainalysis Reactor และ Elliptic Navigator ใช้โมเดลแมชชีนเลิร์นนิงแบบกล่องดำในการให้คะแนนความเสี่ยงของกระเป๋าเงินดิจิทัล การใช้แมชชีนเลิร์นนิงแบบกล่องดำนี้แพร่หลายและมีประสิทธิภาพมากพอที่จะนำไปใช้ในตลาดแลกเปลี่ยนหลักส่วนใหญ่ และมีความไม่โปร่งใสมากพอที่เจ้าหน้าที่ฝ่ายปฏิบัติตามกฎระเบียบมักไม่สามารถระบุได้ว่าทำไมกระเป๋าเงินดิจิทัลเฉพาะนั้นจึงถูกบล็อก

การตรวจสอบสัญญาอัจฉริยะ นี่คือจุดที่ข้อจำกัดของ AI ปรากฏให้เห็นอย่างชัดเจน งานวิจัยจาก arXiv ในปี 2024 ได้ประเมิน GPT-4 ในการตรวจจับช่องโหว่ของสัญญาอัจฉริยะ พบว่ามีความแม่นยำ 96.6% แต่มีอัตราการเรียกคืนเพียง 37.8% ซึ่งพลาดการตรวจจับข้อบกพร่องที่แท้จริงไปเกือบสองในสาม ผลลัพธ์ของ ChatGPT ไม่เสถียรระหว่างการทำงานใน 42% ของสัญญา (ACM TOSEM 2024) เครื่องมือแบบไฮบริด เช่น GPTScan ซึ่งใช้ GPT ร่วมกับการวิเคราะห์แบบคงที่ มีความแม่นยำเกิน 90% และมีอัตราการเรียกคืนประมาณ 70% ในสัญญาโทเค็น (arXiv 2308.03314) ปัจจุบัน CertiK Skynet ตรวจสอบโครงการมากกว่า 17,000 โครงการ และมีมูลค่าตลาดประมาณ 494 พันล้านดอลลาร์ แต่ทีมตรวจสอบที่รับผิดชอบทุกทีมยังคงใช้ AI ร่วมกับผู้ตรวจสอบที่เป็นมนุษย์อยู่

ที่ปรึกษาการลงทุนอัตโนมัติ (Robo-advisors) Betterment บริหารจัดการสินทรัพย์กว่า 56 พันล้านดอลลาร์สหรัฐฯ ในบัญชีมากกว่า 900,000 บัญชี Wealthfront มีสินทรัพย์ภายใต้การบริหารจัดการ (AUM) อยู่ที่ 42.9 พันล้านดอลลาร์สหรัฐฯ อุตสาหกรรมที่ปรึกษาการลงทุนอัตโนมัติทั่วโลกมีสินทรัพย์ภายใต้การบริหารจัดการ (AUM) เกิน 1 ล้านล้านดอลลาร์สหรัฐฯ การปรับสมดุลพอร์ตการลงทุน การลดหย่อนภาษีจากการขาดทุน และการประเมินความเสี่ยง ล้วนขับเคลื่อนด้วยแบบจำลองแมชชีนเลิร์นนิง (ML) ซึ่งการตัดสินใจเฉพาะเจาะจงของแบบจำลองเหล่านี้ไม่ได้ถูกเปิดเผยในเอกสารใดๆ ที่เผยแพร่ต่อลูกค้ารายย่อย

การให้คะแนนเครดิตและการตรวจจับการฉ้อโกง FICO ถูกใช้โดยผู้ให้กู้ในสหรัฐฯ ถึง 90% และ FICO Falcon ประมวลผลธุรกรรมมากกว่า 65 พันล้านรายการต่อปี โดยมีอัตราการตรวจจับการฉ้อโกงสูงกว่า 95% จากการศึกษาของธนาคารแห่งอังกฤษในปี 2024 ในสถาบันการเงิน 50 แห่งในสหราชอาณาจักร พบว่าแบบจำลองความเสี่ยงด้านเครดิตด้วย Machine Learning ช่วยลดการจำแนกประเภทผิดพลาดลงได้ประมาณ 25% เมื่อเทียบกับการถดถอยเชิงลอจิสติก ความแม่นยำที่เพิ่มขึ้นนั้นเป็นเรื่องจริง แต่ข้อเสียคือ ภายใต้หนังสือเวียน CFPB ฉบับที่ 2022-03 และ 2023-03 ผู้ให้กู้ในสหรัฐฯ ไม่สามารถใช้แบบจำลองที่ไม่โปร่งใสเพียงพอที่จะป้องกันคำอธิบายการดำเนินการที่ไม่พึงประสงค์เฉพาะเจาะจงภายใต้ ECOA ได้

รูปแบบในทั้งห้ากรณีนั้นเหมือนกันหมด โมเดลมีความแม่นยำกว่าแบบพื้นฐานที่โปร่งใส ความทึบแสงนั้นแยกออกจากความแม่นยำไม่ได้ในเชิงโครงสร้าง และหน่วยงานกำกับดูแลกำลังตามทันเร็วกว่าเครื่องมืออธิบายการทำงานเสียอีก

หมายเหตุเกี่ยวกับ Blackbox AI: หลักสูตร LLM ด้านการเขียนโค้ด

ขอชี้แจงความหมายโดยย่อ เมื่อผู้คนค้นหา "blackbox AI" พวกเขามักหมายถึงปัญหาเชิงแนวคิดที่บทความนี้กล่าวถึง บางครั้งพวกเขาก็หมายถึง Blackbox AI ซึ่งเป็นบริษัทที่ blackbox.ai Blackbox.ai คือ LLM (Learning Lifecycle Management) สำหรับการเขียนโค้ดที่ออกแบบมาเพื่อเปลี่ยนแปลงวิธีการเขียนโค้ดของนักพัฒนา ผลิตภัณฑ์นี้ทำงานร่วมกับ VS Code ในฐานะตัวแทนการเขียนโค้ด แนะนำโค้ด และแข่งขันกับเครื่องมือต่างๆ เช่น Claude Code, GitHub Copilot และ Cursor เป็นหนึ่งในเทคโนโลยี AI ขั้นสูงที่เป็นที่รู้จักกันดีในด้านการเขียนโค้ดด้วย AI สร้างขึ้นจากโมเดล AI หลายแบบ และโค้ดที่ Blackbox แนะนำครอบคลุมทุกอย่างตั้งแต่การปรับโครงสร้างโค้ดไปจนถึงการสร้างโครงร่างการทดสอบ Blackbox ผสานรวมการสร้างโค้ด การแชท และการค้นหาเข้าไว้ในเวิร์กโฟลว์เดียว และผู้ใช้ส่วนใหญ่จะเรียกมันว่าเป็นผู้ช่วย AI ที่ดีที่สุดที่พวกเขาเคยลองใช้ในโปรแกรมแก้ไขโค้ดของพวกเขา

ความหมายทั้งสองมักสับสนกันในผลการค้นหา ผลิตภัณฑ์ Blackbox AI ไม่ใช่หัวข้อของบทความนี้ เรากำลังพิจารณาคุณสมบัติเชิงโครงสร้างของระบบ AI ที่ไม่โปร่งใส ไม่ใช่ผู้ช่วยเขียนโค้ดตัวใดตัวหนึ่ง หากคุณค้นหาผลิตภัณฑ์ บริษัทนั้นมีเอกสารและราคาของตนเอง หากคุณค้นหาแนวคิด โปรดอ่านต่อ

ปัญญาประดิษฐ์ที่อธิบายได้และเครื่องมือการอธิบาย

ปัญญาประดิษฐ์ที่อธิบายได้ (Explainable AI) หรือที่เรียกย่อว่า XAI คือสาขาที่พยายามเปิดเผยรายละเอียดของโมเดล AI ที่ไม่โปร่งใสโดยไม่ลดทอนความแม่นยำ และนี่ก็เป็นตลาดที่กำลังเติบโตอย่างแท้จริง มีการคาดการณ์สำหรับปี 2026 ว่าจะมีมูลค่าระหว่าง 9 พันล้านถึง 13 พันล้านดอลลาร์ทั่วโลก โดยช่องว่างจะขึ้นอยู่กับว่าคุณยอมรับนิยามของ XAI จากฝ่ายใด เป้าหมายคือการทำให้โมเดล AI สามารถอธิบายได้มากขึ้นโดยไม่ต้องบังคับให้ทีมกลับไปใช้โมเดลที่ช้ากว่าหรือมีความแม่นยำน้อยกว่า ทีมที่ชาญฉลาดจะทดสอบเครื่องมือเหล่านี้กับเครื่องมือ AI อื่นๆ ก่อนที่จะเผยแพร่ และจะแนบผลลัพธ์พร้อมเอกสารประกอบที่ผู้ตรวจสอบสามารถอ่านได้จริง

มีเทคนิค XAI สามตระกูลที่น่าสนใจให้เรียนรู้

อย่างแรกคือ SHAP ซึ่งย่อมาจาก SHapley Additive exPlanations มันมาจากทฤษฎีเกมแบบร่วมมือ (Cooperative Game Theory) โดยสำหรับแต่ละการทำนาย SHAP จะกำหนดคะแนนการมีส่วนร่วมให้กับคุณลักษณะอินพุตแต่ละตัว ทีมจัดอันดับเครดิตชื่นชอบมัน ทีมตรวจจับการฉ้อโกงก็ชื่นชอบมัน และผู้สร้างแบบจำลองความเสี่ยงด้านการดูแลสุขภาพก็ยอมรับมันได้ SHAP มีความถูกต้องตามทฤษฎี แต่ในทางปฏิบัติแล้วมันใช้ทรัพยากรมากกับข้อมูลตารางขนาดใหญ่

วิธีที่สองคือ LIME (Local Interpretable Model-agnostic Explanations) ซึ่งย่อมาจาก Local Interpretable Model-agnostic Explanations LIME สร้างแบบจำลองตัวแทนที่เรียบง่ายและตีความได้ง่ายโดยอิงจากคำทำนายเพียงคำเดียว และใช้แบบจำลองนั้นในการอธิบายข้อมูลต้นฉบับ เร็วกว่า SHAP ใช้งานได้กับข้อความ รูปภาพ และตาราง ข้อเสียคือ LIME ถูกออกแบบมาให้เป็นแบบเฉพาะที่ ดังนั้นจึงอาจทำให้คุณเข้าใจผิดได้หากคุณคิดว่าคำอธิบายหนึ่งสามารถนำไปใช้ได้กับทุกกรณี

ประการที่สามคือคำอธิบายเชิงสมมติฐาน แทนที่จะบอกคุณว่าทำไมแบบจำลองถึงตอบว่าใช่ คำอธิบายเชิงสมมติฐานจะบอกคุณถึงการเปลี่ยนแปลงปัจจัยนำเข้าที่น้อยที่สุดที่จะทำให้คำตอบเปลี่ยนเป็นไม่ใช่ นั่นคือสิ่งที่ผู้ขอสินเชื่อหรือธุรกรรมที่ถูกตั้งข้อสงสัยต้องการทราบอย่างแท้จริง: "ฉันต้องเปลี่ยนแปลงอะไรบ้าง?" คำอธิบายเชิงสมมติฐานกำลังได้รับความนิยมอย่างรวดเร็วในหนังสือแจ้งการดำเนินการที่ไม่เป็นไปตามที่คาดหวัง เนื่องจากสอดคล้องกับความคาดหวังของหน่วยงานกำกับดูแลอย่างชัดเจน

นอกเหนือจากสามอย่างนั้นแล้ว คุณจะได้เห็นแผนภาพแสดงความสำคัญของฟีเจอร์ การแสดงภาพการทำงานของกลไกความสนใจสำหรับเลเยอร์ Transformer และ Grad-CAM สำหรับตัวจำแนกภาพ การตีความเชิงกลไก ซึ่งเป็นการวิศวกรรมย้อนกลับของเซลล์ประสาทและวงจรความสนใจเฉพาะนั้น อยู่ในระดับแนวหน้าของสาขานี้ Anthropic, OpenAI และห้องปฏิบัติการทางวิชาการอีกจำนวนหนึ่งได้เผยแพร่วงจรบางส่วนแล้ว แต่ผลงานเหล่านั้นยังไม่สามารถนำไปใช้ในสิ่งที่ทีมตรวจสอบการปฏิบัติตามข้อกำหนดขององค์กรสามารถนำไปใช้งานได้

จงซื่อสัตย์เกี่ยวกับจุดจบของเรื่องทั้งหมดนี้ งานวิจัยในอุตสาหกรรมที่เผยแพร่โดย Palo Alto Networks และหน่วยงานอื่นๆ ระบุว่า XAI ทำงานได้ดีสำหรับตัวจำแนกภาพและแบบจำลองตารางที่มีโครงสร้าง และใช้งานได้เพียงบางส่วนสำหรับ LLM เท่านั้น ตรรกะภายในแบบจำลองภาษาจะเปลี่ยนแปลงไปตามตำแหน่งของโทเค็นและหน้าต่างบริบท ดังนั้นคะแนนการระบุคุณลักษณะจึงอาจทำให้เข้าใจผิดได้ในแบบที่คำอธิบายเองไม่ได้เตือนคุณ เครื่องมืออธิบายที่แสดงโค้ดพื้นฐานนั้นมีประโยชน์ แต่ไม่ใช่ทางออกที่สมบูรณ์สำหรับปัญหาแบบกล่องดำ

การกำกับดูแลปัญญาประดิษฐ์แบบกล่องดำ: กฎหมาย AI ของสหภาพยุโรป, NIST, CFPB

ผู้จำหน่าย AI ส่วนใหญ่ไม่ได้คาดคิดว่าหน่วยงานกำกับดูแลจะดำเนินการเร็วขนาดนี้ แต่พวกเขาก็ทำจริง ๆ แนวคิดเดิมที่ว่า "ส่งมอบก่อน จัดทำเอกสารทีหลัง" กำลังจะหมดไป และกฎระเบียบเพียงไม่กี่ข้อก็เป็นสาเหตุสำคัญ

ยุโรปเป็นผู้นำในเรื่องนี้มาก่อนด้วยกฎหมาย AI ของสหภาพยุโรป เป็นการทยอยบังคับใช้ตั้งแต่ปี 2025 ถึง 2027 ไม่ใช่การเปลี่ยนไปใช้แบบครั้งเดียวจบ ข้อห้ามต่างๆ เริ่มมีผลบังคับใช้ในวันที่ 2 กุมภาพันธ์ 2025 กฎระเบียบ AI ทั่วไปเริ่มมีผลบังคับใช้ในวันที่ 2 สิงหาคม 2025 ข้อกำหนดสำหรับระบบที่มีความเสี่ยงสูงจะมีผลบังคับใช้ตั้งแต่วันที่ 2 สิงหาคม 2026 และการขยายขอบเขตไปยังผลิตภัณฑ์ที่อยู่ภายใต้การกำกับดูแลจะมีผลบังคับใช้หนึ่งปีหลังจากนั้น คือวันที่ 2 สิงหาคม 2027 ค่าปรับนั้นไม่ใช่เรื่องเล่นๆ สูงถึง 35 ล้านยูโร หรือ 7% ของรายได้ทั่วโลกสำหรับการละเมิดที่ร้ายแรงที่สุด และ 15 ล้านยูโร หรือ 3% สำหรับกรณีอื่นๆ (DLA Piper, 2025) และรายชื่อกรณีการใช้งานที่มีความเสี่ยงสูงนั้นอ่านแล้วเหมือนกับรายชื่อของผู้ใช้งานระบบ AI ที่มีการตรวจสอบแบบกล่องดำ เช่น การให้คะแนนเครดิต การจ้างงาน การศึกษา การบังคับใช้กฎหมาย และการระบุตัวตนด้วยไบโอเมตริก ทั้งหมดนี้จำเป็นต้องมีเอกสาร การเปิดเผยข้อมูล และการกำกับดูแลโดยมนุษย์โดยอัตโนมัติ

สถานการณ์ในอเมริกาดูซับซ้อนกว่า แต่ก็กำลังเคลื่อนไปในทิศทางเดียวกัน กรอบการบริหารความเสี่ยงด้าน AI ของ NIST ถือเป็นมาตรฐานพื้นฐานของสหรัฐฯ ที่ใกล้เคียงที่สุด กรอบนี้เผยแพร่เมื่อเดือนมกราคม 2023 และขยายเพิ่มเติมในปี 2024 และ 2025 และได้กลายเป็นเอกสารที่องค์กรขนาดใหญ่ใช้เป็นแนวทาง ไม่ว่าจะเป็นข้อกำหนดทางเทคนิคหรือไม่ก็ตาม เดือนธันวาคม 2025 มีการเผยแพร่ NIST IR 8596 ซึ่งเป็นร่างเบื้องต้นของ Cyber AI Profile พร้อมกับการประชุมเชิงปฏิบัติการติดตามผลในวันที่ 14 มกราคม 2026 หลายทีมได้เริ่มนำไปใช้แล้ว

สำนักงานคุ้มครองผู้บริโภคทางการเงิน (Consumer Financial Protection Bureau) มีท่าทีที่ตรงไปตรงมามากกว่า หนังสือเวียนฉบับที่ 2022-03 และ 2023-03 ระบุไว้อย่างชัดเจนว่า เจ้าหนี้ไม่สามารถใช้อัลกอริทึมที่ซับซ้อนได้ หากความซับซ้อนนั้นทำให้เจ้าหนี้ไม่สามารถให้เหตุผลที่เฉพาะเจาะจงสำหรับการดำเนินการที่ไม่เป็นผลดีภายใต้ ECOA และระเบียบข้อบังคับ B ได้ โปรดอ่านอย่างละเอียด นี่ไม่ใช่การห้ามใช้การเรียนรู้ของเครื่องจักรในการให้สินเชื่อ แต่เป็นการห้ามใช้การเรียนรู้ของเครื่องจักรที่โปร่งใสจนไม่สามารถบอกผู้สมัครที่ถูกปฏิเสธได้ว่าพวกเขาทำผิดอะไร กล่าวคือ เป็นการห้ามใช้แบบกล่องดำสำหรับสินเชื่อผู้บริโภค

ธนาคารต่างๆ ต้องเผชิญกับข้อกำหนดที่เก่ากว่าแต่ก็ยังเข้มงวดกว่าเดิม ระเบียบข้อบังคับของธนาคารกลางสหรัฐ (Federal Reserve SR 11-7) ซึ่งมีผลบังคับใช้มาตั้งแต่ปี 2011 บังคับให้ธนาคารต้องแสดงให้เห็นว่าพวกเขามีความเข้าใจในแบบจำลองใดๆ ก็ตามที่ส่งผลต่อการตัดสินใจที่สำคัญ ระบบการเรียนรู้เชิงลึกสมัยใหม่ยังยากที่จะผ่านเกณฑ์นี้ได้โดยปราศจากความช่วยเหลือ และประกาศของ OCC (OCC Bulletin 2011-12) ก็บังคับใช้แนวทางเดียวกันนี้

ผลลัพธ์โดยรวม: หน่วยงานที่อยู่ภายใต้การกำกับดูแลใดๆ ในสหรัฐอเมริกาหรือสหภาพยุโรปหมดข้ออ้างที่จะมองว่าความไม่โปร่งใสเป็นสิ่งที่ยอมรับได้เพื่อแลกกับความถูกต้องแม่นยำแล้ว ไม่ว่าจะออกแบบให้สามารถตีความได้ตั้งแต่ขั้นตอนการตรวจสอบการออกแบบครั้งแรก หรือสร้างระบบผสมผสานที่มนุษย์เป็นผู้ให้คำอธิบายในส่วนที่แบบจำลองไม่สามารถอธิบายได้ ไม่มีทางเลือกที่สามที่จะรอดพ้นจากการดำเนินการบังคับใช้กฎหมายได้

วิธีการตรวจสอบระบบ AI แบบกล่องดำ

แล้วการใช้งานระบบ AI แบบกล่องดำอย่างมีความรับผิดชอบในปี 2026 นั้นมีลักษณะอย่างไร? แนวทางปฏิบัติจริงนั้นสั้นกว่าที่ผู้ขายกล่าวอ้างไว้มาก

เริ่มต้นด้วยข้อมูล บันทึกแหล่งที่มาของข้อมูลฝึกฝน ใครเป็นผู้ติดป้ายกำกับ และมีกลุ่มย่อยใดบ้าง ประมาณครึ่งหนึ่งของปัญหาความลำเอียงที่คุณจะพบเจอในภายหลังนั้นถูกบันทึกไว้แล้วในข้อมูลเหล่านี้ และอีกครึ่งหนึ่งที่คุณไม่สามารถตรวจสอบได้ก็คือครึ่งที่คุณไม่สามารถแก้ไขได้

จากนั้นทำการทดสอบแบบ Red-team กับโมเดล ตรวจสอบโมเดลด้วยข้อมูลป้อนเข้าที่เป็นอันตราย การแทรกข้อความแจ้งเตือน กรณีพิเศษ และตัวอย่างที่อยู่นอกเหนือการกระจายตัว Anthropic, OpenAI และ Microsoft ได้เผยแพร่คู่มือสำหรับการทำงานนี้แล้ว ซึ่งคุณสามารถนำไปปรับใช้ได้โดยไม่ต้องคิดค้นวิธีการใหม่

ใช้ XAI กับทุกโมเดลที่ใช้งานจริง ไม่ใช่แค่โมเดลหลักๆ เท่านั้น ใช้ SHAP สำหรับไปป์ไลน์แบบตาราง ใช้ LIME สำหรับข้อความและรูปภาพ ใช้ Counterfactuals สำหรับทุกการตัดสินใจที่วนกลับไปยังผู้ใช้ ไม่มีเครื่องมือใดสมบูรณ์แบบ แต่การขาดเครื่องมือเหล่านี้ถือเป็นสัญญาณเตือนสำหรับผู้ตรวจสอบที่เข้ามาตรวจสอบระบบของคุณ

คอยสังเกตการเปลี่ยนแปลงอย่างฉับพลัน โมเดลต่างๆ มักล้าสมัยเร็วกว่าที่ทีมส่วนใหญ่คาดคิด ติดตามการกระจายตัวของข้อมูลนำเข้า การกระจายตัวของข้อมูลส่งออก และผลลัพธ์ที่ตามมา ตั้งค่าการแจ้งเตือนสำหรับแต่ละส่วน และถือว่าการเปลี่ยนแปลงที่ไม่สามารถอธิบายได้เป็นเหตุการณ์ ไม่ใช่เรื่องแปลกประหลาด

สร้างขั้นตอนการร้องเรียนก่อนที่คุณจะต้องการใช้มัน ทุกการตัดสินใจที่สำคัญควรมีกลไกการแก้ไขโดยมนุษย์ และช่องทางการอุทธรณ์ที่บันทึกไว้ซึ่งลูกค้าสามารถใช้ได้จริง หากทีมสนับสนุนของคุณเป็นช่องทางการอุทธรณ์ ก็ควรเขียนลงไปด้วย

สุดท้ายนี้ ให้ปรับกรอบการทำงานของคุณให้เข้ากับกรอบที่เกี่ยวข้อง เช่น NIST AI RMF หากคุณอยู่ในสหรัฐอเมริกา ข้อกำหนดความเสี่ยงสูงของ EU AI Act หากคุณอยู่ในยุโรป และ CFPB Circulars 2022-03 และ 2023-03 หากคุณเกี่ยวข้องกับสินเชื่อผู้บริโภค การทำเช่นนี้ตั้งแต่เนิ่นๆ จะประหยัดกว่าการปรับปรุงแก้ไขหลังจากที่ได้รับคำสั่งบังคับใช้กฎหมายอย่างมาก

คุณจะไม่สามารถกำจัดกล่องดำได้ นั่นไม่ใช่ปัญหา หน้าที่ของคุณคือทำให้มันสามารถตรวจสอบได้ มีความรับผิดชอบ และมีขอบเขตจำกัด นั่นคือมาตรฐานที่หน่วยงานกำกับดูแลกำลังบังคับใช้อยู่แล้ว และนั่นคือสิ่งที่การใช้งานอย่างมีประสิทธิภาพควรจะเป็นในปี 2026