Trí tuệ nhân tạo hộp đen là gì? Giải thích về vấn đề hộp đen.

Vào tháng 4 năm 2026, bảng xếp hạng khả năng nhận biết ảo giác của Vectara đã đưa ra một kết luận khó xử. Các mô hình ngôn ngữ hàng đầu hiện chỉ nhận biết ảo giác dưới 4% thời gian trong bài kiểm tra cốt lõi. Nhưng các biến thể "suy luận" mới của GPT-5, Claude Sonnet 4.5, Grok-4 và Gemini-3-Pro đều nhận biết ảo giác trên 10% trên tập dữ liệu mới. Grok-4-fast-reasoning đạt mức 20,2%. Các mô hình thông minh nhất, những mô hình "suy nghĩ" trước khi trả lời, lại là những mô hình tệ nhất trong việc cho bạn biết khi chúng không biết.

Đó chính là vấn đề "hộp đen" gói gọn trong một đoạn văn. Chúng ta đã xây dựng các hệ thống trí tuệ nhân tạo thường tạo ra những kết quả hữu ích nhưng không ai, kể cả người tạo ra chúng, có thể giải thích đầy đủ. Chúng chính xác mà không cần hiệu chỉnh, trôi chảy mà không trung thực, và tự tin mà không chính xác.

Các cơ quan quản lý đã nhận thấy điều này. Đạo luật AI của EU hiện áp dụng mức phạt lên tới 35 triệu euro hoặc 7% doanh thu toàn cầu đối với các hành vi sử dụng bị cấm, với các quy tắc về hệ thống rủi ro cao có hiệu lực vào ngày 2 tháng 8 năm 2026. Cục Bảo vệ Tài chính Người tiêu dùng Hoa Kỳ đã nói rõ với các ngân hàng rằng họ không thể sử dụng các thuật toán phức tạp nếu những thuật toán đó cản trở họ giải thích lý do từ chối cấp tín dụng. Và lĩnh vực trí tuệ nhân tạo có thể giải thích được, một chủ đề chuyên biệt cách đây 5 năm, hiện là một thị trường được ước tính trị giá từ 9 tỷ đến 13 tỷ đô la vào năm 2026.

Hướng dẫn này sẽ giải thích AI hộp đen thực chất là gì, tại sao ngay cả những mô hình AI trông đơn giản cũng trở thành hộp đen, điều gì xảy ra sai sót khi chúng trở thành hộp đen, chúng xuất hiện ở đâu trong lĩnh vực tiền điện tử và công nghệ tài chính, cách bộ công cụ AI có thể giải thích (SHAP, LIME, các giả định phản thực) cố gắng giải mã chúng, và những điều bạn cần biết về chế độ pháp lý mới ở EU và Mỹ. Ngoài ra còn có một phần ngắn để làm rõ một sự nhầm lẫn thường gặp: AI hộp đen, trợ lý lập trình tại blackbox.ai, là một thứ khác.

Trí tuệ nhân tạo hộp đen là gì và tại sao nó lại quan trọng?

Trí tuệ nhân tạo hộp đen (Black box AI) đề cập đến bất kỳ hệ thống AI nào mà quá trình suy luận bên trong của nó không minh bạch đối với người dùng và thường cả các nhà phát triển đã xây dựng nó. Đầu vào và đầu ra thì hiển thị. Nhưng con đường giữa chúng lại ẩn giấu bên trong các lớp trọng số, các mẫu được học và các phép biến đổi máy học mà không một con người nào có thể hiểu hết. Điều tương tự cũng áp dụng cho dù mô hình xử lý dữ liệu dạng bảng, hình ảnh hay các tác vụ xử lý ngôn ngữ tự nhiên như dịch thuật và trò chuyện.

Thuật ngữ "hộp đen" đã có từ trước cả học sâu hiện đại. Các kỹ sư đã sử dụng thuật ngữ này ít nhất từ những năm 1960 để chỉ bất kỳ hệ thống nào mà bạn có thể "tác động" từ bên ngoài nhưng không thể tháo rời. Các nhà sinh học thường chỉ ra rằng chính bộ não con người cũng là một hộp đen, nhưng sự so sánh này chỉ đúng đến một mức độ nhất định: trí tuệ nhân tạo (AI) không hoạt động giống như con người, và giả định rằng nó hoạt động giống con người là một trong những cách nhanh nhất để hiểu sai về ý nghĩa của AI "hộp đen". Điều đã thay đổi trong thập kỷ qua là quy mô. Một mô hình ngôn ngữ lớn hiện đại có thể chứa hàng trăm tỷ tham số. Một mạng nơ-ron sâu điển hình trải rộng "kiến thức" trên hàng nghìn lớp và hàng triệu đầu thu nhận thông tin, với các nơ-ron đơn lẻ mã hóa nhiều mẫu không liên quan cùng một lúc. Các nhà nghiên cứu gọi đặc tính cuối cùng này là đa nghĩa, và đó là một trong những lý do khiến khả năng giải thích cơ học vẫn còn ở giai đoạn sơ khai.

Tại sao những người ngoài phòng nghiên cứu lại cần quan tâm? Bởi vì trí tuệ nhân tạo (AI) "hộp đen" hiện đang chi phối những quyết định quan trọng. Nó phê duyệt và từ chối tín dụng. Nó chấm điểm bị cáo. Nó gắn cờ các giao dịch là gian lận. Nó chiếm một phần lớn khối lượng giao dịch trên mọi sàn giao dịch tiền điện tử lớn. Khi nó mắc lỗi, tính thiếu minh bạch khiến việc tìm ra nguyên nhân, sửa chữa hoặc buộc ai đó chịu trách nhiệm gần như là bất khả thi.

Điều này cũng quan trọng bởi vì việc quản trị AI không còn coi tính thiếu minh bạch là vấn đề của nhà phát triển nữa. Liên minh châu Âu hiện coi đó là vấn đề tiếp cận thị trường. Các cơ quan quản lý của Mỹ coi đó là vấn đề cho vay công bằng. Mọi giám đốc điều hành đã phê duyệt một sáng kiến về AI kể từ năm 2024 đều gặp phải cùng một trở ngại: thực chất thứ này đang làm gì và tại sao? Hiểu về AI "hộp đen" không còn là điều tùy chọn nữa, và bạn không thể giải quyết vấn đề "hộp đen" bằng cách đơn giản sử dụng một nhà cung cấp khác.

Vì sao các mô hình AI trở thành "hộp đen"?

Không phải mọi hệ thống AI đều là hộp đen. Một cây quyết định đơn giản hoàn toàn minh bạch. Một mô hình hồi quy tuyến tính đưa ra các hệ số mà bạn có thể đọc được. Ngay cả một hệ thống AI dựa trên quy tắc từ những năm 1990 về nguyên tắc cũng có thể kiểm toán từng dòng một.

Vậy tại sao các mô hình AI hiện nay lại trở thành những "hộp đen"? Điều này xảy ra do bốn lý do chồng chéo nhau.

Đầu tiên, về quy mô. Các mô hình học sâu với hàng triệu hoặc hàng tỷ tham số hoạt động trong không gian đa chiều mà con người không thể hình dung được. Bạn có thể mô tả một mô hình 200 tỷ tham số bằng toán học, nhưng không ai có thể hình dung được nó trong đầu.

Thứ hai, biểu diễn phân tán. Trong mạng nơ-ron sâu, không có một nơ-ron đơn lẻ nào lưu trữ "khái niệm về con mèo" hay "quy tắc từ chối khoản vay". Các khái niệm trải rộng trên hàng nghìn nơ-ron, và các nơ-ron riêng lẻ tham gia vào nhiều khái niệm cùng một lúc. Việc tìm ra một lời giải thích rõ ràng là một dự án nghiên cứu, chứ không phải là một câu hỏi.

Thứ ba, sự phụ thuộc vào dữ liệu huấn luyện. Hành vi của mô hình được định hình bởi dữ liệu huấn luyện của nó, thường là dữ liệu độc quyền, khổng lồ và đôi khi tiềm ẩn nhiều rủi ro pháp lý. Ngay cả khi nhà phát triển công bố trọng số của mô hình, dữ liệu hiếm khi được chia sẻ. Vì vậy, một phần quan trọng của câu trả lời cho câu hỏi "tại sao" lại bị thiếu.

Thứ tư, mục đích. Có những lý do thực tế để sử dụng các phương pháp hộp đen một cách có chủ đích. Một số nhà phát triển và lập trình viên AI cố tình che giấu các chi tiết bên trong mô hình để bảo vệ tài sản trí tuệ, và các lý do khác để sử dụng thiết kế hộp đen bao gồm các điều khoản cấp phép và rào cản cạnh tranh. Ngay cả một mô hình có trọng số mở cũng có thể tạo ra một hộp đen xung quanh các quyết định của nó, bởi vì hầu hết các mô hình hiện đại đều dựa trên các mô hình phát sinh mà không có tài liệu nào ghi lại được. Một công ty đã đầu tư 100 triệu đô la vào một mô hình sẽ không muốn công bố kiến trúc và quy trình huấn luyện của nó. Các mô hình AI mã nguồn mở chia sẻ mã nguồn cơ bản của chúng cuối cùng cũng là hộp đen, bởi vì người dùng vẫn không thể kiểm tra các trọng số đã học với bất kỳ sự giải thích có ý nghĩa nào.

Kết quả là ngay cả những mô hình AI tiên tiến tưởng chừng đơn giản, bao gồm cả LLM và các mô hình AI tạo sinh, cũng trở thành "hộp đen" theo mặc định. Các mô hình minh bạch là ngoại lệ, chứ không phải là quy tắc. Các "hộp đen" phức tạp có thể mang lại độ chính xác ấn tượng, đó là lý do tại sao các nhóm tiếp tục triển khai chúng bất chấp tính không rõ ràng. Điều tương tự cũng đúng với các mô hình AI "hộp đen" được huấn luyện trên dữ liệu phong phú, phức tạp: sự vượt trội so với các mô hình AI dựa trên quy tắc thường đủ lớn để lấn át những lo ngại về khả năng giải thích cho đến khi có sự cố xảy ra. Hầu hết các AI "hộp đen" hiện đại cuối cùng vẫn là "hộp đen" vì người dùng vẫn không thể kiểm tra các trọng số đã học. Các mô hình trọng số mở chia sẻ mã nguồn cơ bản của chúng, và người dùng có thể đọc kiến trúc, nhưng mã nguồn cơ bản cuối cùng vẫn là "hộp đen" khi bạn hỏi "tại sao mô hình lại nói như vậy".

Vấn đề hộp đen trong học sâu

Vấn đề "hộp đen" xuất hiện khi bốn lý do trên kết hợp lại. Mô hình hoạt động, thường là rất ấn tượng. Nhưng nó hoạt động theo cách chống lại ba điều cùng một lúc: giải thích, xác thực và sửa chữa.

Hãy xem ví dụ kinh điển: một mô hình học sâu được huấn luyện để nhận dạng gấu trúc. Nó đạt điểm 99% trên tập dữ liệu thử nghiệm. Trông có vẻ tuyệt vời. Sau đó, ai đó chạy một công cụ phân tích khả năng diễn giải và phát hiện ra rằng mô hình thực sự không nhìn vào con gấu trúc. Nó đang chú ý đến cây tre. Hầu hết các bức ảnh về gấu trúc trong dữ liệu huấn luyện cũng có chứa tre. Mô hình đã học được một lối tắt. Trên một bức ảnh gấu trúc không có tre, mô hình thất bại.

Kiểu "học tắt" này xuất hiện khắp nơi trong học sâu. Mô hình tìm ra một quy luật thống kê không phù hợp với khái niệm cơ bản, nhưng bạn chỉ nhận ra khi thế giới thực tế trông hơi khác so với tập dữ liệu huấn luyện. Cuộc khủng hoảng tài chính năm 2008 là một ví dụ lịch sử tương tự. Các mô hình Giá trị rủi ro (Value-at-Risk) được xây dựng dựa trên giả định Gaussian hoạt động rất tốt trong thị trường bình thường và sụp đổ trong điều kiện thị trường bất thường, bởi vì chúng đã học được những lối tắt mà chính những người xây dựng mô hình cũng không nhận ra đó là lối tắt.

Các mô hình học sâu hiện nay đều mắc phải lỗi tương tự, chỉ khác ở số lượng tham số và độ tin cậy. Các nhà nghiên cứu về khả năng giải thích cơ học, bao gồm các nhóm tại Anthropic và OpenAI, đã bắt đầu phân tích ngược các phần nhỏ của mô hình ngôn ngữ, từng nơ-ron một. Công trình của họ cho thấy bên trong một mô hình ngôn ngữ gần giống với các mạch rối hơn là logic gọn gàng. Không có điểm nào bạn có thể chỉ ra và nói "đây là nơi chứa câu trả lời". Vấn đề hộp đen không phải là một lỗi cần sửa; nó mang tính cấu trúc.

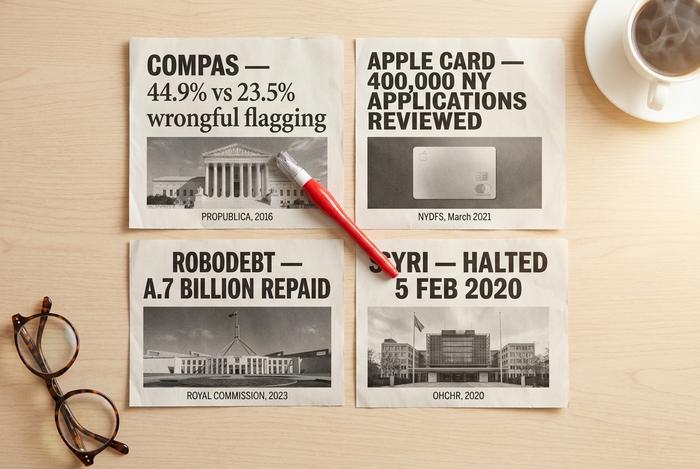

Ví dụ về Trí tuệ nhân tạo hộp đen: COMPAS, Apple Card, Robodebt, SyRI

Bạn muốn xem trí tuệ nhân tạo hộp đen trông như thế nào khi gặp sự cố? Bốn trường hợp mà mọi người thường nhắc đến sẽ cho bạn biết hầu hết những gì bạn cần biết. Chúng trải rộng trên các lĩnh vực tư pháp hình sự, ngân hàng và phúc lợi xã hội. Tất cả đều gây tổn hại cho người thật. Và không có hai trường hợp nào thất bại theo cùng một cách.

Hãy bắt đầu với COMPAS. Northpointe đã xây dựng nó để dự đoán liệu bị cáo có tái phạm hay không, và các tòa án Hoa Kỳ đã triển khai rộng rãi nó. Sau đó, ProPublica đã xem xét kỹ lưỡng hệ thống này. Cuộc kiểm toán năm 2016 của họ đã sử dụng dữ liệu từ hơn 7.000 người bị bắt giữ tại Quận Broward và kết quả thật đáng lo ngại: Bị cáo da đen bị gắn cờ sai là có nguy cơ cao trong 44,9% trường hợp, trong khi con số này đối với bị cáo da trắng chỉ là 23,5%. Một bài báo tiếp theo năm 2024 thậm chí còn làm cho tình hình tồi tệ hơn. Hai đặc điểm (tuổi tác và tiền án) có độ chính xác tương đương với con số 137 của COMPAS. Vì vậy, sự phức tạp không mang lại tín hiệu bổ sung nào, nhưng nó lại khiến việc phát hiện ra sự thiên vị trở nên khó khăn hơn nhiều. Đó chính là mô hình hộp đen kinh điển đánh giá con người thay vì sản phẩm. Mô hình hộp đen đánh giá ứng viên xin việc, mô hình mà Amazon đã loại bỏ vào năm 2018, cũng có hình dạng tương tự.

Rồi đến thẻ Apple Card, cuối năm 2019. Wozniak nói vợ ông được cấp hạn mức tín dụng thấp hơn ông gấp 10 lần. David Heinemeier Hansson cũng nói điều tương tự. Câu chuyện lan truyền nhanh chóng. Sở Dịch vụ Tài chính New York đã xem xét nghiêm túc: họ đã thu thập khoảng 400.000 đơn đăng ký và kiểm tra. Tháng 3 năm 2021, họ đưa ra phán quyết rằng không có sự phân biệt đối xử giới tính theo luật định. Nhưng họ cũng viết, và đây là phần quan trọng, rằng sự thiếu minh bạch trong trải nghiệm khách hàng là một vấn đề về lòng tin. Hóa ra, tác hại của "hộp đen" một nửa là về kết quả và một nửa là về nhận thức. Một thông cáo báo chí không thể giải quyết được vấn đề nhận thức.

Robodebt là mặt trái của vấn đề. Không hề có mạng nơ-ron sâu nào tham gia. Úc đã áp dụng quy tắc tính thu nhập bình quân dựa trên hồ sơ phúc lợi từ năm 2016 đến 2019, cáo buộc khoảng 400.000 người nhận trợ cấp gian lận, và không thể giải thích một cách mạch lạc cách tính toán cho bất kỳ ai nhận được thư. Một Ủy ban Hoàng gia sau đó đã tuyên bố chương trình này là bất hợp pháp. Chính phủ đã hoàn trả 1,7 tỷ đô la Úc cộng thêm 112 triệu đô la Úc tiền bồi thường. Bài học rút ra: một hệ thống không cần phải phức tạp về mặt kỹ thuật để trở thành một hộp đen. Nó chỉ cần không chịu trách nhiệm giải trình.

Vụ bê bối trợ cấp chăm sóc trẻ em ở Hà Lan và dự án SyRI là hai cột mốc quan trọng trong lịch sử châu Âu. Ngày 5 tháng 2 năm 2020, một tòa án Hà Lan đã ra lệnh dừng ngay lập tức hoạt động của SyRI, phán quyết rằng tính thiếu minh bạch của nó vi phạm Điều 8 của Công ước Nhân quyền châu Âu. Vụ bê bối liên quan đến trợ cấp chăm sóc trẻ em đã cuốn vào vòng xoáy của hơn 20.000 bậc phụ huynh bị cáo buộc gian lận oan. Chính phủ Rutte đã từ chức vào tháng 1 năm 2021 vì vụ việc này. Phán quyết đó hiện là điểm tham chiếu tiêu chuẩn trong giới hoạch định chính sách của EU về lý do tại sao trí tuệ nhân tạo thiếu minh bạch trong các bối cảnh quan trọng không phải là vấn đề đạo đức nhẹ nhàng, mà là vấn đề pháp lý.

Bốn trường hợp. Các lĩnh vực khác nhau, công nghệ khác nhau, quốc gia khác nhau. Cùng một mô hình: một hệ thống thiếu minh bạch, một quyết định gây hậu quả nghiêm trọng, và những người chịu ảnh hưởng không có cách nào thực sự để phản kháng.

Rủi ro hộp đen của trí tuệ nhân tạo trong các hệ thống trí tuệ nhân tạo thực tế

Khi bạn bắt đầu lập danh mục rủi ro AI "hộp đen" trong các hệ thống AI thực tế, một mô hình sẽ xuất hiện. Năm rủi ro tương tự xuất hiện lặp đi lặp lại, bất kể mô hình đó là hệ thống chấm điểm tín dụng, chatbot hay hệ thống giao dịch thuật toán.

| Rủi ro | Nó trông như thế nào? | Lý do nó có thể mở rộng |

|---|---|---|

| Thiên kiến tiềm ẩn | Mô hình này đối xử với các nhóm được bảo vệ một cách khác biệt. | Dữ liệu huấn luyện mang theo các mô hình lịch sử. |

| Ảo giác | Mô hình này tự bịa ra các sự kiện hoặc trích dẫn. | Các chương trình LLM tối ưu hóa sự trôi chảy, chứ không phải sự thật. |

| Học theo lối tắt | Mô hình dựa trên các mối tương quan không liên quan. | Dễ học hơn so với khái niệm thực sự. |

| Sự mong manh đối nghịch | Thay đổi nhỏ ở đầu vào sẽ đảo ngược đầu ra. | Ranh giới quyết định đa chiều |

| Phân tích kiểm toán | Không thể tái hiện lại lý do tại sao. | Không có trạng thái nội bộ có thể giải thích được |

Những rủi ro này càng trở nên trầm trọng hơn đối với các hệ thống AI "hộp đen" được sử dụng trong lĩnh vực tài chính, tuyển dụng, chăm sóc sức khỏe và tiền điện tử. Các quy trình học sâu phức tạp bên trong chúng khiến việc dự đoán lỗi tiếp theo sẽ xảy ra ở đâu trở nên khó khăn, và các công cụ AI truyền thống dành cho kiểm thử chất lượng không được xây dựng cho các mô hình có hàng trăm tỷ tham số.

Thiên kiến tiềm ẩn thường thu hút sự chú ý của dư luận, nhưng sự dễ bị tổn thương trước các đối thủ và sự đổ vỡ trong quá trình kiểm toán mới là những vấn đề lớn hơn về lâu dài. Một thiên kiến ổn định ít nhất có thể được đo lường và điều chỉnh. Một mô hình liên tục gặp lỗi khác nhau mỗi khi chạy (như ChatGPT, với khoảng 42% nhiệm vụ đánh giá hợp đồng thông minh theo một nghiên cứu của ACM TOSEM năm 2024) sẽ khó được chứng nhận để sử dụng trong môi trường có quy định hơn nhiều.

Yếu tố mới nhất gia nhập danh sách này là cái mà các nhà nghiên cứu gọi là "rủi ro AI tác nhân". Khi bạn kết nối một mô hình học máy (LLM) với các công cụ, cấp cho nó bộ nhớ và cho phép nó gọi các API, bạn sẽ làm tăng thêm tính mờ ám. Một quyết định duy nhất giờ đây là một chuỗi các lần gọi mô hình, các tài liệu được truy xuất và các lệnh gọi công cụ, mỗi lần đều có một phần mờ ám. Các tác nhân hiện đại là những hộp đen nằm trong những hộp đen khác.

Trí tuệ nhân tạo hộp đen trong lĩnh vực tiền điện tử và công nghệ tài chính

Trong tất cả các ngành sử dụng trí tuệ nhân tạo hộp đen, tiền điện tử và công nghệ tài chính là nơi mà khía cạnh triển khai và khía cạnh rủi ro xung đột mạnh mẽ nhất. Rủi ro rất lớn. Độ trễ rất ngắn. Thông tin công khai rất ít. Quy định, đặc biệt là trong lĩnh vực tiền điện tử, vẫn còn rời rạc. Kết quả là một môi trường mà việc triển khai được ưu tiên trước, còn việc viết tài liệu lại được ưu tiên sau.

Giao dịch thuật toán. Giao dịch thuật toán chiếm khoảng 70-80% khối lượng giao dịch tiền điện tử trong năm 2025, cao hơn tỷ lệ 60-70% trên các thị trường chứng khoán lớn. Riêng Wintermute đã xử lý hơn 15 tỷ đô la trên hơn 60 sàn giao dịch mỗi ngày, với khối lượng giao dịch kỷ lục 2,24 tỷ đô la trong một ngày được báo cáo vào năm 2025. Các chiến lược đằng sau những dòng tiền này là các thuật toán học sâu mà không một nhà quan sát bên ngoài nào có thể kiểm toán. Sự sụp đổ của Alameda/FTX vào tháng 11 năm 2022 là minh họa rõ ràng nhất về rủi ro này: tổng vốn hóa thị trường tiền điện tử đã giảm từ hơn 1 nghìn tỷ đô la xuống dưới 800 tỷ đô la chỉ trong khoảng một tháng, và khoản rủi ro 14,6 tỷ đô la liên quan đến FTT trên bảng cân đối kế toán của Alameda đã không được phát hiện cho đến khi nó được phơi bày.

Chấm điểm AML và KYC. Thị trường phần mềm chống rửa tiền toàn cầu đạt 4,13 tỷ đô la vào năm 2025 và được dự báo sẽ đạt 9,38 tỷ đô la vào năm 2030 (MarketsandMarkets). Riêng việc tuân thủ AML/KYC trong lĩnh vực tiền điện tử tăng trưởng với tốc độ CAGR 13,8%. Các nhà cung cấp như ComplyAdvantage, Chainalysis Reactor và Elliptic Navigator hiện đang sử dụng các mô hình học máy hộp đen để chấm điểm rủi ro ví. Việc sử dụng học máy hộp đen ở đây rất phổ biến và hiệu quả, đủ để được triển khai tại hầu hết các sàn giao dịch lớn, và đủ mờ ám đến mức các nhân viên tuân thủ thường không thể tái tạo lại lý do tại sao một ví cụ thể bị chặn.

Kiểm toán hợp đồng thông minh. Đây là nơi mà những hạn chế của AI bộc lộ rõ ràng. Một nghiên cứu trên arXiv năm 2024 đã đánh giá GPT-4 về khả năng phát hiện lỗ hổng trong hợp đồng thông minh. Nó đạt độ chính xác 96,6% nhưng chỉ có độ thu hồi 37,8%, bỏ sót gần hai phần ba số lỗi thực sự. Kết quả đầu ra của ChatGPT không ổn định giữa các lần chạy trên 42% hợp đồng (ACM TOSEM 2024). Các công cụ lai như GPTScan, kết hợp GPT với phân tích tĩnh, đạt độ chính xác hơn 90% và độ thu hồi khoảng 70% trên các hợp đồng token (arXiv 2308.03314). CertiK Skynet hiện đang giám sát hơn 17.000 dự án và khoảng 494 tỷ đô la giá trị thị trường, nhưng mọi nhóm kiểm toán có trách nhiệm vẫn kết hợp AI với người đánh giá là con người.

Các cố vấn tài chính tự động (robo-advisor). Betterment quản lý hơn 56 tỷ đô la trên hơn 900.000 tài khoản. Wealthfront quản lý 42,9 tỷ đô la. Ngành công nghiệp cố vấn tài chính tự động đã vượt mốc 1 nghìn tỷ đô la tổng tài sản được quản lý (AUM) trên toàn cầu. Việc tái cân bằng danh mục đầu tư, tối ưu hóa thuế và chấm điểm rủi ro đều được thực hiện bởi các mô hình học máy (ML), và các quyết định cụ thể của chúng không được tiết lộ trong bất kỳ tài liệu nào dành cho khách hàng cá nhân.

Chấm điểm tín dụng và phát hiện gian lận. FICO được 90% các tổ chức cho vay tại Mỹ sử dụng, và FICO Falcon xử lý hơn 65 tỷ giao dịch mỗi năm với tỷ lệ phát hiện gian lận được báo cáo là hơn 95%. Một nghiên cứu của Ngân hàng Anh năm 2024 đối với 50 tổ chức tại Anh cho thấy các mô hình rủi ro tín dụng dựa trên học máy đã giảm thiểu việc phân loại sai khoảng 25% so với hồi quy logistic. Sự gia tăng độ chính xác là có thật. Tuy nhiên, theo Thông tư 2022-03 và 2023-03 của CFPB, các tổ chức cho vay tại Mỹ không thể sử dụng các mô hình đủ mờ ám để ngăn chặn các giải thích cụ thể về hành động bất lợi theo ECOA.

Mô hình này có cùng một dạng mẫu. Mô hình chính xác hơn so với đường cơ sở minh bạch. Tính mờ đục không thể tách rời khỏi độ chính xác về mặt cấu trúc. Và các cơ quan quản lý đang bắt kịp nhanh hơn so với các công cụ giải thích.

Ghi chú về Trí tuệ nhân tạo hộp đen: Chương trình Thạc sĩ Luật Lập trình (Coding LLM)

Một lời giải thích ngắn gọn. Khi mọi người tìm kiếm "AI hộp đen", họ thường muốn nói đến vấn đề khái niệm mà bài viết này đề cập. Đôi khi họ muốn nói đến Blackbox AI, công ty tại blackbox.ai. Blackbox.ai là một phần mềm quản lý học tập (LLM) dành cho lập trình được thiết kế để thay đổi cách các nhà phát triển viết mã. Sản phẩm này tích hợp với VS Code như một trợ lý lập trình, đề xuất mã và cạnh tranh với các công cụ như Claude Code, GitHub Copilot và Cursor. Đây là một trong những công nghệ AI tiên tiến nổi tiếng hơn trong lĩnh vực lập trình AI, được xây dựng trên nhiều mô hình AI, và mã mà Blackbox đề xuất bao gồm mọi thứ từ việc tái cấu trúc đến tạo khung kiểm thử. Blackbox tích hợp việc tạo mã, trò chuyện và tìm kiếm vào một quy trình làm việc duy nhất, và hầu hết người dùng đều gọi nó là trợ lý AI tốt nhất mà họ từng thử trong trình soạn thảo của mình.

Hai nghĩa này thường bị lẫn lộn trong kết quả tìm kiếm. Sản phẩm Blackbox AI không phải là chủ đề của bài viết này. Chúng ta đang xem xét thuộc tính cấu trúc của các hệ thống AI mờ đục, chứ không phải bất kỳ trợ lý lập trình nào. Nếu bạn tìm kiếm sản phẩm, công ty đó có tài liệu và bảng giá riêng. Nếu bạn tìm kiếm khái niệm, hãy tiếp tục đọc.

Trí tuệ nhân tạo có thể giải thích và các công cụ giải thích

Trí tuệ nhân tạo có thể giải thích được, thường được viết tắt là XAI, là lĩnh vực cố gắng làm sáng tỏ các mô hình AI khó hiểu mà không làm giảm độ chính xác của chúng. Đây cũng là một thị trường thực sự hiện nay. Dự báo cho năm 2026 cho thấy thị trường này sẽ đạt từ 9 tỷ đến 13 tỷ đô la trên toàn cầu, với sự chênh lệch tùy thuộc vào định nghĩa XAI mà bạn chấp nhận. Mục tiêu là làm cho các mô hình AI dễ giải thích hơn mà không buộc các nhóm phải quay lại các mô hình cơ bản chậm hơn hoặc kém chính xác hơn. Các nhóm thông minh sẽ chạy các công cụ này trên các công cụ AI trước khi phát hành chúng, và họ kết hợp kết quả đầu ra với tài liệu mà người đánh giá có thể đọc hiểu được.

Có ba nhóm kỹ thuật XAI đáng để tìm hiểu.

Đầu tiên là SHAP, viết tắt của SHapley Additive exPlanations. Nó được mượn từ lý thuyết trò chơi hợp tác: với mỗi dự đoán, SHAP gán một điểm đóng góp cho mỗi đặc trưng đầu vào. Các nhóm chấm điểm tín dụng rất thích nó. Các nhóm phát hiện gian lận cũng thích nó. Các nhà mô hình hóa rủi ro chăm sóc sức khỏe thì chấp nhận được. SHAP có tính chặt chẽ về mặt lý thuyết, nhưng về mặt tính toán, nó là một "con quái vật" khi xử lý dữ liệu dạng bảng lớn.

Thứ hai là LIME, viết tắt của Local Interpretable Model-agnostic Explanations (Giải thích cục bộ, không phụ thuộc vào mô hình). LIME xây dựng một mô hình thay thế đơn giản, dễ hiểu xung quanh một dự đoán duy nhất và sử dụng mô hình đó để giải thích dự đoán ban đầu. Nhanh hơn SHAP. Hoạt động trên văn bản, hình ảnh và bảng. Tuy nhiên, điểm cần lưu ý là LIME được thiết kế cục bộ, vì vậy nó có thể gây hiểu lầm nếu bạn cho rằng một lời giải thích duy nhất có thể khái quát hóa.

Thứ ba là các giải thích dựa trên giả định phản thực. Thay vì cho bạn biết tại sao mô hình lại đưa ra kết quả "có", các giải thích phản thực sẽ cho bạn biết sự thay đổi nhỏ nhất trong dữ liệu đầu vào có thể làm thay đổi kết quả thành "không". Đó chính xác là điều mà người xin cấp tín dụng hoặc giao dịch bị gắn cờ muốn biết: "Tôi cần phải thay đổi điều gì?". Các giải thích phản thực đang nhanh chóng được sử dụng rộng rãi trong các thông báo về hành động bất lợi chính vì chúng phù hợp hoàn toàn với kỳ vọng của cơ quan quản lý.

Ngoài ba điều đó, bạn sẽ thấy các biểu đồ tầm quan trọng của tính năng, hình ảnh hóa sự chú ý cho các lớp Transformer và Grad-CAM cho các bộ phân loại hình ảnh. Khả năng giải thích cơ chế, thực hành đảo ngược kỹ thuật các nơ-ron và mạch chú ý cụ thể, đang ở vị trí tiên tiến nhất trong lĩnh vực này. Anthropic, OpenAI và một số phòng thí nghiệm học thuật đã công bố các mạch một phần, nhưng công trình này vẫn chưa được ứng dụng vào bất kỳ sản phẩm nào mà nhóm tuân thủ quy định của doanh nghiệp có thể sử dụng.

Hãy thành thật về kết quả cuối cùng của vấn đề này. Nghiên cứu ngành được công bố bởi Palo Alto Networks và các tổ chức khác chỉ ra rằng XAI hoạt động tốt đối với các bộ phân loại hình ảnh và mô hình bảng có cấu trúc, và chỉ một phần đối với các mô hình ngôn ngữ logic (LLM). Logic bên trong mô hình ngôn ngữ thay đổi khi vị trí token và cửa sổ ngữ cảnh thay đổi, do đó điểm số gán thuộc tính có thể gây hiểu lầm theo những cách mà chính lời giải thích không cảnh báo bạn. Các công cụ giải thích chia sẻ mã nguồn cơ bản của chúng rất hữu ích. Tuy nhiên, chúng không phải là giải pháp hoàn chỉnh cho vấn đề hộp đen.

Điều chỉnh Trí tuệ Nhân tạo Hộp đen: Đạo luật AI của EU, NIST, CFPB

Hầu hết các nhà cung cấp AI đều không ngờ rằng các cơ quan quản lý lại hành động nhanh đến vậy. Nhưng họ đã làm được. Quan điểm cũ "phát hành trước, nộp hồ sơ sau" đang dần lỗi thời, và một số ít quy định chính là lý do.

Châu Âu đã đi tiên phong với Đạo luật AI của EU. Đây là quá trình triển khai theo từng giai đoạn từ năm 2025 đến năm 2027, chứ không phải là một sự thay đổi đột ngột. Các hành vi bị cấm bắt đầu có hiệu lực từ ngày 2 tháng 2 năm 2025. Các quy tắc về AI đa năng có hiệu lực vào ngày 2 tháng 8 năm 2025. Các nghĩa vụ đối với hệ thống rủi ro cao bắt đầu có hiệu lực từ ngày 2 tháng 8 năm 2026, và việc mở rộng phạm vi áp dụng cho các sản phẩm được quản lý sẽ có hiệu lực một năm sau đó, vào ngày 2 tháng 8 năm 2027. Mức phạt không chỉ mang tính hình thức. 35 triệu euro hoặc 7% doanh thu toàn cầu đối với các vi phạm nghiêm trọng nhất, 15 triệu euro hoặc 3% đối với các vi phạm còn lại (DLA Piper, 2025). Và danh sách các trường hợp sử dụng rủi ro cao giống như một danh sách những ứng dụng "hộp đen" nổi tiếng: chấm điểm tín dụng, tuyển dụng, giáo dục, thực thi pháp luật, nhận dạng sinh trắc học. Mỗi trường hợp trong số đó hiện nay đều yêu cầu tài liệu, tính minh bạch và sự giám sát của con người theo mặc định.

Tình hình ở Mỹ phức tạp hơn nhưng đang đi theo cùng một hướng. Khung quản lý rủi ro AI của NIST là chuẩn mực gần nhất với chuẩn mực của Mỹ. Được ban hành vào tháng 1 năm 2023, mở rộng trong suốt năm 2024 và 2025, nó đã âm thầm trở thành tài liệu mà các doanh nghiệp lớn tự đặt mình vào để tham khảo, bất kể về mặt kỹ thuật họ có bắt buộc phải tuân theo hay không. Tháng 12 năm 2025, NIST IR 8596, bản dự thảo sơ bộ của Hồ sơ AI an ninh mạng, được công bố, cùng với một hội thảo tiếp theo vào ngày 14 tháng 1 năm 2026. Rất nhiều nhóm đã và đang áp dụng nó.

Cục Bảo vệ Tài chính Người tiêu dùng đã thẳng thắn hơn. Các Thông tư 2022-03 và 2023-03 nêu rõ: người cho vay không thể sử dụng thuật toán phức tạp nếu sự phức tạp đó cản trở người cho vay đưa ra lý do cụ thể cho hành động bất lợi theo ECOA và Quy định B. Hãy đọc kỹ điều đó. Đây không phải là lệnh cấm sử dụng máy học trong cho vay. Đây là lệnh cấm sử dụng máy học quá mờ ám đến mức bạn không thể cho người nộp đơn bị từ chối biết họ đã làm sai điều gì. Nói cách khác, đó là lệnh cấm hộp đen đối với tín dụng tiêu dùng.

Các ngân hàng phải đối mặt với một yêu cầu cũ hơn nhưng vẫn khắt khe hơn. Quy định SR 11-7 của Cục Dự trữ Liên bang, có hiệu lực từ năm 2011, buộc các ngân hàng phải chứng minh rằng họ hiểu bất kỳ mô hình nào chi phối một quyết định quan trọng. Các hệ thống học sâu hiện đại gặp khó khăn trong việc đáp ứng yêu cầu này mà không cần trợ giúp, và Thông báo 2011-12 của OCC cũng áp dụng cách tiếp cận tương tự.

Kết quả cuối cùng: bất kỳ tổ chức nào chịu sự quản lý ở Mỹ hoặc EU đều không còn lý do gì để coi sự thiếu minh bạch là sự đánh đổi chấp nhận được cho tính chính xác. Hoặc là khả năng giải thích được tích hợp ngay từ khâu xem xét thiết kế ban đầu, hoặc là bạn xây dựng một hệ thống lai trong đó con người đưa ra lời giải thích mà mô hình không thể. Không có con đường thứ ba nào có thể vượt qua được hành động cưỡng chế.

Cách kiểm toán hệ thống AI hộp đen

Vậy việc triển khai có trách nhiệm một hệ thống AI "hộp đen" thực sự sẽ như thế nào vào năm 2026? Quy trình thực tế ngắn gọn hơn nhiều so với những gì các nhà cung cấp quảng cáo.

Bạn bắt đầu với dữ liệu. Ghi lại nguồn gốc của dữ liệu huấn luyện, người đã gắn nhãn cho nó và những nhóm con nào được đại diện. Khoảng một nửa các vấn đề về sai lệch mà bạn sẽ gặp phải sau này đã được mã hóa ở đây, và một nửa mà bạn không thể truy tìm nguồn gốc là một nửa mà bạn không thể khắc phục.

Sau đó, bạn tiến hành tấn công mô hình bằng phương pháp "red-team". Kiểm tra nó bằng các dữ liệu đầu vào mang tính đối kháng, các thao tác chèn dữ liệu tức thời, các trường hợp ngoại lệ và các ví dụ nằm ngoài phạm vi phân phối. Anthropic, OpenAI và Microsoft hiện đã xuất bản các cẩm nang hướng dẫn cho công việc này mà bạn có thể điều chỉnh mà không cần phải phát minh ra phương pháp luận mới.

Áp dụng XAI cho mọi mô hình đang được sử dụng trong sản xuất, không chỉ những mô hình nổi bật. SHAP cho các pipeline dạng bảng. LIME cho văn bản và hình ảnh. Phân tích phản thực tế cho bất kỳ quyết định nào có liên quan đến người dùng. Không có công cụ nào là hoàn hảo. Mặt khác, sự thiếu vắng của chúng là một dấu hiệu cảnh báo đối với bất kỳ kiểm toán viên nào khi xem xét hệ thống của bạn.

Hãy chú ý đến sự thay đổi đột ngột. Các mô hình trở nên lỗi thời nhanh hơn hầu hết các nhóm dự đoán. Theo dõi phân bố đầu vào, phân bố đầu ra và kết quả tiếp theo. Thiết lập cảnh báo cho từng yếu tố và coi những thay đổi không giải thích được là sự cố, chứ không phải điều kỳ lạ.

Hãy xây dựng quy trình giải quyết khiếu nại trước khi bạn cần đến nó. Mỗi quyết định quan trọng trong mô hình đều cần có sự phê duyệt của con người và kênh khiếu nại được ghi chép rõ ràng mà khách hàng có thể sử dụng. Nếu nhóm hỗ trợ của bạn là kênh khiếu nại, hãy ghi lại điều đó.

Cuối cùng, hãy tự xác định mình thuộc khuôn khổ nào. Nếu bạn ở Mỹ, hãy tham khảo NIST AI RMF. Nếu bạn ở châu Âu, hãy tham khảo các yêu cầu rủi ro cao của Đạo luật AI của EU. Nếu bạn có liên quan đến tín dụng tiêu dùng, hãy tham khảo Thông tư 2022-03 và 2023-03 của CFPB. Làm điều này một lần và sớm sẽ tiết kiệm chi phí hơn rất nhiều so với việc phải điều chỉnh lại sau khi nhận được thông báo từ cơ quan thực thi pháp luật.

Bạn sẽ không thể loại bỏ hoàn toàn "hộp đen". Điều đó không sao cả. Nhiệm vụ là làm cho nó có thể quan sát được, có trách nhiệm giải trình và có giới hạn. Đó là tiêu chuẩn mà các cơ quan quản lý đã và đang thực thi, và đó cũng là hình ảnh của một hệ thống triển khai hoàn thiện vào năm 2026.