هوش مصنوعی جعبه سیاه چیست؟ توضیح مسئله جعبه سیاه

در آوریل ۲۰۲۶، جدول امتیازات توهم وکتارا حکم عجیبی صادر کرد. مدلهای برتر زبانی اکنون کمتر از ۴٪ مواقع در آزمون اصلی خود دچار توهم میشوند. اما انواع جدید «استدلال» GPT-5، Claude Sonnet 4.5، Grok-4 و Gemini-3-Pro همگی در مجموعه دادههای جدید بیش از ۱۰٪ دچار توهم میشوند. استدلال سریع Grok-4 به ۲۰.۲٪ رسید. باهوشترین مدلها، آنهایی که قبل از پاسخ دادن «فکر میکنند»، در گفتن اینکه چه زمانی نمیدانند، بدترین هستند.

این مشکل جعبه سیاه در یک پاراگراف است. ما سیستمهای هوش مصنوعی ساختهایم که اغلب خروجیهای مفیدی تولید میکنند و هیچکس، از جمله سازندگان آنها، نمیتواند بهطور کامل آنها را توضیح دهد. آنها بدون اینکه کالیبره شوند، دقیق هستند، بدون اینکه صادق باشند، روان هستند و بدون اینکه درست باشند، مطمئن هستند.

نهادهای نظارتی متوجه شدند. قانون هوش مصنوعی اتحادیه اروپا اکنون جریمههایی تا سقف ۳۵ میلیون یورو یا ۷ درصد از گردش مالی جهانی را برای کاربردهای ممنوعه وضع کرده است و قوانین سیستم پرخطر از ۲ آگوست ۲۰۲۶ لازمالاجرا میشوند. دفتر حمایت مالی از مصرفکنندگان ایالات متحده به صراحت به بانکها اعلام کرد که اگر الگوریتمهای پیچیده مانع از توضیح رد اعتبار شوند، نمیتوانند از آنها استفاده کنند. و حوزه هوش مصنوعی قابل توضیح، که پنج سال پیش موضوعی خاص بود، اکنون بازاری است که تخمین زده میشود در سال ۲۰۲۶ بین ۹ تا ۱۳ میلیارد دلار ارزش داشته باشد.

این راهنما به بررسی این موضوع میپردازد که هوش مصنوعی جعبه سیاه واقعاً چیست، چرا حتی مدلهای هوش مصنوعی ساده نیز به جعبه سیاه تبدیل میشوند، چه مشکلی در این مواقع پیش میآید، در کجای ارزهای دیجیتال و فینتک ظاهر میشوند، چگونه جعبه ابزار هوش مصنوعی قابل توضیح (SHAP، LIME، خلاف واقعها) سعی در رمزگشایی از آنها دارد و آنچه باید در مورد رژیم نظارتی جدید در اتحادیه اروپا و ایالات متحده بدانید. همچنین یک مسیر انحرافی کوتاه برای رفع یک سردرگمی تکراری وجود دارد: هوش مصنوعی جعبه سیاه، دستیار کدنویسی در blackbox.ai، چیز متفاوتی است.

هوش مصنوعی جعبه سیاه چیست و چرا اهمیت دارد؟

هوش مصنوعی جعبه سیاه به هر سیستم هوش مصنوعی اشاره دارد که استدلال درونی آن برای کاربران و اغلب برای توسعهدهندگانی که آن را ساختهاند، مبهم است. ورودیها و خروجیها قابل مشاهده هستند. مسیر بین آنها در لایههایی از وزنها، الگوهای آموختهشده و تبدیلهای یادگیری ماشین پنهان است که هیچ انسانی نمیتواند به طور کامل آنها را بخواند. همین امر در مورد اینکه آیا مدل دادههای جدولی، تصاویر یا وظایف پردازش زبان طبیعی مانند ترجمه و چت را مدیریت میکند، صدق میکند.

این برچسب قدیمیتر از یادگیری عمیق مدرن است. مهندسان حداقل از دهه ۱۹۶۰ از عبارت «جعبه سیاه» برای هر سیستمی که بتوانید از بیرون به آن ضربه بزنید اما نتوانید آن را باز کنید، استفاده کردهاند. زیستشناسان دوست دارند اشاره کنند که خود مغز انسان نیز یک جعبه سیاه است، اما این مقایسه فقط تا این حد پیش میرود: یک هوش مصنوعی مانند انسان کار نمیکند و فرض اینکه این کار را انجام میدهد، یکی از سریعترین راهها برای قضاوت نادرست در مورد آنچه هوش مصنوعی جعبه سیاه به آن اشاره دارد، است. چیزی که در دهه گذشته تغییر کرده، مقیاس است. یک مدل زبان بزرگ مدرن میتواند صدها میلیارد پارامتر را حمل کند. یک شبکه عصبی عمیق معمولی «دانش» را در هزاران لایه و میلیونها سر توجه پخش میکند، و نورونهای منفرد چندین الگوی نامرتبط را به طور همزمان رمزگذاری میکنند. محققان این ویژگی آخر را چندمعنایی مینامند و این یکی از دلایلی است که تفسیرپذیری مکانیکی هنوز در روزهای اولیه خود است.

چرا کسی خارج از آزمایشگاههای تحقیقاتی باید اهمیت بدهد؟ چون هوش مصنوعی جعبه سیاه اکنون تصمیمات مهم را هدایت میکند. اعتبار را تأیید و رد میکند. به متهمان امتیاز میدهد. تراکنشها را به عنوان کلاهبرداری علامتگذاری میکند. سهم بزرگی از حجم معاملات را در هر صرافی بزرگ کریپتو انجام میدهد. وقتی مشکلی پیش میآید، عدم شفافیت، فهمیدن دلیل، رفع آن یا پاسخگو کردن کسی را تقریباً غیرممکن میکند.

همچنین این موضوع اهمیت دارد زیرا حاکمیت هوش مصنوعی دیگر با ابهام به عنوان یک مشکل توسعهدهنده برخورد نمیکند. اتحادیه اروپا اکنون آن را به عنوان یک مسئله دسترسی به بازار در نظر میگیرد. تنظیمکنندگان ایالات متحده با آن به عنوان یک مسئله وامدهی منصفانه برخورد میکنند. هر مدیر اجرایی که از سال ۲۰۲۴ با یک طرح هوش مصنوعی موافقت کرده است، با همان مشکل مواجه شده است: این چیز واقعاً چه کاری انجام میدهد و چرا؟ درک هوش مصنوعی جعبه سیاه دیگر اختیاری نیست و شما نمیتوانید مشکل جعبه سیاه را صرفاً با استفاده از یک فروشنده متفاوت حل کنید.

چرا مدلهای هوش مصنوعی به جعبههای سیاه تبدیل میشوند؟

هر هوش مصنوعی یک جعبه سیاه نیست. یک درخت تصمیم ساده کاملاً شفاف است. یک مدل رگرسیون خطی ضرایبی را ارائه میدهد که میتوانید آنها را بخوانید. حتی یک سیستم هوش مصنوعی مبتنی بر قانون از دهه ۱۹۹۰، در اصل، خط به خط قابل حسابرسی است.

بنابراین چگونه مدلهای هوش مصنوعی امروزی به جعبههای سیاه تبدیل میشوند؟ این اتفاق به چهار دلیل مشترک رخ میدهد.

اول، مقیاس. مدلهای یادگیری عمیق با میلیونها یا میلیاردها پارامتر در فضاهای با ابعاد بالا عمل میکنند که انسانها نمیتوانند آنها را تجسم کنند. شما میتوانید یک مدل ۲۰۰ میلیارد پارامتری را در ریاضی توصیف کنید، اما هیچکس نمیتواند آن را در ذهن خود نگه دارد.

دوم، بازنماییهای توزیعشده. در یک شبکه عصبی عمیق، هیچ نورون واحدی «مفهوم گربه» یا «قانون رد وام» را ذخیره نمیکند. مفاهیم در هزاران نورون پخش میشوند و نورونهای منفرد به طور همزمان در بسیاری از مفاهیم شرکت میکنند. ارائه یک توضیح واضح یک پروژه تحقیقاتی است، نه یک پرسوجو.

سوم، وابستگی به دادههای آموزشی. رفتار مدل توسط دادههای آموزشی آن شکل میگیرد که معمولاً اختصاصی، عظیم و گاهی اوقات از نظر قانونی پرچالش هستند. حتی وقتی یک توسعهدهنده وزنهای مدل را منتشر میکند، دادهها به ندرت به اشتراک گذاشته میشوند. بنابراین بخش کلیدی «چرا» از قلم افتاده است.

چهارم، قصد و نیت. دلایل عملی برای استفاده عمدی از رویکردهای جعبه سیاه وجود دارد. برخی از توسعهدهندگان و برنامهنویسان هوش مصنوعی، عمداً اجزای داخلی مدل را مبهم میکنند تا از مالکیت معنوی محافظت کنند و دلایل دیگر برای استفاده از طرحهای جعبه سیاه شامل شرایط صدور مجوز و خندقهای رقابتی است. حتی یک مدل با وزن باز میتواند به طور مؤثر در مورد تصمیمات خود یک جعبه سیاه ایجاد کند، زیرا اکثر مدلهای مدرن به الگوهای نوظهوری متکی هستند که هیچ مستندسازی در آنها ثبت نمیشود. شرکتی که ۱۰۰ میلیون دلار در یک مدل سرمایهگذاری کرده است، مشتاق انتشار معماری و رویه آموزش آن نیست. مدلهای هوش مصنوعی متنباز که کد زیربنایی خود را به اشتراک میگذارند، در نهایت نیز جعبه سیاه هستند، زیرا کاربران هنوز نمیتوانند وزنهای آموخته شده را با هیچ تفسیر معناداری بررسی کنند.

نتیجه این است که حتی مدلهای هوش مصنوعی پیشرفته به ظاهر ساده، از جمله LLMها و مدلهای هوش مصنوعی مولد، به طور پیشفرض به جعبههای سیاه تبدیل میشوند. مدلهای شفاف استثنا هستند، نه قاعده. جعبههای سیاه پیچیده میتوانند دقت چشمگیری ارائه دهند، به همین دلیل است که تیمها با وجود ابهام، به استقرار آنها ادامه میدهند. همین امر در مورد مدلهای هوش مصنوعی جعبه سیاه که بر روی دادههای غنی و نامرتب آموزش دیدهاند نیز صادق است: افزایش مدلهای هوش مصنوعی مبتنی بر قانون اغلب به اندازهای بزرگ است که نگرانیهای مربوط به قابلیت توضیح را تا زمانی که چیزی خراب نشود، نادیده میگیرد. اکثر هوش مصنوعیهای جعبه سیاه مدرن در نهایت جعبههای سیاه هستند زیرا کاربران هنوز نمیتوانند وزنهای آموخته شده را بررسی کنند. مدلهای وزن باز کد زیربنایی خود را به اشتراک میگذارند و کاربران میتوانند معماری را بخوانند، اما کد زیربنایی در نهایت جعبههای سیاه هستند وقتی میپرسید "چرا مدل این را گفت".

مسئله جعبه سیاه در یادگیری عمیق

مشکل جعبه سیاه چیزی است که وقتی این چهار دلیل با هم ترکیب میشوند، به دست میآید. این مدل اغلب به طرز چشمگیری کار میکند. اما به گونهای عمل میکند که همزمان در برابر سه چیز مقاومت میکند: توضیح، اعتبارسنجی و اصلاح.

مثال کلاسیک را در نظر بگیرید: یک مدل یادگیری عمیق که برای شناسایی پانداها آموزش دیده است. در مجموعه تست ۹۹٪ امتیاز کسب میکند. عالی به نظر میرسد. سپس کسی یک ابزار تفسیرپذیری را اجرا میکند و متوجه میشود که مدل واقعاً به پاندا نگاه نمیکند. بلکه به بامبو توجه میکند. اکثر عکسهای پانداها در دادههای آموزشی نیز حاوی بامبو هستند. مدل یک میانبر یاد گرفته است. در عکس پاندا بدون بامبو، مدل شکست میخورد.

این نوع «یادگیری میانبر» در همه جای یادگیری عمیق وجود دارد. مدل یک نظم آماری پیدا میکند که با مفهوم اساسی مطابقت ندارد، اما شما فقط زمانی متوجه میشوید که دنیا کمی متفاوت از مجموعه آموزشی به نظر میرسد. بحران مالی ۲۰۰۸ در اینجا یک قیاس تاریخی است. مدلهای ارزش در معرض خطر که بر اساس فرضیات گاوسی ساخته شدهاند، در بازارهای عادی به زیبایی کار میکنند و در شرایط دم منفجر میشوند، زیرا آنها میانبرهایی را یاد گرفته بودند که مدلسازان متوجه میانبر بودن آنها نشده بودند.

مدلهای یادگیری عمیق امروزی دقیقاً همان حالت شکست را با پارامترهای بیشتر و اطمینان بیشتر به اشتراک میگذارند. محققان تفسیرپذیری مکانیکی، از جمله تیمهایی در Anthropic و OpenAI، مهندسی معکوس بخشهای کوچکی از مدلهای زبانی را نورون به نورون آغاز کردهاند. کار آنها نشان میدهد که درون یک LLM به مدارهای درهمتنیده نزدیکتر است تا منطق منظم. هیچ نقطهای وجود ندارد که بتوانید انگشت خود را روی آن بگذارید و بگویید "اینجا جایی است که پاسخ وجود دارد". مشکل جعبه سیاه یک اشکال نیست که باید برطرف شود؛ بلکه ساختاری است.

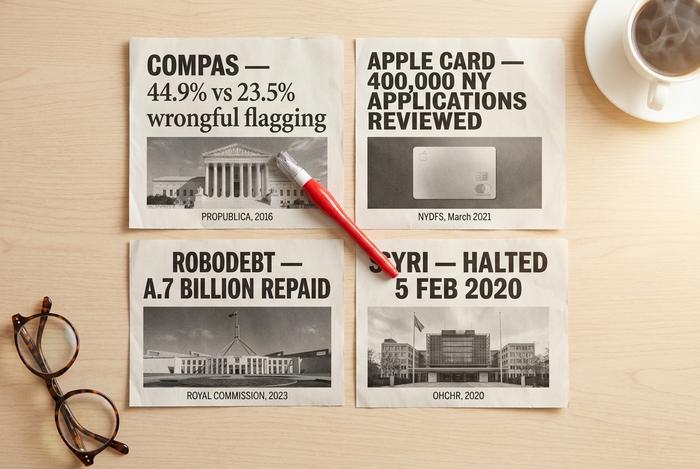

نمونههایی از هوش مصنوعی جعبه سیاه: COMPAS، اپل کارت، Robodebt، SyRI

میخواهید ببینید هوش مصنوعی جعبه سیاه وقتی سقوط میکند چه شکلی میشود؟ چهار موردی که همه مدام به آنها اشاره میکنند، بیشتر آنچه را که باید بدانید به شما میگویند. این موارد شامل عدالت کیفری، بانکداری و رفاه اجتماعی میشوند. همه آنها به افراد واقعی آسیب رساندهاند. و هیچ دو موردی به یک شکل شکست نخوردهاند.

با COMPAS شروع کنید. شرکت نورثپوینت آن را برای پیشبینی اینکه آیا متهم دوباره مرتکب جرم میشود یا خیر، ساخت و دادگاههای ایالات متحده آن را به طور گسترده به کار گرفتند. سپس پروپابلیکا به جزئیات پرداخت. حسابرسی سال ۲۰۱۶ آنها بیش از ۷۰۰۰ نفر از دستگیرشدگان شهرستان بروارد را از طریق دادهها بررسی کرد و نتیجه زشت بود: متهمان سیاهپوست در ۴۴.۹٪ موارد به اشتباه به عنوان پرخطر علامتگذاری شدند، در حالی که این رقم برای متهمان سفیدپوست فقط ۲۳.۵٪ بود. یک مقاله تکمیلی در سال ۲۰۲۴ اوضاع را بدتر کرد. دو ویژگی (سن و محکومیتهای قبلی) با دقت ۱۳۷ مورد COMPAS مطابقت داشت. بنابراین پیچیدگی به معنای واقعی کلمه هیچ سیگنال اضافی به همراه نداشت، اما تشخیص سوگیری را بسیار دشوارتر کرد. این مدل جعبه سیاه متعارف است که به جای محصولات، افراد را ارزیابی میکند. مدل جعبهای که متقاضیان کار را ارزیابی میکند، مدلی که آمازون در سال ۲۰۱۸ کنار گذاشت، با همین شکل مطابقت دارد.

سپس اپل کارت، اواخر سال ۲۰۱۹. وزنیاک گفت که همسرش سقف اعتباری ۱۰ برابر کمتر از سقف اعتباری او دریافت کرده است. دیوید هاینمایر هانسون هم همین را گفت. این داستان به سرعت پخش شد. اداره خدمات مالی نیویورک آن را جدی گرفت: آنها تقریباً ۴۰۰۰۰۰ درخواست را بررسی و بررسی کردند. در مارس ۲۰۲۱، آنها با حکمی مبنی بر عدم تبعیض جنسیتی قانونی بازگشتند. اما آنها همچنین نوشتند، و این بخشی است که اهمیت دارد، که ابهام در تجربه مشتری به خودی خود یک مشکل اعتماد است. معلوم شد که آسیب جعبه سیاه، نیمی مربوط به نتایج و نیمی مربوط به ادراک است. یک بیانیه مطبوعاتی، جنبه ادراک را اصلاح نمیکند.

روبودبِت روی دیگر سکه است. هیچ شبکه عصبی عمیقی در کار نیست. استرالیا بین سالهای ۲۰۱۶ تا ۲۰۱۹ قانون میانگینگیری درآمد را علیه سوابق رفاهی اجرا کرد، تقریباً ۴۰۰۰۰۰ دریافتکننده را به کلاهبرداری متهم کرد و نتوانست محاسبه را به طور منسجم برای هر کسی که نامه را دریافت کرده بود توضیح دهد. یک کمیسیون سلطنتی بعداً این طرح را غیرقانونی خواند. دولت ۱.۷ میلیارد دلار استرالیا به علاوه ۱۱۲ میلیون دلار استرالیا غرامت بازپرداخت کرد. درس: یک سیستم برای اینکه یک جعبه سیاه باشد، نیازی به پیچیدگی فنی ندارد. فقط باید غیرپاسخگو باشد.

پروندههای مربوط به کودکان هلندی و SyRI، پشتوانه مالی اروپایی هستند. در ۵ فوریه ۲۰۲۰، دادگاهی در هلند دستور توقف فوری SyRI را صادر کرد و حکم داد که ابهام آن، ماده ۸ کنوانسیون اروپایی حقوق بشر را نقض میکند. رسوایی مربوط به مزایای مراقبت از کودک، بیش از ۲۰،۰۰۰ والدین را که به اشتباه به کلاهبرداری متهم شده بودند، درگیر کرد. دولت روته در ژانویه ۲۰۲۱ به دلیل این موضوع استعفا داد. این حکم اکنون مرجع استاندارد در محافل سیاستگذاری اتحادیه اروپا برای این است که چرا هوش مصنوعی مبهم در محیطهای پرخطر، یک مسئله اخلاقی نرم نیست، بلکه یک مسئله حقوقی است.

چهار مورد. بخشهای مختلف، فناوریهای مختلف، کشورهای مختلف. الگوی یکسان: یک سیستم مبهم، یک تصمیم مهم، و افرادی که در سمت گیرنده هستند و هیچ راه واقعی برای مقابله با آن ندارند.

ریسک هوش مصنوعی جعبه سیاه در سیستمهای هوش مصنوعی دنیای واقعی

وقتی شروع به فهرستبندی ریسک هوش مصنوعی جعبه سیاه در سیستمهای هوش مصنوعی دنیای واقعی میکنید، الگویی ظاهر میشود. پنج ریسک یکسان بارها و بارها ظاهر میشوند، صرف نظر از اینکه مدل یک امتیازدهنده اعتباری، یک ربات چت یا یک سیستم معاملات الگوریتمی باشد.

| ریسک | چه شکلی است؟ | چرا مقیاسپذیر است؟ |

|---|---|---|

| تعصب پنهان | مدل با گروههای محافظتشده رفتار متفاوتی دارد | دادههای آموزشی حاوی الگوهای تاریخی هستند |

| توهم | مدل، حقایق یا استنادها را ابداع میکند | LLM ها برای روان بودن بهینه سازی می کنند، نه برای حقیقت |

| یادگیری میانبر | مدل به همبستگیهای نامربوط متکی است | یادگیری آسانتر از مفهوم واقعی |

| شکنندگی خصمانه | تغییر کوچک ورودی، خروجی را تغییر میدهد | مرزهای تصمیمگیری با ابعاد بالا |

| تجزیه و تحلیل حسابرسی | نمیتوان چرایی را بازسازی کرد | هیچ حالت داخلی قابل تفسیری وجود ندارد |

این خطرات در سیستمهای هوش مصنوعی جعبه سیاه که در امور مالی، استخدام، مراقبتهای بهداشتی و ارزهای دیجیتال استفاده میشوند، وجود دارند. فرآیندهای پیچیده یادگیری عمیق درون آنها، پیشبینی محل شکست بعدی را دشوار میکند و ابزارهای سنتی هوش مصنوعی برای تضمین کیفیت (QA) برای مدلهایی با صدها میلیارد پارامتر ساخته نشدهاند.

تعصب پنهان تیتر خبرها میشود، اما شکنندگی خصمانه و شکست حسابرسی، مسائل بلندمدت بزرگتری هستند. حداقل میتوان تعصب پایدار را اندازهگیری و اصلاح کرد. مدلی که هر بار که اجرا میشود، به طور متفاوتی شکست میخورد (کاری که ChatGPT انجام میدهد، تقریباً در ۴۲٪ از وظایف ارزیابی قرارداد هوشمند طبق یک مطالعه ACM TOSEM در سال ۲۰۲۴) برای استفاده تنظیمشده، بسیار دشوارتر است.

جدیدترین مورد وارد شده به این لیست چیزی است که محققان آن را «ریسک هوش مصنوعی عاملمحور» مینامند. وقتی یک LLM را به ابزارها متصل میکنید، به آن حافظه میدهید و اجازه میدهید APIها را فراخوانی کند، ابهام را افزایش میدهید. اکنون یک تصمیم واحد به زنجیرهای از فراخوانیهای مدل، اسناد بازیابی شده و فراخوانیهای ابزار تبدیل میشود که هر یک از آنها تا حدی مبهم هستند. عاملهای مدرن جعبههای سیاهی درون جعبههای سیاه هستند.

هوش مصنوعی جعبه سیاه در ارزهای دیجیتال و فینتک

از بین هر صنعتی که از هوش مصنوعی جعبه سیاه استفاده میکند، کریپتو و فینتک جایی هستند که جنبهی استقرار و جنبهی ریسک بیشترین برخورد را دارند. ریسکها زیاد هستند. تأخیر کم است. افشاگری کم است. مقررات، به خصوص در کریپتو، هنوز هم ناهمگون است. نتیجه، محیطی است که در آن ابتدا استقرار و سپس نوشتن مستندات ارجحیت دارد.

معاملات الگوریتمی. معاملات الگوریتمی تخمین زده میشود که ۷۰ تا ۸۰ درصد از حجم معاملات ارزهای دیجیتال در سال ۲۰۲۵ را به خود اختصاص داده است، که بالاتر از سهم ۶۰ تا ۷۰ درصدی در بازارهای سهام اصلی است. وینترمیوت به تنهایی بیش از ۱۵ میلیارد دلار را در بیش از ۶۰ مکان در یک روز به طور متوسط جابجا میکند، و رکورد ۲.۲۴ میلیارد دلار حجم معاملات یک روزه در سال ۲۰۲۵ گزارش شده است. استراتژیهای پشت این جریانها، مجموعههای یادگیری عمیق هستند که هیچ ناظر خارجی نمیتواند آنها را بررسی کند. فروپاشی آلامدا/FTX در نوامبر ۲۰۲۲، واضحترین نمونه از این ریسک است: کل ارزش بازار ارزهای دیجیتال تقریباً در عرض یک ماه از بیش از ۱ تریلیون دلار به زیر ۸۰۰ میلیارد دلار کاهش یافت و ریسک ۱۴.۶ میلیارد دلاری FTT در ترازنامه آلامدا تا آن لحظه که دیگر وجود نداشت، نامرئی بود.

امتیازدهی AML و KYC. بازار جهانی نرمافزارهای ضد پولشویی در سال ۲۰۲۵ به ۴.۱۳ میلیارد دلار رسید و پیشبینی میشود تا سال ۲۰۳۰ به ۹.۳۸ میلیارد دلار برسد (MarketsandMarkets). انطباق با AML/KYC ارزهای دیجیتال به طور خاص با نرخ رشد مرکب سالانه ۱۳.۸ درصد رشد میکند. فروشندگانی مانند ComplyAdvantage، Chainalysis Reactor و Elliptic Navigator اکنون از مدلهای یادگیری ماشین جعبه سیاه برای امتیازدهی ریسک کیف پول استفاده میکنند. استفاده از یادگیری ماشین جعبه سیاه در اینجا به اندازه کافی گسترده و مؤثر است که در اکثر صرافیهای بزرگ به کار گرفته میشود و به اندازه کافی مبهم است که مأموران انطباق اغلب نمیتوانند دلیل مسدود شدن یک کیف پول خاص را بازسازی کنند.

حسابرسی قراردادهای هوشمند. اینجاست که محدودیتهای هوش مصنوعی به وضوح خود را نشان میدهد. یک مطالعه arXiv در سال ۲۰۲۴، GPT-4 را در تشخیص آسیبپذیری قراردادهای هوشمند ارزیابی کرد. این روش به دقت ۹۶.۶٪ اما تنها ۳۷.۸٪ بازیابی رسید و تقریباً دو سوم نقصهای واقعی را از دست داد. خروجیهای ChatGPT در ۴۲٪ از قراردادها در طول اجرا ناپایدار هستند (ACM TOSEM 2024). ابزارهای ترکیبی مانند GPTScan که GPT را با تجزیه و تحلیل استاتیک جفت میکنند، در قراردادهای توکن از دقت ۹۰٪ و بازیابی حدود ۷۰٪ فراتر میروند (arXiv 2308.03314). CertiK Skynet اکنون بیش از ۱۷۰۰۰ پروژه و تقریباً ۴۹۴ میلیارد دلار ارزش بازار را رصد میکند، اما هر تیم حسابرسی مسئول هنوز هوش مصنوعی را با یک بررسیکننده انسانی جفت میکند.

مشاوران رباتیک. Betterment بیش از ۵۶ میلیارد دلار را در بیش از ۹۰۰۰۰۰ حساب مدیریت میکند. Wealthfront ۴۲.۹ میلیارد دلار ارزش دارد. صنعت مشاوران رباتیک از مرز ۱ تریلیون دلار در داراییهای تحت مدیریت جهانی عبور کرده است. متعادلسازی مجدد پرتفوی، برداشت زیان مالیاتی و امتیازدهی ریسک، همگی توسط مدلهای یادگیری ماشینی هدایت میشوند که تصمیمات خاص آنها در هیچ سند مربوط به خردهفروشی افشا نمیشود.

امتیازدهی اعتباری و تشخیص تقلب. FICO توسط ۹۰٪ از وامدهندگان آمریکایی استفاده میشود و FICO Falcon سالانه بیش از ۶۵ میلیارد تراکنش را با نرخ تشخیص تقلب بیش از ۹۵٪ پردازش میکند. مطالعهای که بانک انگلستان در سال ۲۰۲۴ روی ۵۰ موسسه بریتانیایی انجام داد، نشان داد که مدلهای ریسک اعتباری یادگیری ماشینی، طبقهبندیهای نادرست را نسبت به رگرسیون لجستیک تقریباً ۲۵٪ کاهش میدهند. افزایش دقت واقعی است. نکتهی منفی این است که طبق بخشنامههای CFPB 2022-03 و 2023-03، وامدهندگان آمریکایی نمیتوانند از مدلهایی که به اندازه کافی مبهم هستند استفاده کنند تا از توضیحات مربوط به اقدامات نامطلوب خاص تحت ECOA جلوگیری شود.

الگوی هر پنج مورد یکسان است. مدل از مدل پایه شفاف دقیقتر است. ابهام از نظر ساختاری از دقت جداییناپذیر است. و تنظیمکنندگان سریعتر از ابزارهای توضیحپذیری در حال جبران عقبماندگی هستند.

یادداشتی در مورد هوش مصنوعی جعبه سیاه: دوره کدنویسی LLM

یک ابهامزدایی سریع. وقتی افراد عبارت «blackbox AI» را جستجو میکنند، اغلب منظورشان مشکل مفهومی است که این مقاله در مورد آن است. گاهی اوقات منظورشان Blackbox AI، شرکت blackbox.ai است. Blackbox.ai یک LLM کدنویسی است که برای تغییر نحوه کدنویسی توسعهدهندگان طراحی شده است. این محصول با VS Code به عنوان یک عامل کدنویسی ادغام میشود، کد را پیشنهاد میدهد و با ابزارهایی مانند Claude Code، GitHub Copilot و Cursor رقابت میکند. این یکی از فناوریهای پیشرفته هوش مصنوعی شناختهشدهتر در فضای کدنویسی هوش مصنوعی است که بر اساس چندین مدل هوش مصنوعی ساخته شده است و کدی که Blackbox پیشنهاد میدهد همه چیز را از اصلاح کد گرفته تا چارچوببندی تست پوشش میدهد. Blackbox تولید کد، چت و جستجو را در یک گردش کار ادغام میکند و اکثر کاربران آن را بهترین دستیار هوش مصنوعی میدانند که در ویرایشگر خود امتحان کردهاند.

این دو معنی اغلب در نتایج جستجو با هم در هم میآمیزند. محصول Blackbox AI موضوع این مقاله نیست. ما به بررسی ویژگی ساختاری سیستمهای هوش مصنوعی مبهم میپردازیم، نه به یک دستیار کدنویسی واحد. اگر این محصول را جستجو کردهاید، شرکت مستندات و قیمتگذاری خود را دارد. اگر این مفهوم را جستجو کردهاید، به خواندن ادامه دهید.

هوش مصنوعی قابل توضیح و ابزارهای قابل توضیح

هوش مصنوعی قابل توضیح، که معمولاً به اختصار XAI نامیده میشود، حوزهای است که سعی میکند مدلهای مبهم هوش مصنوعی را بدون از بین بردن دقت آنها، رمزگشایی کند. این حوزه اکنون نیز یک بازار واقعی است. پیشبینیها برای سال ۲۰۲۶ بین ۹ تا ۱۳ میلیارد دلار در سطح جهان است و این شکاف بسته به تعریف کدام XAI مورد قبول شماست. هدف این است که مدلهای هوش مصنوعی بدون مجبور کردن تیمها به بازگشت به خطوط پایه کندتر یا کمدقتتر، قابل توضیحتر شوند. تیمهای هوشمند این ابزارها را قبل از انتشار روی ابزارهای هوش مصنوعی اجرا میکنند و خروجی را با مستنداتی که یک بررسیکننده انسانی میتواند بخواند، جفت میکنند.

سه خانواده از تکنیکهای XAI ارزش آشنایی دارند.

اولین مورد SHAP است که مخفف SHApley Additive Explanations (توضیحات افزایشی SHApley) است. این روش از نظریه بازیهای مشارکتی وام گرفته شده است: برای هر پیشبینی، SHAP به هر ویژگی ورودی یک امتیاز سهم اختصاص میدهد. تیمهای امتیازدهی اعتباری آن را دوست دارند. تیمهای تشخیص تقلب آن را دوست دارند. مدلسازان ریسک مراقبتهای بهداشتی آن را تحمل میکنند. SHAP از نظر تئوری دقیق است، اما از نظر محاسباتی در دادههای جدولی بزرگ، یک هیولا است.

مورد دوم LIME است، توضیحات مستقل از مدل تفسیرپذیر محلی. LIME یک مدل جایگزین ساده و تفسیرپذیر را حول یک پیشبینی واحد میسازد و از آن برای توضیح پیشبینی اصلی استفاده میکند. سریعتر از SHAP. روی متن، تصاویر و جداول کار میکند. نکته این است که LIME از نظر طراحی محلی است، بنابراین اگر فرض کنید یک توضیح تعمیمپذیر است، میتواند شما را گمراه کند.

سوم، توضیحات خلاف واقع است. به جای اینکه به شما بگویند چرا مدل پاسخ مثبت داده است، توضیحات خلاف واقع کوچکترین تغییر ورودی را که میتوانست پاسخ را به نه تغییر دهد، به شما میگویند. این دقیقاً همان چیزی است که یک متقاضی اعتبار یا یک تراکنش علامتگذاری شده میخواهد بداند: "چه چیزی را باید تغییر دهم؟" توضیحات خلاف واقع به سرعت در اطلاعیههای مربوط به اقدامات نامطلوب در حال افزایش هستند، دقیقاً به این دلیل که به طور واضح با انتظارات تنظیمکننده مطابقت دارند.

فراتر از این سه، نمودارهای اهمیت ویژگی، تجسم توجه برای لایههای تبدیلکننده و Grad-CAM برای طبقهبندیکنندههای تصویر را خواهید دید. تفسیرپذیری مکانیکی، عمل مهندسی معکوس نورونهای خاص و مدارهای توجه، در لبهی این حوزه قرار دارد. Anthropic، OpenAI و تعداد انگشتشماری از آزمایشگاههای دانشگاهی مدارهای جزئی را منتشر کردهاند، اما این کار هنوز به چیزی تبدیل نشده است که یک تیم انطباق سازمانی بتواند ارائه دهد.

در مورد اینکه همه اینها به کجا ختم میشود صادق باشید. تحقیقات صنعتی منتشر شده توسط Palo Alto Networks و دیگران نشان میدهد که XAI برای طبقهبندیکنندههای تصویر و مدلهای جدولی ساختاریافته خوب عمل میکند و فقط تا حدی برای LLMها. منطق درون یک مدل زبانی با تغییر موقعیت توکن و پنجره زمینه تغییر میکند، بنابراین نمرات انتساب ویژگی میتوانند به روشهایی گمراهکننده باشند که خود توضیح در مورد آنها به شما هشدار نمیدهد. ابزارهای توضیحپذیری که کد اصلی خود را به اشتراک میگذارند مفید هستند. آنها یک راه حل کامل برای مشکل جعبه سیاه نیستند.

تنظیم مقررات هوش مصنوعی جعبه سیاه: قانون هوش مصنوعی اتحادیه اروپا، NIST، CFPB

بیشتر فروشندگان هوش مصنوعی انتظار نداشتند که نهادهای نظارتی به این سرعت اقدام کنند. اما این اتفاق افتاد. طرز فکر قدیمی «الان ارسال کن، بعداً مستند کن» در حال منسوخ شدن است و دلیل آن تعداد کمی از قوانین است.

اروپا اولین کسی بود که با قانون هوش مصنوعی اتحادیه اروپا به این مرحله رسید. این قانون به صورت مرحلهای در طول سالهای ۲۰۲۵ تا ۲۰۲۷ اجرا میشود، نه یک تغییر واحد. اقدامات ممنوعه در ۲ فوریه ۲۰۲۵ لازمالاجرا شدند. قوانین عمومی هوش مصنوعی در ۲ آگوست ۲۰۲۵ اعمال شدند. تعهدات سیستمی پرخطر از ۲ آگوست ۲۰۲۶ اعمال میشوند و تمدید محصولات تحت نظارت یک سال پس از آن، در ۲ آگوست ۲۰۲۷، اعمال میشود. جریمهها نمایشی نیستند. ۳۵ میلیون یورو یا ۷٪ از گردش مالی جهانی برای جدیترین تخلفات، ۱۵ میلیون یورو یا ۳٪ برای بقیه (DLA Piper، ۲۰۲۵). و فهرست موارد استفاده پرخطر مانند فهرست کامل موارد استفاده از جعبه سیاه است: امتیازدهی اعتباری، استخدام، آموزش، اجرای قانون، شناسایی بیومتریک. اکنون هر یک از این موارد به طور پیشفرض نیاز به مستندسازی، شفافیت و نظارت انسانی دارند.

تصویر آمریکا آشفتهتر است اما در همان جهت حرکت میکند. چارچوب مدیریت ریسک هوش مصنوعی NIST نزدیکترین چیز به یک مبنای آمریکایی است. این چارچوب که در ژانویه ۲۰۲۳ منتشر شد و در سالهای ۲۰۲۴ و ۲۰۲۵ گسترش یافت، بیسروصدا به سندی تبدیل شده است که شرکتهای بزرگ، چه از نظر فنی و چه غیر فنی، خود را با آن تطبیق میدهند. دسامبر ۲۰۲۵، NIST IR 8596، پیشنویس اولیه پروفایل هوش مصنوعی سایبری، را به همراه داشت و کارگاه آموزشی بعدی در ۱۴ ژانویه ۲۰۲۶ برگزار شد. بسیاری از تیمها در حال حاضر آن را پذیرفتهاند.

اداره حمایت مالی مصرفکننده رکتر عمل کرده است. بخشنامههای 2022-03 و 2023-03 مستقیماً این را میگویند: یک طلبکار نمیتواند از یک الگوریتم پیچیده استفاده کند اگر پیچیدگی آن مانع از ارائه دلایل خاص برای اقدام نامطلوب تحت ECOA و آییننامه B شود. آن را با دقت بخوانید. این ممنوعیت یادگیری ماشینی در وامدهی نیست. این ممنوعیت یادگیری ماشینی آنقدر مبهم است که نمیتوانید به متقاضی رد شده بگویید چه اشتباهی مرتکب شده است. در واقع، این یک ممنوعیت جعبه سیاه برای اعتبار مصرفکننده است.

بانکها با یک الزام قدیمیتر اما همچنان سختتر مواجه هستند. SR 11-7 فدرال رزرو، که از سال ۲۰۱۱ در دفاتر ثبت شده است، بانکها را مجبور میکند تا نشان دهند که هر مدلی را که منجر به یک تصمیم اساسی میشود، درک میکنند. سیستمهای یادگیری عمیق مدرن تلاش میکنند تا بدون کمک از این مانع عبور کنند و بولتن OCC 2011-12 نیز همین رویکرد را اعمال میکند.

نتیجه نهایی: هیچ نهاد تحت نظارتی در ایالات متحده یا اتحادیه اروپا دیگر بهانهای برای در نظر گرفتن ابهام به عنوان یک بدهبستان قابل قبول برای دقت ندارد. یا قابلیت تفسیر از اولین بررسی طراحی مهندسی میشود، یا شما یک مدل ترکیبی میسازید که در آن یک انسان توضیحی را که مدل نمیتواند، حمل میکند. هیچ راه سومی وجود ندارد که از یک اقدام اجرایی جان سالم به در ببرد.

چگونه یک سیستم هوش مصنوعی جعبه سیاه را حسابرسی کنیم

بنابراین، استقرار مسئولانه یک سیستم هوش مصنوعی جعبه سیاه در سال ۲۰۲۶ چگونه خواهد بود؟ دستورالعملهای عملی کوتاهتر از آن چیزی است که فروشندگان وانمود میکنند.

شما با دادهها شروع میکنید. مستند کنید که دادههای آموزشی از کجا آمدهاند، چه کسی آنها را برچسبگذاری کرده است و کدام زیرگروهها نمایش داده میشوند. تقریباً نیمی از مشکلات سوگیری که بعداً با آنها مواجه خواهید شد، در اینجا کدگذاری شدهاند و نیمی که نمیتوانید ردیابی کنید، نیمی است که نمیتوانید اصلاح کنید.

سپس مدل را در تیم قرمز قرار میدهید. آن را با ورودیهای تخاصمی، تزریقهای سریع، موارد حاشیهای و نمونههای خارج از توزیع بررسی میکنید. آنتروپیک، OpenAI و مایکروسافت اکنون کتابهای راهنمای این کار را منتشر میکنند که میتوانید بدون اختراع روش جدید، آنها را تطبیق دهید.

XAI را روی هر مدل در حال تولید اعمال کنید، نه فقط مدلهای اصلی. SHAP را برای خطوط لوله جدولی. LIME را برای متن و تصاویر. ابزارهای خلاف واقع را برای هر تصمیمی که به کاربر برمیگردد. هیچ یک از این ابزارها کامل نیستند. از سوی دیگر، نبود آنها برای هر حسابرسی که وارد پشته شما میشود، یک پرچم قرمز است.

مراقب انحراف باشید. مدلها سریعتر از آنچه اکثر تیمها انتظار دارند، کهنه میشوند. توزیع ورودیها، توزیع خروجیها و نتایج پاییندستی را پیگیری کنید. برای هر کدام هشدار تنظیم کنید و تغییرات غیرقابل توضیح را به عنوان حادثه، نه یک کنجکاوی، در نظر بگیرید.

قبل از اینکه به آن نیاز پیدا کنید، مسیر ارجاع را بسازید. هر تصمیم مدلِ مهم باید یک جایگزین انسانی و یک کانال درخواست تجدیدنظر مستند داشته باشد که مشتری بتواند واقعاً از آن استفاده کند. اگر تیم پشتیبانی شما کانال درخواست تجدیدنظر است، آن را نیز بنویسید.

در آخر، خودتان را با چارچوبی که اعمال میشود، تطبیق دهید. اگر در ایالات متحده هستید، NIST AI RMF. اگر در اروپا هستید، EU AI Act الزامات پرخطر. اگر اصلاً به اعتبار مصرفکننده دست میزنید، بخشنامههای CFPB 2022-03 و 2023-03. انجام این کار یک بار و در مراحل اولیه، به طور چشمگیری ارزانتر از مقاومسازی پس از دریافت یک اقدام اجرایی است.

شما جعبه سیاه را حذف نخواهید کرد. اشکالی ندارد. وظیفه این است که آن را قابل مشاهده، پاسخگو و محدود کنید. این استانداردی است که تنظیمکنندگان در حال حاضر اجرا میکنند و این همان چیزی است که استقرار بالغ در سال 2026 به نظر میرسد.