Cos`è l`IA a scatola nera? Il problema della scatola nera spiegato.

Nell'aprile del 2026, la classifica delle allucinazioni di Vectara ha fornito un verdetto alquanto imbarazzante. I migliori modelli linguistici ora allucinano meno del 4% delle volte nel test principale. Ma le nuove varianti di "ragionamento" di GPT-5, Claude Sonnet 4.5, Grok-4 e Gemini-3-Pro allucinano tutte in oltre il 10% dei casi sul nuovo dataset. Grok-4-fast-reasoning ha raggiunto il 20,2%. I modelli più intelligenti, quelli che "pensano" prima di rispondere, sono i peggiori nell'ammettere quando non sanno.

Questo è il problema della scatola nera, riassunto in un paragrafo. Abbiamo creato sistemi di intelligenza artificiale che spesso producono risultati utili, ma che nessuno, nemmeno i loro creatori, è in grado di spiegare completamente. Sono precisi senza essere calibrati, fluidi senza essere onesti e sicuri di sé senza essere corretti.

Le autorità di regolamentazione se ne sono accorte. L'AI Act dell'UE ora prevede sanzioni fino a 35 milioni di euro o il 7% del fatturato globale per gli usi proibiti, con le norme sui sistemi ad alto rischio che entreranno in vigore il 2 agosto 2026. Il Consumer Financial Protection Bureau statunitense ha chiaramente comunicato alle banche che non possono utilizzare algoritmi complessi se questi impediscono loro di spiegare un rifiuto di credito. E il settore dell'intelligenza artificiale spiegabile, un argomento di nicchia cinque anni fa, è ora un mercato stimato tra i 9 e i 13 miliardi di dollari nel 2026.

Questa guida illustra cos'è effettivamente l'IA a scatola nera, perché anche i modelli di IA apparentemente semplici diventano scatole nere, cosa succede quando ciò accade, dove si manifesta nel mondo delle criptovalute e del fintech, come il toolkit per l'IA spiegabile (SHAP, LIME, controfattuali) cerca di decifrarle e cosa è importante sapere sul nuovo regime normativo nell'UE e negli Stati Uniti. È presente anche una breve digressione per chiarire un equivoco ricorrente: l'IA a scatola nera, l'assistente di programmazione di blackbox.ai, è una cosa diversa.

Cos'è l'IA a scatola nera e perché è importante?

Per IA a scatola nera si intende qualsiasi sistema di intelligenza artificiale il cui ragionamento interno è opaco agli utenti e, spesso, anche agli sviluppatori che lo hanno creato. Input e output sono visibili, ma il percorso tra di essi è nascosto all'interno di strati di pesi, schemi appresi e trasformazioni di apprendimento automatico che nessun essere umano è in grado di decifrare completamente. Lo stesso principio si applica sia che il modello gestisca dati tabellari, immagini o attività di elaborazione del linguaggio naturale come la traduzione e la chat.

L'espressione "scatola nera" è più antica del moderno deep learning. Gli ingegneri usano il termine "scatola nera" almeno dagli anni '60 per indicare qualsiasi sistema che si possa esaminare dall'esterno ma non smontare. Il cervello umano stesso, come amano sottolineare i biologi, è anch'esso una scatola nera, ma il paragone ha i suoi limiti: un'IA non funziona come un essere umano, e presumere che lo faccia è uno dei modi più rapidi per fraintendere il significato di "IA a scatola nera". Ciò che è cambiato nell'ultimo decennio è la scala. Un moderno modello linguistico di grandi dimensioni può contenere centinaia di miliardi di parametri. Una tipica rete neurale profonda distribuisce la "conoscenza" su migliaia di strati e milioni di centri di attenzione, con singoli neuroni che codificano simultaneamente molteplici pattern non correlati. I ricercatori chiamano quest'ultima proprietà polisemanticità, ed è uno dei motivi per cui l'interpretabilità meccanicistica è ancora agli albori.

Perché dovrebbe interessare a qualcuno al di fuori dei laboratori di ricerca? Perché l'intelligenza artificiale a scatola nera sta ormai guidando decisioni di grande importanza. Approva e nega il credito. Valuta gli imputati. Segnala le transazioni come fraudolente. Gestisce una quota considerevole del volume di scambi su ogni principale piattaforma di scambio di criptovalute. Quando commette un errore, l'opacità rende quasi impossibile scoprirne la causa, porvi rimedio o individuare i responsabili.

È importante anche perché la governance dell'IA non considera più l'opacità un problema degli sviluppatori. L'UE ora la considera una questione di accesso al mercato. Le autorità di regolamentazione statunitensi la considerano una questione di equità creditizia. Ogni dirigente che ha approvato un'iniziativa sull'IA dal 2024 si è imbattuto nello stesso ostacolo: cosa sta facendo effettivamente questo sistema e perché? Comprendere l'IA "a scatola nera" non è più un'opzione, e non si può risolvere il problema della scatola nera semplicemente cambiando fornitore.

Perché i modelli di IA diventano scatole nere

Non tutte le IA sono scatole nere. Un semplice albero decisionale è completamente trasparente. Un modello di regressione lineare restituisce coefficienti che si possono leggere. Persino un sistema di IA basato su regole degli anni '90 è, in linea di principio, verificabile riga per riga.

Come mai, dunque, i modelli di intelligenza artificiale odierni diventano delle scatole nere? Ciò accade per quattro ragioni che si sovrappongono.

Innanzitutto, la scala. I modelli di deep learning con milioni o miliardi di parametri operano in spazi ad alta dimensionalità che gli esseri umani non possono visualizzare. È possibile descrivere matematicamente un modello con 200 miliardi di parametri, ma nessuno può tenerlo a mente.

In secondo luogo, le rappresentazioni distribuite. In una rete neurale profonda, nessun singolo neurone memorizza "il concetto di gatto" o "la regola per rifiutare un prestito". I concetti si diffondono su migliaia di neuroni e i singoli neuroni partecipano simultaneamente a molti concetti. Ricavare una spiegazione precisa è un progetto di ricerca, non una semplice domanda.

In terzo luogo, la dipendenza dai dati di addestramento. Il comportamento del modello è plasmato dai dati di addestramento, che di solito sono proprietari, enormi e talvolta soggetti a problematiche legali. Anche quando uno sviluppatore pubblica i pesi del modello, i dati vengono raramente condivisi. Pertanto, manca una parte fondamentale del "perché".

In quarto luogo, l'intento. Esistono ragioni pratiche per utilizzare deliberatamente approcci a scatola nera. Alcuni sviluppatori e programmatori di IA nascondono intenzionalmente i dettagli interni dei modelli per proteggere la proprietà intellettuale, e altre ragioni per utilizzare design a scatola nera includono i termini di licenza e i vantaggi competitivi. Anche un modello open source può di fatto creare una scatola nera attorno alle sue decisioni, perché la maggior parte dei modelli moderni si basa su schemi emergenti che non vengono documentati. Un'azienda che ha investito 100 milioni di dollari in un modello non è desiderosa di pubblicare la sua architettura e la procedura di addestramento. Anche i modelli di IA open source che condividono il loro codice sorgente sono in definitiva delle scatole nere, perché gli utenti non possono ancora esaminare i pesi appresi con un'interpretazione significativa.

Il risultato è che persino modelli di IA avanzati apparentemente semplici, inclusi i modelli lineari generalizzati (LLM) e i modelli di IA generativa, diventano per definizione delle scatole nere. I modelli trasparenti sono l'eccezione, non la regola. Le complesse scatole nere possono offrire un'accuratezza impressionante, ed è per questo che i team continuano a implementarle nonostante l'opacità. Lo stesso vale per i modelli di IA a scatola nera addestrati su dati ricchi e disordinati: il vantaggio rispetto ai modelli di IA basati su regole è spesso sufficiente a prevalere sui problemi di interpretabilità, finché qualcosa non si rompe. La maggior parte delle moderne IA a scatola nera rimangono tali perché gli utenti non possono ancora ispezionare i pesi appresi. I modelli a pesi aperti condividono il codice sottostante e gli utenti possono leggerne l'architettura, ma il codice sottostante rimane comunque una scatola nera quando ci si chiede "perché il modello ha detto questo?".

Il problema della scatola nera nell'apprendimento profondo

Il problema della scatola nera è ciò che si ottiene quando queste quattro ragioni si sommano. Il modello funziona, spesso in modo impressionante. Ma funziona in un modo che resiste a tre cose contemporaneamente: spiegazione, validazione e correzione.

Prendiamo l'esempio classico: un modello di deep learning addestrato per identificare i panda. Ottiene un punteggio del 99% sul set di test. Sembra perfetto. Poi qualcuno esegue uno strumento di interpretabilità e scopre che il modello in realtà non sta guardando il panda. Sta prestando attenzione al bambù. La maggior parte delle fotografie di panda nei dati di addestramento contiene anche bambù. Il modello ha imparato una scorciatoia. Su una fotografia di panda senza bambù, il modello fallisce.

Questo tipo di "apprendimento per scorciatoie" è onnipresente nel deep learning. Il modello individua una regolarità statistica che non corrisponde al concetto sottostante, ma ce ne accorgiamo solo quando il mondo reale appare leggermente diverso dal set di addestramento. La crisi finanziaria del 2008 è un esempio storico calzante. I modelli Value-at-Risk basati su ipotesi gaussiane funzionavano perfettamente nei mercati normali, ma crollavano in condizioni estreme, perché avevano appreso delle scorciatoie di cui i modellisti non si rendevano conto.

I modelli di deep learning odierni presentano esattamente la stessa modalità di fallimento, con più parametri e maggiore affidabilità. I ricercatori nel campo dell'interpretabilità meccanicistica, tra cui team di Anthropic e OpenAI, hanno iniziato a decostruire, neurone per neurone, piccole parti dei modelli linguistici. Il loro lavoro dimostra che l'interno di un LLM è più simile a circuiti intricati che a una logica ordinata. Non esiste un punto preciso in cui si possa individuare la soluzione. Il problema della scatola nera non è un bug da correggere, ma un problema strutturale.

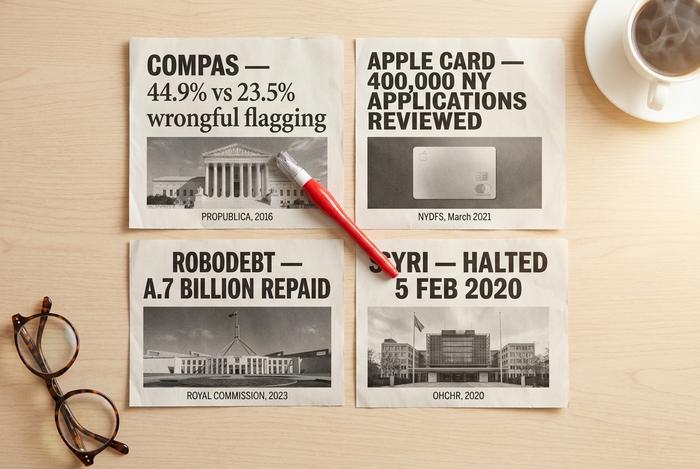

Esempi di IA a scatola nera: COMPAS, Apple Card, Robodebt, SyRI

Volete vedere che aspetto ha un'IA a scatola nera quando fallisce? I quattro casi che tutti citano vi dicono quasi tutto quello che dovete sapere. Riguardano la giustizia penale, il settore bancario e il welfare. Tutti hanno danneggiato persone reali. E nessuno di loro ha fallito nello stesso modo.

Partiamo da COMPAS. Northpointe lo ha creato per prevedere se un imputato avrebbe commesso nuovamente un reato, e i tribunali statunitensi lo hanno ampiamente adottato. Poi ProPublica ha esaminato i dati. La loro analisi del 2016 ha esaminato oltre 7.000 persone arrestate nella contea di Broward e il risultato è stato sconcertante: gli imputati neri sono stati erroneamente classificati come ad alto rischio nel 44,9% dei casi, mentre la percentuale per gli imputati bianchi era solo del 23,5%. Un successivo studio del 2024 ha peggiorato ulteriormente la situazione. Due parametri (età e precedenti penali) eguagliavano l'accuratezza dei 137 parametri di COMPAS. Quindi la complessità non ha apportato alcun segnale aggiuntivo, ma ha reso molto più difficile individuare il pregiudizio. Questo è il classico modello a scatola nera che valuta le persone anziché i prodotti. Il modello a scatola che valuta i candidati a un posto di lavoro, quello che Amazon ha abbandonato nel 2018, ha la stessa forma.

Poi, alla fine del 2019, è arrivata la Apple Card. Wozniak ha affermato che a sua moglie era stato concesso un limite di credito dieci volte inferiore al suo. Anche David Heinemeier Hansson ha confermato la stessa cosa. La notizia è diventata virale. Il Dipartimento dei Servizi Finanziari di New York l'ha presa sul serio: ha esaminato circa 400.000 richieste. Nel marzo 2021, ha emesso un verdetto di assenza di discriminazione di genere ai sensi di legge. Tuttavia, ha anche scritto, e questo è il punto cruciale, che l'opacità dell'esperienza del cliente rappresentava di per sé un problema di fiducia. Il danno derivante dalla "scatola nera", a quanto pare, dipende per metà dai risultati e per metà dalla percezione. Un comunicato stampa non risolve il problema della percezione.

Il Robodebt è l'altra faccia della medaglia. Nessuna rete neurale profonda coinvolta. L'Australia ha applicato una regola di mediazione del reddito ai dati relativi all'assistenza sociale tra il 2016 e il 2019, accusando circa 400.000 beneficiari di frode, e non è stata in grado di spiegare in modo coerente il calcolo a nessuno di coloro che hanno ricevuto la lettera. Una Commissione Reale ha successivamente dichiarato il sistema illegale. Il governo ha restituito 1,7 miliardi di dollari australiani più altri 112 milioni di dollari australiani a titolo di risarcimento. Morale della favola: un sistema non ha bisogno di essere tecnicamente sofisticato per essere una scatola nera. Deve solo essere privo di responsabilità.

Il caso olandese "Toeslagenaffaire" e SyRI rappresentano i due estremi della vicenda europea. Il 5 febbraio 2020, un tribunale olandese ha ordinato l'immediata sospensione di SyRI, stabilendo che la sua opacità violava l'articolo 8 della Convenzione europea dei diritti dell'uomo. Il relativo scandalo relativo agli assegni familiari ha coinvolto oltre 20.000 genitori ingiustamente accusati di frode. Il governo Rutte si è dimesso nel gennaio 2021 a seguito di questa vicenda. Tale sentenza è ora il punto di riferimento standard negli ambienti politici dell'UE per dimostrare perché l'opacità dell'intelligenza artificiale in contesti ad alto rischio non sia una questione di etica marginale, bensì legale.

Quattro casi. Settori diversi, tecnologie diverse, paesi diversi. Stesso schema: un sistema opaco, una decisione dalle conseguenze importanti e persone che ne subiscono le conseguenze senza un reale modo di opporsi.

Rischi dell'IA a scatola nera nei sistemi di IA del mondo reale

Una volta che si inizia a catalogare i rischi dell'IA "a scatola nera" nei sistemi di IA reali, emerge uno schema. Gli stessi cinque rischi si ripresentano continuamente, indipendentemente dal fatto che il modello sia un sistema di valutazione del credito, un chatbot o un sistema di trading algoritmico.

| Rischio | Che aspetto ha | Perché è scalabile |

|---|---|---|

| pregiudizi nascosti | Il modello tratta i gruppi protetti in modo diverso | I dati di training contengono modelli storici |

| Allucinazione | Il modello inventa fatti o citazioni | I modelli LLM sono ottimizzati per la fluidità, non per la verità. |

| Apprendimento rapido | Il modello si basa su correlazioni irrilevanti | Più facile da imparare del concetto reale |

| fragilità avversaria | Una piccola variazione nell'input inverte l'output | Confini decisionali ad alta dimensionalità |

| guasto all'acustica | Non riesco a ricostruire il perché | Nessuno stato interno interpretabile |

Questi rischi si moltiplicano nei sistemi di intelligenza artificiale "a scatola nera" utilizzati in finanza, reclutamento, sanità e criptovalute. I complessi processi di apprendimento profondo al loro interno rendono difficile prevedere dove si verificherà il prossimo errore, e i tradizionali strumenti di intelligenza artificiale per il controllo qualità non sono stati progettati per modelli con centinaia di miliardi di parametri.

I pregiudizi nascosti fanno notizia, ma la fragilità delle contraddizioni e i fallimenti degli audit rappresentano i problemi più importanti a lungo termine. Un pregiudizio stabile può almeno essere misurato e corretto. Un modello che fallisce in modo diverso ogni volta che viene eseguito (come fa ChatGPT, in circa il 42% delle attività di valutazione degli smart contract secondo uno studio ACM TOSEM del 2024) è molto più difficile da certificare per l'uso regolamentato.

L'ultima aggiunta a questa lista è ciò che i ricercatori definiscono "rischio dell'IA agentiva". Quando si integra un modello di apprendimento basato su logica (LLM) con degli strumenti, gli si fornisce memoria e gli si permette di chiamare le API, si aumenta l'opacità. Una singola decisione diventa così una catena di invocazioni del modello, documenti recuperati e chiamate agli strumenti, ognuna delle quali parzialmente opaca. Gli agenti moderni sono scatole nere dentro altre scatole nere.

L'intelligenza artificiale a scatola nera nel settore delle criptovalute e del fintech.

Tra tutti i settori che utilizzano l'IA a scatola nera, le criptovalute e il fintech sono quelli in cui la fase di implementazione e quella di gestione del rischio si scontrano più duramente. La posta in gioco è alta. La latenza è breve. La trasparenza è scarsa. La regolamentazione, soprattutto nel settore delle criptovalute, è ancora frammentaria. Il risultato è un ambiente che premia l'implementazione immediata e la successiva redazione della documentazione.

Trading algoritmico. Si stima che il trading algoritmico abbia generato il 70-80% del volume di criptovalute nel 2025, una percentuale superiore al 60-70% registrato nei principali mercati azionari. Wintermute da sola movimenta oltre 15 miliardi di dollari al giorno su più di 60 piattaforme, con un volume record di 2,24 miliardi di dollari in un singolo giorno, registrato nel 2025. Le strategie alla base di questi flussi sono algoritmi di deep learning che nessun osservatore esterno può verificare. Il crollo di Alameda/FTX nel novembre 2022 è l'esempio più lampante del rischio: la capitalizzazione totale del mercato delle criptovalute è crollata da oltre 1.000 miliardi di dollari a meno di 800 miliardi di dollari in circa un mese, e l'esposizione di 14,6 miliardi di dollari di FTT nel bilancio di Alameda è rimasta invisibile fino al momento in cui è diventata evidente.

Valutazione del rischio AML e KYC. Il mercato globale dei software antiriciclaggio ha raggiunto i 4,13 miliardi di dollari nel 2025 e si prevede che raggiungerà i 9,38 miliardi di dollari entro il 2030 (MarketsandMarkets). La conformità AML/KYC nel settore delle criptovalute, in particolare, cresce a un tasso annuo composto (CAGR) del 13,8%. Fornitori come ComplyAdvantage, Chainalysis Reactor ed Elliptic Navigator utilizzano ora modelli di machine learning "a scatola nera" per la valutazione del rischio dei wallet. L'uso del machine learning "a scatola nera" in questo ambito è sufficientemente diffuso ed efficace da essere implementato nella maggior parte dei principali exchange, e al contempo abbastanza opaco da impedire spesso ai responsabili della conformità di ricostruire il motivo per cui uno specifico wallet è stato bloccato.

Audit dei contratti intelligenti. È qui che i limiti dell'IA emergono chiaramente. Uno studio del 2024 pubblicato su arXiv ha valutato GPT-4 per il rilevamento delle vulnerabilità dei contratti intelligenti. Ha raggiunto una precisione del 96,6%, ma solo un recall del 37,8%, non rilevando quasi due terzi dei difetti reali. Gli output di ChatGPT risultano instabili tra le diverse esecuzioni nel 42% dei contratti (ACM TOSEM 2024). Strumenti ibridi come GPTScan, che combinano GPT con l'analisi statica, superano il 90% di precisione e circa il 70% di recall sui contratti token (arXiv 2308.03314). CertiK Skynet monitora attualmente oltre 17.000 progetti e circa 494 miliardi di dollari di valore di mercato, ma ogni team di audit responsabile affianca ancora all'IA un revisore umano.

I robo-advisor. Betterment gestisce oltre 56 miliardi di dollari su più di 900.000 conti. Wealthfront ne gestisce 42,9 miliardi. Il settore dei robo-advisor ha superato i 1.000 miliardi di dollari di asset in gestione a livello globale. Il ribilanciamento del portafoglio, la compensazione delle minusvalenze e la valutazione del rischio sono tutti basati su modelli di machine learning le cui decisioni specifiche non sono divulgate in alcun documento destinato ai clienti al dettaglio.

Valutazione del credito e rilevamento delle frodi. FICO è utilizzato dal 90% degli istituti di credito statunitensi e FICO Falcon elabora oltre 65 miliardi di transazioni all'anno con tassi di rilevamento delle frodi superiori al 95%. Uno studio della Banca d'Inghilterra condotto nel 2024 su 50 istituzioni del Regno Unito ha rilevato che i modelli di rischio di credito basati sull'apprendimento automatico hanno ridotto le errate classificazioni di circa il 25% rispetto alla regressione logistica. Il guadagno in termini di accuratezza è reale. Il compromesso è che, in base alle circolari CFPB 2022-03 e 2023-03, gli istituti di credito statunitensi non possono utilizzare modelli sufficientemente opachi da impedire specifiche spiegazioni di azioni avverse ai sensi dell'ECOA.

Lo schema si ripete in tutti e cinque i casi. Il modello è più accurato rispetto al modello di riferimento trasparente. L'opacità è strutturalmente inseparabile dall'accuratezza. E gli enti regolatori si stanno adeguando più rapidamente degli strumenti di interpretazione.

Nota sull'IA a scatola nera: il Master in Coding

Una breve precisazione. Quando le persone cercano "blackbox AI", spesso si riferiscono al problema concettuale trattato in questo articolo. A volte, però, si riferiscono a Blackbox AI, l'azienda di cui al sito blackbox.ai. Blackbox.ai è un LLM (Learning Learning Model) per la programmazione, progettato per trasformare il modo in cui gli sviluppatori scrivono codice. Il prodotto si integra con VS Code come agente di programmazione, suggerisce codice e compete con strumenti come Claude Code, GitHub Copilot e Cursor. È una delle tecnologie di intelligenza artificiale avanzata più conosciute nel settore della programmazione basata sull'IA, costruita su diversi modelli di IA, e il codice suggerito da Blackbox copre ogni aspetto, dal refactoring alla creazione di test. Blackbox integra generazione di codice, chat e ricerca in un unico flusso di lavoro, e la maggior parte degli utenti lo considera il miglior assistente IA che abbiano mai provato all'interno del proprio editor.

I due significati spesso si confondono nei risultati di ricerca. Il prodotto Blackbox AI non è l'oggetto di questo articolo. Ci concentriamo sulla proprietà strutturale dei sistemi di intelligenza artificiale opachi, non su un singolo assistente di programmazione. Se avete cercato il prodotto, l'azienda gestisce la propria documentazione e i propri prezzi. Se invece avete cercato il concetto, continuate a leggere.

Intelligenza artificiale spiegabile e strumenti di spiegabilità

L'intelligenza artificiale spiegabile, solitamente abbreviata in XAI, è il campo che cerca di rendere più comprensibili i modelli di IA opachi senza comprometterne l'accuratezza. Si tratta di un mercato reale, con previsioni per il 2026 comprese tra i 9 e i 13 miliardi di dollari a livello globale, a seconda della definizione di XAI che si adotta. L'obiettivo è rendere i modelli di IA più comprensibili senza costringere i team a tornare a modelli di base più lenti o meno precisi. I team più esperti testano questi strumenti su altri strumenti di IA prima di rilasciarli e corredano l'output con una documentazione leggibile da un revisore umano.

È opportuno conoscere tre famiglie di tecniche XAI.

Il primo è SHAP, acronimo di SHapley Additive exPlanations. È mutuato dalla teoria dei giochi cooperativi: per ogni previsione, SHAP assegna un punteggio di contributo a ogni caratteristica di input. I team di valutazione del credito lo adorano. I team di rilevamento delle frodi lo adorano. Chi si occupa di modellazione del rischio in ambito sanitario lo tollera. SHAP è teoricamente rigoroso, ma dal punto di vista computazionale è una vera bestia con grandi quantità di dati tabellari.

Il secondo è LIME, Local Interpretable Model-agnostic Explanations (Spiegazioni locali interpretabili agnostiche al modello). LIME costruisce un modello surrogato semplice e interpretabile attorno a una singola previsione e lo utilizza per spiegare l'originale. È più veloce di SHAP. Funziona con testo, immagini e tabelle. Il problema è che LIME è locale per sua natura, quindi può indurre in errore se si presume che una spiegazione sia generalizzabile.

Il terzo tipo è rappresentato dalle spiegazioni controfattuali. Invece di spiegare perché il modello ha dato esito positivo, le spiegazioni controfattuali indicano la minima modifica necessaria per ribaltare la risposta in negativa. Questo è esattamente ciò che un richiedente di credito o una transazione segnalata desidera sapere: "Cosa dovrei cambiare?". Le spiegazioni controfattuali stanno rapidamente guadagnando terreno nelle comunicazioni di esito negativo proprio perché si allineano perfettamente alle aspettative delle autorità di regolamentazione.

Oltre a questi tre, troverete grafici di importanza delle caratteristiche, visualizzazione dell'attenzione per i layer transformer e Grad-CAM per i classificatori di immagini. L'interpretabilità meccanicistica, ovvero la pratica di decodificare specifici neuroni e circuiti di attenzione, si colloca all'avanguardia del settore. Anthropic, OpenAI e alcuni laboratori accademici hanno pubblicato circuiti parziali, ma il lavoro non si è ancora tradotto in qualcosa che un team di conformità aziendale possa implementare.

Siamo onesti riguardo alle implicazioni di tutto ciò. Le ricerche di settore pubblicate da Palo Alto Networks e altri indicano che l'XAI funziona bene per i classificatori di immagini e i modelli tabulari strutturati, ma solo parzialmente per i modelli linguistici complessi (LLM). La logica all'interno di un modello linguistico cambia al variare della posizione del token e della finestra di contesto, quindi i punteggi di attribuzione delle caratteristiche possono essere fuorvianti in modi che la spiegazione stessa non segnala. Gli strumenti di interpretabilità che condividono il codice sottostante sono utili, ma non rappresentano una soluzione definitiva al problema della scatola nera.

Regolamentazione dell'IA a scatola nera: Legge UE sull'IA, NIST, CFPB

La maggior parte dei fornitori di IA non si aspettava che gli enti regolatori si muovessero così rapidamente. Invece lo hanno fatto. Il vecchio approccio "distribuisci ora, documenta dopo" sta per scomparire, e la ragione è da ricercarsi in una manciata di norme.

L'Europa è stata la prima a muoversi in questo senso con l'EU AI Act. Si tratta di un'implementazione graduale tra il 2025 e il 2027, non di un passaggio immediato. Le pratiche vietate sono diventate applicabili il 2 febbraio 2025. Le norme generali sull'IA sono entrate in vigore il 2 agosto 2025. Gli obblighi relativi ai sistemi ad alto rischio entreranno in vigore dal 2 agosto 2026, e l'estensione ai prodotti regolamentati arriverà un anno dopo, il 2 agosto 2027. Le sanzioni non sono una mera formalità. 35 milioni di euro o il 7% del fatturato mondiale per le violazioni più gravi, 15 milioni di euro o il 3% per le altre (DLA Piper, 2025). E l'elenco dei casi d'uso ad alto rischio sembra un elenco dei principali utilizzi di sistemi a scatola nera: valutazione del credito, assunzioni, istruzione, forze dell'ordine, identificazione biometrica. Ognuno di questi ora richiede documentazione, trasparenza e supervisione umana per impostazione predefinita.

Il quadro americano è più complesso, ma la tendenza è la stessa. Il framework NIST per la gestione del rischio di IA è quanto di più simile a un punto di riferimento statunitense. Pubblicato nel gennaio 2023 e ampliato nel corso del 2024 e del 2025, è diventato silenziosamente il documento di riferimento per le grandi aziende, a prescindere dal fatto che siano tecnicamente obbligate ad adottarlo o meno. Nel dicembre 2025 è stato pubblicato il documento NIST IR 8596, la bozza preliminare del Cyber AI Profile, con un workshop di approfondimento il 14 gennaio 2026. Molti team lo stanno già adottando.

Il Consumer Financial Protection Bureau è stato più esplicito. Le circolari 2022-03 e 2023-03 lo affermano chiaramente: un creditore non può utilizzare un algoritmo complesso se tale complessità gli impedisce di fornire le motivazioni specifiche di un provvedimento negativo ai sensi dell'ECOA e del Regolamento B. Leggete attentamente. Non si tratta di un divieto di utilizzo dell'apprendimento automatico nei prestiti. Si tratta di un divieto di utilizzo dell'apprendimento automatico talmente opaco da non permettere di spiegare a un richiedente a cui è stato negato un prestito cosa abbia sbagliato. In pratica, si tratta di un divieto di "scatola nera" per il credito al consumo.

Le banche si trovano ad affrontare un requisito più datato ma ancora più stringente. La norma SR 11-7 della Federal Reserve, in vigore dal 2011, impone alle banche di dimostrare di comprendere qualsiasi modello che influenzi una decisione rilevante. I moderni sistemi di deep learning faticano a soddisfare tale requisito senza supporto esterno, e il Bollettino 2011-12 dell'OCC ribadisce lo stesso approccio.

Risultato finale: qualsiasi ente regolamentato negli Stati Uniti o nell'UE ha esaurito le scuse per considerare l'opacità un compromesso accettabile in cambio dell'accuratezza. O l'interpretabilità viene integrata fin dalla prima revisione del progetto, oppure si crea un sistema ibrido in cui un essere umano fornisce la spiegazione che il modello non può offrire. Non esiste una terza via che resista a un'azione di applicazione della legge.

Come effettuare un audit di un sistema di intelligenza artificiale a scatola nera

Quindi, come si presenta concretamente l'implementazione responsabile di un sistema di intelligenza artificiale a scatola nera nel 2026? La procedura pratica è più breve di quanto i fornitori lascino intendere.

Si inizia dai dati. Documentate la provenienza dei dati di addestramento, chi li ha etichettati e quali sottogruppi sono rappresentati. Circa la metà dei problemi di distorsione che incontrerete in seguito sono già codificati qui, e l'altra metà, che non potete rintracciare, è quella che non potete correggere.

Dopodiché, si procede al red teaming del modello. Lo si analizza con input avversari, iniezioni di prompt, casi limite ed esempi fuori dalla distribuzione. Anthropic, OpenAI e Microsoft pubblicano ora manuali per questo tipo di lavoro, che è possibile adattare senza dover inventare una nuova metodologia.

Applica XAI a ogni modello in produzione, non solo a quelli principali. SHAP per le pipeline tabellari. LIME per testo e immagini. Controfattuali per ogni decisione che si ripercuote sull'utente. Nessuno di questi strumenti è perfetto. La loro assenza, d'altra parte, è un campanello d'allarme per qualsiasi revisore che si trovi a esaminare la tua infrastruttura.

Presta attenzione alle deviazioni. I modelli diventano obsoleti più velocemente di quanto la maggior parte dei team si aspetti. Monitora le distribuzioni degli input, le distribuzioni degli output e i risultati a valle. Imposta degli avvisi per ciascuno di essi e tratta le variazioni inspiegabili come incidenti, non come stranezze.

Definisci il percorso di escalation prima che sia necessario. Ogni decisione importante relativa al modello dovrebbe prevedere una possibilità di annullamento da parte di un operatore umano e un canale di ricorso documentato che il cliente possa effettivamente utilizzare. Se il team di supporto funge da canale di ricorso, specificalo anche tu.

Infine, allineatevi al quadro normativo applicabile. Se siete negli Stati Uniti, consultate il NIST AI RMF. Se siete in Europa, consultate i requisiti per le attività ad alto rischio dell'EU AI Act. Se operate nel settore del credito al consumo, consultate le circolari CFPB 2022-03 e 2023-03. Fare questo una volta per tutte, tempestivamente, è decisamente più economico che adeguarsi a posteriori dopo aver ricevuto un provvedimento di applicazione della legge.

Non eliminerete la scatola nera. Va bene così. L'obiettivo è renderla osservabile, responsabile e circoscritta. Questo è lo standard che le autorità di regolamentazione stanno già imponendo, ed è ciò che rappresenterà un'implementazione matura nel 2026.