Qu’est-ce que l’IA boîte noire ? Le problème de la boîte noire expliqué

En avril 2026, le classement des modèles de langage Vectara concernant les hallucinations a livré un verdict surprenant. Les meilleurs modèles de langage hallucinent désormais moins de 4 % du temps sur le test principal. Cependant, les nouvelles variantes « raisonnement » de GPT-5, Claude Sonnet 4.5, Grok-4 et Gemini-3-Pro affichent toutes plus de 10 % d'hallucinations sur le nouveau jeu de données. Grok-4-fast-reasoning a même atteint 20,2 %. Les modèles les plus intelligents, ceux qui « réfléchissent » avant de répondre, sont les moins aptes à admettre leur ignorance.

Voilà, en un paragraphe, le problème de la boîte noire. Nous avons conçu des systèmes d'IA qui produisent souvent des résultats utiles, mais que personne, pas même leurs créateurs, ne peut expliquer pleinement. Ils sont précis sans être calibrés, fluides sans être honnêtes et sûrs d'eux sans être corrects.

Les autorités de régulation l'ont constaté. La loi européenne sur l'IA prévoit désormais des amendes pouvant atteindre 35 millions d'euros ou 7 % du chiffre d'affaires mondial en cas d'utilisation interdite, les règles relatives aux systèmes à haut risque entrant en vigueur le 2 août 2026. Aux États-Unis, le Bureau de protection financière des consommateurs a clairement indiqué aux banques qu'elles ne peuvent pas utiliser d'algorithmes complexes si ces derniers les empêchent de justifier un refus de crédit. Par ailleurs, le domaine de l'IA explicable, un sujet de niche il y a cinq ans, représente aujourd'hui un marché estimé entre 9 et 13 milliards de dollars en 2026.

Ce guide explique ce qu'est réellement l'IA « boîte noire », pourquoi même des modèles d'IA d'apparence simple deviennent des boîtes noires, les problèmes qui surviennent dans ce cas, où elles apparaissent dans les secteurs des cryptomonnaies et de la fintech, comment les outils d'IA explicable (SHAP, LIME, contrefactuels) tentent de les décrypter, et ce qu'il faut savoir sur le nouveau cadre réglementaire en vigueur dans l'UE et aux États-Unis. Une petite précision s'impose : l'assistant de programmation Blackbox AI, disponible sur blackbox.ai, est une chose différente.

Qu’est-ce que l’IA boîte noire et pourquoi est-ce important ?

L'expression « IA boîte noire » désigne tout système d'IA dont le raisonnement interne reste opaque aux utilisateurs et, souvent, même aux développeurs qui l'ont conçu. Les entrées et les sorties sont visibles, mais le chemin entre elles est dissimulé sous des couches de pondération, de modèles appris et de transformations d'apprentissage automatique qu'aucun humain ne peut déchiffrer intégralement. Ceci est valable que le modèle traite des données tabulaires, des images ou des tâches de traitement automatique du langage naturel comme la traduction et la conversation.

L'expression est antérieure à l'apprentissage profond moderne. Les ingénieurs utilisent le terme « boîte noire » depuis au moins les années 1960 pour désigner tout système que l'on peut observer de l'extérieur sans pouvoir le démonter. Le cerveau humain lui-même, aiment à le souligner les biologistes, est également une boîte noire, mais la comparaison a ses limites : une IA ne fonctionne pas comme un humain, et supposer le contraire est l'un des moyens les plus sûrs de mal interpréter ce que signifie l'expression « IA boîte noire ». Ce qui a changé au cours de la dernière décennie, c'est l'échelle. Un modèle de langage moderne de grande taille peut contenir des centaines de milliards de paramètres. Un réseau neuronal profond typique répartit la « connaissance » sur des milliers de couches et des millions de neurones, chaque neurone encodant simultanément plusieurs motifs non liés. Les chercheurs appellent cette dernière propriété la polysémantique, et c'est l'une des raisons pour lesquelles l'interprétabilité mécaniste n'en est qu'à ses débuts.

Pourquoi cela devrait-il intéresser le monde extérieur aux laboratoires de recherche ? Parce que l’IA opaque influence désormais des décisions cruciales. Elle accorde ou refuse des crédits, évalue la solvabilité des accusés, signale les transactions frauduleuses et gère une part importante du volume d’échanges sur toutes les grandes plateformes de cryptomonnaies. Lorsqu’elle commet une erreur, son opacité rend presque impossible d’en déterminer la cause, de la corriger ou d’en demander des comptes.

C'est également important car la gouvernance de l'IA ne considère plus l'opacité comme un problème relevant des développeurs. L'UE la perçoit désormais comme une question d'accès au marché. Les autorités de régulation américaines, quant à elles, l'envisagent comme une question d'équité en matière de prêts. Depuis 2024, tous les dirigeants ayant validé une initiative en matière d'IA se sont heurtés au même obstacle : que fait réellement ce système, et pourquoi ? Comprendre le fonctionnement interne de l'IA n'est plus une option, et changer de fournisseur ne résoudra pas ce problème.

Pourquoi les modèles d'IA deviennent des boîtes noires

Toutes les IA ne sont pas des boîtes noires. Un arbre de décision simple est totalement transparent. Un modèle de régression linéaire produit des coefficients interprétables. Même un système d'IA à base de règles des années 1990 est, en principe, auditable ligne par ligne.

Comment les modèles d'IA actuels deviennent-ils des boîtes noires ? Cela s'explique par quatre raisons qui se recoupent.

Tout d'abord, la question de l'échelle. Les modèles d'apprentissage profond, qui comportent des millions, voire des milliards de paramètres, opèrent dans des espaces de grande dimension que l'être humain ne peut visualiser. On peut décrire mathématiquement un modèle à 200 milliards de paramètres, mais personne ne peut le concevoir mentalement.

Deuxièmement, les représentations distribuées. Dans un réseau neuronal profond, aucun neurone ne stocke à lui seul « le concept de chat » ou « la règle de refus d’un prêt ». Les concepts se diffusent entre des milliers de neurones, et chaque neurone participe simultanément à de nombreux concepts. Obtenir une explication claire est un projet de recherche, non une simple question.

Troisièmement, la dépendance aux données d'entraînement. Le comportement du modèle est déterminé par ses données d'entraînement, généralement propriétaires, volumineuses et parfois sujettes à des litiges. Même lorsqu'un développeur publie les poids du modèle, les données sont rarement partagées. Un élément essentiel du « pourquoi » fait donc défaut.

Quatrièmement, l'intention. Il existe des raisons pratiques d'utiliser délibérément des approches de type « boîte noire ». Certains développeurs et programmeurs d'IA obscurcissent volontairement le fonctionnement interne de leurs modèles afin de protéger leur propriété intellectuelle. D'autres raisons justifient l'utilisation de ces conceptions, notamment les conditions de licence et les avantages concurrentiels. Même un modèle à pondération ouverte peut, de fait, rendre ses décisions opaques, car la plupart des modèles modernes reposent sur des schémas émergents non documentés. Une entreprise ayant investi 100 millions de dollars dans un modèle n'est pas disposée à publier son architecture ni sa procédure d'entraînement. Les modèles d'IA open source qui partagent leur code source restent, eux aussi, des boîtes noires, car les utilisateurs ne peuvent toujours pas analyser les pondérations apprises et les interpréter de manière pertinente.

Il en résulte que même des modèles d'IA avancés en apparence simples, comme les modèles linéaires et les modèles d'IA génératifs, deviennent par défaut des boîtes noires. Les modèles transparents sont l'exception, et non la règle. Les boîtes noires complexes peuvent offrir une précision impressionnante, ce qui explique pourquoi les équipes continuent de les déployer malgré leur opacité. Il en va de même pour les modèles d'IA de type boîte noire entraînés sur des données riches et complexes : le gain par rapport aux modèles d'IA basés sur des règles est souvent suffisamment important pour compenser les problèmes d'explicabilité, jusqu'à ce qu'un dysfonctionnement survienne. La plupart des IA modernes de type boîte noire le restent car les utilisateurs ne peuvent toujours pas examiner les poids appris. Les modèles à poids ouverts partagent leur code sous-jacent et les utilisateurs peuvent consulter l'architecture, mais ce code reste une boîte noire lorsqu'on se demande « pourquoi le modèle a-t-il dit cela ? ».

Le problème de la boîte noire en apprentissage profond

Le problème de la boîte noire survient lorsque ces quatre raisons se conjuguent. Le modèle fonctionne, souvent de manière impressionnante. Mais son fonctionnement résiste à trois choses à la fois : l’explication, la validation et la correction.

Prenons l'exemple classique d'un modèle d'apprentissage profond entraîné à identifier les pandas. Il obtient un score de 99 % sur l'ensemble de test. C'est parfait. Puis, quelqu'un utilise un outil d'interprétabilité et découvre que le modèle ne se concentre pas vraiment sur le panda. Il s'intéresse plutôt au bambou. La plupart des photos de pandas dans les données d'entraînement contiennent également du bambou. Le modèle a appris un raccourci. Sur une photo de panda sans bambou, le modèle échoue.

Ce type d’« apprentissage par raccourcis » est omniprésent en apprentissage profond. Le modèle découvre une régularité statistique qui ne correspond pas au concept sous-jacent, mais on ne s’en aperçoit que lorsque le monde réel diffère légèrement de l’ensemble d’entraînement. La crise financière de 2008 en est un exemple historique. Les modèles de valeur à risque (VaR) construits sur des hypothèses gaussiennes fonctionnaient parfaitement sur les marchés normaux, mais se sont effondrés dans des conditions extrêmes, car ils avaient intégré des raccourcis que les modélisateurs ignoraient être des raccourcis.

Les modèles d'apprentissage profond actuels présentent exactement le même mode de défaillance, avec davantage de paramètres et une plus grande fiabilité. Des chercheurs en interprétabilité mécaniste, notamment des équipes d'Anthropic et d'OpenAI, ont entrepris de déconstruire de petites portions de modèles de langage, neurone par neurone. Leurs travaux révèlent que le fonctionnement interne d'un modèle de langage s'apparente davantage à des circuits intriqués qu'à une logique rigoureuse. Il est impossible de désigner un point précis et d'affirmer : « Voici où se trouve la solution. » Ce problème de « boîte noire » n'est pas un bug à corriger ; il est structurel.

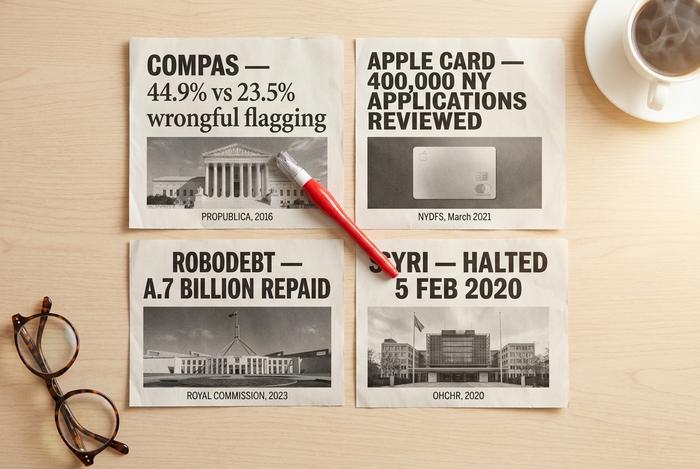

Exemples d'IA boîte noire : COMPAS, Apple Card, Robodebt, SyRI

Vous voulez voir à quoi ressemble une IA opaque lorsqu'elle dysfonctionne ? Les quatre cas constamment cités vous en apprendront l'essentiel. Ils concernent la justice pénale, le secteur bancaire et l'aide sociale. Tous ont causé des dommages concrets. Et aucun de ces échecs n'est identique.

Commençons par COMPAS. Développé par Northpointe pour prédire la récidive d'un prévenu, ce système a été largement adopté par les tribunaux américains. ProPublica a ensuite mené une enquête approfondie. Son audit de 2016, portant sur plus de 7 000 personnes arrêtées dans le comté de Broward, a révélé un constat alarmant : les prévenus noirs ont été classés à tort comme présentant un risque élevé de récidive dans 44,9 % des cas, contre seulement 23,5 % pour les prévenus blancs. Une étude complémentaire de 2024 a aggravé la situation. Deux critères (l'âge et les condamnations antérieures) ont atteint la même précision que les 137 critères de COMPAS. La complexité accrue n'a donc apporté aucune information supplémentaire, mais a considérablement compliqué la détection du biais. Il s'agit du modèle classique de la « boîte noire » qui évalue les individus plutôt que les produits. Le modèle d'évaluation des candidats à l'embauche, abandonné par Amazon en 2018, présente les mêmes caractéristiques.

Puis, fin 2019, Apple Card. Wozniak a déclaré que sa femme avait obtenu une limite de crédit dix fois inférieure à la sienne. David Heinemeier Hansson a fait le même constat. L'histoire a fait le tour du web. Le Département des services financiers de l'État de New York a pris l'affaire au sérieux : il a examiné près de 400 000 demandes. En mars 2021, il a conclu à l'absence de discrimination fondée sur le sexe. Mais il a également écrit, et c'est là le point crucial, que le manque de transparence de l'expérience client constituait en soi un problème de confiance. Il s'avère que les conséquences d'un manque de transparence sont liées à parts égales aux résultats et à la perception. Un communiqué de presse ne suffit pas à changer cette perception.

Le système de recouvrement automatisé des dettes (Robodebt) représente l'autre face de la médaille. Aucun réseau neuronal complexe n'est impliqué. L'Australie a appliqué une règle de calcul de la moyenne des revenus aux dossiers d'aide sociale entre 2016 et 2019, a accusé environ 400 000 bénéficiaires de fraude et s'est avérée incapable d'expliquer clairement le calcul aux destinataires du courrier. Une commission royale a par la suite qualifié le système d'illégal. Le gouvernement a remboursé 1,7 milliard de dollars australiens, auxquels s'ajoutent 112 millions de dollars australiens d'indemnisation. Leçon à retenir : un système n'a pas besoin d'être techniquement sophistiqué pour être opaque. Il suffit qu'il ne soit soumis à aucune obligation de rendre des comptes.

L'affaire néerlandaise des « toeslagenaffaire » et le projet SyRI constituent les deux extrémités du spectre européen. Le 5 février 2020, un tribunal néerlandais a ordonné l'arrêt immédiat du projet SyRI, jugeant que son opacité violait l'article 8 de la Convention européenne des droits de l'homme. Le scandale des allocations familiales qui en a découlé a touché plus de 20 000 parents accusés à tort de fraude. Le gouvernement Rutte a démissionné en janvier 2021. Cette décision fait désormais autorité au sein des cercles politiques européens : elle démontre que l'opacité de l'IA dans des contextes à forts enjeux n'est pas une simple question d'éthique, mais bien une question de droit.

Quatre cas. Des secteurs différents, des technologies différentes, des pays différents. Un même schéma se dessine : un système opaque, une décision lourde de conséquences et des personnes qui en subissent les conséquences sans réel moyen de s’y opposer.

Risques liés à l'IA « boîte noire » dans les systèmes d'IA du monde réel

Lorsqu'on commence à recenser les risques liés à l'IA « boîte noire » dans les systèmes d'IA réels, une tendance se dégage. Les cinq mêmes risques reviennent sans cesse, que le modèle soit un système d'évaluation du crédit, un chatbot ou un système de trading algorithmique.

| Risque | À quoi ça ressemble | Pourquoi cela s'adapte |

|---|---|---|

| biais caché | Ce modèle traite différemment les groupes protégés. | Les données d'entraînement comportent des schémas historiques |

| Hallucination | Le modèle invente des faits ou des citations | Les LLM privilégient la fluidité, pas la vérité. |

| Apprentissage rapide | Le modèle repose sur des corrélations non pertinentes. | Plus facile à apprendre que le concept réel |

| Fragilité adverse | Une petite modification de l'entrée inverse la sortie | Frontières de décision multidimensionnelles |

| Analyse détaillée de l'audit | Impossible de reconstituer le pourquoi | Aucun état interne interprétable |

Ces risques s'accumulent dans les systèmes d'IA opaques utilisés dans la finance, le recrutement, la santé et les cryptomonnaies. La complexité des processus d'apprentissage profond qu'ils recèlent rend difficile la prédiction de la prochaine défaillance, et les outils d'IA traditionnels pour l'assurance qualité n'ont pas été conçus pour des modèles comportant des centaines de milliards de paramètres.

Les biais cachés font souvent la une, mais la fragilité face aux adversaires et les défaillances d'audit constituent les problèmes majeurs à long terme. Un biais stable peut au moins être mesuré et corrigé. Un modèle qui échoue différemment à chaque exécution (comme ChatGPT, sur environ 42 % des tâches d'évaluation de contrats intelligents selon une étude ACM TOSEM de 2024) est beaucoup plus difficile à certifier pour un usage réglementé.

Le dernier élément à rejoindre cette liste est ce que les chercheurs appellent le « risque lié à l'IA agentielle ». Lorsqu'on intègre un modèle logique à des outils, qu'on lui alloue de la mémoire et qu'on l'autorise à interroger des API, on accroît considérablement l'opacité. Une simple décision se transforme alors en une chaîne d'invocations de modèles, de documents récupérés et d'appels d'outils, chacun étant partiellement opaque. Les agents modernes sont des boîtes noires imbriquées les unes dans les autres.

L'intelligence artificielle « boîte noire » dans les cryptomonnaies et la fintech

De tous les secteurs utilisant l'IA « boîte noire », les cryptomonnaies et la fintech sont ceux où le déploiement et les risques s'entrechoquent le plus. Les enjeux sont considérables, la latence est faible et la transparence limitée. La réglementation, notamment dans le domaine des cryptomonnaies, reste fragmentaire. Il en résulte un environnement qui privilégie le déploiement rapide à la documentation ultérieure.

Le trading algorithmique a généré environ 70 à 80 % du volume des cryptomonnaies en 2025, une part supérieure à celle des principaux marchés actions (60 à 70 %). À elle seule, la plateforme Wintermute traite plus de 15 milliards de dollars par jour sur plus de 60 plateformes, avec un volume record de 2,24 milliards de dollars enregistré en 2025. Les stratégies sous-jacentes à ces flux reposent sur des systèmes d'apprentissage profond inaccessibles à tout observateur extérieur. L'effondrement d'Alameda/FTX en novembre 2022 illustre parfaitement ce risque : la capitalisation totale du marché des cryptomonnaies est passée de plus de 1 000 milliards de dollars à moins de 800 milliards en un mois environ, et l'exposition sous-jacente de 14,6 milliards de dollars liée à la FTT dans le bilan d'Alameda est restée invisible jusqu'à ce qu'elle soit révélée au grand jour.

Évaluation des risques liés à la lutte contre le blanchiment d'argent (LCB) et à la connaissance du client (KYC). Le marché mondial des logiciels de lutte contre le blanchiment d'argent a atteint 4,13 milliards de dollars en 2025 et devrait atteindre 9,38 milliards de dollars d'ici 2030 (MarketsandMarkets). La conformité LCB/KYC dans le secteur des cryptomonnaies connaît une croissance annuelle composée de 13,8 %. Des fournisseurs comme ComplyAdvantage, Chainalysis Reactor et Elliptic Navigator utilisent désormais des modèles d'apprentissage automatique opaques pour évaluer les risques liés aux portefeuilles. L'utilisation de ces modèles est si répandue et efficace qu'elle est déployée sur la plupart des grandes plateformes d'échange, tout en restant suffisamment opaque pour que les responsables de la conformité ne puissent souvent pas reconstituer les raisons du blocage d'un portefeuille.

Audit des contrats intelligents. C'est là que les limites de l'IA apparaissent clairement. Une étude arXiv de 2024 a évalué GPT-4 pour la détection des vulnérabilités des contrats intelligents. Ce modèle a atteint une précision de 96,6 %, mais seulement un rappel de 37,8 %, manquant ainsi près des deux tiers des failles réelles. Les résultats de ChatGPT sont instables d'une exécution à l'autre pour 42 % des contrats (ACM TOSEM 2024). Les outils hybrides comme GPTScan, qui combinent GPT avec une analyse statique, dépassent les 90 % de précision et atteignent environ 70 % de rappel sur les contrats de jetons (arXiv 2308.03314). CertiK Skynet surveille désormais plus de 17 000 projets et une capitalisation boursière d'environ 494 milliards de dollars, mais toute équipe d'audit responsable continue d'associer l'IA à un auditeur humain.

Les robo-conseillers. Betterment gère plus de 56 milliards de dollars répartis sur plus de 900 000 comptes. Wealthfront, quant à lui, gère 42,9 milliards de dollars. Le secteur des robo-conseillers a franchi la barre des 1 000 milliards de dollars d’actifs sous gestion à l’échelle mondiale. Le rééquilibrage des portefeuilles, l’optimisation fiscale et l’évaluation des risques sont entièrement pilotés par des modèles d’apprentissage automatique dont les décisions spécifiques ne sont divulguées dans aucun document destiné aux particuliers.

Évaluation du crédit et détection des fraudes. FICO est utilisé par 90 % des établissements de crédit américains, et FICO Falcon traite plus de 65 milliards de transactions par an avec un taux de détection des fraudes supérieur à 95 %. Une étude de la Banque d'Angleterre menée en 2024 auprès de 50 institutions britanniques a révélé que les modèles d'apprentissage automatique pour l'évaluation du risque de crédit réduisaient les erreurs de classification d'environ 25 % par rapport à la régression logistique. Le gain en précision est donc réel. En contrepartie, conformément aux circulaires 2022-03 et 2023-03 du CFPB, les établissements de crédit américains ne peuvent pas utiliser de modèles suffisamment opaques pour empêcher toute justification spécifique des décisions défavorables prises en vertu de l'ECOA.

Le schéma se répète pour les cinq modèles. Le modèle est plus précis que le modèle de référence transparent. L'opacité est intrinsèquement liée à la précision. Et les organismes de réglementation progressent plus vite que les outils d'explicabilité.

Note sur l'IA boîte noire : le LLM en programmation

Petit point important : lorsque l’on recherche « IA boîte noire », on fait souvent référence au problème conceptuel abordé dans cet article. Parfois, on fait référence à Blackbox AI, l’entreprise à l’adresse blackbox.ai. Blackbox.ai est un master en programmation (LLM) conçu pour transformer la façon dont les développeurs écrivent du code. Le produit s’intègre à VS Code en tant qu’agent de codage, suggère du code et rivalise avec des outils comme Claude Code, GitHub Copilot et Cursor. C’est l’une des technologies d’IA avancées les plus connues dans le domaine du codage assisté par ordinateur. Basée sur plusieurs modèles d’IA, elle propose des suggestions de code couvrant tous les aspects, des refactorisations à la création de squelettes de tests. Blackbox intègre la génération de code, le chat et la recherche dans un flux de travail unique, et la plupart des utilisateurs la considèrent comme le meilleur assistant IA qu’ils aient testé dans leur éditeur.

Les deux significations sont souvent confondues dans les résultats de recherche. Le produit Blackbox AI n'est pas le sujet de cet article. Nous nous intéressons à la structure des systèmes d'IA opaques, et non à un assistant de programmation en particulier. Si vous avez recherché le produit, sachez que l'entreprise propose sa propre documentation et ses propres tarifs. Si vous avez recherché le concept, poursuivez votre lecture.

IA explicable et outils d'explicabilité

L'IA explicable, ou XAI, est le domaine qui vise à rendre les modèles d'IA opaques plus compréhensibles sans en altérer la précision. Ce marché est aujourd'hui bien établi. Les prévisions pour 2026 tablent sur une valeur mondiale comprise entre 9 et 13 milliards de dollars, cet écart dépendant de la définition de la XAI retenue. L'objectif est de rendre les modèles d'IA plus explicables sans contraindre les équipes à utiliser des méthodes de base moins performantes ou moins précises. Les équipes les plus compétentes testent ces outils sur les modèles d'IA avant leur déploiement et accompagnent les résultats d'une documentation compréhensible par un humain.

Il est intéressant de connaître trois familles de techniques d'IA explicable.

La première méthode est SHAP, acronyme de SHapley Additive exPlanations. Empruntée à la théorie des jeux coopératifs, elle attribue, pour chaque prédiction, un score de contribution à chaque variable d'entrée. Les équipes d'évaluation du crédit et de détection des fraudes l'adorent. Les modélisateurs des risques dans le secteur de la santé la tolèrent. Théoriquement rigoureuse, SHAP représente néanmoins une charge de calcul considérable pour les grands volumes de données tabulaires.

La seconde méthode est LIME (Local Interpretable Model-agnostic Explanations). LIME construit un modèle de substitution simple et interprétable à partir d'une seule prédiction et l'utilise pour expliquer la prédiction originale. Plus rapide que SHAP, elle fonctionne avec du texte, des images et des tableaux. Son principal inconvénient est sa conception locale : elle peut donc induire en erreur si l'on suppose qu'une explication est généralisable.

La troisième méthode consiste à utiliser des explications contrefactuelles. Au lieu d'expliquer pourquoi le modèle a donné une réponse positive, les explications contrefactuelles indiquent la plus petite modification des données qui aurait permis d'obtenir une réponse négative. C'est précisément ce que souhaite savoir un demandeur de crédit ou une transaction signalée : « Que devrais-je changer ? ». Les explications contrefactuelles sont de plus en plus utilisées dans les notifications de refus, car elles correspondent parfaitement aux attentes des autorités de réglementation.

Outre ces trois éléments, vous découvrirez des graphiques d'importance des caractéristiques, la visualisation de l'attention pour les couches transformeuses et Grad-CAM pour les classificateurs d'images. L'interprétabilité mécaniste, qui consiste à reconstituer par rétro-ingénierie des neurones et des circuits d'attention spécifiques, représente la pointe de la recherche dans ce domaine. Anthropic, OpenAI et quelques laboratoires universitaires ont publié des circuits partiels, mais ces travaux n'ont pas encore abouti à des solutions exploitables par les équipes de conformité en entreprise.

Soyons honnêtes quant aux conséquences de tout cela. Des études sectorielles publiées par Palo Alto Networks et d'autres organismes indiquent que l'IA explicable (XAI) fonctionne bien pour les classificateurs d'images et les modèles tabulaires structurés, mais seulement partiellement pour les modèles de langage. La logique interne d'un modèle de langage évolue en fonction de la position du jeton et du contexte, ce qui peut induire en erreur les scores d'attribution des caractéristiques, sans que l'explication elle-même ne le signale. Les outils d'explicabilité qui partagent leur code source sont utiles, mais ne constituent pas une solution définitive au problème de la boîte noire.

Réglementation de l'IA boîte noire : loi européenne sur l'IA, NIST, CFPB

La plupart des fournisseurs d'IA ne s'attendaient pas à une telle rapidité de la part des autorités de réglementation. Et pourtant, c'est ce qui s'est passé. La vieille approche du « déploiement immédiat, documentation ultérieure » est en train de disparaître, et quelques règles seulement en sont la cause.

L'Europe a été la première à agir avec la loi européenne sur l'IA. Son déploiement se fera progressivement entre 2025 et 2027, et non par une simple transition. Les pratiques interdites sont entrées en vigueur le 2 février 2025. Les règles générales relatives à l'IA sont entrées en vigueur le 2 août 2025. Les obligations concernant les systèmes à haut risque s'appliqueront à partir du 2 août 2026, et l'extension aux produits réglementés un an plus tard, le 2 août 2027. Les amendes ne sont pas symboliques : 35 millions d'euros ou 7 % du chiffre d'affaires mondial pour les infractions les plus graves, et 15 millions d'euros ou 3 % pour les autres (DLA Piper, 2025). La liste des cas d'utilisation à haut risque ressemble à un annuaire des déploiements de systèmes opaques : notation de crédit, recrutement, éducation, application de la loi, identification biométrique. Chacun de ces systèmes exige désormais systématiquement documentation, transparence et supervision humaine.

La situation aux États-Unis est plus complexe, mais évolue dans la même direction. Le cadre de gestion des risques liés à l'IA du NIST constitue ce qui se rapproche le plus d'un référentiel américain. Publié en janvier 2023, puis enrichi en 2024 et 2025, il est devenu discrètement le document de référence pour les grandes entreprises, même si elles n'y sont pas techniquement tenues. En décembre 2025, le NIST IR 8596, version préliminaire du profil de cybersécurité lié à l'IA, a été publié, suivi d'un atelier le 14 janvier 2026. De nombreuses équipes l'ont déjà adopté.

Le Bureau de protection financière des consommateurs (CFPB) a été plus direct. Les circulaires 2022-03 et 2023-03 l'affirment sans détour : un créancier ne peut utiliser un algorithme complexe si cette complexité l'empêche de fournir les motifs précis d'une décision de refus conformément à l'ECOA et au Règlement B. Lisez attentivement. Il ne s'agit pas d'une interdiction de l'apprentissage automatique dans le secteur du crédit, mais d'une interdiction d'un apprentissage automatique si opaque qu'il est impossible d'expliquer à un demandeur débouté les raisons de son refus. En clair, c'est une interdiction de l'opacité totale en matière de crédit à la consommation.

Les banques sont soumises à une exigence plus ancienne, mais toujours plus contraignante. La directive SR 11-7 de la Réserve fédérale, en vigueur depuis 2011, les oblige à démontrer leur compréhension de tout modèle sous-jacent à une décision importante. Les systèmes d'apprentissage profond modernes peinent à satisfaire à cette exigence sans assistance, et le Bulletin 2011-12 de l'OCC préconise la même approche.

En résumé : aucune entité réglementée aux États-Unis ou dans l’UE ne peut plus se permettre de considérer l’opacité comme un compromis acceptable au détriment de la précision. Soit l’interprétabilité est intégrée dès la conception, soit on opte pour une solution hybride où l’explication humaine compense les lacunes du modèle. Aucune autre voie ne résiste à une action coercitive.

Comment auditer un système d'IA boîte noire

À quoi ressemblera concrètement le déploiement responsable d'un système d'IA « boîte noire » en 2026 ? La marche à suivre est plus courte que ce que les fournisseurs prétendent.

Tout commence par les données. Documentez la provenance des données d'entraînement, les personnes qui les ont étiquetées et les sous-groupes représentés. Environ la moitié des biais que vous rencontrerez par la suite sont déjà présents dans ces données, et l'autre moitié, que vous ne pourrez pas identifier, sera impossible à corriger.

Ensuite, il faut tester le modèle avec une équipe d'attaque. On le soumet à des entrées adverses, des injections d'invites, des cas limites et des exemples hors distribution. Anthropic, OpenAI et Microsoft publient désormais des guides pratiques pour ce travail, que vous pouvez adapter sans avoir à inventer une nouvelle méthodologie.

Appliquez l'IAx à tous les modèles en production, et pas seulement aux plus visibles. Utilisez SHAP pour les pipelines tabulaires. Utilisez LIME pour le texte et les images. Intégrez des analyses contrefactuelles à toute décision impliquant un utilisateur. Aucun de ces outils n'est parfait. Leur absence, en revanche, constitue un signal d'alarme pour tout auditeur examinant votre infrastructure.

Soyez vigilant face aux dérives. Les modèles deviennent obsolètes plus rapidement que la plupart des équipes ne le pensent. Suivez les distributions des données d'entrée, des données de sortie et les conséquences en aval. Configurez des alertes pour chacune d'elles et considérez les variations inexpliquées comme des incidents, et non comme des curiosités.

Préparez la procédure d'escalade avant même d'en avoir besoin. Chaque décision importante concernant un modèle doit pouvoir être validée par un humain et disposer d'un canal d'appel documenté et accessible au client. Si votre équipe de support constitue ce canal, consignez-le également par écrit.

Enfin, identifiez le cadre réglementaire applicable. Aux États-Unis, consultez le NIST AI RMF. En Europe, renseignez-vous sur les exigences relatives aux risques élevés liées à l'IA de l'UE. Si vous intervenez dans le secteur du crédit à la consommation, consultez les circulaires 2022-03 et 2023-03 du CFPB. Effectuer cette démarche dès le départ est nettement moins coûteux que de devoir se conformer à la réglementation après avoir reçu une notification de mise en demeure.

Vous ne parviendrez pas à éliminer complètement l'opacité. C'est normal. L'objectif est de rendre le système observable, traçable et circonscrit. C'est la norme que les organismes de réglementation appliquent déjà, et c'est à cela que ressemblera un déploiement abouti en 2026.