ブラックボックスAIとは何か?ブラックボックス問題の解説

2026年4月、Vectaraの誤認識ランキングは、やや残念な結果を示した。現在、上位の言語モデルは、コアテストにおいて誤認識する割合が4%未満となっている。しかし、GPT-5、Claude Sonnet 4.5、Grok-4、Gemini-3-Proといった新しい「推論」バリアントは、いずれも新しいデータセットにおいて10%を超える誤認識率を示した。Grok-4-fast-reasoningに至っては20.2%に達した。最も賢いモデル、つまり回答する前に「考える」モデルほど、知らないことをきちんと伝える能力が低いという結果になった。

これが、ブラックボックス問題を簡潔にまとめたものです。私たちは、有用な出力を生成するにもかかわらず、開発者自身を含め、誰もその内容を完全に説明できないAIシステムを構築してきました。それらは、調整されていないにもかかわらず正確であり、正直ではないにもかかわらず流暢であり、正しくないにもかかわらず自信に満ちています。

規制当局もこの状況を認識している。EUのAI法では、禁止されている使用に対して最大3500万ユーロ、または全世界売上高の7%の罰金が科せられ、高リスクシステムに関する規則は2026年8月2日に発効する。米国消費者金融保護局は、複雑なアルゴリズムが信用拒否の理由説明を妨げる場合、銀行はそのようなアルゴリズムを使用することはできないと明確に伝えている。そして、5年前にはニッチな分野だった説明可能なAIの分野は、2026年には90億ドルから130億ドルの市場規模になると推定されている。

このガイドでは、ブラックボックスAIとは一体何なのか、なぜ一見シンプルなAIモデルでさえブラックボックス化してしまうのか、ブラックボックス化した場合に何が起こるのか、暗号通貨やフィンテックの分野でブラックボックスがどのような形で現れるのか、説明可能なAIツールキット(SHAP、LIME、反事実分析など)がどのようにブラックボックス化を解決しようとしているのか、そしてEUと米国の新たな規制体制について知っておくべきことなどを解説します。また、よくある誤解を解消するために少し寄り道しますが、blackbox.aiのコーディングアシスタントであるBlackbox AIは、このガイドで紹介するブラックボックスAIとは別物です。

ブラックボックスAIとは何か、そしてなぜそれが重要なのか

ブラックボックスAIとは、内部の推論がユーザーはもちろん、開発者自身にも不透明なAIシステムを指します。入力と出力は可視化されていますが、それらの間の経路は、重み付け、学習済みパターン、機械学習変換といった層の中に隠されており、人間には完全に理解できません。これは、モデルが表形式データ、画像、あるいは翻訳やチャットといった自然言語処理タスクのいずれを扱う場合でも同様です。

この用語は、現代のディープラーニングよりも古い。エンジニアは少なくとも1960年代から、外部から突っつくことはできてもネジを外すことはできないシステム全般を「ブラックボックス」と呼んできた。生物学者は人間の脳自体もブラックボックスだと指摘するが、この比較には限界がある。AIは人間のように機能するわけではなく、そうであると仮定することは、ブラックボックスAIが何を指すのかを誤解する最も手っ取り早い方法の一つである。過去10年間で変化したのは規模だ。現代の大規模な言語モデルは、数千億のパラメータを扱うことができる。典型的なディープニューラルネットワークは、数千の層と数百万のアテンションヘッドに「知識」を分散させ、単一のニューロンが複数の無関係なパターンを同時に符号化する。研究者はこの最後の特性を多義性と呼び、これが機械論的解釈可能性がまだ初期段階にある理由の一つである。

研究機関以外の人々がなぜこのことに関心を持つべきなのか?それは、ブラックボックスAIが今や重大な意思決定を左右しているからだ。AIは信用供与の承認・否認を行い、被告人の信用スコアを算出し、不正取引を検知する。主要な仮想通貨取引所の取引量の大部分を担っている。AIが何らかの誤りを犯した場合、その不透明性ゆえに、原因究明、修正、責任追及はほぼ不可能となる。

AIガバナンスにおいて、不透明性がもはや開発者の問題として扱われなくなったことも、この問題が重要視される理由の一つです。EUはこれを市場アクセス問題として捉え、米国の規制当局は公正な融資の問題として扱っています。2024年以降、AIイニシアチブに署名したすべての経営幹部は、同じ壁にぶつかっています。つまり、「これは実際には何をしているのか、そしてなぜなのか?」という問題です。ブラックボックスAIを理解することはもはや選択肢ではなく、単に別のベンダーを使うだけではブラックボックス問題を解決することはできません。

AIモデルがブラックボックスになる理由

すべてのAIがブラックボックスというわけではありません。単純な決定木は完全に透明です。線形回帰モデルは読み取れる係数を出力します。1990年代のルールベースのAIシステムでさえ、原理的には一行ずつ監査可能です。

では、今日のAIモデルはどのようにしてブラックボックスになってしまうのでしょうか?それは、互いに関連し合う4つの理由によって起こります。

まず、スケールの問題です。数百万、数十億ものパラメータを持つ深層学習モデルは、人間が視覚化できない高次元空間で動作します。2000億個のパラメータを持つモデルを数式で記述することはできますが、それを頭の中で理解できる人は誰もいません。

第二に、分散表現について。深層ニューラルネットワークでは、単一のニューロンが「猫の概念」や「融資拒否のルール」を記憶しているわけではありません。概念は何千ものニューロンに分散し、個々のニューロンは同時に多くの概念に関与しています。明確な説明を抽出することは、クエリではなく、研究プロジェクトと言えるでしょう。

第三に、訓練データへの依存性です。モデルの動作は訓練データによって左右されますが、訓練データは通常、企業秘密であり、膨大で、場合によっては法的問題も伴います。開発者がモデルの重みを公開したとしても、データ自体はめったに共有されません。そのため、「なぜ」という問いに対する重要な答えが欠けてしまうのです。

第四に、意図です。ブラックボックス方式を意図的に採用する実際的な理由があります。一部のAI開発者やプログラマーは、知的財産を保護するためにモデルの内部構造を意図的に隠蔽します。また、ライセンス条件や競争上の優位性といった理由から、ブラックボックス設計を採用することもあります。オープンウェイトモデルであっても、その意思決定を事実上ブラックボックス化することができます。なぜなら、最新のモデルのほとんどは、ドキュメントでは捉えられない創発的なパターンに依存しているからです。1億ドルをモデルに投資した企業は、そのアーキテクチャやトレーニング手順を公開したがらないでしょう。基盤となるコードを共有するオープンソースのAIモデルも、最終的にはブラックボックスと言えます。なぜなら、ユーザーは学習された重みを意味のある解釈で検証することができないからです。

その結果、LLMや生成AIモデルなど、一見単純な高度なAIモデルでさえ、デフォルトでブラックボックスになってしまう。透過的なモデルは例外であり、一般的ではない。複雑なブラックボックスは驚異的な精度を発揮できるため、チームは不透明さにもかかわらず、それらを導入し続けている。豊富で複雑なデータで学習されたブラックボックスAIモデルについても同様だ。ルールベースのAIモデルに対するリフトは、何かが壊れるまで説明可能性の懸念を凌駕するほど大きいことが多い。ほとんどの最新のブラックボックスAIは、ユーザーが学習された重みを検査できないため、最終的にはブラックボックスである。オープンウェイトモデルは基盤となるコードを共有し、ユーザーはアーキテクチャを読むことができるが、「なぜモデルはそう言ったのか」と問うと、基盤となるコードは結局ブラックボックスのままだ。

深層学習におけるブラックボックス問題

ブラックボックス問題とは、これら4つの理由が重なり合った結果生じる問題である。モデル自体は、しばしば驚くほど優れた性能を発揮する。しかし、その動作は、説明、検証、修正という3つのことを同時に拒むという性質を持っている。

典型的な例として、パンダを識別するように訓練された深層学習モデルを考えてみましょう。テストセットでは99%の正答率を達成し、素晴らしい結果に見えます。ところが、誰かが解釈ツールを実行すると、モデルが実際にはパンダを見ていないことが判明します。モデルは竹に注目しているのです。訓練データに含まれるパンダの写真のほとんどには竹も写っています。モデルは近道を学習してしまったのです。竹のないパンダの写真では、モデルは正しく認識できません。

こうした「近道学習」は、ディープラーニングの至るところに見られます。モデルは、根本的な概念とは一致しない統計的な規則性を見つけ出しますが、現実世界が訓練データセットとわずかに異なる場合にのみ、そのことに気づきます。2008年の金融危機は、まさにその歴史的な例です。ガウス分布を前提としたバリュー・アット・リスク(VaR)モデルは、通常の市場ではうまく機能しましたが、異常事態が発生すると破綻しました。これは、モデル開発者が近道だと気づかなかった近道を学習してしまったためです。

今日の深層学習モデルも、より多くのパラメータとより高い信頼度を持つものの、まさに同じ失敗パターンを共有しています。AnthropicやOpenAIなどのチームを含む、メカニズム的解釈可能性の研究者たちは、言語モデルの小さな部分をニューロンごとにリバースエンジニアリングし始めています。彼らの研究は、LLMの内部が整然とした論理よりも絡み合った回路に近いことを示しています。「ここに答えがある」と指し示すことができるポイントは存在しません。ブラックボックス問題は修正すべきバグではなく、構造的な問題なのです。

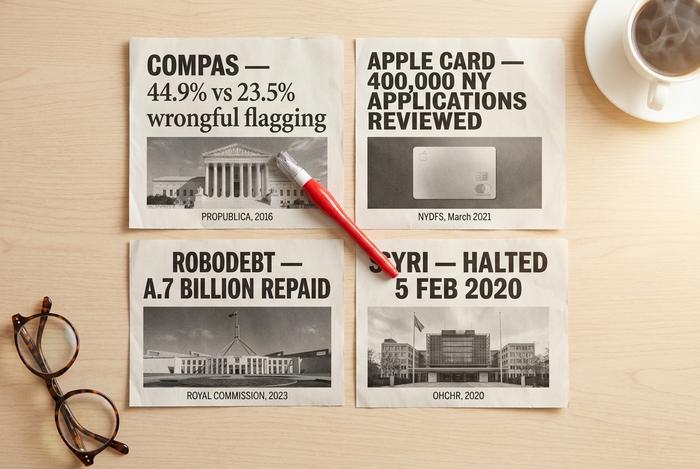

ブラックボックスAIの例:COMPAS、Apple Card、Robodebt、SyRI

ブラックボックスAIが失敗した時の様子を見てみたいですか?誰もが繰り返し引用する4つの事例を見れば、そのほとんどが分かります。刑事司法、銀行、福祉といった分野にまたがり、いずれも実際に人々に被害を与えました。そして、失敗の仕方はどれも全く同じではありませんでした。

COMPASから始めましょう。ノースポイント社が被告の再犯を予測するために開発したもので、米国の裁判所が広く導入しました。その後、プロパブリカが内部を調査しました。2016年の監査では、ブロワード郡の7,000人以上の逮捕者をデータに照らし合わせたところ、結果はひどいものでした。黒人被告は44.9%のケースで誤って高リスクと判定されたのに対し、白人被告の場合はわずか23.5%でした。2024年の追跡調査論文ではさらに悪化しました。2つの特徴(年齢と前科)がCOMPASの137の精度に匹敵しました。つまり、複雑さによって文字通り追加のシグナルは得られず、バイアスを見つけるのがはるかに難しくなっただけでした。これは、製品ではなく人を評価する典型的なブラックボックスモデルです。アマゾンが2018年に廃止した求職者を評価するボックスモデルも同じ形をしています。

そして2019年後半、Apple Cardの件が話題になった。ウォズニアック氏は、妻のクレジットカード利用限度額が自分の10分の1だったと発言。デビッド・ハイネマイヤー・ハンソン氏も同様の発言をした。この話は瞬く間に広まった。ニューヨーク州金融サービス局はこれを重く受け止め、約40万件の申請を精査した。2021年3月、同局は法定の性差別はなかったとの判断を下した。しかし、重要な点として、顧客体験の不透明さ自体が信頼の問題であるとも指摘した。ブラックボックスによる弊害は、結果と認識の両面で半分ずつ影響することが判明した。プレスリリースでは認識面は改善されない。

ロボット債務は、その裏返しと言えるでしょう。高度なニューラルネットワークは一切関わっていません。オーストラリアは2016年から2019年にかけて、福祉受給記録に対して所得平均化ルールを適用し、約40万人の受給者を不正受給で告発しましたが、通知を受け取った人々に計算方法をきちんと説明できませんでした。その後、王立委員会はこの制度を違法と判断しました。政府は17億豪ドルを返還し、さらに1億1200万豪ドルの賠償金を支払いました。教訓:ブラックボックスとなるために、技術的に高度なシステムである必要はありません。説明責任を果たせなければ良いのです。

オランダの「トスラーゲン事件」とSyRIは、ヨーロッパにおけるこの二つの事例を象徴する。2020年2月5日、オランダの裁判所はSyRIの不透明性が欧州人権条約第8条に違反するとして、SyRIの即時停止を命じた。関連する育児手当スキャンダルでは、2万人以上の親が不正行為の疑いをかけられ、ルッテ政権は2021年1月に辞任した。この判決は現在、EUの政策立案者の間で、重要な局面における不透明なAIは倫理的な問題ではなく、法的な問題であることを示す標準的な基準点となっている。

4つの事例。分野も技術も国も異なるが、共通するパターンは、不透明なシステム、重大な結果を招く決定、そしてその決定に抵抗する手段を持たない人々である。

実世界のAIシステムにおけるブラックボックスAIリスク

現実世界のAIシステムにおけるブラックボックスAIリスクを分類し始めると、あるパターンが見えてくる。信用スコアラー、チャットボット、アルゴリズム取引システムなど、モデルの種類に関わらず、同じ5つのリスクが繰り返し現れるのだ。

| リスク | 見た目はどんな感じか | スケールアップする理由 |

|---|---|---|

| 隠れた偏見 | このモデルは保護対象グループを異なる扱いをする | トレーニングデータには過去のパターンが含まれている |

| 幻覚 | モデルが事実や引用を捏造する | LLMは真実ではなく流暢さを重視する |

| ショートカット学習 | このモデルは無関係な相関関係に依存している | 実際の概念よりも学びやすい |

| 敵対的脆弱性 | 入力のわずかな変化が出力を反転させる | 高次元決定境界 |

| 監査の内訳 | 理由を再現できない | 解釈可能な内部状態はありません |

金融、人材採用、医療、暗号通貨などで使用されるブラックボックス型AIシステムでは、こうしたリスクが複合的に発生します。システム内部の複雑な深層学習プロセスにより、次にどこで不具合が発生するかを予測することは困難であり、従来のAI品質保証ツールは、数千億ものパラメータを持つモデルに対応するように設計されていません。

隠れたバイアスは注目を集めるが、より長期的な問題としては、敵対的脆弱性や監査の破綻が挙げられる。安定したバイアスであれば、少なくとも測定して修正することができる。しかし、実行するたびに異なる失敗を繰り返すモデル(2024年のACM TOSEM調査によると、ChatGPTはスマートコントラクト評価タスクの約42%で失敗している)は、規制された用途での認証を取得するのがはるかに難しい。

このリストに新たに加わったのが、研究者たちが「エージェント型AIリスク」と呼ぶものだ。LLMをツールに組み込み、メモリを与え、APIを呼び出すようにすると、不透明度がさらに高まる。一つの意思決定が、モデル呼び出し、取得ドキュメント、ツール呼び出しの連鎖となり、それぞれが部分的に不透明になる。現代のエージェントは、ブラックボックスの中のブラックボックスなのだ。

暗号通貨とフィンテックにおけるブラックボックスAI

ブラックボックスAIを利用するあらゆる業界の中でも、仮想通貨とフィンテックは、導入面とリスク面が最も激しく衝突する分野です。リスクは大きく、レイテンシは短く、情報開示は不十分です。特に仮想通貨分野における規制は、いまだに断片的です。その結果、まず導入し、後からドキュメントを作成する方が有利になるような環境が生まれています。

アルゴリズム取引。アルゴリズム取引は、2025年には暗号資産取引量の推定70~80%を占め、主要株式市場の60~70%を上回りました。Wintermuteだけでも、平均して1日に60以上のプラットフォームで150億ドル以上が動き、2025年には1日当たりの取引量が22億4000万ドルという記録が報告されました。これらの取引の流れの背後にある戦略は、外部の観察者が監査できないディープラーニングのアンサンブルです。2022年11月のアラメダ/FTXの破綻は、リスクを最も明確に示した例です。暗号資産市場全体の時価総額は、約1か月で1兆ドル以上から8000億ドル未満にまで減少しましたが、アラメダのバランスシート上の146億ドルのFTTエクスポージャーは、明らかになるまで見えませんでした。

AMLおよびKYCスコアリング。世界のマネーロンダリング対策ソフトウェア市場は2025年に41億3000万ドルに達し、2030年には93億8000万ドルに達すると予測されています(MarketsandMarkets)。特に暗号資産のAML/KYCコンプライアンスは年平均成長率13.8%で成長しています。ComplyAdvantage、Chainalysis Reactor、Elliptic Navigatorなどのベンダーは現在、ウォレットのリスクスコアリングにブラックボックス機械学習モデルを使用しています。ここでのブラックボックス機械学習の使用は広く普及しており、ほとんどの主要取引所で導入されるほど効果的ですが、不透明なため、コンプライアンス担当者は特定のウォレットがブロックされた理由を再現できないことがよくあります。

スマートコントラクトの監査。AIの限界がはっきりと表れるのはこの分野です。2024年のarXivの研究では、スマートコントラクトの脆弱性検出におけるGPT-4の評価が行われました。精度は96.6%でしたが、再現率はわずか37.8%で、実際の欠陥の約3分の2を見逃しました。ChatGPTの出力は、42%のコントラクトで実行ごとに不安定でした(ACM TOSEM 2024)。GPTと静的解析を組み合わせたGPTScanのようなハイブリッドツールは、トークンコントラクトで90%を超える精度と約70%の再現率を達成しています(arXiv 2308.03314)。CertiK Skynetは現在17,000以上のプロジェクトと約4,940億ドルの市場価値を監視していますが、責任ある監査チームは依然としてAIと人間のレビュー担当者を組み合わせています。

ロボアドバイザー。Bettermentは90万以上の口座で560億ドル以上を運用している。Wealthfrontは429億ドル。ロボアドバイザー業界は世界の運用資産総額が1兆ドルを超えた。ポートフォリオのリバランス、税金対策のための損失確定、リスクスコアリングはすべて機械学習モデルによって行われ、その具体的な決定内容は個人向け資料には一切記載されていない。

信用スコアリングと不正検出。FICOは米国の貸し手の90%で使用されており、FICO Falconは年間650億件以上の取引を処理し、95%以上の不正検出率を報告しています。2024年にイングランド銀行が英国の50の金融機関を対象に行った調査では、機械学習による信用リスクモデルはロジスティック回帰と比較して誤分類を約25%削減することが分かりました。精度の向上は確かにあります。トレードオフとして、CFPB通達2022-03および2023-03の下では、米国の貸し手はECOAに基づく特定の不利な措置の説明を阻止するほど不透明なモデルを使用することはできません。

5つの事例すべてにおいて、同じ傾向が見られる。モデルは、透明性のあるベースラインよりも精度が高い。不透明性は、精度と構造的に切り離せない関係にある。そして、規制当局の対応は、説明可能性ツールの普及よりも速いペースで進んでいる。

Blackbox AIに関する注記:コーディングLLM

簡単に説明しておきましょう。「blackbox AI」で検索する場合、多くの場合、この記事で取り上げている概念的な問題を指しています。また、blackbox.ai という会社、Blackbox AI を指している場合もあります。Blackbox.ai は、開発者がコードを書く方法を変革するために設計されたコーディング LLM です。この製品は VS Code と統合してコーディング エージェントとして機能し、コードを提案し、Claude Code、GitHub Copilot、Cursor などのツールと競合します。複数の AI モデルに基づいて構築された、AI コーディング分野で最もよく知られている高度な AI テクノロジーの 1 つであり、Blackbox が提案するコードは、リファクタリングからテストの足場まで、あらゆるものを網羅しています。Blackbox は、コード生成、チャット、検索を 1 つのワークフローに統合しており、ほとんどのユーザーは、エディタ内で試した中で最高の AI アシスタントだと評価しています。

検索結果では、この2つの意味が混同されることがよくあります。この記事は、Blackbox AIという製品に関するものではありません。ここでは、特定のコーディングアシスタントではなく、不透明なAIシステムの構造的特性について考察します。もし製品名で検索されたのであれば、Blackbox AI社が独自のドキュメントと価格を公開しています。概念名で検索されたのであれば、このまま読み進めてください。

説明可能なAIと説明可能性ツール

説明可能なAI(通常はXAIと略される)は、精度を損なうことなく、不透明なAIモデルを解明しようとする分野です。これは既に実在する市場でもあります。2026年の市場規模は世界全体で90億ドルから130億ドルと予測されており、その差はXAIの定義によって異なります。目標は、チームを低速または低精度のベースラインに戻すことなく、AIモデルの説明可能性を高めることです。優秀なチームは、リリース前にAIツール上でこれらのツールを実行し、その結果を人間が実際に読めるドキュメントと組み合わせます。

XAI技術には、知っておくべき3つの系統がある。

一つ目はSHAP(SHapley Additive exPlanationsの略)です。これは協力ゲーム理論から着想を得たもので、各予測に対して、入力されたすべての特徴量に貢献度スコアを割り当てます。信用スコアリングチームや不正検出チームに高く評価されていますが、医療リスクモデリング担当者には受け入れられています。SHAPは理論的には厳密ですが、大規模な表形式データに対しては計算負荷が非常に高いという難点があります。

2つ目は、LIME(Local Interpretable Model-agnostic Explanations)です。LIMEは、単一の予測に基づいてシンプルで解釈可能な代理モデルを構築し、それを用いて元の予測を説明します。SHAPよりも高速です。テキスト、画像、表に対応しています。ただし、LIMEは設計上ローカルなため、1つの説明が一般化できると想定すると、誤った結果を招く可能性があります。

3つ目は、反事実的説明です。モデルがなぜ「はい」と答えたのかを説明する代わりに、反事実的説明では、答えが「いいえ」に変わるような最小限の入力変更点を示します。これはまさに、信用申請者や問題のある取引の担当者が知りたいこと、「何を変えればよいのか?」ということです。反事実的説明は、規制当局の期待に明確に合致するため、不利益処分通知において急速に普及しつつあります。

これら3つ以外にも、特徴重要度プロット、トランスフォーマー層のアテンション可視化、画像分類器のGrad-CAMなどが見られます。メカニズム解釈可能性、つまり特定のニューロンやアテンション回路をリバースエンジニアリングする手法は、この分野の最先端に位置しています。Anthropic、OpenAI、そして少数の学術研究室が部分的な回路を公開していますが、その成果はまだ企業のコンプライアンスチームが提供できるような形にはなっていません。

このことが最終的にどうなるのか、正直に考えてみましょう。パロアルトネットワークスなどが発表した業界調査によると、XAIは画像分類器や構造化表形式モデルには有効ですが、言語モデル(LLM)には部分的にしか有効ではありません。言語モデル内部のロジックはトークンの位置やコンテキストウィンドウの変化に応じて変化するため、特徴量帰属スコアは説明自体が警告していないような誤解を招く可能性があります。基盤となるコードを共有する説明可能性ツールは有用ですが、ブラックボックス問題に対する完全な解決策ではありません。

ブラックボックスAIの規制:EU AI法、NIST、CFPB

ほとんどのAIベンダーは、規制当局がこれほど迅速に動くとは予想していなかった。しかし、実際はそうだった。「まずは出荷、書類作成は後回し」という従来の姿勢はもはや通用しなくなりつつあり、その理由はごく少数の規制にある。

欧州はEU AI法でいち早くこの法規制を導入しました。これは2025年から2027年にかけて段階的に導入されるもので、一括導入ではありません。禁止行為は2025年2月2日に施行されました。汎用AI規則は2025年8月2日に施行されました。高リスクシステム義務は2026年8月2日から適用され、規制対象製品の適用範囲拡大はそれから1年後の2027年8月2日に開始されます。罰金は見せかけではありません。最も重大な違反に対しては3,500万ユーロまたは全世界売上高の7%、その他の違反に対しては1,500万ユーロまたは3%の罰金が科せられます(DLA Piper、2025年)。高リスクユースケースのリストは、ブラックボックス展開の錚々たる顔ぶれです。信用スコアリング、採用、教育、法執行、生体認証IDなど。これら全てにおいて、文書化、透明性、そして人間の監視がデフォルトで必要となります。

アメリカの状況はより複雑だが、同じ方向に向かっている。NIST AIリスク管理フレームワークは、米国における基準に最も近いものだ。2023年1月に発表され、2024年と2025年に拡張されたこのフレームワークは、技術的に義務付けられているかどうかに関わらず、大企業が自社の対応を定めるための文書として静かに定着している。2025年12月には、サイバーAIプロファイルの暫定草案であるNIST IR 8596が発表され、2026年1月14日にはフォローアップワークショップが開催された。多くのチームが既にこのフレームワークを採用している。

消費者金融保護局は、より率直な見解を示している。通達2022-03号と2023-03号には、債権者が複雑なアルゴリズムを使用することは認められないと明記されている。複雑なアルゴリズムは、ECOAおよび規制Bに基づき、債権者が不利な措置を取った具体的な理由を説明することを妨げる可能性がある。この部分をよく読んでほしい。これは、融資における機械学習の禁止ではない。不透明な機械学習の使用を禁止しているのだ。つまり、拒否された申請者に何が悪かったのかを伝えることができないほど不透明な機械学習の使用を禁止しているのである。事実上、これは消費者信用におけるブラックボックス禁止令に等しい。

銀行は、より古いものの、依然として厳しい要件に直面している。2011年から施行されている連邦準備制度理事会規則SR 11-7は、銀行に対し、重要な意思決定の根拠となるあらゆるモデルを理解していることを証明することを義務付けている。最新のディープラーニングシステムは、外部の支援なしにこのハードルをクリアするのは困難であり、通貨監督庁(OCC)の公報2011-12も同様のアプローチを強制している。

結論として、米国またはEUの規制対象企業は、不透明性を正確性のための許容可能なトレードオフとして扱う言い訳がもはや通用しなくなった。解釈可能性を最初の設計レビューから組み込むか、モデルでは説明できない部分を人間が補うハイブリッド型システムを構築するかのどちらかしかない。執行措置に耐えうる第三の道は存在しない。

ブラックボックスAIシステムの監査方法

では、2026年におけるブラックボックス型AIシステムの責任ある導入とは、実際にはどのようなものになるのだろうか?実践的な手順は、ベンダーが主張するよりもずっと簡潔だ。

まずはデータから始めましょう。トレーニングデータの出所、ラベル付けを行った人物、そしてどのサブグループが含まれているかを記録してください。後々直面するバイアス問題の約半分は既にここに含まれており、追跡できない残りの半分は修正不可能です。

次に、レッドチーム方式でモデルを検証します。敵対的な入力、プロンプトの注入、エッジケース、分布外の例などを用いてモデルを徹底的に調べます。Anthropic、OpenAI、Microsoftは現在、この作業のためのプレイブックを公開しており、新しい手法を開発することなく、それらを応用することができます。

主要なモデルだけでなく、運用中のすべてのモデルにXAIを適用しましょう。表形式のパイプラインにはSHAP、テキストと画像にはLIME、ユーザーにフィードバックするあらゆる意思決定には反事実分析を適用しましょう。これらのツールはどれも完璧ではありませんが、それらが導入されていないと、監査担当者がシステム構成を調査する際に大きな問題となります。

ドリフトに注意しましょう。モデルは、ほとんどのチームが予想するよりも早く陳腐化します。入力分布、出力分布、および下流の結果を追跡してください。それぞれにアラートを設定し、説明のつかない変化は単なる好奇心ではなく、インシデントとして扱いましょう。

必要になる前にエスカレーションパスを構築しておきましょう。重要なモデル決定にはすべて、人間の介入による承認と、顧客が実際に利用できる文書化された異議申し立てチャネルが必要です。サポートチームが異議申し立てチャネルとなる場合は、その旨も明記しておきましょう。

最後に、適用されるフレームワークに照らし合わせて確認してください。米国に拠点を置いている場合はNIST AI RMF、欧州に拠点を置いている場合はEU AI Actの高リスク要件、消費者信用に関わる業務を行っている場合はCFPB通達2022-03および2023-03を参照してください。これを早期に一度実施することで、規制当局から措置が講じられた後に後から対応しようとするよりもはるかに費用を抑えることができます。

ブラックボックスを完全に排除することはできません。それで構いません。重要なのは、それを監視可能で、説明責任が果たされ、境界が明確にされた状態にすることです。これは規制当局が既に実施している基準であり、2026年における成熟した導入形態の姿でもあります。