Что такое ИИ «черного ящика»? Объяснение проблемы «черного ящика».

В апреле 2026 года рейтинг моделей Vectara, демонстрирующих эффект галлюцинаций, вынес неутешительный вердикт. Лучшие языковые модели теперь демонстрируют эффект галлюцинаций менее чем в 4% случаев на основном тесте. Но новые «рациональные» варианты GPT-5, Claude Sonnet 4.5, Grok-4 и Gemini-3-Pro демонстрируют эффект галлюцинаций более чем в 10% случаев на новом наборе данных. Grok-4-fast-reasoning достиг 20,2%. Самые умные модели, те, которые «думают» перед ответом, хуже всего умеют сообщать о своих незнаниях.

В этом и заключается проблема «черного ящика» в одном абзаце. Мы создали системы искусственного интеллекта, которые часто выдают полезные результаты, и никто, включая их создателей, не может полностью их объяснить. Они точны, но не откалиброваны, беглы, но не честны, и уверены, но не правы.

Регуляторы обратили на это внимание. Закон ЕС об искусственном интеллекте теперь предусматривает штрафы в размере до 35 миллионов евро или 7% от мирового оборота за запрещенные виды использования, а правила для систем высокого риска вступят в силу 2 августа 2026 года. Бюро по защите прав потребителей финансовых услуг США прямо заявило банкам, что они не могут использовать сложные алгоритмы, если эти алгоритмы не позволяют им объяснить отказ в предоставлении кредита. А область объяснимого искусственного интеллекта, еще пять лет назад нишевая тема, теперь представляет собой рынок, оцениваемый в 9–13 миллиардов долларов к 2026 году.

В этом руководстве подробно объясняется, что такое «черный ящик» в искусственном интеллекте, почему даже простые на вид модели ИИ становятся «черными ящиками», что происходит, когда это случается, где они встречаются в криптовалютах и финтехе, как инструментарий объяснимого ИИ (SHAP, LIME, контрфактические модели) пытается их взломать, и что вам следует знать о новом режиме регулирования в ЕС и США. Также есть небольшое отступление, чтобы прояснить часто встречающееся недоразумение: «черный ящик» в искусственном интеллекте, помощник по программированию на blackbox.ai, — это совсем другое.

Что такое искусственный интеллект типа «черный ящик» и почему это важно?

Под «черным ящиком» в искусственном интеллекте понимается любая система, чья внутренняя логика непрозрачна для пользователей и, зачастую, для разработчиков, создавших её. Входные и выходные данные видны. Путь между ними скрыт внутри слоев весов, изученных шаблонов и преобразований машинного обучения, которые ни один человек не может полностью понять. То же самое относится к случаям, когда модель обрабатывает табличные данные, изображения или задачи обработки естественного языка, такие как перевод и чат.

Термин «черный ящик» старше современного глубокого обучения. Инженеры используют его, по крайней мере, с 1960-х годов, для обозначения любой системы, которую можно осмотреть снаружи, но нельзя разобрать. Биологи любят подчеркивать, что сам человеческий мозг тоже является «черным ящиком», но это сравнение не совсем корректно: ИИ работает не так, как человек, и предположение об обратном — один из самых быстрых способов неправильно оценить, что подразумевается под «черным ящиком» в ИИ. За последнее десятилетие изменился масштаб. Современная большая языковая модель может содержать сотни миллиардов параметров. Типичная глубокая нейронная сеть распределяет «знания» по тысячам слоев и миллионам механизмов внимания, при этом отдельные нейроны кодируют множество несвязанных паттернов одновременно. Исследователи называют это последнее свойство полисемантичностью, и это одна из причин, почему механистическая интерпретируемость все еще находится на ранней стадии развития.

Почему это должно волновать кого-либо за пределами исследовательских лабораторий? Потому что искусственный интеллект, работающий по принципу «черного ящика», теперь принимает важные решения. Он одобряет и отклоняет кредиты. Он оценивает обвиняемых. Он помечает транзакции как мошеннические. Он управляет значительной частью торгового объема на каждой крупной криптовалютной бирже. Когда он ошибается, непрозрачность делает практически невозможным выяснить причину, исправить ошибку или привлечь кого-либо к ответственности.

Это также важно, потому что в сфере управления ИИ непрозрачность больше не рассматривается как проблема разработчиков. В ЕС теперь это вопрос доступа к рынку. Американские регуляторы рассматривают это как вопрос справедливого кредитования. Каждый руководитель, одобривший инициативу в области ИИ с 2024 года, сталкивался с одной и той же проблемой: что это на самом деле делает и зачем? Понимание «черного ящика» ИИ больше не является необязательным, и проблему «черного ящика» нельзя решить, просто используя другого поставщика.

Почему модели искусственного интеллекта превращаются в «чёрные ящики»

Не каждый ИИ — это чёрный ящик. Простое дерево решений полностью прозрачно. Модель линейной регрессии выдаёт коэффициенты, которые можно прочитать. Даже основанная на правилах система ИИ из 1990-х годов, в принципе, поддаётся построчному аудиту.

Так как же современные модели ИИ превращаются в «черные ящики»? Это происходит по четырем взаимосвязанным причинам.

Во-первых, масштаб. Модели глубокого обучения с миллионами или миллиардами параметров работают в многомерных пространствах, которые человек не может визуализировать. Модель с 200 миллиардами параметров можно описать математически, но никто не сможет удержать её в голове.

Во-вторых, распределенные представления. В глубокой нейронной сети ни один нейрон не хранит «понятие кошки» или «правило отказа в кредите». Понятия разбросаны по тысячам нейронов, и отдельные нейроны одновременно участвуют во многих понятиях. Получение четкого объяснения — это исследовательский проект, а не вопрос.

В-третьих, зависимость от обучающих данных. Поведение модели определяется ее обучающими данными, которые обычно являются конфиденциальными, огромными и иногда сопряжены с юридическими сложностями. Даже когда разработчик публикует веса модели, данные редко передаются другим. Таким образом, отсутствует ключевой аспект вопроса «почему».

В-четвертых, намерение. Существуют практические причины для преднамеренного использования подходов «черного ящика». Некоторые разработчики и программисты ИИ намеренно скрывают внутреннее устройство моделей для защиты интеллектуальной собственности, а другие причины использования конструкций «черного ящика» включают условия лицензирования и конкурентные преимущества. Даже модель с открытыми весами может фактически создать «черный ящик» вокруг своих решений, поскольку большинство современных моделей полагаются на возникающие закономерности, которые не отражены в документации. Компания, инвестировавшая 100 миллионов долларов в модель, не горит желанием публиковать ее архитектуру и процедуру обучения. Модели ИИ с открытым исходным кодом, которые делятся своим базовым кодом, в конечном итоге тоже являются «черными ящиками», поскольку пользователи по-прежнему не могут анализировать изученные веса с какой-либо осмысленной интерпретацией.

В результате даже, казалось бы, простые продвинутые модели ИИ, включая модели с линейными логистическими регрессиями (LLM) и генеративные модели ИИ, по умолчанию становятся «черными ящиками». Прозрачные модели — исключение, а не правило. Сложные «черные ящики» могут демонстрировать впечатляющую точность, поэтому команды продолжают их использовать, несмотря на непрозрачность. То же самое верно и для моделей ИИ типа «черный ящик», обученных на сложных, неструктурированных данных: преимущество перед моделями ИИ, основанными на правилах, часто достаточно велико, чтобы перевесить опасения по поводу объяснимости, пока что-то не сломается. Большинство современных моделей ИИ типа «черный ящик» в конечном итоге остаются «черными ящиками», потому что пользователи по-прежнему не могут проверить изученные веса. Модели с открытыми весами предоставляют общий базовый код, и пользователи могут прочитать архитектуру, но базовый код в конечном итоге оказывается «черным ящиком», когда вы спрашиваете: «Почему модель сказала это?».

Проблема «черного ящика» в глубоком обучении

Проблема «черного ящика» возникает, когда эти четыре причины суммируются. Модель работает, зачастую впечатляюще. Но она работает таким образом, что одновременно сопротивляется трем вещам: объяснению, подтверждению и исправлению.

Рассмотрим классический пример: модель глубокого обучения, обученная распознавать панд. Она набирает 99% на тестовом наборе данных. Всё выглядит отлично. Затем кто-то запускает инструмент для проверки интерпретируемости и обнаруживает, что модель на самом деле смотрит не на панду, а на бамбук. Большинство фотографий панд в обучающих данных также содержат бамбук. Модель научилась использовать обходной путь. На фотографии панды без бамбука модель терпит неудачу.

Подобный вид «обучения на основе упрощенных алгоритмов» повсеместно встречается в глубоком обучении. Модель обнаруживает статистическую закономерность, которая не соответствует лежащей в основе концепции, но это заметно только тогда, когда мир немного отличается от обучающего набора данных. Историческая аналогия здесь — финансовый кризис 2008 года. Модели Value-at-Risk, построенные на гауссовых предположениях, прекрасно работали на нормальных рынках и резко прибавляли в условиях «хвостовых» распределений, потому что они усвоили упрощенные алгоритмы, которые разработчики моделей не осознавали.

Современные модели глубокого обучения демонстрируют точно такой же сбой, но с большим количеством параметров и большей степенью уверенности. Исследователи механистической интерпретируемости, включая команды из Anthropic и OpenAI, начали обратное проектирование небольших частей языковых моделей нейрон за нейроном. Их работа показывает, что внутренняя структура языковой модели ближе к запутанным схемам, чем к упорядоченной логике. Нет точки, в которой можно указать пальцем и сказать: «Вот где находится ответ». Проблема «черного ящика» — это не ошибка, которую нужно исправить; это структурная проблема.

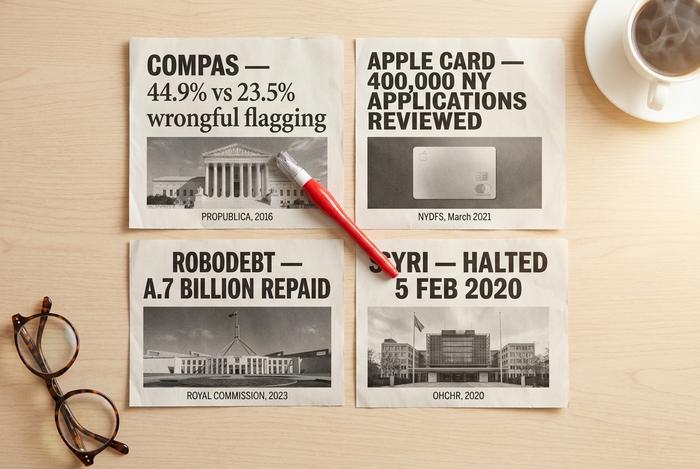

Примеры ИИ типа «черный ящик»: COMPAS, Apple Card, Robodebt, SyRI.

Хотите увидеть, как выглядит искусственный интеллект «чёрного ящика», когда он даёт сбой? Четыре случая, которые все постоянно приводят в пример, говорят сами за себя. Они охватывают уголовное правосудие, банковское дело и социальное обеспечение. Все они причинили вред реальным людям. И ни один из них не потерпел неудачу одинаково.

Начнём с COMPAS. Компания Northpointe разработала его для прогнозирования вероятности повторного совершения преступления подсудимым, и американские суды широко внедрили его. Затем ProPublica заглянула под капот. В ходе аудита 2016 года, проанализировав данные более чем 7000 арестованных в округе Бровард, результаты оказались плачевными: чернокожие подсудимые были ошибочно отнесены к группе высокого риска в 44,9% случаев, в то время как для белых подсудимых этот показатель составил всего 23,5%. В последующем исследовании 2024 года ситуация ещё больше ухудшилась. Два параметра (возраст и наличие предыдущих судимостей) совпали с точностью COMPAS (137). Таким образом, сложность не принесла буквально никакого дополнительного сигнала, но значительно затруднила выявление предвзятости. Это каноническая модель «чёрного ящика», которая оценивает людей, а не продукты. Модель «чёрного ящика», которая оценивает кандидатов на работу, от которой Amazon отказалась в 2018 году, имеет ту же форму.

Затем, в конце 2019 года, появилась Apple Card. Возняк сказал, что его жена получила кредитный лимит в 10 раз меньше, чем у него. Дэвид Хайнемайер Ханссон сказал то же самое. История быстро распространилась в интернете. Департамент финансовых услуг Нью-Йорка отнесся к этому серьезно: они проверили около 400 000 заявок. В марте 2021 года они пришли к выводу об отсутствии дискриминации по половому признаку в соответствии с законом. Но они также написали, и это важная часть, что непрозрачность в отношении клиентского опыта сама по себе является проблемой доверия. Оказывается, вред, причиняемый «черным ящиком», наполовину связан с результатами, а наполовину с восприятием. Пресс-релиз не решает проблему восприятия.

Robodebt — это другая сторона медали. Здесь не используется глубокая нейронная сеть. В период с 2016 по 2019 год Австралия применяла правило усреднения дохода к данным о социальных выплатах, обвинила в мошенничестве около 400 000 получателей и не смогла внятно объяснить расчеты никому из получивших письмо. Королевская комиссия позже признала эту схему незаконной. Правительство вернуло 1,7 миллиарда австралийских долларов, а также выплатило еще 112 миллионов австралийских долларов в качестве компенсации. Вывод: система не обязательно должна быть технически сложной, чтобы быть «черным ящиком». Она просто должна быть безответственной.

Голландский скандал с непрозрачным ИИ и SyRI являются своего рода европейской преградой на пути развития этой системы. 5 февраля 2020 года голландский суд постановил немедленно остановить работу SyRI, заявив, что его непрозрачность нарушает статью 8 Европейской конвенции по правам человека. Связанный с этим скандал с пособиями на уход за детьми затронул более 20 000 родителей, которые были несправедливо обвинены в мошенничестве. Правительство Рютте подало в отставку в январе 2021 года. Это решение теперь является стандартным ориентиром в политических кругах ЕС, объясняющим, почему непрозрачный ИИ в ситуациях с высокими ставками — это не просто этический, а юридический вопрос.

Четыре случая. Разные сектора, разные технологии, разные страны. Одна и та же схема: непрозрачная система, судьбоносное решение и люди, оказавшиеся в проигрыше, без реальной возможности противостоять ему.

Риски «черного ящика» в реальных системах искусственного интеллекта

Как только вы начинаете каталогизировать риски, связанные с «черным ящиком» ИИ в реальных системах искусственного интеллекта, выявляется закономерность. Одни и те же пять рисков повторяются снова и снова, независимо от того, является ли модель системой оценки кредитоспособности, чат-ботом или алгоритмической торговой системой.

| Риск | Как это выглядит | Почему это масштабируется |

|---|---|---|

| Скрытая предвзятость | Модель предусматривает дифференцированный подход к защищенным группам. | Обучающие данные содержат исторические закономерности. |

| Галлюцинация | Модель выдумывает факты или цитаты. | Магистратура по подготовке магистров права направлена на развитие беглости речи, а не на знание истины. |

| Упрощенный способ обучения | Модель основана на нерелевантных корреляциях. | Легче усвоить, чем саму концепцию. |

| Состязательная хрупкость | Небольшое изменение входного сигнала приводит к изменению выходного сигнала. | Границы принятия решений в многомерном пространстве |

| Анализ аудита | Невозможно восстановить причину. | Отсутствует интерпретируемое внутреннее состояние |

Эти риски усугубляются в системах искусственного интеллекта типа «черный ящик», используемых в финансах, подборе персонала, здравоохранении и криптовалютах. Сложные процессы глубокого обучения внутри них затрудняют прогнозирование того, где произойдет следующая ошибка, а традиционные инструменты ИИ для контроля качества не были созданы для моделей с сотнями миллиардов параметров.

Скрытая предвзятость привлекает внимание СМИ, но более серьезными долгосрочными проблемами являются уязвимость, возникающая в результате враждебных действий, и сбои в аудите. Стабильную предвзятость, по крайней мере, можно измерить и скорректировать. Модель, которая каждый раз дает разные результаты при запуске (что происходит с ChatGPT примерно в 42% задач оценки смарт-контрактов, согласно исследованию ACM TOSEM 2024 года), гораздо сложнее сертифицировать для использования в регулируемых целях.

Новейшим участником этого списка является то, что исследователи называют «риском в сфере агентного ИИ». Когда вы интегрируете LLM в инструменты, выделяете ему память и позволяете ему вызывать API, вы значительно увеличиваете непрозрачность. Теперь одно решение представляет собой цепочку вызовов модели, полученных документов и вызовов инструментов, каждый из которых частично непрозрачен. Современные агенты — это черные ящики внутри черных ящиков.

Искусственный интеллект «чёрного ящика» в крипто- и финтех-индустрии

В каждой отрасли, использующей ИИ типа «черный ящик», криптовалюты и финтех — это те сферы, где наиболее остро сталкиваются вопросы внедрения и управления рисками. Ставки велики. Задержка невелика. Раскрытие информации скудно. Регулирование, особенно в криптовалютах, по-прежнему носит фрагментарный характер. В результате создается среда, в которой поощряется сначала внедрение, а затем написание документации.

Алгоритмическая торговля. По оценкам, в 2025 году алгоритмическая торговля обеспечила 70-80% объема криптовалютных операций, что выше, чем 60-70% на основных фондовых рынках. Только Wintermute в среднем ежедневно перемещает более 15 миллиардов долларов через более чем 60 площадок, а рекордный объем операций за один день в 2025 году составил 2,24 миллиарда долларов. Стратегии, лежащие в основе этих потоков, представляют собой ансамбли глубокого обучения, которые не может проверить ни один сторонний наблюдатель. Обвал Alameda/FTX в ноябре 2022 года является наиболее наглядной иллюстрацией риска: общая капитализация криптовалютного рынка упала с более чем 1 триллиона долларов до менее чем 800 миллиардов долларов примерно за месяц, а лежащая в основе задолженность по FTT в размере 14,6 миллиарда долларов на балансе Alameda оставалась невидимой до того момента, пока не стала очевидной.

Оценка рисков в сфере противодействия отмыванию денег (AML) и идентификации клиентов (KYC). Глобальный рынок программного обеспечения для борьбы с отмыванием денег достиг 4,13 млрд долларов в 2025 году и, по прогнозам, составит 9,38 млрд долларов к 2030 году (MarketsandMarkets). В частности, в сфере соблюдения требований AML/KYC в криптоиндустрии наблюдается рост на 13,8% в год. Такие поставщики, как ComplyAdvantage, Chainalysis Reactor и Elliptic Navigator, теперь используют модели машинного обучения «черного ящика» для оценки рисков кошельков. Использование машинного обучения «черного ящика» здесь достаточно широко распространено и эффективно, чтобы быть внедренным на большинстве крупных бирж, и в то же время достаточно непрозрачно, чтобы сотрудники, ответственные за соблюдение требований, часто не могли восстановить причину блокировки конкретного кошелька.

Аудит смарт-контрактов. Именно здесь отчетливо проявляются ограничения ИИ. В исследовании arXiv 2024 года оценивалась эффективность GPT-4 в обнаружении уязвимостей смарт-контрактов. Точность составила 96,6%, но полнота — всего 37,8%, при этом было пропущено почти две трети реальных уязвимостей. Результаты ChatGPT нестабильны при повторном запуске в 42% контрактов (ACM TOSEM 2024). Гибридные инструменты, такие как GPTScan, которые сочетают GPT со статическим анализом, превышают 90% точности и ~70% полноты в контрактах на основе токенов (arXiv 2308.03314). CertiK Skynet сейчас отслеживает более 17 000 проектов и имеет рыночную стоимость около 494 миллиардов долларов, но каждая ответственная аудиторская группа по-прежнему использует ИИ в паре с человеком-экспертом.

Робо-консультанты. Betterment управляет активами на сумму более 56 миллиардов долларов в более чем 900 000 счетов. Wealthfront управляет активами на сумму 42,9 миллиарда долларов. Объем активов под управлением робо-консультантов в мировой индустрии превысил 1 триллион долларов. Ребалансировка портфеля, оптимизация налоговых потерь и оценка рисков осуществляются с помощью моделей машинного обучения, конкретные решения которых не раскрываются ни в одном документе, предназначенном для розничных клиентов.

Кредитный скоринг и выявление мошенничества. FICO используется 90% американских кредиторов, а FICO Falcon обрабатывает более 65 миллиардов транзакций в год с заявленным уровнем выявления мошенничества более 95%. Исследование Банка Англии, проведенное в 2024 году среди 50 британских учреждений, показало, что модели оценки кредитного риска на основе машинного обучения сократили количество ошибок классификации примерно на 25% по сравнению с логистической регрессией. Повышение точности реально. Компромисс заключается в том, что в соответствии с циркулярами CFPB 2022-03 и 2023-03 американские кредиторы не могут использовать модели, достаточно непрозрачные для предотвращения конкретных объяснений неблагоприятных действий в рамках ECOA.

Общая закономерность во всех пяти моделях одинакова. Модель точнее, чем прозрачный базовый вариант. Непрозрачность структурно неотделима от точности. И регулирующие органы догоняют разработчиков быстрее, чем появляются инструменты для обеспечения объяснимости.

Заметка о Blackbox AI: Магистерская программа по программированию.

Быстрое уточнение. Когда люди ищут "blackbox AI", они часто имеют в виду концептуальную проблему, о которой идёт речь в этой статье. Иногда они имеют в виду Blackbox AI, компанию blackbox.ai. Blackbox.ai — это LLM-программа для разработчиков, призванная изменить подход к написанию кода. Продукт интегрируется с VS Code в качестве агента для кодирования, предлагает варианты кода и конкурирует с такими инструментами, как Claude Code, GitHub Copilot и Cursor. Это одна из наиболее известных передовых технологий ИИ в области программирования, построенная на основе множества моделей ИИ, а предлагаемый Blackbox код охватывает всё — от рефакторинга до создания шаблонов для тестирования. Blackbox объединяет генерацию кода, чат и поиск в единый рабочий процесс, и большинство пользователей назвали бы его лучшим ИИ-помощником, который они когда-либо пробовали в своём редакторе.

В результатах поиска эти два значения часто путают. Продукт Blackbox AI не является предметом этой статьи. Мы рассматриваем структурные свойства непрозрачных систем искусственного интеллекта, а не какой-либо конкретный помощник в программировании. Если вы искали этот продукт, компания ведет собственную документацию и информацию о ценах. Если вы искали концепцию, продолжайте читать.

Инструменты для объяснения искусственного интеллекта и обеспечения объяснимости

Объяснимый искусственный интеллект, обычно сокращаемый до XAI, — это область, которая пытается раскрыть непрозрачность моделей ИИ, не жертвуя при этом их точностью. Сейчас это также реальный рынок. По прогнозам, к 2026 году его объем в мире составит от 9 до 13 миллиардов долларов, причем разница зависит от того, чье определение XAI вы принимаете. Цель состоит в том, чтобы сделать модели ИИ более объяснимыми, не заставляя команды возвращаться к более медленным или менее точным базовым моделям. Умные команды запускают эти инструменты на инструментах ИИ перед их выпуском и сопоставляют результаты с документацией, которую может прочитать человек-эксперт.

Стоит ознакомиться с тремя семействами методик XAI.

Первый метод — SHAP, сокращение от SHapley Additive exPlanations (аддитивные объяснения Шэпли). Он заимствован из теории кооперативных игр: для каждого прогноза SHAP присваивает оценку вклада каждой входной характеристике. Команды, занимающиеся кредитным скорингом, в восторге от него. Команды, занимающиеся выявлением мошенничества, тоже. Специалисты по моделированию рисков в здравоохранении терпят его. Теоретически SHAP сложен, но на вычислительных мощностях он представляет собой настоящую проблему при работе с большими табличными данными.

Второй метод — LIME (Local Interpretable Model-agnostic Explanations — локальные, интерпретируемые, не зависящие от модели объяснения). LIME строит простую, интерпретируемую суррогатную модель на основе одного предсказания и использует её для объяснения исходного. Работает быстрее, чем SHAP. Подходит для текста, изображений и таблиц. Однако, LIME по своей сути является локальным методом, поэтому он может ввести в заблуждение, если вы предположите, что одно объяснение является обобщающим.

Третий подход — это контрфактические объяснения. Вместо того чтобы объяснять, почему модель ответила «да», контрфактические объяснения указывают на малейшее изменение входных данных, которое могло бы изменить ответ на «нет». Именно это и хочет знать заявитель на кредит или лицо, в отношении которого была выявлена подозрительная транзакция: «Что мне нужно изменить?». Контрфактические объяснения быстро набирают популярность в уведомлениях об отказе именно потому, что они четко соответствуют ожиданиям регулятора.

Помимо этих трех, вы увидите графики важности признаков, визуализацию внимания для слоев трансформеров и Grad-CAM для классификаторов изображений. Механистическая интерпретируемость, практика обратного проектирования конкретных нейронов и цепей внимания, находится на переднем крае этой области. Anthropic, OpenAI и несколько академических лабораторий опубликовали фрагменты схем, но эта работа пока не нашла применения в проектах, которые могла бы внедрить команда по обеспечению соответствия корпоративным стандартам.

Будьте честны в отношении того, к чему всё это приводит. Исследования, опубликованные Palo Alto Networks и другими компаниями, показывают, что XAI хорошо работает для классификаторов изображений и структурированных табличных моделей, и лишь частично для языковых моделей. Логика внутри языковой модели меняется по мере изменения положения токена и контекстного окна, поэтому оценки атрибуции признаков могут вводить в заблуждение способами, о которых само объяснение не предупреждает. Инструменты объяснимости, которые предоставляют общий базовый код, полезны. Они не являются готовым решением проблемы «чёрного ящика».

Регулирование ИИ по принципу «черного ящика»: Закон ЕС об ИИ, NIST, CFPB.

Большинство поставщиков решений в области ИИ не ожидали такой скорости действий со стороны регулирующих органов. Но они её ожидали. Старая стратегия «сначала внедрять, потом документировать» уходит в прошлое, и тому есть несколько причин.

Европа первой приняла Закон ЕС об искусственном интеллекте. Внедрение осуществляется поэтапно в период с 2025 по 2027 год, а не единовременно. Запрещенные практики вступили в силу 2 февраля 2025 года. Правила общего назначения в области ИИ начали действовать 2 августа 2025 года. Обязательства в отношении систем высокого риска вступят в силу со 2 августа 2026 года, а продление действия правил для регулируемых продуктов — через год, 2 августа 2027 года. Штрафы не просто формальность. 35 миллионов евро или 7% от мирового оборота за наиболее серьезные нарушения, 15 миллионов евро или 3% за остальные (DLA Piper, 2025). Список высокорискованных сценариев использования выглядит как перечень самых распространенных систем «черного ящика»: кредитный скоринг, найм персонала, образование, правоохранительные органы, биометрическая идентификация. Каждый из этих сценариев теперь по умолчанию требует документации, прозрачности и человеческого контроля.

Американская ситуация более запутанная, но движется в том же направлении. Рамочная программа NIST по управлению рисками в сфере ИИ является наиболее близким аналогом базового уровня в США. Выпущенная в январе 2023 года и расширенная в 2024 и 2025 годах, она незаметно стала документом, на который ориентируются крупные предприятия, независимо от того, обязаны ли они это делать технически. В декабре 2025 года был выпущен NIST IR 8596, предварительный проект профиля кибербезопасности в сфере ИИ, а 14 января 2026 года состоялся последующий семинар. Многие команды уже внедряют его.

Бюро по защите прав потребителей финансовых услуг высказалось более прямолинейно. В циркулярах 2022-03 и 2023-03 это прямо указано: кредитор не может использовать сложный алгоритм, если его сложность не позволяет ему указать конкретные причины отказа в соответствии с ECOA и Положением B. Внимательно прочтите это. Это не запрет на использование машинного обучения в кредитовании. Это запрет на машинное обучение, настолько непрозрачное, что вы не можете сказать заявителю, которому было отказано, в чем именно он ошибся. По сути, это запрет на использование «черного ящика» в сфере потребительского кредитования.

Банки сталкиваются со старым, но всё ещё более жёстким требованием. Постановление Федеральной резервной системы SR 11-7, действующее с 2011 года, обязывает банки демонстрировать понимание любой модели, лежащей в основе принятия существенных решений. Современные системы глубокого обучения с трудом справляются с этой задачей без посторонней помощи, и бюллетень OCC 2011-12 поддерживает тот же подход.

В итоге: у любой регулируемой организации в США или ЕС закончились оправдания для того, чтобы считать непрозрачность приемлемым компромиссом в угоду точности. Либо интерпретируемость должна быть заложена с самого начала проектирования, либо создается гибридная система, в которой человек может дать объяснение, недоступное модели. Третьего пути, который выдержал бы принудительные меры, не существует.

Как провести аудит системы искусственного интеллекта типа «черный ящик»

Итак, как же на самом деле выглядит ответственное внедрение системы искусственного интеллекта типа «черный ящик» в 2026 году? Практический сценарий короче, чем утверждают поставщики.

Начните с данных. Задокументируйте, откуда взялись обучающие данные, кто их разметил и какие подгруппы представлены. Примерно половина проблем с предвзятостью, с которыми вы столкнетесь позже, уже закодирована здесь, а ту половину, которую вы не сможете отследить, вы не сможете исправить.

Затем вы проводите проверку модели методом «красной команды». Исследуйте её с помощью враждебных входных данных, внедрения подсказок, граничных случаев и примеров, выходящих за рамки распространённого набора данных. Anthropic, OpenAI и Microsoft теперь публикуют руководства по этой работе, которые вы можете адаптировать, не изобретая новую методологию.

Применяйте XAI ко всем моделям в процессе производства, а не только к основным. SHAP — для табличных конвейеров. LIME — для текста и изображений. Контрфактические сценарии — для любого решения, которое возвращается к пользователю. Ни один из этих инструментов не идеален. С другой стороны, их отсутствие — это тревожный сигнал для любого аудитора, который заглянет в вашу систему.

Следите за отклонениями. Модели устаревают быстрее, чем ожидает большинство команд. Отслеживайте распределение входных данных, распределение выходных данных и конечные результаты. Настройте оповещения для каждого параметра и рассматривайте необъяснимые изменения как инциденты, а не как курьез.

Создайте механизм эскалации заранее, до того, как он понадобится. Каждое важное решение по модели должно предусматривать возможность отмены решения человеком и документированный канал обжалования, которым клиент действительно может воспользоваться. Если каналом обжалования является ваша служба поддержки, задокументируйте это тоже.

Наконец, сопоставьте себя с применимой системой. NIST AI RMF, если вы находитесь в США. Требования ЕС к высокорискованным операциям в сфере ИИ, если вы находитесь в Европе. Циркуляры CFPB 2022-03 и 2023-03, если вы вообще работаете с потребительским кредитованием. Сделать это один раз, на раннем этапе, значительно дешевле, чем перенастраивать систему после того, как на ваш стол попадут документы о принудительном исполнении.

Вы не сможете полностью устранить «чёрный ящик». И это нормально. Задача состоит в том, чтобы сделать его наблюдаемым, подотчётным и ограниченным. Именно такой стандарт уже соблюдают регулирующие органы, и именно так будет выглядеть зрелая реализация в 2026 году.