Що таке чорний ящик ШІ? Пояснення проблеми чорного ящика

У квітні 2026 року рейтинг галюцинацій Vectara виніс незручний вердикт. Найкращі мовні моделі тепер галюцинують менше ніж у 4% випадків в основному тесті. Але нові варіанти «міркування» GPT-5, Claude Sonnet 4.5, Grok-4 та Gemini-3-Pro галюцинують понад 10% на новому наборі даних. Grok-4-fast-reasoning досяг 20,2%. Найрозумніші моделі, ті, що «думають», перш ніж відповісти, найгірше повідомляють, коли не знають.

Це проблема чорної скриньки, як зазначено в одному абзаці. Ми створили системи штучного інтелекту, які часто видають корисні результати, і ніхто, включаючи їхніх творців, не може повністю пояснити, що вони собою являють. Вони точні, але не калібровані, вільно говорять, але не чесні, і впевнені, але не правильні.

Регулятори це помітили. Закон ЄС про штучний інтелект тепер стягує штрафи до 35 мільйонів євро або 7% від світового обороту за заборонене використання, а правила систем високого ризику набувають чинності 2 серпня 2026 року. Бюро фінансового захисту споживачів США чітко заявило банкам, що вони не можуть використовувати складні алгоритми, якщо ці алгоритми заважають їм пояснити відмову в кредиті. А сфера пояснимого штучного інтелекту, нішева тема п'ять років тому, зараз є ринком, який оцінюється від 9 до 13 мільярдів доларів у 2026 році.

У цьому посібнику розповідається, що насправді являє собою штучний інтелект «чорної скриньки», чому навіть прості на вигляд моделі штучного інтелекту стають чорними скриньками, що йде не так, коли це трапляється, де вони з'являються в криптовалюті та фінтеху, як інструментарій штучного інтелекту (SHAP, LIME, контрфактуальні моделі) намагається їх розгадати, і що вам слід знати про новий регуляторний режим у ЄС та США. Також є короткий відступ, щоб прояснити постійну плутанину: ШІ «чорної скриньки», помічник кодування на blackbox.ai, — це зовсім інша річ.

Що таке чорний ящик штучного інтелекту та чому він важливий

Штучний інтелект «чорної скриньки» – це будь-яка система штучного інтелекту, внутрішня логіка якої непрозора для користувачів і, часто, для розробників, які її створили. Вхідні та вихідні дані є видимими. Шлях між ними прихований у шарах вагових коефіцієнтів, вивчених шаблонів та перетворень машинного навчання, які жодна людина не може повністю прочитати. Те саме стосується того, чи обробляє модель табличні дані, зображення чи завдання обробки природної мови, такі як переклад і чат.

Цей термін старший за сучасне глибоке навчання. Інженери використовують термін «чорна скринька» щонайменше з 1960-х років для будь-якої системи, яку можна подивитися ззовні, але не відкрутити. Біологи люблять зазначати, що сам людський мозок також є чорною скринькою, але порівняння заходить лише до певної межі: штучний інтелект працює не так, як людина, і припущення, що він працює, — це один із найшвидших способів неправильно оцінити, що саме мається на увазі під штучним інтелектом «чорна скринька». За останнє десятиліття змінився масштаб. Сучасна велика мовна модель може містити сотні мільярдів параметрів. Типова глибока нейронна мережа поширює «знання» по тисячах шарів і мільйонах головок уваги, причому окремі нейрони кодують одночасно кілька непов'язаних шаблонів. Дослідники називають цю останню властивість полісемантичністю, і це одна з причин, чому механістична інтерпретованість все ще перебуває на ранній стадії розвитку.

Чому комусь поза дослідницькими лабораторіями це має бути цікаво? Тому що штучний інтелект, що працює на принципі «чорної скриньки», тепер приймає важливі рішення. Він схвалює та відхиляє кредити. Він оцінює відповідачів. Він позначає транзакції як шахрайство. Він контролює значну частку обсягу торгів на кожній великій криптовалютній біржі. Коли він щось робить не так, непрозорість робить майже неможливим з'ясувати причину, виправити це або притягнути когось до відповідальності.

Це також важливо, тому що управління ШІ більше не розглядає непрозорість як проблему розробника. ЄС тепер розглядає це як питання доступу до ринку. Регулятори США розглядають це як питання справедливого кредитування. Кожен керівник, який підписав ініціативу ШІ з 2024 року, стикався з однією й тією ж перешкодою: що ця річ насправді робить і чому? Розуміння ШІ «чорної скриньки» більше не є необов'язковим, і ви не можете вирішити проблему «чорної скриньки», просто використовуючи іншого постачальника.

Чому моделі штучного інтелекту стають чорними скриньками

Не кожен ШІ є чорною скринькою. Просте дерево рішень повністю прозоре. Модель лінійної регресії видає коефіцієнти, які ви можете прочитати. Навіть система ШІ на основі правил з 1990-х років, в принципі, може бути перевірена рядок за рядком.

Тож як сучасні моделі штучного інтелекту стають чорними скриньками? Це відбувається з чотирьох причин, що перетинаються.

По-перше, масштаб. Моделі глибокого навчання з мільйонами або мільярдами параметрів працюють у багатовимірних просторах, які людина не може уявити. Ви можете описати модель з 200 мільярдами параметрів математикою, але ніхто не може втримати її в голові.

По-друге, розподілені представлення. У глибокій нейронній мережі жоден окремий нейрон не зберігає «концепцію кота» чи «правило відхилення позики». Концепції розподілені по тисячах нейронів, а окремі нейрони беруть участь у багатьох концепціях одночасно. Вилучення чіткого пояснення – це дослідницький проект, а не запит.

По-третє, залежність від навчальних даних. Поведінка моделі формується її навчальними даними, які зазвичай є власницькими, гігантськими, а іноді й юридично загрожують. Навіть коли розробник публікує ваги моделі, дані рідко поширюються. Тому ключова частина питання «чому» відсутня.

По-четверте, намір. Існують практичні причини для навмисного використання підходів «чорної скриньки». Деякі розробники та програмісти ШІ навмисно приховують внутрішні механізми моделей, щоб захистити інтелектуальну власність, а інші причини використання дизайну «чорної скриньки» включають ліцензійні умови та конкурентні рови. Навіть модель з відкритою вагою може ефективно створити чорну скриньку навколо своїх рішень, оскільки більшість сучасних моделей спираються на нові шаблони, про які немає жодної документації. Компанія, яка інвестувала 100 мільйонів доларів у модель, не прагне публікувати свою архітектуру та процедуру навчання. Моделі ШІ з відкритим кодом, які діляться своїм базовим кодом, зрештою також є чорними скриньками, оскільки користувачі все ще не можуть перевірити вивчені ваги з будь-якою змістовною інтерпретацією.

У результаті навіть, здавалося б, прості, просунуті моделі ШІ, включаючи LLM та генеративні моделі ШІ, за замовчуванням стають чорними скриньками. Прозорі моделі є винятком, а не правилом. Складні чорні скриньки можуть забезпечити вражаючу точність, тому команди продовжують їх розгортати, незважаючи на непрозорість. Те саме стосується моделей ШІ «чорних скриньок», навчених на багатих, невпорядкованих даних: перевага над моделями ШІ на основі правил часто є достатньо великою, щоб подолати проблеми з пояснювальністю, доки щось не зламається. Більшість сучасних ШІ «чорних скриньок» зрештою є чорними скриньками, оскільки користувачі все ще не можуть перевіряти вивчені ваги. Моделі з відкритими вагами діляться своїм базовим кодом, і користувачі можуть читати архітектуру, але базовий код зрештою є чорними скриньками, коли ви запитуєте: «чому модель так сказала?».

Проблема чорної скриньки в глибокому навчанні

Проблема чорної скриньки виникає, коли ці чотири причини поєднуються. Модель працює, часто вражаюче. Але вона працює таким чином, що протистоїть трьом речам одночасно: поясненню, перевірці та виправленню.

Візьмемо класичну ілюстрацію: модель глибокого навчання, навчену ідентифікувати панд. Вона набирає 99% на тестовому наборі. Виглядає чудово. Потім хтось запускає інструмент інтерпретації та виявляє, що модель насправді не дивиться на панду. Вона звертає увагу на бамбук. Більшість фотографій панд у навчальних даних також містять бамбук. Модель навчилася скороченому шляху. На фотографії панди без бамбука модель не працює.

Такий вид «скороченого навчання» є скрізь у глибокому навчанні. Модель знаходить статистичну закономірність, яка не відповідає основній концепції, але ви помічаєте це лише тоді, коли світ виглядає дещо інакше, ніж навчальний набір. Фінансова криза 2008 року є тут історичною аналогією. Моделі Value-at-Risk, побудовані на гауссових припущеннях, чудово працювали на нормальних ринках і вибухнули в умовах хвоста, тому що вони вивчили скорочені шляхи, які моделери не усвідомлювали як скорочені шляхи.

Сучасні моделі глибокого навчання мають саме такий режим відмови, з більшою кількістю параметрів та більшою впевненістю. Дослідники механістичної інтерпретації, включаючи команди Anthropic та OpenAI, почали зворотне проектування невеликих частин мовних моделей нейрон за нейроном. Їхня робота показує, що всередині LLM ближче до заплутаних схем, ніж до акуратної логіки. Немає точки, коли можна просто сказати: «ось де знаходиться відповідь». Проблема чорної скриньки — це не помилка, яку потрібно виправити; вона структурна.

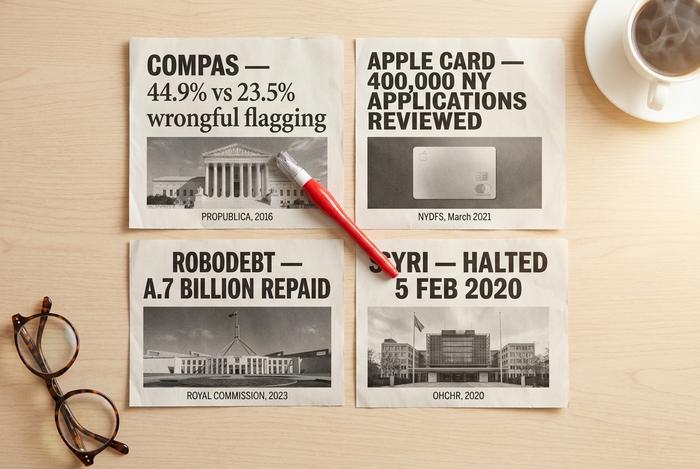

Приклади штучного інтелекту чорної скриньки: COMPAS, Apple Card, Robodebt, SyRI

Хочете побачити, як виглядає штучний інтелект у чорній скриньці, коли він падає? Чотири випадки, які всі постійно наводять, розкажуть вам більшість того, що вам потрібно знати. Вони охоплюють кримінальне правосуддя, банківську справу та соціальне забезпечення. Усі вони завдали шкоди реальним людям. І жодні два не зазнали однакової невдачі.

Почнімо з COMPAS. Northpointe створила його, щоб передбачити, чи вчинить підсудний повторно злочин, і суди США широко розгорнули його. Потім ProPublica зазирнула під капот. Їхній аудит 2016 року провів перевірку даних понад 7000 заарештованих з округу Бровард, і результат був жахливим: темношкірі підсудні були помилково позначені як такі, що мають високий ризик, у 44,9% випадків, тоді як для білих підсудних цей показник становив лише 23,5%. Подальша робота 2024 року погіршила ситуацію. Дві характеристики (вік та попередні судимості) відповідали точності 137 показника COMPAS. Тож складність буквально не додала жодного додаткового сигналу, але значно ускладнила виявлення упередженості. Це канонічна модель чорної скриньки, яка оцінює людей, а не продукти. Модель скриньки, яка оцінює кандидатів на роботу, та, яку Amazon скасував у 2018 році, відповідає тій самій формі.

Потім Apple Card, наприкінці 2019 року. Возняк сказав, що його дружина отримала кредитний ліміт у 10 разів менший, ніж його. Девід Хайнемайєр Ганссон сказав те саме. Історія стала вірусною. Департамент фінансових послуг Нью-Йорка поставився до цього серйозно: вони переглянули приблизно 400 000 заявок і перевірили. У березні 2021 року вони повернулися з вердиктом про відсутність законодавчої гендерної дискримінації. Але вони також написали, і це найважливіше, що непрозорість клієнтського досвіду сама по собі була проблемою довіри. Виявляється, що шкода від чорної скриньки наполовину пов'язана з результатами, а наполовину зі сприйняттям. Прес-реліз не виправляє проблему сприйняття.

Robodebt — це зворотний бік медалі. Глибокої нейронної мережі не було задіяно. Австралія застосовувала правило усереднення доходів до даних про соціальне забезпечення між 2016 і 2019 роками, звинуватила приблизно 400 000 одержувачів у шахрайстві та не змогла чітко пояснити розрахунок нікому, хто отримав листа. Пізніше Королівська комісія назвала схему незаконною. Уряд повернув 1,7 мільярда австралійських доларів плюс ще 112 мільйонів австралійських доларів компенсації. Урок: система не обов'язково має бути технічно складною, щоб бути чорною скринькою. Вона просто повинна бути безпідзвітною.

Нідерландська toeslagenaffaire та SyRI є європейським центром уваги. 5 лютого 2020 року нідерландський суд наказав негайно припинити діяльність SyRI, постановивши, що її непрозорість порушує статтю 8 Європейської конвенції з прав людини. Пов'язаний із цим скандал з допомогою на догляд за дітьми охопив понад 20 000 батьків, яких помилково звинуватили у шахрайстві. Уряд Рютте пішов у відставку через це у січні 2021 року. Це рішення зараз є стандартною точкою відліку в політичних колах ЄС щодо того, чому непрозорий ШІ в умовах високого ризику не є питанням м'якої етики, а юридичним.

Чотири випадки. Різні сектори, різні технології, різні країни. Та сама схема: непрозора система, серйозне рішення та люди, які постраждали та не мають реальної можливості чинити опір.

Ризик чорної скриньки штучного інтелекту в реальних системах штучного інтелекту

Щойно ви починаєте каталогізувати ризики ШІ «чорної скриньки» в реальних системах ШІ, виявляється певна закономірність. Ті самі п'ять ризиків з'являються знову і знову, незалежно від того, чи є модель кредитним скорером, чат-ботом чи системою алгоритмічної торгівлі.

| Ризик | Як це виглядає | Чому це масштабується |

|---|---|---|

| Прихована упередженість | Модель по-різному ставиться до захищених груп | Дані навчання містять історичні закономірності |

| Галюцинації | Модель вигадує факти або цитати | Магістр права оптимізує плавність викладу, а не істинність |

| Скорочене навчання | Модель спирається на нерелевантні кореляції | Легше вивчити, ніж реальну концепцію |

| Крихкість суперництва | Невелика зміна вхідного сигналу змінює вихідний сигнал | Високовимірні межі рішень |

| Розбивка аудиту | Неможливо відтворити причину | Немає інтерпретованого внутрішнього стану |

Ці ризики поєднуються в системах штучного інтелекту «чорної скриньки», що використовуються у фінансах, наймі, охороні здоров'я та криптовалюті. Складні процеси глибокого навчання всередині них ускладнюють прогнозування наступного збою, а традиційні інструменти штучного інтелекту для контролю якості не були створені для моделей із сотнями мільярдів параметрів.

Прихована упередженість потрапляє в заголовки газет, але крихкість суперництва та збій аудиту є більшими довгостроковими проблемами. Стабільну упередженість можна принаймні виміряти та виправити. Модель, яка по-різному спрацьовує щоразу, коли ви її запускаєте (що ChatGPT і робить приблизно у 42% завдань оцінки смарт-контрактів згідно з дослідженням ACM TOSEM за 2024 рік), набагато важче сертифікувати для регульованого використання.

Найновішим учасником цього списку є те, що дослідники називають «ризиком агентного ШІ». Коли ви підключаєте LLM до інструментів, надаєте йому пам'ять і дозволяєте викликати API, ви посилюєте непрозорість. Одне рішення тепер є ланцюжком викликів моделі, отриманих документів та викликів інструментів, кожен з яких частково непрозорий. Сучасні агенти — це чорні скриньки всередині чорних скриньок.

Штучний інтелект чорної скриньки в криптовалюті та фінтех

З усіх галузей, що використовують штучний інтелект «чорної скриньки», саме в криптовалюті та фінтех сторони розгортання та ризиків стикаються найбільше. Ставки великі. Затримка коротка. Розкриття інформації слабке. Регулювання, особливо в криптовалюті, все ще є неоднорідним. Результатом є середовище, яке спочатку винагороджує розгортання, а потім написання документації.

Алгоритмічна торгівля. Алгоритмічна торгівля забезпечила приблизно 70-80% обсягу криптовалют у 2025 році, що перевищує 60-70% частку на основних фондових ринках. Тільки Wintermute переміщує понад 15 мільярдів доларів на понад 60 майданчиках в середньому за день, з рекордним обсягом у 2,24 мільярда доларів за один день, зареєстрованим у 2025 році. Стратегії, що стоять за цими потоками, є ансамблями глибокого навчання, які жоден сторонній спостерігач не може перевірити. Крах Alameda/FTX у листопаді 2022 року є найяскравішою ілюстрацією ризику: загальна капіталізація крипторинку впала з понад 1 трильйона доларів до менш ніж 800 мільярдів доларів приблизно за місяць, а базовий обсяг FTT у розмірі 14,6 мільярда доларів на балансі Alameda був невидимим до того моменту, коли він став невидимим.

Оцінка AML та KYC. Глобальний ринок програмного забезпечення для боротьби з відмиванням грошей досяг 4,13 мільярда доларів у 2025 році та, за прогнозами, до 2030 року становитиме 9,38 мільярда доларів (MarketsandMarkets). Дотримання криптовалют AML/KYC зростає зі середньорічним темпом зростання 13,8%. Такі постачальники, як ComplyAdvantage, Chainalysis Reactor та Elliptic Navigator, зараз використовують моделі машинного навчання «чорної скриньки» для оцінки ризиків гаманців. Використання машинного навчання «чорної скриньки» тут широко поширене та достатньо ефективне для розгортання на більшості великих бірж, а також достатньо непрозоре, щоб співробітники з дотримання вимог часто не могли відновити причину блокування певного гаманця.

Аудит смарт-контрактів. Саме тут чітко проявляються межі ШІ. Дослідження arXiv 2024 року оцінило GPT-4 щодо виявлення вразливостей смарт-контрактів. Він досяг точності 96,6%, але лише 37,8% повноти, пропускаючи майже дві третини реальних недоліків. Вихідні дані ChatGPT нестабільні протягом циклів у 42% контрактів (ACM TOSEM 2024). Гібридні інструменти, такі як GPTScan, які поєднують GPT зі статичним аналізом, перевищують 90% точності та ~70% повноти для токен-контрактів (arXiv 2308.03314). CertiK Skynet зараз контролює понад 17 000 проектів та приблизно 494 мільярди доларів ринкової вартості, але кожна відповідальна аудиторська команда все ще поєднує ШІ з людиною-рецензентом.

Робо-консультанти. Betterment управляє понад 56 мільярдами доларів на понад 900 000 рахунків. Wealthfront становить 42,9 мільярда доларів. Індустрія робо-консультантів перевищила 1 трильйон доларів у світовому активі під управлінням. Ребалансування портфеля, збір податкових збитків та оцінка ризиків здійснюються на основі моделей машинного навчання, конкретні рішення яких не розкриваються в жодному документі, орієнтованому на роздрібну торгівлю.

Кредитний скоринг та виявлення шахрайства. FICO використовується 90% кредиторів США, а FICO Falcon обробляє понад 65 мільярдів транзакцій на рік із заявленим рівнем виявлення шахрайства понад 95%. Дослідження Банку Англії, проведене у 2024 році серед 50 установ Великої Британії, показало, що моделі кредитного ризику відмивання грошей зменшили кількість неправильних класифікацій приблизно на 25% порівняно з логістичною регресією. Підвищення точності є реальним. Компроміс полягає в тому, що згідно з циркулярами CFPB 2022-03 та 2023-03 кредитори США не можуть використовувати моделі, які є достатньо непрозорими, щоб запобігти конкретним поясненням несприятливих дій згідно з ECOA.

Закономірність для всіх п'яти однакова. Модель точніша, ніж прозора базова лінія. Непрозорість структурно невіддільна від точності. А регулятори наздоганяють швидше, ніж інструменти пояснювальності.

Примітка щодо Blackbox AI: The Coding LLM

Швидке пояснення. Коли люди шукають «blackbox AI», вони часто мають на увазі концептуальну проблему, про яку йдеться в цій статті. Іноді вони мають на увазі Blackbox AI, компанію blackbox.ai. Blackbox.ai — це LLM з кодування, розроблена для трансформації способу написання коду розробниками. Продукт інтегрується з VS Code як агент кодування, пропонує код і конкурує з такими інструментами, як Claude Code, GitHub Copilot і Cursor. Це одна з найвідоміших передових технологій штучного інтелекту в просторі кодування штучного інтелекту, побудована на кількох моделях штучного інтелекту, а код, який пропонує Blackbox, охоплює все: від рефакторингу до тестового скатування. Blackbox інтегрує генерацію коду, чат і пошук в один робочий процес, і більшість користувачів назвали б його найкращим помічником штучного інтелекту, якого вони пробували у своєму редакторі.

Ці два значення часто плутаються в результатах пошуку. Продукт Blackbox AI не є темою цієї статті. Ми розглядаємо структурну властивість непрозорих систем штучного інтелекту, а не якийсь окремий помічник з кодування. Якщо ви шукали продукт, компанія має власну документацію та ціни. Якщо ви шукали саму концепцію, продовжуйте читати.

Зрозумілий ШІ та інструменти для пояснення

Поясний ШІ, зазвичай скорочено XAI (пояснювальний штучний інтелект), – це галузь, яка намагається розкрити непрозорі моделі ШІ, не знижуючи їхньої точності. Зараз це також реальний ринок. Прогнози на 2026 рік становлять від 9 до 13 мільярдів доларів у світі, причому розрив залежить від того, чиє визначення XAI ви приймаєте. Мета полягає в тому, щоб зробити моделі ШІ більш поясними, не змушуючи команди повертатися до повільніших або менш точних базових рівнів. Розумні команди запускають ці інструменти на інструментах ШІ перед їх випуском і поєднують результати з документацією, яку людина-рецензент може фактично прочитати.

Варто знати три сімейства техніки XAI.

Перший – це SHAP, скорочення від SHapley Additive exPlanations (адитивні пояснення SHapley). Він запозичений з теорії кооперативних ігор: для кожного прогнозу SHAP призначає кожній вхідній ознаці певний бал внеску. Команди з оцінки кредитоспроможності його люблять. Команди з виявлення шахрайства його люблять. Моделювання ризиків у сфері охорони здоров'я його терпить. SHAP теоретично суворий, але обчислювально він просто звір для великих табличних даних.

Другий — LIME (Local Interpretable Model-Agnostic Explanations, Локальні Інтерпретовані Модельно-Агностичні Пояснення). LIME будує просту, інтерпретовану сурогатну модель навколо одного прогнозу та використовує його для пояснення оригіналу. Швидший, ніж SHAP. Працює з текстом, зображеннями та таблицями. Загвоздка в тому, що LIME є локальним за своєю природою, тому він може ввести вас в оману, якщо ви припустите, що одне пояснення узагальнює.

Третє – це контрфактуальні пояснення. Замість того, щоб пояснювати, чому модель сказала «так», контрфактуальні пояснення повідомляють про найменшу зміну вхідних даних, яка б змінила відповідь на «ні». Саме це хоче знати заявник на отримання кредиту або позначена транзакція: «Що мені потрібно змінити?». Контрфактуальні пояснення швидко набувають популярності в повідомленнях про несприятливі дії саме тому, що вони чітко відповідають очікуванням регулятора.

Окрім цих трьох, ви побачите графіки важливості ознак, візуалізацію уваги для трансформаторних шарів та Grad-CAM для класифікаторів зображень. Механістична інтерпретованість, практика зворотного проектування певних нейронів та ланцюгів уваги, знаходиться на передовій галузі. Anthropic, OpenAI та кілька академічних лабораторій опублікували часткові схеми, але ця робота ще не втілилася в те, що команда з дотримання корпоративних вимог може представити.

Будьте чесними щодо того, де все це працює. Галузеве дослідження, опубліковане Palo Alto Networks та іншими, зазначає, що XAI добре працює для класифікаторів зображень та структурованих табличних моделей, і лише частково для LLM. Логіка всередині мовної моделі змінюється зі зміною позиції токена та контекстного вікна, тому оцінки атрибуції ознак можуть вводити в оману таким чином, про що саме пояснення вас не попереджає. Інструменти пояснювальності, які мають спільний базовий код, корисні. Вони не є завершеним рішенням проблеми чорної скриньки.

Регулювання ШІ «чорної скриньки»: Закон ЄС про ШІ, NIST, CFPB

Більшість постачальників штучного інтелекту не очікували, що регуляторні органи діятимуть так швидко. Але вони очікували. Стара практика «відправляй зараз, документуй потім» вже не втрачає своєї актуальності, і причиною цього є невелика кількість правил.

Європа першою досягла цього завдяки Закону ЄС про штучний інтелект. Він передбачає поетапне впровадження з 2025 по 2027 рік, а не одноразове перемикання. Заборонені практики набули чинності 2 лютого 2025 року. Загальні правила щодо штучного інтелекту набули чинності 2 серпня 2025 року. Зобов'язання щодо високоризикових систем набувають чинності з 2 серпня 2026 року, а розширення для регульованих продуктів відбувається через рік, 2 серпня 2027 року. Штрафи не для показухи. 35 мільйонів євро або 7% світового обороту за найсерйозніші порушення, 15 мільйонів євро або 3% для решти (DLA Piper, 2025). А список випадків використання з високим рівнем ризику виглядає як список «хто є хто» у розгортанні «чорної скриньки»: кредитний скоринг, найм, освіта, правоохоронні органи, біометрична ідентифікація. Тепер кожен з них за замовчуванням вимагає документації, прозорості та людського контролю.

Американська картина більш хаотична, але рухається в тому ж напрямку. Структура управління ризиками для штучного інтелекту NIST (NIST AI Risk Management Framework) найближче до базового рівня для США. Випущена в січні 2023 року, розширена на 2024 та 2025 роки, вона непомітно стала документом, до якого великі підприємства повинні дотримуватися, незалежно від того, чи повинні вони технічно це робити. У грудні 2025 року було опубліковано NIST IR 8596, попередній проект профілю кібер-штучного інтелекту (Cyber AI Profile), а 14 січня 2026 року відбувся наступний семінар. Багато команд вже впроваджують її.

Бюро фінансового захисту споживачів було більш прямолінійним. У циркулярах 2022-03 та 2023-03 це прямо зазначено: кредитор не може використовувати складний алгоритм, якщо його складність заважає йому надати конкретні причини для несприятливих дій згідно з ECOA та Регламентом B. Уважно прочитайте це. Це не заборона на машинне навчання в кредитуванні. Це заборона на машинне навчання настільки непрозора, що ви не можете сказати заявнику, якому відмовлено, що він зробив неправильно. Фактично, це заборона на споживчий кредит за принципом «чорної скриньки».

Банки стикаються зі старою, але все ще жорсткішою вимогою. Федеральна резервна система SR 11-7, яка діє з 2011 року, зобов'язує банки демонструвати, що вони розуміють будь-яку модель, яка керує суттєвим рішенням. Сучасні системи глибокого навчання намагаються подолати цю позначку без сторонньої допомоги, і Бюлетень OCC 2011-12 застосовує той самий підхід.

Кінцевий результат: будь-яка регульована організація в США чи ЄС вичерпала всі виправдання для того, щоб розглядати непрозорість як прийнятний компроміс заради точності. Або інтерпретованість вбудовується з першого огляду проекту, або ви створюєте гібрид, де людина несе пояснення, яке модель не може. Немає третього шляху, який би пережив дії правоохоронних органів.

Як провести аудит системи штучного інтелекту «чорної скриньки»

Тож як насправді виглядатиме відповідальне розгортання системи штучного інтелекту «чорний ящик» у 2026 році? Практичний план коротший, ніж стверджують постачальники.

Ви починаєте з даних. Задокументуйте, звідки взяті навчальні дані, хто їх позначив і які підгрупи представлені. Приблизно половина проблем зміщення, з якими ви зіткнетеся пізніше, вже закодовані тут, а половину, яку ви не можете простежити, — це половину, яку ви не можете виправити.

Потім ви об'єднуєте модель у червоні команди. Досліджуєте її за допомогою змагальних вхідних даних, швидких введень, граничних випадків та прикладів поза розповсюдженням. Anthropic, OpenAI та Microsoft зараз публікують методичні посібники для цієї роботи, які ви можете адаптувати, не винаходячи нової методології.

Застосовуйте XAI до кожної моделі у продакшені, а не лише до заголовків. SHAP для табличних конвеєрів. LIME для тексту та зображень. Контрфактуальні варіанти для будь-якого рішення, яке повертається до користувача. Жоден з цих інструментів не є ідеальним. З іншого боку, їхня відсутність є червоним прапорцем для будь-якого аудитора, який заходить у ваш стек.

Слідкуйте за дрейфом. Моделі застарівають швидше, ніж очікує більшість команд. Відстежуйте розподіл вхідних даних, розподіл вихідних даних та результати подальшого розвитку. Встановлюйте сповіщення для кожного з них та розглядайте незрозумілі зміни як інциденти, а не курйози.

Створіть шлях ескалації, перш ніж він вам знадобиться. Кожне рішення щодо моделі, що має наслідки, повинно мати можливість скасувати це людиною та задокументований канал оскарження, який клієнт може фактично використовувати. Якщо ваша команда підтримки є каналом оскарження, запишіть це також.

Нарешті, зіставте себе з застосовною структурою. NIST AI RMF, якщо ви перебуваєте в США. Вимоги щодо високого ризику згідно із Законом ЄС про штучний інтелект, якщо ви перебуваєте в Європі. Циркуляри CFPB 2022-03 та 2023-03, якщо ви взагалі торкаєтеся споживчого кредиту. Зробити це один раз і на ранній стадії значно дешевше, ніж модернізувати після того, як на вашому столі з'явиться захід щодо правозастосування.

Ви не позбудетесь чорної скриньки. Це нормально. Завдання полягає в тому, щоб зробити її спостережуваною, підзвітною та обмеженою. Це стандарт, який регулятори вже застосовують, і саме так виглядатиме зріле впровадження у 2026 році.