Czym jest sztuczna inteligencja typu „czarna skrzynka”? Wyjaśnienie problemu „czarnej skrzynki”

W kwietniu 2026 roku ranking halucynacji Vectary wydał niefortunny werdykt. Najlepsze modele językowe mają obecnie halucynacje w mniej niż 4% przypadków w teście podstawowym. Jednak nowe warianty „rozumowania” GPT-5, Claude Sonnet 4.5, Grok-4 i Gemini-3-Pro mają halucynacje w ponad 10% przypadków w nowym zestawie danych. Szybkie rozumowanie Grok-4 osiągnęło 20,2%. Najmądrzejsze modele, te, które „myślą”, zanim udzielą odpowiedzi, najgorzej radzą sobie z mówieniem, kiedy czegoś nie wiedzą.

To jest problem czarnej skrzynki opisany w jednym akapicie. Zbudowaliśmy systemy sztucznej inteligencji, które często generują użyteczne wyniki, których nikt, łącznie z ich twórcami, nie potrafi w pełni wyjaśnić. Są precyzyjne, ale nie skalibrowane, płynne, ale nie uczciwe, i pewne siebie, ale nie poprawne.

Regulatorzy to zauważyli. Unijna ustawa o sztucznej inteligencji (AI) nakłada obecnie grzywny w wysokości do 35 milionów euro lub 7% globalnego obrotu za niedozwolone zastosowania, a przepisy dotyczące systemów wysokiego ryzyka zaczną obowiązywać 2 sierpnia 2026 r. Amerykańskie Biuro Ochrony Konsumentów (Consumer Financial Protection Bureau) jasno poinformowało banki, że nie mogą korzystać ze złożonych algorytmów, jeśli uniemożliwiają im one wyjaśnienie odmowy udzielenia kredytu. Rynek sztucznej inteligencji (AI), który pięć lat temu był niszowy, jest obecnie szacowany na 9–13 miliardów dolarów w 2026 roku.

W tym przewodniku dowiesz się, czym właściwie jest sztuczna inteligencja typu black box, dlaczego nawet pozornie proste modele AI stają się czarnymi skrzynkami, co się wtedy psuje, gdzie pojawiają się w kryptowalutach i fintechu, jak zestaw narzędzi do wyjaśniania sztucznej inteligencji (SHAP, LIME, kontrfakty) próbuje je rozszyfrować oraz co warto wiedzieć o nowym systemie regulacyjnym w UE i USA. Znajdziesz tu również krótki dygresję, która rozwieje powtarzające się wątpliwości: Blackbox AI, asystent kodowania w blackbox.ai, to zupełnie inna sprawa.

Czym jest sztuczna inteligencja typu „black box” i dlaczego jest ważna

Termin „sztuczna inteligencja czarnej skrzynki” odnosi się do każdego systemu AI, którego wewnętrzne rozumowanie jest niejasne dla użytkowników, a często również dla programistów, którzy go stworzyli. Dane wejściowe i wyjściowe są widoczne. Ścieżka między nimi jest ukryta w warstwach wag, wyuczonych wzorców i transformacji uczenia maszynowego, których żaden człowiek nie jest w stanie w pełni odczytać. To samo dotyczy sytuacji, gdy model obsługuje dane tabelaryczne, obrazy, czy zadania przetwarzania języka naturalnego, takie jak tłumaczenie i czat.

Etykieta ta jest starsza niż współczesne uczenie głębokie. Inżynierowie używają „czarnej skrzynki” co najmniej od lat 60. XX wieku w odniesieniu do każdego systemu, który można szturchnąć z zewnątrz, ale nie można go odkręcić. Sam ludzki mózg, jak lubią podkreślać biolodzy, również jest czarną skrzynką, ale porównanie to ma swoje granice: sztuczna inteligencja nie działa jak człowiek, a założenie, że działa, to jeden z najszybszych sposobów na błędne oszacowanie, do czego odnosi się pojęcie czarnej skrzynki. W ostatniej dekadzie zmieniła się skala. Współczesny model dużego języka może przenosić setki miliardów parametrów. Typowa głęboka sieć neuronowa rozprzestrzenia „wiedzę” na tysiące warstw i miliony głów uwagi, a pojedyncze neurony kodują wiele niepowiązanych ze sobą wzorców jednocześnie. Naukowcy nazywają tę ostatnią właściwość polisemantycznością i jest to jeden z powodów, dla których interpretowalność mechanistyczna wciąż znajduje się w powijakach.

Dlaczego ktokolwiek spoza laboratoriów badawczych miałby się tym przejmować? Ponieważ sztuczna inteligencja typu „czarna skrzynka” podejmuje teraz ważne decyzje. Przyznaje i odmawia kredytów. Ocenia oskarżonych. Oznacza transakcje jako oszustwa. Odpowiada za znaczną część wolumenu obrotu na każdej dużej giełdzie kryptowalut. Kiedy coś pójdzie nie tak, nieprzejrzystość sprawia, że ustalenie przyczyny, naprawienie błędu lub pociągnięcie kogokolwiek do odpowiedzialności jest praktycznie niemożliwe.

Ma to również znaczenie, ponieważ zarządzanie sztuczną inteligencją nie traktuje już nieprzejrzystości jako problemu programistów. Unia Europejska traktuje ją teraz jako kwestię dostępu do rynku. Amerykańskie organy regulacyjne traktują ją jako kwestię uczciwego pożyczania. Każdy dyrektor, który podpisał inicjatywę dotyczącą sztucznej inteligencji od 2024 roku, napotkał ten sam problem: co to właściwie robi i dlaczego? Zrozumienie sztucznej inteligencji typu „czarna skrzynka” nie jest już opcjonalne i nie da się rozwiązać problemu czarnej skrzynki, po prostu korzystając z usług innego dostawcy.

Dlaczego modele sztucznej inteligencji stają się czarnymi skrzynkami

Nie każda sztuczna inteligencja to czarna skrzynka. Proste drzewo decyzyjne jest w pełni transparentne. Model regresji liniowej generuje współczynniki, które można odczytać. Nawet oparty na regułach system sztucznej inteligencji z lat 90. jest w zasadzie audytowalny wiersz po wierszu.

Jak więc dzisiejsze modele sztucznej inteligencji stają się czarnymi skrzynkami? Dzieje się tak z czterech nakładających się na siebie powodów.

Po pierwsze, skala. Modele głębokiego uczenia się z milionami, a nawet miliardami parametrów działają w wielowymiarowych przestrzeniach, których człowiek nie jest w stanie sobie wyobrazić. Można opisać model z 200 miliardami parametrów za pomocą matematyki, ale nikt nie jest w stanie go ogarnąć.

Po drugie, reprezentacje rozproszone. W głębokiej sieci neuronowej żaden pojedynczy neuron nie przechowuje „konceptu kota” ani „reguły odrzucenia pożyczki”. Koncepcje rozmywają się w tysiącach neuronów, a poszczególne neurony uczestniczą w przetwarzaniu wielu koncepcji jednocześnie. Wyciągnięcie jasnego wyjaśnienia to projekt badawczy, a nie zapytanie.

Po trzecie, zależność od danych treningowych. Zachowanie modelu jest kształtowane przez jego dane treningowe, które zazwyczaj są zastrzeżone, ogromne i czasami obciążone przepisami prawnymi. Nawet gdy deweloper publikuje wagi modelu, dane te rzadko są udostępniane. Brakuje więc kluczowego elementu „dlaczego”.

Po czwarte, intencja. Istnieją praktyczne powody, aby świadomie stosować podejścia oparte na czarnej skrzynce. Niektórzy twórcy i programiści sztucznej inteligencji celowo ukrywają wewnętrzne mechanizmy modelu, aby chronić własność intelektualną, a inne powody korzystania z modeli opartych na czarnej skrzynce to warunki licencji i fosy konkurencyjne. Nawet model o otwartym kodzie źródłowym może skutecznie stworzyć czarną skrzynkę wokół swoich decyzji, ponieważ większość współczesnych modeli opiera się na pojawiających się wzorcach, których nie uwzględnia żadna dokumentacja. Firma, która zainwestowała 100 milionów dolarów w model, nie chce publikować jego architektury i procedury treningowej. Modele sztucznej inteligencji o otwartym kodzie źródłowym, które udostępniają swój kod źródłowy, są ostatecznie również czarnymi skrzynkami, ponieważ użytkownicy nadal nie mogą weryfikować wyuczonych wag w sposób sensowny.

W rezultacie nawet pozornie proste, zaawansowane modele sztucznej inteligencji (AI), w tym modele LLM i generatywne modele AI, stają się domyślnie czarnymi skrzynkami. Modele transparentne są wyjątkiem, a nie regułą. Złożone czarne skrzynki mogą zapewniać imponującą dokładność, dlatego zespoły nadal je wdrażają pomimo braku przejrzystości. To samo dotyczy modeli AI typu „czarna skrzynka” trenowanych na bogatych, chaotycznych danych: siła napędowa modeli AI opartych na regułach jest często wystarczająco duża, aby zignorować obawy dotyczące wyjaśnialności, dopóki coś się nie zepsuje. Większość współczesnych AI typu „czarna skrzynka” to ostatecznie czarne skrzynki, ponieważ użytkownicy nadal nie mogą sprawdzić wyuczonych wag. Modele o otwartych wagach udostępniają swój kod bazowy, a użytkownicy mogą odczytać architekturę, ale kod bazowy to ostatecznie czarne skrzynki, gdy zapytasz „dlaczego model to powiedział”.

Problem czarnej skrzynki w uczeniu głębokim

Problem czarnej skrzynki pojawia się, gdy te cztery przyczyny się kumulują. Model działa, często imponująco. Działa jednak w sposób, który opiera się trzem czynnikom jednocześnie: wyjaśnieniu, walidacji i korekcie.

Weźmy klasyczny przykład: model głębokiego uczenia wytrenowany do rozpoznawania pand. Uzyskuje 99% w zbiorze testowym. Wygląda świetnie. Nagle ktoś uruchamia narzędzie do interpretacji i odkrywa, że model tak naprawdę nie patrzy na pandę. Zwraca uwagę na bambus. Większość zdjęć pand w danych treningowych również zawiera bambus. Model nauczył się skrótu. Na zdjęciu pandy bez bambusa model nie działa.

Ten rodzaj „uczenia się na skróty” jest wszechobecny w uczeniu głębokim. Model znajduje regularność statystyczną, która nie pasuje do koncepcji bazowej, ale zauważa się ją dopiero wtedy, gdy świat wygląda nieco inaczej niż w zbiorze treningowym. Kryzys finansowy z 2008 roku stanowi tu historyczną analogię. Modele wartości zagrożonej (VaR) oparte na założeniach Gaussa działały doskonale na normalnych rynkach i eksplodowały w warunkach skrajnych, ponieważ nauczyły się skrótów, których twórcy modeli nie uznali za skróty.

Dzisiejsze modele głębokiego uczenia się mają ten sam tryb awarii, z większą liczbą parametrów i większą pewnością. Badacze zajmujący się interpretowalnością mechanistyczną, w tym zespoły z Anthropic i OpenAI, rozpoczęli inżynierię wsteczną małych fragmentów modeli językowych neuron po neuronie. Ich praca pokazuje, że wnętrze LLM jest bliższe splątanym obwodom niż uporządkowanej logice. Nie ma punktu, w którym można by wskazać palcem i powiedzieć: „tutaj kryje się odpowiedź”. Problem czarnej skrzynki nie jest błędem, który trzeba naprawić; ma on charakter strukturalny.

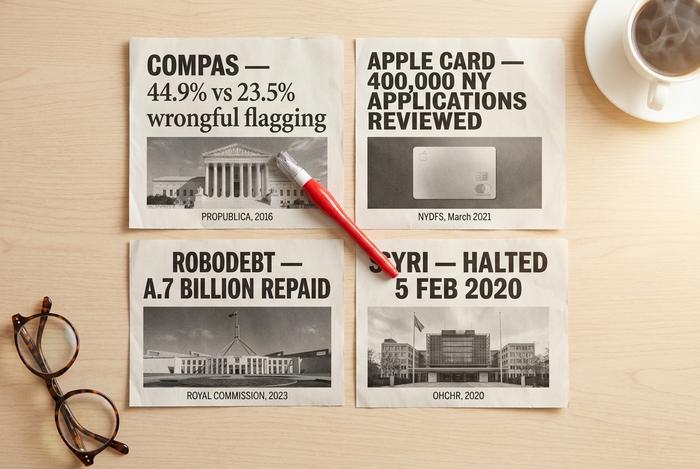

Przykłady sztucznej inteligencji typu Black Box: COMPAS, Apple Card, Robodebt, SyRI

Chcesz zobaczyć, jak wygląda sztuczna inteligencja typu „czarna skrzynka”, gdy się zawali? Cztery przypadki, które wszyscy przytaczają, powiedzą ci większość tego, co musisz wiedzieć. Obejmują one wymiar sprawiedliwości, bankowość i opiekę społeczną. Wszystkie krzywdzą prawdziwych ludzi. I żadne dwa nie zawiodły w ten sam sposób.

Zacznijmy od COMPAS. Northpointe stworzyło go, aby przewidywać, czy oskarżony ponownie popełni przestępstwo, a sądy w USA szeroko go wdrożyły. Następnie ProPublica zajrzała pod maskę. Ich audyt z 2016 roku przebadał dane ponad 7000 aresztowanych w hrabstwie Broward, a wynik był fatalny: czarnoskórzy oskarżeni zostali błędnie oznaczeni jako osoby wysokiego ryzyka w 44,9% przypadków, podczas gdy w przypadku białych oskarżonych odsetek ten wyniósł zaledwie 23,5%. Dokument uzupełniający z 2024 roku pogorszył sytuację. Dwie cechy (wiek i wcześniejsze wyroki skazujące) pokrywały się z dokładnością 137-elementowego modelu COMPAS. Zatem złożoność nie przyniosła dosłownie żadnego dodatkowego sygnału, ale znacznie utrudniła wykrycie błędu. To kanoniczny model czarnej skrzynki, który ocenia ludzi, a nie produkty. Model skrzynki, który ocenia kandydatów do pracy, ten sam, który Amazon porzucił w 2018 roku, ma ten sam kształt.

Następnie Apple Card, pod koniec 2019 roku. Wozniak powiedział, że jego żona dostała 10 razy niższy limit kredytowy niż on. David Heinemeier Hansson powiedział to samo. Historia stała się viralem. Departament Usług Finansowych Nowego Jorku potraktował ją poważnie: przeanalizował około 400 000 wniosków i je przeanalizował. W marcu 2021 roku wydał werdykt o braku dyskryminacji ze względu na płeć. Napisali jednak również, i to jest najważniejsza część, że nieprzejrzystość doświadczeń klientów sama w sobie stanowi problem zaufania. Okazuje się, że szkody wyrządzone przez czarną skrzynkę zależą w połowie od rezultatów, a w połowie od percepcji. Komunikat prasowy nie rozwiązuje problemu percepcji.

Robodebt to druga strona medalu. Nie ma w tym głębokiej sieci neuronowej. W latach 2016-2019 Australia stosowała zasadę uśredniania dochodów w dokumentach socjalnych, oskarżając około 400 000 beneficjentów o oszustwo i nie potrafiąc spójnie wyjaśnić obliczeń nikomu, kto otrzymał list. Komisja Królewska uznała później ten program za niezgodny z prawem. Rząd wypłacił 1,7 miliarda dolarów australijskich plus kolejne 112 milionów dolarów australijskich odszkodowania. Lekcja: system nie musi być technicznie zaawansowany, aby być czarną skrzynką. Wystarczy, że będzie nierozliczalny.

Holenderska afera „toeslagenaffaire” i SyRI to europejskie klamry. 5 lutego 2020 r. holenderski sąd nakazał natychmiastowe wstrzymanie działalności SyRI, orzekając, że jej nieprzejrzystość narusza artykuł 8 Europejskiej Konwencji Praw Człowieka. Związany z nią skandal związany z zasiłkami opiekuńczymi dla dzieci pochłonął ponad 20 000 rodziców, którzy zostali niesłusznie oskarżeni o oszustwo. Rząd Ruttego podał się do dymisji w styczniu 2021 r. To orzeczenie jest obecnie standardowym punktem odniesienia w kręgach politycznych UE, wyjaśniającym, dlaczego nieprzejrzystość sztucznej inteligencji w środowiskach wysokiego ryzyka nie jest kwestią etyki, lecz prawa.

Cztery przypadki. Różne sektory, różne technologie, różne kraje. Ten sam schemat: nieprzejrzysty system, decyzja o konsekwencjach i ludzie po stronie odbiorczej, którzy nie mają realnej możliwości sprzeciwu.

Ryzyko związane z czarną skrzynką AI w rzeczywistych systemach AI

Gdy zaczniesz katalogować ryzyko związane z czarną skrzynką AI w rzeczywistych systemach AI, pojawi się pewien schemat. Te same pięć zagrożeń pojawia się wielokrotnie, niezależnie od tego, czy model jest scoringiem kredytowym, chatbotem, czy algorytmicznym systemem handlowym.

| Ryzyko | Jak to wygląda | Dlaczego to się skaluje |

|---|---|---|

| Ukryte uprzedzenia | Model traktuje grupy chronione inaczej | Dane treningowe niosą ze sobą wzorce historyczne |

| Halucynacja | Model wymyśla fakty lub cytaty | Studia magisterskie LLM optymalizują płynność, a nie prawdę |

| Nauka skrótów | Model opiera się na nieistotnych korelacjach | Łatwiejsze do nauczenia niż prawdziwa koncepcja |

| Kruchość antagonistyczna | Niewielka zmiana na wejściu zmienia wyjście | Wielowymiarowe granice decyzyjne |

| Podział audytu | Nie można odtworzyć przyczyny | Brak interpretowalnego stanu wewnętrznego |

Ryzyka te narastają w systemach sztucznej inteligencji typu „black box” wykorzystywanych w finansach, rekrutacji, opiece zdrowotnej i kryptowalutach. Złożone procesy głębokiego uczenia się w nich zawarte utrudniają przewidywanie, gdzie nastąpi kolejna awaria, a tradycyjne narzędzia sztucznej inteligencji do kontroli jakości (QA) nie zostały stworzone dla modeli z setkami miliardów parametrów.

Ukryte uprzedzenia trafiają na pierwsze strony gazet, ale kruchość antagonistyczna i awarie audytu to poważniejsze problemy długoterminowe. Stabilne uprzedzenia można przynajmniej zmierzyć i skorygować. Model, który zawodzi inaczej za każdym razem (co ChatGPT robi w około 42% zadań oceny inteligentnych kontraktów, zgodnie z badaniem ACM TOSEM z 2024 roku), jest znacznie trudniejszy do certyfikacji do użytku regulowanego.

Najnowszym elementem tej listy jest to, co naukowcy nazywają „agency AI risk”. Łącząc LLM z narzędziami, dając mu pamięć i pozwalając na wywoływanie interfejsów API, zwiększasz nieprzejrzystość. Pojedyncza decyzja to teraz łańcuch wywołań modelu, pobranych dokumentów i wywołań narzędzi, z których każde jest częściowo nieprzejrzyste. Współcześni agenci to czarne skrzynki w czarnych skrzynkach.

Black Box AI w kryptografii i fintech

Spośród wszystkich branż wykorzystujących sztuczną inteligencję typu black box, w kryptowalutach i fintechach proces wdrażania i ryzyko ścierają się najmocniej. Stawki są wysokie. Opóźnienia krótkie. Ujawnianie informacji ograniczone. Regulacje, szczególnie w branży kryptowalut, wciąż są nieuporządkowane. Rezultatem jest środowisko, które nagradza najpierw wdrożenie, a dopiero potem tworzenie dokumentacji.

Handel algorytmiczny. Handel algorytmiczny odpowiadał za około 70-80% wolumenu kryptowalut w 2025 roku, czyli więcej niż 60-70% udział w głównych rynkach akcji. Sam Wintermute obraca średnio ponad 15 miliardów dolarów na ponad 60 platformach w ciągu jednego dnia, a w 2025 roku odnotowano rekordowy wolumen 2,24 miliarda dolarów w ciągu jednego dnia. Strategie stojące za tymi przepływami to zespoły głębokiego uczenia, których żaden zewnętrzny obserwator nie jest w stanie zweryfikować. Upadek Alameda/FTX w listopadzie 2022 roku jest najwyraźniejszą ilustracją tego ryzyka: całkowita kapitalizacja rynku kryptowalut spadła z ponad 1 biliona dolarów do poniżej 800 miliardów dolarów w ciągu około miesiąca, a bazowa ekspozycja na podatek od transakcji finansowych (FTT) w wysokości 14,6 miliarda dolarów w bilansie Alameda była niewidoczna do momentu, w którym przestała być widoczna.

Scoring AML i KYC. Globalny rynek oprogramowania do przeciwdziałania praniu pieniędzy osiągnął wartość 4,13 mld dolarów w 2025 roku i prognozuje się, że do 2030 roku wyniesie 9,38 mld dolarów (MarketsandMarkets). Zgodność z przepisami AML/KYC w sektorze kryptowalut rośnie ze średnioroczną stopą wzrostu (CAGR) na poziomie 13,8%. Dostawcy tacy jak ComplyAdvantage, Chainalysis Reactor i Elliptic Navigator wykorzystują obecnie modele uczenia maszynowego typu black box do oceny ryzyka portfela. Wykorzystanie uczenia maszynowego typu black box jest w tym przypadku powszechne i na tyle skuteczne, że można je wdrożyć na większości głównych giełd, a jednocześnie na tyle nieprzejrzyste, że specjaliści ds. zgodności często nie są w stanie odtworzyć przyczyny zablokowania konkretnego portfela.

Audyt inteligentnych kontraktów. To właśnie tutaj ograniczenia sztucznej inteligencji wyraźnie się ujawniają. Badanie arXiv z 2024 roku oceniło GPT-4 pod kątem wykrywania luk w zabezpieczeniach inteligentnych kontraktów. Osiągnął on 96,6% precyzji, ale tylko 37,8% wskaźnika wykrywalności, pomijając prawie dwie trzecie rzeczywistych luk. Wyniki ChatGPT są niestabilne w 42% przypadków (ACM TOSEM 2024). Narzędzia hybrydowe, takie jak GPTScan, które łączą GPT z analizą statyczną, przekraczają 90% precyzji i ~70% wskaźnika wykrywalności w przypadku kontraktów tokenowych (arXiv 2308.03314). CertiK Skynet monitoruje obecnie ponad 17 000 projektów o wartości rynkowej około 494 miliardów dolarów, ale każdy odpowiedzialny zespół audytorów nadal łączy sztuczną inteligencję z ludzkim recenzentem.

Robo-doradcy. Betterment zarządza ponad 56 miliardami dolarów na ponad 900 000 kont. Wealthfront ma 42,9 miliarda dolarów. Branża robo-doradców przekroczyła 1 bilion dolarów globalnego zarządzania aktywami. Rebalansowanie portfela, pozyskiwanie strat podatkowych i ocena ryzyka są oparte na modelach uczenia maszynowego, których konkretne decyzje nie są ujawniane w żadnym dokumencie przeznaczonym dla klientów detalicznych.

Scoring kredytowy i wykrywanie oszustw. System FICO jest wykorzystywany przez 90% amerykańskich pożyczkodawców, a system FICO Falcon przetwarza ponad 65 miliardów transakcji rocznie, wykazując ponad 95% wykrywalności oszustw. Badanie Banku Anglii przeprowadzone w 2024 roku wśród 50 brytyjskich instytucji wykazało, że modele ryzyka kredytowego oparte na uczeniu maszynowym (ML) zmniejszyły liczbę błędnych klasyfikacji o około 25% w porównaniu z regresją logistyczną. Wzrost dokładności jest realny. Wadą jest to, że zgodnie z okólnikami CFPB z lat 2022-03 i 2023-03 amerykańscy pożyczkodawcy nie mogą stosować modeli wystarczająco nieprzejrzystych, aby zapobiec konkretnym wyjaśnieniom dotyczącym działań niepożądanych w ramach ustawy ECOA.

Schemat we wszystkich pięciu jest taki sam. Model jest dokładniejszy niż transparentna linia bazowa. Nieprzezroczystość jest strukturalnie nierozerwalnie związana z dokładnością. A organy regulacyjne nadrabiają zaległości szybciej niż narzędzia wyjaśniające.

Notatka na temat Blackbox AI: Programowanie LLM

Szybkie ujednoznacznienie. Kiedy ludzie wyszukują hasło „blackbox AI”, często mają na myśli problem koncepcyjny, którego dotyczy ten artykuł. Czasami mają na myśli Blackbox AI, firmę blackbox.ai. Blackbox.ai to program LLM z zakresu kodowania, zaprojektowany, aby zmienić sposób, w jaki programiści piszą kod. Produkt integruje się z VS Code jako agent kodowania, sugeruje kod i konkuruje z narzędziami takimi jak Claude Code, GitHub Copilot i Cursor. Jest to jedna z bardziej znanych zaawansowanych technologii AI w obszarze kodowania AI, oparta na wielu modelach AI, a kod sugerowany przez Blackbox obejmuje wszystko, od refaktoryzacji po tworzenie rusztowań testowych. Blackbox integruje generowanie kodu, czat i wyszukiwanie w jednym przepływie pracy, a większość użytkowników nazwałaby go najlepszym asystentem AI, jakiego wypróbowali w swoim edytorze.

Te dwa znaczenia często się mylą w wynikach wyszukiwania. Produkt Blackbox AI nie jest tematem tego artykułu. Analizujemy właściwości strukturalne nieprzejrzystych systemów AI, a nie pojedynczego asystenta kodowania. Jeśli szukałeś produktu, firma prowadzi własną dokumentację i cennik. Jeśli szukałeś tej koncepcji, czytaj dalej.

Wyjaśnialna sztuczna inteligencja i narzędzia wyjaśnialności

Wyjaśnialna sztuczna inteligencja (XAI), zwykle w skrócie XAI, to dziedzina, która stara się ujawnić niejasne modele AI bez obniżania ich dokładności. To również realny rynek. Prognozy na rok 2026 wynoszą od 9 do 13 miliardów dolarów na całym świecie, a różnica zależy od tego, którą definicję XAI przyjmiemy. Celem jest uczynienie modeli AI bardziej zrozumiałymi bez zmuszania zespołów do powrotu do wolniejszych lub mniej dokładnych baz danych. Inteligentne zespoły uruchamiają te narzędzia w narzędziach AI przed ich udostępnieniem i łączą wyniki z dokumentacją, którą może przeczytać człowiek.

Warto poznać trzy rodziny techniki XAI.

Pierwszym z nich jest SHAP, skrót od SHapley Additive ExPlanations. Został on zapożyczony z teorii gier kooperacyjnych: dla każdej prognozy SHAP przypisuje punktację wkładu do każdej cechy wejściowej. Zespoły zajmujące się scoringiem kredytowym uwielbiają go. Zespoły zajmujące się wykrywaniem oszustw uwielbiają go. Modele ryzyka w opiece zdrowotnej tolerują go. SHAP jest teoretycznie rygorystyczny, ale obliczeniowo to prawdziwa bestia w przypadku dużych zbiorów danych tabelarycznych.

Drugim jest LIME, czyli Local Interpretable Model-agnostic Explanations (Lokalne Wyjaśnienia Niezależne od Modelu Interpretowalnego). LIME buduje prosty, interpretowalny model zastępczy wokół pojedynczej prognozy i wykorzystuje go do wyjaśnienia oryginału. Szybciej niż SHAP. Działa na tekście, obrazach i tabelach. Problem polega na tym, że LIME jest z założenia lokalne, więc może wprowadzić w błąd, jeśli założymy, że jedno wyjaśnienie jest generalizujące.

Trzecim sposobem są wyjaśnienia kontrfaktyczne. Zamiast wyjaśniać, dlaczego model odpowiedział „tak”, wyjaśnienia kontrfaktyczne podają najmniejszą zmianę danych wejściowych, która zmieniłaby odpowiedź na „nie”. Właśnie tego chce dowiedzieć się osoba ubiegająca się o kredyt lub dokonująca transakcji oznaczonej flagą: „Co musiałbym zmienić?”. Wyjaśnienia kontrfaktyczne szybko zyskują na popularności w zawiadomieniach o działaniach niepożądanych właśnie dlatego, że idealnie wpisują się w oczekiwania regulatorów.

Poza tymi trzema, zobaczysz wykresy ważności cech, wizualizację uwagi dla warstw transformatorowych oraz Grad-CAM dla klasyfikatorów obrazów. Interpretacja mechanistyczna, czyli praktyka inżynierii wstecznej określonych neuronów i obwodów uwagi, znajduje się w czołówce tej dziedziny. Anthropic, OpenAI i kilka laboratoriów akademickich opublikowało częściowe obwody, ale prace te nie przełożyły się jeszcze na nic, co mógłby wdrożyć zespół ds. zgodności w przedsiębiorstwie.

Bądźmy szczerzy, co do tego, dokąd to wszystko prowadzi. Badania branżowe opublikowane przez Palo Alto Networks i inne firmy wskazują, że XAI dobrze sprawdza się w przypadku klasyfikatorów obrazów i ustrukturyzowanych modeli tabelarycznych, a tylko częściowo w przypadku LLM. Logika wewnątrz modelu języka zmienia się wraz ze zmianą pozycji tokena i okna kontekstowego, więc wyniki atrybucji cech mogą wprowadzać w błąd w sposób, przed którym samo wyjaśnienie nie ostrzega. Narzędzia do analizy wyjaśnialności, które współdzielą swój kod źródłowy, są przydatne. Nie stanowią one jednak kompletnego rozwiązania problemu czarnej skrzynki.

Regulacja sztucznej inteligencji typu black box: Ustawa UE o sztucznej inteligencji, NIST, CFPB

Większość dostawców sztucznej inteligencji nie spodziewała się, że organy regulacyjne zareagują tak szybko. A jednak. Stara postawa „wyślij teraz, udokumentuj później” odchodzi w zapomnienie, a powodem jest kilka przepisów.

Europa jako pierwsza weszła w życie z unijną ustawą o sztucznej inteligencji (AI Act). Jej wdrażanie będzie przebiegać etapami w latach 2025–2027, a nie jednorazowo. Zabronione praktyki stały się wykonalne 2 lutego 2025 r. Przepisy dotyczące sztucznej inteligencji ogólnego przeznaczenia weszły w życie 2 sierpnia 2025 r. Obowiązki systemowe wysokiego ryzyka wchodzą w życie 2 sierpnia 2026 r., a rozszerzenie dotyczące produktów regulowanych wchodzi w życie rok później, 2 sierpnia 2027 r. Kary nie są na pokaz. 35 milionów euro, czyli 7% światowego obrotu, za najpoważniejsze naruszenia, 15 milionów euro, czyli 3% za pozostałe (DLA Piper, 2025). Lista przypadków użycia wysokiego ryzyka przypomina listę wdrożeń czarnych skrzynek: scoring kredytowy, rekrutacja, edukacja, organy ścigania, identyfikacja biometryczna. Każde z nich wymaga teraz domyślnie dokumentacji, przejrzystości i nadzoru ze strony człowieka.

Sytuacja w Ameryce jest bardziej chaotyczna, ale zmierza w tym samym kierunku. Ramy Zarządzania Ryzykiem Sztucznej Inteligencji (NIST AI Risk Management Framework) są najbliższe amerykańskiemu poziomowi odniesienia. Opublikowane w styczniu 2023 roku, a następnie rozszerzone na lata 2024 i 2025, po cichu stały się dokumentem, na podstawie którego duże przedsiębiorstwa oceniają, czy muszą to zrobić z technicznego punktu widzenia. Grudzień 2025 roku przyniósł dokument NIST IR 8596, wstępny projekt Profilu Cybernetycznej Sztucznej Inteligencji, z warsztatami uzupełniającymi, które odbyły się 14 stycznia 2026 roku. Wiele zespołów już go wdraża.

Biuro Ochrony Konsumentów Finansowych wyraziło się bardziej dosadnie. Okólniki 2022-03 i 2023-03 mówią wprost: wierzyciel nie może zastosować złożonego algorytmu, jeśli złożoność ta uniemożliwia mu podanie konkretnych powodów niekorzystnego działania zgodnie z ustawą ECOA i rozporządzeniem B. Proszę to uważnie przeczytać. To nie jest zakaz stosowania uczenia maszynowego w udzielaniu pożyczek. To zakaz stosowania uczenia maszynowego, który jest tak nieprzejrzysty, że nie da się powiedzieć wnioskodawcy, którego wniosek został odrzucony, co zrobił źle. To w rzeczywistości zakaz dotyczący kredytów konsumenckich, który jest jak czarna skrzynka.

Banki stoją przed starszym, ale wciąż bardziej rygorystycznym wymogiem. Ustawa SR 11-7 Rezerwy Federalnej, obowiązująca od 2011 roku, nakłada na banki obowiązek wykazania, że rozumieją każdy model, który wpływa na istotną decyzję. Współczesne systemy głębokiego uczenia się starają się pokonać tę poprzeczkę bez pomocy, a Biuletyn OCC 2011-12 narzuca to samo podejście.

Efekt końcowy: każdemu regulowanemu podmiotowi w USA lub UE zabrakło wymówek, by traktować nieprzejrzystość jako akceptowalny kompromis w kwestii dokładności. Albo interpretowalność jest uwzględniana już od pierwszej weryfikacji projektu, albo tworzy się hybrydę, w której człowiek jest w stanie przedstawić wyjaśnienie, którego model nie jest w stanie przekazać. Nie ma trzeciej ścieżki, która przetrwałaby działania egzekucyjne.

Jak przeprowadzić audyt systemu AI typu „czarna skrzynka”

Jak więc będzie wyglądać odpowiedzialne wdrożenie systemu AI typu „czarna skrzynka” w 2026 roku? Praktyczny podręcznik jest krótszy, niż twierdzą dostawcy.

Zaczynamy od danych. Udokumentuj, skąd pochodzą dane treningowe, kto je oznaczył i które podgrupy są reprezentowane. Mniej więcej połowa problemów z uprzedzeniami, na które natrafisz później, jest już tutaj zakodowana, a tej połowy, której nie możesz wyśledzić, nie da się naprawić.

Następnie należy przeprowadzić red teaming modelu. Zbadać go za pomocą danych wejściowych przeciwnika, szybkich iniekcji, przypadków skrajnych i przykładów spoza dystrybucji. Anthropic, OpenAI i Microsoft publikują obecnie podręczniki do tego projektu, które można dostosować bez konieczności wymyślania nowej metodologii.

Zastosuj XAI do każdego modelu w produkcji, nie tylko do tych nagłówkowych. SHAP do tabelarycznych potoków. LIME do tekstu i obrazów. Kontrfakty dla każdej decyzji, która prowadzi do użytkownika. Żadne z tych narzędzi nie jest idealne. Z drugiej strony, ich brak to sygnał ostrzegawczy dla każdego audytora wchodzącego do Twojego stosu.

Uważaj na dryft. Modele tracą na wartości szybciej, niż większość zespołów się spodziewa. Śledź rozkłady danych wejściowych, wyjściowych i dalsze wyniki. Ustaw alerty dla każdego z nich i traktuj niewyjaśnione zmiany jako incydenty, a nie ciekawostki.

Stwórz ścieżkę eskalacji, zanim będzie potrzebna. Każda decyzja dotycząca modelu powinna mieć możliwość jej pominięcia przez człowieka i udokumentowany kanał odwołania, z którego klient może faktycznie skorzystać. Jeśli kanałem odwołania jest Twój zespół wsparcia, również to zapisz.

Na koniec dostosuj się do obowiązujących ram. NIST AI RMF, jeśli jesteś w USA. Wymagania UE dotyczące wysokiego ryzyka wynikające z ustawy o sztucznej inteligencji, jeśli jesteś w Europie. Okólniki CFPB 2022-03 i 2023-03, jeśli w ogóle korzystasz z kredytu konsumenckiego. Zrobienie tego raz, na wczesnym etapie, jest znacznie tańsze niż modernizacja po wszczęciu postępowania egzekucyjnego.

Nie wyeliminujecie czarnej skrzynki. To dobrze. Zadanie polega na tym, aby była obserwowalna, rozliczalna i ograniczona. To standard, który już egzekwują organy regulacyjne i tak właśnie będzie wyglądać dojrzałe wdrożenie w 2026 roku.