Kara Kutu Yapay Zeka Nedir? Kara Kutu Problemi Açıklanıyor

Nisan 2026'da Vectara'nın halüsinasyon liderlik tablosu garip bir sonuç ortaya koydu. En iyi dil modelleri artık temel testlerinde %4'ten daha az oranda halüsinasyon gösteriyor. Ancak GPT-5, Claude Sonnet 4.5, Grok-4 ve Gemini-3-Pro'nun yeni "akıl yürütme" varyantlarının tümü yeni veri setinde %10'un üzerinde halüsinasyon gösteriyor. Grok-4-fast-reasoning ise %20,2'ye ulaştı. En akıllı modeller, yani cevap vermeden önce "düşünen" modeller, bilmedikleri zaman bunu size söylemede en kötü olanlar.

Bu, kara kutu sorununu tek bir paragrafta özetliyor. Sıklıkla faydalı çıktılar üreten ve yaratıcıları da dahil olmak üzere hiç kimsenin tam olarak açıklayamadığı yapay zeka sistemleri geliştirdik. Kalibre edilmemiş olsalar da hassaslar, dürüst olmasalar da akıcılar ve doğru olmasalar da kendinden eminler.

Düzenleyiciler durumu fark etti. AB Yapay Zeka Yasası, yasaklanmış kullanımlar için 35 milyon Euro'ya veya küresel cironun %7'sine kadar para cezası öngörüyor ve yüksek riskli sistem kuralları 2 Ağustos 2026'da yürürlüğe girecek. ABD Tüketici Finansal Koruma Bürosu, bankalara, kredi reddini açıklamalarını engelleyen karmaşık algoritmaları kullanamayacaklarını açıkça belirtti. Ve beş yıl önce niş bir konu olan açıklanabilir yapay zeka alanı, 2026 yılında 9 milyar ila 13 milyar dolar arasında bir pazar olarak tahmin ediliyor.

Bu kılavuz, kara kutu yapay zekanın aslında ne olduğunu, basit görünen yapay zeka modellerinin neden kara kutuya dönüştüğünü, böyle olduklarında neler ters gittiğini, kripto ve fintech alanlarında nerede ortaya çıktıklarını, açıklanabilir yapay zeka araç setinin (SHAP, LIME, karşı olgusal durumlar) bunları nasıl çözmeye çalıştığını ve AB ve ABD'deki yeni düzenleyici rejim hakkında bilmeniz gerekenleri ele almaktadır. Ayrıca, sıkça karşılaşılan bir karışıklığı gidermek için kısa bir ara verilmiştir: blackbox.ai adresindeki kodlama asistanı olan Kara Kutu Yapay Zeka farklı bir şeydir.

Kara Kutu Yapay Zeka Nedir ve Neden Önemlidir?

Kara kutu yapay zekâ, içsel mantığı kullanıcılar ve çoğu zaman onu geliştiren geliştiriciler için de anlaşılmaz olan herhangi bir yapay zekâ sistemini ifade eder. Girişler ve çıkışlar görünürdür. Aralarındaki yol, hiçbir insanın tam olarak okuyamayacağı ağırlık katmanları, öğrenilmiş kalıplar ve makine öğrenimi dönüşümleri içinde gizlidir. Bu durum, modelin tablo verilerini, görüntüleri veya çeviri ve sohbet gibi doğal dil işleme görevlerini ele alması fark etmeksizin geçerlidir.

Bu terim, modern derin öğrenmeden daha eskidir. Mühendisler, en az 1960'lardan beri, dışarıdan kurcalayabileceğiniz ancak vidalarını sökemeyeceğiniz herhangi bir sistem için "kara kutu" terimini kullanmışlardır. Biyologlar, insan beyninin kendisinin de bir kara kutu olduğunu belirtmeyi severler, ancak bu karşılaştırma yalnızca belirli bir noktaya kadar geçerlidir: Yapay zeka insan gibi çalışmaz ve böyle çalıştığını varsaymak, kara kutu yapay zekanın neyi ifade ettiğini yanlış anlamanın en hızlı yollarından biridir. Son on yılda değişen şey ölçek oldu. Modern büyük bir dil modeli yüz milyarlarca parametre taşıyabilir. Tipik bir derin sinir ağı, "bilgiyi" binlerce katmana ve milyonlarca dikkat başlığına yayar; tek bir nöron aynı anda birden fazla ilişkisiz deseni kodlar. Araştırmacılar bu son özelliğe çok anlamlılık derler ve bu, mekanik yorumlanabilirliğin hala başlangıç aşamasında olmasının nedenlerinden biridir.

Araştırma laboratuvarlarının dışındaki herhangi birinin neden bununla ilgilenmesi gerekiyor? Çünkü kara kutu yapay zekâ artık önemli kararları yönlendiriyor. Kredileri onaylıyor ve reddediyor. Sanıkları puanlıyor. İşlemleri dolandırıcılık olarak işaretliyor. Her büyük kripto para borsasındaki işlem hacminin büyük bir bölümünü yönetiyor. Bir hata yaptığında, şeffaf olmaması, nedenini bulmayı, düzeltmeyi veya herhangi birini sorumlu tutmayı neredeyse imkansız hale getiriyor.

Bu durum aynı zamanda önemli çünkü yapay zeka yönetişimi artık şeffaflık sorununu geliştiricinin sorunu olarak görmüyor. AB artık bunu pazara erişim sorunu olarak ele alıyor. ABD düzenleyicileri ise adil kredi verme sorunu olarak değerlendiriyor. 2024'ten beri bir yapay zeka girişimini onaylayan her yönetici aynı duvara tosladı: Bu şey aslında ne yapıyor ve neden? Kara kutu yapay zekayı anlamak artık isteğe bağlı değil ve kara kutu sorununu sadece farklı bir tedarikçi kullanarak çözemezsiniz.

Yapay Zeka Modelleri Neden Kara Kutu Haline Geliyor?

Her yapay zekâ kara kutu değildir. Basit bir karar ağacı tamamen şeffaftır. Doğrusal regresyon modeli, okuyabileceğiniz katsayılar üretir. Hatta 1990'lardan kalma kural tabanlı bir yapay zekâ sistemi bile, prensip olarak, satır satır denetlenebilir.

Peki günümüzün yapay zeka modelleri nasıl kara kutu haline geliyor? Bunun dört, birbiriyle örtüşen nedeni var.

Öncelikle ölçeklendirme. Milyonlarca veya milyarlarca parametreye sahip derin öğrenme modelleri, insanların görselleştiremediği yüksek boyutlu uzaylarda çalışır. 200 milyar parametreli bir modeli matematiksel olarak tanımlayabilirsiniz, ancak kimse bunu aklında tutamaz.

İkinci olarak, dağıtılmış temsiller. Derin bir sinir ağında, tek bir nöron "kedi kavramını" veya "krediyi reddetme kuralını" saklamaz. Kavramlar binlerce nörona yayılır ve bireysel nöronlar aynı anda birçok kavrama katılır. Temiz bir açıklama çıkarmak bir araştırma projesidir, bir sorgulama değil.

Üçüncüsü, eğitim verilerine bağımlılık. Modelin davranışı, genellikle özel mülkiyete ait, devasa ve bazen yasal olarak sorunlu olan eğitim verileri tarafından şekillendirilir. Bir geliştirici model ağırlıklarını yayınlasa bile, veriler nadiren paylaşılır. Dolayısıyla "neden" sorusunun önemli bir kısmı eksiktir.

Dördüncüsü, amaç. Kara kutu yaklaşımlarını kasıtlı olarak kullanmanın pratik nedenleri vardır. Bazı yapay zeka geliştiricileri ve programcıları, fikri mülkiyeti korumak için model iç işleyişini kasıtlı olarak gizlerler ve kara kutu tasarımlarını kullanmanın diğer nedenleri arasında lisans koşulları ve rekabet avantajları yer alır. Açık ağırlıklı bir model bile, kararlarının etrafında etkili bir şekilde kara kutu oluşturabilir, çünkü çoğu modern model, hiçbir dokümantasyonun yakalayamadığı ortaya çıkan kalıplara dayanır. Bir modele 100 milyon dolar yatırım yapan bir şirket, mimarisini ve eğitim prosedürünü yayınlamaya istekli değildir. Temel kodlarını paylaşan açık kaynaklı yapay zeka modelleri de nihayetinde kara kutulardır, çünkü kullanıcılar öğrenilen ağırlıkları anlamlı bir yorumla inceleyemezler.

Sonuç olarak, LLM'ler ve üretken yapay zeka modelleri de dahil olmak üzere görünüşte basit gelişmiş yapay zeka modelleri bile varsayılan olarak kara kutu haline geliyor. Şeffaf modeller istisnadır, kural değil. Karmaşık kara kutular etkileyici doğruluk sağlayabilir, bu nedenle ekipler şeffaf olmamalarına rağmen onları kullanmaya devam ediyor. Zengin, karmaşık veriler üzerinde eğitilmiş kara kutu yapay zeka modelleri için de aynı şey geçerlidir: Kural tabanlı yapay zeka modellerine göre sağlanan avantaj, bir şey bozulana kadar açıklanabilirlik endişelerini genellikle göz ardı edecek kadar büyüktür. Çoğu modern kara kutu yapay zeka modeli nihayetinde kara kutudur çünkü kullanıcılar hala öğrenilen ağırlıkları inceleyemezler. Açık ağırlıklı modeller temel kodlarını paylaşır ve kullanıcılar mimariyi okuyabilir, ancak "model neden böyle söyledi" diye sorduğunuzda temel kod nihayetinde kara kutudur.

Derin Öğrenmede Kara Kutu Problemi

Kara kutu problemi, bu dört nedenin bir araya gelmesiyle ortaya çıkar. Model çalışır, hatta çoğu zaman etkileyici sonuçlar verir. Ancak, aynı anda üç şeye direnen bir şekilde çalışır: açıklama, doğrulama ve düzeltme.

Klasik örneği ele alalım: Pandaları tanımlamak üzere eğitilmiş bir derin öğrenme modeli. Test setinde %99 başarı elde ediyor. Harika görünüyor. Sonra biri yorumlanabilirlik aracını çalıştırıyor ve modelin aslında pandaya değil, bambuya baktığını keşfediyor. Eğitim verilerindeki panda fotoğraflarının çoğunda bambu da bulunuyor. Model bir kısayol öğrenmiş. Bambu içermeyen bir panda fotoğrafında ise model başarısız oluyor.

Bu tür "kısayol öğrenme" derin öğrenmenin her yerinde mevcuttur. Model, altta yatan kavramla uyuşmayan istatistiksel bir düzenlilik bulur, ancak bunu yalnızca dünya eğitim kümesinden biraz farklı göründüğünde fark edersiniz. Burada tarihsel benzetme 2008 finansal krizidir. Gauss varsayımlarına dayalı Değer-Risk modelleri normal piyasalarda mükemmel çalıştı ve uç koşullarda patladı, çünkü modelleyicilerin kısayol olduğunu fark etmedikleri kısayollar öğrenmişlerdi.

Günümüzün derin öğrenme modelleri, daha fazla parametre ve daha fazla güvenle, tam olarak bu başarısızlık modunu paylaşıyor. Anthropic ve OpenAI'deki ekipler de dahil olmak üzere mekanik yorumlanabilirlik araştırmacıları, dil modellerinin küçük parçalarını nöron nöron tersine mühendislikle incelemeye başladılar. Çalışmaları, bir dil öğrenme modelinin iç yapısının düzenli mantıktan ziyade iç içe geçmiş devrelere daha yakın olduğunu gösteriyor. Parmağınızı koyup "cevabın bulunduğu yer burası" diyebileceğiniz bir nokta yok. Kara kutu problemi düzeltilmesi gereken bir hata değil; yapısal bir sorun.

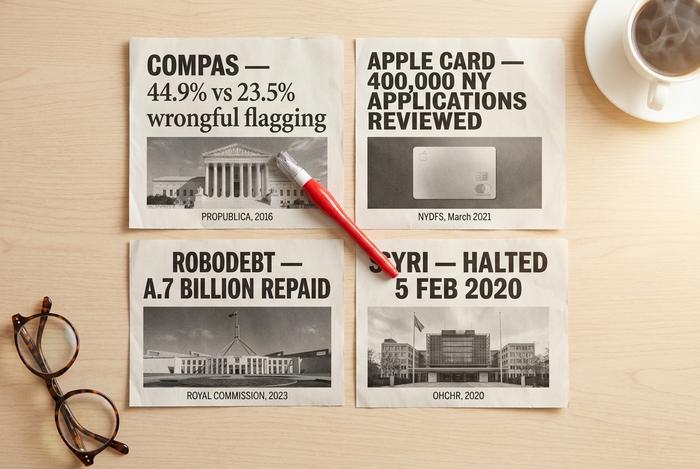

Kara Kutu Yapay Zeka Örnekleri: COMPAS, Apple Card, Robodebt, SyRI

Kara kutu yapay zekânın çöktüğünde nasıl göründüğünü görmek ister misiniz? Herkesin sürekli bahsettiği dört örnek, bilmeniz gerekenlerin çoğunu size anlatıyor. Bunlar ceza adaleti, bankacılık ve sosyal yardım alanlarını kapsıyor. Hepsi gerçek insanlara zarar veriyor. Ve hiçbirinin başarısızlığı aynı şekilde gerçekleşmedi.

COMPAS ile başlayalım. Northpointe, bir sanığın tekrar suç işleyip işlemeyeceğini tahmin etmek için bunu geliştirdi ve ABD mahkemeleri bunu yaygın olarak kullanmaya başladı. Ardından ProPublica işin iç yüzünü inceledi. 2016'daki denetimlerinde, Broward County'de tutuklanan 7.000'den fazla kişiyi verilerden geçirdiler ve sonuç vahimdi: Siyah sanıklar vakaların %44,9'unda yanlışlıkla yüksek riskli olarak işaretlenirken, beyaz sanıklar için bu oran sadece %23,5'ti. 2024'te yapılan bir takip çalışması durumu daha da kötüleştirdi. İki özellik (yaş ve önceki mahkumiyetler) COMPAS'ın %137'lik doğruluğuyla eşleşti. Yani karmaşıklık kelimenin tam anlamıyla ekstra bir sinyal getirmedi, ancak önyargıyı tespit etmeyi çok daha zorlaştırdı. Bu, ürünler yerine insanları değerlendiren klasik kara kutu modelidir. Amazon'un 2018'de terk ettiği iş başvurusu yapanları değerlendiren kutu modeli de aynı şekle uyuyor.

Ardından 2019 sonlarında Apple Card olayı yaşandı. Wozniak, eşinin kredi limitinin kendisininkinden 10 kat daha düşük olduğunu söyledi. David Heinemeier Hansson da aynı şeyi söyledi. Hikaye viral oldu. New York Finansal Hizmetler Departmanı bunu ciddiye aldı: yaklaşık 400.000 başvuruyu incelediler. Mart 2021'de, yasal cinsiyet ayrımcılığı olmadığı yönünde bir karar verdiler. Ancak aynı zamanda, ve bu önemli olan kısım, müşteri deneyimindeki şeffaflık eksikliğinin başlı başına bir güven sorunu olduğunu da yazdılar. Anlaşılan o ki, kara kutu zararı, sonuçlarla ve algıyla ilgili olmanın yarısıyla ilgili. Bir basın açıklaması algı tarafını düzeltmiyor.

Robodebt ise madalyonun diğer yüzü. Derin sinir ağları söz konusu değil. Avustralya, 2016 ile 2019 yılları arasında sosyal yardım kayıtlarına karşı gelir ortalaması alma kuralı uyguladı, yaklaşık 400.000 kişiyi dolandırıcılıkla suçladı ve mektubu alan hiç kimseye hesaplamayı tutarlı bir şekilde açıklayamadı. Daha sonra bir Kraliyet Komisyonu bu sistemi yasa dışı ilan etti. Hükümet 1,7 milyar Avustralya doları artı 112 milyon Avustralya doları tazminat ödedi. Ders: Bir sistemin kara kutu olması için teknik olarak karmaşık olması gerekmez. Sadece hesap verilemez olması yeterlidir.

Hollanda'daki ayak bakımı skandalı ve SyRI, Avrupa'da bu konuda iki uç noktayı temsil ediyor. 5 Şubat 2020'de bir Hollanda mahkemesi, SyRI'nin şeffaf olmamasının Avrupa İnsan Hakları Sözleşmesi'nin 8. maddesini ihlal ettiğine hükmederek, projenin derhal durdurulmasını emretti. İlgili çocuk bakım yardımı skandalı, yanlış bir şekilde dolandırıcılıkla suçlanan 20.000'den fazla ebeveyni de içine çekti. Rutte hükümeti bu olay nedeniyle Ocak 2021'de istifa etti. Bu karar, AB politika çevrelerinde, yüksek riskli ortamlarda şeffaf olmayan yapay zekanın neden yumuşak bir etik sorunu değil, yasal bir sorun olduğuna dair standart referans noktası haline geldi.

Dört örnek. Farklı sektörler, farklı teknolojiler, farklı ülkeler. Hepsinin ortak noktası: şeffaf olmayan bir sistem, sonuçları ağır olan bir karar ve bu karardan etkilenen, geri adım atacak gerçek bir yolu olmayan insanlar.

Gerçek Dünya Yapay Zeka Sistemlerinde Kara Kutu Yapay Zeka Riski

Gerçek dünyadaki yapay zeka sistemlerinde kara kutu yapay zeka risklerini kataloglamaya başladığınızda, bir örüntü ortaya çıkıyor. Modelin kredi puanlama sistemi, sohbet robotu veya algoritmik işlem sistemi olmasına bakılmaksızın, aynı beş risk tekrar tekrar karşımıza çıkıyor.

| Risk | Nasıl göründüğü | Ölçeklenebilir olmasının nedenleri |

|---|---|---|

| Gizli önyargı | Model, koruma altındaki gruplara farklı davranıyor. | Eğitim verileri tarihsel kalıpları içerir. |

| Halüsinasyon | Model, gerçekleri veya alıntıları uydurur. | LLM'ler gerçeği değil, akıcılığı optimize eder. |

| Kısayol öğrenme | Model alakasız korelasyonlara dayanıyor. | Gerçek kavramdan daha kolay öğrenilebilir. |

| Düşmanca kırılganlık | Küçük bir giriş değişikliği çıkışı tersine çevirir. | Yüksek boyutlu karar sınırları |

| Denetim dökümü | Sebebini yeniden oluşturamıyorum. | Yorumlanabilir iç durum yok |

Bu riskler, finans, işe alım, sağlık hizmetleri ve kripto para birimlerinde kullanılan kara kutu yapay zeka sistemlerinde daha da artmaktadır. İçlerindeki karmaşık derin öğrenme süreçleri, bir sonraki hatanın nerede meydana geleceğini tahmin etmeyi zorlaştırırken, geleneksel yapay zeka kalite kontrol araçları yüz milyarlarca parametreye sahip modeller için tasarlanmamıştır.

Gizli önyargı manşetlerde yer alıyor, ancak düşmanca kırılganlık ve denetim aksaklıkları daha büyük uzun vadeli sorunlar. İstikrarlı bir önyargı en azından ölçülebilir ve düzeltilebilir. Her çalıştırıldığında farklı şekilde başarısız olan bir model (2024 ACM TOSEM araştırmasına göre ChatGPT, akıllı sözleşme değerlendirme görevlerinin yaklaşık %42'sinde başarısız oluyor) düzenlenmiş kullanım için sertifikalandırılması çok daha zordur.

Bu listeye en yeni eklenen unsur, araştırmacıların "ajan tabanlı yapay zeka riski" olarak adlandırdığı şeydir. Bir LLM'yi araçlara bağladığınızda, ona bellek verdiğinizde ve API'leri çağırmasına izin verdiğinizde, şeffaflığı daha da artırırsınız. Tek bir karar artık model çağrıları, alınan belgeler ve araç çağrıları zinciridir ve bunların her biri kısmen şeffaf değildir. Modern ajanlar, kara kutular içinde kara kutulardır.

Kripto ve Fintech'te Kara Kutu Yapay Zekası

Kara kutu yapay zekâ kullanan tüm sektörler arasında, kripto para ve fintech, uygulama tarafı ile risk tarafının en sert şekilde çatıştığı yerlerdir. Riskler büyük. Gecikme süresi kısa. Şeffaflık yetersiz. Özellikle kripto parada düzenlemeler hala yamalı bohça gibi. Sonuç olarak, önce uygulamayı devreye alıp sonra dokümantasyonu yazmayı ödüllendiren bir ortam ortaya çıkıyor.

Algoritmik işlem. Algoritmik işlem, 2025 yılında kripto para hacminin tahmini %70-80'ini yönlendirdi; bu oran, büyük hisse senedi piyasalarındaki %60-70'lik paydan daha yüksek. Sadece Wintermute bile ortalama bir günde 60'tan fazla platformda 15 milyar dolardan fazla işlem hacmi gerçekleştiriyor ve 2025 yılında 2,24 milyar dolarlık rekor bir günlük işlem hacmi bildirildi. Bu akışların arkasındaki stratejiler, dışarıdan hiçbir gözlemcinin denetleyemeyeceği derin öğrenme tabanlı sistemlerdir. Kasım 2022'deki Alameda/FTX çöküşü, riskin en net örneğidir: toplam kripto para piyasası değeri yaklaşık bir ay içinde 1 trilyon dolardan 800 milyar doların altına düştü ve Alameda'nın bilançosundaki 14,6 milyar dolarlık FTT riski, görünür hale gelene kadar görünmezdi.

AML ve KYC puanlaması. Küresel kara para aklama karşıtı yazılım pazarı 2025 yılında 4,13 milyar dolara ulaştı ve 2030 yılına kadar 9,38 milyar dolara ulaşması öngörülüyor (MarketsandMarkets). Kripto AML/KYC uyumluluğu özellikle %13,8'lik bir bileşik yıllık büyüme oranıyla artıyor. ComplyAdvantage, Chainalysis Reactor ve Elliptic Navigator gibi satıcılar artık cüzdan risk puanlaması için kara kutu makine öğrenimi modelleri kullanıyor. Burada kara kutu makine öğreniminin kullanımı yaygın ve çoğu büyük borsada kullanılacak kadar etkili ve uyumluluk görevlilerinin belirli bir cüzdanın neden bloke edildiğini yeniden oluşturamayacak kadar şeffaf değil.

Akıllı sözleşme denetimi. İşte yapay zekanın sınırlarının açıkça ortaya çıktığı yer burası. 2024 tarihli bir arXiv çalışması, GPT-4'ün akıllı sözleşme güvenlik açığı tespitindeki performansını değerlendirdi. %96,6 doğruluk oranına ulaşırken, yalnızca %37,8 geri çağırma oranı elde etti ve gerçek hataların neredeyse üçte ikisini kaçırdı. ChatGPT çıktıları, sözleşmelerin %42'sinde çalıştırmalar arasında kararsızlık gösteriyor (ACM TOSEM 2024). GPT'yi statik analizle birleştiren GPTScan gibi hibrit araçlar, token sözleşmelerinde %90'ın üzerinde doğruluk ve yaklaşık %70 geri çağırma oranına ulaşıyor (arXiv 2308.03314). CertiK Skynet şu anda 17.000'den fazla projeyi ve yaklaşık 494 milyar dolarlık piyasa değerini izliyor, ancak her sorumlu denetim ekibi hala yapay zekayı bir insan inceleyiciyle birlikte kullanıyor.

Robot danışmanlar. Betterment, 900.000'den fazla hesapta 56 milyar dolardan fazla varlığı yönetiyor. Wealthfront ise 42,9 milyar dolarda yer alıyor. Robot danışmanlık sektörü, küresel varlık yönetiminde 1 trilyon doları aşmış durumda. Portföy yeniden dengeleme, vergi kaybı hasadı ve risk puanlaması, belirli kararları perakendecilere yönelik hiçbir belgede açıklanmayan makine öğrenimi modelleri tarafından yönlendiriliyor.

Kredi puanlaması ve dolandırıcılık tespiti. FICO, ABD'deki kredi verenlerin %90'ı tarafından kullanılıyor ve FICO Falcon, yılda 65 milyardan fazla işlemi işliyor ve %95'in üzerinde dolandırıcılık tespit oranına sahip olduğu bildiriliyor. İngiltere Merkez Bankası'nın 2024 yılında 50 İngiliz kurumu üzerinde yaptığı bir çalışmada, makine öğrenimi tabanlı kredi riski modellerinin, lojistik regresyona kıyasla yanlış sınıflandırmaları yaklaşık %25 oranında azalttığı bulundu. Doğruluk artışı gerçektir. Dezavantajı ise, CFPB Genelgeleri 2022-03 ve 2023-03 uyarınca, ABD'li kredi verenlerin ECOA kapsamında belirli olumsuz işlem açıklamalarını önleyecek kadar şeffaf olmayan modeller kullanamamasıdır.

Beş modelin tamamında aynı örüntü gözlemleniyor. Model, şeffaf temel modelden daha doğru. Şeffaflık, yapısal olarak doğruluktan ayrılamaz. Ve düzenleyiciler, açıklanabilirlik araçlarından daha hızlı bir şekilde bu duruma ayak uyduruyor.

Blackbox AI üzerine not: Kodlama LLM'si

Öncelikle bir açıklama yapalım. İnsanlar "blackbox AI" araması yaptıklarında, genellikle bu makalenin ele aldığı kavramsal problemi kastediyorlar. Bazen de blackbox.ai adresindeki şirket olan Blackbox AI'yı kastediyorlar. Blackbox.ai, geliştiricilerin kod yazma biçimini dönüştürmek için tasarlanmış bir kodlama öğrenme yönetim sistemidir (LLM). Ürün, VS Code ile bir kodlama ajanı olarak entegre olur, kod önerir ve Claude Code, GitHub Copilot ve Cursor gibi araçlarla rekabet eder. Yapay zeka kodlama alanındaki en bilinen gelişmiş yapay zeka teknolojilerinden biridir, birden fazla yapay zeka modeli üzerine kuruludur ve Blackbox'ın önerdiği kod, yeniden düzenlemelerden test iskeletine kadar her şeyi kapsar. Blackbox, kod üretimi, sohbet ve aramayı tek bir iş akışına entegre eder ve çoğu kullanıcı bunu editörlerinde denedikleri en iyi yapay zeka asistanı olarak adlandırır.

Bu iki anlam, arama sonuçlarında sıklıkla birbirine karışıyor. Blackbox AI ürünü bu makalenin konusu değil. Biz, herhangi bir kodlama asistanına değil, opak yapay zeka sistemlerinin yapısal özelliğine bakıyoruz. Eğer ürünü aradıysanız, şirket kendi dokümantasyonunu ve fiyatlandırmasını tutuyor. Eğer kavramı aradıysanız, okumaya devam edin.

Açıklanabilir Yapay Zeka ve Açıklanabilirlik Araçları

Açıklanabilir Yapay Zeka (genellikle XAI olarak kısaltılır), doğruluğunu bozmadan anlaşılması güç yapay zeka modellerini açığa çıkarmayı amaçlayan bir alandır. Ayrıca şu anda gerçek bir pazardır. 2026 için küresel tahminler 9 milyar ila 13 milyar dolar arasında değişmektedir; bu fark, XAI'nin hangi tanımını kabul ettiğinize bağlıdır. Amaç, ekipleri daha yavaş veya daha az doğru temel yöntemlere geri döndürmeden yapay zeka modellerini daha açıklanabilir hale getirmektir. Akıllı ekipler, bu araçları yapay zeka araçları üzerinde çalıştırıp piyasaya sürmeden önce, insan bir inceleyicinin okuyabileceği belgelerle birlikte sunarlar.

XAI tekniğinin üç ailesini bilmekte fayda var.

İlki SHAP, yani SHapley Additive exPlanations'ın kısaltmasıdır. İşbirlikçi oyun teorisinden ödünç alınmıştır: her tahmin için SHAP, her girdi özelliğine bir katkı puanı atar. Kredi puanlama ekipleri buna bayılır. Dolandırıcılık tespit ekipleri buna bayılır. Sağlık risk modelleme uzmanları buna tahammül eder. SHAP teorik olarak titizdir, ancak büyük tablo verilerinde hesaplama açısından oldukça zorlayıcıdır.

İkincisi LIME, Yerel Yorumlanabilir Modelden Bağımsız Açıklamalar'dır. LIME, tek bir tahmin etrafında basit, yorumlanabilir bir vekil model oluşturur ve bunu orijinalini açıklamak için kullanır. SHAP'tan daha hızlıdır. Metin, resim ve tablolarda çalışır. Dezavantajı, LIME'ın tasarım gereği yerel olmasıdır, bu nedenle bir açıklamanın genelleştirilebileceğini varsayarsanız sizi yanıltabilir.

Üçüncüsü ise karşıolgusal açıklamalar. Modelin neden evet dediğini anlatmak yerine, karşıolgusal açıklamalar size cevabı hayıra çevirecek en küçük girdi değişikliğini söyler. Kredi başvurusunda bulunan veya işaretlenmiş bir işlemle karşılaşan herkesin bilmek istediği tam olarak budur: "Neyi değiştirmem gerekirdi?". Karşıolgusal açıklamalar, düzenleyici kurumların beklentilerine tam olarak uydukları için olumsuz işlem bildirimlerinde hızla yaygınlaşıyor.

Bu üçünün ötesinde, özellik önem grafikleri, transformatör katmanları için dikkat görselleştirmesi ve görüntü sınıflandırıcıları için Grad-CAM göreceksiniz. Mekanistik yorumlanabilirlik, belirli nöronların ve dikkat devrelerinin tersine mühendisliği uygulaması, alanın en ileri noktasında yer almaktadır. Anthropic, OpenAI ve birkaç akademik laboratuvar kısmi devreler yayınladı, ancak bu çalışma henüz bir kurumsal uyumluluk ekibinin gönderebileceği bir şeye dönüşmedi.

Bu işin nereye vardığı konusunda dürüst olun. Palo Alto Networks ve diğerleri tarafından yayınlanan sektör araştırmaları, XAI'nin görüntü sınıflandırıcıları ve yapılandırılmış tablo modelleri için iyi çalıştığını, ancak dil modellerinde (LLM) yalnızca kısmen etkili olduğunu belirtiyor. Bir dil modelinin içindeki mantık, belirteç konumu ve bağlam penceresi değiştikçe değişir; bu nedenle özellik atama puanları, açıklamanın kendisinin sizi uyarmadığı şekillerde yanıltıcı olabilir. Temel kodlarını paylaşan açıklanabilirlik araçları faydalıdır. Ancak bunlar, kara kutu problemine kesin bir çözüm değildir.

Kara Kutu Yapay Zekanın Düzenlenmesi: AB Yapay Zeka Yasası, NIST, CFPB

Çoğu yapay zeka tedarikçisi, düzenleyicilerin bu kadar hızlı hareket edeceğini beklemiyordu. Ama öyle oldu. Eski "önce gönder, sonra belgele" yaklaşımı artık geçerliliğini yitiriyor ve bunun nedeni de birkaç kural.

Avrupa, AB Yapay Zeka Yasası ile bu konuda öncü oldu. Bu, tek seferde geçiş değil, 2025-2027 yılları arasında aşamalı bir uygulama. Yasaklanmış uygulamalar 2 Şubat 2025'te yürürlüğe girdi. Genel amaçlı yapay zeka kuralları 2 Ağustos 2025'te devreye girdi. Yüksek riskli sistem yükümlülükleri 2 Ağustos 2026'dan itibaren geçerli olacak ve düzenlemeye tabi ürünler uzantısı bundan bir yıl sonra, 2 Ağustos 2027'de yürürlüğe girecek. Cezalar göstermelik değil. En ciddi ihlaller için 35 milyon Euro veya dünya çapındaki cironun %7'si, geri kalanlar için 15 milyon Euro veya %3 (DLA Piper, 2025). Ve yüksek riskli kullanım örnekleri listesi, kara kutu uygulamalarının önde gelen isimlerinden oluşuyor: kredi puanlaması, işe alım, eğitim, kolluk kuvvetleri, biyometrik kimlik. Bunların her biri artık varsayılan olarak belgelendirme, şeffaflık ve insan gözetimi gerektiriyor.

Amerika'daki durum daha karmaşık ancak aynı yönde ilerliyor. NIST Yapay Zeka Risk Yönetimi Çerçevesi, ABD'nin temel referans noktasına en yakın şey. Ocak 2023'te yayınlanan, 2024 ve 2025'te genişletilen bu çerçeve, büyük işletmelerin teknik olarak zorunlu olup olmamasına bakılmaksızın kendilerini haritalandırdıkları bir belge haline geldi. Aralık 2025'te, Siber Yapay Zeka Profili'nin ön taslağı olan NIST IR 8596 yayınlandı ve 14 Ocak 2026'da bir takip çalıştayı düzenlendi. Birçok ekip şimdiden bunu benimsiyor.

Tüketici Finansal Koruma Bürosu daha açık sözlü davrandı. 2022-03 ve 2023-03 sayılı genelgelerde doğrudan belirtiliyor: Bir alacaklı, karmaşıklığı nedeniyle ECOA ve B Yönetmeliği kapsamında olumsuz bir işlem için belirli nedenleri belirtmesini engelleyen karmaşık bir algoritma kullanamaz. Bunu dikkatlice okuyun. Bu, kredi vermede makine öğrenimine bir yasak değil. Bu, reddedilen bir başvuru sahibine neyi yanlış yaptığını söyleyemeyeceğiniz kadar şeffaf olmayan makine öğrenimine bir yasak. Bu, aslında tüketici kredisi için bir kara kutu yasağıdır.

Bankalar daha eski ama yine de zorlu bir gereklilikle karşı karşıya. 2011'den beri yürürlükte olan Federal Rezerv SR 11-7, bankaların önemli bir kararı yönlendiren herhangi bir modeli anladıklarını göstermelerini zorunlu kılıyor. Modern derin öğrenme sistemleri, yardım almadan bu eşiği aşmakta zorlanıyor ve OCC'nin 2011-12 Bülteni de aynı yaklaşımı savunuyor.

Sonuç olarak: ABD veya AB'deki herhangi bir düzenlemeye tabi kuruluş, şeffaflık eksikliğini doğruluk için kabul edilebilir bir ödün olarak görmenin bahanesini tüketmiştir. Ya yorumlanabilirlik ilk tasarım incelemesinden itibaren dahil edilir ya da modelin sağlayamadığı açıklamayı insan üstlenir; böylece hibrit bir yapı oluşturulur. Yaptırım eylemine dayanabilecek üçüncü bir yol yoktur.

Kara Kutu Yapay Zeka Sisteminin Denetimi Nasıl Yapılır?

Peki, 2026'da kara kutu yapay zeka sisteminin sorumlu bir şekilde devreye alınması aslında nasıl görünecek? Pratik kılavuz, satıcıların iddia ettiğinden daha kısa.

Verilerle başlıyorsunuz. Eğitim verilerinin nereden geldiğini, kimin etiketlediğini ve hangi alt grupların temsil edildiğini belgeleyin. Daha sonra karşılaşacağınız önyargı sorunlarının yaklaşık yarısı zaten burada kodlanmıştır ve izleyemediğiniz diğer yarısı da düzeltemeyeceğiniz yarısıdır.

Ardından modeli kırmızı takım testine tabi tutarsınız. Düşman girdileri, istem enjeksiyonları, uç durumlar ve dağıtım dışı örneklerle modeli incelersiniz. Anthropic, OpenAI ve Microsoft artık bu çalışma için yeni bir metodoloji icat etmenize gerek kalmadan uyarlayabileceğiniz kılavuzlar yayınlıyor.

XAI'yi yalnızca en önemli modellerde değil, üretimdeki her modelde uygulayın. Tablo tabanlı işlem hatları için SHAP, metin ve görseller için LIME, kullanıcıya geri dönen her karar için karşı olgusal analiz kullanın. Bu araçların hiçbiri mükemmel değil. Öte yandan, bunların yokluğu, sisteminizi inceleyen herhangi bir denetçi için kırmızı bayrak anlamına gelir.

Sapmalara dikkat edin. Modeller çoğu ekibin beklediğinden daha hızlı eskimeye başlar. Girdi dağılımlarını, çıktı dağılımlarını ve sonraki sonuçları takip edin. Her biri için uyarılar ayarlayın ve açıklanamayan değişimleri merak konusu değil, olay olarak değerlendirin.

İhtiyaç duymadan önce çözüm yolunu oluşturun. Her önemli model kararının insan müdahalesi gerektiren bir mekanizması ve müşterinin gerçekten kullanabileceği belgelenmiş bir itiraz kanalı olmalıdır. Destek ekibiniz itiraz kanalı ise, bunu da yazın.

Son olarak, kendinizi geçerli olan çerçeveye göre konumlandırın. ABD'deyseniz NIST AI RMF'yi, Avrupa'daysanız AB Yapay Zeka Yasası'nın yüksek risk gereksinimlerini, tüketici kredisiyle ilgili herhangi bir işlem yapıyorsanız CFPB Genelgeleri 2022-03 ve 2023-03'ü dikkate alın. Bunu bir kez ve erken yapmak, bir yaptırım kararı masanıza düştükten sonra yeniden düzenleme yapmaktan çok daha ucuzdur.

Kara kutuyu ortadan kaldırmayacaksınız. Bu sorun değil. Görev, onu gözlemlenebilir, hesap verebilir ve sınırlandırılabilir hale getirmektir. Düzenleyicilerin halihazırda uyguladığı standart budur ve 2026'da olgun bir uygulamanın görünümü de budur.