Anonymisation numérique en 2026 : Ce que cela signifie et comment être

L'expression « anonymisé numériquement » est actuellement très utilisée. Netflix l'a employée cette année dans le générique d'ouverture d'un documentaire sur une affaire criminelle. Le film remplaçait les visages et les voix des témoins par des personnages dotés d'intelligence artificielle. (L'orthographe britannique « digitally anonymised » apparaît dans le même contexte pour les versions destinées au Royaume-Uni.) Des chercheurs universitaires ont utilisé cette même expression en 2019 pour un ensemble de données concernant 1,5 million d'Américains. Ils ont ensuite pu réidentifier 99,98 % d'entre eux à partir de seulement 15 attributs simples. Ces deux affirmations sont techniquement vraies. Elles décrivent cependant des réalités radicalement différentes, voire presque opposées, selon l'interprétation. Ainsi, lorsqu'on vous dit qu'un visage, un enregistrement ou un ensemble de données entier a été anonymisé numériquement, la seule question pertinente qui se pose ensuite est : qu'entend-on exactement par là ? Et à qui cette anonymisation est-elle censée être valable ?

Que signifie concrètement « anonymisé numériquement » ?

Deux concepts distincts se cachent derrière l'étiquette « anonymisation ». Le premier est la dépersonnalisation superficielle : un visage flouté, un faux nom, un modificateur de voix, un avatar IA. Cela permet de masquer une personne à un observateur qui ne cherche pas à approfondir la question. Le second est l'anonymisation statistique : un ensemble d'enregistrements est modifié de telle sorte que même une personne compétente, disposant de données publiques, ne puisse pas relier une donnée à une personne. La première est une mesure symbolique de protection des données. La seconde constitue la véritable protection des données. Le considérant 26 du RGPD expose clairement la différence : les données ne sont anonymes que lorsqu'aucun « moyen raisonnablement susceptible d'être utilisé » ne permet de les réidentifier. La loi HIPAA encadre ce même concept soit par une bande de sécurité de 18 identifiants, soit par une décision d'expert concluant que le risque de réidentification est « très faible ». Les recommandations de l'ICO (Information Commissioner's Office) du Royaume-Uni, mises à jour en mars 2025, parlent de « test de l'intrus motivé ». La plupart des produits vendus comme « numériquement anonymisés » réussissent le premier test, mais échouent au second.

Comment les individus sont anonymisés numériquement en pratique

L'anonymat numérique individuel ne se résume pas à une simple action, mais à un ensemble de solutions. Chaque couche masque un identifiant et laisse les autres intacts. La plupart des utilisateurs recherchent trois ou quatre outils, et non un seul produit étiqueté « anonymiseur ».

Couche réseau. Votre adresse IP est l'identifiant le plus facile à divulguer et le moins coûteux à masquer. Tor reste la solution la plus robuste au niveau du réseau, avec environ 2,5 millions d'utilisateurs quotidiens et une infrastructure d'environ 8 000 relais bénévoles (estimation mi-2025, selon Tor Metrics). Un VPN commercial est une alternative plus légère ; environ 32 % des adultes américains en utilisaient un en 2025, contre 46 % l'année précédente (d'après Security.org), et les applications VPN dans le monde comptent environ 147 millions d'utilisateurs. Tor gère les menaces étatiques. Un VPN gère votre FAI, votre employeur et le Wi-Fi des cafés. Ces deux solutions répondent à des problématiques différentes.

Couche navigateur. Choisissez un navigateur dont les paramètres par défaut supposent un réseau hostile : Brave, LibreWolf, Mullvad Browser ou Tor Browser pour une protection maximale. La protection contre l’empreinte numérique et le blocage des publicités sont plus importants ici qu’une fenêtre de navigation privée, qui ne fait que masquer l’historique local à une personne partageant votre ordinateur portable.

Couche d'identité. L'adresse e-mail est l'identifiant le plus précieux qu'un traqueur puisse collecter, car elle relie les profils des courtiers en données sur différents services. La solution ? Utiliser un alias par service via SimpleLogin (racheté par Proton en avril 2022, qui comptait alors plus de 100 000 utilisateurs et 2 millions d'alias) ou addy.io. Ajoutez un nom d'utilisateur par service et un numéro de téléphone virtuel pour les vérifications par SMS, et la jonction inter-sites la plus simple devient indétectable.

Couche de paiement. Bitcoin n'est plus un outil de confidentialité. Chainalysis affirme pouvoir tracer la quasi-totalité de la couche d'échange ; la part criminelle du volume on-chain a chuté d'environ 70 % à environ 20 % précisément parce que les enquêteurs dé-anonymisent régulièrement les chaînes. Monero est la seule cryptomonnaie majeure que Chainalysis déclare publiquement ne pas pouvoir tracer à grande échelle. La raison technique réside dans l'empilement des signatures de l'anneau CLSAG (anneaux de 16 membres : un signataire réel, 15 leurres), les adresses furtives et le masquage des montants via RingCT. Le prix à payer est la liquidité. Binance a retiré XMR de sa liste mondiale en septembre 2024 et Kraken l'a retiré de l'Espace économique européen le 31 décembre 2024, clôturant une vague de retraits de la liste de 60 plateformes d'échange en 2024 et d'environ 73 à la mi-2025. Malgré la compression des prix, Monero affichait une capitalisation boursière proche de 7,6 milliards de dollars et un volume de transactions quotidien d'environ 28 000 fin 2025, pour un prix avoisinant les 411 dollars en mai 2026. Les commerçants souhaitant accepter les cryptomonnaies sans imposer de procédure KYC à leurs clients peuvent utiliser des passerelles de paiement non dépositaires. Plisio, par exemple, prend en charge plus de 50 cryptomonnaies avec des frais de 0,5 %, contre une commission de 2 à 3 % généralement appliquée par les réseaux de cartes bancaires.

Hygiène des appareils et des comptes : aucun compte connecté dans la session privée. Profils distincts pour chaque identité. Ce système fonctionne uniquement si vous ne le désactivez pas en vous connectant au même compte Gmail sur tous les appareils.

| Couche | Ce qu'il cache | Outil de pointe | numéro 2025-2026 |

|---|---|---|---|

| Réseau | Visibilité IP, route et FAI | Tor / Mullvad VPN / Proton VPN | Tor compte environ 2,5 millions d'utilisateurs quotidiens et 147 millions d'applications VPN dans le monde. |

| Navigateur | Empreintes digitales, traqueurs, télémétrie | Navigateur Brave / LibreWolf / Mullvad | Brave 100M MAU (septembre 2025) |

| Identité | Inscription par e-mail, réutilisation du téléphone | SimpleLogin / addy.io | SimpleLogin : plus de 100 000 utilisateurs et plus de 2 millions d’alias |

| Paiement | Empreinte digitale des dépenses, KYC | Monero / Plisio non-custodial | Monero : environ 28 000 transactions quotidiennes, capitalisation de 7,6 milliards de dollars |

| Compte | Liaison interservices | Identités par service, pas d'authentification unique (SSO) | — |

Pourquoi les ensembles de données « anonymisés » sont-ils constamment réidentifiés ?

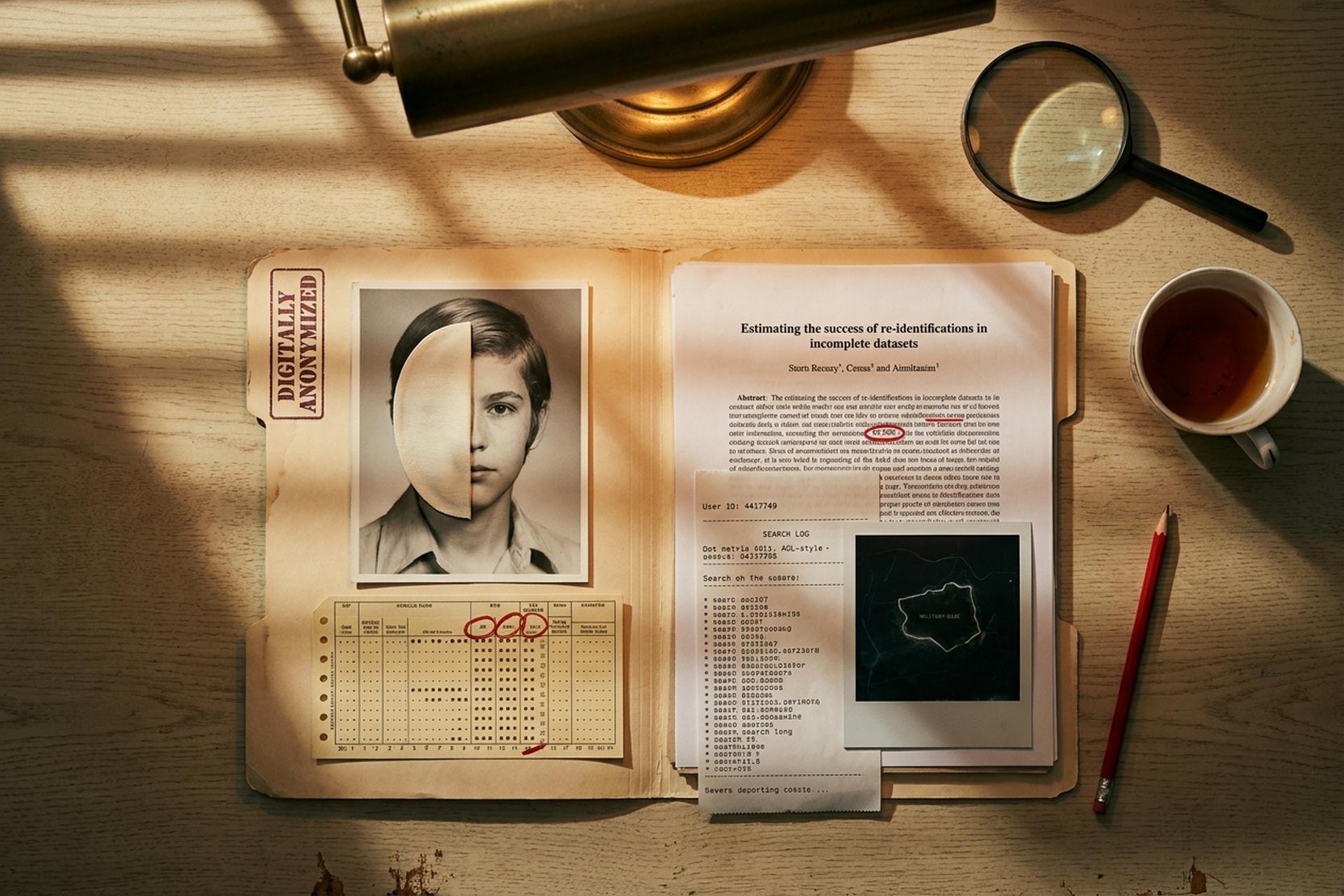

Le dossier universitaire est peu flatteur. Supprimer les noms ne suffit presque jamais.

| Année | Ensemble de données / événement | Résultat de réidentification |

|---|---|---|

| 1997 | Sortie de l'hôpital GIC du Massachusetts | Latanya Sweeney examine le bilan du gouverneur William Weld à l'aide des listes électorales publiques. |

| 2000 | Recensement américain de 1990 | Sweeney montre que 87 % des Américains sont uniques selon {ZIP, DOB, sex} |

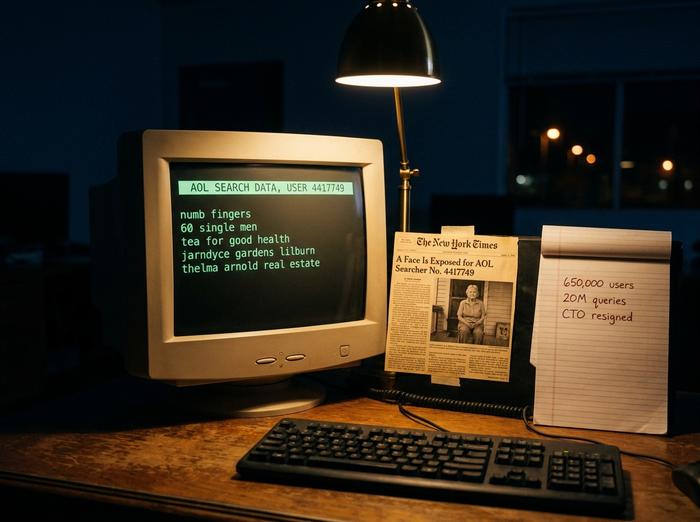

| 2006 | Journaux de recherche AOL (20 millions de requêtes / 650 000 utilisateurs) | Le New York Times identifie l'utilisateur 4417749 comme étant Thelma Arnold en moins de 5 jours ; le directeur technique démissionne. |

| 2008 | Prix Netflix (480 189 abonnés) | Narayanan et Shmatikov : 99 % des enregistrements sont identifiables avec 8 notes et des dates de 14 jours. |

| 2013 | 1,5 million d'abonnés à la téléphonie mobile | de Montjoye : 4 points spatio-temporels permettent d’identifier de manière unique 95 % des utilisateurs |

| 2014 | ensemble de données sur les taxis de New York | Numéros de médaillon hachés MD5 déchiffrés en moins de 2 minutes ; voyages de célébrités reconstitués |

| 2016 | Communiqué de presse de Medicare et PBS australien | Réidentification de 3 députés en exercice et d'un joueur de football australien en 5 semaines ; données retirées. |

| 2018 | Carte thermique mondiale de Strava | Environ 13 billions de points GPS ont révélé les périmètres des bases militaires en Irak, en Syrie et en Afghanistan. |

| 2019 | Rocher, Hendrickx, de Montjoye | 99,98 % des Américains sont correctement réidentifiés à partir de 15 attributs démographiques. |

| 2026 | Netflix « Enquête sur Lucy Letby » | Utilisation de l'IA pour identifier les témoins (visages et voix) ; anonymisation visuelle uniquement. |

Le scénario se répète. Un éditeur supprime les identifiants évidents, affirme que l'ensemble de données est anonymisé, et un chercheur, disposant d'une source auxiliaire publique (listes électorales, IMDb, photos de paparazzi, annuaires d'employeurs), les réunit à nouveau, révélant ainsi les véritables identités en quelques semaines.

L'affaire AOL d'août 2006 fut le premier cas de réidentification en situation réelle largement médiatisé, et l'historique de recherche s'avéra être un outil d'identification quasi-pertinent à part entière. Les requêtes de Thelma Arnold concernant des « doigts engourdis », « 60 hommes célibataires » et sa ville natale de Lilburn, en Géorgie, suffirent à deux journalistes du New York Times pour la retrouver sur le perron de sa maison. Trois employés d'AOL, dont le directeur technique, se retrouvèrent au chômage quelques semaines plus tard.

Le Prix Netflix, lancé en octobre 2006, a permis de recueillir environ 100 millions d'évaluations de 17 770 films auprès de 480 189 abonnés. Narayanan et Shmatikov ont publié leur article sur la désanonymisation des données lors de la conférence IEEE S&P 2008. Avec seulement deux évaluations et une période de trois jours, ils ont pu identifier de manière unique 68 % des abonnés. Avec huit évaluations et une période de quatorze jours, ce chiffre atteignait 99 %. Netflix a annulé la suite prévue en 2010 suite à une action en justice (Doe c. Netflix) et à une enquête de la FTC.

Le documentaire de Lucy Letby, sorti sur Netflix en février 2026, est une version grand public de cette même leçon. Le carton d'ouverture indique : « Certains intervenants ont été numériquement modifiés afin de préserver leur anonymat. Leurs noms, apparences et voix ont été modifiés. » La technique d'anonymisation utilisée ici est l'intelligence artificielle générative, et non un simple floutage ou une silhouette. Ce choix est motivé en partie par les témoins qui devaient se conformer à des injonctions judiciaires limitant leur visibilité publique. Les réactions du public sont partagées : certains critiquent l'utilisation de l'IA, la jugeant trop artificielle, tandis que d'autres défendent l'idée qu'un avatar IA préserve mieux les émotions humaines qu'une boîte noire. Or, ces deux points de vue passent à côté de l'essentiel. L'utilisation de l'IA pour l'anonymisation visuelle ne modifie en rien les indices comportementaux présents dans le témoignage lui-même : formulation, dates, intitulés de poste. Un intrus motivé, disposant de données anonymisées et d'une liste restreinte de candidats, aura toujours suffisamment d'éléments pour agir. L'IA a modifié l'apparence du résultat, mais pas les méthodes de réidentification.

Confidentialité différentielle et seule anonymisation honnête

Le cadre qui résiste aux attaques de type de Montjoye est la confidentialité différentielle. Dwork, McSherry, Nissim et Smith l'ont définie en 2006 dans leur article « Calibrating Noise to Sensitivity in Private Data Analysis ». L'idée n'est pas de supprimer les identifiants, mais d'ajouter un bruit soigneusement ajusté aux résultats des requêtes afin que la présence ou l'absence d'une personne dans les données soit statistiquement impossible à confirmer.

Elle s'accompagne d'un budget de confidentialité quantitatif, epsilon (ε). Plus epsilon est faible, plus le bruit est important et plus la confidentialité est renforcée. La confidentialité différentielle a été précédée de plusieurs cadres moins stricts. La k-anonymat, proposée par Sweeney en 2002, exige que chaque enregistrement soit identique à au moins k-1 autres en termes de quasi-identifiants. La l-diversité (Machanavajjhala et al., 2007) a ajouté une contrainte sur la diversité des attributs sensibles. La t-proximité (Li et al., 2007) a resserré la distribution. Ces trois méthodes sont des heuristiques. Seule la confidentialité différentielle offre une garantie mathématique dans le pire des cas contre l'utilisation de données auxiliaires arbitraires.

Les résultats en matière de déploiement sont mitigés. Apple a annoncé la confidentialité différentielle locale lors de la WWDC 2016, mais des audits de rétro-ingénierie ont révélé que ses paramètres epsilon variaient d'environ 2 à 8, ce que les chercheurs en protection de la vie privée jugent insuffisant. Le Bureau du recensement des États-Unis a appliqué la confidentialité différentielle à la version 2020 via son algorithme TopDown avec un ε global d'environ 19,61. Ce chiffre a lui aussi été critiqué pour son laxisme, mais le recensement de 2020 était la première publication nationale à offrir une garantie formelle de confidentialité. Si une allégation d'« anonymisation numérique » ne mentionne pas de valeur epsilon (ou au moins ak ou at), il s'agit presque certainement de l'ancienne méthode d'anonymisation par bande de 18 identifiants, et non de la méthode formelle.

Lucy Letby, les avatars d'IA et l'anonymisation numérique

Le documentaire sur Lucy Letby est l'exemple le plus commenté d'« anonymisation numérique des visages » début 2026, et ce pour une raison bien précise. Il retrace le parcours de cette infirmière néonatale britannique condamnée pour sept meurtres, et soulève de plus en plus de questions quant à une possible erreur judiciaire. Le choix de Netflix de remplacer les visages et les voix des témoins par des avatars générés par intelligence artificielle a des répercussions qui dépassent le cadre de cette affaire. L'opinion publique est partagée. Certains jugent les avatars distrayants, caricaturaux et troublants. D'autres défendent cette technique, estimant qu'elle préserve les émotions humaines, contrairement à une simple silhouette ou à l'utilisation de la voix seule.

Ce que le débat a surtout négligé, c'est le modèle de menace. Un visage virtuel créé par une IA n'est qu'une surcouche d'interface utilisateur. Il ne protège pas la source contre un intrus compétent et motivé qui dispose déjà d'une liste de candidats (d'autres membres du personnel du même service, du même hôpital et aux mêmes dates) et d'une transcription contenant les dates, les fonctions professionnelles et les tournures de phrase. L'affaire Lucy Letby, avec un établissement et une chronologie publics, illustre parfaitement ces deux points. Plus le nombre de sources potentielles est restreint, moins la superposition d'une IA est efficace. Il ne s'agit pas d'un argument contre la technique elle-même, mais d'un argument en faveur d'une clarification de ce qu'elle anonymise et de ce qu'elle ne couvre pas.

Ce que la loi exige des demandes « anonymisées numériquement »

Dans la plupart des marchés, trois organismes de réglementation définissent les normes minimales : le RGPD de l’UE, la loi HIPAA américaine relative aux données de santé et les recommandations de l’ICO britannique de 2025. Le considérant 26 du RGPD établit le critère de la « probabilité raisonnable ». La loi HIPAA propose soit une limitation de 18 identifiants spécifiques, soit une expertise concluant que le risque résiduel de réidentification est « très faible ». L’ICO britannique a réaffirmé le critère de l’intrus motivé en mars 2025.

Le changement juridique le plus important de l'année écoulée est venu de la Cour de justice de l'Union européenne. Dans l'affaire C-413/23, CEPD contre SRB, arrêtée le 4 septembre 2025, la CJUE a adopté une théorie relative des données à caractère personnel. Un même enregistrement peut être pseudonymisé pour une partie et anonyme pour une autre, selon ce que chaque partie peut raisonnablement savoir. Il s'agit d'un tournant majeur. Avant 2025, la position par défaut, défendue notamment par de Montjoye, était que les données riches étaient toujours considérées comme des données à caractère personnel, car la capacité de réidentification n'a pas de limite réelle. L'arrêt de 2025 précise que cette qualification dépend du contexte. Les deux points de vue peuvent coexister ; en pratique, cela permet aux parties en aval de faire valoir plus facilement que leur copie d'un ensemble de données est anonyme, même si la copie de l'éditeur original ne l'était pas.

Liste de vérification : les données sont-elles réellement anonymisées numériquement ?

Cinq questions à se poser avant de prendre cette étiquette au sérieux :

1. Quels identifiants ont été supprimés ? Les noms seuls ne suffisent pas. Les données démographiques, les horodatages et les attributs rares subsistent malgré la suppression des informations confidentielles et restent des informations identifiables.

2. Quelles données auxiliaires sont raisonnablement disponibles ? Listes électorales, IMDb, photos de paparazzi, annuaires d’employeurs. Tout élément exploitable est pertinent.

3. Existe-t-il une garantie formelle ? Un paramètre d’anonymat k, un indice de proximité t ou un epsilon de confidentialité différentielle ? Sans valeur numérique, aucune garantie.

4. Qui a validé l'affirmation ? Une équipe interne ou un auditeur externe, en se basant sur un modèle de menace d'intrus motivé défini.

5. Quels sont les recours en cas de réidentification ? Un ensemble de données anonymisées numériquement qui s’avère ne pas l’être constitue une violation de données, et non un communiqué de presse.

En 2026, l'expression « anonymisé numériquement » recouvre deux réalités distinctes. En tant que promesse d'expérience utilisateur (votre visage ne sera pas affiché), elle est acceptable, parfois élégante, parfois mal mise en œuvre. En tant qu'affirmation statistique (ces données sont anonymes), elle est presque toujours insuffisante sans garantie formelle. Il est donc essentiel de concevoir la pile technologique en partant du principe que l'étiquette ne représente que la moitié du travail qu'elle sous-entend. Exigez des explications mathématiques lorsque l'étiquette est apposée sur des données qui ne vous appartiennent pas.