Anonimizado digitalmente en 2026: qué significa y cómo serlo

La frase "anonimizado digitalmente" está teniendo un gran impacto en la actualidad. Netflix la utilizó este año en la introducción de un documental sobre crímenes reales. La película sustituyó los rostros y las voces de los testigos por personajes de IA. (La grafía británica "digitally anonymised" aparece en el mismo contexto en el texto dirigido al Reino Unido). Investigadores académicos utilizaron la misma frase en 2019 para un conjunto de datos de 1,5 millones de estadounidenses. Posteriormente, reidentificaron al 99,98 % de ellos a partir de tan solo 15 atributos simples. Ambas afirmaciones son técnicamente ciertas. Sin embargo, describen cosas radicalmente diferentes, casi opuestas, según cómo se interpreten. Por lo tanto, cuando alguien afirma que un rostro, un registro o un conjunto de datos completo ha sido anonimizado digitalmente, la única pregunta útil que cabe plantearse es qué significa realmente y frente a quién se supone que debe protegerse dicha anonimización.

Qué significa realmente "anonimizado digitalmente"

Dos ideas distintas se esconden tras la etiqueta. La primera es la desidentificación superficial: un rostro borroso, un nombre falso, un modulador de voz, un avatar de IA. Oculta a una persona de un observador que no intenta indagar más a fondo. La segunda es la anonimización estadística: un conjunto de registros modificado de tal manera que incluso un experto en reidentificación con datos públicos no puede vincular una fila con una persona. La primera es una medida de privacidad de datos. La segunda es la privacidad de datos propiamente dicha. El considerando 26 del RGPD capta la diferencia claramente. Los datos solo son anónimos cuando ningún "medio razonablemente probable de ser utilizado" puede reidentificarlos. La HIPAA codifica la misma idea como una franja de puerto seguro de 18 identificadores o una determinación de experto que establece que el riesgo de reidentificación es "muy pequeño". La guía de la ICO del Reino Unido, actualizada en marzo de 2025, la denomina la prueba del intruso motivado. La mayoría de los productos vendidos como "anonimizados digitalmente" superan la primera prueba y no la segunda.

Cómo se logra el anonimato digital de las personas en la práctica

El anonimato digital individual no se logra con un solo interruptor, sino mediante un conjunto de herramientas. Cada capa corrige un identificador y deja intactos los demás. La mayoría de los lectores prefieren tres o cuatro herramientas, no un único producto etiquetado como "anonimizador".

Capa de red. Tu dirección IP es el identificador más fácil de filtrar y el más fácil de ocultar. Tor sigue siendo la opción más robusta a nivel de red, con aproximadamente 2,5 millones de usuarios diarios y una infraestructura de alrededor de 8000 repetidores voluntarios a mediados de 2025, según Tor Metrics. Una VPN comercial es la alternativa más sencilla; alrededor del 32 % de los adultos estadounidenses usaron una en 2025, frente al 46 % del año anterior, según Security.org, y las aplicaciones VPN globales cuentan con aproximadamente 147 millones de usuarios. Tor gestiona los modelos de amenazas a nivel estatal. Una VPN gestiona a tu proveedor de internet, a tu empleador y al Wi-Fi de la cafetería. Ambas soluciones resuelven problemas diferentes.

Capa del navegador. Elige un navegador configurado por defecto para redes hostiles: Brave, LibreWolf, Mullvad Browser o Tor Browser son buenas opciones. La protección contra el rastreo de huellas digitales y el bloqueo de anuncios son más importantes que una ventana privada, que solo oculta el historial local a quien comparte tu portátil.

Capa de identidad. El correo electrónico es el identificador más útil que un rastreador puede recopilar, ya que une los perfiles de los intermediarios de datos en diferentes servicios. La solución consiste en usar un alias por servicio a través de SimpleLogin (adquirido por Proton en abril de 2022 con más de 100 000 usuarios y 2 millones de alias en ese momento) o addy.io. Si se añade un nombre de usuario por servicio y un número de teléfono virtual para verificaciones por SMS, la unión entre sitios más sencilla se vuelve inaccesible.

Capa de pago. Bitcoin ya no es una herramienta de privacidad. Chainalysis afirma que puede rastrear prácticamente toda la capa de negociación; la proporción criminal del volumen en la cadena ha caído de alrededor del 70% a aproximadamente el 20% precisamente porque los investigadores desanonimizan las cadenas de forma rutinaria. Monero es la única criptomoneda importante que Chainalysis afirma públicamente que no puede rastrear a gran escala. La razón técnica es la pila de firmas de anillo CLSAG (anillos de 16 miembros: un firmante real, 15 señuelos), direcciones ocultas y ocultación de la cantidad de RingCT. El precio es la liquidez. Binance eliminó globalmente XMR de su lista en septiembre de 2024 y Kraken lo retiró del Espacio Económico Europeo antes del 31 de diciembre de 2024, poniendo fin a una ola de eliminación de 60 exchanges en 2024 y alrededor de 73 para mediados de 2025. A pesar de la presión, Monero mantuvo una capitalización de mercado cercana a los 7600 millones de dólares y un volumen de transacciones diarias de alrededor de 28 000 a finales de 2025, con un precio cercano a los 411 dólares en mayo de 2026. Los comercios que deseen aceptar criptomonedas sin exigir a los compradores que completen el proceso KYC pueden utilizar pasarelas de pago sin custodia. Plisio, por ejemplo, admite más de 50 criptomonedas con una comisión del 0,5 %, frente a la tasa de descuento para comerciantes del 2-3 % típica de las plataformas de pago con tarjeta.

Higiene del dispositivo y la cuenta. No se permiten cuentas con sesión iniciada en la sesión privada. Perfiles separados para identidades separadas. Esta configuración solo funciona si no la reviertes iniciando sesión con la misma cuenta de Gmail en todas ellas.

| Capa | Lo que oculta | Herramienta de primera categoría | Número 2025-2026 |

|---|---|---|---|

| Red | IP, ruta, visibilidad del ISP | VPN Tor / Mullvad / VPN Proton | Tor cuenta con aproximadamente 2,5 millones de usuarios diarios y 147 millones de aplicaciones VPN a nivel mundial. |

| Navegador | Huella dactilar, rastreadores, telemetría | Navegador Brave / LibreWolf / Mullvad | Brave alcanza los 100 millones de usuarios activos mensuales (septiembre de 2025) |

| Identidad | Unirse por correo electrónico, reutilizar el teléfono | SimpleLogin / addy.io | SimpleLogin cuenta con más de 100.000 usuarios y más de 2 millones de alias. |

| Pago | Huella digital de gastos, KYC | Monero / Plisio sin custodia | Monero ~28.000 transacciones diarias, capitalización de $7.600 millones |

| Cuenta | Vinculación entre servicios | Identidades por servicio, sin inicio de sesión único (SSO) | — |

¿Por qué los conjuntos de datos "anonimizados" siguen siendo reidentificados?

El expediente académico no es nada halagador. Eliminar los nombres casi nunca es suficiente.

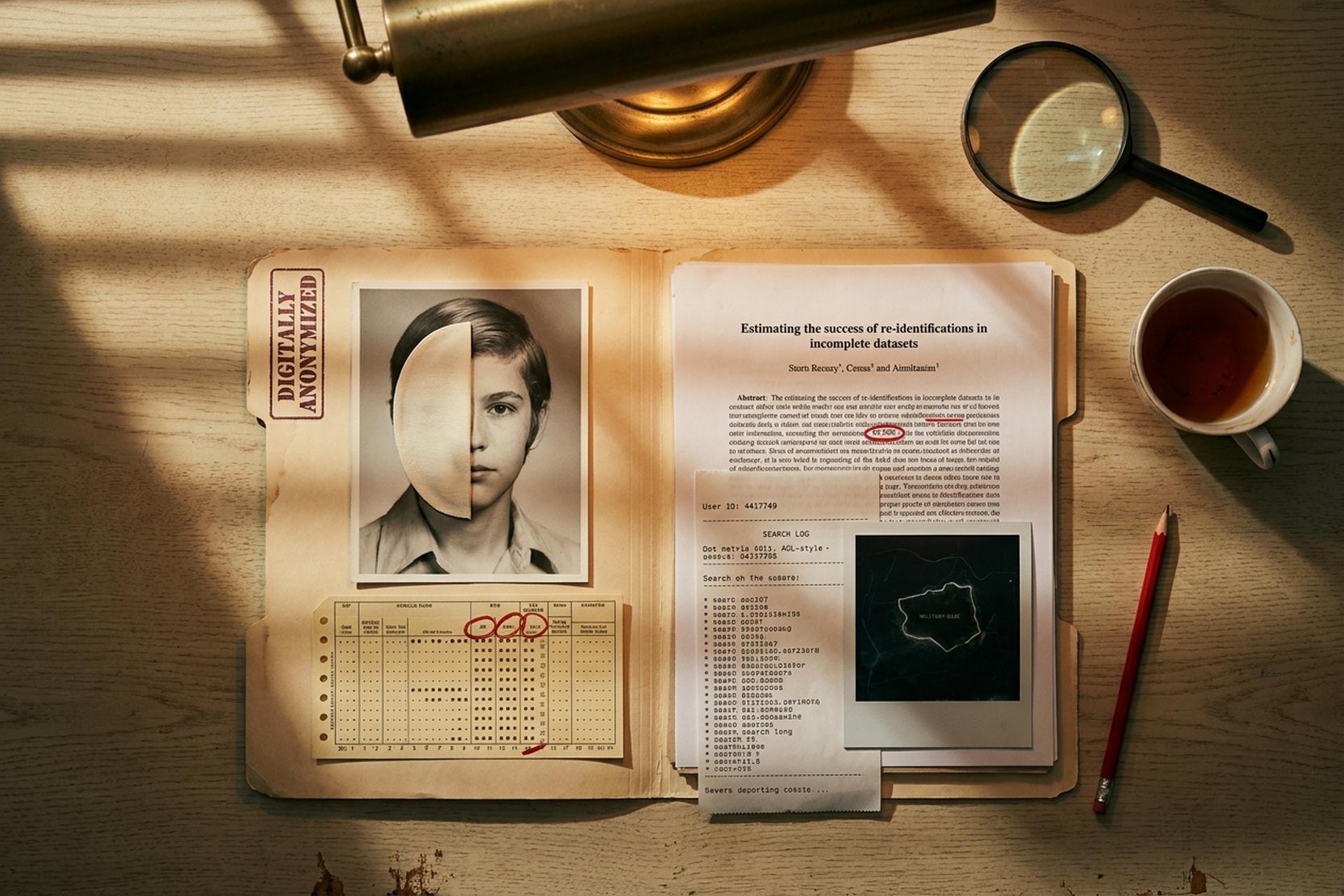

| Año | Conjunto de datos / evento | Resultado de la reidentificación |

|---|---|---|

| 1997 | Comunicado del hospital GIC de Massachusetts | Latanya Sweeney analiza el historial del gobernador William Weld utilizando los registros públicos de votantes. |

| 2000 | Censo de Estados Unidos de 1990 | Sweeney muestra que el 87% de los estadounidenses son únicos por {ZIP, DOB, sex} |

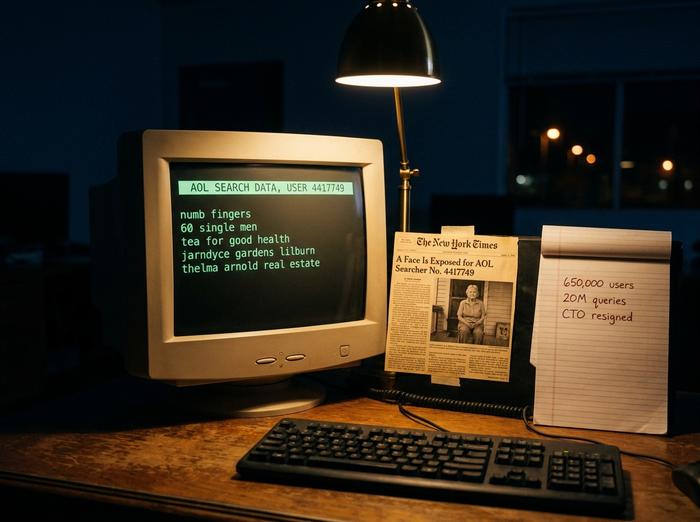

| 2006 | Registros de búsqueda de AOL (20 millones de consultas / 650 mil usuarios) | El NYT identifica al usuario 4417749 como Thelma Arnold en 5 días; el CTO renuncia. |

| 2008 | Premio Netflix (480.189 suscriptores) | Narayanan y Shmatikov: 99% de los registros identificables con 8 calificaciones + fechas de 14 días |

| 2013 | 1,5 millones de suscriptores de telefonía móvil | de Montjoye: 4 puntos espaciotemporales identifican de forma única al 95% de los usuarios. |

| 2014 | conjunto de datos de taxis de Nueva York | Los números de medallones con hash MD5 se revirtieron en menos de 2 minutos; se reconstruyeron los viajes de las celebridades. |

| 2016 | Comunicado de prensa de Medicare y PBS de Australia | Reidentificación de 3 diputados en ejercicio y un jugador de la AFL en un plazo de 5 semanas; se retira el conjunto de datos. |

| 2018 | Mapa de calor global de Strava | Aproximadamente 13 billones de puntos GPS revelaron los perímetros de bases militares en Irak, Siria y Afganistán. |

| 2019 | Rocher, Hendrickx, de Montjoye | El 99,98% de los estadounidenses se pueden identificar correctamente a partir de 15 atributos demográficos. |

| 2026 | Netflix "Investigación sobre Lucy Letby" | Rostros y voces de IA aplicados a los testigos; solo anonimización visual. |

El patrón se repite. Una editorial elimina los identificadores obvios, afirma que el conjunto de datos está anonimizado y un investigador con una fuente auxiliar pública (registros electorales, IMDB, fotos de paparazzi, directorios de empleadores) vuelve a unir las dos partes, y las identidades reales quedan al descubierto en cuestión de semanas.

El caso de AOL en agosto de 2006 fue el primer caso de reidentificación en la vida real ampliamente difundido, y los historiales de búsqueda resultaron ser, por sí mismos, una especie de identificadores. Las búsquedas de Thelma Arnold sobre "dedos entumecidos", "60 hombres solteros" y su ciudad natal, Lilburn, Georgia, fueron suficientes para que dos reporteros del New York Times la encontraran en el porche. Tres empleados de AOL, incluido el director de tecnología, perdieron su trabajo en cuestión de semanas.

El premio Netflix, lanzado en octubre de 2006, publicó cerca de 100 millones de calificaciones de 480.189 suscriptores para 17.770 películas. Narayanan y Shmatikov publicaron su artículo sobre desanonimización en IEEE S&P 2008. Con tan solo dos calificaciones y un intervalo de tres días, pudieron identificar de forma unívoca al 68% de los suscriptores. Con ocho calificaciones y un intervalo de catorce días, la cifra aumentó al 99%. Netflix canceló la secuela prevista en 2010 tras una demanda de Doe contra Netflix y una investigación de la FTC.

El documental de Lucy Letby, estrenado en Netflix en febrero de 2026, es la versión para el público general de la misma lección. El título inicial dice: "Algunos participantes han sido digitalmente disfrazados para mantener el anonimato. Sus nombres, apariencias y voces han sido alterados". La técnica de anonimización empleada es la IA generativa, en lugar de un desenfoque o una silueta, motivada en parte por la necesidad de los testigos de cumplir con las órdenes judiciales que limitaban su visibilidad pública. La reacción del público se dividió entre la queja sobre el efecto del valle inquietante en el uso de la IA y la defensa de que un avatar de IA preserva mejor las emociones humanas que una caja negra. Ambas posturas pasan por alto el punto fundamental. El uso de la IA para la anonimización visual no elimina las huellas conductuales presentes en el testimonio: la forma de expresarse, las fechas, los cargos laborales. Un intruso motivado, con datos anonimizados y una lista corta de candidatos, aún tiene mucho material con el que trabajar. La IA ha cambiado la apariencia del resultado, pero no la lógica de la reidentificación.

Privacidad diferencial y la única anonimización honesta

El marco que sobrevive a la clase de ataques de De Montjoye es la privacidad diferencial. Dwork, McSherry, Nissim y Smith la definieron en 2006 en su artículo "Calibrating Noise to Sensitivity in Private Data Analysis". La idea no es eliminar los identificadores, sino añadir ruido cuidadosamente ajustado a los resultados de las consultas para que la presencia o ausencia de cualquier persona en los datos sea estadísticamente negable.

Viene con un presupuesto de privacidad cuantitativo, épsilon (ε). Un épsilon menor significa más ruido y mayor privacidad. El camino hacia la privacidad diferencial fue una secuencia de marcos más débiles. La k-anonimidad, propuesta por Sweeney en 2002, requiere que cada registro se vea igual que al menos k-1 otros en los cuasi-identificadores. La l-diversidad (Machanavajjhala et al. 2007) agregó una restricción a la diversidad de atributos sensibles. La t-cercanía (Li et al. 2007) ajustó la distribución. Los tres son heurísticos. Solo la privacidad diferencial proporciona una garantía matemática en el peor de los casos contra datos auxiliares arbitrarios.

El historial de implementación es mixto. Apple anunció privacidad diferencial local en la WWDC 2016, pero las auditorías de ingeniería inversa encontraron que sus configuraciones de épsilon variaban de aproximadamente 2 a 8, lo que los investigadores de privacidad consideran débil. La Oficina del Censo de EE. UU. aplicó privacidad diferencial a la publicación de 2020 mediante su algoritmo TopDown con un ε global de alrededor de 19,61. Ese número recibió críticas por ser demasiado laxo, pero el Censo de 2020 fue la primera publicación nacional que incluyó alguna garantía formal de privacidad. Si una afirmación de "anonimización digital" no indica un épsilon —o al menos ak o at—, es casi seguro que se trata del tipo antiguo de tira de 18 identificadores, no del tipo formal.

Lucy Letby, avatares de IA y anonimización digital

El documental sobre Lucy Letby es, con razón, el ejemplo más comentado de "rostro digitalmente anonimizado" a principios de 2026. El documental trata sobre la enfermera neonatal británica condenada por siete asesinatos, con crecientes dudas sobre un posible error judicial. La decisión de Netflix de reemplazar los rostros y las voces de los testigos con avatares generados por IA tiene repercusiones que van más allá del caso. La reacción del público fue dividida. Un sector calificó a los avatares de distractores, "caricaturescos" e inquietantes. El otro defendió la técnica argumentando que preservaba la emoción humana, algo que un tratamiento basado únicamente en siluetas o voces habría aplanado.

Lo que en el debate se ha pasado por alto en gran medida es el modelo de amenazas. Un rostro creado con IA es una capa superpuesta a la experiencia de usuario. No protege a la fuente contra un intruso competente y motivado que ya cuenta con una lista de posibles candidatos (otros empleados de la misma unidad en el mismo hospital durante las mismas fechas) y una transcripción con fechas, funciones profesionales y expresiones clave. El caso de Lucy Letby, con una institución y una cronología públicas, presenta ambos. Cuanto más reducido sea el grupo de fuentes, menos beneficios ofrece una superposición de IA. Esto no es un argumento en contra de la técnica, sino un argumento a favor de la claridad sobre lo que anonimiza y lo que no.

Lo que exige la ley en relación con las reclamaciones "anonimizadas digitalmente"

En la mayoría de los mercados, tres organismos reguladores establecen los límites mínimos: el RGPD de la UE, la HIPAA de EE. UU. para datos sanitarios y la guía de la ICO del Reino Unido de 2025. El considerando 26 del RGPD establece el criterio de "probabilidad razonable". La HIPAA ofrece una franja de 18 identificadores específicos del Safe Harbor o una opinión de un experto que determine que el riesgo residual de reidentificación es "muy pequeño". La ICO del Reino Unido reafirmó el criterio del intruso motivado en marzo de 2025.

El cambio jurídico más significativo del último año provino del Tribunal de Justicia de la Unión Europea (TJUE). En el asunto C-413/23, SEPD contra SRB, resuelto el 4 de septiembre de 2025, el TJUE adoptó una teoría relativa de los datos personales. Un mismo registro puede ser seudónimo en manos de una parte y anónimo en manos de otra, en función de lo que cada parte pueda saber razonablemente. Esto representa un giro importante. La postura predominante antes de 2025, impulsada por de Montjoye y otros, era que los datos enriquecidos siempre son datos personales, dado que la capacidad de reidentificación no tiene un límite real. La sentencia de 2025 establece que la decisión depende del contexto. Ambas posturas pueden coexistir; en la práctica, esto otorga mayor margen a las partes receptoras para argumentar que su copia de un conjunto de datos es anónima, incluso si la copia del editor original no lo era.

Lista de verificación: ¿Los datos están realmente anonimizados digitalmente?

Cinco preguntas que debes hacerte antes de tomarte en serio la etiqueta:

1. ¿Qué identificadores se eliminaron? Los nombres por sí solos no son suficientes. Los datos demográficos, las marcas de tiempo y los atributos poco comunes sobreviven a cada eliminación de Safe Harbor y siguen siendo información identificable.

2. ¿Qué datos auxiliares están razonablemente disponibles? Listas de votantes, IMDB, fotos de paparazzi, directorios de empleadores. Cualquier cosa que se pueda combinar cuenta.

3. ¿Existe alguna garantía formal? ¿Un parámetro de anonimato k, un número de cercanía t o un épsilon de privacidad diferencial? Sin un número, no hay garantía.

4. ¿Quién validó la afirmación? Un equipo interno o un auditor externo, basándose en un modelo de amenazas de intrusos motivados definido.

5. ¿Qué medidas se pueden tomar si se produce una reidentificación? Un conjunto de datos anonimizados digitalmente que resulta no serlo constituye una violación de seguridad, no un comunicado de prensa.

La interpretación honesta de "anonimizado digitalmente" en 2026 es que abarca dos cosas inconexas a la vez. Como promesa de UX (no mostraremos tu rostro) es aceptable, a veces elegante, a veces mal ejecutada. Como afirmación estadística (este conjunto de datos es anónimo) casi siempre es insuficiente sin una garantía formal. Construye la pila individual partiendo de la base de que la etiqueta solo realiza la mitad del trabajo que implica. Exige los cálculos cuando la etiqueta se aplique a datos de terceros.