Digitale Anonymisierung im Jahr 2026: Was es bedeutet und wie man sie behebt

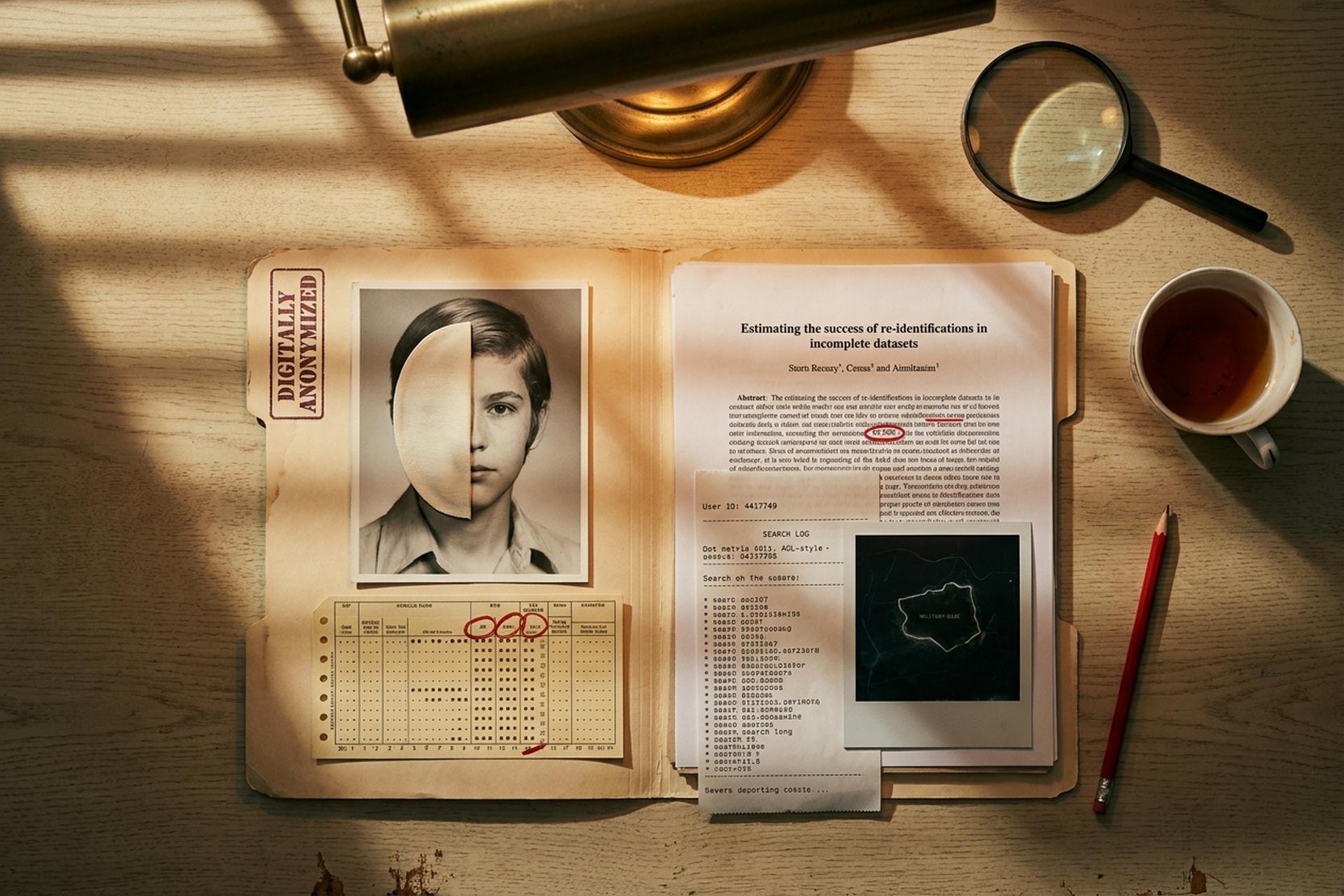

Der Begriff „digital anonymisiert“ spielt derzeit eine wichtige Rolle. Netflix verwendete ihn dieses Jahr im Vorspann einer True-Crime-Dokumentation. Im Film wurden Gesichter und Stimmen von Zeugen durch KI-gesteuerte Charaktere ersetzt. (Die britische Schreibweise „digitally anonymisiertised“ wird im selben Kontext für britische Nutzer verwendet.) Akademische Forscher nutzten denselben Begriff 2019 für einen Datensatz mit 1,5 Millionen US-Amerikanern. Sie konnten 99,98 % von ihnen anhand von nur 15 einfachen Merkmalen wiedererkennen. Beide Aussagen sind technisch korrekt. Sie beschreiben jedoch grundverschiedene – je nach Interpretation sogar gegensätzliche – Dinge. Wenn Ihnen also jemand mitteilt, dass ein Gesicht, ein Datensatz oder ein ganzer Datensatz digital anonymisiert wurde, ist die einzig sinnvolle Frage, was genau damit gemeint ist und gegenüber wem diese Anonymisierung gelten soll.

Was „digital anonymisiert“ tatsächlich bedeutet

Hinter dem Etikett verbergen sich zwei unterschiedliche Konzepte. Das erste ist die oberflächliche Anonymisierung: ein verpixeltes Gesicht, ein falscher Name, ein Stimmverzerrer, ein KI-Avatar. Dadurch wird eine Person vor einem Betrachter verborgen, der nicht weiter recherchiert. Das zweite ist die statistische Anonymisierung: Ein Datensatz wird so verändert, dass selbst ein versierter Experte mit öffentlich zugänglichen Daten eine Zeile nicht mehr einer Person zuordnen kann. Ersteres ist eine Geste des Datenschutzes. Letzteres ist der eigentliche Datenschutz. Erwägungsgrund 26 der DSGVO verdeutlicht den Unterschied: Daten sind nur dann anonym, wenn sie mit keinem vernünftigerweise anwendbaren Mittel reidentifiziert werden können. HIPAA kodiert dasselbe Konzept als „Safe Harbor“-Streifen mit 18 Identifikationsmerkmalen oder als Expertenfeststellung, dass das Risiko der Reidentifizierung „sehr gering“ ist. Die Leitlinien des ICO UK (aktualisiert im März 2025) bezeichnen dies als „Test des motivierten Eindringlings“. Die meisten als „digital anonymisiert“ verkauften Produkte bestehen den ersten Test, fallen aber beim zweiten durch.

Wie Einzelpersonen in der Praxis digital anonymisiert werden

Individuelle digitale Anonymität lässt sich nicht mit einem einzigen Schalter beheben, sondern ist ein komplexes System. Jede Schicht blockiert einen Identifikator und lässt die anderen unberührt. Die meisten Nutzer wünschen sich drei oder vier Tools, nicht ein einzelnes Produkt mit der Bezeichnung „Anonymisierer“.

Netzwerkschicht. Ihre IP-Adresse ist der am einfachsten zu ermittelnde und zu verbergende Identifikator. Tor bleibt die sicherste Option auf Netzwerkebene mit rund 2,5 Millionen täglichen Nutzern und einer Infrastruktur von etwa 8.000 freiwilligen Relays (Stand: Mitte 2025 laut Tor Metrics). Ein kommerzielles VPN ist die ressourcenschonendere Alternative; laut Security.org nutzten 2025 etwa 32 % der Erwachsenen in den USA ein solches, im Vergleich zu 46 % im Vorjahr. Weltweit verzeichnen VPN-Apps rund 147 Millionen Nutzer. Tor schützt vor Bedrohungen durch Staaten. Ein VPN schützt vor Ihrem Internetanbieter, Ihrem Arbeitgeber und dem WLAN im Café. Die beiden lösen unterschiedliche Probleme.

Browserebene. Wählen Sie einen Browser, der standardmäßig von einem unsicheren Netzwerk ausgeht: Brave, LibreWolf, Mullvad Browser oder Tor Browser bieten den sichersten Schutz. Fingerabdruckschutz und Werbeblockierung sind hier wichtiger als ein privates Fenster, das lediglich den Browserverlauf vor anderen Nutzern Ihres Laptops verbirgt.

Identitätsebene. E-Mail-Adressen sind der wichtigste Identifikator, den ein Tracker erfassen kann, da sie die Profile von Datenhändlern dienstübergreifend verknüpfen. Die Lösung besteht in der Verwendung eines Alias pro Dienst über SimpleLogin (im April 2022 von Proton übernommen, damals mit über 100.000 Nutzern und 2 Millionen Aliasen) oder addy.io. Mit einem dienstspezifischen Benutzernamen und einer virtuellen Telefonnummer für SMS-Verifizierungen wird die einfachste dienstübergreifende Verknüpfung unterbunden.

Zahlungsebene. Bitcoin ist kein Instrument der Privatsphäre mehr. Chainalysis behauptet, praktisch die gesamte Handelsebene nachverfolgen zu können; der Anteil krimineller Transaktionen am On-Chain-Volumen ist von rund 70 % auf etwa 20 % gesunken, da Ermittler regelmäßig Blockchains deanonymisieren. Monero ist die einzige größere Kryptowährung, die Chainalysis nach eigenen Angaben nicht in großem Umfang nachverfolgen kann. Der technische Grund dafür ist die Vielzahl an CLSAG-Ringsignaturen (16-köpfige Ringe: ein echter Unterzeichner, 15 Lockvögel), Stealth-Adressen und die Verschleierung von RingCT-Beträgen. Der Preis dafür ist Liquidität. Binance nahm XMR im September 2024 weltweit vom Handel, und Kraken zog es bis zum 31. Dezember 2024 aus dem Europäischen Wirtschaftsraum zurück. Damit endete eine Delisting-Welle von 60 Börsen im Jahr 2024 und rund 73 bis Mitte 2025. Trotz des Drucks erreichte Monero Ende 2025 eine Marktkapitalisierung von fast 7,6 Milliarden US-Dollar und rund 28.000 Transaktionen täglich. Der Kurs lag im Mai 2026 bei etwa 411 US-Dollar. Händler, die Kryptowährungen akzeptieren möchten, ohne Käufer zu einer KYC-Prüfung zu zwingen, können Non-Custodial-Gateways nutzen. Plisio beispielsweise unterstützt über 50 Kryptowährungen mit einer Gebühr von 0,5 %, im Gegensatz zu den üblichen Händlergebühren von 2–3 % bei Kartenzahlungssystemen.

Geräte- und Kontohygiene. Keine angemeldeten Konten während der privaten Sitzung. Separate Profile für separate Identitäten. Die Sicherheitsvorkehrungen funktionieren nur, wenn Sie sie nicht durch die Anmeldung mit demselben Gmail-Konto auf allen Konten rückgängig machen.

| Schicht | Was es verbirgt | Erstklassiges Werkzeug | Anzahl 2025-2026 |

|---|---|---|---|

| Netzwerk | IP-, Routen- und ISP-Sichtbarkeit | Tor / Mullvad VPN / Proton VPN | Tor hat rund 2,5 Millionen tägliche Nutzer und 147 Millionen VPN-Apps weltweit. |

| Browser | Fingerabdruck, Tracker, Telemetrie | Brave / LibreWolf / Mullvad Browser | Brave erreicht 100 Millionen monatlich aktive Nutzer (Sep 2025) |

| Identität | E-Mail-Anmeldung, Telefonwiederverwendung | SimpleLogin / addy.io | SimpleLogin: Über 100.000 Benutzer, über 2 Millionen Aliase |

| Zahlung | Fingerabdruck, KYC | Monero / Plisio nicht-verwahrend | Monero: Täglich ca. 28.000 Transaktionen, Marktkapitalisierung 7,6 Mrd. USD |

| Konto | Dienstübergreifende Verknüpfung | Dienstspezifische Identitäten, kein SSO | — |

Warum "anonymisierte" Datensätze immer wieder reidentifiziert werden

Die akademischen Leistungen sind wenig schmeichelhaft. Namen zu entfernen, reicht fast nie aus.

| Jahr | Datensatz / Ereignis | Ergebnis der Reidentifizierung |

|---|---|---|

| 1997 | Entlassung aus dem GIC-Krankenhaus in Massachusetts | Latanya Sweeney analysiert die Wählerbilanz von Gouverneur William Weld anhand öffentlicher Wählerverzeichnisse. |

| 2000 | US-Volkszählung von 1990 | Sweeney zeigt, dass 87 % der Amerikaner einzigartig sind ({ZIP, DOB, sex}). |

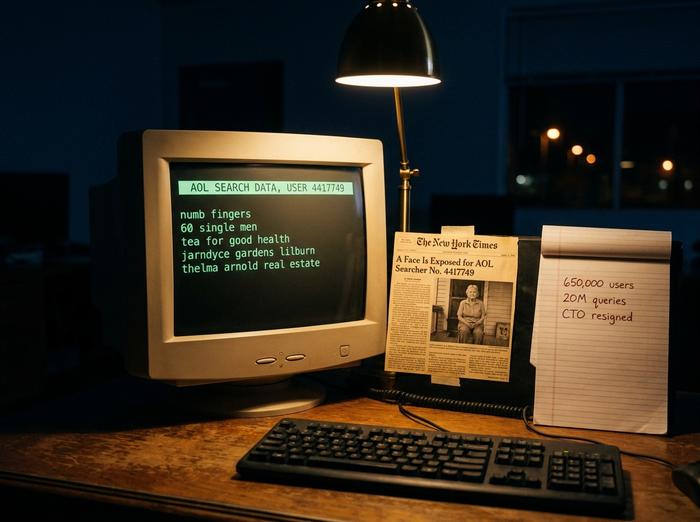

| 2006 | AOL-Suchprotokolle (20 Mio. Suchanfragen / 650.000 Nutzer) | Die New York Times identifiziert Nutzerin 4417749 innerhalb von 5 Tagen als Thelma Arnold; der CTO tritt zurück. |

| 2008 | Netflix-Preis (480.189 Abonnenten) | Narayanan und Shmatikov: 99 % der Datensätze identifizierbar mit 8 Bewertungen + 14-tägigen Daten |

| 2013 | 1,5 Millionen Mobilfunkteilnehmer | de Montjoye: 4 raumzeitliche Punkte identifizieren 95 % der Nutzer eindeutig. |

| 2014 | NYC-Taxidatensatz | MD5-gehashte Medaillonnummern in weniger als 2 Minuten umgekehrt; Promi-Reisen rekonstruiert |

| 2016 | Veröffentlichung von Australian Medicare und PBS | Wiedererkennung von drei amtierenden Parlamentsabgeordneten und einem AFL-Spieler innerhalb von fünf Wochen; Datensatz zurückgezogen |

| 2018 | Strava globale Heatmap | Rund 13 Billionen GPS-Punkte enthüllten die Umrisse von Militärbasen im Irak, in Syrien und in Afghanistan. |

| 2019 | Rocher, Hendrickx, de Montjoye | 99,98 % der Amerikaner können anhand von 15 demografischen Merkmalen korrekt wiedererkannt werden. |

| 2026 | Netflix „Untersuchung von Lucy Letby“ | KI-Gesichter und -Stimmen werden auf Zeugen angewendet; nur visuelle Anonymisierung |

Das Muster wiederholt sich. Ein Herausgeber entfernt die offensichtlichen Identifikationsmerkmale, behauptet, der Datensatz sei anonymisiert, und ein Forscher mit einer öffentlichen Hilfsquelle (Wählerverzeichnisse, IMDB, Paparazzi-Fotos, Arbeitgeberverzeichnisse) führt die beiden wieder zusammen, wodurch innerhalb weniger Wochen die wahren Identitäten aufgedeckt werden.

Der AOL-Fall im August 2006 war der erste öffentlichkeitswirksame Fall von Reidentifizierung in der realen Welt, und Suchverläufe erwiesen sich als eigenständige, quasi-identifizierende Merkmale. Thelma Arnolds Suchanfragen zu „tauben Fingern“, „60 alleinstehenden Männern“ und ihrer Heimatstadt Lilburn, Georgia, reichten aus, damit zwei Reporter der New York Times sie auf der Veranda ausfindig machten. Drei AOL-Mitarbeiter, darunter der CTO, verloren innerhalb weniger Wochen ihre Jobs.

Der im Oktober 2006 ins Leben gerufene Netflix Prize veröffentlichte rund 100 Millionen Bewertungen von 480.189 Abonnenten für 17.770 Filme. Narayanan und Shmatikov präsentierten ihre Studie zur De-Anonymisierung auf der IEEE S&P 2008. Bereits mit zwei Bewertungen und einem dreitägigen Zeitraum konnten sie 68 % der Abonnenten eindeutig identifizieren. Mit acht Bewertungen und einem vierzehntägigen Zeitraum stieg dieser Wert auf 99 %. Netflix stellte die geplante Fortsetzung 2010 nach einer Klage von Doe gegen Netflix und einer Untersuchung der FTC ein.

Die Lucy-Letby-Dokumentation, die im Februar 2026 auf Netflix erschien, vermittelt dieselbe Lektion auf konsumentengerechte Weise. Die einleitende Einblendung lautet: „Einige Mitwirkende wurden digital anonymisiert, um ihre Anonymität zu wahren. Ihre Namen, ihr Aussehen und ihre Stimmen wurden verändert.“ Die Anonymisierungstechnik basiert hier auf generativer KI und nicht auf Unschärfe oder Silhouetten. Hintergrund war unter anderem, dass Zeugen gerichtlichen Anordnungen nachkommen mussten, die ihre öffentliche Sichtbarkeit einschränkten. Die Reaktionen des Publikums spalteten sich: Einerseits wurde der Einsatz von KI als unheimlich empfunden, andererseits argumentierte man, ein KI-Avatar bewahre menschliche Emotionen besser als eine Blackbox. Beide Meinungen verkennen jedoch den Kern der Sache. Die visuelle Anonymisierung mittels KI ändert nichts an den Verhaltensmustern in den Aussagen selbst: Formulierungen, Daten, Berufsbezeichnungen. Ein motivierter Angreifer hat mit anonymisierten Daten und einer kurzen Liste potenzieller Zeugen immer noch genügend Material zur Verfügung. Die KI hat lediglich das Erscheinungsbild der Ergebnisse verändert. Die zugrundeliegende Mathematik der Wiederidentifizierung bleibt jedoch unverändert.

Differenzielle Privatsphäre und die einzig ehrliche Anonymisierung

Das Rahmenwerk, das den De-Montjoye-Angriff übersteht, ist die differentielle Privatsphäre. Dwork, McSherry, Nissim und Smith definierten sie 2006 in ihrer Arbeit „Calibrating Noise to Sensitivity in Private Data Analysis“. Die Idee besteht nicht darin, Identifikatoren zu entfernen. Vielmehr geht es darum, den Abfrageergebnissen gezielt abgestimmtes Rauschen hinzuzufügen, sodass die Anwesenheit oder Abwesenheit einer Person in den Daten statistisch nicht mehr nachweisbar ist.

Es beinhaltet ein quantitatives Datenschutzbudget, Epsilon (ε). Ein niedrigerer Epsilon-Wert bedeutet mehr Rauschen und einen höheren Datenschutz. Der Differential Privacy ging eine Reihe schwächerer Ansätze voraus. Die 2002 von Sweeney vorgeschlagene k-Anonymität verlangt, dass jeder Datensatz hinsichtlich der Quasi-Identifikatoren mit mindestens k-1 anderen übereinstimmt. Die l-Diversität (Machanavajjhala et al., 2007) führte eine Einschränkung der Diversität sensibler Attribute ein. Die t-Nähe (Li et al., 2007) verschärfte die Verteilung. Alle drei sind Heuristiken. Nur die Differential Privacy bietet eine mathematische Garantie gegen beliebige Hilfsdaten im ungünstigsten Fall.

Die Erfahrungen mit der Implementierung sind uneinheitlich. Apple kündigte auf der WWDC 2016 lokale differentielle Privatsphäre an, doch Reverse-Engineering-Analysen ergaben, dass die Epsilon-Werte zwischen etwa 2 und 8 lagen, was Datenschutzforscher als schwach einstufen. Das US Census Bureau wandte differentielle Privatsphäre bei der Veröffentlichung der Volkszählung 2020 mittels seines TopDown-Algorithmus mit einem globalen ε von etwa 19,61 an. Dieser Wert wurde aufgrund seiner Ungenauigkeit kritisiert, doch die Volkszählung 2020 war die erste nationale Veröffentlichung mit einer formalen Datenschutzgarantie. Wenn in einer Aussage zur „digitalen Anonymisierung“ kein Epsilon – oder zumindest kein ak oder at – angegeben ist, handelt es sich mit hoher Wahrscheinlichkeit um die ältere Variante mit 18 Identifikatoren, nicht um die formale.

Lucy Letby, KI-Avatare und digitale Anonymisierung

Die Dokumentation über Lucy Letby ist aus gutem Grund das meistdiskutierte Beispiel für „digital anonymisierte Gesichter“ Anfang 2026. Sie handelt von der britischen Kinderkrankenschwester, die wegen siebenfachen Mordes verurteilt wurde, und wirft immer mehr Fragen nach einem möglichen Justizirrtum auf. Netflix’ Entscheidung, die Gesichter und Stimmen von Zeugen durch KI-generierte Avatare zu ersetzen, hat weitreichende Konsequenzen. Die Reaktionen des Publikums waren geteilt. Die einen empfanden die Avatare als ablenkend, „cartoonhaft“ und unheimlich. Die anderen verteidigten die Technik, da sie menschliche Emotionen bewahre, die durch eine Silhouette oder die Verwendung nur der Stimme verloren gegangen wären.

Was in der Debatte weitgehend außer Acht gelassen wurde, ist das Bedrohungsmodell. Eine KI-gestützte Anonymisierung ist lediglich eine Benutzeroberfläche. Sie schützt die Quelle nicht vor einem kompetenten und motivierten Angreifer, der bereits über eine Liste potenzieller Angreifer (andere Mitarbeiter derselben Abteilung im selben Krankenhaus im selben Zeitraum) und ein Protokoll mit Daten, Berufsbezeichnungen und Formulierungen verfügt. Der Fall Lucy Letby, in dem die Institution öffentlich genannt und der zeitliche Ablauf dokumentiert ist, weist beides auf. Je kleiner der Kreis der Quellen, desto geringer der Nutzen einer KI-gestützten Anonymisierung. Dies ist kein Argument gegen die Technik an sich, sondern ein Plädoyer dafür, klarzustellen, was sie anonymisiert und was nicht.

Was das Gesetz von „digital anonymisierten“ Ansprüchen verlangt

Drei Regulierungsbehörden legen in den meisten Märkten die Mindeststandards fest: die EU-Datenschutz-Grundverordnung (DSGVO), die US-amerikanischen HIPAA-Regeln für Gesundheitsdaten und die Leitlinien des britischen Information Commissioner’s Office (ICO) von 2025. Erwägungsgrund 26 der DSGVO legt den Test der „vernünftigerweise wahrscheinlichen“ Risiken fest. HIPAA bietet entweder einen Safe Harbor mit 18 festgelegten Identifikatoren oder eine Expertenmeinung, die das verbleibende Risiko der Reidentifizierung als „sehr gering“ einstuft. Das ICO UK bekräftigte im März 2025 den Test des motivierten Eindringlings.

Die bedeutendste rechtliche Änderung des vergangenen Jahres kam vom Gerichtshof der Europäischen Union. Im Fall C-413/23, EDPS gegen SRB, entschieden am 4. September 2025, führte der EuGH eine relative Theorie personenbezogener Daten ein. Derselbe Datensatz kann in den Händen einer Partei pseudonymisiert und in den Händen einer anderen anonym sein, je nachdem, was jede Partei vernünftigerweise wissen kann. Dies stellt eine wichtige Kehrtwende dar. Vor 2025 galt, vertreten unter anderem von de Montjoye, die Auffassung, dass umfangreiche Daten stets personenbezogene Daten seien, da die Re-Identifizierungsmöglichkeiten praktisch unbegrenzt seien. Das Urteil von 2025 besagt nun, dass die Beurteilung kontextabhängig ist. Beide Auffassungen können nebeneinander bestehen; die praktische Folge ist, dass nachgelagerte Parteien mehr Spielraum haben, zu argumentieren, ihre Kopie eines Datensatzes sei anonym, selbst wenn die Kopie des ursprünglichen Herausgebers nicht anonym war.

Checkliste: Sind die Daten tatsächlich digital anonymisiert?

Fünf Fragen, die Sie sich stellen sollten, bevor Sie das Label ernst nehmen:

1. Welche Identifikationsmerkmale wurden entfernt? Namen allein reichen nicht aus. Demografische Daten, Zeitstempel und seltene Attribute bleiben nach jeder Safe-Harbor-Streichung erhalten und stellen weiterhin identifizierbare Informationen dar.

2. Welche Zusatzdaten sind in angemessener Weise verfügbar? Wählerverzeichnisse, IMDB, Paparazzi-Fotos, Arbeitgeberverzeichnisse. Alles, was verknüpft werden kann, zählt.

3. Gibt es eine formale Garantie? Einen k-Anonymitätsparameter, eine t-Nähezahl oder ein Epsilon für differentielle Privatsphäre? Ohne Zahl keine Garantie.

4. Wer hat die Behauptung überprüft? Ein internes Team oder ein externer Prüfer anhand eines definierten Bedrohungsmodells für motivierte Eindringlinge.

5. Welche Möglichkeiten gibt es, wenn es zu einer Re-Identifizierung kommt? Ein digital anonymisierter Datensatz, der sich als nicht anonymisiert herausstellt, ist ein Datenschutzverstoß und keine Pressemitteilung.

Die ehrliche Interpretation von „digital anonymisiert“ im Jahr 2026 zeigt, dass es zwei voneinander unabhängige Dinge gleichzeitig umfasst. Als UX-Versprechen („Wir zeigen Ihr Gesicht nicht“) ist es in Ordnung, mitunter elegant, manchmal aber auch schlecht umgesetzt. Als statistische Aussage („Dieser Datensatz ist anonym“) ist es ohne formale Garantie fast immer unzureichend. Gehen Sie beim Aufbau Ihrer individuellen Technologieinfrastruktur davon aus, dass die Kennzeichnung nur die Hälfte der versprochenen Arbeit leistet. Verlangen Sie die mathematische Begründung, wenn die Kennzeichnung auf Daten anderer Personen angewendet wird.