Datenerhebungsmethoden: Primäre, sekundäre und 2026 Tools

Die Methoden der Datenerhebung befinden sich derzeit in einer schwierigen Lage. Die theoretischen Grundlagen – primäre versus sekundäre Datenerhebung, quantitative versus qualitative Datenerhebung – haben sich in etwa seit zwanzig Jahren nicht verändert. Die praktische Umsetzung hingegen wurde in den letzten fünf Jahren dreimal grundlegend überarbeitet. Apples intelligenter Tracking-Schutz legte einen Großteil der Webanalyse lahm. Googles Privacy Sandbox wurde im April 2025 stillschweigend eingestellt, nachdem die Topics API nur noch 13 % der Chrome-Seitenaufrufe erreichte und Drittanbieter-Cookies standardmäßig aktiviert blieben. KI-gestützte Web-Scraper durchsuchten das öffentliche Web schneller, als die Herausgeber reagieren konnten. Wer 2026 über dieses Thema schreibt, steht vor der Wahl: Entweder er vermittelt die aktuell verfügbaren Methoden oder die, die 2019 funktionierten. Dieser Artikel wählt die erste Option.

Welche Datenerhebungsmethoden gibt es eigentlich?

Eine Datenerhebungsmethode ist ein Verfahren zur Informationsgewinnung, das auf eine spezifische Forschungsfrage abzielt. Zwei Achsen strukturieren das gesamte Feld. Die erste unterscheidet zwischen Primär- und Sekundärdaten. Primärdaten werden eigenständig für die jeweilige Forschungsfrage erhoben. Sekundärdaten sind bereits vorhandene Daten, die wiederverwendet werden. Die zweite Achse unterscheidet zwischen quantitativen und qualitativen Daten. Quantitative Daten sind zählbar und statistisch: Zahlen, Häufigkeiten, Bewertungen, Zeitstempel. Qualitative Daten sind interpretativ: Wörter, Themen, Beobachtungen, Transkripte. In der Praxis werden beide Datentypen häufig bewusst kombiniert. Eine Umfrage mit einer 1- bis 5-stufigen Bewertungsskala und einem Freitextfeld für die Frage „Warum?“ ist das am häufigsten verwendete Instrument für Mixed-Methods-Forschung.

Primäre Datenerhebungsmethoden, die im Jahr 2026 verwendet werden

Sieben zentrale Datenerhebungsmethoden decken nahezu alle Aspekte der Primärforschung ab. Jede Methode zeichnet sich durch Stärken, Kosten und ein Standardverfahren für 2026 aus. Die Stichprobenverfahren (Zufallsstichprobe, geschichtete Stichprobe, Gelegenheitsstichprobe, Clusterstichprobe) bilden die Grundlage für die Wahl des Stichprobendesigns und entscheiden darüber, ob die erhobenen Daten verallgemeinerbar sind.

| Verfahren | Am besten geeignet für | Typisches Werkzeug | Anker 2026 |

|---|---|---|---|

| Umfragen / Fragebögen | Skala, Bewertungen, Segmentierung | Qualtrics, SurveyMonkey, Typeform | Online dominiert; mobile Priorität |

| Interviews | Tiefe, Motivation, Grenzfälle | Zoom, Microsoft Teams + Otter.ai | Asynchrone Werkzeuge im Aufwind |

| Fokusgruppen | Gruppendynamik, Konzeptprüfung | Recollective, Discuss.io | ca. 5.000–9.000 US-Dollar pro Sitzung (Twilio) |

| Beobachtung | Reales Verhalten im Kontext | Feldnotizen, Video, Bildschirmaufnahme | Ethnographie lebt, weniger populär |

| Experimente | Kausalschluss | A/B-Testing-Plattformen (Optimizely, GrowthBook) | Disziplin bei Ausharren ist wichtiger |

| Dokumente / Aufzeichnungen | Vorhandener Organisationstext | SharePoint, Unterstützung von Transkripten | LLM-gestützte Analyse üblich |

| Mobile Datenerfassung | Feldstudien, Arbeiten in Gebieten mit geringer Konnektivität | SurveyCTO, KoboToolbox | Offline-First bleibt unerlässlich |

Umfragen und Fragebögen leisten nach wie vor den größten Beitrag. Sie sind skalierbar und segmentierbar. Sie sind die einzige praktikable Möglichkeit, 10.000 Personen dieselbe Frage zu stellen. Der Schlüssel liegt in der Gestaltung der Fragen, nicht in der Plattform. Ein schlecht formulierter Fragebogen erzeugt nur unnötige Informationen, die kein Befragter mehr retten kann.

Interviews lassen sich in ihrer Tiefe einordnen. Strukturierte Interviews folgen einem festen Leitfaden. Halbstrukturierte Interviews verwenden ebenfalls einen Leitfaden, ermöglichen aber Nachfragen. Unstrukturierte Interviews ähneln einem geführten Gespräch. Zwanzig Stunden qualitativ hochwertiger Interviews können die Produktstrategie ebenso prägen wie eine Umfrage unter 1.000 Personen. Ganz unterschiedliche Erkenntnisse, dieselbe Entscheidung.

Fokusgruppen sind nach wie vor nützlich für gruppenorientierte Themen wie Verpackung, Markenreaktionen und Tabuthemen. Ihre Nutzung ging zurück, als Einzelinterviews durch Ferngespräche so günstig wurden. Ein erfahrener Moderator kann in einer Fokusgruppe Widersprüche aufdecken, die in einem Einzelinterview unentdeckt bleiben. Twilio gibt die typischen Kosten mit 5.000 bis 9.000 US-Dollar pro Sitzung an, weshalb sie in Marktforschungsbudgets für wichtige Entscheidungen reserviert sind.

Beobachtung kommt zum Einsatz, wenn das selbstberichtete Verhalten irreführend ist. Und das ist meistens der Fall. Die teilnehmende Beobachtung, die ethnografische Tradition, ist zwar aufwendig und zeitintensiv, aber die einzige Möglichkeit, das tatsächliche Verhalten von Menschen im jeweiligen Kontext zu erfassen. Die nicht-teilnehmende Beobachtung ist kostengünstiger, aber auch begrenzter.

Experimente gelten nach wie vor als Goldstandard für Kausalzusammenhänge. A/B-Tests für Webprodukte. Kontrollierte Studien im klinischen Umfeld. Quasi-Experimente, bei denen eine zufällige Zuteilung nicht möglich ist. Die häufigste Fehlerquelle bei Experimenten in der Wirtschaft: kleine Stichproben und das heimliche Betrachten der Ergebnisse vor Testende.

Zu den Dokumenten und Aufzeichnungen gehören interne Protokolle, Kundendienstprotokolle, Support-Tickets und Verkaufsnotizen. Moderne LLM-Workflows machen die Analyse dieser Rohdaten deutlich günstiger als noch vor fünf Jahren. Kundenservice-Teams nutzen Ticketarchive nun wieder als primäre Datenquelle, nachdem sie diese jahrelang vernachlässigt hatten.

Die mobile Datenerfassung ist in der Feldforschung, der Arbeit von Nichtregierungsorganisationen und in Umfragen in Schwellenländern mit lückenhafter Netzabdeckung unerlässlich. SurveyCTO und KoboToolbox sind etablierte Plattformen. Offline-Funktionalität ist dabei ein unverzichtbares Merkmal.

Methoden und Quellen der Sekundärdatenerhebung

Sekundärdaten bilden die andere Hälfte des Feldes. Es geht um Wiederverwendung, nicht um Ersterhebung. Die Quellen für Sekundärdaten reichen von offenen Regierungsdatensätzen über statistische Ämter und Marktforschungspanels von Kantar und Nielsen bis hin zu internen Data Lakes, Kassenarchiven, Volkszählungsdaten und dem offenen Web. Der Boombereich liegt im Web Scraping. Unternehmen wie Bright Data und Apify erwirtschaften mit legitimen Anwendungsfällen – wie Preisanalyse, Markenbeobachtung und akademischer Forschung – Milliardenumsätze. Und zunehmend auch mit KI-Trainingskorpora.

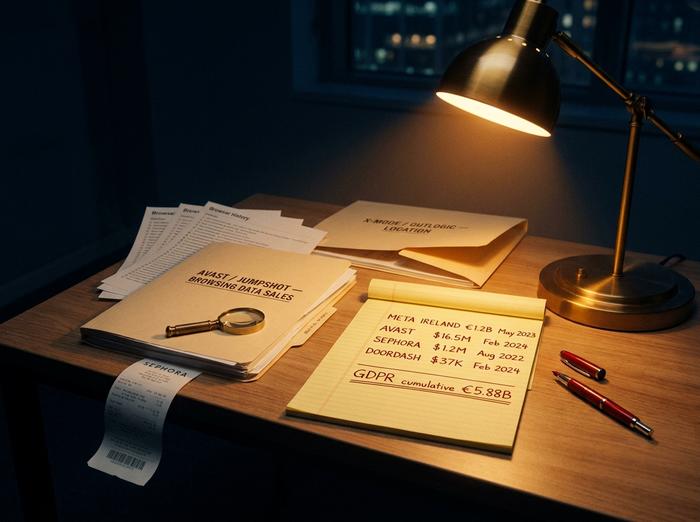

Auch die Rechtslage hat hier maßgeblich dazu beigetragen. Im Februar 2024 verhängte die FTC eine Geldstrafe von 16,5 Millionen US-Dollar gegen den Antivirenhersteller Avast, weil dieser mithilfe seiner Sicherheitstools Browserdaten gesammelt und über seine Tochtergesellschaft Jumpshot weiterverkauft hatte. Dieselbe Behörde ordnete im Januar 2024 an, dass X-Mode und Outlogic den Verkauf sensibler Standortdaten einstellen müssen – ein Novum. Die Authors Guild und die New York Times reichten 2023 Klage gegen OpenAI wegen der Verwendung von Trainingsdaten ein. Beide Verfahren sind auch 2026 noch anhängig. Früher war die Datensammlung für Dritte legal. Heute ist sie kostenpflichtig.

Quantitative vs. qualitative Datenerhebung

Der klassische Ansatz. Quantitative Methoden liefern Zahlen, mit denen sich Statistiken erstellen lassen: groß angelegte Umfragen, A/B-Tests, Telemetriedaten, Transaktionsprotokolle. Statistische Methoden analysieren die Daten anschließend hinsichtlich Trends, Korrelationen und Konfidenzintervallen. Qualitative Forschungsmethoden liefern Texte und Bedeutungen, die interpretiert werden müssen: Interviews, offene Umfrageantworten, ethnografische Feldnotizen. Die von beiden Seiten erhobenen Daten ergänzen sich. Die meisten aussagekräftigen Forschungsergebnisse kombinieren beide Ansätze. Ein Net Promoter Score (NPS) liefert eine leicht nachvollziehbare Kennzahl. Die dazugehörige Freitextfrage „Warum haben Sie diese Bewertung abgegeben?“ erklärt die Gründe für die Veränderung der Kennzahl. Betrachtet man nur eine der beiden Methoden, fehlt die halbe Wahrheit.

Zwei praktische Regeln: Wenn Sie die Antwortkategorien vorab festlegen können und nur noch eine Skala benötigen, ist die quantitative Methode die beste Wahl. Wenn Sie noch nicht genau beschreiben können, wonach Sie suchen – und das kommt häufiger vor, als man annimmt –, sollte die qualitative Methode Vorrang haben. Die quantitative Methode misst dann, was die qualitative Methode ergeben hat.

Wie Unternehmen im Jahr 2026 Daten sammeln

Die Datenerfassung im Geschäftsbetrieb sieht ganz anders aus als im Lehrbuch. Fünf Schichten decken den Großteil der Abläufe in einem modernen Unternehmen ab.

| Schicht | Funktion | Typischer Lieferant | Anker 2025-2026 |

|---|---|---|---|

| CRM | Kundendatensätze aus erster Hand | Salesforce, HubSpot, MS Dynamics 365 | Salesforce hält einen Marktanteil von ca. 21 % am globalen CRM-Markt. |

| Web-/App-Analyse | Verhaltenstelemetrie | GA4, Plausibel, Adobe Analytics | GA4 universell nach UA-Sendeplan (Juli 2023) |

| Serverseitiges Tracking | Erstanbieter-Identifikatoren nach ITP | Serverseitiger GTM, RudderStack, Segment | Standardinfrastruktur nach Apple ITP |

| CDP | Einheitliches Kundenprofil | Twilio Segment, Tealium, mParticle | Markt ~2 Milliarden US-Dollar (2024) → ~7 Milliarden US-Dollar bis 2028 |

| IoT / Telemetrie | Geräteereignisse | AWS IoT, Azure IoT Hub | ~18,8 Milliarden vernetzte Geräte (Ende 2024) |

CRM ist der Ort, an dem Kundendaten aus erster Hand gespeichert werden. Salesforce hält etwa ein Fünftel des globalen CRM-Marktes. HubSpot ist Marktführer im KMU-Segment. Microsoft Dynamics 365 ist in Unternehmen, die bereits Microsoft 365 nutzen, stark vertreten. Im CRM landen zudem häufig zuerst regulierte Daten, weshalb die Durchsetzung der DSGVO dort immer wieder spürbar wird.

Web- und App-Analysen verlagerten sich nach der Abschaltung von Universal Analytics im Juli 2023 konsequent auf Google Analytics 4. Datenschutzorientierte Teams nutzen Plausible oder Fathom. Weniger Daten bedeuten weniger Reporting-Möglichkeiten. Adobe Analytics ist weiterhin führend im Enterprise-Bereich.

Serverseitiges Tracking ist die am wenigsten beachtete Entwicklung der letzten drei Jahre. Apples ITP und der browserbasierte Fingerprint-Schutz haben clientseitige Cookies stark beeinträchtigt. Daher haben Anbieter die Tracking-Ebene hinter ihre eigene Domain verlagert. Auch Safari und Firefox können dort keine IDs mehr entfernen. Serverseitiger Google Tag Manager und RudderStack sind die Standardlösungen.

Kundendatenplattformen (CDPs) vereinen Datensätze aus CRM, Web, Apps und E-Mails in einem Kundenprofil. Statista schätzt den CDP-Markt im Jahr 2024 auf rund 2 Milliarden US-Dollar, bis 2028 soll er auf 7 Milliarden US-Dollar anwachsen. Twilio Segment, Tealium und mParticle sind die führenden Anbieter in diesem Segment.

IoT und Telemetrie werden in den meisten Artikeln vernachlässigt, was jedoch nicht sein sollte. IoT Analytics zählte Ende 2024 weltweit rund 18,8 Milliarden vernetzte IoT-Geräte. Bis 2030 wird mit einem Anstieg auf 40 Milliarden gerechnet. Jedes dieser Geräte sammelt Daten zu verschiedenen Aspekten: Energieverbrauch, Standort, Temperatur, Bewegung, Anwesenheit. Die EU-Datenschutz-Grundverordnung (DSGVO), die am 12. September 2025 in Kraft trat, gewährt Nutzern das Recht auf Datenübertragbarkeit der von diesen Geräten generierten Daten.

Zwei neuere Kategorien ergänzen die bestehende Datenstruktur. Zero-Party-Daten , bei denen Nutzer ihre Präferenzen direkt über Präferenzzentren, Quizze und Profilfelder angeben, erlebten nach dem Scheitern von Privacy Sandbox einen Aufschwung. Marken erkannten, dass die Zukunft nach Cookies noch nicht angebrochen war und dass die Befragung der Nutzer einfacher sein könnte als das Raten. KI-Trainingskorpora sind derzeit die umstrittenste Form der Datenerhebung im großen Stil. Der britische High Court urteilte am 4. November 2025 im Fall Getty Images gegen Stability AI, dass KI-Modellgewichte keine „Kopien“ im Sinne des Urheberrechtsgesetzes darstellen. Getty hatte seine primären Urheberrechtsverletzungsklagen bereits mitten im Prozess zurückgezogen. Die Erhebung von KI-Trainingsdaten ging in dieser Runde knapp als Sieger hervor.

Datenschutz, Ethik und die rechtlichen Grundlagen der Datenerhebung

Bis 2026 sind für die meisten Unternehmen, die Daten sammeln, drei rechtliche Grundlagen relevant: die DSGVO in der EU, der CCPA und CPRA in Kalifornien sowie die FTC auf US-Bundesebene, die sich stark auf ihre Verbraucherschutzfunktion stützt, da es noch kein bundesweites Datenschutzgesetz gibt. Laut dem Enforcement Tracker von CMS Law beliefen sich die kumulierten DSGVO-Bußgelder bis Ende 2024 auf über 5,88 Milliarden Euro. An der Spitze dieser Liste steht die Strafe von 1,2 Milliarden Euro gegen Meta Ireland vom Mai 2023 wegen unrechtmäßiger Datentransfers von der EU in die USA. Direkt darunter folgt eine Strafe von 405 Millionen Euro gegen Instagram wegen des Umgangs mit Kinderdaten aus dem Jahr 2022.

Die Durchsetzung der Datenschutzbestimmungen in Kalifornien ist zwar finanziell weniger aufwendig, aber deutlich schneller. Die dortige Aufsichtsbehörde konzentriert sich auf kleinere Fälle und bearbeitet diese zügiger. Sephora zahlte im August 2022 1,2 Millionen US-Dollar, weil das Unternehmen personenbezogene Daten ohne Widerspruch verkauft hatte. DoorDash folgte im Februar 2024 mit einer Zahlung von 375.000 US-Dollar wegen eines ähnlichen Verstoßes. Beide Fälle zeigen, dass der Widerspruch gegen den Verkauf personenbezogener Daten in der Praxis Gewicht hat und die Behörde sich eher auf alltägliche Datenschutzverletzungen als auf aufsehenerregende Fälle konzentriert.

Auf Bundesebene war die FTC bis 2024 stark ausgelastet. Avast zahlte im Februar 16,5 Millionen US-Dollar, weil das Unternehmen über sein Antivirenprodukt Browserdaten gesammelt und über eine Tochtergesellschaft weiterverkauft hatte. Im Januar erwirkten X-Mode und Outlogic jeweils wegweisende Verfügungen, die den Verkauf sensibler Standortdaten untersagten. Die Verfügung gegen Drizly vom Oktober 2022 ging noch weiter: Sie nannte den Geschäftsführer persönlich und signalisierte damit, dass die Verantwortung für Datenschutzverletzungen nun nicht mehr nur beim Unternehmen selbst, sondern auch bei den Führungskräften liegt.

Die Sammlung von KI-Trainingsdaten ist ein Bereich, der sich in diesem Zusammenhang noch in der Entwicklung befindet. Die New York Times verklagte OpenAI am 27. Dezember 2023. Die Authors Guild hatte bereits drei Monate zuvor, im September 2023, Klage eingereicht, und beide Verfahren waren 2026 noch anhängig. Im Fall Getty gegen Stability AI erging am 4. November 2025 ein Urteil des britischen High Court, das gegen den Rechteinhaber ausfiel. Das Gericht befand, dass die Gewichte von KI-Modellen keine „Kopien“ im Sinne des Copyright, Designs and Patents Act darstellen. Getty hatte seine Hauptklagepunkte wegen Urheberrechtsverletzung bereits während des Verfahrens zurückgezogen. Eine Sammelklage von LinkedIn, die am 21. Januar 2025 eingereicht wurde, wurde neun Tage später freiwillig zurückgezogen. Die Klage lautete auf KI-Training mit privaten InMail-Nachrichten. Der Beweis: LinkedIn konnte nachweisen, dass die Daten nicht zum Trainieren eines Modells verwendet worden waren. Bisher zeigt sich, dass die Sammlung von KI-Trainingsdaten schwer gerichtlich durchzusetzen ist, egal wie problematisch die Außenwirkung auch sein mag.

Eine Zahl, die in Branchenpräsentationen immer wieder auftaucht, bedarf hier einer Korrektur. Der Fehler ist relevant, wenn Leser ihn zitieren. TikToks Vergleich im Rahmen des COPPA-Gesetzes von 2019 gegen Musical.ly belief sich auf 5,7 Millionen US-Dollar. Nicht auf die 5,9 Milliarden US-Dollar, die in manchen Präsentationen noch immer angegeben werden. Die neuere, separat am 2. August 2024 eingereichte Klage des US-Justizministeriums und der Federal Trade Commission (FTC) fordert bis zu 51.744 US-Dollar pro Tag und Verstoß und ist auch 2026 noch anhängig.

Ich bin nicht überzeugt, dass sich die Lage im nächsten Jahr vereinfacht. Die pragmatische Kurzfassung für 2026: Jede neue Datenerfassungsmethode muss vor der Datenübermittlung, nicht erst danach, einer Datenschutzprüfung unterzogen werden. Die Durchsetzung von Dark Patterns wird im Rahmen des EU-Gesetzes über digitale Dienste verstärkt. Einwilligungsbanner werden nun anhand der Richtlinien des Europäischen Datenschutzausschusses (EDPB) geprüft. Und der Test auf motivierte Eindringlinge aus dem Update des britischen ICO vom März 2025 gilt für alle als „anonymisiert“ gekennzeichneten Daten.

Die richtige Datenerfassungsmethode auswählen

Die Wahl der Datenerhebungsmethode ist der wichtigste Schritt im gesamten Forschungsprozess. Der Entscheidungsbaum ist kurz. Beginnen Sie mit der Forschungsfrage, nicht mit dem Werkzeug.

Lautet die Frage „Wie viele?“, wählen Sie quantitative Methoden: Umfragen, Telemetrie, Transaktionsprotokolle. Lautet die Frage „Warum?“, wählen Sie qualitative Methoden: Interviews oder offene Antworten. Lautet die Frage „Was geschieht hier, das ich noch nicht verstehe?“, wählen Sie Beobachtungsmethoden. Benötigen Sie sowohl Tiefe als auch Umfang, entwickeln Sie im Vorfeld ein Instrument mit gemischten Methoden. Planen Sie doppelt so viel Analysezeit ein, wie Sie voraussichtlich benötigen.

Drei Faktoren schränken die Entscheidung ein. Erstens die ethischen und rechtlichen Grundlagen: In welchen Ländern befindet sich die Zielgruppe, und welche Regeln für Einwilligung und Datenspeicherung gelten? Zweitens das Budget: Fokusgruppen mit 5.000 bis 9.000 US-Dollar pro Sitzung sind für eine explorative Fragestellung, die sich in zweitägigen Interviews beantworten ließe, nicht zielführend. Drittens der Zeithorizont: Umfragen mit großer Stichprobe benötigen zwei bis vier Wochen für eine reibungslose Durchführung, ethnografische Studien dauern Monate, und Telemetrie liefert zwar Echtzeitdaten, setzt aber voraus, dass die Instrumente bereits vorhanden sind.

Die akademische Methodenklassifizierung hat sich also seit zwanzig Jahren nicht verändert. Die Geschäftsprozesse, die diese Methoden umsetzen, wurden in fünf Jahren dreimal grundlegend überarbeitet. Die rechtlichen Rahmenbedingungen haben sich in den letzten achtzehn Monaten zweimal geändert. Wählen Sie die Methode, die für die Fragestellung relevant ist. Gehen Sie dann davon aus, dass der Datenerfassungsplan einer Datenschutzprüfung bedarf, bevor – und nicht erst nachdem – der erste Datensatz erfasst wird.