Méthodes de collecte de données : données primaires, secondaires et outils 2026

Les méthodes de collecte de données se trouvent actuellement dans une situation paradoxale. Sur le plan théorique – données primaires versus secondaires, quantitatives versus qualitatives – elles restent globalement inchangées depuis vingt ans. En revanche, leur mise en œuvre a été entièrement repensée à trois reprises au cours des cinq dernières années. La fonctionnalité de prévention du suivi intelligent d'Apple a perturbé une part importante de l'analyse web. Le Privacy Sandbox de Google a été discrètement abandonné en avril 2025, l'API Topics n'atteignant plus que 13 % des chargements de pages Chrome, les cookies tiers restant activés par défaut. Les robots d'exploration basés sur l'IA ont sillonné le web public plus vite que les éditeurs ne pouvaient les limiter. En 2026, quiconque abordera ce sujet devra choisir entre enseigner les outils existants ou ceux qui fonctionnaient en 2019. Cet article privilégie la première option.

Quelles sont les méthodes de collecte de données réellement utilisées ?

Une méthode de collecte de données est une procédure permettant de recueillir des informations en vue de répondre à une question de recherche spécifique. Ce domaine se structure autour de deux axes principaux. Le premier oppose les données primaires aux données secondaires. Les données primaires sont recueillies directement auprès du chercheur pour répondre à sa propre question. Les données secondaires sont des données existantes que l'on réutilise. Le second axe oppose les données quantitatives aux données qualitatives. Les données quantitatives sont dénombrables et statistiques : nombres, effectifs, évaluations, horodatages. Les données qualitatives sont interprétatives : mots, thèmes, observations, transcriptions. Dans la pratique, les protocoles de recherche combinent généralement les deux approches. Un questionnaire avec une échelle de 1 à 5 et une question ouverte « pourquoi » constitue l'instrument de méthode mixte le plus courant.

Méthodes de collecte de données primaires utilisées en 2026

Sept types de collecte de données principaux couvrent la quasi-totalité des aspects primaires. Chaque méthode présente des avantages, un profil de coût et un outil par défaut pour 2026. Les méthodes d'échantillonnage (aléatoire, stratifié, de commodité, par grappes) constituent le choix de conception sous-jacent, déterminant la généralisabilité des données collectées.

| Méthode | Idéal pour | Outil typique | ancre 2026 |

|---|---|---|---|

| Enquêtes / questionnaires | Échelle, évaluations, segmentation | Qualtrics, SurveyMonkey, Typeform | Le numérique domine ; priorité au mobile |

| Entretiens | Profondeur, motivation, cas limites | Zoom, Microsoft Teams + Otter.ai | Les outils asynchrones prennent de l'ampleur |

| groupes de discussion | Dynamique de groupe, tests de concepts | Réminiscence, Discuss.io | Environ 5 000 à 9 000 $ par session (Twilio) |

| Observation | Comportement réel dans le contexte | Notes de terrain, vidéo, enregistrement d'écran | L'ethnographie a de beaux jours devant elle, mais elle est moins populaire. |

| Expériences | Inférence causale | Plateformes de tests A/B (Optimizely, GrowthBook) | La discipline des récalcitrants compte davantage |

| Documents / archives | Texte organisationnel existant | SharePoint, transcriptions de support | Analyse assistée par LLM courante |

| collecte de données mobiles | Études de terrain, travaux à faible connectivité | SurveyCTO, KoboToolbox | Le modèle hors ligne prioritaire reste essentiel |

Les enquêtes et les questionnaires restent les outils les plus efficaces. Ils permettent de réaliser des études à grande échelle et de segmenter les échantillons. Ils constituent le seul moyen pratique de poser la même question à 10 000 personnes. La clé du succès réside dans la conception des questions, et non dans le choix de la plateforme. Un questionnaire mal formulé génère des réponses parasites qu'aucun répondant ne peut corriger.

Les entretiens se situent sur l'axe de profondeur. Les entretiens structurés suivent un guide prédéfini. Les entretiens semi-structurés utilisent également un guide, mais permettent des questions complémentaires. Les entretiens non structurés s'apparentent à une conversation guidée. Vingt heures d'entretiens de grande qualité peuvent influencer la stratégie produit autant qu'un sondage auprès de 1 000 personnes. Des données très différentes, une même décision.

Les groupes de discussion restent utiles pour les sujets d'intérêt collectif tels que le packaging, les réactions aux marques et les sujets tabous. Leur utilisation a décliné avec la démocratisation des entretiens individuels à distance, devenus très abordables. Un animateur compétent peut faire émerger des contradictions qui échappent à un entretien individuel. Twilio estime le coût moyen entre 5 000 et 9 000 dollars par session, ce qui explique pourquoi les budgets d'études de marché les réservent aux décisions stratégiques.

L'observation est la méthode employée lorsque les déclarations subjectives sont mensongères, ce qui est le cas la plupart du temps. L'observation participante, méthode ethnographique traditionnelle, est coûteuse et lente, mais reste le seul moyen de saisir les comportements réels des individus en contexte. L'observation non participante est moins onéreuse, mais plus limitée.

Les expériences restent la référence absolue pour établir des liens de causalité. Tests A/B sur un produit web. Essais contrôlés en milieu clinique. Quasi-expériences où l'assignation aléatoire est impossible. L'erreur qui compromet la plupart des expériences en entreprise : un échantillon trop petit et l'analyse des résultats avant la fin du test.

Les documents et enregistrements comprennent les journaux internes, les transcriptions du service client, les tickets d'assistance et les notes de vente. Grâce aux flux de travail modernes de gestion des leads, l'analyse de ce type de texte brut est bien moins coûteuse qu'il y a cinq ans. Les équipes en charge de l'expérience client considèrent à nouveau les archives de tickets comme une source de collecte privilégiée, après les avoir longtemps négligées.

La collecte de données mobiles est essentielle pour les recherches de terrain, les activités des ONG et les enquêtes dans les marchés émergents où la connectivité est inégale. SurveyCTO et KoboToolbox sont des plateformes reconnues. Une conception privilégiant le fonctionnement hors ligne est indispensable.

Méthodes et sources de collecte de données secondaires

Les données secondaires constituent l'autre moitié du domaine. Il s'agit de réutiliser les données, et non de les collecter initialement. Les sources de données secondaires sont variées : bases de données publiques, instituts de statistiques, panels syndiqués de Kantar et Nielsen, lacs de données internes, archives de points de vente, données de recensement et web ouvert. Le secteur en plein essor est celui du web scraping. Bright Data et Apify gèrent des entreprises pesant plusieurs milliards de dollars grâce à des usages légitimes : veille tarifaire, suivi de marque, recherche universitaire et, de plus en plus, corpus d'entraînement pour l'IA.

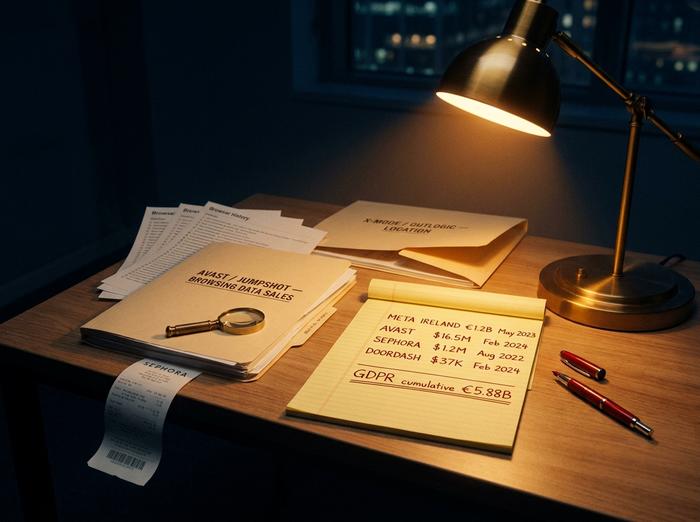

C’est également dans ce domaine que le cadre juridique a le plus évolué. En février 2024, la FTC a infligé une amende de 16,5 millions de dollars à l’éditeur d’antivirus Avast pour avoir collecté des données de navigation via ses outils de sécurité et les avoir revendues par l’intermédiaire de sa filiale Jumpshot. La même autorité de régulation a ordonné à X-Mode et Outlogic, en janvier 2024, de cesser de vendre des données de géolocalisation sensibles, une mesure inédite. La Guilde des auteurs et le New York Times ont tous deux porté plainte contre OpenAI en 2023 concernant l’utilisation de données d’entraînement. Ces deux affaires sont toujours en cours en 2026. La collecte secondaire de données était autrefois considérée comme gratuite. Elle ne l’est plus.

Collecte de données quantitatives vs qualitatives

La méthode classique. Les méthodes quantitatives produisent des données chiffrées exploitables statistiquement : enquêtes à grande échelle, tests A/B, données télémétriques, journaux de transactions. Les méthodes statistiques analysent ensuite ces données pour en dégager des tendances, des corrélations et des intervalles de confiance. Les méthodes de recherche qualitatives produisent du texte et du sens qu’il faut interpréter : entretiens, réponses ouvertes à des enquêtes, notes de terrain ethnographiques. Les données recueillies de chaque côté se complètent. La plupart des recherches pertinentes combinent les deux. Le Net Promoter Score (NPS) fournit un chiffre facile à suivre. La question ouverte « Pourquoi avez-vous attribué ce score ? » qui y est associée explique la variation de ce score. Utiliser l’un ou l’autre seul, c’est passer à côté de la moitié de l’information.

Deux règles pratiques. Si vous pouvez définir à l'avance les catégories de réponses et que vous avez seulement besoin d'une échelle, l'approche quantitative est préférable. Si vous ne pouvez pas encore décrire ce que vous recherchez — et c'est plus fréquent qu'on ne le pense —, l'approche qualitative prime. Ensuite, l'analyse quantitative mesure les résultats de l'analyse qualitative.

Comment les entreprises collectent des données en 2026

L'architecture métier, c'est là que la collecte de données prend tout son sens, loin des schémas théoriques. Cinq couches couvrent la majeure partie du fonctionnement d'une entreprise moderne.

| Couche | Fonction | fournisseur typique | ancre 2025-2026 |

|---|---|---|---|

| CRM | Données clients de première partie | Salesforce, HubSpot, MS Dynamics 365 | Salesforce représente environ 21 % du marché mondial du CRM |

| Analyse Web/d'applications | Télémétrie comportementale | GA4, Plausible, Adobe Analytics | GA4 universel après le retrait d'UA (juillet 2023) |

| Suivi côté serveur | Identifiants de première partie après ITP | GTM côté serveur, RudderStack, Segment | Infrastructure par défaut après Apple ITP |

| CDP | Profil client unifié | Segment Twilio, Tealium, mParticle | Marché ~2 milliards de dollars (2024) → ~7 milliards de dollars d’ici 2028 |

| IoT / télémétrie | Événements liés à l'appareil | AWS IoT, Azure IoT Hub | ~18,8 milliards d'appareils connectés (fin 2024) |

Le CRM centralise les données clients de première partie. Salesforce détient environ un cinquième du marché mondial du CRM. HubSpot domine le segment des PME. Microsoft Dynamics 365 est fortement implanté au sein des grandes entreprises qui utilisent déjà Microsoft 365. Le CRM est également le premier endroit où les données réglementées sont généralement enregistrées, ce qui explique la fréquence des contrôles liés au RGPD dans ce domaine.

Après l'arrêt d'Universal Analytics en juillet 2023 , l'analyse web et mobile s'est massivement tournée vers Google Analytics 4. Les équipes soucieuses de la protection de la vie privée privilégient Plausible ou Fathom. Moins de données signifie moins de possibilités de reporting. Adobe Analytics reste la référence pour les grandes entreprises.

Le suivi côté serveur est l'évolution la moins commentée de ces trois dernières années. L'ITP d'Apple et la protection par empreinte digitale au niveau du navigateur ont fortement perturbé le fonctionnement des cookies côté client. Les fournisseurs ont donc déplacé la couche de suivi derrière leur propre domaine. Safari et Firefox ne peuvent pas non plus supprimer les identifiants à cet endroit. Google Tag Manager et RudderStack constituent la solution par défaut côté serveur.

Les plateformes de données clients (CDP) centralisent les données issues des CRM, du web, des applications et des e-mails dans un profil client unique. Statista estime le marché des CDP à environ 2 milliards de dollars en 2024, avec une prévision de 7 milliards de dollars d'ici 2028. Twilio Segment, Tealium et mParticle sont les acteurs majeurs de ce secteur.

L'Internet des objets (IoT) et la télémétrie constituent un aspect souvent négligé, à tort. Fin 2024, IoT Analytics recensait environ 18,8 milliards d'objets connectés dans le monde. Ce nombre devrait atteindre 40 milliards d'ici 2030. Chacun d'eux collecte des données : consommation d'énergie, géolocalisation, température, mouvements, occupation. Le règlement européen sur la protection des données, entré en vigueur le 12 septembre 2025, confère aux utilisateurs un droit à la portabilité des données générées par ces appareils.

Deux nouvelles catégories s'ajoutent à la pile existante. Les données de tiers , où les utilisateurs expriment directement leurs préférences via des centres de préférences, des questionnaires et des champs de profil, ont connu un essor considérable après l'échec de Privacy Sandbox. Les marques ont compris que l'ère post-cookies n'était pas encore arrivée et qu'il était parfois plus simple de demander l'avis des utilisateurs que de deviner. Les corpus d'entraînement de l'IA constituent actuellement la forme de collecte de données à grande échelle la plus controversée. Le 4 novembre 2025, dans l'affaire Getty Images contre Stability AI, la Haute Cour britannique a statué que les pondérations des modèles d'IA ne sont pas des « copies » au sens de la loi sur le droit d'auteur, les dessins et modèles et les brevets. Getty avait déjà abandonné ses principales accusations de contrefaçon en cours de procès. La collecte de données pour l'entraînement de l'IA a remporté cette manche, de justesse.

Confidentialité, éthique et cadre légal pour la collecte

D'ici 2026, trois cadres juridiques seront déterminants pour la plupart des entreprises de collecte de données : le RGPD dans l'UE, le CCPA et le CPRA en Californie, et la FTC au niveau fédéral américain, qui s'appuie fortement sur son rôle de protection des consommateurs en l'absence de loi fédérale sur la protection de la vie privée. Selon le tableau de bord de CMS Law, le montant cumulé des amendes liées au RGPD a dépassé 5,88 milliards d'euros fin 2024. L'amende de 1,2 milliard d'euros infligée à Meta Ireland en mai 2023 pour des transferts illégaux de données entre l'UE et les États-Unis figure en tête de ce classement. Juste derrière : une amende de 405 millions d'euros infligée à Instagram en 2022 pour des données d'enfants.

En Californie, les sanctions financières sont moins importantes, mais le rythme de traitement est plus rapide. L'autorité de régulation privilégie les cas mineurs et les résout plus vite. Sephora a ainsi versé 1,2 million de dollars en août 2022 pour avoir vendu des données personnelles sans possibilité de retrait. DoorDash a suivi en février 2024 avec un accord à l'amiable de 375 000 dollars pour une infraction similaire. Ces deux cas démontrent que le principe « ne vendez pas mes données personnelles » est appliqué avec rigueur et que l'agence se concentre sur les violations de données courantes plutôt que sur les affaires médiatisées.

Du côté fédéral, la FTC est restée très active tout au long de l'année 2024. En février, Avast a versé 16,5 millions de dollars pour avoir collecté des données de navigation via son antivirus et les avoir revendues par l'intermédiaire d'une filiale. En janvier, X-Mode et Outlogic ont toutes deux obtenu des injonctions inédites leur interdisant la vente de données de géolocalisation sensibles. L'injonction visant Drizly, datant d'octobre 2022, est allée plus loin : elle nommait personnellement le PDG, signifiant ainsi que la responsabilité de la gestion des violations de données incombe désormais aux dirigeants, et non plus seulement à l'entreprise.

La collecte de données d'entraînement des IA est un aspect de ce dossier qui reste encore à écrire. Le New York Times a porté plainte contre OpenAI le 27 décembre 2023. La Guilde des auteurs avait déposé une plainte trois mois plus tôt, en septembre 2023, et les deux affaires étaient toujours en cours en 2026. L'affaire Getty contre Stability AI a ensuite abouti à un arrêt de la Haute Cour britannique le 4 novembre 2025, défavorable au titulaire des droits. La cour a statué que les poids des modèles d'IA ne constituent pas des « copies » au sens de la loi sur le droit d'auteur, les dessins et modèles et les brevets. Getty avait déjà abandonné ses principales accusations de contrefaçon en cours de procès. Une action collective intentée par LinkedIn le 21 janvier 2025 a été retirée volontairement neuf jours plus tard. L'accusation : l'entraînement des IA sur des messages InMail privés. La preuve : LinkedIn a démontré que les données n'avaient été utilisées pour entraîner aucun modèle. Le constat est clair : la collecte de données d'entraînement des IA est difficile à contester en justice, aussi négative que puisse paraître l'affaire.

Un chiffre qui revient fréquemment dans les documents du secteur mérite d'être rectifié. Cette erreur est lourde de conséquences lorsque les lecteurs la citent. L'accord conclu en 2019 entre TikTok et Musical.ly, au titre de la loi COPPA, s'élevait à 5,7 millions de dollars, et non à 5,9 milliards comme l'indiquent encore certains documents. La plainte plus récente déposée par le Département de la Justice et la Commission fédérale du commerce (FTC) le 2 août 2024 réclame jusqu'à 51 744 dollars par jour et par infraction ; elle est toujours en cours en 2026.

Je ne suis pas convaincu que la situation se simplifiera d'ici un an. En résumé, pour 2026 : tout nouveau processus de collecte de données devra faire l'objet d'un examen de protection de la vie privée avant leur intégration, et non après. La lutte contre les pratiques trompeuses se renforce avec le règlement européen sur les services numériques. Les bannières de consentement sont désormais auditées conformément aux lignes directrices du CEPD. Enfin, le test de l'intrus motivé, issu de la mise à jour de mars 2025 de l'ICO britannique, s'applique à tout élément étiqueté « anonymisé ».

Choisir la bonne méthode de collecte de données

Le choix de la méthode de collecte de données est l'étape la plus importante de tout le processus de recherche. L'arbre de décision est simple : commencez par la question de recherche, et non par l'outil.

Si la question est « combien », privilégiez une approche quantitative : enquêtes, télémétrie, journaux de transactions. Si la question est « pourquoi », privilégiez une approche qualitative : entretiens ou questions ouvertes. Si la question est « que se passe-t-il ici que je ne comprends pas encore ? », privilégiez l’observation. Si vous avez besoin d’une analyse à la fois approfondie et à grande échelle, concevez dès le départ un instrument de méthodes mixtes. Prévoyez un temps d’analyse deux fois supérieur à celui que vous estimez nécessaire.

Trois contraintes encadrent ce choix. Premièrement, les aspects éthiques et juridiques : à quelles juridictions votre public cible se situe-t-il et quelles règles de consentement et de conservation des données s’appliquent ? Deuxièmement, le budget : organiser des groupes de discussion à 5 000 $ à 9 000 $ la session n’est pas la solution idéale pour une question exploratoire à laquelle deux jours d’entretiens permettraient de répondre. Troisièmement, l’horizon temporel : les enquêtes à grande échelle nécessitent deux à quatre semaines pour une analyse complète, l’ethnographie prend des mois, et la télémétrie, bien qu’en temps réel, suppose que l’instrumentation soit déjà en place.

Ainsi, la taxonomie académique des méthodes n'a pas évolué depuis vingt ans. L'infrastructure informatique qui sous-tend ces méthodes a été entièrement repensée trois fois en cinq ans. Le cadre juridique a lui aussi évolué à deux reprises au cours des dix-huit derniers mois. Choisissez la méthode adaptée à la question. Partez ensuite du principe que le plan de collecte de données nécessite une analyse de la protection des données avant, et non après, l'enregistrement du premier fichier.