Metodi di raccolta dati: primari, secondari e strumenti 2026

I metodi di raccolta dati si trovano attualmente in una situazione alquanto singolare. La teoria alla base del settore – dati primari contro dati secondari, quantitativi contro qualitativi – appare pressoché identica a quella di vent'anni fa. L'implementazione, invece, è stata completamente ripensata negli ultimi cinque anni. La funzione Intelligent Tracking Prevention di Apple ha compromesso una parte significativa dell'analisi web. La Privacy Sandbox di Google è stata silenziosamente dismessa nell'aprile del 2025, quando l'API Topics ha raggiunto solo il 13% dei caricamenti di pagine Chrome, con i cookie di terze parti che rimanevano attivi per impostazione predefinita. Gli scraper basati sull'intelligenza artificiale hanno divorato il web pubblico più velocemente di quanto gli editori potessero limitarne la diffusione. Chiunque scriva di questo argomento nel 2026 si troverà di fronte alla scelta tra insegnare gli strumenti esistenti o quelli che funzionavano nel 2019. Questo articolo opta per la prima opzione.

Quali sono effettivamente i metodi di raccolta dati?

Un metodo di raccolta dati è una procedura per raccogliere informazioni finalizzate a una specifica domanda di ricerca. L'intero campo si articola in due assi principali. Il primo è la distinzione tra dati primari e secondari. I dati primari vengono raccolti direttamente per rispondere alla propria domanda di ricerca. I dati secondari sono dati già esistenti che vengono riutilizzati. Il secondo asse è la distinzione tra dati quantitativi e qualitativi. I dati quantitativi sono quantificabili e statistici: numeri, conteggi, valutazioni, timestamp. I dati qualitativi sono interpretativi: parole, temi, osservazioni, trascrizioni. Nella pratica, i disegni di ricerca combinano solitamente i due approcci. Un questionario con una valutazione da 1 a 5 e una domanda a risposta aperta ("perché") è lo strumento di ricerca a metodi misti più comune.

Metodi di raccolta dati primari utilizzati nel 2026

Sette tipologie principali di raccolta dati coprono quasi tutto il lato primario. Ogni metodo ha un punto di forza, un profilo di costo e uno strumento predefinito per il 2026. I metodi di campionamento (casuale, stratificato, di convenienza, a grappolo) si collocano al di sotto di questi, rappresentando la scelta progettuale che determina se i dati raccolti sono generalizzabili.

| Metodo | Ideale per | Strumento tipico | Ancoraggio 2026 |

|---|---|---|---|

| Sondaggi/questionari | Scala, valutazioni, segmentazione | Qualtrics, SurveyMonkey, Typeform | Il mondo online domina; priorità ai dispositivi mobili |

| interviste | Profondità, motivazione, casi limite | Zoom, Microsoft Teams + Otter.ai | Strumenti asincroni in ascesa |

| Gruppi di discussione | Dinamiche di gruppo, verifica dei concetti | Recollective, Discuss.io | Circa 5.000-9.000 dollari a sessione (Twilio) |

| Osservazione | Comportamento reale nel contesto | Appunti sul campo, video, registrazione dello schermo | L'etnografia continua a vivere, ma è meno popolare |

| Esperimenti | Inferenza causale | Piattaforme per test A/B (Optimizely, GrowthBook) | La disciplina dei disobbedienti è più importante |

| Documenti/registri | Testo organizzativo esistente | SharePoint, supporto per le trascrizioni | Analisi assistita da LLM comune |

| Raccolta dati mobili | Studi sul campo, lavoro a bassa connettività | SurveyCTO, KoboToolbox | La modalità offline-first rimane essenziale |

Sondaggi e questionari rimangono gli strumenti più efficaci. Sono scalabili, segmentabili e rappresentano l'unico modo pratico per porre la stessa domanda a 10.000 persone. Il segreto sta nella formulazione della domanda, non nella piattaforma. Un questionario mal formulato genera un rumore di fondo che nessun intervistato può correggere.

Le interviste si collocano sull'asse della profondità. Quelle strutturate utilizzano un copione fisso. Quelle semi-strutturate utilizzano un copione ma consentono approfondimenti. Quelle non strutturate assomigliano a una conversazione guidata. Venti ore di interviste di alta qualità possono plasmare la strategia di prodotto tanto quanto un sondaggio condotto su 1.000 persone. Prove molto diverse, stessa decisione.

I focus group rimangono utili per argomenti che richiedono la partecipazione del pubblico, come il packaging, le reazioni ai marchi e i temi tabù. Il loro utilizzo è diminuito quando le interviste individuali, rese possibili grazie al lavoro a distanza, sono diventate molto più economiche. Un moderatore esperto che conduce un focus group può far emergere contraddizioni che un'intervista individuale non riesce a cogliere. Twilio stima un costo tipico tra i 5.000 e i 9.000 dollari a sessione, motivo per cui i budget per le ricerche di mercato li riservano alle decisioni di maggiore importanza.

L'osservazione è ciò che si fa quando il comportamento auto-riferito è falso. Il che accade nella maggior parte dei casi. L'osservazione partecipante, la tradizione etnografica, è costosa e lenta, ma è l'unico modo per cogliere ciò che le persone fanno realmente nel loro contesto. L'osservazione non partecipante è più economica e più limitata.

Gli esperimenti rimangono il metodo di riferimento per le affermazioni causali. Test A/B su un prodotto web. Studi controllati in ambito clinico. Quasi-esperimenti in cui l'assegnazione casuale è impossibile. La disciplina che compromette la maggior parte degli esperimenti in ambito aziendale: la dimensione ridotta del campione e l'analisi dei dati prima della fine del test.

I documenti e le registrazioni includono registri interni, trascrizioni del servizio clienti, ticket di supporto e note di vendita. I moderni flussi di lavoro LLM rendono l'analisi di questo tipo di testo grezzo molto più economica rispetto a cinque anni fa. I team dedicati all'esperienza del cliente ora considerano nuovamente gli archivi dei ticket come una fonte primaria di raccolta dati, dopo anni in cui li avevano ignorati.

La raccolta dati tramite dispositivi mobili è fondamentale nella ricerca sul campo, nel lavoro delle ONG e nei sondaggi nei mercati emergenti, dove la connettività è discontinua. SurveyCTO e KoboToolbox sono le piattaforme consolidate. La progettazione "offline-first" è una caratteristica imprescindibile.

Metodi e fonti di raccolta dei dati secondari

I dati secondari rappresentano l'altra metà del campo. Si tratta di riutilizzo, non di raccolta primaria. Le fonti di dati secondari spaziano dai dataset governativi aperti, agli enti statistici, ai panel di Kantar e Nielsen, ai data lake interni, agli archivi dei punti vendita, ai dati censuari e al web aperto. Il settore in maggiore espansione è quello del web scraping. Bright Data e Apify gestiscono attività multimiliardarie basate su utilizzi legittimi: analisi dei prezzi, monitoraggio dei marchi, ricerca accademica. E, sempre più spesso, corpus per l'addestramento dell'intelligenza artificiale.

Anche in questo ambito la situazione legale ha subito notevoli cambiamenti. Nel febbraio 2024, la FTC ha multato il fornitore di antivirus Avast per 16,5 milioni di dollari per aver raccolto dati di navigazione tramite i suoi strumenti di sicurezza e averli rivenduti attraverso una sussidiaria chiamata Jumpshot. Lo stesso ente regolatore ha ordinato a X-Mode e Outlogic nel gennaio 2024 di interrompere la vendita di dati di geolocalizzazione sensibili, un'azione senza precedenti. L'Authors Guild e il New York Times hanno entrambi intentato causa contro OpenAI nel 2023 per l'utilizzo di dati di addestramento. Entrambi i casi sono ancora in corso nel 2026. La raccolta secondaria di dati un tempo sembrava gratuita. Ora non lo è più.

Raccolta di dati quantitativi vs. qualitativi

Il taglio classico. I metodi quantitativi producono numeri su cui è possibile eseguire analisi statistiche: sondaggi su larga scala, test A/B, eventi di telemetria, registri delle transazioni. I metodi statistici analizzano quindi i dati per individuare tendenze, correlazioni e intervalli di confidenza. I metodi di ricerca qualitativa producono testo e significato che devono essere interpretati: interviste, risposte a domande aperte nei sondaggi, note etnografiche sul campo. I dati raccolti da ciascun approccio si completano a vicenda. La ricerca più utile combina i due metodi. Il Net Promoter Score fornisce un numero facile da monitorare. La domanda a testo libero "perché hai dato quel punteggio" allegata fornisce la ragione della variazione del punteggio. Utilizzare uno dei due metodi singolarmente significa perdere metà della storia.

Due regole pratiche. Se puoi predefinire le categorie di risposta e ti serve solo una scala di misurazione, l'approccio quantitativo è preferibile. Se non riesci ancora a descrivere cosa stai cercando – e questo è più comune di quanto si pensi – l'approccio qualitativo viene prima. Successivamente, il lavoro quantitativo misurerà ciò che è emerso dal lavoro qualitativo.

Come le aziende raccolgono i dati nel 2026

La struttura aziendale, dove la raccolta dati non ha nulla a che vedere con quella descritta nei manuali, è composta da cinque livelli che coprono la maggior parte delle attività di un'azienda moderna.

| Strato | Funzione | fornitore tipico | Conduttore 2025-2026 |

|---|---|---|---|

| CRM | Dati dei clienti di prima parte | Salesforce, HubSpot, MS Dynamics 365 | Salesforce detiene circa il 21% del mercato globale dei CRM. |

| Analisi web/app | Telemetria comportamentale | GA4, Plausibile, Adobe Analytics | GA4 universale dopo la scadenza di UA (luglio 2023) |

| Tracciamento lato server | Identificatori di prima parte dopo ITP | Server-side GTM, RudderStack, Segment | Infrastruttura predefinita dopo Apple ITP |

| CDP | Profilo cliente unificato | Segmento Twilio, Tealium, mParticle | Mercato ~$2 miliardi (2024) → ~$7 miliardi entro il 2028 |

| IoT / telemetria | Eventi del dispositivo | AWS IoT, Azure IoT Hub | Circa 18,8 miliardi di dispositivi connessi (fine 2024) |

Il CRM è il sistema in cui risiedono i dati di prima parte dei clienti. Salesforce detiene circa un quinto del mercato globale del CRM. HubSpot è leader nel segmento delle PMI. Microsoft Dynamics 365 è forte all'interno delle aziende che già acquistano Microsoft 365. Il CRM è anche il sistema in cui i dati regolamentati tendono ad arrivare per primi, motivo per cui le questioni relative all'applicazione del GDPR continuano a emergere proprio in questo ambito.

Dopo la disattivazione di Universal Analytics nel luglio 2023 , l'analisi web e delle app si è spostata decisamente su Google Analytics 4. I team attenti alla privacy utilizzano Plausible o Fathom. Meno dati significano meno capacità di reporting. Adobe Analytics detiene ancora la leadership nel mercato enterprise.

Il tracciamento lato server è il cambiamento meno discusso degli ultimi tre anni. ITP di Apple e la protezione tramite fingerprint a livello di browser hanno compromesso seriamente i cookie lato client. Per questo motivo, i fornitori hanno spostato il livello di tracciamento dietro il proprio dominio. Safari e Firefox non sono in grado di rimuovere gli ID nemmeno lì. Google Tag Manager e RudderStack lato server sono diventati l'infrastruttura predefinita.

Le piattaforme di dati dei clienti (CDP) unificano i dati provenienti da CRM, web, app ed email in un unico profilo per cliente. Statista stima che il mercato delle CDP raggiungerà circa 2 miliardi di dollari nel 2024, con una previsione di 7 miliardi di dollari entro il 2028. Twilio Segment, Tealium e mParticle sono i principali attori di questo segmento.

L'IoT e la telemetria sono gli aspetti che la maggior parte degli articoli trascura, e non dovrebbero. Alla fine del 2024, IoT Analytics ha contato circa 18,8 miliardi di dispositivi IoT connessi a livello globale. Si prevede che questo numero raggiungerà i 40 miliardi entro il 2030. Ognuno di essi raccoglie dati su qualcosa: consumo energetico, posizione, temperatura, movimento, presenza. Il Regolamento generale sulla protezione dei dati (GDPR) dell'UE, in vigore dal 12 settembre 2025, conferisce agli utenti il diritto alla portabilità dei dati generati da tali dispositivi.

Due nuove categorie si affiancano a quelle già esistenti. I dati di terze parti , in cui gli utenti esprimono volontariamente le proprie preferenze tramite centri di preferenze, quiz e campi del profilo, hanno registrato un'impennata dopo il fallimento di Privacy Sandbox. I brand si sono resi conto che il futuro senza cookie non era ancora arrivato e che chiedere direttamente alle persone poteva essere più semplice che fare supposizioni. I corpus di addestramento per l'IA rappresentano attualmente la forma di raccolta dati su larga scala più controversa. Il 4 novembre 2025, l'Alta Corte del Regno Unito ha stabilito, nel caso Getty Images contro Stability AI, che i pesi dei modelli di IA non costituiscono "copie" ai sensi del Copyright, Designs and Patents Act. Getty aveva già ritirato le sue principali accuse di violazione del copyright a metà del processo. La raccolta di dati per l'addestramento dell'IA ha vinto quella battaglia, seppur di stretta misura.

Privacy, etica e fondamenti giuridici per la raccolta dei dati

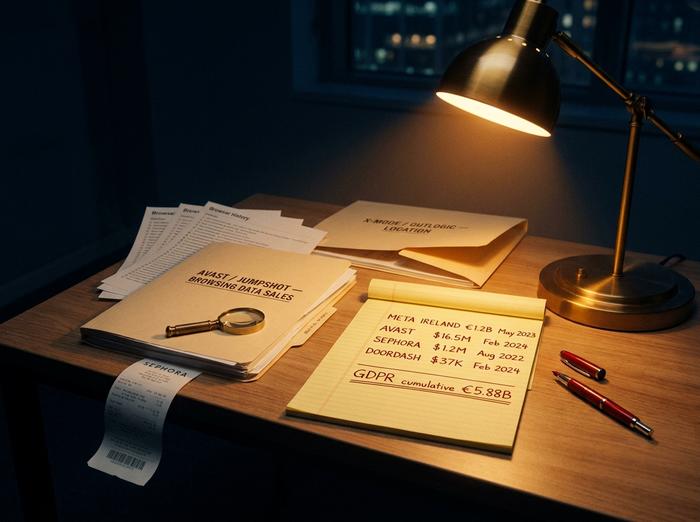

Entro il 2026, per la maggior parte delle aziende che si occupano di raccolta dati, tre normative di riferimento sono fondamentali: il GDPR nell'UE, il CCPA e il CPRA in California e la FTC a livello federale negli Stati Uniti, che si concentra fortemente sul suo ruolo di tutela dei consumatori poiché non esiste ancora una legge federale sulla privacy. Secondo il tracker di CMS Law, le multe cumulative per violazione del GDPR hanno superato i 5,88 miliardi di euro entro la fine del 2024. La sanzione di 1,2 miliardi di euro inflitta a Meta Ireland nel maggio 2023 per trasferimenti illeciti di dati dall'UE agli Stati Uniti si colloca al primo posto. Subito dopo, la multa di 405 milioni di euro inflitta a Instagram nel 2022 per i dati dei minori.

In California, l'applicazione delle norme si traduce in sanzioni meno onerose in termini economici, ma in tempi più rapidi. L'autorità di regolamentazione locale seleziona i casi di minore entità e li risolve più velocemente. Sephora ha pagato 1,2 milioni di dollari nell'agosto 2022 per aver venduto dati personali senza offrire un'opzione di dissenso. DoorDash ha seguito l'esempio nel febbraio 2024, raggiungendo un accordo extragiudiziale di 375.000 dollari per la stessa violazione. Entrambi i casi dimostrano che il principio "non vendere i miei dati personali" ha un peso concreto nella pratica e che l'agenzia si concentra sulle violazioni più comuni piuttosto che su quelle più eclatanti.

Sul fronte federale, la FTC è rimasta impegnata per tutto il 2024. A febbraio, Avast ha pagato 16,5 milioni di dollari per aver raccolto dati di navigazione tramite il suo antivirus e averli rivenduti attraverso una sua controllata. A gennaio, X-Mode e Outlogic hanno entrambe ricevuto provvedimenti senza precedenti che vietano la vendita di dati di geolocalizzazione sensibili. Il provvedimento relativo a Drizly, emesso nell'ottobre 2022, è andato oltre: ha nominato personalmente l'amministratore delegato, segnalando che la responsabilità della gestione delle violazioni dei dati ora ricade sui vertici aziendali, e non solo sull'azienda stessa.

La raccolta di dati per l'addestramento dell'IA è un aspetto ancora in fase di definizione. Il New York Times ha citato in giudizio OpenAI il 27 dicembre 2023. L'Authors Guild aveva presentato un ricorso tre mesi prima, a settembre 2023, ed entrambi i casi erano ancora attivi nel 2026. Il caso Getty contro Stability AI ha poi portato a una sentenza dell'Alta Corte del Regno Unito il 4 novembre 2025, che si è pronunciata contro il detentore dei diritti. La corte ha stabilito che i pesi dei modelli di IA non sono "copie" ai sensi del Copyright, Designs and Patents Act. Getty aveva già ritirato le sue principali accuse di violazione del copyright a metà del processo. Una class action intentata da LinkedIn il 21 gennaio 2025 è stata archiviata volontariamente nove giorni dopo. L'accusa: addestramento dell'IA su messaggi InMail privati. La prova: LinkedIn ha dimostrato che i dati non erano stati utilizzati per addestrare alcun modello. Il quadro generale finora è che la raccolta di dati per l'addestramento dell'IA è difficile da contestare in tribunale, a prescindere da quanto negativa possa apparire la situazione.

Una cifra che continua a comparire nelle presentazioni del settore merita una correzione. L'errore è rilevante quando i lettori lo citano. L'accordo raggiunto da TikTok nel 2019 ai sensi del COPPA, contro l'entità Musical.ly, ammontava a 5,7 milioni di dollari. Non ai 5,9 miliardi di dollari che alcune presentazioni continuano a riportare. La nuova denuncia presentata separatamente dal Dipartimento di Giustizia e dalla FTC il 2 agosto 2024 richiede fino a 51.744 dollari al giorno per violazione, ed è ancora pendente nel 2026.

Non sono convinto che la situazione si semplificherà nel corso del prossimo anno. In sintesi, per il 2026 è chiaro: qualsiasi nuova pipeline di raccolta dati necessita di una revisione della privacy prima che i dati vengano acquisiti, non dopo. L'applicazione delle norme contro le pratiche scorrette (dark pattern) è in aumento ai sensi del Digital Services Act (DSA) dell'UE. I banner di consenso vengono ora verificati in base alle linee guida dell'EDPB (Comitato europeo per la protezione dei dati). Inoltre, il test dell'intruso motivato, introdotto dall'ICO (Information Commissioner's Office) del Regno Unito nel marzo 2025, si applica a qualsiasi dato etichettato come "anonimizzato".

Scegliere il metodo di raccolta dati più adatto

La scelta del metodo di raccolta dati è il passo più importante dell'intero processo di ricerca. L'albero decisionale è breve. Iniziate dalla domanda di ricerca, non dallo strumento.

Se la domanda è "quanti", optate per un approccio quantitativo: sondaggi, telemetria, registri delle transazioni. Se la domanda è "perché", optate per un approccio qualitativo: interviste o risposte aperte. Se la domanda è "cosa sta succedendo qui che ancora non capisco?", optate per un approccio osservazionale. Se avete bisogno sia di profondità che di ampiezza, progettate fin da subito uno strumento di analisi a metodi misti. Calcolate il doppio del tempo di analisi che pensate di dover impiegare.

Tre vincoli condizionano la scelta. L'aspetto etico e legale: in quali giurisdizioni si trova il tuo pubblico e quali norme di consenso e conservazione si applicano? Il budget: i focus group, con costi che variano dai 5.000 ai 9.000 dollari a sessione, non sono adatti per una domanda esplorativa a cui si potrebbe rispondere con due giorni di interviste. L'orizzonte temporale: i sondaggi su larga scala richiedono dalle due alle quattro settimane per essere completati senza intoppi, l'etnografia richiede mesi, la telemetria è in tempo reale ma presuppone che la strumentazione sia già presente.

Quindi: la tassonomia accademica dei metodi non è cambiata in vent'anni. L'infrastruttura aziendale che supporta questi metodi è stata riscritta tre volte in cinque. Il quadro normativo si è modificato due volte negli ultimi diciotto mesi. Scegliete il metodo più adatto alla domanda. Poi, presupponete che il piano di raccolta dati necessiti di una revisione della privacy prima, e non dopo, che venga inserito il primo record.