Metody zbierania danych: podstawowe, wtórne i narzędzia 2026

Metody gromadzenia danych znajdują się obecnie w dziwnym położeniu. Podręcznikowa strona tej dziedziny – podstawowe kontra wtórne, ilościowe kontra jakościowe – wygląda mniej więcej tak samo, jak dwadzieścia lat temu. Strona implementacyjna była przebudowywana trzy razy w ciągu ostatnich pięciu lat. Inteligentna Zapobieganie Śledzeniu firmy Apple uszkodziła znaczną część analityki internetowej. Piaskownica Prywatności Google została po cichu wycofana w kwietniu 2025 roku, gdy API Tematów osiągnęło zaledwie 13% wczytań stron Chrome, a pliki cookie innych firm pozostały domyślnie włączone. Scrapery AI przeszukiwały publiczną sieć szybciej, niż wydawcy byli w stanie je ograniczyć. Wybór dla każdego, kto pisze o tym w 2026 roku, to albo nauczać istniejącego zestawu narzędzi, albo tego, który działał w 2019 roku. Niniejszy artykuł skupia się na pierwszej opcji.

Jakie są właściwie metody zbierania danych?

Metoda gromadzenia danych to procedura gromadzenia informacji ukierunkowanych na konkretne pytanie badawcze. Całe pole badawcze podzielono na dwie osie. Pierwsza to podział na dane pierwotne i wtórne. Dane pierwotne są zbierane z pierwszej ręki na potrzeby własnego pytania. Dane wtórne to dane, które już istnieją i można je ponownie wykorzystać. Druga oś to podział na dane ilościowe i jakościowe. Dane ilościowe są policzalne i statystyczne: liczby, zliczenia, oceny, znaczniki czasu. Dane jakościowe są interpretowalne: słowa, tematy, obserwacje, transkrypcje. W rzeczywistych projektach badawczych zazwyczaj celowo łączy się te dwa elementy. Ankieta z oceną 1-5 i swobodnym tekstem „dlaczego” jest najpopularniejszym narzędziem mieszanym w praktyce.

Podstawowe metody gromadzenia danych stosowane w 2026 r.

Siedem podstawowych typów zbierania danych obejmuje niemal wszystkie aspekty pierwotne. Każda metoda ma swoją moc, profil kosztów i domyślne narzędzie na rok 2026. Metody próbkowania (losowe, warstwowe, dogodne, klastrowe) są pod nimi, jako wybór projektowy decydujący o tym, czy zebrane dane się uogólniają.

| Metoda | Najlepszy dla | Typowe narzędzie | Kotwica 2026 |

|---|---|---|---|

| Ankiety / kwestionariusze | Skala, oceny, segmentacja | Qualtrics, SurveyMonkey, Typeform | Dominuje internet, mobilność przede wszystkim |

| Wywiady | Głębia, motywacja, przypadki skrajne | Zoom, Microsoft Teams + Otter.ai | Coraz popularniejsze narzędzia asynchroniczne |

| Grupy fokusowe | Dynamika grupy, testowanie koncepcji | Wspomnienia, Discuss.io | ~5000–9000 dolarów za sesję (Twilio) |

| Obserwacja | Rzeczywiste zachowanie w kontekście | Notatki terenowe, wideo, nagranie ekranu | Etnografia żyje, jest mniej popularna |

| Eksperymenty | Wnioskowanie przyczynowe | Platformy do testów A/B (Optimizely, GrowthBook) | Dyscyplina wstrzemięźliwości ma większe znaczenie |

| Dokumenty / zapisy | Istniejący tekst organizacyjny | Sharepoint, obsługa transkrypcji | Powszechna analiza wspomagana przez LLM |

| Mobilne zbieranie danych | Badania terenowe, prace o niskiej łączności | SurveyCTO, KoboToolbox | Tryb offline w pierwszej kolejności pozostaje niezbędny |

Ankiety i kwestionariusze wciąż odgrywają największą rolę. Skalują się. Segmentują. To jedyny praktyczny sposób, aby zadać to samo pytanie 10 000 osób. Sztuką jest konstrukcja pytań, a nie platforma. Źle sformułowany kwestionariusz generuje szum, którego żaden respondent nie jest w stanie uratować.

Wywiady opierają się na osi głębokości. Wywiady ustrukturyzowane korzystają ze stałego scenariusza. Wywiady częściowo ustrukturyzowane korzystają ze scenariusza, ale pozwalają na kontynuację. Wywiady nieustrukturyzowane przypominają rozmowę kierowaną. Dwadzieścia godzin wysokiej jakości wywiadów może wpłynąć na strategię produktu tak samo, jak ankieta przeprowadzona wśród 1000 osób. Zupełnie inne dowody, ta sama decyzja.

Grupy fokusowe nadal są przydatne w przypadku tematów poruszanych przez grupy, takich jak opakowania, reakcje marek i tematy tabu. Ich popularność spadła, gdy zdalne wywiady stały się tak tanie. Doświadczony moderator prowadzący grupę fokusową potrafi wychwycić sprzeczności, które nie są widoczne w wywiadach indywidualnych. Twilio szacuje typowy koszt na 5000–9000 dolarów za sesję, dlatego budżety na badania rynku zarezerwowane są dla decyzji o wysokim ryzyku.

Obserwacja to sposób postępowania, gdy samoocena zachowania jest fałszywa. A tak jest w większości przypadków. Obserwacja uczestnicząca, tradycja etnograficzna, jest kosztowna i powolna, ale stanowi jedyny sposób na uchwycenie tego, co ludzie faktycznie robią w kontekście. Obserwacja nieuczestnicząca jest tańsza i bardziej ograniczona.

Eksperymenty nadal stanowią złoty standard w przypadku twierdzeń o związku przyczynowo-skutkowym. Testy A/B na produkcie internetowym. Kontrolowane badania kliniczne. Quasi-eksperymenty, w których losowy przydział jest niemożliwy. Dyscyplina, która psuje większość eksperymentów w biznesie: mała liczebność próby i wgląd w metrykę przed zakończeniem testu.

Dokumenty i rejestry obejmują dzienniki wewnętrzne, transkrypcje obsługi klienta, zgłoszenia do pomocy technicznej i notatki sprzedażowe. Nowoczesne procesy LLM sprawiają, że analiza tego rodzaju surowych tekstów jest znacznie tańsza niż pięć lat temu. Zespoły ds. obsługi klienta ponownie traktują archiwa zgłoszeń jako główne źródło gromadzenia danych, po latach ich odrzucania.

Mobilne gromadzenie danych ma znaczenie w badaniach terenowych, pracy organizacji pozarządowych i badaniach rynków wschodzących, gdzie łączność jest niestabilna. SurveyCTO i KoboToolbox to uznane platformy. Projektowanie w trybie offline to nieodzowna cecha.

Metody i źródła gromadzenia danych wtórnych

Dane wtórne to druga połowa pola. Ponowne wykorzystanie, a nie pierwotne gromadzenie. Źródła danych wtórnych obejmują otwarte zbiory danych rządowych, agencje statystyczne, panele syndykowane Kantar i Nielsen, wewnętrzne jeziora danych, archiwa punktów sprzedaży, dane spisowe oraz otwartą sieć. Obszar boomu znajduje się w web scrapingu. Bright Data i Apify prowadzą wielomiliardowe przedsiębiorstwa, wykorzystując legalne zastosowania: analizę cen, monitorowanie marki, badania naukowe. I coraz częściej korpusy szkoleniowe sztucznej inteligencji.

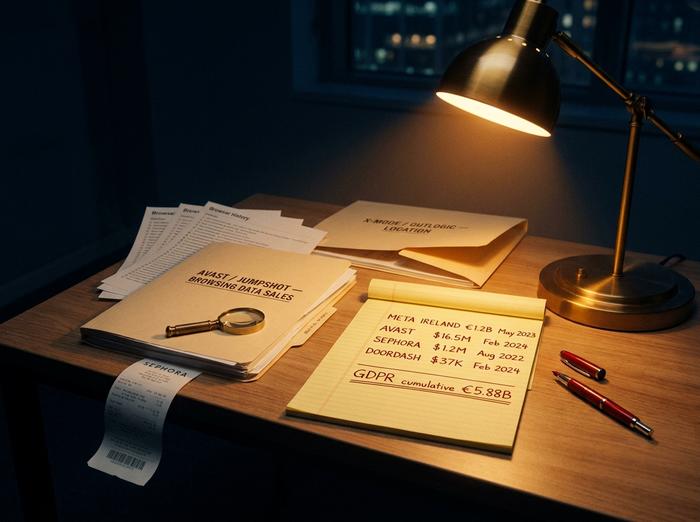

Tutaj również nastąpiły największe zmiany w sferze prawnej. W lutym 2024 roku Federalna Komisja Handlu (FTC) nałożyła na producenta oprogramowania antywirusowego Avast grzywnę w wysokości 16,5 miliona dolarów za gromadzenie danych przeglądania za pośrednictwem swoich narzędzi bezpieczeństwa i odsprzedaż ich za pośrednictwem spółki zależnej Jumpshot. Ten sam organ regulacyjny nakazał firmom X-Mode i Outlogic w styczniu 2024 roku zaprzestanie sprzedaży poufnych danych o lokalizacji, co było pierwszym tego typu działaniem. W 2023 roku Gildia Autorów (Authors Guild) i „New York Times” złożyły pozew przeciwko OpenAI w związku z wykorzystaniem danych szkoleniowych. Obie sprawy pozostają w toku w 2026 roku. Dawniej wtórne gromadzenie danych wydawało się darmowe. Teraz jednak nie jest darmowe.

Gromadzenie danych ilościowych i jakościowych

Klasyczny styl. Metody ilościowe generują liczby, na podstawie których można tworzyć statystyki: ankiety na dużą skalę, testy A/B, zdarzenia telemetryczne, dzienniki transakcji. Metody statystyczne następnie analizują dane pod kątem trendów, korelacji i przedziałów ufności. Jakościowe metody badawcze generują tekst i znaczenie, które trzeba zinterpretować: wywiady, odpowiedzi z ankiet otwartych, etnograficzne notatki terenowe. Dane zebrane z każdej strony uzupełniają się nawzajem. Najbardziej przydatne badania łączą te dwie metody. Net Promoter Score daje wynik, który łatwo śledzić. Dołączony do niego tekst „dlaczego przyznałeś/aś taki wynik” wyjaśnia przyczynę zmiany wyniku. Uruchomienie któregokolwiek z nich osobno spowoduje utratę połowy historii.

Dwie praktyczne zasady. Jeśli potrafisz z góry określić kategorie odpowiedzi i potrzebujesz jedynie skali, wygrywa analiza ilościowa. Jeśli nie potrafisz jeszcze opisać, czego szukasz – a to zdarza się częściej, niż ludzie przyznają – najpierw analiza jakościowa. Następnie analiza ilościowa mierzy to, co ujawniła analiza jakościowa.

Jak firmy zbierają dane w 2026 roku

Stos biznesowy to miejsce, w którym gromadzenie danych nie przypomina podręcznika. Pięć warstw obejmuje większość działań nowoczesnej firmy.

| Warstwa | Funkcjonować | Typowy sprzedawca | Kotwica 2025-2026 |

|---|---|---|---|

| CRM | Rekordy klientów pierwszej strony | Salesforce, HubSpot, MS Dynamics 365 | Salesforce ~21% globalnego rynku CRM |

| Analityka internetowa/aplikacyjna | Telemetria behawioralna | GA4, Plausible, Adobe Analytics | GA4 uniwersalny po zachodzie słońca UA (lipiec 2023) |

| Śledzenie po stronie serwera | Identyfikatory własne po ITP | GTM po stronie serwera, RudderStack, Segment | Domyślna infrastruktura po Apple ITP |

| CDP | Zunifikowany profil klienta | Segment Twilio, Tealium, mParticle | Rynek ~2 miliardy dolarów (2024) → ~7 miliardów dolarów do 2028 roku |

| IoT / telemetria | Zdarzenia urządzenia | AWS IoT, Azure IoT Hub | ~18,8 mld podłączonych urządzeń (koniec 2024 r.) |

CRM to miejsce, w którym znajdują się dane klientów. Salesforce kontroluje około jednej piątej globalnego rynku CRM. HubSpot jest liderem w segmencie MŚP. Microsoft Dynamics 365 ma silną pozycję wśród przedsiębiorstw, które już kupują Microsoft 365. CRM to również miejsce, w którym dane regulowane zazwyczaj trafiają jako pierwsze, dlatego właśnie tam wciąż pojawiają się zapisy RODO.

Analityka internetowa i aplikacji zdecydowanie przeniosła się do Google Analytics 4 po wyłączeniu Universal Analytics w lipcu 2023 roku. Zespoły dbające o prywatność korzystają z Plausible lub Fathom. Mniej danych, mniej możliwości raportowania. Adobe Analytics nadal dominuje w segmencie korporacyjnym.

Śledzenie po stronie serwera to najmniej omawiana zmiana w ciągu ostatnich trzech lat. ITP firmy Apple i ochrona odcisków palców na poziomie przeglądarki poważnie złamały pliki cookie po stronie klienta. Dlatego dostawcy przenieśli warstwę śledzenia za własną domenę. Safari i Firefox również nie mogą tam usuwać identyfikatorów. Domyślnie, po stronie serwera, znajdują się Menedżer tagów Google i RudderStack.

Platformy danych klientów ujednolicają rekordy z CRM, strony internetowej, aplikacji i poczty e-mail w jeden profil dla każdego klienta. Statista szacuje, że rynek CDP będzie wart około 2 miliardy dolarów w 2024 roku, a do 2028 roku osiągnie 7 miliardów dolarów. Twilio Segment, Tealium i mParticle stanowią filary tej kategorii.

IoT i telemetria to warstwa, którą większość artykułów pomija, a której nie powinna pomijać. IoT Analytics naliczył około 18,8 miliarda podłączonych urządzeń IoT na całym świecie pod koniec 2024 roku. Prognozuje się, że do 2030 roku liczba ta wzrośnie do 40 miliardów. Każde z nich gromadzi dane dotyczące: zużycia energii, lokalizacji, temperatury, ruchu i obecności. Ustawa UE o danych, która wchodzi w życie 12 września 2025 roku, daje użytkownikom prawo do przenoszenia danych generowanych przez te urządzenia.

Obok stosu znajdują się dwie nowe kategorie. Dane typu „zero-party” , w których użytkownicy dobrowolnie zgłaszają swoje preferencje bezpośrednio za pośrednictwem centrów preferencji, quizów i pól profilu, gwałtownie wzrosły po awarii Privacy Sandbox. Marki zdały sobie sprawę, że przyszłość po plikach cookie jeszcze nie nadeszła i że pytanie ludzi może być prostsze niż zgadywanie. Korpusy szkoleniowe AI są obecnie najbardziej kontrowersyjną formą gromadzenia danych na dużą skalę. Brytyjski Sąd Najwyższy orzekł 4 listopada 2025 r. w sprawie Getty Images przeciwko Stability AI, że wagi modeli AI nie są „kopiami” w rozumieniu ustawy o prawie autorskim, wzorach i patentach. Getty wycofało już swoje główne roszczenia o naruszenie w trakcie procesu. Gromadzenie danych szkoleniowych AI wygrało tę rundę minimalną przewagą.

Prywatność, etyka i podstawa prawna gromadzenia danych

Do 2026 roku dla większości firm zajmujących się zbieraniem danych będą miały znaczenie trzy poziomy prawne. RODO w UE. CCPA i CPRA w Kalifornii. Oraz FTC na szczeblu federalnym w USA, mocno kładąca nacisk na swoją rolę w ochronie konsumentów, ponieważ nadal nie ma federalnego prawa dotyczącego prywatności. Według systemu monitorowania egzekwowania przepisów CMS Law, łączna suma kar za naruszenie RODO przekroczyła 5,88 mld euro do końca 2024 roku. Na szczycie listy znajduje się kara w wysokości 1,2 mld euro nałożona na Meta Ireland w maju 2023 roku za bezprawne transfery danych z UE do USA. Tuż poniżej: kara w wysokości 405 mln euro nałożona na Instagram za dane dzieci od 2022 roku.

Egzekwowanie przepisów w Kalifornii przynosi mniejsze zyski, ale większe tempo. Tamtejszy organ nadzoru wybiera mniejsze sprawy i rozwiązuje je szybciej. Sephora zapłaciła 1,2 miliona dolarów w sierpniu 2022 roku za sprzedaż danych osobowych bez możliwości rezygnacji. DoorDash poszedł w jej ślady w lutym 2024 roku, wypłacając odszkodowanie w wysokości 375 000 dolarów za tego samego rodzaju uchybienie. Obie sprawy pokazują, że zasada „nie sprzedawaj moich danych osobowych” ma znaczenie w praktyce, a agencja skupia się na codziennych naruszeniach, a nie na tych, które przyciągają uwagę mediów.

Po stronie federalnej, FTC nie próżnowała do 2024 roku. W lutym Avast zapłacił 16,5 miliona dolarów za gromadzenie danych przeglądania za pośrednictwem swojego produktu antywirusowego i odsprzedaż ich za pośrednictwem spółki zależnej. W styczniu X-Mode i Outlogic otrzymały pierwsze w swoim rodzaju nakazy zakazujące sprzedaży poufnych danych o lokalizacji. Nakaz Drizly z października 2022 roku poszedł o krok dalej: wymienił osobiście nazwisko dyrektora generalnego, co wskazuje, że reakcja na naruszenia bezpieczeństwa spoczywa teraz na osobach na najwyższych szczeblach, a nie tylko na firmie.

Zbiór danych dotyczących trenowania sztucznej inteligencji to sedno tego wszystkiego, co wciąż jest w toku. „New York Times” pozwał OpenAI 27 grudnia 2023 r. Gildia Autorów wniosła pozew trzy miesiące wcześniej, we wrześniu 2023 r., a obie sprawy były nadal aktualne w 2026 r. Sprawa Getty przeciwko Stability AI doprowadziła następnie do orzeczenia Sądu Najwyższego Wielkiej Brytanii z 4 listopada 2025 r., które działało na niekorzyść posiadacza praw. Sąd orzekł, że wagi modeli sztucznej inteligencji nie są „kopiami” w rozumieniu ustawy o prawie autorskim, wzorach i patentach (Copyright, Designs and Patents Act). Getty wycofało już swoje główne roszczenia dotyczące naruszenia w trakcie procesu. Pozew zbiorowy złożony przez LinkedIn 21 stycznia 2025 r. został dobrowolnie oddalony dziewięć dni później. Roszczenie: trenowanie sztucznej inteligencji na podstawie prywatnych wiadomości InMail. Dowód: LinkedIn wykazał, że dane nie zostały wykorzystane do trenowania żadnego modelu. Jak dotąd, trudno jest spierać się o gromadzenie danych dotyczących trenowania sztucznej inteligencji, niezależnie od tego, jak źle to wygląda.

Jedna z kwot, która ciągle pojawia się w branżowych prezentacjach, zasługuje na korektę. Błąd ma znaczenie, gdy czytelnicy go przytaczają. Ugoda TikToka z 2019 roku w ramach COPPA, przeciwko podmiotowi Musical.ly, wyniosła 5,7 miliona dolarów. Nie 5,9 miliarda dolarów, które nadal drukują niektóre prezentacje. Nowsza skarga Departamentu Sprawiedliwości i Federalnej Komisji Handlu, złożona oddzielnie 2 sierpnia 2024 roku, domaga się do 51 744 dolarów dziennie za każde naruszenie i nadal oczekuje na rozpatrzenie w 2026 roku.

Nie jestem przekonany, że cokolwiek z tego stanie się prostsze w ciągu najbliższego roku. Praktyczny skrót na rok 2026: każdy nowy system gromadzenia danych wymaga przeglądu prywatności przed ich dotarciem, a nie po. Egzekwowanie przepisów dotyczących ukrytych wzorców rośnie w ramach unijnej ustawy o usługach cyfrowych. Banery zgody są teraz audytowane pod kątem zgodności z wytycznymi EROD. A test zmotywowanego intruza z aktualizacji brytyjskiego ICO z marca 2025 roku ma zastosowanie do wszystkiego, co jest oznaczone jako „anonimizowane”.

Wybór właściwej metody zbierania danych

Wybór metody zbierania danych to najważniejszy krok w całym procesie badawczym. Drzewo decyzyjne jest krótkie. Zacznij od pytania badawczego, a nie od narzędzia.

Jeśli pytanie brzmi „ile”, postaw na metody ilościowe: ankiety, telemetria, dziennik transakcji. Jeśli pytanie brzmi „dlaczego”, postaw na metody jakościowe: wywiady lub odpowiedzi otwarte. Jeśli pytanie brzmi „co się tu dzieje, czego jeszcze nie rozumiem”, postaw na obserwację. Jeśli potrzebujesz zarówno głębi, jak i skali, zaprojektuj narzędzie mieszane z góry. Zaplanuj dwukrotnie więcej czasu na analizę, niż myślisz, że potrzebujesz.

Trzy ograniczenia weryfikują wybór. Kwestie etyczne i prawne: w jakich jurysdykcjach znajduje się Twoja grupa docelowa oraz jakie zasady dotyczące zgody i przechowywania danych mają zastosowanie? Budżet: grupy fokusowe w cenie 5000–9000 dolarów za sesję nie są właściwym rozwiązaniem w przypadku pytania eksploracyjnego, na które odpowiedzi można by uzyskać w ciągu dwóch dni wywiadów. Horyzont czasowy: badania ankietowe z dużą liczbą respondentów trwają od dwóch do czterech tygodni, etnografia zajmuje miesiące, telemetria działa w czasie rzeczywistym, ale zakłada, że instrumenty już istnieją.

Zatem: akademicka taksonomia metod nie zmieniła się od dwudziestu lat. Stos biznesowy, który uruchamia te metody, został przepisany trzy razy w ciągu pięciu lat. Kwestie prawne zmieniły się dwukrotnie w ciągu ostatnich osiemnastu miesięcy. Wybierz metodę dla pytania. Następnie załóż, że plan gromadzenia danych wymaga przeglądu prywatności przed, a nie po pojawieniu się pierwszego rekordu.