Métodos de coleta de dados: Primários, Secundários e Ferramentas 2026

Os métodos de coleta de dados estão em um momento peculiar. O lado teórico da área — primário versus secundário, quantitativo versus qualitativo — permanece praticamente o mesmo de vinte anos atrás. Já o lado prático foi reconstruído três vezes nos últimos cinco anos. A Prevenção Inteligente de Rastreamento da Apple comprometeu uma parte significativa da análise da web. O Privacy Sandbox do Google foi discretamente desativado em abril de 2025, após a API de Tópicos atingir apenas 13% dos carregamentos de páginas do Chrome, com os cookies de terceiros permanecendo ativados por padrão. Os scrapers de IA vasculharam a web pública mais rápido do que os editores conseguiam limitar seu uso. A escolha para quem escrever sobre isso em 2026 será entre ensinar as ferramentas existentes ou aquelas que funcionavam em 2019. Este artigo opta pela primeira.

Quais são, de fato, os métodos de coleta de dados?

Um método de coleta de dados é um procedimento para reunir informações com o objetivo de responder a uma questão de pesquisa específica. Dois eixos organizam todo o campo. O primeiro é a distinção entre dados primários e secundários. Dados primários são coletados em primeira mão para responder à sua própria pergunta. Dados secundários são dados que já existem e que você reutiliza. O segundo eixo é a distinção entre dados quantitativos e qualitativos. Dados quantitativos são contáveis e estatísticos: números, contagens, classificações, registros de data e hora. Dados qualitativos são interpretativos: palavras, temas, observações, transcrições. Projetos de pesquisa reais geralmente combinam os dois métodos propositalmente. Um questionário com uma escala de 1 a 5 pontos, além de um campo aberto para "por que", é o instrumento de métodos mistos mais comum na prática.

Métodos de coleta de dados primários utilizados em 2026

Sete tipos principais de coleta de dados abrangem praticamente tudo no âmbito da pesquisa primária. Cada método possui um ponto forte, um perfil de custo e uma ferramenta padrão para 2026. Os métodos de amostragem (aleatória, estratificada, por conveniência e por conglomerados) são a base desses métodos, representando a escolha de projeto que determina se os dados coletados são generalizáveis.

| Método | Ideal para | Ferramenta típica | âncora de 2026 |

|---|---|---|---|

| Pesquisas/questionários | Escala, classificações, segmentação | Qualtrics, SurveyMonkey, Typeform | O online domina; prioridade para dispositivos móveis. |

| Entrevistas | Profundidade, motivação, casos extremos | Zoom, Microsoft Teams + Otter.ai | Ferramentas assíncronas em ascensão |

| grupos focais | Dinâmica de grupo, teste de conceito | Recollective, Discuss.io | Aproximadamente US$ 5.000 a US$ 9.000 por sessão (Twilio) |

| Observação | Comportamento real em contexto | Anotações de campo, vídeo, gravação de tela | A etnografia continua viva, menos popular. |

| Experimentos | Inferência causal | Plataformas de teste A/B (Optimizely, GrowthBook) | A disciplina de resistência importa mais |

| Documentos/registros | Texto organizacional existente | SharePoint, suporte a transcrições | Análise assistida por LLM comum |

| Coleta de dados móveis | Estudos de campo, trabalho com baixa conectividade | SurveyCTO, KoboToolbox | Priorizar o modo offline continua sendo essencial. |

Pesquisas e questionários ainda são as ferramentas mais utilizadas. Eles são escaláveis, segmentam o público e são a única maneira prática de fazer a mesma pergunta a 10.000 pessoas. O segredo está na formulação das perguntas, não na plataforma. Um questionário mal formulado gera ruído que nenhum respondente consegue corrigir.

As entrevistas se situam no eixo da profundidade. As estruturadas utilizam um roteiro fixo. As semiestruturadas utilizam um roteiro, mas permitem perguntas adicionais. As não estruturadas se assemelham a uma conversa guiada. Vinte horas de entrevistas de alta qualidade podem moldar a estratégia de produto tão bem quanto uma pesquisa com mil pessoas. Evidências muito diferentes, mesma decisão.

Os grupos focais continuam sendo úteis para tópicos que envolvem grupos, como embalagens, reações à marca e assuntos tabus. Seu uso diminuiu quando o trabalho remoto tornou as entrevistas individuais muito baratas. Um moderador habilidoso conduzindo um grupo focal pode revelar contradições que uma entrevista individual não captaria. A Twilio estima o custo típico entre US$ 5.000 e US$ 9.000 por sessão, razão pela qual os orçamentos de pesquisa de mercado os reservam para decisões de alto risco.

A observação é o que se faz quando o comportamento autodeclarado mente. O que acontece na maioria das vezes. A observação participante, tradição etnográfica, é cara e demorada, mas é a única maneira de captar o que as pessoas realmente fazem em contexto. A observação não participante é mais barata e mais limitada.

Experimentos ainda são o padrão ouro para comprovar relações de causa e efeito. Testes A/B em um produto web. Ensaios controlados em um ambiente clínico. Quase-experimentos onde a alocação aleatória é impossível. A prática que mais prejudica experimentos em negócios: tamanho amostral pequeno e análise superficial da métrica antes do término do teste.

Documentos e registros incluem logs internos, transcrições de atendimento ao cliente, chamados de suporte e notas de vendas. Os fluxos de trabalho modernos do LLM tornam a análise desse tipo de texto bruto muito mais barata do que há cinco anos. As equipes de experiência do cliente agora tratam os arquivos de chamados como uma fonte primária de coleta de dados novamente, depois de anos os descartando.

A coleta de dados móveis é importante em pesquisas de campo, trabalhos de ONGs e pesquisas em mercados emergentes onde a conectividade é irregular. SurveyCTO e KoboToolbox são plataformas consolidadas. O design que prioriza o modo offline é um requisito indispensável.

Métodos e fontes de coleta de dados secundários

Os dados secundários representam a outra metade do campo. Reutilização, não coleta inédita. As fontes de dados secundários variam entre conjuntos de dados governamentais abertos, agências estatísticas, painéis sindicados da Kantar e da Nielsen, data lakes internos, arquivos de pontos de venda, dados censitários e a web aberta. O setor em expansão está na extração de dados da web (web scraping). Empresas como Bright Data e Apify administram negócios multimilionários com usos legítimos: inteligência de preços, monitoramento de marcas, pesquisa acadêmica e, cada vez mais, corpora para treinamento de IA.

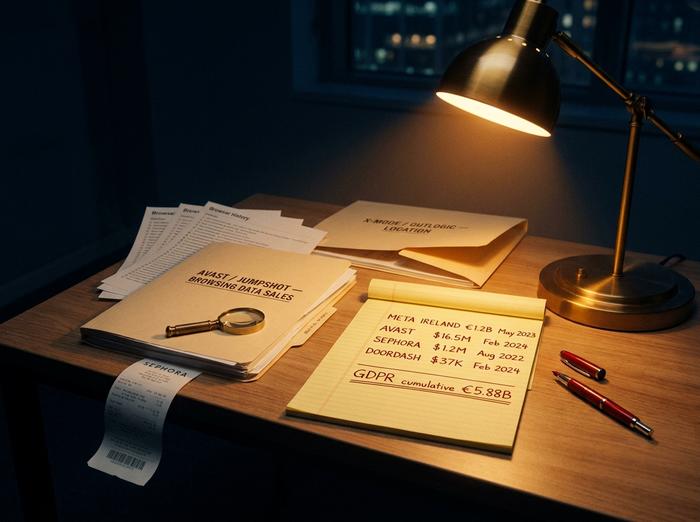

Aqui também houve grandes mudanças no cenário jurídico. Em fevereiro de 2024, a FTC multou a fornecedora de antivírus Avast em US$ 16,5 milhões por coletar dados de navegação por meio de suas ferramentas de segurança e revendê-los através de uma subsidiária chamada Jumpshot. O mesmo órgão regulador ordenou, em janeiro de 2024, que a X-Mode e a Outlogic parassem de vender dados de localização sensíveis, uma ação inédita. A Authors Guild e o New York Times entraram com processos contra a OpenAI em 2023 devido ao uso de dados de treinamento. Ambos os casos permanecem ativos em 2026. A coleta secundária de dados costumava ser algo natural. Agora não é mais.

Coleta de dados quantitativos versus qualitativos

O corte clássico. Os métodos quantitativos produzem números que permitem realizar análises estatísticas: pesquisas em larga escala, testes A/B, eventos de telemetria, registros transacionais. Os métodos estatísticos, então, analisam os dados, identificando tendências, correlações e intervalos de confiança. Os métodos de pesquisa qualitativa produzem texto e significado que precisam ser interpretados: entrevistas, respostas abertas em pesquisas, notas de campo etnográficas. Os dados coletados de cada abordagem complementam a outra. A maioria das pesquisas úteis combina as duas. O Net Promoter Score (NPS) fornece um número fácil de acompanhar. O campo de texto livre "por que você deu essa nota?" associado a ele explica o motivo da variação da pontuação. Usar qualquer um deles isoladamente significa perder metade da história.

Duas regras práticas. Se você consegue definir as categorias de resposta antecipadamente e só precisa de uma escala, a análise quantitativa é a melhor opção. Se você ainda não consegue descrever o que está procurando — e isso é mais comum do que se imagina —, a análise qualitativa vem primeiro. Depois, o trabalho quantitativo mede o que quer que o trabalho qualitativo tenha revelado.

Como as empresas coletam dados em 2026

Na estrutura organizacional, a coleta de dados é bem diferente do que se vê nos livros. Cinco camadas abrangem a maior parte das operações de uma empresa moderna.

| Camada | Função | Fornecedor típico | âncora 2025-2026 |

|---|---|---|---|

| CRM | Registros de clientes próprios | Salesforce, HubSpot, MS Dynamics 365 | A Salesforce detém cerca de 21% do mercado global de CRM. |

| Análise da web/aplicativos | Telemetria comportamental | GA4, Plausível, Adobe Analytics | GA4 universal após o pôr do sol da UA (julho de 2023) |

| Rastreamento do lado do servidor | Identificadores primários após o ITP | GTM do lado do servidor, RudderStack, Segmento | Infraestrutura padrão após o Apple ITP |

| CDP | Perfil unificado do cliente | Twilio Segment, Tealium, mParticle | Mercado ~$2B (2024) → ~$7B até 2028 |

| IoT / telemetria | Eventos do dispositivo | AWS IoT, Azure IoT Hub | Aproximadamente 18,8 bilhões de dispositivos conectados (final de 2024) |

O CRM é onde os dados primários dos clientes residem. A Salesforce detém aproximadamente um quinto do mercado global de CRM. A HubSpot lidera o segmento de pequenas e médias empresas (PMEs). O Microsoft Dynamics 365 tem forte presença em empresas que já utilizam o Microsoft 365. O CRM também é onde os dados regulamentados tendem a ser armazenados primeiro, razão pela qual a aplicação do GDPR continua sendo um tema recorrente.

Após o encerramento do Universal Analytics em julho de 2023 , as análises da web e de aplicativos migraram decisivamente para o Google Analytics 4. Equipes focadas em privacidade utilizam o Plausible ou o Fathom. Menos dados significam menos recursos de geração de relatórios. O Adobe Analytics ainda domina o mercado corporativo.

O rastreamento no servidor é a mudança menos discutida dos últimos três anos. O ITP da Apple e a proteção por impressão digital no nível do navegador prejudicaram seriamente os cookies do lado do cliente. Por isso, os fornecedores moveram a camada de rastreamento para dentro de seus próprios domínios. Safari e Firefox também não conseguem remover IDs nesses locais. O Google Tag Manager e o RudderStack, implementados no servidor, são as soluções padrão.

As plataformas de dados do cliente ( CDPs) unificam registros de CRM, web, aplicativos e e-mail em um único perfil por cliente. A Statista estima que o mercado de CDP atingirá cerca de US$ 2 bilhões em 2024, com previsão de alcançar US$ 7 bilhões em 2028. Twilio Segment, Tealium e mParticle são as principais empresas do setor.

A IoT e a telemetria são a camada que a maioria dos artigos ignora, e não deveriam. A IoT Analytics contabilizou cerca de 18,8 bilhões de dispositivos IoT conectados globalmente no final de 2024. A projeção é de que esse número chegue a 40 bilhões até 2030. Cada um deles coleta dados sobre algo: consumo de energia, localização, temperatura, movimento, ocupação. A Lei de Proteção de Dados da UE, em vigor desde 12 de setembro de 2025, concede aos usuários o direito à portabilidade dos dados gerados por esses dispositivos.

Duas categorias mais recentes complementam a estrutura existente. Os dados de terceiros (zero-party data) , em que os usuários expressam suas preferências diretamente por meio de centros de preferências, questionários e campos de perfil, ganharam destaque após o fracasso do Privacy Sandbox. As marcas perceberam que o futuro pós-cookies ainda não havia chegado e que perguntar às pessoas poderia ser mais simples do que adivinhar. Os corpora de treinamento de IA são a forma mais contestada de coleta em larga escala atualmente. A Alta Corte do Reino Unido decidiu em 4 de novembro de 2025, no caso Getty Images vs. Stability AI, que os pesos dos modelos de IA não são "cópias" de acordo com a Lei de Direitos Autorais, Desenhos e Patentes. A Getty já havia desistido de suas principais alegações de infração no meio do julgamento. A coleta para treinamento de IA venceu essa rodada por uma margem estreita.

Privacidade, ética e o limite legal para cobrança

Até 2026, três pilares legais serão cruciais para a maioria das empresas que realizam coleta de dados. O GDPR na UE. A CCPA e a CPRA na Califórnia. E a FTC no âmbito federal dos EUA, que se apoiará fortemente em seu papel de proteção ao consumidor, visto que ainda não existe uma lei federal de privacidade em vigor. O rastreador de aplicação da lei da CMS Law indica que as multas acumuladas pelo GDPR ultrapassaram € 5,88 bilhões até o final de 2024. A multa de € 1,2 bilhão imposta à Meta Ireland em maio de 2023, por transferências ilegais de dados da UE para os EUA, está no topo dessa lista. Logo abaixo, encontra-se uma multa de € 405 milhões aplicada ao Instagram por dados de crianças, em 2022.

Na Califórnia, a fiscalização resulta em custos menores, mas em maior agilidade. O órgão regulador local seleciona casos menores e os resolve mais rapidamente. A Sephora pagou US$ 1,2 milhão em agosto de 2022 por vender informações pessoais sem a opção de exclusão (opt-out). A DoorDash seguiu o mesmo caminho em fevereiro de 2024, com um acordo de US$ 375 mil pelo mesmo tipo de falha. Ambos os casos demonstram que a política de "não vender minhas informações pessoais" tem peso na prática, e a agência prioriza violações de dados comuns em vez de casos que ganham manchetes.

No âmbito federal, a FTC manteve-se bastante ocupada ao longo de 2024. A Avast pagou US$ 16,5 milhões em fevereiro por coletar dados de navegação por meio de seu antivírus e revendê-los através de uma subsidiária. Em janeiro, a X-Mode e a Outlogic receberam ordens judiciais inéditas proibindo a venda de dados de localização sensíveis. A ordem judicial contra a Drizly, de outubro de 2022, foi além: nomeou pessoalmente o diretor executivo, sinalizando que a responsabilidade pela resposta a violações de segurança agora recai sobre as pessoas no topo da hierarquia, e não apenas sobre a empresa.

A coleta de treinamento de IA é o aspecto ainda em desenvolvimento de toda essa questão. O New York Times processou a OpenAI em 27 de dezembro de 2023. A Authors Guild havia entrado com uma ação três meses antes, em setembro de 2023, e ambos os casos ainda estavam ativos em 2026. O caso Getty vs. Stability AI resultou em uma decisão da Alta Corte do Reino Unido em 4 de novembro de 2025, que prejudicou o detentor dos direitos autorais. O tribunal considerou que os pesos dos modelos de IA não são "cópias" de acordo com a Lei de Direitos Autorais, Desenhos e Patentes. A Getty já havia desistido de suas principais alegações de infração no meio do julgamento. Uma ação coletiva movida pelo LinkedIn em 21 de janeiro de 2025 foi arquivada voluntariamente nove dias depois. A alegação: treinamento de IA em mensagens privadas do InMail. A prova: o LinkedIn demonstrou que os dados não haviam sido usados para treinar nenhum modelo. O padrão até agora é que a coleta de treinamento de IA é difícil de litigar, não importa quão ruim a imagem pareça.

Um valor que continua aparecendo em apresentações do setor merece uma correção. O erro é relevante quando os leitores o citam. O acordo firmado em 2019 entre o TikTok e a Musical.ly, referente à Lei de Proteção da Privacidade Online das Crianças (COPPA), foi de US$ 5,7 milhões. Não os US$ 5,9 bilhões que algumas apresentações ainda divulgam. A denúncia mais recente do Departamento de Justiça e da Comissão Federal de Comércio (FTC), apresentada em 2 de agosto de 2024, busca indenizações de até US$ 51.744 por dia por violação e ainda está pendente em 2026.

Não estou convencido de que nada disso se tornará mais simples no próximo ano. Em resumo, para 2026, qualquer novo processo de coleta de dados precisa de uma revisão de privacidade antes que os dados cheguem, não depois. A aplicação de medidas contra práticas questionáveis está se intensificando sob a Lei de Serviços Digitais da UE. Os banners de consentimento agora são auditados de acordo com as diretrizes do CEPD (Comitê Europeu para a Proteção de Dados). E o teste de intrusão motivada da atualização de março de 2025 do ICO (Escritório do Comissário de Informação do Reino Unido) se aplica a tudo o que for rotulado como "anonimizado".

Escolher o método certo de coleta de dados

A escolha do método de coleta de dados é a etapa mais importante em todo o processo de pesquisa. A árvore de decisão é curta. Comece com a pergunta de pesquisa, não com a ferramenta.

Se a pergunta for "quantos", opte por uma abordagem quantitativa: pesquisa, telemetria, registro de transações. Se a pergunta for "por quê?", opte por uma abordagem qualitativa: entrevistas ou respostas abertas. Se for "o que está acontecendo aqui que eu ainda não entendo?", opte pela observação. Se você precisar de profundidade e abrangência, elabore um instrumento de métodos mistos desde o início. Reserve o dobro do tempo de análise que você acha necessário.

Três restrições limitam a escolha. A ética e a legalidade: em que jurisdições se encontra o seu público-alvo e quais as regras de consentimento e retenção aplicáveis? O orçamento: grupos focais a um custo de US$ 5.000 a US$ 9.000 por sessão não são a opção ideal para uma questão exploratória que seria respondida com dois dias de entrevistas. O horizonte temporal: pesquisas com grande número de participantes levam de duas a quatro semanas para serem concluídas sem problemas, a etnografia leva meses, a telemetria é em tempo real, mas pressupõe que os instrumentos já existam.

Então: a taxonomia acadêmica de métodos não mudou em vinte anos. A estrutura de negócios que executa esses métodos foi reescrita três vezes em cinco anos. O cenário jurídico mudou duas vezes nos últimos dezoito meses. Escolha o método para a questão. Em seguida, considere que o plano de coleta de dados precisa de uma revisão de privacidade antes, e não depois, do primeiro registro ser obtido.