Métodos de recopilación de datos: primarios, secundarios y 2026 Herramientas

Los métodos de recopilación de datos se encuentran en una situación peculiar. La teoría —datos primarios frente a secundarios, cuantitativos frente a cualitativos— se mantiene prácticamente igual que hace veinte años. Sin embargo, la implementación se ha reinventado tres veces en los últimos cinco años. La función de Prevención de Seguimiento Inteligente de Apple causó estragos en una parte importante del análisis web. El entorno aislado de privacidad de Google se retiró discretamente en abril de 2025, una vez que la API de Temas solo alcanzó el 13 % de las cargas de páginas de Chrome, con las cookies de terceros activadas por defecto. Los rastreadores de IA procesaban la web pública más rápido de lo que los editores podían limitarlos. Quien escriba sobre esto en 2026 deberá elegir entre enseñar las herramientas existentes o las que funcionaban en 2019. Este artículo opta por la primera.

¿Cuáles son realmente los métodos de recopilación de datos?

Un método de recolección de datos es un procedimiento para obtener información orientada a una pregunta de investigación específica. Dos ejes organizan todo el campo. El primero es datos primarios versus secundarios. Los datos primarios se recolectan directamente para la pregunta de investigación en cuestión. Los datos secundarios son datos ya existentes que se reutilizan. El segundo eje es datos cuantitativos versus cualitativos. Los datos cuantitativos son cuantificables y estadísticos: números, recuentos, calificaciones, marcas de tiempo. Los datos cualitativos son interpretativos: palabras, temas, observaciones, transcripciones. Los diseños de investigación reales suelen combinar ambos tipos de datos intencionadamente. Una encuesta con una calificación de 1 a 5 más un espacio libre para la pregunta "¿por qué?" es el instrumento de métodos mixtos más común en la práctica.

Métodos de recopilación de datos primarios utilizados en 2026

Siete tipos básicos de recopilación de datos abarcan prácticamente todo lo relacionado con la recopilación primaria. Cada método tiene sus ventajas, su perfil de costos y una herramienta predeterminada para 2026. Los métodos de muestreo (aleatorio, estratificado, por conveniencia, por conglomerados) constituyen la elección de diseño que determina si los datos recopilados son generalizables.

| Método | Lo mejor para | Herramienta típica | Ancla de 2026 |

|---|---|---|---|

| Encuestas / cuestionarios | Escala, calificaciones, segmentación | Qualtrics, SurveyMonkey, Typeform | El entorno online domina; la prioridad son los dispositivos móviles. |

| Entrevistas | Profundidad, motivación, casos límite | Zoom, Microsoft Teams + Otter.ai | Las herramientas asíncronas están en auge. |

| Grupos focales | Dinámica de grupos, prueba de conceptos | Recordatorio, Discuss.io | Aproximadamente entre 5.000 y 9.000 dólares por sesión (Twilio) |

| Observación | Comportamiento real en contexto | Notas de campo, vídeo, grabación de pantalla | La etnografía sigue viva, aunque menos popular. |

| Experimentos | Inferencia causal | Plataformas de pruebas A/B (Optimizely, GrowthBook) | La disciplina de los que se resisten es más importante que nunca. |

| Documentos / registros | Texto organizativo existente | SharePoint, transcripciones de soporte | Análisis asistido por LLM común |

| Recopilación de datos móviles | Estudios de campo, trabajo en entornos de baja conectividad. | SurveyCTO, KoboToolbox | La prioridad al entorno offline sigue siendo esencial. |

Las encuestas y los cuestionarios siguen siendo la herramienta más eficaz. Permiten la escalabilidad, la segmentación y son la única forma práctica de hacer la misma pregunta a 10 000 personas. La clave está en el diseño de las preguntas, no en la plataforma. Un cuestionario mal redactado genera información irrelevante que ningún encuestado puede solucionar.

Las entrevistas se sitúan en el eje de profundidad. Las estructuradas utilizan un guion fijo. Las semiestructuradas utilizan un guion, pero permiten preguntas de seguimiento. Las no estructuradas se asemejan a una conversación guiada. Veinte horas de entrevistas de alta calidad pueden influir en la estrategia de producto tanto como una encuesta a 1000 personas. Evidencia muy diferente, misma decisión.

Los grupos focales siguen siendo útiles para temas que requieren participación grupal, como el empaquetado, las reacciones a las marcas y los temas tabú. Su uso disminuyó cuando el trabajo remoto abarató las entrevistas individuales. Un moderador experto puede sacar a la luz contradicciones que una entrevista individual pasa por alto. Twilio estima que el costo típico oscila entre los 5000 y los 9000 dólares por sesión, razón por la cual los presupuestos de investigación de mercado los reservan para decisiones de gran importancia.

La observación es lo que se hace cuando el comportamiento autoinformado miente. Lo cual ocurre casi siempre. La observación participante, la tradición etnográfica, es costosa y lenta, pero es la única manera de captar lo que la gente realmente hace en contexto. La observación no participante es más barata y más limitada.

Los experimentos siguen siendo el método de referencia para las afirmaciones causales. Pruebas A/B en un producto web. Ensayos controlados en un entorno clínico. Cuasiexperimentos donde la asignación aleatoria es imposible. La disciplina que suele perjudicar a la mayoría de los experimentos en el ámbito empresarial: el tamaño reducido de la muestra y el análisis de las métricas antes de que finalice la prueba.

Los documentos y registros incluyen bitácoras internas, transcripciones de atención al cliente, tickets de soporte y notas de ventas. Los flujos de trabajo modernos de LLM hacen que analizar este tipo de texto sin procesar sea mucho más económico que hace cinco años. Los equipos de experiencia del cliente ahora vuelven a considerar los archivos de tickets como una fuente de recopilación primaria, después de años de haberlos descartado.

La recopilación de datos móviles es fundamental en la investigación de campo, el trabajo de las ONG y las encuestas en mercados emergentes donde la conectividad es irregular. SurveyCTO y KoboToolbox son las plataformas consolidadas. El diseño que prioriza el funcionamiento sin conexión es una característica indispensable.

Métodos y fuentes de recopilación de datos secundarios

Los datos secundarios constituyen la otra mitad del campo. Se trata de reutilización, no de recopilación inicial. Las fuentes de datos secundarios abarcan desde conjuntos de datos gubernamentales abiertos, agencias estadísticas, paneles sindicados de Kantar y Nielsen, lagos de datos internos, archivos de puntos de venta, datos censales y la web abierta. El sector en auge es el web scraping. Empresas como Bright Data y Apify gestionan negocios multimillonarios basados en usos legítimos: inteligencia de precios, monitorización de marcas, investigación académica y, cada vez más, corpus de entrenamiento para IA.

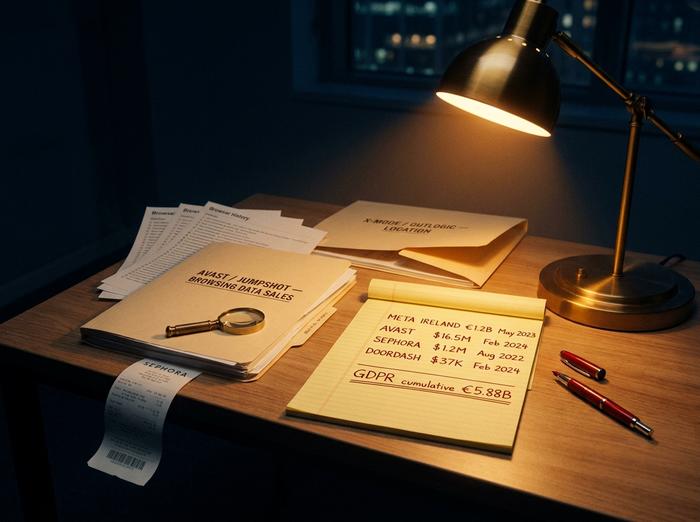

El panorama legal también experimentó grandes cambios. En febrero de 2024, la FTC multó al proveedor de antivirus Avast con 16,5 millones de dólares por recopilar datos de navegación a través de sus herramientas de seguridad y revenderlos mediante una filial llamada Jumpshot. El mismo organismo regulador ordenó a X-Mode y Outlogic en enero de 2024 que dejaran de vender datos de ubicación confidenciales, una medida sin precedentes. El Gremio de Autores y el New York Times presentaron demandas contra OpenAI en 2023 por el uso de datos de entrenamiento. Ambos casos siguen activos en 2026. La recopilación secundaria de datos solía ser gratuita. Ya no lo es.

Recopilación de datos cuantitativos frente a datos cualitativos

El enfoque clásico. Los métodos cuantitativos generan números sobre los que se pueden realizar análisis estadísticos: encuestas a gran escala, pruebas A/B, eventos de telemetría, registros de transacciones. Los métodos estadísticos analizan los datos para identificar tendencias, correlaciones e intervalos de confianza. Los métodos de investigación cualitativa generan texto y significado que se deben interpretar: entrevistas, respuestas abiertas a encuestas, notas de campo etnográficas. Los datos recopilados de cada método se complementan entre sí. La investigación más útil combina ambos. El Net Promoter Score proporciona un número fácil de rastrear. La pregunta "¿Por qué le diste esa puntuación?" adjunta explica el motivo del cambio. Si se utiliza uno solo, se pierde la mitad de la historia.

Dos reglas prácticas. Si puedes predefinir las categorías de respuesta y solo necesitas una escala, lo cuantitativo es la mejor opción. Si aún no puedes describir lo que buscas —algo más común de lo que se suele admitir—, lo cualitativo es lo primero. Luego, el análisis cuantitativo mide lo que el análisis cualitativo reveló.

Cómo las empresas recopilan datos en 2026

La arquitectura empresarial es donde la recopilación de datos no se parece en nada a lo que se enseña en los libros de texto. Cinco capas abarcan la mayor parte de las operaciones de una empresa moderna.

| Capa | Función | Proveedor típico | Ancla 2025-2026 |

|---|---|---|---|

| CRM | Registros de clientes de primera parte | Salesforce, HubSpot, MS Dynamics 365 | Salesforce representa aproximadamente el 21% del mercado global de CRM. |

| Análisis web/de aplicaciones | Telemetría conductual | GA4, Plausible, Adobe Analytics | GA4 universal después de la finalización de UA (julio de 2023) |

| Seguimiento del lado del servidor | Identificadores de primera parte después de ITP | GTM del lado del servidor, RudderStack, Segmento | Infraestructura predeterminada después de Apple ITP |

| CDP | Perfil de cliente unificado | Segmento de Twilio, Tealium, mParticle | Mercado ~$2 mil millones (2024) → ~$7 mil millones para 2028 |

| IoT / telemetría | Eventos del dispositivo | AWS IoT, Azure IoT Hub | Aproximadamente 18.800 millones de dispositivos conectados (finales de 2024) |

El CRM es donde reside la información de primera mano de los clientes. Salesforce controla aproximadamente una quinta parte del mercado global de CRM. HubSpot lidera el segmento de las pymes. Microsoft Dynamics 365 tiene una fuerte presencia en las empresas que ya utilizan Microsoft 365. El CRM también es donde suelen almacenarse primero los datos regulados, razón por la cual la aplicación del RGPD sigue siendo un factor clave en este ámbito.

Tras el cierre de Universal Analytics en julio de 2023 , el análisis web y de aplicaciones migró decisivamente a Google Analytics 4. Los equipos que priorizan la privacidad utilizan Plausible o Fathom. Menos datos implican menor capacidad de generación de informes. Adobe Analytics sigue dominando el mercado empresarial.

El seguimiento del lado del servidor es el cambio menos comentado de los últimos tres años. La protección ITP de Apple y la protección de huellas digitales a nivel de navegador afectaron gravemente a las cookies del lado del cliente. Por ello, los proveedores trasladaron la capa de seguimiento a su propio dominio. Safari y Firefox tampoco pueden eliminar las identificaciones allí. Google Tag Manager y RudderStack, del lado del servidor, son la infraestructura predeterminada.

Las plataformas de datos de clientes (CDP ) unifican los registros de CRM, web, aplicaciones y correo electrónico en un único perfil por cliente. Statista estima que el mercado de CDP alcanzará aproximadamente los 2.000 millones de dólares en 2024 y llegará a los 7.000 millones de dólares en 2028. Twilio Segment, Tealium y mParticle son las empresas líderes del sector.

El IoT y la telemetría constituyen la capa que la mayoría de los artículos pasan por alto, y no deberían. IoT Analytics contabilizó aproximadamente 18.800 millones de dispositivos IoT conectados a nivel mundial a finales de 2024. Se prevé que esta cifra alcance los 40.000 millones en 2030. Cada uno de ellos recopila datos sobre algún aspecto: consumo de energía, ubicación, temperatura, movimiento, ocupación, etc. La Ley de Protección de Datos de la UE, vigente desde el 12 de septiembre de 2025, otorga a los usuarios derechos de portabilidad sobre los datos que generan estos dispositivos.

Dos nuevas categorías se encuentran junto a la pila. Los datos de origen cero , donde los usuarios voluntariamente expresan sus preferencias directamente a través de centros de preferencias, cuestionarios y campos de perfil, se dispararon después del fracaso de Privacy Sandbox. Las marcas se dieron cuenta de que el futuro sin cookies aún no había llegado y que preguntar a la gente podría ser más sencillo que adivinar. Los corpus de entrenamiento de IA son la forma de recopilación a gran escala más controvertida en este momento. El Tribunal Superior del Reino Unido dictaminó el 4 de noviembre de 2025 en Getty Images v Stability AI que los pesos de los modelos de IA no son "copias" según la Ley de Derechos de Autor, Diseños y Patentes. Getty ya había retirado sus principales demandas por infracción a mitad del juicio. La recopilación de entrenamiento de IA ganó esa ronda, por un estrecho margen.

Privacidad, ética y el límite legal para la recopilación de datos

Para 2026, tres bases legales son cruciales para la mayoría de las empresas que gestionan la recopilación de datos: el RGPD en la UE, la CCPA y la CPRA en California, y la FTC a nivel federal en EE. UU., que se apoya firmemente en su función de protección al consumidor, dado que aún no existe una ley federal de privacidad vigente. El rastreador de cumplimiento de CMS Law indica que las multas acumuladas por incumplimiento del RGPD superaron los 5880 millones de euros a finales de 2024. La multa de 1200 millones de euros impuesta a Meta Ireland en mayo de 2023 por transferencias ilegales de datos de la UE a EE. UU. encabeza la lista. Justo debajo se encuentra la multa de 405 millones de euros impuesta a Instagram en 2022 por datos de menores.

La aplicación de la ley en California implica menos dinero, pero más rapidez. El organismo regulador prioriza los casos menores y los resuelve con mayor celeridad. Sephora pagó 1,2 millones de dólares en agosto de 2022 por vender información personal sin consentimiento del usuario. DoorDash hizo lo propio en febrero de 2024 con un acuerdo de 375.000 dólares por una infracción similar. Ambos casos demuestran que la cláusula de "no vender mi información personal" tiene peso en la práctica, y la agencia se centra en las infracciones cotidianas en lugar de las que acaparan titulares.

En el ámbito federal, la FTC se mantuvo activa durante todo 2024. En febrero, Avast pagó 16,5 millones de dólares por recopilar datos de navegación a través de su antivirus y revenderlos mediante una filial. En enero, X-Mode y Outlogic obtuvieron órdenes judiciales pioneras que prohibían la venta de datos de ubicación confidenciales. La orden contra Drizly, de octubre de 2022, fue aún más allá: nombró personalmente al director ejecutivo, lo que indica que la responsabilidad de responder ante una filtración de datos recae ahora en los altos cargos, no solo en la empresa.

La recopilación de datos para entrenamiento de IA es un aspecto aún por definir. El New York Times demandó a OpenAI el 27 de diciembre de 2023. El Gremio de Autores había presentado una demanda tres meses antes, en septiembre de 2023, y ambos casos seguían activos en 2026. El caso Getty contra Stability AI produjo entonces una sentencia del Tribunal Superior del Reino Unido el 4 de noviembre de 2025 que perjudicó al titular de los derechos. El tribunal dictaminó que los pesos de los modelos de IA no son "copias" según la Ley de Derechos de Autor, Diseños y Patentes. Getty ya había retirado sus principales demandas por infracción a mitad del juicio. Una demanda colectiva de LinkedIn presentada el 21 de enero de 2025 fue desestimada voluntariamente nueve días después. La demanda: entrenamiento de IA en mensajes privados de InMail. La prueba: LinkedIn demostró que los datos no se habían utilizado para entrenar ningún modelo. Hasta ahora, la tendencia es que la recopilación de datos para entrenamiento de IA es difícil de litigar, por muy negativa que parezca la imagen pública.

Una cifra que se repite con frecuencia en las presentaciones del sector merece una corrección. El error es relevante cuando los lectores la citan. El acuerdo de TikTok de 2019 con la entidad Musical.ly, en virtud de la ley COPPA, fue de 5,7 millones de dólares, no de los 5.900 millones que aún se publican en algunas presentaciones. La demanda más reciente del Departamento de Justicia y la Comisión Federal de Comercio, presentada el 2 de agosto de 2024, exige por separado hasta 51.744 dólares diarios por infracción, y sigue pendiente en 2026.

No estoy convencido de que nada de esto se simplifique durante el próximo año. La conclusión práctica para 2026 es que cualquier nuevo sistema de recopilación de datos requiere una revisión de privacidad antes de que los datos lleguen a su destino, no después. La aplicación de la ley contra las prácticas engañosas está aumentando en virtud de la Ley de Servicios Digitales de la UE. Los avisos de consentimiento ahora se auditan conforme a las directrices del CEPD. Y la prueba del intruso motivado de la actualización de marzo de 2025 de la ICO del Reino Unido se aplica a todo lo que se etiquete como "anonimizado".

Elegir el método de recopilación de datos adecuado

La elección del método de recolección de datos es el paso más importante en todo el proceso de investigación. El árbol de decisiones es breve. Comience con la pregunta de investigación, no con la herramienta.

Si la pregunta es "¿cuántos?", utilice métodos cuantitativos: encuestas, telemetría, registros de transacciones. Si la pregunta es "¿por qué?", utilice métodos cualitativos: entrevistas o respuestas abiertas. Si la pregunta es "¿qué está pasando aquí que aún no entiendo?", utilice métodos observacionales. Si necesita profundidad y alcance, diseñe un instrumento de métodos mixtos desde el principio. Asigne el doble del tiempo de análisis que cree necesario.

Tres limitaciones condicionan la elección. La ética y los aspectos legales: ¿en qué jurisdicciones se encuentra su público objetivo y qué normas de consentimiento y retención se aplican? El presupuesto: los grupos focales con un coste de entre 5000 y 9000 dólares por sesión no son la opción más adecuada para una pregunta exploratoria que se podría responder con dos días de entrevistas. El horizonte temporal: las encuestas con un gran número de participantes requieren de dos a cuatro semanas para una ejecución correcta, la etnografía lleva meses, la telemetría es en tiempo real, pero presupone que la instrumentación ya existe.

Así pues: la taxonomía académica de los métodos no ha cambiado en veinte años. La infraestructura empresarial que los ejecuta se ha reescrito tres veces en cinco. El marco legal cambió dos veces en los últimos dieciocho meses. Elija el método adecuado para la pregunta. Luego, asuma que el plan de recopilación de datos requiere una revisión de privacidad antes, no después, de que se registre el primer dato.