Cyfrowo anonimizowany w 2026: co to oznacza i jak to zrobić

Fraza „cyfrowo zanonimizowany” (ang. „digitally anonymised”) robi obecnie ogromne wrażenie. Netflix użył jej w tym roku na pierwszej stronie filmu dokumentalnego o prawdziwych zbrodniach. Film zastąpił twarze i głosy świadków postaciami sztucznej inteligencji. (Brytyjska pisownia „cyfrowo zanonimizowany” pojawia się w tym samym kontekście w wersji brytyjskiej). Naukowcy akademiccy użyli tej samej frazy w 2019 roku w odniesieniu do zbioru danych 1,5 miliona Amerykanów. Następnie ponownie zidentyfikowali 99,98% z nich na podstawie zaledwie 15 prostych atrybutów. Oba twierdzenia są technicznie prawdziwe. Opisują one również radykalnie różne rzeczy – niemal przeciwstawne, w zależności od interpretacji. Zatem gdy ktoś mówi ci, że twarz, rekord lub cały zbiór danych został zanonimizowany cyfrowo, jedynym sensownym pytaniem jest, co właściwie ma na myśli i wobec kogo ta anonimizacja ma się sprawdzić.

Co tak naprawdę oznacza „anonimizacja cyfrowa”

Za tą etykietą kryją się dwie odrębne idee. Pierwsza to powierzchniowa deidentyfikacja: rozmyta twarz, fałszywe imię, modulator głosu, awatar AI. Ukrywa ona osobę przed widzem, który nie próbuje zgłębić tematu. Druga to anonimizacja statystyczna: zestaw rekordów ulega zmianie, więc nawet doświadczony reidentyfikator z publicznymi danymi nie może powiązać wiersza z konkretną osobą. Pierwsza to gest ochrony prywatności danych. Druga to ochrona prywatności danych. Motyw 26 RODO wyraźnie ujmuje tę różnicę. Dane są anonimowe tylko wtedy, gdy żaden „środek, który z dużym prawdopodobieństwem zostanie użyty” nie umożliwia ich ponownej identyfikacji. HIPAA koduje tę samą ideę jako pasek Safe Harbor dla identyfikatorów dla osób powyżej 18 roku życia lub orzeczenie eksperta, że ryzyko ponownej identyfikacji jest „bardzo małe”. Wytyczne ICO UK, zaktualizowane w marcu 2025 r., nazywają to testem zmotywowanego intruza. Większość rzeczy sprzedawanych jako „cyfrowo zanonimizowane” przechodzi pierwszy test, ale nie przechodzi drugiego.

Jak w praktyce anonimizuje się cyfrowo osoby fizyczne

Indywidualna anonimowość cyfrowa to nie jeden przełącznik. To stos. Każda warstwa ustala jeden identyfikator, a pozostałe pozostawia bez zmian. Większość czytelników chce trzech lub czterech narzędzi, a nie jednego produktu z etykietą „anonimizator”.

Warstwa sieciowa. Twój adres IP to identyfikator, który najłatwiej ujawnić i najłatwiej ukryć. Tor pozostaje najsilniejszą opcją na poziomie sieci, z około 2,5 miliona użytkowników dziennie i infrastrukturą około 8000 ochotniczych przekaźników (stan na połowę 2025 roku, według Tor Metrics). Komercyjna sieć VPN to lżejsza alternatywa; w 2025 roku korzystało z niej około 32% dorosłych Amerykanów, w porównaniu z 46% rok wcześniej, według Security.org, a globalne aplikacje VPN liczą około 147 milionów użytkowników. Tor obsługuje modele zagrożeń na poziomie państwa. Sieć VPN obsługuje Twojego dostawcę usług internetowych, pracodawcę i sieć Wi-Fi kawiarni. Te dwa rozwiązania rozwiązują różne problemy.

Warstwa przeglądarki. Wybierz przeglądarkę, której domyślne ustawienia zakładają, że sieć jest wroga: Brave, LibreWolf, Mullvad Browser lub Tor Browser w najsilniejszym przypadku. Odporność na odciski palców i blokowanie reklam są tu ważniejsze niż prywatne okno, które ukrywa jedynie lokalną historię przed osobą udostępniającą Twój laptop.

Warstwa tożsamości. Adres e-mail to najprzydatniejszy identyfikator, jaki może zebrać tracker, ponieważ łączy profile brokerów danych w różnych usługach. Rozwiązaniem jest alias dla każdej usługi za pośrednictwem SimpleLogin (przejętego przez Proton w kwietniu 2022 roku, z ponad 100 000 użytkowników i 2 milionami aliasów w tamtym czasie) lub addy.io. Dodaj nazwę użytkownika dla każdej usługi i wirtualny numer telefonu do weryfikacji SMS, a najprostsze łączenie między witrynami przestanie działać.

Warstwa płatności. Bitcoin nie jest już narzędziem ochrony prywatności. Chainalysis twierdzi, że może śledzić praktycznie całą warstwę transakcyjną; udział przestępczości w wolumenie on-chain spadł z około 70% do około 20% właśnie dlatego, że śledczy rutynowo deanonimizują łańcuchy. Monero to jedyna duża kryptowaluta, której Chainalysis publicznie twierdzi, że nie jest w stanie śledzić na dużą skalę. Przyczyną techniczną jest stos podpisów pierścieniowych CLSAG (16-członowe pierścienie: jeden prawdziwy sygnatariusz, 15 wabików), ukryte adresy i ukrywanie kwoty RingCT. Ceną jest płynność. Binance globalnie wycofała XMR z giełdy we wrześniu 2024 r., a Kraken wycofał go z Europejskiego Obszaru Gospodarczego do 31 grudnia 2024 r., ograniczając falę wycofań 60 giełd w 2024 r. i około 73 do połowy 2025 r. Pomimo presji, Monero utrzymywało kapitalizację rynkową na poziomie blisko 7,6 miliarda dolarów i dzienną liczbę transakcji na poziomie około 28 000 pod koniec 2025 roku, a cena w maju 2026 roku wynosiła około 411 dolarów. Sprzedawcy, którzy chcą akceptować kryptowaluty bez zmuszania kupujących do KYC, mogą korzystać z bramek płatności bez powiernictwa. Na przykład Plisio obsługuje ponad 50 monet z prowizją 0,5%, podczas gdy typowa dla kart płatniczych stopa dyskontowa dla sprzedawców wynosi 2-3%.

Higiena urządzenia i konta. Brak zalogowanych kont w sesji prywatności. Osobne profile dla osobnych tożsamości. Stos działa tylko wtedy, gdy nie cofniesz go, logując się do tego samego konta Gmail we wszystkich kontach.

| Warstwa | Co kryje | Najlepsze w swojej klasie narzędzie | Numer 2025-2026 |

|---|---|---|---|

| Sieć | Widoczność IP, trasy, dostawcy usług internetowych | Tor / Mullvad VPN / Proton VPN | Tor ~2,5 mln użytkowników dziennie, 147 mln globalnych aplikacji VPN |

| Przeglądarka | Odcisk palca, urządzenia śledzące, telemetria | Przeglądarka Brave/LibreWolf/Mullvad | Brave 100 mln aktywnych użytkowników miesięcznie (wrzesień 2025) |

| Tożsamość | Dołączanie do poczty e-mail, ponowne wykorzystanie telefonu | SimpleLogin / addy.io | SimpleLogin Ponad 100 tys. użytkowników, ponad 2 mln aliasów |

| Zapłata | Odcisk palca wydatków, KYC | Monero / Plisio bez depozytu | Monero ~28 tys. transakcji dziennie, kapitalizacja 7,6 mld USD |

| Konto | Łączenie międzyusługowe | Tożsamości dla poszczególnych usług, bez logowania jednokrotnego | — |

Dlaczego „anonimizowane” zbiory danych są ciągle ponownie identyfikowane

Wyniki w nauce są niepochlebne. Zdejmowanie nazwisk prawie nigdy nie wystarcza.

| Rok | Zestaw danych / zdarzenie | Wynik ponownej identyfikacji |

|---|---|---|

| 1997 | Zwolnienie lekarskie szpitala Massachusetts GIC | Latanya Sweeney identyfikuje osiągnięcia gubernatora Williama Welda, korzystając z publicznych spisów wyborców |

| 2000 | Spis powszechny USA z 1990 r. | Sweeney pokazuje, że 87% Amerykanów jest wyjątkowych {ZIP, DOB, sex} |

| 2006 | Dzienniki wyszukiwania AOL (20 mln zapytań / 650 tys. użytkowników) | NYT w ciągu 5 dni identyfikuje użytkownika 4417749 jako Thelmę Arnold; dyrektor ds. technologii rezygnuje |

| 2008 | Nagroda Netflix (480 189 subskrybentów) | Narayanan i Shmatikov: 99% rekordów można zidentyfikować za pomocą 8 ocen + 14-dniowych dat |

| 2013 | 1,5 mln abonentów telefonii komórkowej | de Montjoye: 4 punkty czasoprzestrzenne jednoznacznie identyfikują 95% użytkowników |

| 2014 | Zbiór danych o taksówkach w Nowym Jorku | Odwrócenie numerów medalionów za pomocą algorytmu MD5 w mniej niż 2 minuty; rekonstrukcja podróży celebrytów |

| 2016 | Australijskie wydanie Medicare i PBS | Ponowna identyfikacja 3 urzędujących parlamentarzystów i jednego zawodnika AFL w ciągu 5 tygodni; zbiór danych wycofany |

| 2018 | Globalna mapa cieplna Strava | ~13 bilionów punktów GPS ujawniło granice baz wojskowych w Iraku, Syrii i Afganistanie |

| 2019 | Rocher, Hendrickx, de Montjoye | 99,98% Amerykanów można poprawnie zidentyfikować na podstawie 15 cech demograficznych |

| 2026 | Netflix „Śledztwo w sprawie Lucy Letby” | Twarze i głosy sztucznej inteligencji zastosowane do świadków; tylko anonimizacja wizualna |

Schemat się powtarza. Wydawca usuwa oczywiste identyfikatory, twierdzi, że zbiór danych jest zanonimizowany, a badacz dysponujący publicznym źródłem pomocniczym (listami wyborców, bazą danych IMDB, zdjęciami paparazzi, katalogami pracodawców) ponownie łączy te dwa elementy, ujawniając prawdziwe tożsamości w ciągu kilku tygodni.

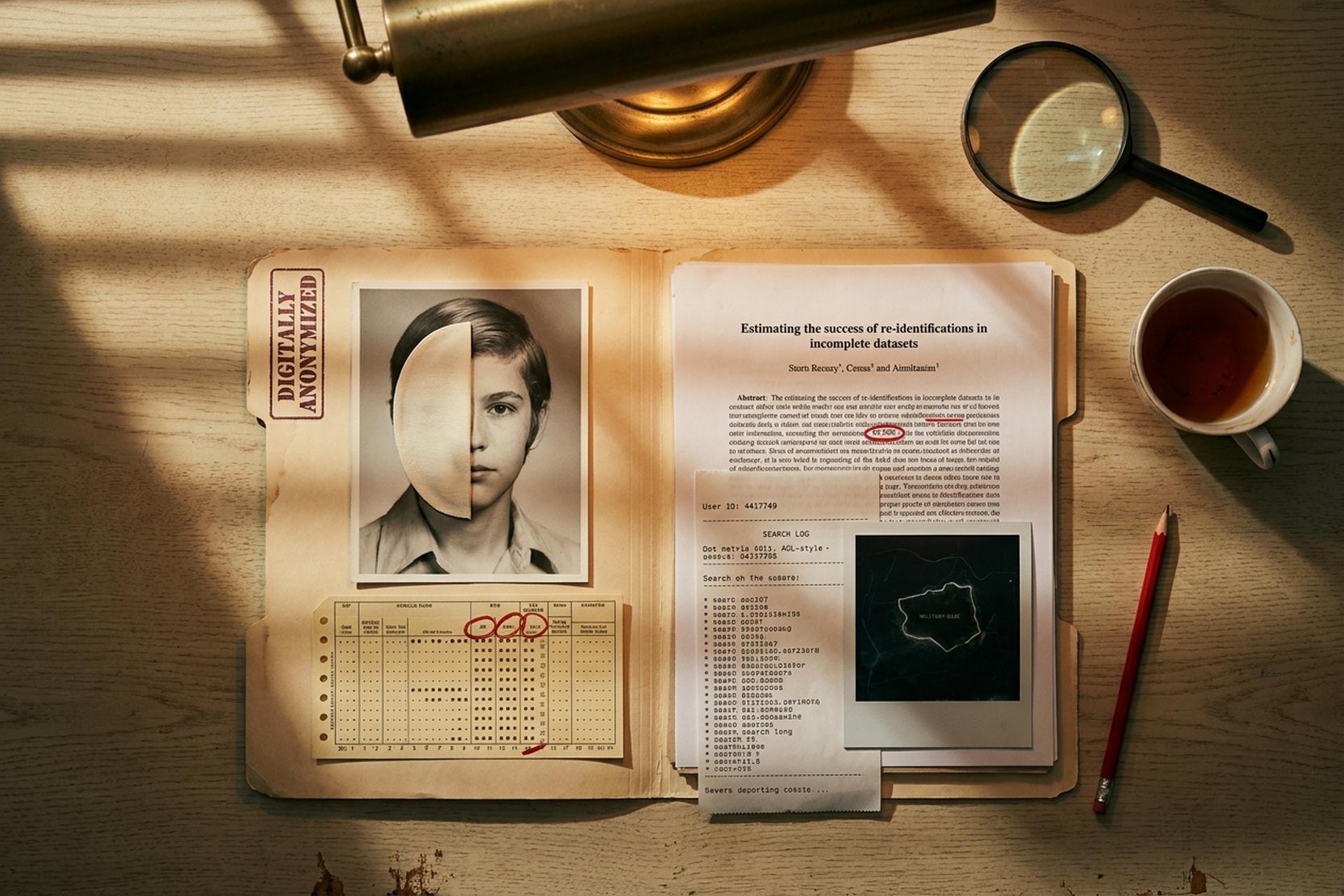

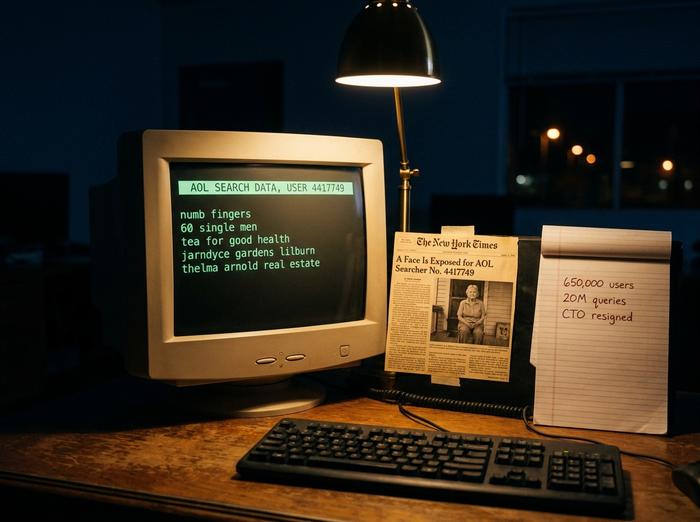

Sprawa AOL z sierpnia 2006 roku była pierwszą szeroko komentowaną reidentyfikacją w świecie rzeczywistym, a historie wyszukiwania okazały się same w sobie quasi-identyfikatorami. Zapytania Thelmy Arnold o „zdrętwiałe palce”, „60 samotnych mężczyzn” i jej rodzinne miasto Lilburn w stanie Georgia wystarczyły, by dwóch reporterów „New York Timesa” znalazło ją na ganku. Trzech pracowników AOL, w tym dyrektor ds. technicznych, straciło pracę w ciągu kilku tygodni.

Nagroda Netflix, uruchomiona w październiku 2006 roku, przyniosła około 100 milionów ocen 17 770 filmów od 480 189 subskrybentów. Narayanan i Shmatikov opublikowali swój artykuł na temat deanonimizacji na konferencji IEEE S&P 2008. Mając zaledwie dwie oceny i trzydniowe okno datowania, byli w stanie jednoznacznie zidentyfikować 68% subskrybentów. Przy ośmiu ocenach i czternastodniowym oknie datowania, liczba ta wzrosła do 99%. Netflix anulował planowaną kontynuację w 2010 roku po pozwie Doe przeciwko Netflixowi i dochodzeniu FTC.

Film dokumentalny o Lucy Letby, wydany jako dokument Netflixa w lutym 2026 roku, jest wersją tej samej lekcji skierowaną do konsumentów. Na planszy tytułowej czytamy: „Niektórzy współautorzy zostali cyfrowo zamaskowani, aby zachować anonimowość. Ich imiona, wygląd i głosy zostały zmienione”. Zastosowana tu technika anonimizacji to generatywna sztuczna inteligencja, a nie rozmycie czy sylwetka, częściowo motywowana przez świadków, którzy musieli zastosować się do nakazów sądowych ograniczających ich widoczność publiczną. Reakcja publiczności była podzielona między skargą typu uncanny valley dotyczącą wykorzystania sztucznej inteligencji a obroną, że awatar sztucznej inteligencji lepiej oddaje ludzkie emocje niż czarna skrzynka. Obie te postawy pomijały głębszy sens. Wykorzystanie sztucznej inteligencji do anonimizacji wizualnej nie wpływa na odciski palców behawioralnych w samych zeznaniach: frazowanie, daty, nazwane stanowiska. Zmotywowany intruz, mając zanonimizowane dane i krótką listę kandydatów, nadal ma wiele do zrobienia. Sztuczna inteligencja zmieniła wygląd wyników. Nie zmieniła matematyki re-id.

Różnicowa prywatność i jedyna uczciwa anonimizacja

Ramą, która przetrwała atak klasy de Montjoye, jest prywatność różnicowa. Dwork, McSherry, Nissim i Smith zdefiniowali ją w 2006 roku w artykule „Calibrating Noise to Sensitivity in Private Data Analysis”. Ideą nie jest usuwanie identyfikatorów, lecz dodawanie starannie dobranego szumu do wyników zapytania, tak aby obecność lub nieobecność dowolnej osoby w danych była statystycznie wykluczona.

Zawiera ilościowy budżet prywatności, epsilon (ε). Niższy epsilon oznacza więcej szumu i silniejszą prywatność. Wprowadzenie różnicowej prywatności było następstwem szeregu słabszych ram. K-anonimowość, zaproponowana przez Sweeneya w 2002 roku, wymaga, aby każdy rekord wyglądał tak samo jak co najmniej k-1 innych w quasi-identyfikatorach. L-różnorodność (Machanavajjhala i in. 2007) wprowadziła ograniczenie na zróżnicowanie wrażliwych atrybutów. t-bliskość (Li i in. 2007) zawęziła rozkład. Wszystkie trzy są heurystyczne. Tylko różnicowa prywatność daje matematyczną gwarancję najgorszego przypadku dla dowolnych danych pomocniczych.

Rekord wdrożeń jest mieszany. Apple ogłosiło lokalną prywatność różnicową podczas konferencji WWDC 2016, ale audyty inżynierii wstecznej wykazały, że ustawienia epsilon wahały się od około 2 do 8, co badacze prywatności uważają za słabe. Biuro Spisu Ludności Stanów Zjednoczonych zastosowało prywatność różnicową w wydaniu z 2020 roku za pomocą algorytmu TopDown z globalnym ε wynoszącym około 19,61. Ta wartość spotkała się z krytyką za zbyt dużą luźność, ale spis z 2020 roku był pierwszym wydaniem krajowym, które w ogóle zawierało jakąkolwiek formalną gwarancję prywatności. Jeśli oświadczenie o „cyfrowej anonimizacji” nie zawiera epsilonu – lub przynajmniej ak lub at – prawie na pewno jest to starszy, 18-elementowy identyfikator, a nie formalny.

Lucy Letby, awatary sztucznej inteligencji i anonimizacja cyfrowa

Film dokumentalny o Lucy Letby jest najczęściej omawianym przykładem „cyfrowej anonimizacji twarzy” na początku 2026 roku, i nie bez powodu. Dokument opowiada o brytyjskiej pielęgniarce neonatologicznej skazanej za siedem morderstw, co rodzi coraz więcej pytań o ewentualną pomyłkę sądową. Decyzja Netflixa o zastąpieniu twarzy i głosów świadków awatarami generowanymi przez sztuczną inteligencję ma znaczenie wykraczające poza samą sprawę. Reakcje widzów były podzielone. Jedna strona nazwała awatary rozpraszającymi, „kreskówkowymi” i niepokojącymi. Druga broniła tej techniki, twierdząc, że zachowuje ona ludzkie emocje, które spłaszczyłaby obróbka oparta wyłącznie na sylwetce lub głosie.

W debacie pominięto głównie model zagrożenia. Twarz AI to nakładka UX. Nie chroni ona źródła przed kompetentnym, zmotywowanym intruzem, który ma już listę kandydatów (innych pracowników na tym samym oddziale w tym samym szpitalu w tych samych datach) oraz transkrypt zawierający daty, role zawodowe i zwroty. Sprawa Lucy Letby, z publicznie wymienioną instytucją i publiczną osią czasu, zawiera jedno i drugie. Im węższy zbiór źródeł, tym mniej można kupić dzięki nakładce AI. To nie jest argument przeciwko tej technice. To argument za jasnym określeniem jej działania i brakiem anonimizacji.

Czego wymaga prawo w przypadku roszczeń „zanonimizowanych cyfrowo”

Trzy organy regulacyjne wyznaczają dolną granicę na większości rynków. Unijne RODO, amerykańskie przepisy HIPAA dotyczące danych medycznych oraz wytyczne brytyjskiego ICO z 2025 roku. Motyw 26 RODO ustanawia test „rozsądnie prawdopodobnego” działania. HIPAA oferuje albo pasek Safe Harbor składający się z 18 określonych identyfikatorów, albo opinię eksperta, że resztkowe ryzyko ponownej identyfikacji jest „bardzo małe”. ICO UK ponownie potwierdziło test zmotywowanego intruza w marcu 2025 roku.

Największa zmiana prawna w ubiegłym roku nastąpiła w Trybunale Sprawiedliwości Unii Europejskiej. W sprawie C-413/23, EDPS przeciwko SRB, rozstrzygniętej 4 września 2025 r., TSUE przyjął względną teorię danych osobowych. Ten sam zapis może być pseudonimowy w rękach jednej strony i anonimowy w rękach drugiej, w oparciu o to, co każda ze stron może rozsądnie wiedzieć. To znaczący zwrot. Domyślne stanowisko sprzed 2025 r., forsowane przez de Montjoye i innych, polegało na tym, że bogate dane są zawsze danymi osobowymi, ponieważ pojemność ponownej identyfikacji nie ma realnych ograniczeń. Orzeczenie z 2025 r. stwierdza, że wezwanie jest kontekstowe. Oba poglądy mogą współistnieć; praktycznym skutkiem jest większa przestrzeń dla stron dalszego łańcucha dostaw do argumentowania, że ich kopia zbioru danych jest anonimowa, nawet jeśli kopia pierwotnego wydawcy taka nie była.

Lista kontrolna: czy dane są faktycznie zanonimizowane cyfrowo?

Pięć pytań, które należy sobie zadać zanim zaczniesz traktować tę etykietę poważnie:

1. Które identyfikatory zostały usunięte? Same nazwy nie wystarczą. Dane demograficzne, znaczniki czasu i rzadkie atrybuty są obecne w każdym pasku Safe Harbor i pozostają informacjami identyfikacyjnymi.

2. Jakie dane pomocnicze są w miarę dostępne? Spisy wyborców, baza danych IMDB, zdjęcia paparazzi, katalogi pracodawców. Wszystko, do czego można dołączyć, się liczy.

3. Czy istnieje formalna gwarancja? Parametr k-anonimowości, liczba t-bliskości czy epsilon różnicowej prywatności. Brak liczby oznacza brak gwarancji.

4. Kto zweryfikował roszczenie? Zespół wewnętrzny czy audytor zewnętrzny w oparciu o zdefiniowany model zagrożenia z udziałem intruza motywowanego.

5. Jakie są środki odwoławcze w przypadku ponownej identyfikacji? Cyfrowo zanonimizowany zbiór danych, który okaże się nieujawniony, stanowi naruszenie, a nie komunikat prasowy.

W 2026 roku termin „cyfrowo zanonimizowany” oznacza, że obejmuje on dwie niezwiązane ze sobą rzeczy naraz. Jako obietnica UX (nie pokażemy Twojej twarzy) jest w porządku, czasami elegancki, czasami źle wykonany. Jako twierdzenie statystyczne (ten zbiór danych jest anonimowy) jest prawie zawsze niewystarczający bez formalnej gwarancji. Buduj indywidualny stos, zakładając, że etykieta wykonuje tylko połowę pracy, którą sugeruje. Żądaj obliczeń, gdy etykieta znajduje się w cudzych danych.