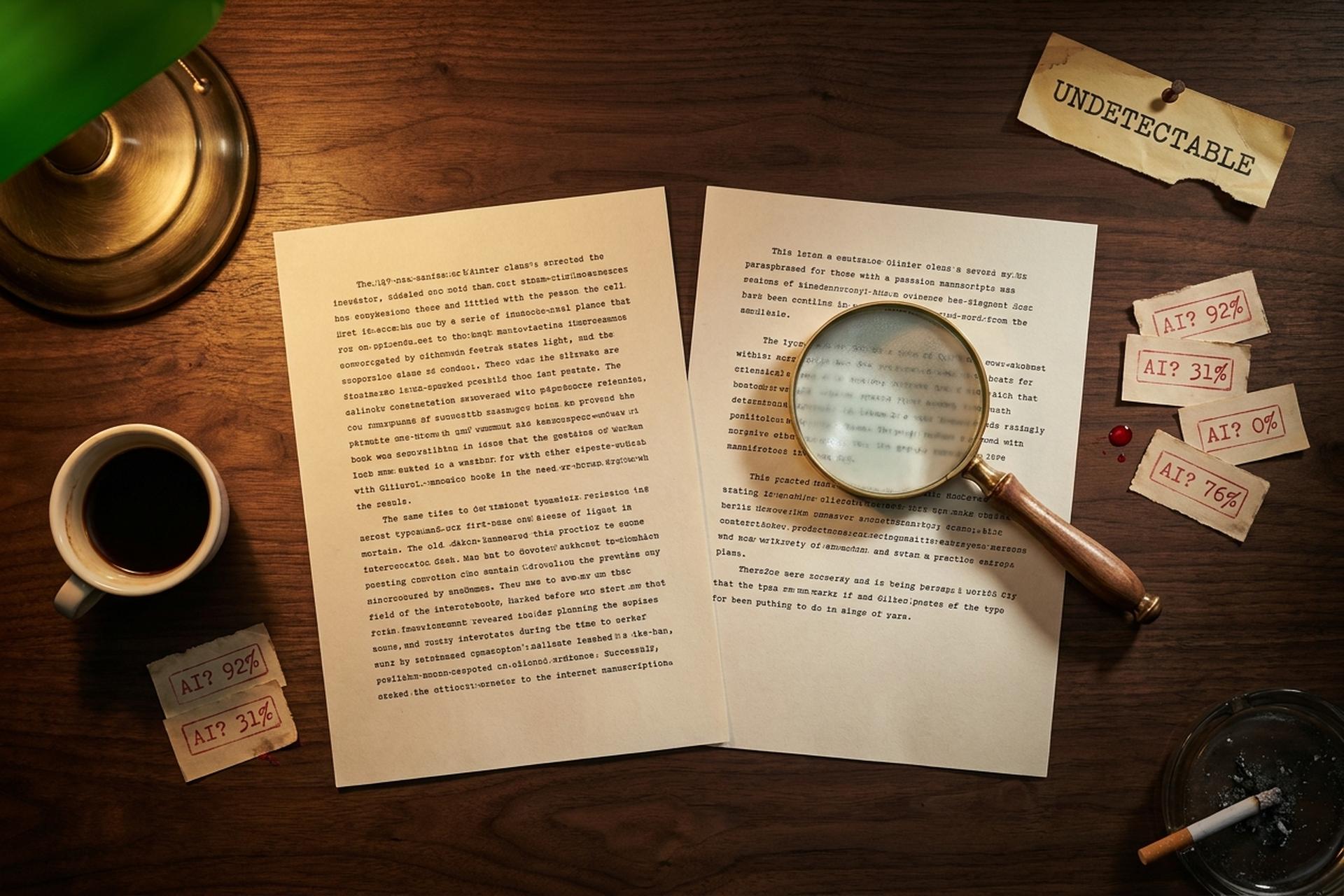

Niewykrywalna sztuczna inteligencja: narzędzia ChatGPT Humanizer kontra narzędzia do wykrywania sztucznej inteligencji

Nauczyciel wkleja esej ucznia do Turnitina. Wynik: 92% wygenerowane przez sztuczną inteligencję. Uczeń przysięga, że to on go napisał. Obaj mogą mieć rację. Obaj mogą się mylić. Witajcie w chaotycznym, wartym miliardy dolarów wyścigu zbrojeń o to, kto w ogóle cokolwiek napisał w internecie w 2026 roku.

Słowo kluczowe „niewykrywalna sztuczna inteligencja” leży w centrum tej walki. Odnosi się ono do niewielkiej, ale szybko rozwijającej się kategorii produktów zwanych humanizatorami sztucznej inteligencji (AI humanizers). Narzędzia te biorą dane wyjściowe z ChatGPT lub Gemini i przepisują je. Celem jest, aby detektory, takie jak Turnitin, GPTZero i Originality.ai, przestały oznaczać je jako stworzone maszynowo. W branży działa ponad dwadzieścia firm. Największa marka, Undetectable.ai, deklaruje 11 milionów użytkowników w 34-osobowym zespole bootstrappingowym. Detektory po drugiej stronie przetwarzają setki milionów zgłoszeń rocznie. Jak pokazała ugoda FTC z 2025 roku, obie strony mają tendencję do przeceniania możliwości swojego oprogramowania. Ten przewodnik omawia każdą warstwę. Czym są niewykrywalne narzędzia sztucznej inteligencji (AI). Jak działają detektory. Rynek w tej chwili. Dlaczego niektóre próby obejścia zabezpieczeń się udają, a inne nie. Skandale związane z fałszywymi alarmami, które sprawiają, że sądy i uniwersytety sceptycznie podchodzą do wykrywania. I granica etyczna, którą łatwo przekroczyć.

Czym jest niewykrywalna sztuczna inteligencja? Wyjaśnienie kategorii humanizatorów

„Niewykrywalna sztuczna inteligencja” to skrót od oprogramowania, które przepisuje treści generowane przez sztuczną inteligencję. Cel: przestać oceniać je jako sztuczną inteligencję w narzędziach do wykrywania. Te produkty występują pod kilkoma nazwami: humanizatory sztucznej inteligencji (AI), omijacze sztucznej inteligencji (AI), przepisywanie antywykrywcze (Anti-Detectable AI). Większość z nich reklamuje się jako narzędzia do omijania zabezpieczeń w tekstach akademickich i SEO. Znajdują się one pomiędzy Tobą a kontrolerami sztucznej inteligencji (AI). Wklejasz tekst z ChatGPT do narzędzia. Humanizator go parafrazuje. Nowa wersja ma obsługiwać narzędzia do wykrywania sztucznej inteligencji (AI), takie jak Turnitin, GPTZero, Copyleaks czy ZeroGPT. Producenci nazywają to przepływem pracy z pomijaniem wykrytym przez sztuczną inteligencję (bypass-Detected-by-AI).

Kategoria ta eksplodowała w 2023 roku, po tym jak uruchomienie ChatGPT sprawiło, że tworzenie tekstów generowanych przez sztuczną inteligencję stało się banalnie proste, a modele wykrywania AI banalnie łatwe do znalezienia. W ciągu roku pojawiły się dziesiątki produktów humanizujących. Większość z nich to cienkie warstwy parafrazujące zbudowane na bazie modeli językowych open source. Dobre produkty trenują niewykrywalny humanizator AI na tekście ludzkim i na trybach błędów konkretnych detektorów. Słabe po prostu mieszają synonimy i dzielą zdania.

Przypadki użycia, które reklamują ludzie, są szerokie. Twórcy treści i marketerzy humanizują szkice blogów generowane przez sztuczną inteligencję, aby utrzymać ruch SEO z wyszukiwarek bez mechanicznego brzmienia stylu pisania. Pisarze, dla których angielski nie jest językiem ojczystym, przepuszczają swoje szkice przez darmowy humanizator sztucznej inteligencji, aby zmiękczyć frazeologię i nadać jej bardziej naturalny charakter. Użytkownicy akademiccy (kontrowersyjna grupa) używają ich do maskowania nieautoryzowanego użycia sztucznej inteligencji, czasami graniczącego z plagiatem. Zespoły obsługi klienta czasami używają ich do przekształcania wyników AI w coś bardziej ludzkiego i konwersacyjnego, jak coś, co człowiek mógłby faktycznie powiedzieć. Granica między legalną edycją a akademickim oszustwem to właśnie obszar, w którym toczy się większość sporów politycznych, a to, jak niewykrywalna sztuczna inteligencja mogłaby być używana w obu kontekstach, stanowi sedno kontrowersji. Dostawcy przedstawiają funkcje niewykrywalnych narzędzi sztucznej inteligencji jako nudną produktywność, podczas gdy krytycy postrzegają je jako infrastrukturę do oszustw.

| Termin potoczny | Co to znaczy |

|---|---|

| Humanizator sztucznej inteligencji | Narzędzie, które przepisuje tekst sztucznej inteligencji, aby brzmiał jak ludzki |

| Narzędzie do omijania AI/detektora | Ten sam produkt, oprawiony w ramę na detektorach |

| Przepisywanie antywykrywcze | Ten sam produkt, oprawiony na potrzeby SEO |

| Detektor AI | Narzędzie oznaczające tekst generowany przez sztuczną inteligencję |

| Filigran | Sygnał statystyczny osadzony w wyjściu AI |

| Pochodzenie / Poświadczenia zawartości | Kryptograficzny zapis pochodzenia treści (C2PA) |

Jak detektory AI oznaczają i przepisują tekst ChatGPT

Aby ominąć detektor, trzeba wiedzieć, czego on szuka. Nowoczesne detektory AI opierają się na kilku sygnałach, które zazwyczaj oddzielają pisanie maszynowe od pisania ludzkiego.

Najczęściej cytowanym wskaźnikiem jest perplexity. GPTZero, detektor skierowany do konsumentów, który pojawił się na początku 2023 roku, nazywa perplexity „miernikiem zaskoczenia”. Modele językowe wybierają najbardziej prawdopodobne kolejne słowo. Przewidywalny tekst o niskim poziomie perplexity czyta się jak wygenerowany maszynowo. Ludzie, zwłaszcza gdy nudzą się lub frustrują w połowie zdania, wpadają na dziwne dobory słów, które potęgują perplexity.

Potem jest jeszcze dynamika. Ludzkie teksty zazwyczaj różnią się znacznie długością zdań i złożonością w obrębie akapitu. Krótki fragment. Potem długie, meandrujące zdanie z trzema zdaniami podrzędnymi. Potem zwięzłe, czterowyrazowe zdanie. Wyniki LLM są bardziej jednolite: zdania grupują się w około 14–22 słowach i tak już pozostają. Detektory mierzą tę zmienność.

Następnie pojawia się częstotliwość n-gramów. Konkretne frazy („zagłębiać się”, „żywy gobelin”, „w dzisiejszym szybko ewoluującym krajobrazie”) pojawiają się znacznie częściej po 2023 roku niż wcześniej. Detektory utrzymują biblioteki wzorców tych sygnałów AI, a większe biblioteki są stale aktualizowane.

I wreszcie, precyzyjnie dostrojony klasyfikator neuronowy. Większość współczesnych narzędzi do wykrywania treści nakłada na statystyki model klasy BERT lub RoBERTa. Te algorytmy uczenia maszynowego zostały zaprojektowane do identyfikowania fragmentów napisanych przez sztuczną inteligencję i napisanych przez ludzi. Są one trenowane na oznaczonych tekstach ludzkich i AI. Wynikiem jest wynik prawdopodobieństwa dla treści wygenerowanych przez AI. GPTZero łączy teraz siedem oddzielnych komponentów: profile stylometryczne, wyszukiwanie w internecie na żywo, analizę struktury zdań. Wzorce długości i złożoności wpływają na wynik.

Niektóre detektory sprawdzają również znaki wodne. SynthID firmy Google osadza sygnał statystyczny w tekście Gemini. Firma OpenAI wewnętrznie zweryfikowała znak wodny dla ChatGPT (Wall Street Journal, sierpień 2024), ale go nie udostępniła. Według ankiety przeprowadzonej wśród użytkowników OpenAI, około 30% z nich stwierdziło, że korzystałoby z produktu rzadziej, gdyby ich dane wyjściowe były oznaczone znakiem wodnym. Znakowanie wodne obrazów jest na dalszym etapie: OpenAI dołączyło do C2PA w maju 2024 roku i teraz domyślnie dołącza dane uwierzytelniające treści do danych wyjściowych DALL-E 3.

Jak działa niewykrywalna sztuczna inteligencja pod maską

Humanizatorzy atakują te same sygnały, które analizują detektory, ale odwrotnie. Każde narzędzie ma na celu cofnięcie tego, co detektor zasygnalizował. Hasło marketingowe zawsze brzmi mniej więcej tak: „niewykrywalna sztuczna inteligencja to zaawansowany program do przepisywania tekstu, który przekształca AI w naturalnie brzmiące teksty”. Dostawcy prześcigają się w twierdzeniu, że należą do najdokładniejszych programów do przepisywania tekstu przez AI lub do najdokładniejszych narzędzi do wykrywania AI, w zależności od tego, po której stronie wyścigu zbrojeń się znajdują.

Typowy proces zaczyna się prosto. Przepuszcza dane wejściowe przez internetowy parafrazer AI. Model jest precyzyjnie dostrojony do ludzkiego pisania. Wywołuje konsternację, wstrzykując nieoczekiwane dobory słów, aby nadać tekstowi humanistyczny charakter. Zmienia strukturę zdań, aby przełamać jednolitość burstiness. Zamienia oznaczone n-gramy na mniej popularne frazy. Dostawcy twierdzą, że ich narzędzie może przekształcić dane wyjściowe AI, aby brzmiały bardziej naturalnie. Twierdzą, że wymykają się one spod kontroli detektorów AI, zachowując jednocześnie swoje pierwotne znaczenie. Czy faktycznie dostarcza wysokiej jakości treści? To bardzo różni się w zależności od produktu. Niektórzy twierdzą, że narzędzie sprawia, że tekst staje się niewykrywalny jednym kliknięciem. Twierdzenie o niemożności wykrycia tekstu i jego oryginalności nie zawsze znajduje odzwierciedlenie w rzeczywistym efekcie.

Uniwersytet Maryland opublikował w 2023 roku najsilniejszą pracę teoretyczną na ten temat. Zespołem kierował Soheil Feizi. Ich preprint „Czy tekst generowany przez sztuczną inteligencję może być niezawodnie wykrywany?” (arXiv:2303.11156) postawił jedno ważne twierdzenie. Lekki neuronowy parafrazer umieszczony na modelu języka obalał każdą metodę wykrywania. Znak wodny. Klasyfikatory neuronowe. Wykrywanie bezbłędne. Wszystkie. Cytat Feiziego w komunikacie prasowym UMD był bezpośredni: „Powinniśmy się po prostu przyzwyczaić do faktu, że nie będziemy w stanie wiarygodnie stwierdzić, czy dokument został napisany przez sztuczną inteligencję, czy przez ludzi”.

Lepsze narzędzia humanizujące idą dalej. Trenują pod kątem konkretnych detektorów. Zespół produktowy pobiera zbiór danych tekstu AI z ChatGPT, przepuszcza go przez Turnitin lub GPTZero i trenuje parafrazę, aby zminimalizować wynik wygenerowany przez detektor. Celem jest, aby tekst AI brzmiał wystarczająco „ludzko”, aby ominąć klasyfikator i przejść detekcję AI. Jest to w zasadzie trening adwersarny w odwrotnej kolejności. Użytkownik otrzymuje jedno z wielu narzędzi do pisania AI zoptymalizowanych pod kątem pokonania jednego konkretnego przeciwnika, a marketingowy przekaz każdego z nich brzmi mniej więcej tak: „niewykrywalna sztuczna inteligencja przepisuje Twój szkic w coś, co nie zostanie wykryte przez narzędzia sprawdzające AI”. Dostawcy twierdzą, że przepisanie sprawia, że treść staje się niewykrywalna i często reklamują, że wynik konsekwentnie przechodzi detekcję AI. To również powód, dla którego wskaźniki pomijania różnią się znacznie między detektorami dla tego samego wyniku działania narzędzia humanizującego. W praktyce niewykrywalna sztuczna inteligencja pomaga obniżyć wynik, ale rzadko go zeruje. Reklamowe zapewnienia, że narzędzie przekształca tekst AI w naturalnie brzmiący tekst ludzki, zazwyczaj przesadzają w kwestii spójności.

Kompromisem jest jakość. Recenzje użytkowników na DitchNet i na Reddicie r/WritingWithAI wielokrotnie zgłaszają tę samą skargę. Humanizatorzy mają tendencję do dodawania wypełniaczy. „Myślę”. „Z mojego doświadczenia”. Takie frazy wciskają się tam, gdzie nie pasują. Połączenia zdań się psują. Niektóre podania spłaszczają przekaz marki. Jeden z recenzentów ocenił wersję darmową na „około 5 na 10 punktów za treści skierowane do odbiorców”. Humanizator może obniżyć wynik detektora z 99% do 50%. Ale jeśli tekst czyta się wtedy dziwnie, zysk jest akademicki.

Rynek: Undetectable.ai, BypassGPT, QuillBot i inne

Liderem rynku jest Undetectable.ai. W tym przypadku sztuczna inteligencja jest narzędziem, a nie tylko usługą. Platforma łączy w sobie niewykrywalny humanizator sztucznej inteligencji, darmowy detektor oraz rozszerzenie do przeglądarki Chrome. Firma została założona w styczniu 2023 roku. Założycielami są: Christian Perry, Devan Leos i Bars Juhasz. Ben Miller dołączył później jako dyrektor operacyjny (COO). Siedziba działu prawnego znajduje się pod adresem 1309 Coffeen Avenue w Sheridan w stanie Wyoming. W komunikatach prasowych wymieniono również siedzibę w Boise w stanie Idaho. Undetectable.ai jest finansowane z własnych środków. Brak ujawnionych informacji o finansowaniu venture capital. Według PR Newswire, do listopada 2024 roku firma osiągnęła 11 milionów użytkowników. To 18 miesięcy od premiery. GetLatka oszacował przychód Undetectable.ai na 3,7 mln USD rocznie we wrześniu 2025 roku. Firma zatrudnia około 34 pracowników. Tracxn zgłosił niepotwierdzoną ofertę fuzji i przejęcia w kwietniu 2025 roku.

Oferta konkurencyjna jest szeroka i zróżnicowana cenowo:

| Narzędzie | Założyciel / rodzic | Plan wejścia | Plan górny | Znaczny |

|---|---|---|---|---|

| Niewykrywalny.ai | Christian Perry | 9,99 USD/mies. | Nieograniczony | 11 mln użytkowników (listopad 2024) |

| StealthGPT | Józef Gherman | 14,99 USD/mies. | 29,99 USD/mies. + dodatek 4,99 USD | Przychody: 2,2 mln USD (grudzień 2023 r.) |

| BypassGPT | HIX.AI | 6,99 USD/mies. | 29,99 USD/mies. | Ograniczony poziom bezpłatny |

| Obejście HIX | HIX.AI | Darmowe 20 kredytów | 49,99 USD/mies. bez ograniczeń | Pozycjonowanie premium |

| QuillBot Humanizer | Learneo (rodzic Course Hero) | 4,17 USD/mies. (rocznie) | — | Ponad 50 milionów użytkowników pakietu QuillBot |

| Phrasly | niezależny | Darmowe 550 słów | 12,99 USD/mies. bez ograniczeń | Roczne rozliczenie |

| Walter pisze o sztucznej inteligencji | niezależny | ~13 USD/mies. (rocznie) | ~25 USD/mies. | Pozycjonowanie premium |

Undetectable.ai pozycjonuje się jako kompleksowe rozwiązanie oferujące zarówno detekcję, jak i humanizację w jednym panelu. Detektor zapewnia 99% dokładności i „100% wykrywalność w recenzowanych badaniach”. Humanizator oferuje wielodetektorową punktację, co oznacza, że testuje wyniki na około ośmiu modelach detektorów jednocześnie, zanim zwróci wynik. Rozszerzenie do przeglądarki Chrome i obsługa 50 języków to prawdziwe wyróżniki.

Liderem kategorii w dziedzinie tworzenia treści opartych na sztucznej inteligencji jest QuillBot, należący do Learneo (firmy macierzystej Course Hero). Z bogatego pakietu narzędzi do pisania QuillBot korzysta ponad 50 milionów osób, a AI Humanizer to jedna z kilkudziesięciu funkcji. Odpowiednik AI Detector w QuillBot obsługuje do 1200 słów na skan za darmo, czyli sześć skanów dziennie. Oba produkty cieszą się popularnością wśród studentów, dlatego właśnie uniwersytety monitorują obecnie korzystanie z QuillBota.

Wartość rynku jest niewielka w porównaniu z jego widocznością. Generatywna sztuczna inteligencja jako całość była warta 59 miliardów dolarów w 2025 roku (Statista). Sam rynek detektorów AI jest znacznie mniejszy. Według MarketsandMarkets, około 0,58 miliarda dolarów w 2025 roku. Przewiduje się, że do 2030 roku osiągnie 2,06 miliarda dolarów. Sektor humanizatorów jest jeszcze mniejszy i bardziej rozdrobniony. Brakuje danych zbiorczych. Szacunki oddolne oparte na ujawnionych przychodach z 30 monitorowanych narzędzi wskazują, że cały sektor generuje od 50 do 150 milionów dolarów rocznych przychodów cyklicznych.

Czy humanizatorzy sztucznej inteligencji rzeczywiście omijają detektory?

Krótka odpowiedź: czasami, w porównaniu z niektórymi detektorami, przy znacznych kosztach jakości.

Dłuższa odpowiedź pochodzi z niezależnych testów. Originality.ai, producent detektorów, przeprowadził kontrolowany eksperyment z humanizatorem Undetectable.ai. Zarówno oryginalny tekst ChatGPT, jak i wersja zhumanizowana uzyskały 100% AI w Originality.ai, z równą pewnością. Writer.com wykazał prawie zerowy ruch (od 6% do 3%). GPTZero spadło ze 100% do 91%. Efekt obejścia był w najlepszym razie marginalny w przypadku najsilniejszych detektorów.

Bardziej szczegółowa recenzja z 2026 r. przeprowadzona w Aithor zaowocowała następującą tabelą, w której wyniki Undetectable.ai zostały przetworzone przez cztery detektory:

| Detektor | Oryginalny wynik AI | Po humanizatorze | Wynik |

|---|---|---|---|

| GPTZero | 97% | 72% | Częściowo pominięte |

| Oryginalność.ai | 99% | 81% | Nie pominięto |

| Copyleaks | Taflowy | Taflowy | Nie pominięto |

| ZeroGPT | 94% | 61% | Częściowo pominięte |

Ten schemat jest spójny we wszystkich recenzjach. ZeroGPT i GPTZero są łatwiejsze do usunięcia. Originality.ai i Copyleaks mają tendencję do utrzymywania się. To nie przypadek. Originality.ai został stworzony specjalnie dla tekstów parafrazowanych w sposób agresywny, a jego wewnętrzne testy porównawcze (opublikowane w artykule Pangrama z stycznia 2026 r. w czasopiśmie JAIT) wykazują około 97% wykrywalności w próbkach parafrazowanych przez QuillBot.

Twierdzenia dostawców dotyczące dokładności rzadko wytrzymują niezależne testy.

| Detektor | Roszczenie sprzedawcy | Niezależne testy |

|---|---|---|

| Turnitin | Dokładność 98%, <1% fałszywie dodatnich wyników | ~85% przypadków przypominania (przyznał to dyrektor ds. produktów w Turnitin); oznaczone jako przypadki generowane przez sztuczną inteligencję – przesadzone |

| Oryginalność.ai | „Lider branży” | Silny w przypadku surowej sztucznej inteligencji, spada w przypadku przeciwników |

| Copyleaks | 99,12% | ~50% na tekst parafrazowany przez QuillBot |

| GPTZero | „Wielowarstwowy 7-składnikowy” | 1-2% wyników fałszywie dodatnich w esejach przed wprowadzeniem sztucznej inteligencji |

| Winston AI | 99,98% | Zmienna: 100% w przypadku wpisu na blogu, 3% w przypadku próbki e-booka |

| Klasyfikator OpenAI | brak danych | 26% osób pamięta produkt po zamknięciu w lipcu 2023 r. |

Żaden detektor nie jest idealny w tych warunkach. Dostawcy, którzy twierdzą inaczej, zazwyczaj publikują wyniki z wąskich testów porównawczych z niewykrywalną treścią generowaną przez sztuczną inteligencję w ramach kontrolowanych komunikatów.

Najbardziej obciążającym przypadkiem jest własny klasyfikator AI firmy OpenAI. Firma uruchomiła go w styczniu 2023 roku, a następnie po cichu zamknęła 20 lipca tego samego roku. Powód: 26% wyników prawdziwie pozytywnych. Sama firma OpenAI przyznała, że model był „niewiarygodny”. Nie opublikowała jeszcze jego następcy. Jej badania dotyczące znakowania wodnego, wewnętrznie zweryfikowane na poziomie 99,9%, zgodnie z raportem WSJ, pozostają nieopublikowane dwa i pół roku później.

Fałszywe alarmy: gdy detektory sztucznej inteligencji wykrywają pismo ludzkie

Najważniejszym wydarzeniem w latach 2024–2026 jest to, że detektory AI zawodzą również w drugą stronę.

James Zou ze Stanford i jego zespół opublikowali artykuł „Detektory GPT są stronnicze wobec pisarzy niebędących rodzimymi użytkownikami języka angielskiego” w czasopiśmie Patterns (lipiec 2023, arXiv:2304.02819). Przeprowadzili oni eseje TOEFL studentów, dla których angielski nie jest językiem ojczystym, przez siedem głównych detektorów. Detektory oznaczyły 61,22% tych esejów jako wygenerowane przez sztuczną inteligencję. Te same detektory oznaczyły prawie zero procent esejów napisanych przez uczniów ósmej klasy urodzonych w USA. Tendencja ta ma prostą przyczynę techniczną. Mniejsza różnorodność leksykalna i prostsza składnia w języku angielskim jako drugim języku wyglądają „jak sztuczna inteligencja” dla osób oceniających za pomocą metody „perplexity”. Szkody są konkretne. Najmocniej odczuwają je studenci zagraniczni właśnie w tych instytucjach, które wdrażają te narzędzia.

Raport Common Sense Media z 2024 roku na temat szkód wyrządzanych przez wykrywanie sztucznej inteligencji poszerzył obraz. Około 10% nastolatków zgłosiło, że zostało fałszywie oskarżonych o korzystanie ze sztucznej inteligencji. Liczba ta wzrosła do 20% wśród nastolatków czarnoskórych, w porównaniu z 7% wśród uczniów białych i 10% wśród uczniów latynoskich. Ten zróżnicowany wpływ odzwierciedla znane uprzedzenia w bazowych modelach językowych, a także reakcję nauczycieli na sygnały odczytywane przez narzędzie.

Najbardziej nagłośnioną katastrofą na wczesnym etapie była katastrofa na uniwersytecie Texas A&M-Commerce w maju 2023 roku. Wykładowca rolnictwa, dr Jared Mumm, wkleił eseje studentów do ChatGPT. Zapytał model, czy to on je napisał. ChatGPT odpowiedział twierdząco na wszystkie pytania. (Jak zawsze było to pomocne). Mumm oblał połowę zajęć. Kilka dni później uniwersytet zmienił zdanie. Studenci korzystali z historii wersji Google Docs, aby udowodnić, że sami napisali eseje. Historię relacjonowały „Washington Post”, „NBC News”, „Rolling Stone” i „Inside Higher Ed”.

Większe uczelnie zaczęły całkowicie wyłączać funkcję wykrywania sztucznej inteligencji w Turnitin. UCLA, UC San Diego, Cal State LA i Vanderbilt – wszystkie te uczelnie ją wyłączyły. Powoływały się na fałszywe alarmy i nierównomierny wpływ na studentów zagranicznych. Sam system California State University wydał 1,1 miliona dolarów na oprogramowanie do wykrywania sztucznej inteligencji w latach 2024-25. Łączne wydatki publicznych systemów w Kalifornii przekroczyły 15 milionów dolarów.

Następnie, w sierpniu 2025 roku, FTC doprowadziła do wycofania się. Workado to podmiot, który zmienił nazwę i był właścicielem narzędzia „AI Content Detector” firmy Content at Scale. Firma reklamowała 98% dokładności. Śledczy FTC odkryli, że rzeczywista dokładność w przypadku treści ogólnego przeznaczenia wynosiła 53%. Model został wytrenowany wyłącznie na prozie akademickiej. W przypadku innych treści jego skuteczność znacznie spadła. Nakaz z 28 sierpnia 2025 roku, wydany za zgodą, zobowiązał Workado do zaprzestania bezpodstawnych twierdzeń. Nakaz zobowiązywał również FTC do wysyłania powiadomień do obecnych klientów. Było to pierwsze działanie egzekucyjne FTC przeciwko dostawcy rozwiązań do wykrywania sztucznej inteligencji za fałszywe reklamy.

Granica etyczna: kiedy tekst sztucznej inteligencji staje się humanizowany, staje się ryzykowny

Większość zastosowań sztucznej inteligencji humanizującej jest legalna. Większość nie jest też oszustwem. To zależy od kontekstu.

Legalne użycie wygląda następująco. Właściciel małej firmy przepuszcza przez narzędzie do humanizacji post na blogu, przygotowany przez ChatGPT. Chce złagodzić korporacyjny ton. Następnie edytuje go przed publikacją. Autor, dla którego angielski nie jest językiem ojczystym, używa narzędzia do humanizacji tak, jak używałby programu do sprawdzania gramatyki. Celem jest dopracowanie fraz bez zmiany znaczenia. Zespół marketingowy parafrazuje wewnętrzny tekst produktu. Żadne z tych działań nie narusza polityki ani umowy. Żadne z nich nie udaje, że praca jest czymś, czym nie jest.

Ryzykowne użycie ma charakter akademicki. Większość uniwersytetów zabrania nieautoryzowanego używania sztucznej inteligencji (AI) w pracach zaliczeniowych. Coraz więcej uczelni zakazuje właśnie stosowania humanizatorów AI. Aktualizacja Turnitina z sierpnia 2025 roku dodała funkcję przeciwdziałającą obejściu, ukierunkowaną na najczęstsze wzorce humanizatorów. Przesyłanie tekstu z humanizowanym AI do zadania wymagającego autorskiego wkładu jest nieuczciwością akademicką. Obowiązuje to w większości regulaminów uczelni. Obowiązuje niezależnie od tego, czy detektor wykryje problem, czy nie. Nieuczciwość to oszustwo dotyczące autorstwa. Obejście to tylko metoda.

Wydawnictwa komercyjne to niejasna kwestia. „New York Times” zerwał współpracę z niezależnym krytykiem Alexem Prestonem w styczniu 2026 roku. Śledztwo wykazało, że w jego recenzjach książek akapity generowane przez sztuczną inteligencję, parafrazując artykuł z „Guardiana”, były generowane przez sztuczną inteligencję. „Washington Post” odnotował podobny incydent w grudniu 2025 roku. Wewnętrzny podcast o sztucznej inteligencji zawierał sfabrykowane cytaty. Śledztwo Semafora ujawniło tę sprawę. Żadna z redakcji nie zakazuje całkowicie wykorzystywania sztucznej inteligencji. Obie zabraniają nieujawnionego wykorzystania sztucznej inteligencji, co do którego odbiorcy zasadnie mogliby się spodziewać, że jest napisane przez ludzi.

Bezpieczniejszy, etyczny przykład wygląda tak. Jeśli odbiorcy zależy na tym, że tekst został stworzony przy pomocy sztucznej inteligencji, należy to ujawnić. Jeśli zadanie zabrania użycia sztucznej inteligencji, nie należy przepuszczać danych wyjściowych przez humanizator, aby ukryć ten fakt. Żadne prawdziwie niewykrywalne narzędzie sztucznej inteligencji nie pomoże uniknąć tego pytania etycznego. Nawet jeśli niewykrywalna sztuczna inteligencja może pomóc w doborze fraz. Jeśli używasz humanizatora, aby brzmieć mniej korporacyjnie lub poprawić frazeologię w drugim języku w swoim szkicu, jesteś bliżej końca spektrum edycji w kontekstach akademickich i zawodowych. Większość zasad ma na ten temat mniej do powiedzenia.

Polityka przesuwa się w kierunku pochodzeniowości, a nie wykrywania. C2PA to skrót od Coalition for Content Provenance and Authenticity (Koalicja na rzecz Pochodzenia Treści i Autentyczności). Osadza kryptograficzne dane uwierzytelniające treści w obrazach i filmach. OpenAI dołączyło do komitetu sterującego w maju 2024 roku. Firma domyślnie dołącza teraz dane uwierzytelniające do danych wyjściowych DALL-E 3. Członkami są Adobe, Microsoft, Google, BBC, NYT i Sony. Specyfikacja C2PA jest przyspieszona i staje się standardem ISO. W przypadku tekstu, równoważne standardy dotyczące znaków wodnych pozostają nierozwiązane na dużą skalę. Dopóki nie zostaną one wprowadzone, wyścig zbrojeń między obejściem a wykrywaniem będzie trwał.