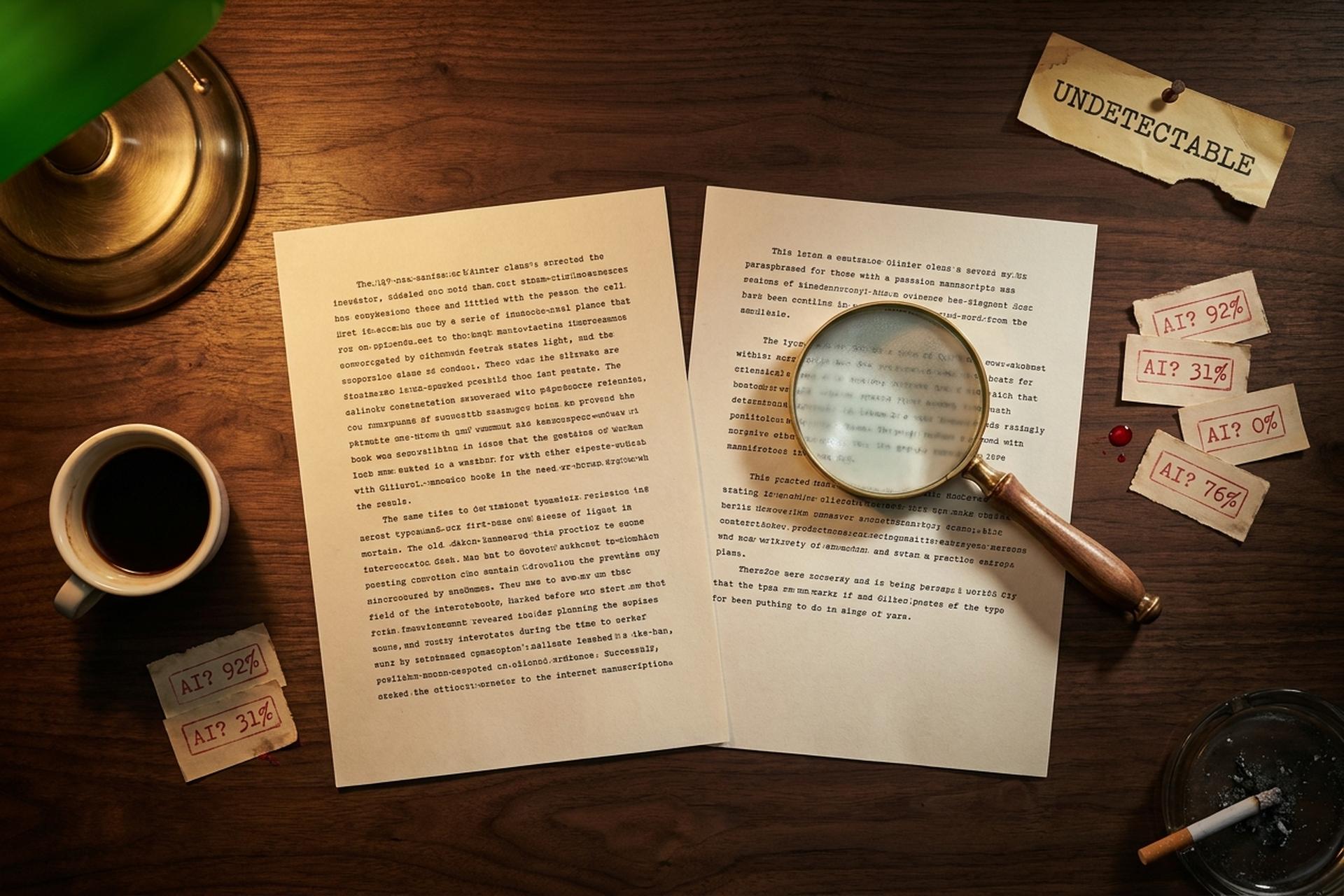

IA indétectable : ChatGPT Humanizer contre outils de détection d’IA

Un professeur soumet la dissertation d'un élève à Turnitin. Le résultat : 92 % générée par l'IA. L'élève jure en être l'auteur. Ils pourraient tous deux avoir raison. Ils pourraient tous deux avoir tort. Bienvenue dans la course effrénée et coûteuse pour savoir qui a réellement écrit quoi que ce soit en ligne en 2026.

L'expression « IA indétectable » est au cœur de ce débat. Elle désigne une catégorie de produits encore restreinte mais en pleine expansion : les humaniseurs d'IA. Ces outils transforment les données générées par ChatGPT ou Gemini. L'objectif ? Empêcher les détecteurs comme Turnitin, GPTZero et Originality.ai de les identifier comme générées par une machine. Plus d'une vingtaine d'entreprises opèrent sur ce marché. La plus importante, Undetectable.ai, revendique 11 millions d'utilisateurs grâce à une équipe autofinancée de 34 personnes. De leur côté, les détecteurs traitent des centaines de millions de soumissions par an. Comme l'a démontré un accord conclu avec la FTC en 2025, les deux camps ont tendance à surestimer les capacités réelles de leurs logiciels. Ce guide explore tous les aspects de ce phénomène : la nature des outils d'IA indétectable ; le fonctionnement des détecteurs ; l'état actuel du marché ; les raisons du succès ou de l'échec de certaines tentatives de contournement ; les scandales de faux positifs qui rendent les tribunaux et les universités sceptiques quant à la détection ; et les limites éthiques faciles à franchir.

Qu’est-ce que l’IA indétectable ? Explication de la catégorie des humaniseurs

L'expression « IA indétectable » désigne un logiciel qui réécrit le contenu généré par l'IA. L'objectif : éviter d'être identifié comme tel par les outils de détection. Ces produits portent différents noms : humaniseurs d'IA, contourneurs d'IA, réécrivains anti-détection. La plupart se présentent comme des outils de contournement pour la rédaction académique et SEO. Ils s'interposent entre vous et les vérificateurs d'IA. Vous collez le texte de ChatGPT dans l'outil, qui le reformule. La nouvelle version est censée passer les outils de détection d'IA comme Turnitin, GPTZero, Copyleaks ou ZeroGPT. Les fournisseurs appellent cela un flux de travail « contournement détecté par l'IA ».

Le secteur a connu une croissance fulgurante en 2023, suite au lancement de ChatGPT qui a rendu la production de textes générés par l'IA extrêmement simple et la détection des modèles d'IA extrêmement facile. En moins d'un an, des dizaines de produits d'humanisation étaient disponibles. La plupart sont de simples paraphraseurs basés sur des modèles de langage open source. Les meilleurs entraînent un humaniseur d'IA indétectable sur des textes humains et sur les failles de certains détecteurs. Les mauvais se contentent de mélanger les synonymes et de découper les phrases.

Les cas d'utilisation mis en avant sont variés. Les créateurs de contenu et les spécialistes du marketing humanisent les brouillons de blogs générés par l'IA afin de préserver le référencement naturel et d'éviter un style robotique. Les rédacteurs non anglophones utilisent un outil d'humanisation IA gratuit pour adoucir leurs formulations et les rendre plus naturelles. Les universitaires (groupe controversé) s'en servent pour dissimuler une utilisation non autorisée de l'IA, parfois à la limite du plagiat. Les équipes de support client y ont parfois recours pour rendre les réponses de l'IA plus humaines et conversationnelles, plus proches du langage naturel. C'est précisément sur la frontière entre correction légitime et tricherie académique que se concentrent les débats, et la question de l'utilisation potentielle d'une IA indétectable dans ces deux contextes est au cœur de la controverse. Les fournisseurs présentent les fonctionnalités de ces outils comme un gain de productivité appréciable, tandis que leurs détracteurs les considèrent comme une infrastructure de tricherie.

| Terme courant | Ce que cela signifie |

|---|---|

| humaniseur IA | Outil qui transforme le texte généré par l'IA en un texte à la sonorité humaine. |

| outil de contournement de détecteur/de contournement d'IA | Même produit, présenté face à des détecteurs |

| Réécriture anti-détection | Même produit, encadré pour le référencement naturel |

| Détecteur d'IA | Outil qui signale les textes générés par l'IA |

| Filigrane | Signal statistique intégré dans la sortie de l'IA |

| Provenance / Références du contenu | Enregistrement cryptographique de la provenance du contenu (C2PA) |

Comment les détecteurs d'IA signalent et réécrivent le texte de ChatGPT

Pour contourner un détecteur, il faut savoir ce qu'il recherche. Les détecteurs d'IA modernes s'appuient sur une poignée de signaux qui permettent de distinguer l'écriture machine de l'écriture humaine.

La perplexité est la mesure la plus souvent citée. GPTZero, le détecteur grand public lancé début 2023, la qualifie de « détecteur de surprise ». Les modèles de langage choisissent le mot suivant le plus probable. Un texte prévisible, à faible perplexité, est perçu comme généré par une machine. Les humains, surtout lorsqu'ils s'ennuient ou sont frustrés en pleine phrase, font des choix de mots étranges qui augmentent la perplexité.

Il y a ensuite la question de la fragmentation. L'écriture humaine tend à varier considérablement en longueur et en complexité des phrases au sein d'un même paragraphe. Un court fragment. Puis une longue phrase sinueuse à trois propositions. Puis une phrase percutante de quatre mots. La production des modèles linéaires à longue portée (LLM) est plus uniforme : les phrases se regroupent autour de 14 à 22 mots et restent ainsi. Les détecteurs mesurent cette variance.

Vient ensuite la fréquence des n-grammes. Des expressions spécifiques (« explorer », « texture vibrante », « dans le paysage actuel en constante évolution ») apparaissent beaucoup plus fréquemment après 2023 qu'auparavant. Les détecteurs gèrent des bibliothèques de modèles de ces indices d'IA, et ces bibliothèques plus importantes sont constamment mises à jour.

Enfin, un classificateur neuronal optimisé. La plupart des outils modernes de détection de contenu intègrent un modèle BERT ou RoBERTa aux statistiques. Ces algorithmes d'apprentissage automatique sont conçus pour distinguer les passages écrits par l'IA de ceux écrits par des humains. Ils sont entraînés sur des textes étiquetés, qu'ils soient écrits par des humains ou par l'IA. Le résultat est un score de probabilité pour le contenu généré par l'IA. GPTZero regroupe désormais sept composants distincts : profils stylométriques, recherche web en temps réel, analyse de la structure des phrases, et prise en compte de la longueur et de la complexité des phrases pour calculer ce score.

Certains détecteurs recherchent également les filigranes. SynthID de Google intègre un signal statistique dans le texte Gemini. OpenAI a validé en interne un filigrane pour ChatGPT (Wall Street Journal, août 2024), mais ne l'a pas encore déployé. Selon une enquête menée par OpenAI auprès de ses utilisateurs, environ 30 % d'entre eux ont déclaré qu'ils utiliseraient moins le produit si leurs résultats étaient filigranés. Le filigranage d'images est plus avancé : OpenAI a rejoint C2PA en mai 2024 et ajoute désormais par défaut des identifiants de contenu aux résultats de DALL-E 3.

Comment l'IA indétectable fonctionne en coulisses

Les outils d'humanisation ciblent les mêmes signaux que les détecteurs, mais en sens inverse. Chaque outil est conçu pour corriger les anomalies détectées. L'argument marketing se résume souvent à une variante d'« IA indétectable : un système de réécriture avancé qui transforme l'IA en un texte naturel ». Les fournisseurs rivalisent d'ingéniosité pour se targuer d'être parmi les systèmes de réécriture ou de détection d'IA les plus performants, selon leur positionnement dans cette course à l'armement.

Un processus classique commence simplement : le texte d'entrée est traité par un outil de reformulation IA en ligne. Le modèle est affiné sur des textes écrits par des humains. Il complexifie le texte en y intégrant des choix de mots inattendus pour le rendre plus humain. Il varie la structure des phrases pour rompre la monotonie et remplace les n-grammes signalés par des formulations moins courantes. Les fournisseurs affirment que leur outil transforme la production de l'IA pour la rendre plus humaine. Ils prétendent qu'il passe inaperçu des détecteurs d'IA tout en conservant le sens original. Mais produit-il réellement un contenu de haute qualité ? Cela varie énormément d'un produit à l'autre. Certains présentent l'outil comme rendant votre texte indétectable en un clic. Cependant, les arguments marketing et l'affirmation d'une écriture indétectable ne sont pas toujours au rendez-vous.

L'Université du Maryland a publié en 2023 l'article théorique le plus convaincant sur le sujet. L'équipe, dirigée par Soheil Feizi, a présenté en prépublication, intitulée « Peut-on détecter de manière fiable un texte généré par l'IA ? » (arXiv:2303.11156), une affirmation majeure : un paraphraseur neuronal léger, intégré à un modèle de langage, déjoue toutes les méthodes de détection. Tatouage numérique. Classificateurs neuronaux. Détection sans exemple. Toutes. Dans le communiqué de presse de l'UMD, Feizi a déclaré sans ambages : « Il faut se faire à l'idée qu'il nous sera impossible de déterminer avec certitude si un document a été écrit par une IA ou par un humain. »

Les outils d'humanisation les plus performants vont plus loin. Ils sont entraînés contre des détecteurs spécifiques. L'équipe produit utilise un ensemble de données de texte généré par IA provenant de ChatGPT, le soumet à Turnitin ou GPTZero, et entraîne le paraphraseur à minimiser le score obtenu par le détecteur. L'objectif est de rendre le texte généré par IA suffisamment humain pour échapper à la classification et réussir la détection par IA. Il s'agit essentiellement d'un entraînement contradictoire inversé. L'utilisateur dispose d'un outil d'écriture IA parmi de nombreux, optimisé pour contrer un adversaire spécifique, et l'argument marketing de chacun repose sur une version simplifiée de l'affirmation suivante : « Une IA indétectable réécrit votre brouillon pour qu'il ne soit pas détecté par les correcteurs IA. » Les fournisseurs affirment que la réécriture rend le contenu indétectable et mettent souvent en avant le fait que le résultat réussit systématiquement la détection par IA. C'est également pourquoi les taux de contournement varient considérablement d'un détecteur à l'autre pour un même résultat d'humanisation. En pratique, l'IA indétectable contribue à réduire le score, mais l'annule rarement. Les arguments marketing selon lesquels l'outil transforme le texte généré par IA en une écriture humaine naturelle exagèrent généralement la constance du résultat.

Le compromis se fait au détriment de la qualité. Les avis des utilisateurs sur DitchNet et le subreddit r/WritingWithAI pointent du doigt le même problème récurrent : les outils d’humanisation ont tendance à insérer des expressions de remplissage. « Je pense », « D’après mon expérience », etc. Ces phrases sont insérées de force, sans cohérence. Les liens entre les phrases sont rompus. Certaines étapes de traitement dénaturent le ton de la marque. Un utilisateur a attribué à la version gratuite la note de « 5/10 environ pour du contenu destiné au grand public ». Un outil d’humanisation peut faire chuter le score de détection de 99 % à 50 %. Mais si le texte reste étrange, le gain est purement théorique.

Le marché : Undetectable.ai, BypassGPT, QuillBot, et bien d’autres.

Le leader du marché est Undetectable.ai. Ici, l'IA est un outil, et non un simple service. La plateforme combine un humaniseur IA indétectable, un détecteur gratuit et une extension Chrome. L'entreprise a été fondée en janvier 2023 par Christian Perry, Devan Leos et Bars Juhasz. Ben Miller a rejoint l'équipe plus tard en tant que directeur des opérations. Son siège social est situé au 1309 Coffeen Avenue à Sheridan, dans le Wyoming. Les communiqués de presse mentionnent également une base à Boise, dans l'Idaho. Undetectable.ai est autofinancée. Aucun financement de capital-risque n'a été divulgué. Selon PR Newswire, l'entreprise a atteint 11 millions d'utilisateurs en novembre 2024, soit 18 mois après son lancement. GetLatka estimait le chiffre d'affaires annuel récurrent d'Undetectable.ai à 3,7 millions de dollars en septembre 2025. L'entreprise comptait environ 34 employés. Tracxn a signalé une offre de fusion-acquisition non confirmée en avril 2025.

L'ensemble concurrentiel est vaste et segmenté en fonction des prix :

| Outil | Fondateur / parent | Plan d'entrée | Plan de pointe | Notable |

|---|---|---|---|---|

| Indétectable.ai | Christian Perry | 9,99 $/mois | Illimité | 11 millions d'utilisateurs (novembre 2024) |

| StealthGPT | Jozef Gherman | 14,99 $/mois | 29,99 $/mois + 4,99 $ de frais supplémentaires | Chiffre d'affaires de 2,2 millions de dollars (décembre 2023) |

| ContournerGPT | HIX.AI | 6,99 $/mois | 29,99 $/mois | Niveau gratuit limité |

| Contournement HIX | HIX.AI | 20 crédits gratuits | 49,99 $/mois illimité | Positionnement premium |

| QuillBot Humanizer | Learneo (société mère de Course Hero) | 4,17 $/mois (annuel) | — | Plus de 50 millions d'utilisateurs sur la suite QuillBot |

| Phrasly | indépendant | 550 mots gratuits | 12,99 $/mois illimité | facturation annuelle |

| Walter écrit sur l'IA | indépendant | ~13 $/mois (annuel) | environ 25 $/mois | Positionnement premium |

Undetectable.ai se positionne comme une solution tout-en-un regroupant détection et humanisation sur une seule et même interface. Son détecteur revendique une précision de 99 % et une détection à 100 % selon des études validées par des pairs. Son outil d'humanisation utilise un système de notation multi-détecteurs, testant simultanément le résultat avec environ huit modèles de détection avant de fournir une conclusion. L'extension Chrome et la prise en charge de 50 langues constituent de véritables atouts.

QuillBot, propriété de Learneo (également maison mère de Course Hero), est le leader du marché des outils de création de contenu par IA. Sa suite logicielle complète est utilisée par plus de 50 millions de personnes, et son module d'humanisation par IA compte parmi ses nombreuses fonctionnalités. Le détecteur de mots intégré à QuillBot permet d'analyser gratuitement jusqu'à 1 200 mots par analyse, six analyses par jour. Ces deux produits sont très appréciés des étudiants, ce qui explique pourquoi les universités surveillent désormais spécifiquement l'utilisation de QuillBot.

Le marché de l'IA générative, malgré sa visibilité, reste modeste. En 2025, il représentait 59 milliards de dollars (Statista). Le marché des détecteurs d'IA est quant à lui bien plus restreint : environ 0,58 milliard de dollars en 2025 (selon MarketsandMarkets), avec des projections à 2,06 milliards de dollars d'ici 2030. Le marché des humaniseurs est encore plus petit et fragmenté, et aucune donnée agrégée n'est disponible. Une estimation ascendante, basée sur les revenus déclarés de 30 outils suivis, situe le chiffre d'affaires annuel récurrent de l'ensemble du secteur entre 50 et 150 millions de dollars.

Les humaniseurs IA parviennent-ils réellement à contourner les détecteurs ?

En bref : parfois, contre certains détecteurs, moyennant un coût de qualité significatif.

Une réponse plus détaillée provient de tests indépendants. Originality.ai, fournisseur de détecteurs, a mené une expérience contrôlée sur l'outil d'humanisation d'Undetectable.ai. Le texte original de ChatGPT et sa version humanisée ont tous deux obtenu un score de 100 % d'IA sur Originality.ai, avec le même niveau de confiance. Writer.com n'a quasiment pas évolué (de 6 % à 3 %). GPTZero a vu son score chuter de 100 % à 91 %. L'effet de contournement était au mieux marginal, même sur les détecteurs les plus performants.

Une analyse plus approfondie réalisée en 2026 par Aithor a produit ce tableau en faisant passer les résultats d'Undetectable.ai à travers quatre détecteurs :

| Détecteur | Score original de l'IA | Après humaniseur | Résultat |

|---|---|---|---|

| GPTZero | 97% | 72% | Contourné partiellement |

| Originalité.ai | 99% | 81% | Non contourné |

| Fuites de copies | Signalé | Signalé | Non contourné |

| ZeroGPT | 94% | 61% | Contourné partiellement |

Ce constat est constant d'une analyse à l'autre. ZeroGPT et GPTZero sont plus faciles à écarter. Originality.ai et Copyleaks ont tendance à bien se maintenir. Ce n'est pas un hasard. Originality.ai est conçu spécifiquement pour la détection de textes paraphrasés par des attaquants, et ses tests internes (publiés dans l'article de Pangram paru dans JAIT en janvier 2026) affichent un taux de détection d'environ 97 % sur des échantillons paraphrasés par QuillBot.

Les affirmations des fournisseurs concernant la précision des informations fournies résistent rarement à des tests indépendants.

| Détecteur | Réclamation du fournisseur | Tests indépendants |

|---|---|---|

| Turnitin | Précision de 98 %, <1 % de faux positifs | Taux de rappel d'environ 85 % (admis par le responsable produit de Turnitin) ; certains cas, générés par l'IA, ont été signalés comme étant surestimés. |

| Originalité.ai | « Leader du secteur » | Fort en IA brute, moins performant en IA adverse |

| Fuites de copies | 99,12% | ~50% sur le texte paraphrasé par QuillBot |

| GPTZero | "Multicouche à 7 composants" | 1 à 2 % de faux positifs sur les dissertations antérieures à l'IA |

| Winston IA | 99,98% | Variable : 100 % sur l’article de blog, 3 % sur l’extrait d’e-book |

| Classificateur OpenAI | n / A | Rappel de 26 % lors de l'arrêt en juillet 2023 |

Aucun détecteur n'est parfait dans ces conditions. Les fournisseurs qui prétendent le contraire publient généralement des résultats issus de tests comparatifs restreints, comparant des contenus indétectables générés par l'IA dans des conditions contrôlées.

Le classificateur d'IA d'OpenAI constitue l'exemple le plus accablant. Lancé en janvier 2023, il a été discrètement abandonné le 20 juillet de la même année. La raison invoquée : un taux de vrais positifs de seulement 26 %. OpenAI a elle-même admis que le modèle était « peu fiable » et n'a pas proposé de remplaçant. Ses recherches sur le tatouage numérique, validées en interne avec une précision de 99,9 % selon le Wall Street Journal, restent inédites deux ans et demi plus tard.

Faux positifs : quand les détecteurs d’IA signalent des erreurs d’écriture humaine

Le plus important, entre 2024 et 2026, c'est que les détecteurs d'IA échouent aussi lamentablement dans l'autre sens.

James Zou et son équipe de Stanford ont publié dans la revue Patterns (juillet 2023, arXiv:2304.02819) un article intitulé « Les détecteurs GPT sont biaisés contre les rédacteurs non natifs d'anglais ». Ils ont analysé des dissertations TOEFL d'étudiants non natifs d'anglais à l'aide de sept détecteurs majeurs. Ces détecteurs ont identifié 61,22 % de ces dissertations comme étant générées par une IA. En revanche, ils n'ont quasiment pas détecté de telles dissertations chez les élèves de 4e (8th grade) nés aux États-Unis. Ce biais s'explique par une raison technique simple : la moindre diversité lexicale et la syntaxe plus simple de l'anglais langue seconde sont perçues comme « semblables à celles de l'IA » par les systèmes d'évaluation basés sur la perplexité. Les conséquences sont concrètes : ce sont les étudiants internationaux, et plus particulièrement ceux des établissements qui utilisent ces outils, qui en subissent les conséquences les plus graves.

Le rapport 2024 de Common Sense Media sur les méfaits de la détection par l'IA a élargi le champ des possibles. Environ 10 % des adolescents interrogés ont déclaré avoir été accusés à tort d'utiliser l'IA. Ce chiffre atteint 20 % chez les adolescents noirs, contre 7 % chez les élèves blancs et 10 % chez les élèves hispaniques. Cet impact disparate s'explique par les biais connus des modèles linguistiques sous-jacents, ainsi que par la manière dont les enseignants réagissent lorsqu'un outil signale un élève.

Le fiasco le plus médiatisé de ces premières années s'est produit à l'université Texas A&M-Commerce en mai 2023. Le professeur d'agriculture, Jared Mumm, a intégré les dissertations de ses étudiants dans ChatGPT. Il a demandé au modèle s'il les avait écrites. ChatGPT a répondu par l'affirmative à chaque fois. (Comme toujours, il s'est avéré utile.) Mumm a alors fait échouer la moitié de la classe. L'université a fait marche arrière quelques jours plus tard. Les étudiants ont utilisé l'historique des versions de Google Docs pour prouver qu'ils avaient bien écrit les dissertations. Le Washington Post, NBC News, Rolling Stone et Inside Higher Ed ont tous couvert l'affaire.

Les grandes universités ont commencé à désactiver purement et simplement la fonction de détection par IA de Turnitin. UCLA, UC San Diego, Cal State LA et Vanderbilt l'ont toutes désactivée. Elles ont invoqué des faux positifs et un impact disproportionné sur les étudiants internationaux. Le système des universités d'État de Californie a dépensé à lui seul 1,1 million de dollars en logiciels de détection par IA en 2024-2025. Les dépenses totales du système public californien ont dépassé les 15 millions de dollars.

En août 2025, la FTC a sévi. Workado, anciennement connue sous le nom de Content at Scale, était propriétaire du « Détecteur de contenu par IA ». L'entreprise annonçait une précision de 98 %. Les enquêteurs de la FTC ont constaté que la précision réelle sur du contenu général n'était que de 53 %. Le modèle avait été entraîné uniquement sur des textes académiques et ses performances se dégradaient fortement avec tout autre type de contenu. L'ordonnance de consentement du 28 août 2025 a contraint Workado à cesser ces allégations non fondées. Elle imposait également l'envoi d'avis rédigés par la FTC aux clients existants. Il s'agissait de la première action coercitive de la FTC contre un fournisseur de détection par IA pour publicité mensongère.

La limite éthique : quand l’humanisation des textes par l’IA devient-elle risquée ?

La plupart des utilisations d'un humaniseur IA sont légales. La plupart ne constituent pas non plus de la triche. Cela dépend du contexte.

Voici un exemple d'utilisation légitime : un propriétaire de petite entreprise soumet un article de blog rédigé avec ChatGPT à un outil d'humanisation. Il souhaite atténuer le ton trop institutionnel, puis le corrige avant publication. Un rédacteur non anglophone utilise un tel outil comme un correcteur grammatical. L'objectif est d'affiner la formulation sans en altérer le sens. Une équipe marketing paraphrase les textes internes relatifs à un produit. Aucun de ces cas ne contrevient à une politique ou à un contrat. Aucun ne prétend que le travail est autre chose que ce qu'il est.

L'utilisation risquée est d'ordre académique. La plupart des universités interdisent l'utilisation non autorisée de l'IA dans les travaux universitaires. Un nombre croissant d'entre elles interdisent désormais spécifiquement les outils d'humanisation de texte par IA. La mise à jour d'août 2025 de Turnitin a ajouté une fonctionnalité de contournement visant les schémas d'humanisation les plus courants. Soumettre un texte humanisé par IA dans un devoir exigeant un travail original constitue une fraude académique. Cela est valable selon la plupart des politiques institutionnelles. Cela reste valable, que le détecteur vous repère ou non. La fraude réside dans la tromperie concernant la paternité du travail. Le contournement n'est que la méthode.

L'édition commerciale se situe dans une zone grise. Le New York Times a rompu ses liens avec le critique indépendant Alex Preston en janvier 2026. Une enquête a révélé la présence de paragraphes générés par IA dans ses critiques de livres, paraphrasés d'un article du Guardian. Le Washington Post a connu un incident similaire en décembre 2025. Un podcast interne, alimenté par IA, diffusait des citations fabriquées de toutes pièces. L'enquête de Semafor a révélé l'affaire. Aucune de ces rédactions n'interdit totalement l'utilisation de l'IA. Toutes deux interdisent toutefois toute utilisation non divulguée de l'IA dont le public pourrait raisonnablement s'attendre à ce que les textes soient écrits par des humains.

Une approche éthique plus sûre se présente ainsi : si le public est susceptible de se soucier de l’utilisation de l’IA dans le texte, il convient de le signaler. Si le sujet interdit l’utilisation de l’IA, il est inutile de recourir à un outil d’humanisation pour masquer son utilisation. Aucun outil d’IA véritablement indétectable ne permet d’éviter cette question éthique, même si une IA indétectable peut améliorer la formulation. Si vous utilisez un outil d’humanisation pour adopter un style moins institutionnel ou corriger des formulations maladroites dans votre brouillon, vous vous rapprochez davantage du rôle de correcteur dans les contextes académiques et professionnels. La plupart des politiques sont moins strictes à ce sujet.

L'orientation politique évolue vers la vérification de la provenance plutôt que la détection. C2PA (Coalition pour la provenance et l'authenticité du contenu) intègre des identifiants cryptographiques dans les images et les vidéos. OpenAI a rejoint son comité de pilotage en mai 2024 et associe désormais systématiquement ces identifiants aux sorties DALL-E 3. Adobe, Microsoft, Google, la BBC, le New York Times et Sony en sont membres. La spécification C2PA est en cours d'adoption accélérée en tant que norme ISO. Pour le texte, les normes de tatouage numérique équivalentes restent à définir à grande échelle. En attendant leur déploiement, la course entre contournement et détection se poursuit.