الذكاء الاصطناعي غير القابل للكشف: مُحَوِّل ChatGPT البشري مقابل أدوات كشف الذكاء الاصطناعي

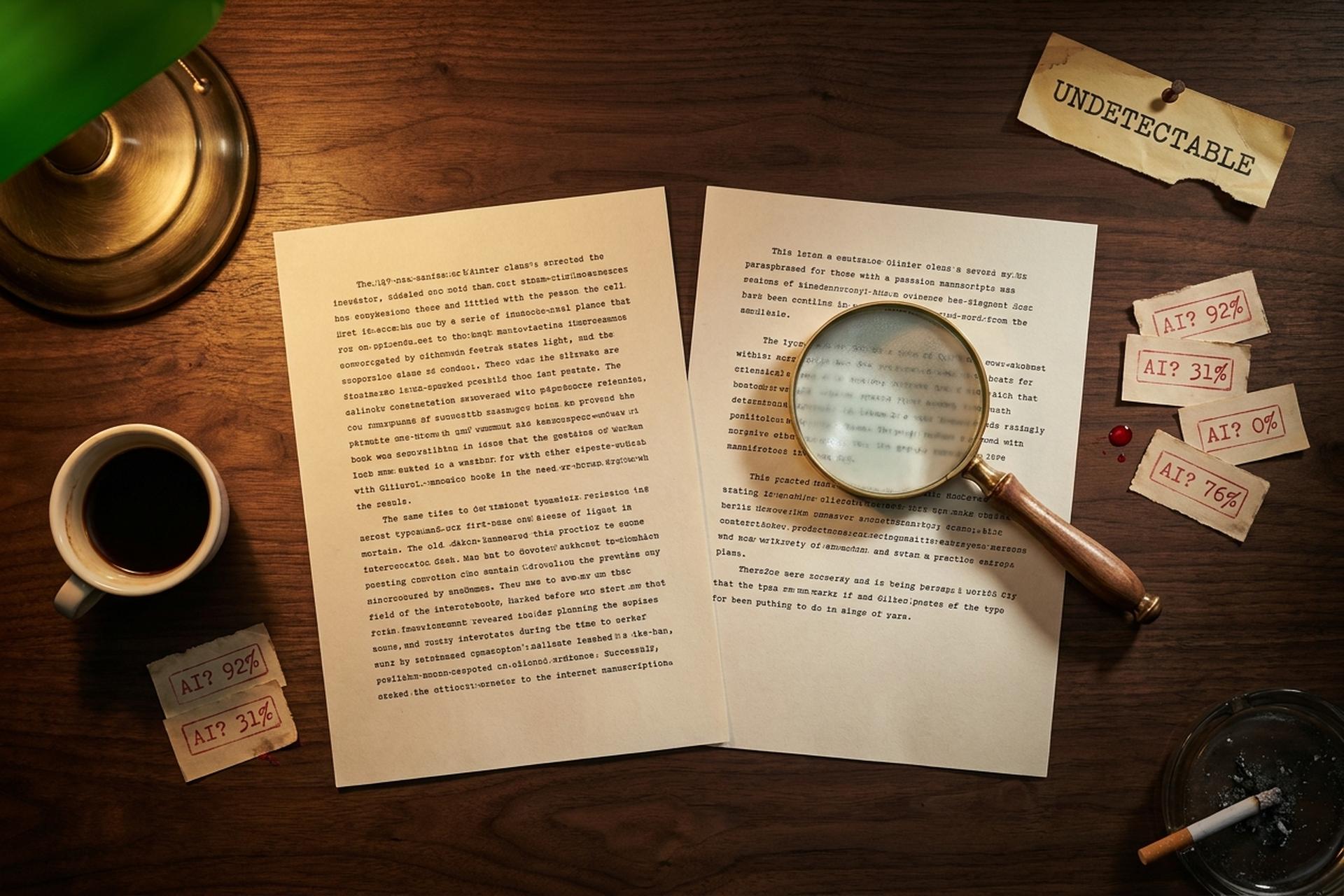

يُلصق مُعلّم مقالًا لأحد طلابه في برنامج Turnitin. فتظهر النتيجة: 92% مُولّد بواسطة الذكاء الاصطناعي. يُقسم الطالب أنه هو من كتبه. قد يكون كلاهما على صواب، وقد يكون كلاهما على خطأ. مرحبًا بكم في سباق التسلح المُعقد الذي تبلغ قيمته مليارات الدولارات حول من كتب أي شيء على الإنترنت في عام 2026.

تُشكّل عبارة "الذكاء الاصطناعي غير القابل للكشف" محور هذا الصراع. وهي تشير إلى فئة صغيرة ولكنها سريعة النمو من المنتجات تُعرف باسم "مُحسِّنات الذكاء الاصطناعي للنصوص البشرية". تقوم هذه الأدوات بمعالجة مُخرجات ChatGPT أو Gemini وإعادة كتابتها. والهدف هو منع برامج الكشف مثل Turnitin وGPTZero وOriginality.ai من تصنيفها على أنها مكتوبة آليًا. تعمل أكثر من عشرين شركة في هذا المجال. وتدّعي العلامة التجارية الأكبر، Undetectable.ai، وجود 11 مليون مستخدم ضمن فريق مُكوّن من 34 شخصًا فقط. في المقابل، تُعالج برامج الكشف مئات الملايين من المُدخلات سنويًا. وكما أظهرت تسوية لجنة التجارة الفيدرالية عام 2025، فإن كلا الطرفين يُبالغ في وصف قدرات برامجهما. يُقدّم هذا الدليل شرحًا مُفصّلًا لكل جانب من جوانب هذه العملية: ما هي أدوات الذكاء الاصطناعي غير القابلة للكشف؟ كيف تعمل برامج الكشف؟ وضع السوق الحالي؟ لماذا تنجح بعض محاولات التجاوز بينما تفشل أخرى؟ فضائح النتائج الإيجابية الخاطئة التي تُثير شكوك المحاكم والجامعات حول الكشف؟ والخط الأخلاقي الذي يسهل تجاوزه؟

ما هو الذكاء الاصطناعي غير القابل للكشف؟ شرح فئة الذكاء الاصطناعي المُؤنسن

"الذكاء الاصطناعي غير القابل للكشف" هو اختصار لبرنامج يُعيد صياغة المحتوى المُنشأ بواسطة الذكاء الاصطناعي. الهدف: منع أدوات الكشف من تصنيفه كذكاء اصطناعي. تُعرف هذه المنتجات بأسماء مختلفة، منها: مُحسِّنات الذكاء الاصطناعي، ومُتجاوزات الذكاء الاصطناعي، ومُعيدات الصياغة المضادة للكشف. يُسوَّق معظمها كأداة لتجاوز أدوات الكشف في الكتابة الأكاديمية وكتابة المحتوى المُحسَّن لمحركات البحث. تعمل هذه البرامج كوسيط بينك وبين أدوات فحص الذكاء الاصطناعي. تقوم بلصق النص من ChatGPT في البرنامج، ثم يُعيد المُحسِّن صياغته بأسلوبه الخاص. من المفترض أن يتجاوز الإصدار الجديد أدوات الكشف عن الذكاء الاصطناعي مثل Turnitin وGPTZero وCopyleaks وZeroGPT. يُطلق البائعون على هذه العملية اسم "آلية التجاوز والكشف بواسطة الذكاء الاصطناعي".

شهد هذا المجال نموًا هائلًا في عام 2023، بعد أن سهّل إطلاق ChatGPT إنتاج الكتابة المولدة بالذكاء الاصطناعي، ووفر نماذج الكشف عنها. وفي غضون عام، ظهرت عشرات المنتجات التي تُحاكي اللغة البشرية. معظمها عبارة عن طبقات إعادة صياغة بسيطة مبنية على نماذج لغوية مفتوحة المصدر. تُدرّب المنتجات الجيدة منها مُحاكيًا بشريًا للذكاء الاصطناعي، يصعب اكتشافه، على النصوص البشرية وعلى نقاط ضعف أدوات الكشف. أما المنتجات الرديئة، فتكتفي بإعادة ترتيب المرادفات وتقسيم الجمل.

تتنوع استخدامات الذكاء الاصطناعي المُعلن عنها. يستخدم مُنشئو المحتوى والمسوقون هذه التقنية لإضفاء طابع إنساني على مسودات المدونات المُولّدة بالذكاء الاصطناعي، وذلك للحفاظ على حركة المرور من محركات البحث دون أن تبدو الكتابة آلية. كما يستخدمها الكتّاب غير الناطقين بالإنجليزية لتعديل مسوداتهم باستخدام برامج الذكاء الاصطناعي المجانية، مما يُضفي عليها طابعًا إنسانيًا أكثر سلاسة وطبيعية. أما الأكاديميون (وهم الفئة الأكثر جدلًا)، فيستخدمونها لإخفاء استخدام الذكاء الاصطناعي غير المصرح به، والذي قد يصل أحيانًا إلى حدّ الانتحال. وتستخدمها فرق دعم العملاء أحيانًا لتحويل مخرجات الذكاء الاصطناعي إلى لغة أقرب إلى اللغة البشرية وأكثر سلاسة، وكأنها كلام بشري حقيقي. يكمن جوهر الجدل الدائر حول سياسات الذكاء الاصطناعي في الخط الفاصل بين التحرير المشروع والغش الأكاديمي، وكيفية استخدام الذكاء الاصطناعي غير القابل للكشف في كلا السياقين. يُسوّق البائعون ميزات أدوات الذكاء الاصطناعي غير القابلة للكشف على أنها أدوات إنتاجية بسيطة، بينما يراها النقاد بنية تحتية للغش.

| مصطلح شائع | ماذا يعني ذلك؟ |

|---|---|

| مُحوِّل الذكاء الاصطناعي للشخصيات | أداة تعيد كتابة نصوص الذكاء الاصطناعي لتبدو وكأنها نصوص بشرية |

| أداة تجاوز الذكاء الاصطناعي / أداة تجاوز الكاشف | نفس المنتج، مُقارنةً بأجهزة الكشف |

| إعادة كتابة مضادة للكشف | نفس المنتج، مُؤطَّر للاستخدام في تحسين محركات البحث |

| كاشف الذكاء الاصطناعي | أداة لتحديد النصوص التي تم إنشاؤها بواسطة الذكاء الاصطناعي |

| العلامة المائية | إشارة إحصائية مضمنة في مخرجات الذكاء الاصطناعي |

| بيانات المصدر / بيانات اعتماد المحتوى | سجل تشفيري يوضح مصدر المحتوى (C2PA) |

كيف تقوم أجهزة الكشف بالذكاء الاصطناعي بتحديد وإعادة كتابة نص ChatGPT

لتجاوز جهاز الكشف، عليك أن تعرف ما يبحث عنه. تعتمد أجهزة الكشف الحديثة التي تعمل بالذكاء الاصطناعي على عدد قليل من الإشارات التي تميل إلى التمييز بين الكتابة الآلية والكتابة البشرية.

يُعدّ مصطلح "الحيرة" الأكثر شيوعًا. يُطلق برنامج GPTZero، وهو أداة كشف الغموض الموجهة للمستهلكين والتي أُطلقت في أوائل عام 2023، على الحيرة اسم "مقياس المفاجأة". تختار نماذج اللغة الكلمة التالية الأكثر احتمالًا. يبدو النص المتوقع ذو الحيرة المنخفضة وكأنه مُولّد آليًا. أما البشر، وخاصةً عندما يشعرون بالملل أو الإحباط في منتصف الجملة، فيُقحمون كلمات غريبة تزيد من الحيرة.

ثمّة تباينٌ ملحوظ. يميل أسلوب الكتابة البشرية إلى التفاوت الكبير في طول الجملة وتعقيدها ضمن الفقرة الواحدة. جملة قصيرة، ثم جملة طويلة متعرجة بثلاث عبارات فرعية، ثم جملة موجزة من أربع كلمات. أما مخرجات نماذج اللغة واللغة فهي أكثر تجانسًا: إذ تتجمع الجمل حول 14 إلى 22 كلمة وتبقى على هذا النحو. وتقيس أجهزة الكشف هذا التباين.

يأتي تكرار نماذج الكلمات (N-gram) في المرتبة التالية. تظهر عبارات محددة ("التعمق في"، "نسيج نابض بالحياة"، "في المشهد سريع التطور اليوم") بشكل متكرر بعد عام 2023 أكثر مما كانت عليه قبل ذلك. تحتفظ أجهزة الكشف بمكتبات أنماط لهذه الإشارات التي تستنتجها تقنيات الذكاء الاصطناعي، ويتم تحديث المكتبات الأكبر حجماً باستمرار.

وأخيرًا، مُصنِّف عصبي مُحسَّن. تعتمد معظم أدوات الكشف عن المحتوى الحديثة على نموذج BERT أو RoBERTa بالإضافة إلى الإحصائيات. صُمِّمت خوارزميات التعلّم الآلي هذه للتمييز بين النصوص المكتوبة بواسطة الذكاء الاصطناعي والنصوص البشرية. يتم تدريبها على نصوص بشرية ونصوص مُصنَّفة بواسطة الذكاء الاصطناعي. والناتج هو درجة احتمالية للمحتوى المُولَّد بواسطة الذكاء الاصطناعي. يجمع GPTZero الآن سبعة مكونات منفصلة: ملفات تعريف أسلوبية، وبحث مباشر على الويب، وتحليل بنية الجملة. تُؤخذ أنماط الطول والتعقيد في الاعتبار عند حساب الدرجة.

تبحث بعض أدوات الكشف أيضًا عن العلامات المائية. يقوم نظام SynthID من جوجل بتضمين إشارة إحصائية في نص Gemini. وقد تحققت OpenAI داخليًا من صحة علامة مائية لـ ChatGPT (صحيفة وول ستريت جورنال، أغسطس 2024) لكنها لم تُصدرها رسميًا. ووفقًا لاستطلاع رأي المستخدمين الذي أجرته OpenAI، قال حوالي 30% من مستخدمي ChatGPT إنهم سيقللون من استخدام المنتج إذا كانت مخرجاتهم تحمل علامة مائية. أما بالنسبة للعلامات المائية على الصور، فقد قطعت OpenAI شوطًا أطول: انضمت إلى C2PA في مايو 2024، وتقوم الآن بإرفاق بيانات اعتماد المحتوى بمخرجات DALL-E 3 افتراضيًا.

كيف يعمل الذكاء الاصطناعي غير القابل للكشف من الداخل

تُهاجم برامج إعادة صياغة الذكاء الاصطناعي نفس الإشارات التي ترصدها برامج الكشف، ولكن بطريقة معكوسة. صُممت كل أداة منها لإلغاء ما رصده برنامج الكشف. وتتمحور الحملة التسويقية دائمًا حول فكرة أن "الذكاء الاصطناعي غير القابل للكشف هو برنامج متطور لإعادة صياغة الذكاء الاصطناعي وتحويله إلى كتابة تبدو طبيعية". ويتنافس البائعون على الادعاء بأنهم من بين أكثر برامج إعادة صياغة الذكاء الاصطناعي دقة، أو من بين أكثر أدوات الكشف عن الذكاء الاصطناعي دقة، وذلك بحسب موقفهم في سباق التسلح هذا.

تبدأ عملية معالجة النصوص عادةً ببساطة. يتم تمرير النص المدخل عبر مُعيد صياغة آلي يعمل بالذكاء الاصطناعي. يُضبط النموذج بدقة على الكتابة البشرية، ويُضيف عنصر التشويق من خلال إدخال كلمات غير متوقعة لإضفاء طابع إنساني على النص. كما يُغير بنية الجمل لكسر نمط التكرار والتكرار. ويستبدل الكلمات المُصنفة بعبارات أقل شيوعًا. يدّعي البائعون أن أدواتهم قادرة على تحويل مخرجات الذكاء الاصطناعي لتصبح أقرب إلى اللغة البشرية، وأنها تتجاوز أنظمة كشف الذكاء الاصطناعي مع الحفاظ على المعنى الأصلي. ولكن هل تُقدم هذه الأدوات محتوى عالي الجودة فعلاً؟ يختلف ذلك اختلافًا كبيرًا بين المنتجات. فبعضها يُسوّق للأداة على أنها تجعل النص غير قابل للكشف بنقرة واحدة. إلا أن الادعاءات التسويقية حول عدم قابلية النص للكشف لا تتطابق دائمًا مع النتائج الفعلية.

نشرت جامعة ميريلاند أقوى ورقة بحثية نظرية في هذا المجال عام 2023، بقيادة سهيل فيزي. وقدّمت ورقتهم البحثية الأولية بعنوان "هل يمكن الكشف عن النصوص المولدة بالذكاء الاصطناعي بشكل موثوق؟" (arXiv:2303.11156) ادعاءً هامًا: أن استخدام مُعيد صياغة عصبي خفيف الوزن، مُدمج مع نموذج لغوي، يتغلب على جميع طرق الكشف، بما في ذلك العلامات المائية، والمصنفات العصبية، والكشف بدون تدريب. وقد صرّح فيزي في بيان صحفي صادر عن جامعة ميريلاند قائلاً: "علينا أن نعتاد على حقيقة أننا لن نتمكن من تحديد ما إذا كانت الوثيقة مكتوبة بواسطة الذكاء الاصطناعي أم بواسطة البشر بشكل موثوق."

تتجاوز برامج تحويل النصوص إلى لغة بشرية مستوى التوقعات. فهي تُدرَّب على مواجهة أنظمة كشف محددة. يقوم فريق المنتج بأخذ مجموعة بيانات من نصوص الذكاء الاصطناعي من ChatGPT، ثم يُمرِّرها عبر Turnitin أو GPTZero، ويُدرِّب برنامج إعادة الصياغة لتقليل أي نتيجة يُنتجها نظام الكشف. الهدف هو جعل نص الذكاء الاصطناعي يبدو بشريًا بما يكفي لتجاوز نظام التصنيف واجتياز كشف الذكاء الاصطناعي. هذا في جوهره تدريبٌ تنافسي معكوس. يحصل المستخدم على إحدى أدوات كتابة الذكاء الاصطناعي العديدة المُحسَّنة للتغلب على منافس محدد، ويتمحور التسويق لكل أداة حول فكرة "ذكاء اصطناعي غير قابل للكشف يُعيد كتابة مسودتك إلى شيء لا يمكن اكتشافه بواسطة مدققي الذكاء الاصطناعي". يقول البائعون إن إعادة الكتابة تجعل المحتوى غير قابل للكشف، وغالبًا ما يُعلنون أن النتيجة تجتاز كشف الذكاء الاصطناعي باستمرار. وهذا أيضًا سبب اختلاف معدلات التجاوز بشكل كبير بين أنظمة الكشف لنفس مُخرَج برنامج تحويل النصوص إلى لغة بشرية. عمليًا، يُساعد الذكاء الاصطناعي غير القابل للكشف في تقليل النتيجة، ولكنه نادرًا ما يُصفِّرها تمامًا. عادةً ما تُبالغ ادعاءات التسويق بأن الأداة تُحوِّل نص الذكاء الاصطناعي إلى كتابة بشرية طبيعية في تقدير مدى اتساقها.

المقايضة تكمن في الجودة. تشير تقييمات المستخدمين على DitchNet ومنتدى r/WritingWithAI على Reddit إلى الشكوى نفسها مرارًا وتكرارًا. تميل برامج تحويل النص إلى لغة بشرية إلى إقحام عبارات زائدة. "أعتقد." "من واقع خبرتي." تُحشر عبارات كهذه في غير موضعها. تنقطع الروابط بين الجمل. بعض التعديلات تُضعف نبرة العلامة التجارية. قيّم أحد المراجعين مخرجات النسخة المجانية "بحوالي 5 من 10 للمحتوى الموجه للجمهور". يمكن لبرنامج تحويل النص إلى لغة بشرية أن يخفض درجة الكشف من 99% إلى 50%. ولكن إذا بدت الكتابة غريبة بعد ذلك، فإن الفائدة ستكون نظرية فقط.

السوق: Undetectable.ai، BypassGPT، QuillBot، وغيرها

تتصدر شركة Undetectable.ai السوق، حيث يُستخدم الذكاء الاصطناعي كأداة وليس مجرد خدمة. تجمع منصتها بين مُحوِّل ذكاء اصطناعي غير قابل للكشف، وكاشف مجاني، وإضافة لمتصفح كروم. تأسست الشركة في يناير 2023 على يد المؤسسين: كريستيان بيري، وديفان ليوس، وبارس جوهاس. انضم بن ميلر لاحقًا بمنصب الرئيس التنفيذي للعمليات. يقع المقر القانوني للشركة في 1309 شارع كوفين في شيريدان، وايومنغ. وتشير البيانات الصحفية أيضًا إلى وجود مقر لها في بويز، أيداهو. تعتمد Undetectable.ai على التمويل الذاتي، ولم يُفصح عن أي تمويل استثماري. ووفقًا لـ PR Newswire، وصل عدد مستخدمي الشركة إلى 11 مليون مستخدم بحلول نوفمبر 2024، أي بعد 18 شهرًا من إطلاقها. وقدّرت GetLatka إيرادات Undetectable.ai السنوية المتكررة بـ 3.7 مليون دولار في سبتمبر 2025، ويعمل بها حوالي 34 موظفًا. وأشارت Tracxn إلى عرض استحواذ غير مؤكد في أبريل 2025.

تتميز المجموعة التنافسية باتساعها وتنوعها السعري:

| أداة | المؤسس / الوالد | مخطط المدخل | الخطة الرئيسية | جدير بالذكر |

|---|---|---|---|---|

| Undetectable.ai | كريستيان بيري | 9.99 دولار شهرياً | غير محدود | 11 مليون مستخدم (نوفمبر 2024) |

| StealthGPT | جوزيف جيرمان | 14.99 دولارًا شهريًا | 29.99 دولارًا شهريًا + 4.99 دولارًا رسوم إضافية | إيرادات بقيمة 2.2 مليون دولار (ديسمبر 2023) |

| تجاوز GPT | HIX.AI | 6.99 دولار شهرياً | 29.99 دولارًا شهريًا | مستوى مجاني محدود |

| تجاوز HIX | HIX.AI | 20 رصيدًا مجانيًا | 49.99 دولارًا أمريكيًا شهريًا، اشتراك غير محدود | موقع متميز |

| مُحَوِّلُ كويلبوت البشري | Learneo (الشركة الأم لـ Course Hero) | 4.17 دولار شهرياً (سنوياً) | — | أكثر من 50 مليون مستخدم عبر مجموعة QuillBot |

| فراسلي | مستقل | 550 كلمة مجانية | 12.99 دولارًا شهريًا غير محدود | الفواتير السنوية |

| والتر يكتب برامج الذكاء الاصطناعي | مستقل | حوالي 13 دولارًا شهريًا (سنويًا) | حوالي 25 دولارًا شهريًا | موقع متميز |

يُقدّم موقع Undetectable.ai نفسه كمنصة شاملة تجمع بين الكشف عن البرامج الضارة وإضفاء الطابع الإنساني عليها في لوحة تحكم واحدة. ويدّعي كاشفه دقة تصل إلى 99%، و"كشفًا بنسبة 100% في دراسات مُحكّمة". أما مُحسِّنه الإنساني، فيعتمد على تقييم متعدد للكاشفات، ما يعني اختبار النتائج على ثمانية نماذج كاشفات أو نحو ذلك في آنٍ واحد قبل عرضها. ويُعدّ امتداد Chrome ودعم 50 لغة من أبرز مزاياه.

يُعدّ QuillBot، المملوك لشركة Learneo (الشركة الأم لـ Course Hero)، البرنامج الرائد في مجال إنشاء المحتوى المدعوم بالذكاء الاصطناعي. يستخدم أكثر من 50 مليون شخص مجموعة أدوات الكتابة الشاملة من QuillBot، وتُعدّ ميزة "المساعدة البشرية بالذكاء الاصطناعي" إحدى عشرات الميزات المتوفرة. يدعم برنامج "كاشف الذكاء الاصطناعي" المدمج في QuillBot ما يصل إلى 1200 كلمة لكل مسح ضوئي مجانًا، بمعدل ست عمليات مسح ضوئي يوميًا. يحظى كلا المنتجين بشعبية واسعة بين الطلاب، وهذا تحديدًا ما يدفع الجامعات إلى مراقبة استخدام QuillBot بشكل خاص.

حجم السوق صغير نسبيًا مقارنةً بحجمه الحقيقي. بلغ حجم سوق الذكاء الاصطناعي التوليدي ككل 59 مليار دولار أمريكي في عام 2025 (بحسب Statista). أما سوق كاشفات الذكاء الاصطناعي وحده فهو أصغر بكثير، إذ يُقدّر بنحو 0.58 مليار دولار أمريكي في عام 2025 وفقًا لـ MarketsandMarkets، ومن المتوقع أن يصل إلى 2.06 مليار دولار أمريكي بحلول عام 2030. أما سوق تقنيات تحسين الصور البشرية فهو أصغر حجمًا وأكثر تشتتًا، ولا توجد بيانات إجمالية عنه. تشير تقديرات مبنية على الإيرادات المعلنة من 30 أداة مُتتبعة إلى أن حجم القطاع بأكمله يتراوح بين 50 و150 مليون دولار أمريكي من الإيرادات السنوية المتكررة.

هل تتجاوز برامج تحويل الذكاء الاصطناعي إلى بشرية أجهزة الكشف بالفعل؟

باختصار: أحيانًا، في مواجهة بعض أجهزة الكشف، مع تكلفة جودة كبيرة.

تأتي الإجابة المطولة من اختبارات مستقلة. أجرت شركة Originality.ai، وهي نفسها شركة متخصصة في كشف النصوص، تجربة مضبوطة على برنامج Undetectable.ai لتحويل النص إلى نص بشري. حقق كل من نص ChatGPT الأصلي والنسخة البشرية منه نسبة 100% في اختبار الذكاء الاصطناعي على Originality.ai، وبثقة متساوية. لم يُظهر موقع Writer.com أي تغيير يُذكر (من 6% إلى 3%). أما GPTZero، فقد انخفضت نسبته من 100% إلى 91%. وكان تأثير التجاوز هامشيًا في أحسن الأحوال حتى على أقوى برامج الكشف.

أظهرت مراجعة أكثر شمولاً أجريت عام 2026 في شركة Aithor هذا الجدول الذي يعرض مخرجات Undetectable.ai من خلال أربعة كاشفات:

| كاشف | النتيجة الأصلية للذكاء الاصطناعي | بعد عملية تحويل الصورة إلى صورة بشرية | نتيجة |

|---|---|---|---|

| جي بي تي زيرو | 97% | 72% | تم تجاوزها جزئياً |

| Originality.ai | 99% | 81% | لم يتم تجاوزها |

| كوبيليكس | تم الإبلاغ عنه | تم الإبلاغ عنه | لم يتم تجاوزها |

| ZeroGPT | 94% | 61% | تم تجاوزها جزئياً |

يتكرر هذا النمط في جميع المراجعات. يسهل حذف ZeroGPT وGPTZero، بينما يميل Originality.ai وCopyleaks إلى البقاء. ليس هذا من قبيل الصدفة، فـ Originality.ai مصمم خصيصًا للنصوص المعاد صياغتها من قبل جهات معادية، وتُظهر معاييره الداخلية (المنشورة في ورقة بحثية لشركة Pangram في يناير 2026 في مؤتمر JAIT) دقة كشف تصل إلى 97% تقريبًا على عينات معاد صياغتها بواسطة QuillBot.

نادراً ما تصمد ادعاءات البائعين بشأن دقة المعلومات أمام الاختبارات المستقلة.

| كاشف | مطالبة البائع | اختبار مستقل |

|---|---|---|

| برنامج Turnitin | دقة 98%، نسبة إيجابية خاطئة أقل من 1% | نسبة استرجاع البيانات حوالي 85% (أقر بذلك مسؤول منتجات Turnitin نفسه)؛ تم تصنيف الحالات على أنها حالات مُبالغ فيها تم إنشاؤها بواسطة الذكاء الاصطناعي. |

| Originality.ai | "رائد في الصناعة" | قوي في الذكاء الاصطناعي الخام، لكنه ضعيف في الذكاء الاصطناعي المعادي |

| كوبيليكس | 99.12% | حوالي 50% على نص معاد صياغته بواسطة QuillBot |

| جي بي تي زيرو | "متعدد الطبقات ذو 7 مكونات" | نسبة 1-2% من النتائج الإيجابية الخاطئة في المقالات التي سبقت استخدام الذكاء الاصطناعي |

| وينستون للذكاء الاصطناعي | 99.98% | المتغير: 100% على منشور المدونة، 3% على عينة الكتاب الإلكتروني |

| مصنف OpenAI | غير متوفر | 26% من عمليات الاستدعاء تمت عند إغلاقها في يوليو 2023 |

لا يوجد جهاز كشف مثالي في جميع هذه الظروف. أما البائعون الذين يدّعون خلاف ذلك، فغالباً ما ينشرون نتائج من معايير قياس ضيقة النطاق مقابل محتوى غير قابل للكشف تم إنشاؤه بواسطة الذكاء الاصطناعي تحت ظروف تحكم محددة.

يُعدّ مُصنِّف الذكاء الاصطناعي الخاص بشركة OpenAI المثال الأبرز على ذلك. فقد أطلقته الشركة في يناير 2023، ثم أوقفته بهدوء في 20 يوليو من العام نفسه. والسبب: نسبة إيجابية صحيحة بلغت 26% فقط. وقد اعترفت OpenAI نفسها بأن النموذج "غير موثوق". ولم تُصدر الشركة بديلاً له. أما بحثها حول العلامات المائية، الذي تم التحقق من صحته داخليًا بدقة 99.9% وفقًا لتقرير صحيفة وول ستريت جورنال، فلا يزال غير منشور بعد عامين ونصف.

النتائج الإيجابية الخاطئة: عندما ترصد أجهزة الكشف بالذكاء الاصطناعي الكتابة البشرية

القصة الأهم في الفترة من 2024 إلى 2026 هي أن أجهزة الكشف بالذكاء الاصطناعي تفشل فشلاً ذريعاً في الاتجاه الآخر أيضاً.

نشر جيمس زو وفريقه من جامعة ستانفورد بحثًا بعنوان "كاشفات GPT متحيزة ضد الكتّاب غير الناطقين باللغة الإنجليزية" في مجلة Patterns (يوليو 2023، arXiv:2304.02819). أجرى الباحثون تحليلًا لمقالات اختبار TOEFL لطلاب غير ناطقين باللغة الإنجليزية باستخدام سبعة من أبرز كاشفات GPT. صنّفت هذه الكاشفات 61.22% من تلك المقالات على أنها مُولّدة بواسطة الذكاء الاصطناعي. في المقابل، صنّفت الكاشفات نفسها نسبة تقارب الصفر من المقالات التي كتبها طلاب الصف الثامن المولودون في الولايات المتحدة. يرجع هذا التحيز إلى سبب تقني بسيط، وهو أن انخفاض التنوع المعجمي وبساطة التركيب النحوي في اللغة الإنجليزية كلغة ثانية تبدو "شبيهة بالذكاء الاصطناعي" بالنسبة لأنظمة التقييم القائمة على مقياس التعقيد. والضرر ملموس، إذ يقع أشدّ وطأته على الطلاب الدوليين في المؤسسات التعليمية التي تستخدم هذه الأدوات.

وسّع تقرير مؤسسة "كومن سينس ميديا" لعام 2024 حول أضرار أنظمة الكشف بالذكاء الاصطناعي نطاق المشكلة. فقد أفاد نحو 10% من المراهقين عمومًا بتعرضهم لاتهامات كاذبة باستخدام الذكاء الاصطناعي. وارتفعت هذه النسبة إلى 20% بين المراهقين السود، مقابل 7% بين الطلاب البيض و10% بين الطلاب اللاتينيين. ويعكس هذا التفاوت في التأثير التحيز المعروف في نماذج اللغة المستخدمة، فضلًا عن كيفية تعامل المعلمين عندما تُشير إحدى الأدوات إلى استخدام الطالب للذكاء الاصطناعي.

كانت الكارثة الأبرز في وقت مبكر من العام هي جامعة تكساس إيه آند إم كوميرس في مايو 2023. قام أستاذ الزراعة، الدكتور جاريد موم، بنسخ مقالات الطلاب ولصقها في برنامج ChatGPT، وسأل البرنامج عما إذا كان هو من كتبها. أجاب البرنامج بالإيجاب على جميعها (وكان مفيدًا كعادته). بعد ذلك، رسب موم نصف الطلاب. تراجعت الجامعة عن قرارها بعد أيام. استخدم الطلاب سجل إصدارات مستندات جوجل لإثبات أنهم هم من كتبوا المقالات. غطت صحيفة واشنطن بوست، وشبكة إن بي سي نيوز، ومجلة رولينج ستون، وموقع Inside Higher Ed القصة.

بدأت المؤسسات التعليمية الكبرى بتعطيل خاصية الكشف بالذكاء الاصطناعي في برنامج Turnitin بشكل كامل. فقد قامت جامعات كاليفورنيا في لوس أنجلوس، وسان دييغو، وولاية كاليفورنيا في لوس أنجلوس، وفاندربيلت بتعطيلها، مُعللة ذلك بظهور نتائج إيجابية خاطئة وتأثيرها غير المتناسب على الطلاب الدوليين. أنفق نظام جامعة ولاية كاليفورنيا وحده 1.1 مليون دولار على برامج الكشف بالذكاء الاصطناعي في العام الدراسي 2024-2025، بينما تجاوز إجمالي إنفاق أنظمة التعليم العامة في كاليفورنيا 15 مليون دولار.

ثم في أغسطس 2025، اتخذت لجنة التجارة الفيدرالية إجراءً حاسمًا. شركة Workado هي الكيان الذي تم تغيير اسمه والذي كان يمتلك "كاشف المحتوى المدعوم بالذكاء الاصطناعي" التابع لشركة Content at Scale. كانت الشركة قد روّجت لدقة تصل إلى 98%. لكن محققي لجنة التجارة الفيدرالية وجدوا أن الدقة الفعلية على المحتوى العام بلغت 53% فقط. تم تدريب النموذج على النصوص الأكاديمية فقط، وتراجعت دقته بشكل كبير على أي محتوى آخر. أمر الموافقة الصادر في 28 أغسطس 2025 ألزم Workado بالتوقف عن الادعاءات غير المدعومة. كما ألزم الأمر بإرسال إشعارات صاغتها لجنة التجارة الفيدرالية إلى العملاء الحاليين. كان هذا أول إجراء إنفاذي تتخذه لجنة التجارة الفيدرالية ضد بائع لتقنية كشف المحتوى المدعوم بالذكاء الاصطناعي بسبب الإعلان المضلل.

الخط الأخلاقي: عندما يصبح إضفاء الطابع الإنساني على نصوص الذكاء الاصطناعي أمراً محفوفاً بالمخاطر

معظم استخدامات برامج الذكاء الاصطناعي لإضفاء الطابع البشري على الشخصيات قانونية، ومعظمها لا يُعد غشاً أيضاً. الأمر يعتمد على السياق.

الاستخدام المشروع يبدو كالتالي: يقوم صاحب مشروع صغير بمعالجة منشور مدونة مكتوب بواسطة ChatGPT من خلال أداة تحويل النص إلى نص بشري. يريد تخفيف حدة اللهجة الرسمية. ثم يقوم بتحريره قبل النشر. يستخدم كاتب غير ناطق بالإنجليزية أداة تحويل النص إلى نص بشري كما لو كان يستخدم مدققًا نحويًا. الهدف هو تحسين الصياغة دون تغيير المعنى. يقوم فريق تسويق بإعادة صياغة محتوى المنتج الداخلي. لا يخالف أي من هذه الأمثلة سياسة أو عقدًا. ولا يدّعي أي منها أن العمل شيء آخر.

الاستخدام المحفوف بالمخاطر هو استخدام أكاديمي. تحظر معظم الجامعات استخدام الذكاء الاصطناعي غير المصرح به في المقررات الدراسية. ويحظر عدد متزايد منها الآن استخدام برامج تحويل النصوص إلى نصوص بشرية باستخدام الذكاء الاصطناعي تحديدًا. أضاف تحديث Turnitin في أغسطس 2025 ميزة مضادة للتحايل تستهدف أكثر أنماط تحويل النصوص إلى نصوص بشرية شيوعًا. يُعدّ تقديم نص مُحوَّل إلى نصوص بشرية باستخدام الذكاء الاصطناعي في مهمة تتطلب عملًا أصليًا غشًا أكاديميًا. وينطبق هذا على معظم السياسات المؤسسية، سواء اكتشف النظام ذلك أم لا. يكمن الغش في التضليل بشأن هوية المؤلف، أما التحايل فهو مجرد أسلوب.

النشر التجاري هو المجال الأكثر غموضًا. قطعت صحيفة نيويورك تايمز علاقتها بالناقد المستقل أليكس بريستون في يناير 2026. وكشف تحقيقٌ عن وجود فقرات مُولّدة بواسطة الذكاء الاصطناعي في مراجعاته للكتب، مُعاد صياغتها من مقالٍ في صحيفة الغارديان. وشهدت صحيفة واشنطن بوست حادثةً مماثلة في ديسمبر 2025، حيثُ نشرت خاصية بودكاست داخلية تعتمد على الذكاء الاصطناعي اقتباساتٍ مُلفّقة. وكشف تحقيقٌ أجرته مؤسسة سيمافور عن هذه القصة. لا تحظر أيٌّ من المؤسستين استخدام الذكاء الاصطناعي بشكلٍ كامل، بل تحظران استخدامه غير المُعلن الذي يتوقع الجمهور منطقيًا أن يكون مكتوبًا بواسطة إنسان.

يبدو الوضع الأخلاقي الافتراضي الأكثر أمانًا على النحو التالي: إذا كان الجمهور سيهتم بمعرفة أن النص قد تمت صياغته بمساعدة الذكاء الاصطناعي، فأفصح عن ذلك. إذا كانت المهمة تمنع استخدام الذكاء الاصطناعي، فلا تُمرر الناتج عبر مُحسِّن اللغة البشرية لإخفاء هذه الحقيقة. لا توجد أداة ذكاء اصطناعي غير قابلة للكشف تمامًا تُساعدك على تجنب هذه المسألة الأخلاقية. حتى عندما يُمكن للذكاء الاصطناعي غير القابل للكشف أن يُساعد في الصياغة. إذا كنت تستخدم مُحسِّن اللغة البشرية لجعل النص يبدو أقل رسمية أو لتصحيح صياغة اللغة الثانية في مسودتك، فأنت أقرب إلى جانب التحرير في السياقات الأكاديمية والمهنية. معظم السياسات لا تُغطي هذا الجانب بشكل كافٍ.

يتجه التوجه السياسي نحو التركيز على إثبات مصدر المحتوى بدلاً من كشفه. يرمز C2PA إلى "تحالف إثبات مصدر المحتوى ومصداقيته"، وهو يدمج بيانات اعتماد المحتوى المشفرة في الصور والفيديوهات. انضمت OpenAI إلى اللجنة التوجيهية في مايو 2024، وتقوم الشركة الآن بإرفاق بيانات الاعتماد افتراضياً بمخرجات DALL-E 3. تضم اللجنة أعضاءً من Adobe وMicrosoft وGoogle وBBC وNYT وSony. ويجري تسريع اعتماد مواصفات C2PA كمعيار ISO. أما بالنسبة للنصوص، فلا تزال معايير العلامات المائية المكافئة غير متوفرة على نطاق واسع. وحتى يتم طرحها، يستمر التنافس بين تقنيات التجاوز والكشف.