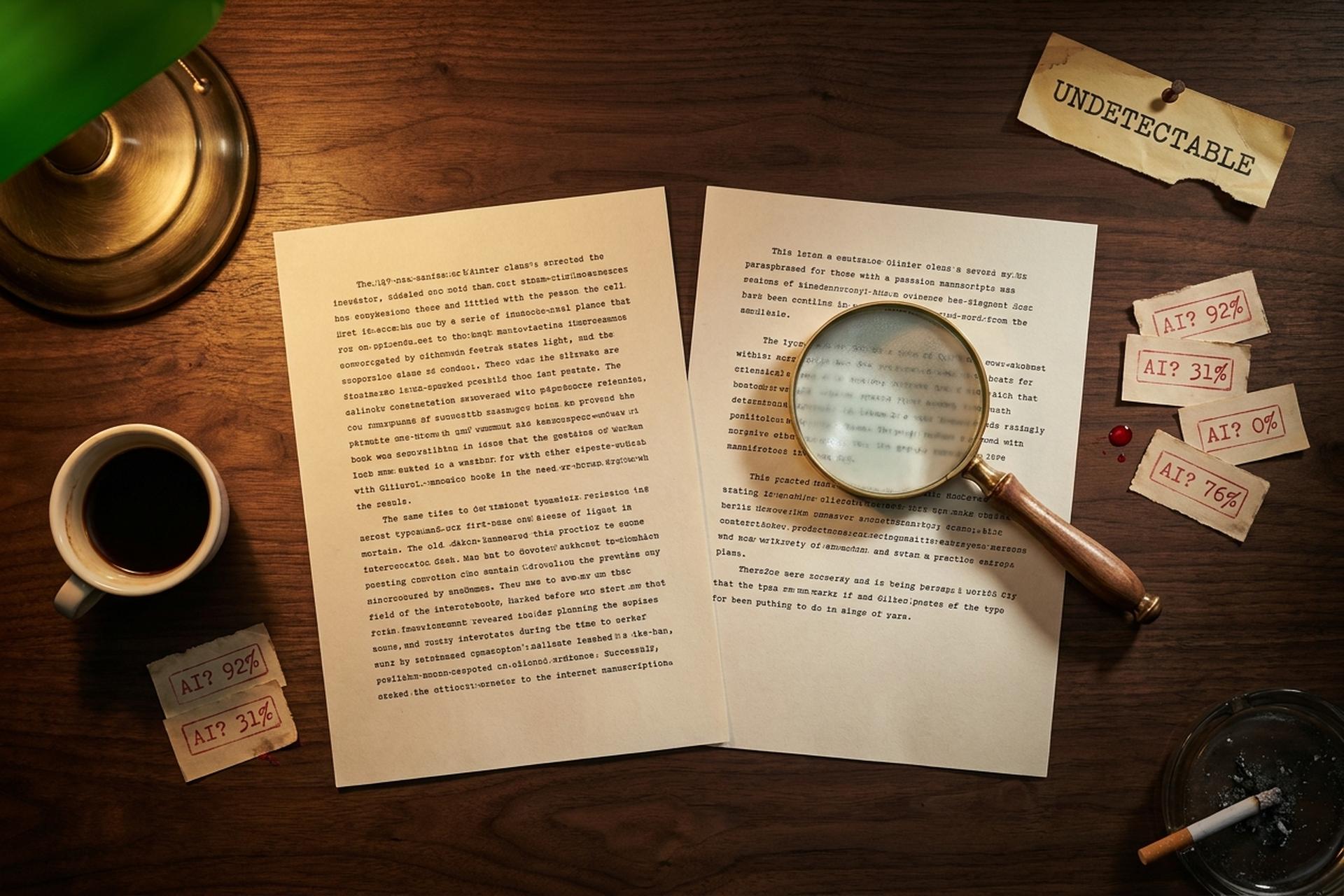

IA indetectable: ChatGPT Humanizer frente a las herramientas de detección de IA

Un profesor introduce el ensayo de un alumno en Turnitin. El resultado: 92 % generado por IA. El alumno jura que lo escribió él. Ambos podrían tener razón. Ambos podrían estar equivocados. Bienvenidos a la caótica carrera armamentística multimillonaria sobre quién escribió realmente algo en internet en 2026.

La palabra clave "IA indetectable" se encuentra en el centro de esta disputa. Se refiere a una categoría pequeña pero de rápido crecimiento de productos llamados humanizadores de IA. Estas herramientas toman la salida de ChatGPT o Gemini y la reescriben. El objetivo es lograr que detectores como Turnitin, GPTZero y Originality.ai dejen de marcarla como escrita por máquina. Más de veinte empresas operan en este sector. La marca más grande, Undetectable.ai, afirma tener 11 millones de usuarios en un equipo autofinanciado de 34 personas. Los detectores, por otro lado, procesan cientos de millones de envíos al año. Como demostró un acuerdo de la FTC en 2025, ambas partes tienen la costumbre de exagerar las capacidades reales de su software. Esta guía analiza cada aspecto: qué son las herramientas de IA indetectable, cómo funcionan los detectores, el mercado actual, por qué algunos intentos de eludir la detección tienen éxito y otros fracasan, los escándalos de falsos positivos que generan escepticismo en tribunales y universidades, y la línea ética que es fácil cruzar.

¿Qué es la IA indetectable? Explicación de la categoría de humanizadores.

"IA indetectable" es una forma abreviada de referirse a un software que reescribe contenido generado por IA. El objetivo: evitar que las herramientas de detección lo detecten como IA. Estos productos reciben varios nombres: humanizadores de IA, eludidores de IA, reescritores anti-detección. La mayoría se promocionan como herramientas para eludir la detección en la redacción académica y SEO. Se interponen entre el usuario y los verificadores de IA. Se pega el texto de ChatGPT en la herramienta y el humanizador lo parafrasea. Se supone que la nueva versión supera las herramientas de detección de IA como Turnitin, GPTZero, Copyleaks o ZeroGPT. Los proveedores lo denominan flujo de trabajo de elusión de detección por IA.

Esta categoría experimentó un auge en 2023, tras el lanzamiento de ChatGPT, que simplificó enormemente la producción de texto generado por IA y la búsqueda de modelos de detección de IA. En menos de un año, ya existían docenas de productos humanizadores. La mayoría son capas de parafraseo sencillas, construidas sobre modelos de lenguaje de código abierto. Los mejores entrenan un humanizador de IA indetectable con texto humano y con los fallos de detectores específicos. Los peores simplemente reordenan sinónimos y fragmentan las frases.

Los casos de uso que se anuncian son muy variados. Los creadores de contenido y los especialistas en marketing humanizan los borradores de blogs generados por IA para mantener el tráfico SEO de los motores de búsqueda sin que el estilo de escritura suene robótico. Los escritores no nativos de inglés procesan sus borradores con un humanizador de IA gratuito para suavizar la redacción y lograr una escritura más natural. Los usuarios académicos (el grupo controvertido) los utilizan para disimular el uso no autorizado de IA, a veces rozando el plagio. Los equipos de atención al cliente a veces los utilizan para convertir la salida de la IA en algo más humano y conversacional, como algo que una persona diría en la vida real. La línea que separa la edición legítima del fraude académico es precisamente donde se concentran la mayoría de los debates sobre políticas, y cómo se podría utilizar la IA indetectable en ambos contextos es el núcleo de la controversia. Los proveedores presentan las características de las herramientas de IA indetectables como productividad aburrida, mientras que los críticos las ven como infraestructura para hacer trampa.

| término común | Qué significa |

|---|---|

| Humanizador de IA | Herramienta que reescribe texto de IA para que suene humano. |

| Herramienta para eludir la IA / detector | El mismo producto, enmarcado frente a detectores. |

| Reescritor anti-detección | El mismo producto, adaptado para SEO. |

| detector de IA | Herramienta que detecta texto generado por IA |

| Filigrana | Señal estadística integrada en la salida de la IA |

| Procedencia / Credenciales de contenido | Registro criptográfico del origen del contenido (C2PA) |

Cómo los detectores de IA marcan y reescriben el texto de ChatGPT

Para sortear un detector, hay que saber qué busca. Los detectores de IA modernos se basan en un conjunto de señales que tienden a diferenciar la escritura de máquinas de la escritura humana.

La perplejidad es el concepto más citado. GPTZero, el detector para el consumidor lanzado a principios de 2023, la denomina su "medidor de sorpresa". Los modelos lingüísticos eligen la palabra más probable a continuación. Un texto predecible y de baja perplejidad se lee como generado por máquina. Los humanos, especialmente cuando se aburren o se frustran a mitad de una frase, recurren a elecciones de palabras extrañas que aumentan la perplejidad.

Luego está la fragmentación. La escritura humana tiende a variar mucho en longitud y complejidad de las oraciones dentro de un párrafo. Un fragmento corto. Luego una oración larga y sinuosa con tres cláusulas. Luego una oración concisa de cuatro palabras. La salida de LLM es más uniforme: las oraciones se agrupan alrededor de 14 a 22 palabras y se mantienen así. Los detectores miden esa varianza.

A continuación, se analiza la frecuencia de los N-gramas. Ciertas frases ("profundizar", "tapiz vibrante", "en el panorama actual en rápida evolución") aparecen con mucha más frecuencia después de 2023 que antes. Los detectores mantienen bibliotecas de patrones de estas señales de IA, y las bibliotecas más grandes se actualizan constantemente.

Y, por último, un clasificador neuronal optimizado. La mayoría de las herramientas modernas de detección de contenido incorporan un modelo BERT o RoBERTa sobre las estadísticas. Estos algoritmos de aprendizaje automático están diseñados para identificar pasajes escritos por IA frente a pasajes escritos por humanos. Se entrenan con texto etiquetado, tanto humano como de IA. El resultado es una puntuación de probabilidad para el contenido generado por IA. GPTZero ahora integra siete componentes distintos: perfiles estilométricos, búsqueda web en tiempo real y análisis de la estructura de las oraciones. Los patrones de longitud y complejidad se incorporan a la puntuación.

Algunos detectores también buscan marcas de agua. SynthID de Google inserta una señal estadística en el texto de Gemini. OpenAI ha validado internamente una marca de agua para ChatGPT (Wall Street Journal, agosto de 2024), pero aún no la ha lanzado. Según una encuesta de usuarios de OpenAI, alrededor del 30 % de los usuarios de ChatGPT afirmaron que usarían menos el producto si su salida tuviera una marca de agua. La implementación de marcas de agua en imágenes está más avanzada: OpenAI se unió a C2PA en mayo de 2024 y ahora adjunta credenciales de contenido a las salidas de DALL-E 3 de forma predeterminada.

Cómo funciona la IA indetectable entre bastidores

Los humanizadores atacan las mismas señales que los detectores, pero a la inversa. Cada herramienta está diseñada para deshacer lo que el detector señaló. El argumento de marketing siempre es alguna variante de "una IA indetectable es un reescritor avanzado que convierte la IA en escritura de sonido natural". Los proveedores compiten por afirmar que se encuentran entre los reescritores de IA más precisos o las herramientas de detección de IA más precisas, según en qué lado de la carrera armamentística se encuentren.

Un proceso típico comienza de forma sencilla. Se procesa la entrada a través de un parafrasista de IA en línea. El modelo se ajusta con textos escritos por humanos. Aumenta la complejidad insertando palabras inesperadas para humanizar el texto. Varía la estructura de las oraciones para romper la uniformidad de la estructura. Reemplaza los n-gramas marcados por frases menos comunes. Los proveedores afirman que su herramienta puede transformar la salida de la IA para que suene más humana. Afirman que pasa desapercibida para los detectores de IA mientras mantiene su significado original. ¿Realmente ofrece contenido de alta calidad? Eso varía enormemente entre productos. Algunos promocionan la herramienta como capaz de hacer que tu texto sea indetectable con un solo clic. La publicidad y la afirmación de que la escritura es indetectable no siempre se corresponden con el resultado real.

La Universidad de Maryland publicó en 2023 el artículo teórico más sólido sobre este tema. El equipo, liderado por Soheil Feizi, presentó su preimpresión titulada "¿Se puede detectar de forma fiable el texto generado por IA?" (arXiv:2303.11156). Esta afirmación era contundente: un parafrasador neuronal ligero, integrado en un modelo de lenguaje, superaba a todos los métodos de detección. Marcas de agua, clasificadores neuronales, detección de cero disparos... todos ellos. La declaración de Feizi en el comunicado de prensa de la UMD fue directa: "Debemos acostumbrarnos a la idea de que no podremos determinar con certeza si un documento fue escrito por IA o por humanos".

Los mejores humanizadores van más allá. Se entrenan contra detectores específicos. El equipo de producto toma un conjunto de datos de texto de IA de ChatGPT, lo procesa con Turnitin o GPTZero y entrena al parafrasador para minimizar la puntuación que produce el detector. El objetivo es que el texto de IA suene lo suficientemente humano como para eludir el clasificador y pasar la detección de IA. Esto es esencialmente un entrenamiento adversario a la inversa. El usuario obtiene una de las muchas herramientas de escritura de IA optimizadas para vencer a un oponente específico, y el argumento de marketing de cada una es alguna versión de "la IA indetectable reescribe tu borrador en algo que no será detectado por los verificadores de IA". Los proveedores dicen que la reescritura hace que el contenido sea indetectable y a menudo anuncian que el resultado pasa la detección de IA de manera consistente. También es la razón por la que las tasas de elusión difieren enormemente entre los detectores para la misma salida del humanizador. En la práctica, la IA indetectable ayuda a reducir la puntuación, pero rara vez la elimina por completo. Las afirmaciones de marketing de que la herramienta transforma el texto de IA en escritura humana de sonido natural generalmente exageran la consistencia.

La contrapartida es la calidad. Las reseñas de usuarios en DitchNet y en r/WritingWithAI de Reddit señalan la misma queja una y otra vez. Los humanizadores tienden a insertar relleno. "Creo que." "Según mi experiencia." Frases como esas se insertan donde no encajan. Se rompen las conexiones entre las oraciones. Algunas pasadas aplanan la voz de la marca. Un crítico calificó el resultado del nivel gratuito con "aproximadamente 5 de 10 para contenido dirigido al público". Un humanizador puede reducir la puntuación del detector del 99% al 50%. Pero si la escritura luego se lee extraña, la ganancia es teórica.

El mercado: Undetectable.ai, BypassGPT, QuillBot y más.

El líder del mercado es Undetectable.ai. Aquí, la IA es una herramienta, no solo un servicio. La plataforma combina un humanizador de IA indetectable, un detector gratuito y una extensión de Chrome. La empresa se fundó en enero de 2023. Fundadores: Christian Perry, Devan Leos y Bars Juhasz. Ben Miller se unió más tarde como director de operaciones. La sede legal está en 1309 Coffeen Avenue en Sheridan, Wyoming. Los comunicados de prensa también mencionan una base en Boise, Idaho. Undetectable.ai se autofinancia. No se ha revelado financiación de capital riesgo. Según PR Newswire, la empresa alcanzó los 11 millones de usuarios en noviembre de 2024. Eso es 18 meses después de su lanzamiento. GetLatka estimó los ingresos recurrentes anuales de Undetectable.ai en 3,7 millones de dólares en septiembre de 2025. Alrededor de 34 empleados. Tracxn señaló una oferta de fusión y adquisición no confirmada en abril de 2025.

El panorama competitivo es amplio y está segmentado por precios:

| Herramienta | Fundador/padre | Plan de entrada | Plan superior | Notable |

|---|---|---|---|---|

| Indetectable.ai | Christian Perry | $9.99/mes | Ilimitado | 11 millones de usuarios (noviembre de 2024) |

| StealthGPT | Jozef Gherman | $14.99/mes | $29.99/mes + $4.99 adicionales | Ingresos de 2,2 millones de dólares (diciembre de 2023) |

| BypassGPT | HIX.AI | $6.99/mes | $29.99/mes | Nivel gratuito limitado |

| Bypass HIX | HIX.AI | 20 créditos gratis | $49.99/mes ilimitado | Posicionamiento premium |

| Humanizador QuillBot | Learneo (empresa matriz de Course Hero) | $4.17/mes (anual) | — | Más de 50 millones de usuarios en toda la suite QuillBot. |

| Frases | independiente | 550 palabras gratis | $12.99/mes ilimitado | facturación anual |

| Walter escribe sobre IA | independiente | ~$13/mes (anual) | ~$25/mes | Posicionamiento premium |

Undetectable.ai se presenta como una solución integral que ofrece detección y humanización en un mismo panel de control. Su detector afirma tener una precisión del 99 % y una detección del 100 % en estudios revisados por pares. Su humanizador ofrece una puntuación multidetector, lo que significa que prueba la salida con aproximadamente ocho modelos de detección simultáneamente antes de ofrecer un resultado. La extensión para Chrome y la cobertura en 50 idiomas son factores diferenciadores clave.

El líder del sector en la creación de contenido con IA es QuillBot, propiedad de Learneo (la misma empresa matriz de Course Hero). Su completo conjunto de herramientas de escritura es utilizado por más de 50 millones de personas, y la función AI Humanizer es solo una de sus muchas características. La función AI Detector, también integrada en QuillBot, admite hasta 1200 palabras por escaneo de forma gratuita, con seis escaneos al día. Ambos productos son populares entre los estudiantes, razón por la cual las universidades ahora monitorizan específicamente el uso de QuillBot.

El mercado de IA generativa es pequeño en relación con su visibilidad. En 2025, representaba una categoría de 59 mil millones de dólares (Statista). El mercado de detectores de IA es mucho menor. Según MarketsandMarkets, alcanzó aproximadamente 0,58 mil millones de dólares en 2025, con una proyección de 2,06 mil millones de dólares para 2030. El sector de humanización es aún más pequeño y fragmentado. No existe una cifra agregada. Una estimación ascendente basada en los ingresos declarados de 30 herramientas analizadas sitúa a todo el sector entre 50 y 150 millones de dólares en ingresos recurrentes anuales.

¿Los humanizadores de IA realmente evaden los detectores?

La respuesta corta: a veces, contra algunos detectores, con un coste de calidad significativo.

La respuesta más detallada proviene de pruebas independientes. Originality.ai, proveedor de detectores, realizó un experimento controlado con el humanizador de Undetectable.ai. Tanto el texto original de ChatGPT como la versión humanizada obtuvieron una puntuación del 100 % en Originality.ai, con la misma confianza. Writer.com apenas mostró cambios (del 6 % al 3 %). GPTZero bajó del 100 % al 91 %. El efecto de evasión fue mínimo en los detectores más potentes.

Una revisión más exhaustiva realizada en Aithor en 2026 produjo esta tabla que muestra el resultado de Undetectable.ai al pasarlo por cuatro detectores:

| Detector | Puntuación original de la IA | Después del humanizador | Resultado |

|---|---|---|---|

| GPTZero | 97% | 72% | Parcialmente eludido |

| Originalidad.ai | 99% | 81% | No se eludió |

| Copyleaks | Marcado | Marcado | No se eludió |

| ZeroGPT | 94% | 61% | Parcialmente eludido |

El patrón se repite en todas las revisiones. ZeroGPT y GPTZero son más fáciles de descartar. Originality.ai y Copyleaks tienden a mantenerse. Esto no es casualidad. Originality.ai está diseñado específicamente para texto parafraseado con fines adversarios, y sus pruebas internas (publicadas en el artículo de Pangram para JAIT de enero de 2026) muestran una detección de aproximadamente el 97 % en muestras parafraseadas con QuillBot.

Las afirmaciones de los proveedores sobre la precisión de sus datos rara vez resisten el contacto con pruebas independientes.

| Detector | Reclamación del vendedor | Pruebas independientes |

|---|---|---|

| Turnitin | 98% de precisión, <1% de falsos positivos | ~85% de recuperación (admitido por el propio responsable de producto de Turnitin); se señalan los casos generados por IA como casos exagerados. |

| Originalidad.ai | "Líder del sector" | Fuerte en IA pura, baja en adversario |

| Copyleaks | 99,12% | ~50% en texto parafraseado por QuillBot |

| GPTZero | "Multicapa de 7 componentes" | 1-2% de falsos positivos en ensayos previos a la IA. |

| Winston IA | 99,98% | Variable: 100 % en la entrada del blog, 3 % en la muestra del libro electrónico. |

| Clasificador de OpenAI | n / A | 26% de retirada del mercado al cerrar en julio de 2023. |

Ningún detector es perfecto en estas condiciones. Los proveedores que afirman lo contrario suelen publicar resultados de pruebas comparativas limitadas frente a contenido indetectable generado por IA bajo indicaciones controladas.

El clasificador de IA de OpenAI es el caso más contundente. La compañía lo lanzó en enero de 2023 y lo desactivó discretamente el 20 de julio del mismo año. El motivo: una tasa de verdaderos positivos del 26 %. OpenAI admitió que el modelo era "poco fiable". No ha lanzado un modelo de reemplazo. Su investigación sobre marcas de agua, validada internamente con una precisión del 99,9 % según el informe del Wall Street Journal, permanece inédita dos años y medio después.

Falsos positivos: cuando los detectores de IA marcan la escritura humana

Lo más relevante entre 2024 y 2026 es que los detectores de IA también fallan estrepitosamente en la otra dirección.

James Zou, de Stanford, y su equipo publicaron «Los detectores GPT tienen un sesgo contra los escritores no nativos de inglés» en Patterns (julio de 2023, arXiv:2304.02819). Analizaron ensayos del TOEFL de estudiantes no nativos de inglés con siete detectores principales. Estos detectores identificaron el 61,22 % de los ensayos como generados por IA. Los mismos detectores identificaron un porcentaje casi nulo de ensayos escritos por estudiantes estadounidenses de octavo grado. El sesgo tiene una explicación técnica sencilla. La menor diversidad léxica y la sintaxis más simple del inglés como segunda lengua se perciben como generadas por IA para los evaluadores basados en la perplejidad. El daño es real y afecta con mayor dureza a los estudiantes internacionales precisamente en las instituciones que utilizan estas herramientas.

El informe de Common Sense Media de 2024 sobre los perjuicios de la detección mediante IA amplió el panorama. Alrededor del 10 % de los adolescentes en general informaron haber sido acusados falsamente de usar IA. La cifra ascendió al 20 % entre los adolescentes negros, frente al 7 % de los estudiantes blancos y el 10 % de los estudiantes latinos. El impacto desproporcionado se relaciona con los sesgos conocidos en los modelos de lenguaje subyacentes, además de la forma en que los profesores responden cuando una herramienta señala a un estudiante.

El desastre más sonado en sus inicios fue el de Texas A&M-Commerce en mayo de 2023. El profesor de agricultura, el Dr. Jared Mumm, copió y pegó ensayos de estudiantes en ChatGPT. Le preguntó al modelo si los había escrito él mismo. ChatGPT respondió afirmativamente a todos. (Fue útil, como siempre). Mumm suspendió entonces a la mitad de la clase. La universidad rectificó días después. Los estudiantes utilizaron el historial de versiones de Google Docs para demostrar que ellos mismos habían escrito los ensayos. The Washington Post, NBC News, Rolling Stone e Inside Higher Ed cubrieron la noticia.

Las instituciones más grandes comenzaron a desactivar por completo la función de detección de IA de Turnitin. UCLA, UC San Diego, Cal State LA y Vanderbilt la desactivaron, alegando falsos positivos y un impacto desproporcionado en los estudiantes internacionales. Solo el sistema de la Universidad Estatal de California gastó 1,1 millones de dólares en software de detección de IA en el año académico 2024-25. El gasto total del sistema público de California superó los 15 millones de dólares.

En agosto de 2025, la FTC tomó medidas drásticas. Workado, la empresa que antes era propietaria del "Detector de Contenido con IA" de Content at Scale, había anunciado una precisión del 98%. Los investigadores de la FTC descubrieron que la precisión real en contenido general era del 53%. El modelo solo había sido entrenado con textos académicos y su rendimiento disminuía drásticamente con cualquier otro tipo de contenido. La orden de consentimiento del 28 de agosto de 2025 obligó a Workado a cesar las afirmaciones infundadas. La orden también exigió que la FTC enviara notificaciones a sus clientes. Fue la primera acción coercitiva de la FTC contra un proveedor de detección por IA por publicidad engañosa.

La línea ética: cuándo humanizar el texto de la IA se vuelve arriesgado

La mayoría de los usos de un humanizador de IA son legales. La mayoría tampoco constituyen trampa. Depende del contexto.

El uso legítimo se ve así: el dueño de una pequeña empresa pasa una entrada de blog redactada con ChatGPT por un humanizador para suavizar el tono corporativo. Luego la edita antes de publicarla. Un escritor no nativo de inglés usa un humanizador como si fuera un corrector gramatical. El objetivo es refinar la redacción sin alterar el significado. Un equipo de marketing parafrasea textos internos sobre productos. Ninguno de estos casos infringe una política ni un contrato. Ninguno pretende que el trabajo sea algo que no es.

El uso arriesgado es académico. La mayoría de las universidades prohíben el uso no autorizado de IA en los trabajos académicos. Un número creciente prohíbe específicamente los humanizadores de IA. La actualización de agosto de 2025 de Turnitin añadió una función de contramedida dirigida a los patrones de humanización más comunes. Presentar texto humanizado por IA en una tarea que requiere trabajo original constituye deshonestidad académica. Esto se aplica a la mayoría de las políticas institucionales, independientemente de si el detector lo detecta o no. La deshonestidad reside en el engaño sobre la autoría; la contramedida es simplemente el método.

La publicación comercial se sitúa en un punto intermedio más turbio. El New York Times rompió relaciones con el crítico independiente Alex Preston en enero de 2026. Una investigación reveló párrafos generados por IA en sus reseñas de libros, parafraseados de un artículo de The Guardian. El Washington Post tuvo su propio incidente en diciembre de 2025. Un podcast interno con IA difundió citas falsas. La investigación de Semafor destapó la noticia. Ninguna de las dos redacciones prohíbe por completo el uso de la IA. Ambas prohíben el uso no divulgado de IA que el público esperaría razonablemente que fuera escrito por humanos.

Una opción ética más segura sería la siguiente: si al público le importaría que el texto haya sido asistido por IA, indíquelo. Si la tarea prohíbe el uso de IA, no procese el resultado con un humanizador para disimularlo. Ninguna herramienta de IA verdaderamente indetectable le ayudará a evitar esa cuestión ética. Incluso cuando la IA indetectable puede ayudar con la redacción. Si utiliza un humanizador para que suene menos corporativo o para corregir la redacción en L2 en su propio borrador, se acerca más al extremo de la edición en contextos académicos y profesionales. La mayoría de las políticas no se pronuncian mucho al respecto.

La política actual se inclina cada vez más hacia la procedencia que hacia la detección. C2PA son las siglas de Coalición para la Procedencia y Autenticidad del Contenido. Esta iniciativa incorpora credenciales criptográficas de contenido en imágenes y vídeos. OpenAI se unió al comité directivo en mayo de 2024. Actualmente, la empresa adjunta credenciales por defecto a las salidas de DALL-E 3. Adobe, Microsoft, Google, BBC, NYT y Sony son miembros. La especificación C2PA se está tramitando con urgencia como estándar ISO. En cuanto al texto, los estándares equivalentes de marca de agua siguen sin resolverse a gran escala. Mientras no se implementen, la carrera armamentística entre la elusión y la detección continúa.