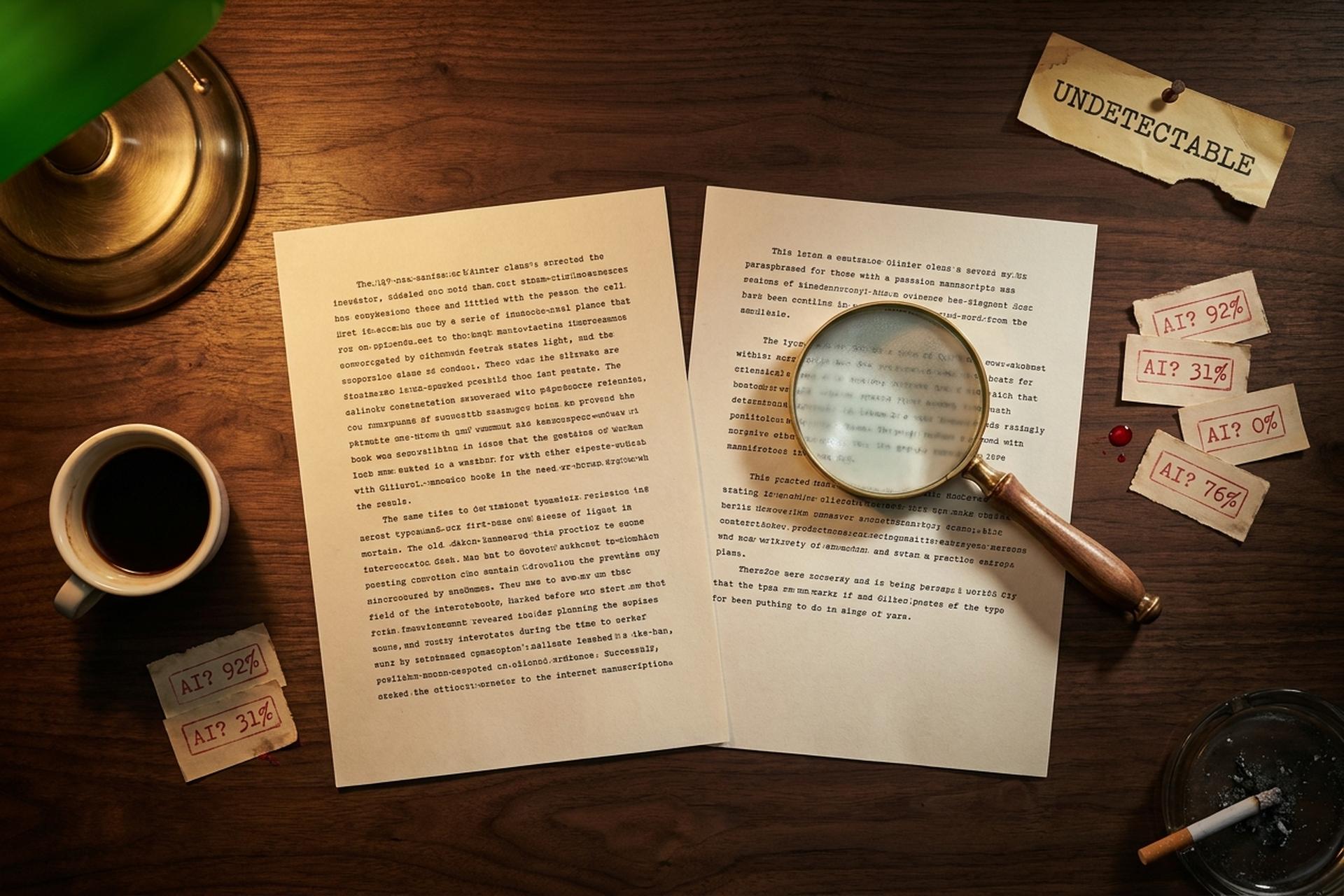

هوش مصنوعی غیرقابل کشف: ChatGPT Humanizer در مقابل ابزارهای آشکارساز هوش مصنوعی

معلمی انشای دانشآموزی را در ترنیتین پیست میکند. نمره برمیگردد: ۹۲٪ توسط هوش مصنوعی تولید شده است. دانشآموز قسم میخورد که خودش آن را نوشته است. هر دو میتوانند درست باشند. هر دو میتوانند اشتباه باشند. به مسابقه تسلیحاتی آشفته و میلیارد دلاری بر سر اینکه چه کسی واقعاً در سال ۲۰۲۶ چیزی را به صورت آنلاین نوشته است، خوش آمدید.

کلمه کلیدی "هوش مصنوعی غیرقابل کشف" در مرکز این مبارزه قرار دارد. این کلمه به دستهای کوچک اما به سرعت در حال رشد از محصولات به نام هوش مصنوعی انسانساز اشاره دارد. این ابزارها خروجی ChatGPT یا Gemini را میگیرند و آن را بازنویسی میکنند. هدف این است که آشکارسازهایی مانند Turnitin، GPTZero و Originality.ai دیگر آن را به عنوان نوشته شده توسط ماشین علامتگذاری نکنند. بیش از بیست شرکت در این حوزه فعالیت میکنند. بزرگترین برند، Undetectable.ai، ادعا میکند که 11 میلیون کاربر در یک تیم 34 نفره خودراهانداز دارد. آشکارسازهای طرف دیگر سالانه صدها میلیون درخواست را پردازش میکنند. همانطور که توافق FTC در سال 2025 نشان داد، هر دو طرف عادت دارند آنچه را که نرمافزارشان واقعاً میتواند انجام دهد، بیش از حد تبلیغ کنند. این راهنما به بررسی هر لایه میپردازد. ابزارهای هوش مصنوعی غیرقابل کشف چیستند. آشکارسازها چگونه کار میکنند. بازار در حال حاضر. چرا برخی از تلاشهای دور زدن موفق میشوند و برخی دیگر شکست میخورند. رسواییهای مثبت کاذب که دادگاهها و دانشگاهها را نسبت به تشخیص بدبین میکند. و خط اخلاقی که عبور از آن آسان است.

هوش مصنوعی غیرقابل کشف چیست؟ دسته بندی انسان ساز توضیح داده شد

«هوش مصنوعی غیرقابل تشخیص» مخفف نرمافزاری است که محتوای تولید شده توسط هوش مصنوعی را بازنویسی میکند. هدف: متوقف کردن امتیازدهی به عنوان هوش مصنوعی در ابزارهای تشخیص. این محصولات با چند نام شناخته میشوند: ابزارهای انسانی هوش مصنوعی. دور زدن هوش مصنوعی. بازنویسهای ضد تشخیص. اکثر آنها خود را به عنوان ابزاری برای دور زدن برای نوشتن آکادمیک و سئو میفروشند. آنها بین شما و بررسیکنندگان هوش مصنوعی قرار میگیرند. شما متن را از ChatGPT در ابزار پیست میکنید. انسانیکننده آن را به صورت خلاصه بیان میکند. قرار است نسخه جدید از ابزارهای تشخیص هوش مصنوعی مانند Turnitin، GPTZero، Copyleaks یا ZeroGPT عبور کند. فروشندگان این را گردش کار دور زدن-شناسایی-شده توسط هوش مصنوعی مینامند.

این دسته از محصولات در سال ۲۰۲۳، پس از آنکه ChatGPT تولید متون تولید شده توسط هوش مصنوعی را به طرز پیش پا افتادهای آسان و یافتن مدلهای تشخیص هوش مصنوعی را به طرز پیش پا افتادهای آسان کرد، به طور گسترده مورد توجه قرار گرفتند. در عرض یک سال، دهها محصول انسانساز به بازار عرضه شدند. اکثر آنها لایههای نازکی از عبارات هستند که بر روی مدلهای زبانی متن باز ساخته شدهاند. نمونههای خوب، یک انسانساز هوش مصنوعی غیرقابل تشخیص را بر اساس متن انسانی و حالتهای خرابی آشکارسازهای خاص آموزش میدهند. نمونههای بد فقط مترادفها را جابجا کرده و جملات را میشکنند.

موارد استفادهای که مردم تبلیغ میکنند گسترده است. تولیدکنندگان محتوا و بازاریابان، پیشنویسهای وبلاگ تولید شده توسط هوش مصنوعی را انسانیسازی میکنند تا ترافیک سئو را از موتورهای جستجو دور نگه دارند، بدون اینکه سبکهای نوشتاری رباتیک به نظر برسند. نویسندگان غیربومی انگلیسی پیشنویسهای خود را از طریق یک انسانساز هوش مصنوعی رایگان اجرا میکنند تا عبارات را به نوشتاری طبیعیتر تبدیل کنند. کاربران دانشگاهی (گروه بحثبرانگیز) از آنها برای پنهان کردن استفاده غیرمجاز از هوش مصنوعی، گاهی اوقات نزدیک به قلمرو سرقت ادبی، استفاده میکنند. تیمهای پشتیبانی مشتری گاهی اوقات از آنها برای تبدیل خروجی هوش مصنوعی به چیزی انسانیتر و محاورهایتر، مانند چیزی که یک شخص واقعاً میگوید، استفاده میکنند. مرز بین ویرایش قانونی و تقلب دانشگاهی دقیقاً همان جایی است که بیشتر دعواهای سیاسی در آن اتفاق میافتد و اینکه چگونه میتوان از هوش مصنوعی غیرقابل کشف در هر دو زمینه استفاده کرد، قلب این جنجال است. فروشندگان ویژگیهای ابزارهای هوش مصنوعی غیرقابل کشف را به عنوان بهرهوری خستهکننده مطرح میکنند، در حالی که منتقدان آنها را زیرساخت تقلب میدانند.

| اصطلاح رایج | معنی آن چیست؟ |

|---|---|

| انسانساز هوش مصنوعی | ابزاری که متن هوش مصنوعی را به صدای انسان بازنویسی میکند |

| ابزار بای پس کننده هوش مصنوعی / بای پس آشکارساز | همان محصول، در قابی در برابر آشکارسازها |

| بازنویسی ضد تشخیص | همان محصول، برای استفاده سئو قاببندی شده است |

| آشکارساز هوش مصنوعی | ابزاری که متن تولید شده توسط هوش مصنوعی را علامت گذاری میکند |

| واترمارک | سیگنال آماری تعبیه شده در خروجی هوش مصنوعی |

| اعتبارنامههای منشأ / محتوا | سابقه رمزنگاریشده از مبدا محتوا (C2PA) |

چگونه آشکارسازهای هوش مصنوعی متن ChatGPT را علامتگذاری و بازنویسی میکنند

برای دور زدن یک آشکارساز، باید بدانید که به دنبال چه چیزی میگردد. آشکارسازهای هوش مصنوعی مدرن به تعداد انگشتشماری سیگنال متکی هستند که تمایل دارند نوشتههای ماشینی را از نوشتههای انسانی متمایز کنند.

واژه «سرگشتگی» بیشترین نقل قول را دارد. GPTZero، ابزاری که برای سنجش میزان شگفتیهای کاربران طراحی شده و در اوایل سال ۲۰۲۳ راهاندازی شد، «سرگشتگی» را «سنجش شگفتی» خود مینامد. مدلهای زبانی محتملترین کلمه بعدی را انتخاب میکنند. متن قابل پیشبینی و با میزان سرگشتگی کم، به صورت تولید شده توسط ماشین خوانده میشود. انسانها، به خصوص وقتی در اواسط جمله خسته یا کلافه میشوند، کلمات عجیبی را انتخاب میکنند که میزان سرگشتگی را افزایش میدهد.

سپس نوبت به انفجار میرسد. نوشتار انسان معمولاً از نظر طول جمله و پیچیدگی در طول یک پاراگراف بسیار متفاوت است. یک قطعه کوتاه. سپس یک جمله طولانی و پر پیچ و خم با سه بند. سپس یک جمله چهار کلمهای گیرا. خروجی LLM یکنواختتر است: جملات حدود ۱۴ تا ۲۲ کلمه خوشهبندی میشوند و به همین شکل باقی میمانند. آشکارسازها این واریانس را اندازهگیری میکنند.

فرکانس N-gram در مرحله بعدی قرار میگیرد. عبارات خاص ("به درون نفوذ کن"، "تابلوی پر جنب و جوش"، "در چشمانداز به سرعت در حال تحول امروز") پس از سال 2023 بسیار بیشتر از قبل ظاهر میشوند. آشکارسازها کتابخانههای الگوی این دادههای هوش مصنوعی را نگهداری میکنند و کتابخانههای بزرگتر دائماً بهروزرسانی میشوند.

و در نهایت، یک طبقهبندیکننده عصبی تنظیمشده. اکثر ابزارهای مدرن تشخیص محتوا، یک مدل BERT یا RoBERTa را بر روی آمارها قرار میدهند. این الگوریتمهای یادگیری ماشین برای شناسایی متون نوشتهشده توسط هوش مصنوعی در مقابل متون انسانی طراحی شدهاند. آنها بر اساس متنهای برچسبگذاریشده انسانی و هوش مصنوعی آموزش دیدهاند. خروجی، یک امتیاز احتمال برای محتوای تولیدشده توسط هوش مصنوعی است. GPTZero اکنون هفت مؤلفه جداگانه را در یک بسته قرار میدهد. پروفایلهای سبکسنجی. جستجوی وب زنده. تجزیه و تحلیل ساختار جمله. الگوهای طول و پیچیدگی، همگی در امتیازدهی لحاظ میشوند.

برخی از آشکارسازها همچنین به دنبال واترمارکها میگردند. SynthID گوگل یک سیگنال آماری را در متن Gemini جاسازی میکند. OpenAI به صورت داخلی یک واترمارک برای ChatGPT تأیید کرده است (وال استریت ژورنال، آگوست 2024) اما آن را ارسال نکرده است. طبق نظرسنجی کاربران OpenAI، حدود 30٪ از کاربران ChatGPT گفتهاند که اگر خروجی آنها واترمارک شود، کمتر از این محصول استفاده خواهند کرد. واترمارک تصویر نیز در حال پیشرفت است: OpenAI در ماه مه 2024 به C2PA پیوست و اکنون به طور پیشفرض اعتبارنامههای محتوا را به خروجیهای DALL-E 3 متصل میکند.

چگونه هوش مصنوعی غیرقابل کشف در پشت صحنه کار میکند

ابزارهای انساننما به همان سیگنالهایی که آشکارسازها به آنها نگاه میکنند حمله میکنند، اما به صورت معکوس. هر ابزار طوری طراحی شده است که آنچه آشکارساز علامتگذاری کرده را خنثی کند. شعار بازاریابی همیشه نوعی از این جمله است: «یک هوش مصنوعی غیرقابل کشف، یک بازنویس پیشرفته است که هوش مصنوعی را به نوشتاری با صدای طبیعی تبدیل میکند.» فروشندگان برای ادعای اینکه جزو دقیقترین بازنویسهای هوش مصنوعی یا دقیقترین ابزارهای تشخیص هوش مصنوعی هستند، رقابت میکنند، بسته به اینکه در کدام طرف مسابقه تسلیحاتی قرار دارند.

یک خط لوله معمولی ساده شروع میشود. ورودی را از طریق یک مفسر آنلاین هوش مصنوعی اجرا کنید. این مدل به دقت بر اساس نوشتار انسانی تنظیم شده است. با تزریق انتخابهای غیرمنتظره کلمات برای انسانیتر کردن متن، سردرگمی ایجاد میکند. ساختار جمله را تغییر میدهد تا یکنواختی انفجاری را از بین ببرد. n-gram های علامتگذاری شده را با عبارات کمتر رایج جایگزین میکند. فروشندگان ادعا میکنند ابزار آنها میتواند خروجی هوش مصنوعی را به گونهای تغییر دهد که صدای انسانیتری داشته باشد. آنها ادعا میکنند که از بررسیهای آشکارسازهای هوش مصنوعی عبور میکند در حالی که معنای اصلی خود را حفظ میکند. آیا واقعاً محتوای با کیفیتی ارائه میدهد؟ این موضوع بین محصولات بسیار متفاوت است. برخی این ابزار را به گونهای تبلیغ میکنند که متن شما را با یک کلیک غیرقابل تشخیص میکند. ادعای بازاریابی و غیرقابل تشخیص بودن نوشتار همیشه با خروجی واقعی مطابقت ندارد.

دانشگاه مریلند قویترین مقاله نظری را در این مورد در سال ۲۰۲۳ منتشر کرد. این تیم توسط سهیل فیضی رهبری میشد. پیشنویس مقاله آنها با عنوان «آیا میتوان متن تولید شده توسط هوش مصنوعی را به طور قابل اعتمادی تشخیص داد؟» (arXiv:2303.11156) یک ادعای بزرگ را مطرح کرد. یک پارافریز عصبی سبک که روی یک مدل زبانی قرار میگیرد، هر روش تشخیصی را شکست میدهد. واترمارکینگ. طبقهبندیکنندههای عصبی. تشخیص صفر-شات. همه آنها. نقل قول فیضی در خبرنامه UMD مستقیم بود: «ما باید به این واقعیت عادت کنیم که نمیتوانیم به طور قابل اعتمادی تشخیص دهیم که آیا یک سند توسط هوش مصنوعی یا توسط انسان نوشته شده است یا خیر.»

انسانسازهای بهتر فراتر میروند. آنها در برابر آشکارسازهای خاص آموزش میبینند. تیم محصول، مجموعهای از متن هوش مصنوعی را از ChatGPT میگیرد، آن را از طریق Turnitin یا GPTZero اجرا میکند و پارافریزر را آموزش میدهد تا هر امتیازی را که آشکارساز تولید میکند، به حداقل برساند. هدف این است که متن هوش مصنوعی به اندازه کافی انسانی به نظر برسد تا از طبقهبندیکننده عبور کند و از تشخیص هوش مصنوعی عبور کند. این اساساً آموزش خصمانه در جهت معکوس است. کاربر یکی از ابزارهای نوشتاری هوش مصنوعی را که برای شکست یک رقیب خاص بهینه شده است، دریافت میکند و شعار بازاریابی برای هر یک از آنها نسخهای از «هوش مصنوعی غیرقابل تشخیص، پیشنویس شما را به چیزی که توسط بررسیکنندههای هوش مصنوعی شناسایی نمیشود، بازنویسی میکند» است. فروشندگان میگویند که بازنویسی، محتوا را غیرقابل تشخیص میکند و اغلب تبلیغ میکنند که نتیجه به طور مداوم از تشخیص هوش مصنوعی عبور میکند. همچنین به همین دلیل است که نرخهای دور زدن در آشکارسازهای مختلف برای خروجی یکسان انسانساز به شدت متفاوت است. در عمل، هوش مصنوعی غیرقابل تشخیص به کاهش امتیاز کمک میکند، اما به ندرت آن را صفر میکند. ادعاهای بازاریابی مبنی بر اینکه این ابزار متن هوش مصنوعی را به نوشتار انسانی با صدای طبیعی تبدیل میکند، معمولاً در مورد سازگاری اغراق میکنند.

مصالحه بر سر کیفیت است. نظرات کاربران در DitchNet و r/WritingWithAI در Reddit بارها و بارها همین شکایت را مطرح میکنند. عبارات انسانی معمولاً پرکننده را تزریق میکنند. "فکر میکنم." "از تجربه من." عباراتی از این دست در جایی که مناسب نیستند، گیر میکنند. اتصالات جمله قطع میشود. برخی از عبارات، صدای برند را مسطح میکنند. یکی از منتقدان، خروجی آزاد را "حدود ۵ از ۱۰ برای محتوای عمومی" ارزیابی کرد. یک متن انسانی میتواند امتیاز آشکارساز را از ۹۹٪ به ۵۰٪ کاهش دهد. اما اگر نوشته به طرز عجیبی خوانده شود، مزیت آن آکادمیک است.

بازار: Undetectable.ai، BypassGPT، QuillBot و موارد دیگر

رهبر بازار Undetectable.ai است. در اینجا، هوش مصنوعی یک ابزار است، نه فقط یک سرویس. این پلتفرم ترکیبی از یک هوش مصنوعی انسانی غیرقابل کشف، یک آشکارساز رایگان و یک افزونه کروم است. این شرکت در ژانویه 2023 تأسیس شد. بنیانگذاران: کریستین پری، دیوان لئوس و بارس جوهاش. بن میلر بعداً به عنوان مدیر ارشد عملیات به این شرکت پیوست. دفتر مرکزی قانونی در خیابان کافین 1309 در شریدان، وایومینگ قرار دارد. در بیانیههای مطبوعاتی همچنین به یک پایگاه در بویزی، آیداهو اشاره شده است. Undetectable.ai به صورت خودگردان اداره میشود. هیچ بودجه سرمایهگذاری خطرپذیر فاش نشدهای وجود ندارد. طبق گزارش PR Newswire، این شرکت تا نوامبر 2024 به 11 میلیون کاربر رسید. این یعنی 18 ماه پس از راهاندازی. GetLatka در سپتامبر 2025، Undetectable.ai را با درآمد سالانه 3.7 میلیون دلار ثابت نگه داشت. حدود 34 کارمند. Tracxn در آوریل 2025 یک پیشنهاد ادغام و تملک تایید نشده را اعلام کرد.

مجموعه رقابتی گسترده و از نظر قیمت تقسیمبندی شده است:

| ابزار | بنیانگذار / والدین | طرح ورود | طرح برتر | قابل توجه |

|---|---|---|---|---|

| غیرقابل کشف.ai | کریستین پری | ۹.۹۹ دلار در ماه | نامحدود | ۱۱ میلیون کاربر (نوامبر ۲۰۲۴) |

| مخفیکاری GPT | یوزف گرمان | ۱۴.۹۹ دلار در ماه | ۲۹.۹۹ دلار در ماه + ۴.۹۹ دلار افزونه | درآمد ۲.۲ میلیون دلاری (دسامبر ۲۰۲۳) |

| بایپسGPT | هوش مصنوعی HIX | ۶.۹۹ دلار در ماه | ۲۹.۹۹ دلار در ماه | ردیف رایگان محدود |

| بای پس HIX | هوش مصنوعی HIX | ۲۰ اعتبار رایگان | ۴۹.۹۹ دلار در ماه، نامحدود | موقعیتیابی ممتاز |

| انسانساز QuillBot | Learneo (والدین Course Hero) | ۴.۱۷ دلار در ماه (سالانه) | — | بیش از ۵۰ میلیون کاربر در مجموعه QuillBot |

| فراسلی | مستقل | ۵۵۰ کلمه رایگان | ۱۲.۹۹ دلار در ماه، نامحدود | صورتحساب سالانه |

| والتر هوش مصنوعی مینویسد | مستقل | حدود ۱۳ دلار در ماه (سالانه) | حدود ۲۵ دلار در ماه | موقعیتیابی ممتاز |

Undetectable.ai خود را به عنوان یک فروشگاه یکپارچه با هر دو تشخیص و انسانیسازی در یک داشبورد قرار میدهد. آشکارساز آن ادعا میکند که ۹۹٪ دقت و "۱۰۰٪ تشخیص در مطالعات بررسی شده توسط همتا" را دارد. انسانیساز آن امتیازدهی چند آشکارسازی را ارائه میدهد، به این معنی که خروجی را قبل از ارائه نتیجه، به طور همزمان در برابر هشت مدل آشکارساز یا بیشتر آزمایش میکند. افزونه کروم و پوشش ۵۰ زبان، تمایز واقعی هستند.

رهبر این دسته در بخش تولید محتوای هوش مصنوعی، QuillBot است که متعلق به Learneo (همان شرکت مادر Course Hero) است. مجموعه گستردهتر نوشتاری QuillBot توسط بیش از ۵۰ میلیون نفر استفاده میشود و AI Humanizer یکی از دهها ویژگی آن است. همتای AI Detector در QuillBot تا ۱۲۰۰ کلمه در هر اسکن رایگان، شش اسکن در روز را پشتیبانی میکند. هر دو محصول در بین دانشجویان محبوب هستند، به همین دلیل است که دانشگاهها اکنون به طور خاص بر استفاده از QuillBot نظارت میکنند.

محاسبات بازار نسبت به میزان دیده شدن آن کوچک است. هوش مصنوعی مولد به طور کلی در سال ۲۰۲۵ یک دسته ۵۹ میلیارد دلاری بود (Statista). بازار آشکارساز هوش مصنوعی به تنهایی بسیار کوچکتر است. طبق گفته MarketsandMarkets، تقریباً ۰.۵۸ میلیارد دلار در سال ۲۰۲۵. پیشبینی میشود تا سال ۲۰۳۰ به ۲.۰۶ میلیارد دلار برسد. بخش انسانساز هنوز کوچکتر و پراکندهتر است. هیچ رقم تجمیعی وجود ندارد. یک تخمین از پایین به بالا بر اساس درآمدهای افشا شده در ۳۰ ابزار ردیابی شده، کل این بخش را ۵۰ تا ۱۵۰ میلیون دلار درآمد سالانه مکرر نشان میدهد.

آیا انسانسازهای هوش مصنوعی واقعاً از آشکارسازها عبور میکنند؟

پاسخ کوتاه: گاهی اوقات، در برابر برخی از آشکارسازها، با هزینه کیفی قابل توجه.

پاسخ طولانیتر از آزمایشهای مستقل به دست میآید. Originality.ai، که خود یک فروشندهی آشکارساز است، یک آزمایش کنترلشده روی نرمافزار انساننمای Undetectable.ai انجام داد. هم متن اصلی ChatGPT و هم نسخه انسانیشده، با اطمینان برابر، امتیاز ۱۰۰٪ هوش مصنوعی را در Originality.ai کسب کردند. Writer.com تقریباً هیچ حرکتی نشان نداد (۶٪ به ۳٪). GPTZero از ۱۰۰٪ به ۹۱٪ کاهش یافت. اثر بایپس در بهترین حالت روی قویترین آشکارسازها، جزئی بود.

یک بررسی کاملتر در سال ۲۰۲۶ در Aithor، جدولی را ارائه داد که خروجی Undetectable.ai را از طریق چهار آشکارساز اجرا میکند:

| آشکارساز | امتیاز هوش مصنوعی اصلی | بعد از انسان ساز | نتیجه |

|---|---|---|---|

| جیپیتیزیرو | ۹۷٪ | ۷۲٪ | تا حدی کنار گذاشته شده است |

| اصالت.ai | ۹۹٪ | ۸۱٪ | نادیده گرفته نشده |

| کپیلیکس | پرچمگذاری شده | پرچمگذاری شده | نادیده گرفته نشده |

| زیرو جیپیتی | ۹۴٪ | ۶۱٪ | تا حدی کنار گذاشته شده است |

این الگو در تمام بررسیها ثابت است. ZeroGPT و GPTZero راحتتر حذف میشوند. Originality.ai و Copyleaks معمولاً پابرجا میمانند. این تصادفی نیست. Originality.ai بهطور خاص برای متن بازنویسیشدهی خصمانه ساخته شده است و معیارهای داخلی آن (منتشر شده در مقالهی JAIT در ژانویه ۲۰۲۶ از Pangram) تقریباً ۹۷٪ تشخیص را در نمونههای بازنویسیشده توسط QuillBot نشان میدهد.

ادعاهای مربوط به دقت فروشندگان به ندرت در تماس با آزمایشهای مستقل دوام میآورند.

| آشکارساز | ادعای فروشنده | آزمایش مستقل |

|---|---|---|

| ترنیتین | دقت ۹۸٪، کمتر از ۱٪ مثبت کاذب | حدود ۸۵٪ فراخوان (که توسط مسئول محصول خود Turnitin پذیرفته شده است)؛ به عنوان موارد تولید شده توسط هوش مصنوعی اغراقآمیز علامتگذاری شد |

| اصالت.ai | «رهبر صنعت» | قوی در هوش مصنوعی خام، افت در مقابل هوش مصنوعی حریف |

| کپیلیکس | ۹۹.۱۲٪ | حدود ۵۰٪ روی متن بازنویسیشده توسط QuillBot |

| جیپیتیزیرو | "چند لایه 7 جزئی" | ۱-۲٪ نتیجه مثبت کاذب در مقالههای پیش از هوش مصنوعی |

| هوش مصنوعی وینستون | ۹۹.۹۸٪ | متغیر: ۱۰۰٪ روی پست وبلاگ، ۳٪ روی نمونه کتاب الکترونیکی |

| طبقهبندیکننده OpenAI | ناموجود | ۲۶٪ هنگام خاموش شدن در ژوئیه ۲۰۲۳ فراخوان میدهند |

هیچ آشکارسازی در این شرایط بینقص نیست. فروشندگانی که ادعای دیگری دارند، تمایل دارند نتایج حاصل از معیارهای محدود را در برابر محتوای غیرقابل کشف تولید شده توسط هوش مصنوعی تحت دستورالعملهای کنترلشده منتشر کنند.

طبقهبندیکننده هوش مصنوعی خودِ OpenAI بدترین نمونه است. این شرکت آن را در ژانویه ۲۰۲۳ راهاندازی کرد، سپس در ۲۰ ژوئیه همان سال بیسروصدا آن را تعطیل کرد. دلیلش هم نرخ ۲۶٪ مثبت واقعی بود. خود OpenAI اعتراف کرد که این مدل «غیرقابل اعتماد» است. جایگزینی منتشر نکرده است. تحقیقات واترمارک آن، که طبق گزارش WSJ با دقت ۹۹.۹٪ به صورت داخلی تأیید شده است، دو سال و نیم بعد منتشر نشده است.

مثبت کاذب: وقتی آشکارسازهای هوش مصنوعی نوشتههای انسانی را تشخیص میدهند

داستان بزرگتر در سالهای ۲۰۲۴-۲۰۲۶ این است که آشکارسازهای هوش مصنوعی در جهت دیگر نیز به شدت شکست میخورند.

جیمز زو از دانشگاه استنفورد و تیمش مقالهای با عنوان «آشکارسازهای GPT علیه نویسندگان غیرانگلیسی زبان جانبدارانه عمل میکنند» در کتاب «الگوها» (ژوئیه 2023، arXiv:2304.02819) منتشر کردند. آنها مقالههای تافل دانشجویان غیرانگلیسی زبان را از طریق هفت آشکارساز اصلی بررسی کردند. این آشکارسازها 61.22٪ از این مقالهها را به عنوان مقالههای تولید شده توسط هوش مصنوعی علامتگذاری کردند. همین آشکارسازها تقریباً صفر درصد از مقالههای نوشته شده توسط دانشآموزان کلاس هشتم متولد آمریکا را علامتگذاری کردند. این تعصب یک دلیل فنی ساده دارد. تنوع واژگانی کمتر و نحو سادهتر در زبان انگلیسی به عنوان زبان دوم، از نظر نمرهدهندگان مبتنی بر سردرگمی، «شبیه هوش مصنوعی» به نظر میرسد. آسیب آن ملموس است. این آسیب بیشتر متوجه دانشجویان بینالمللی در مؤسساتی است که دقیقاً از این ابزارها استفاده میکنند.

گزارش سال ۲۰۲۴ کامن سنس مدیا در مورد آسیبهای تشخیص هوش مصنوعی، تصویر را گستردهتر کرد. حدود ۱۰٪ از نوجوانان در کل گزارش دادند که به اشتباه به استفاده از هوش مصنوعی متهم شدهاند. این تعداد در میان نوجوانان سیاهپوست به ۲۰٪ افزایش یافت، در حالی که این رقم برای دانشآموزان سفیدپوست ۷٪ و برای دانشآموزان لاتین تبار ۱۰٪ بود. این تأثیر متفاوت، بر تعصب شناخته شده در مدلهای زبانی زیربنایی، به علاوه نحوه واکنش معلمان به زمانی که یک ابزار، دانشآموزی را شناسایی میکند، تأثیر میگذارد.

عمومیترین فاجعه زودهنگام، مربوط به دانشگاه تگزاس ای اند ام-کامرس در ماه مه ۲۰۲۳ بود. دکتر جارد مام، مربی کشاورزی، مقالههای دانشجویان را در ChatGPT پیست کرد. او از مدل پرسید که آیا آنها را نوشته است یا خیر. ChatGPT به همه آنها پاسخ مثبت داد. (مثل همیشه مفید بود.) سپس مام نیمی از کلاس را مردود کرد. دانشگاه چند روز بعد مسیر را معکوس کرد. دانشجویان از تاریخچه نسخههای گوگل داکس برای اثبات اینکه خودشان مقالهها را نوشتهاند استفاده کردند. واشنگتن پست، انبیسی نیوز، رولینگ استون و اینساید هایر اد همگی این داستان را پوشش دادند.

موسسات بزرگتر شروع به غیرفعال کردن کامل ویژگی تشخیص هوش مصنوعی Turnitin کردند. UCLA، UC San Diego، Cal State LA و Vanderbilt همگی آن را غیرفعال کردند. آنها به موارد مثبت کاذب و تأثیر متفاوت بر دانشجویان بینالمللی اشاره کردند. سیستم دانشگاه ایالتی کالیفرنیا به تنهایی ۱.۱ میلیون دلار برای نرمافزار تشخیص هوش مصنوعی در سالهای ۲۰۲۴-۲۰۲۵ هزینه کرد. کل هزینههای سیستم عمومی کالیفرنیا از ۱۵ میلیون دلار فراتر رفت.

سپس در آگوست ۲۰۲۵، FTC چکش را زمین زد. Workado نهاد تغییر نام داده شدهای است که مالک «شناساگر محتوای هوش مصنوعی» شرکت Scale در Content بود. این شرکت دقت ۹۸٪ را تبلیغ کرده بود. محققان FTC دریافتند که دقت واقعی در محتوای عمومی ۵۳٪ است. این مدل فقط بر اساس نثر دانشگاهی آموزش دیده بود. در هر چیز دیگری به شدت افت میکرد. دستور رضایت ۲۸ آگوست ۲۰۲۵، Workado را ملزم به توقف ادعاهای بدون پشتوانه کرد. این دستور همچنین مستلزم ارسال اخطارهای تهیه شده توسط FTC به مشتریان فعلی بود. این اولین اقدام اجرایی FTC علیه یک فروشنده تشخیص هوش مصنوعی به دلیل تبلیغات نادرست بود.

خط اخلاقی: وقتی انسانیسازی متن هوش مصنوعی خطرناک میشود

بیشتر استفادههای از هوش مصنوعیِ انساننما قانونی است. اکثر آنها تقلب هم محسوب نمیشوند. بستگی به زمینه دارد.

استفاده مشروع به این شکل است. یک صاحب کسبوکار کوچک، یک پست وبلاگ تهیهشده توسط ChatGPT را از طریق یک نرمافزار ویرایش متن اجرا میکند. آنها میخواهند لحن سازمانی خود را ملایمتر کنند. سپس قبل از انتشار، آن را ویرایش میکنند. یک نویسنده غیرانگلیسی زبان از نرمافزار ویرایش متن مانند یک بررسیکننده گرامر استفاده میکند. هدف، اصلاح عبارتبندی بدون تغییر معنی است. یک تیم بازاریابی، متن داخلی محصول را بازنویسی میکند. هیچکدام از اینها، سیاست یا قراردادی را نقض نمیکنند. هیچکدام وانمود نمیکنند که کار چیزی است که نیست.

استفادهی پرخطر، آکادمیک است. اکثر دانشگاهها استفادهی غیرمجاز از هوش مصنوعی را در دروس ممنوع میکنند. اکنون تعداد فزایندهای از دانشگاهها بهطور خاص، انساننماهای هوش مصنوعی را ممنوع میکنند. بهروزرسانی آگوست ۲۰۲۵ ترنیتین، یک ویژگی ضد دور زدن را اضافه کرد که رایجترین الگوهای انساننما را هدف قرار میدهد. ارسال متن هوش مصنوعی انسانیشده به تکلیفی که نیاز به کار اصلی دارد، بیصداقتی آکادمیک است. این موضوع تحت اکثر سیاستهای نهادی صدق میکند. چه آشکارساز شما را شناسایی کند چه نکند، صدق میکند. بیصداقتی، فریب در مورد نویسندگی است. دور زدن فقط یک روش است.

انتشارات تجاری، میانه مبهمتری است. نیویورک تایمز در ژانویه ۲۰۲۶ با منتقد آزاد الکس پرستون قطع همکاری کرد. یک تحقیق نشان داد که پاراگرافهای تولید شده توسط هوش مصنوعی در نقد کتابهای او، از یک مقاله گاردین اقتباس شده است. واشنگتن پست نیز در دسامبر ۲۰۲۵ حادثه مشابهی داشت. یک پادکست داخلی هوش مصنوعی، نقل قولهای ساختگی ارسال کرده بود. تحقیقات سمافور این ماجرا را فاش کرد. هیچکدام از اتاقهای خبر استفاده از هوش مصنوعی را به طور کامل ممنوع نمیکنند. هر دو، استفاده از هوش مصنوعی فاش نشدهای را که مخاطب منطقاً انتظار دارد توسط انسان نوشته شده باشد، ممنوع میکنند.

یک پیشفرض اخلاقی امنتر این است. اگر مخاطب اهمیت میدهد که متن با کمک هوش مصنوعی نوشته شده است، آن را فاش کنید. اگر تکلیف استفاده از هوش مصنوعی را ممنوع کرده است، برای پنهان کردن این واقعیت، خروجی را از طریق یک نرمافزار ویرایش متن عبور ندهید. هیچ ابزار هوش مصنوعی واقعاً غیرقابل شناسایی به شما کمک نمیکند از این سوال اخلاقی اجتناب کنید. حتی زمانی که هوش مصنوعی غیرقابل شناسایی میتواند در عبارتبندی کمک کند. اگر از نرمافزار ویرایش متن برای کمتر رسمی به نظر رسیدن یا اصلاح عبارتبندی L2 در پیشنویس خود استفاده میکنید، به انتهای طیف ویرایش برای زمینههای دانشگاهی و حرفهای نزدیکتر هستید. اکثر سیاستها در این مورد حرف کمتری برای گفتن دارند.

جهتگیری سیاستها به سمت منشأ محتوا به جای تشخیص آن در حال تغییر است. C2PA مخفف ائتلاف برای منشأ و اصالت محتوا است. این ائتلاف، اعتبارنامههای محتوای رمزنگاریشده را در تصاویر و ویدیوها جاسازی میکند. OpenAI در ماه مه 2024 به کمیته راهبری پیوست. این شرکت اکنون اعتبارنامهها را به طور پیشفرض به خروجیهای DALL-E 3 پیوست میکند. ادوبی، مایکروسافت، گوگل، بیبیسی، نیویورک تایمز و سونی همگی عضو آن هستند. مشخصات C2PA به سرعت به عنوان یک استاندارد ISO در حال پیگیری است. برای متن، استانداردهای معادل واترمارک در مقیاس بزرگ هنوز حل نشدهاند. تا زمانی که این استانداردها عرضه نشوند، مسابقه تسلیحاتی دور زدن در مقابل تشخیص ادامه خواهد داشت.