Unauffindbare KI: ChatGPT Humanizer vs. KI-Detektor-Tools

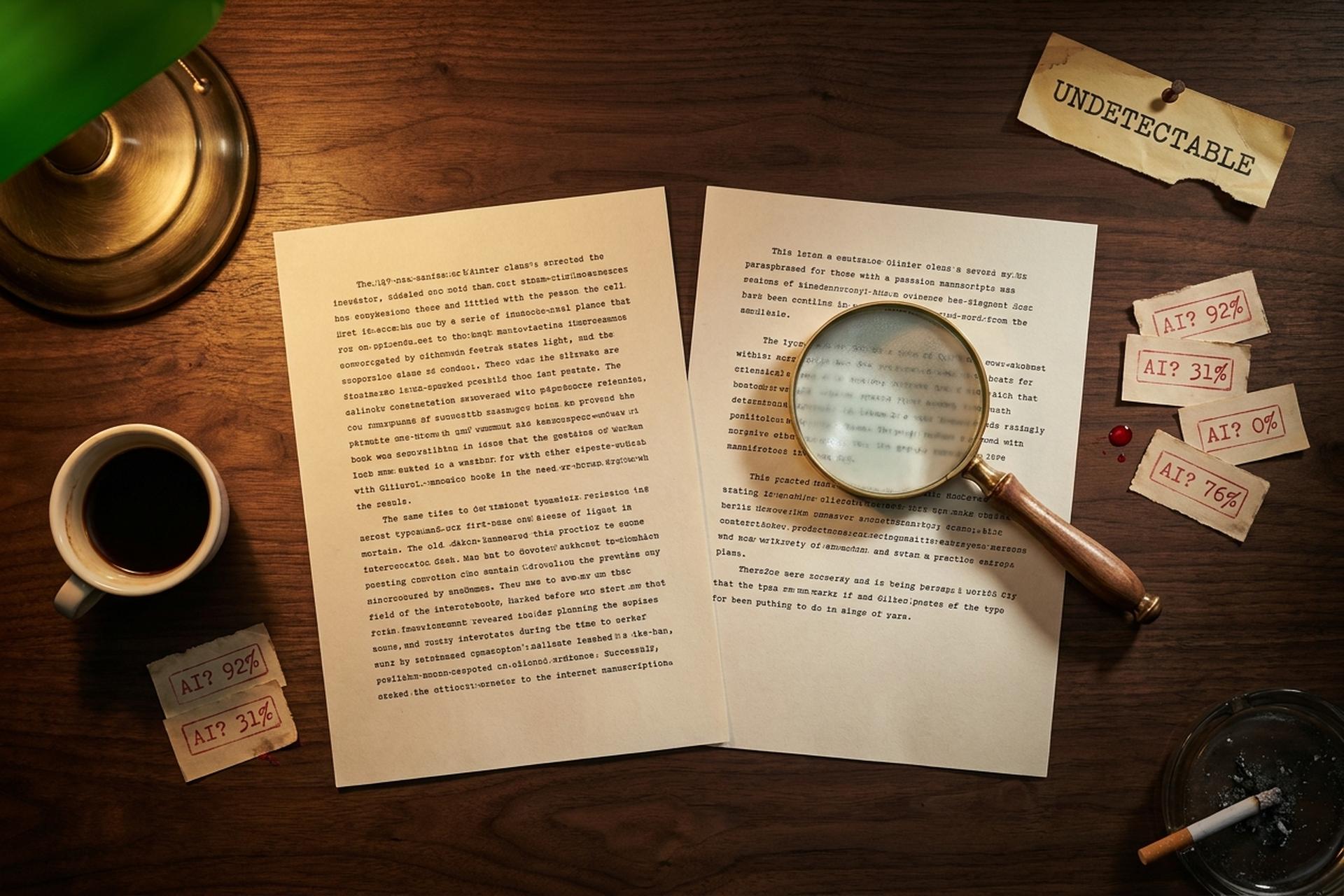

Ein Lehrer gibt den Aufsatz eines Schülers in Turnitin ein. Das Ergebnis: 92 % KI-generiert. Der Schüler beteuert, ihn selbst geschrieben zu haben. Beide könnten Recht haben. Beide könnten sich irren. Willkommen im unübersichtlichen, milliardenschweren Wettlauf darum, wer im Jahr 2026 tatsächlich online etwas verfasst hat.

Das Schlüsselwort „unerkennbare KI“ steht im Zentrum dieser Auseinandersetzung. Es bezeichnet eine kleine, aber schnell wachsende Produktkategorie namens KI-Humanisierer. Diese Tools nehmen ChatGPT- oder Gemini-Ausgaben und schreiben sie um. Ziel ist es, zu verhindern, dass Erkennungsprogramme wie Turnitin, GPTZero und Originality.ai die Texte als maschinell geschrieben einstufen. Über zwanzig Unternehmen sind in diesem Bereich tätig. Der größte Anbieter, Undetectable.ai, gibt an, 11 Millionen Nutzer zu haben und arbeitet mit einem eigenfinanzierten Team von 34 Personen. Die Erkennungsprogramme der Gegenseite verarbeiten jährlich Hunderte Millionen von Einreichungen. Wie ein Vergleich mit der FTC im Jahr 2025 zeigte, neigen beide Seiten dazu, die tatsächlichen Fähigkeiten ihrer Software zu übertreiben. Dieser Leitfaden beleuchtet alle Aspekte: Was sind unerkennbare KI-Tools? Wie funktionieren die Erkennungsprogramme? Wie sieht der Markt aktuell aus? Warum sind manche Umgehungsversuche erfolgreich und andere nicht? Welche Skandale um falsch-positive Ergebnisse haben Gerichte und Universitäten skeptisch gegenüber der Erkennung gemacht? Und wo liegt die ethische Grenze, die leicht überschritten werden kann?

Was ist unmerkliche KI? Die Kategorie der Humanisierung erklärt

„Nicht erkennbare KI“ ist die Kurzform für eine Software, die KI-generierte Inhalte umschreibt. Ziel ist es, von Erkennungstools nicht mehr als KI eingestuft zu werden. Diese Produkte sind unter verschiedenen Bezeichnungen bekannt: KI-Humanisierer, KI-Umgeher, Anti-Erkennungs-Umschreiber. Die meisten werden als Umgehungstool für akademisches und SEO-Texten beworben. Sie fungieren als Schnittstelle zwischen Ihnen und den KI-Prüfern. Sie fügen Text aus ChatGPT in das Tool ein. Der Humanisierer paraphrasiert ihn. Die neue Version soll KI-Erkennungstools wie Turnitin, GPTZero, Copyleaks oder ZeroGPT umgehen. Anbieter bezeichnen dies als den „Bypass-Erkennungs-durch-KI“-Workflow.

Die Kategorie erlebte 2023 einen regelrechten Boom, nachdem ChatGPT die Erstellung KI-generierter Texte und die Suche nach KI-Erkennungsmodellen extrem vereinfacht hatte. Innerhalb eines Jahres waren Dutzende von Humanisierungs-Produkten verfügbar. Die meisten basieren auf einfachen Paraphrasierungsfunktionen, die auf Open-Source-Sprachmodellen aufbauen. Die guten Produkte trainieren einen nicht erkennbaren KI-Humanisierer mit menschlichen Texten und den Fehlern spezifischer Erkennungsmethoden. Die schlechten hingegen mischen lediglich Synonyme und zerstückeln Sätze.

Die Anwendungsfälle, die beworben werden, sind vielfältig. Content-Ersteller und Marketer überarbeiten KI-generierte Blog-Entwürfe, um SEO-Traffic von Suchmaschinen zu erhalten, ohne dass der Schreibstil roboterhaft wirkt. Autoren, deren Muttersprache nicht Englisch ist, nutzen kostenlose KI-Humanisierungssoftware, um ihre Texte natürlicher zu gestalten. Akademische Nutzer (die umstrittene Gruppe) verwenden sie, um unautorisierte KI-Nutzung zu verschleiern, die mitunter an Plagiat grenzt. Kundendienstteams nutzen sie manchmal, um KI-Ausgaben natürlicher und dialogorientierter zu gestalten, so wie sie von einem Menschen gesprochen werden würden. Die Grenze zwischen legitimer Bearbeitung und akademischem Betrug ist genau der Punkt, an dem die meisten Auseinandersetzungen über Richtlinien stattfinden, und die Frage, wie unentdeckbare KI in beiden Kontexten eingesetzt werden könnte, ist der Kern der Kontroverse. Anbieter preisen die Funktionen unentdeckbarer KI-Tools als langweilige Produktivitätssteigerungen an, während Kritiker sie als Betrugsinfrastruktur sehen.

| Gebräuchlicher Begriff | Was es bedeutet |

|---|---|

| KI-Humanisierer | Tool, das KI-Texte so umschreibt, dass sie menschlich klingen. |

| KI-Umgehungswerkzeug / Detektor-Umgehungswerkzeug | Gleiches Produkt, nur mit Detektoren versehen |

| Anti-Erkennungs-Umschreiber | Gleiches Produkt, für SEO-Zwecke optimiert |

| KI-Detektor | Tool zur Kennzeichnung von KI-generiertem Text |

| Wasserzeichen | Statistisches Signal, eingebettet in die KI-Ausgabe |

| Herkunftsnachweis / Inhaltsnachweise | Kryptografischer Nachweis der Herkunft von Inhalten (C2PA) |

Wie KI-Detektoren ChatGPT-Texte erkennen und umschreiben

Um einen Detektor zu umgehen, muss man wissen, wonach er sucht. Moderne KI-Detektoren stützen sich auf einige wenige Signale, die maschinelles Schreiben von menschlichem Schreiben unterscheiden.

Die Perplexität ist der am häufigsten genannte Faktor. GPTZero, der Anfang 2023 eingeführte, verbraucherorientierte Detektor, bezeichnet Perplexität als seinen „Überraschungsmesser“. Sprachmodelle wählen das wahrscheinlichste nächste Wort aus. Vorhersehbare Texte mit geringer Perplexität wirken maschinell generiert. Menschen hingegen, insbesondere wenn sie sich mitten im Satz langweilen oder frustriert sind, verwenden ungewöhnliche Wörter, die die Perplexität erhöhen.

Hinzu kommt die Unregelmäßigkeit. Menschliche Texte variieren innerhalb eines Absatzes stark in Satzlänge und Komplexität. Ein kurzes Fragment, dann ein langer, verschachtelter Satz mit drei Teilsätzen, dann ein prägnanter Vier-Wort-Satz. Die Ausgabe von LLM ist einheitlicher: Sätze gruppieren sich um 14 bis 22 Wörter und bleiben dabei. Detektoren messen diese Varianz.

Als nächstes folgt die N-Gramm-Frequenz. Bestimmte Phrasen („eintauchen in“, „lebendiger Teppich“, „in der heutigen schnelllebigen Landschaft“) treten nach 2023 deutlich häufiger auf als zuvor. Detektoren verwalten Musterbibliotheken dieser KI-Indikatoren, und größere Bibliotheken werden ständig aktualisiert.

Und schließlich ein feinabgestimmter neuronaler Klassifikator. Die meisten modernen Tools zur Inhaltserkennung verwenden zusätzlich zu den Statistiken ein BERT- oder RoBERTa-Klassenmodell. Diese Algorithmen des maschinellen Lernens dienen dazu, KI-generierte Texte von menschlichen Texten zu unterscheiden. Sie werden mit gekennzeichneten menschlichen und KI-Texten trainiert. Das Ergebnis ist ein Wahrscheinlichkeitswert für KI-generierte Inhalte. GPTZero bündelt nun sieben separate Komponenten: Stilometrische Profile, Live-Websuche und Satzstrukturanalyse. Längen- und Komplexitätsmuster fließen in die Berechnung ein.

Einige Detektoren suchen auch nach Wasserzeichen. Googles SynthID bettet ein statistisches Signal in Gemini-Texte ein. OpenAI hat intern ein Wasserzeichen für ChatGPT validiert (Wall Street Journal, August 2024), es aber noch nicht veröffentlicht. Laut einer Nutzerumfrage von OpenAI gaben rund 30 % der ChatGPT-Nutzer an, das Produkt weniger zu verwenden, wenn ihre Ausgaben mit einem Wasserzeichen versehen wären. Die Bildwasserzeichentechnologie ist weiter fortgeschritten: OpenAI trat im Mai 2024 C2PA bei und fügt DALL-E 3-Ausgaben nun standardmäßig Content Credentials hinzu.

Wie unmerkliche KI im Detail funktioniert

Humanisierer greifen dieselben Signale an, die Detektoren analysieren, jedoch in umgekehrter Richtung. Jedes Tool ist darauf ausgelegt, die vom Detektor gemeldeten Fehler zu korrigieren. Die Marketingstrategie lautet stets in etwa: „Eine nicht erkennbare KI ist ein hochentwickelter Texterneuerer, der KI-Code in natürlich klingenden Text umwandelt.“ Anbieter überbieten sich damit, entweder die präzisesten KI-Texterneuerer oder die präzisesten KI-Erkennungstools anzubieten, je nachdem, auf welcher Seite dieses Wettrüstens sie stehen.

Ein typischer Workflow beginnt einfach: Der Text wird durch einen Online-KI-Paraphrasierer geleitet. Das Modell wird anhand menschlicher Texte feinabgestimmt. Es erzeugt Verwirrung, indem es unerwartete Wörter einfügt, um den Text menschlicher klingen zu lassen. Es variiert die Satzstruktur, um die Gleichförmigkeit von abgehackten Sätzen aufzubrechen. Es ersetzt markierte N-Gramme durch weniger gebräuchliche Formulierungen. Anbieter behaupten, ihr Tool könne KI-Ausgaben so verändern, dass sie natürlicher klingen. Sie behaupten, es durchlaufe die KI-Erkennungsprüfungen und behalte dabei seine ursprüngliche Bedeutung bei. Liefert es tatsächlich qualitativ hochwertige Inhalte? Das variiert stark zwischen den Produkten. Manche versprechen, dass ihr Tool Ihren Text mit einem Klick unkenntlich macht. Die Marketingaussagen und das Versprechen, Texte unkenntlich zu machen, werden jedoch nicht immer durch das tatsächliche Ergebnis bestätigt.

Die University of Maryland veröffentlichte 2023 die aussagekräftigste theoretische Arbeit zu diesem Thema. Das Team unter der Leitung von Soheil Feizi stellte in ihrem Preprint „Can AI-Generated Text be Reliably Detected?“ (arXiv:2303.11156) eine gewagte These auf: Ein ressourcenschonender neuronaler Paraphrasierer, der auf einem Sprachmodell aufbaut, überlistet jede Erkennungsmethode. Wasserzeichen, neuronale Klassifikatoren, Zero-Shot-Erkennung – alle. Feizis Zitat in der Pressemitteilung der UMD war eindeutig: „Wir sollten uns einfach daran gewöhnen, dass wir nicht zuverlässig feststellen können, ob ein Dokument von einer KI oder von Menschen verfasst wurde.“

Bessere Humanisierer gehen noch einen Schritt weiter. Sie werden gezielt gegen bestimmte Erkennungsmethoden trainiert. Das Produktteam verwendet einen Datensatz mit KI-Texten von ChatGPT, analysiert ihn mit Turnitin oder GPTZero und trainiert den Paraphrasierer so, dass er die vom Erkennungsdienst ermittelte Punktzahl minimiert. Ziel ist es, KI-Texte so menschlich klingen zu lassen, dass sie die Klassifizierung umgehen und die KI-Erkennung bestehen. Dies ist im Prinzip ein umgekehrtes adversarielles Training. Der Nutzer erhält eines von vielen KI-Schreibwerkzeugen, die für einen bestimmten Zweck optimiert sind. Die Marketingaussage für jedes dieser Werkzeuge lautet in etwa: „Unerkennbare KI schreibt Ihren Entwurf so um, dass er von KI-Prüfern nicht erkannt wird.“ Anbieter behaupten, die Umschreibung mache den Inhalt unerkennbar und werben oft damit, dass das Ergebnis die KI-Erkennung zuverlässig besteht. Das erklärt auch die stark variierenden Erfolgsraten bei der Verwendung desselben Humanisierers durch verschiedene Erkennungsmethoden. In der Praxis hilft unerkennbare KI zwar, die Punktzahl zu reduzieren, aber sie erreicht selten null. Marketingversprechen, dass das Tool KI-Texte in natürlich klingende menschliche Texte umwandelt, übertreiben die Konsistenz in der Regel.

Der Kompromiss ist die Qualität. Nutzerbewertungen auf DitchNet und im Reddit-Forum r/WritingWithAI weisen immer wieder auf dieselbe Kritik hin: Sprachvervollständiger fügen oft Füllwörter ein. „Ich denke.“ „Meiner Erfahrung nach.“ Solche Phrasen werden unpassend eingefügt. Satzverbindungen werden unterbrochen. Manche Bearbeitungsschritte lassen den Markenauftritt verflachen. Ein Rezensent bewertete die Ergebnisse der kostenlosen Version mit „etwa 5 von 10 Punkten für öffentlich zugängliche Inhalte“. Ein Sprachvervollständiger kann die Erkennungsrate von 99 % auf 50 % senken. Doch wenn sich der Text anschließend seltsam liest, ist der Nutzen vernachlässigbar.

Der Markt: Undetectable.ai, BypassGPT, QuillBot und mehr

Marktführer ist Undetectable.ai. Hier ist KI ein Werkzeug, nicht nur eine Dienstleistung. Die Plattform kombiniert einen unauffälligen KI-Humanisierer, einen kostenlosen Detektor und eine Chrome-Erweiterung. Das Unternehmen wurde im Januar 2023 gegründet. Gründer: Christian Perry, Devan Leos und Bars Juhasz. Ben Miller stieß später als COO hinzu. Der Firmensitz befindet sich in der Coffeen Avenue 1309 in Sheridan, Wyoming. Pressemitteilungen nennen außerdem einen Standort in Boise, Idaho. Undetectable.ai ist eigenfinanziert. Es wurden keine Angaben zu Risikokapital gemacht. Laut PR Newswire erreichte das Unternehmen bis November 2024 11 Millionen Nutzer – 18 Monate nach dem Start. GetLatka schätzte den jährlichen Umsatz (ARR) von Undetectable.ai im September 2025 auf 3,7 Millionen US-Dollar. Das Unternehmen beschäftigt rund 34 Mitarbeiter. Tracxn meldete im April 2025 ein unbestätigtes Übernahmeangebot.

Der Wettbewerbsmarkt ist breit gefächert und preislich segmentiert:

| Werkzeug | Gründer / Elternteil | Einstiegsplan | Topplan | Bemerkenswert |

|---|---|---|---|---|

| Undetectable.ai | Christian Perry | 9,99 €/Monat | Unbegrenzt | 11 Millionen Nutzer (November 2024) |

| StealthGPT | Jozef Gherman | 14,99 €/Monat | 29,99 $/Monat + 4,99 $ Zusatzgebühr | 2,2 Mio. US-Dollar Umsatz (Dezember 2023) |

| BypassGPT | HIX.AI | 6,99 €/Monat | 29,99 €/Monat | Begrenzte kostenlose Version |

| HIX-Bypass | HIX.AI | Gratis 20 Credits | 49,99 $/Monat unbegrenzt | Premium-Positionierung |

| QuillBot Humanizer | Learneo (Muttergesellschaft von Course Hero) | 4,17 $/Monat (jährlich) | — | Mehr als 50 Millionen Nutzer der QuillBot-Suite |

| Phrase | unabhängig | Kostenlos (550 Wörter) | 12,99 $/Monat unbegrenzt | Jährliche Abrechnung |

| Walter schreibt KI | unabhängig | ~13 €/Monat (jährlich) | ca. 25 €/Monat | Premium-Positionierung |

Undetectable.ai positioniert sich als Komplettlösung, die Erkennung und Humanisierung in einem einzigen Dashboard vereint. Der Detektor verspricht eine Genauigkeit von 99 % und eine „100%ige Erkennungsrate in Peer-Review-Studien“. Die Humanisierungsfunktion zeichnet sich durch Multi-Detektor-Scoring aus, d. h. sie testet die Ausgabe gleichzeitig anhand von etwa acht Detektormodellen, bevor ein Ergebnis zurückgegeben wird. Die Chrome-Erweiterung und die Unterstützung von 50 Sprachen sind echte Alleinstellungsmerkmale.

Marktführer im Bereich KI-gestützter Inhaltserstellung ist QuillBot von Learneo (dem Mutterkonzern von Course Hero). Die umfassende Schreibsoftware von QuillBot wird von über 50 Millionen Menschen genutzt, und der KI-Humanizer ist nur eine von vielen Funktionen. Der KI-Detektor in QuillBot unterstützt bis zu 1.200 Wörter pro Scan kostenlos, maximal sechs Scans pro Tag. Beide Produkte sind bei Studierenden beliebt, weshalb Universitäten die Nutzung von QuillBot nun gezielt überwachen.

Der Markt für generative KI ist im Verhältnis zu seiner Sichtbarkeit klein. Generative KI insgesamt erreichte 2025 ein Volumen von 59 Milliarden US-Dollar (Statista). Der Markt für KI-Detektoren allein ist deutlich kleiner. Laut MarketsandMarkets lag er 2025 bei rund 0,58 Milliarden US-Dollar und soll bis 2030 auf 2,06 Milliarden US-Dollar anwachsen. Der Bereich der Humanisierungstools ist noch kleiner und stärker fragmentiert. Hierzu liegen keine aggregierten Zahlen vor. Eine Bottom-up-Schätzung auf Basis der offengelegten Umsätze von 30 analysierten Tools geht von einem jährlichen Umsatzvolumen des gesamten Sektors zwischen 50 und 150 Millionen US-Dollar aus.

Umgehen KI-Humanisatoren tatsächlich die Detektoren?

Die kurze Antwort: Manchmal, bei manchen Detektoren, mit erheblichen Qualitätseinbußen.

Die ausführlichere Antwort liefert ein unabhängiger Test. Originality.ai, selbst ein Anbieter von Detektoren, führte ein kontrolliertes Experiment mit dem Humanizer von Undetectable.ai durch. Sowohl der ursprüngliche ChatGPT-Text als auch die humanisierte Version erreichten bei Originality.ai mit gleicher Sicherheit 100 % KI-Erkennung. Writer.com zeigte kaum eine Veränderung (von 6 % auf 3 %). GPTZero fiel von 100 % auf 91 %. Der Bypass-Effekt war bei den stärksten Detektoren bestenfalls marginal.

Eine ausführlichere Überprüfung im Jahr 2026 bei Aithor ergab diese Tabelle, die die Ausgabe von Undetectable.ai durch vier Detektoren laufen lässt:

| Detektor | Original AI-Score | Nach dem Humanisierer | Ergebnis |

|---|---|---|---|

| GPTZero | 97 % | 72 % | Teilweise umgangen |

| Originality.ai | 99% | 81 % | Nicht umgangen |

| Copyleaks | Markiert | Markiert | Nicht umgangen |

| ZeroGPT | 94 % | 61 % | Teilweise umgangen |

Das Muster ist in allen Tests konsistent. ZeroGPT und GPTZero lassen sich leichter abwehren. Originality.ai und Copyleaks hingegen halten in der Regel stand. Das ist kein Zufall. Originality.ai wurde speziell für paraphrasierte Texte entwickelt, und die internen Benchmarks (veröffentlicht in Pangrams JAIT-Paper vom Januar 2026) zeigen eine Erkennungsrate von etwa 97 % bei mit QuillBot paraphrasierten Texten.

Die Genauigkeitsangaben von Herstellern halten unabhängigen Tests selten stand.

| Detektor | Verkäuferbehauptung | Unabhängige Prüfung |

|---|---|---|

| Turnitin | 98 % Genauigkeit, <1 % falsch positive Ergebnisse | ~85 % Rückrufquote (vom Produktverantwortlichen von Turnitin selbst bestätigt); als KI-generierte Fälle gekennzeichnet; überbewertet |

| Originality.ai | "Branchenführer" | Stark in Bezug auf reine KI, Schwächen bei gegnerischen Spielen |

| Copyleaks | 99,12 % | ~50% des Textes wurde von QuillBot paraphrasiert. |

| GPTZero | „Mehrschicht-7-Komponenten-System“ | 1-2 % falsch positive Ergebnisse bei Aufsätzen vor der KI-Einführung |

| Winston AI | 99,98 % | Variable: 100 % beim Blogbeitrag, 3 % bei der E-Book-Probe |

| OpenAI-Klassifikator | n / A | 26 % Rückrufquote bei Abschaltung im Juli 2023 |

Kein Detektor ist unter diesen Bedingungen perfekt. Anbieter, die das Gegenteil behaupten, veröffentlichen in der Regel Ergebnisse aus eng begrenzten Benchmarks mit nicht erkennbaren Inhalten, die von KI unter kontrollierten Vorgaben generiert werden.

Der KI-Klassifikator von OpenAI ist das wohl eklatanteste Beispiel. Das Unternehmen veröffentlichte ihn im Januar 2023 und stellte ihn am 20. Juli desselben Jahres stillschweigend wieder ein. Der Grund: eine Trefferquote von lediglich 26 %. OpenAI selbst räumte ein, das Modell sei „unzuverlässig“. Ein Ersatz wurde bisher nicht veröffentlicht. Auch die Forschung zum Thema Wasserzeichen, die laut WSJ-Bericht intern mit einer Genauigkeit von 99,9 % validiert wurde, ist zweieinhalb Jahre später noch immer unveröffentlicht.

Falsch-positive Ergebnisse: Wenn KI-Detektoren menschliche Handschrift als solche erkennen.

Die wichtigere Erkenntnis in den Jahren 2024-2026 ist, dass KI-Detektoren auch in die andere Richtung kläglich versagen.

James Zou von der Stanford University und sein Team veröffentlichten in Patterns (Juli 2023, arXiv:2304.02819) die Studie „GPT detectors are biased against non-native English writers“. Sie analysierten TOEFL-Aufsätze von Studierenden, deren Muttersprache nicht Englisch ist, mithilfe von sieben gängigen Analysetools. Diese wiesen 61,22 % der Aufsätze als KI-generiert aus. Im Gegensatz dazu erkannten dieselben Tools nahezu null Prozent der Aufsätze von in den USA geborenen Achtklässlern. Die Verzerrung lässt sich technisch einfach erklären: Geringere lexikalische Vielfalt und einfachere Syntax im Englischen als Zweitsprache wirken auf Perplexitäts-basierte Bewertungsmethoden „KI-ähnlich“. Die Folgen sind konkret: Internationale Studierende an den Hochschulen, die diese Tools einsetzen, sind am stärksten betroffen.

Der Bericht von Common Sense Media aus dem Jahr 2024 über die Gefahren der KI-Erkennung erweiterte das Bild. Rund 10 % aller Jugendlichen gaben an, fälschlicherweise der Nutzung von KI beschuldigt worden zu sein. Bei schwarzen Jugendlichen stieg diese Zahl auf 20 %, im Vergleich zu 7 % bei weißen und 10 % bei lateinamerikanischen Schülern. Die ungleichen Auswirkungen lassen sich auf bekannte Verzerrungen in den zugrunde liegenden Sprachmodellen sowie auf die Reaktion von Lehrkräften zurückführen, wenn ein Schüler durch ein Tool als verdächtig eingestuft wird.

Das wohl bekannteste frühe Fiasko ereignete sich im Mai 2023 an der Texas A&M-Commerce. Der Agrardozent Dr. Jared Mumm lud studentische Essays in ChatGPT hoch und fragte das Programm, ob es diese verfasst habe. ChatGPT bestätigte dies in allen Fällen. (Wie immer war es hilfreich.) Daraufhin ließ Mumm die Hälfte der Studierenden durchfallen. Wenige Tage später ruderte die Universität zurück. Die Studierenden konnten mithilfe des Versionsverlaufs von Google Docs beweisen, dass sie die Essays selbst geschrieben hatten. Die Washington Post, NBC News, Rolling Stone und Inside Higher Ed berichteten über den Fall.

Größere Hochschulen begannen, die KI-Erkennungsfunktion von Turnitin komplett zu deaktivieren. UCLA, UC San Diego, Cal State LA und Vanderbilt schalteten sie ab. Sie nannten als Gründe Fehlalarme und die ungleiche Behandlung internationaler Studierender. Allein das California State University System gab im Zeitraum 2024/25 1,1 Millionen US-Dollar für KI-Erkennungssoftware aus. Die Gesamtausgaben des öffentlichen Hochschulsystems in Kalifornien beliefen sich auf über 15 Millionen US-Dollar.

Im August 2025 schlug die FTC dann hart durch. Workado, das umbenannte Unternehmen, dem Content at Scales „KI-Inhaltserkennungsdienst“ gehörte, hatte mit einer Genauigkeit von 98 % geworben. FTC-Ermittler stellten jedoch fest, dass die tatsächliche Genauigkeit bei allgemeinen Inhalten lediglich 53 % betrug. Das Modell war ausschließlich mit akademischen Texten trainiert worden und schnitt bei anderen Textsorten deutlich schlechter ab. Die am 28. August 2025 ergangene Einverständniserklärung verpflichtete Workado, die unbegründeten Werbeaussagen einzustellen. Zudem wurden bestehende Kunden gemäß den von der FTC erstellten Richtlinien benachrichtigt. Es handelte sich um die erste Durchsetzungsmaßnahme der FTC gegen einen Anbieter von KI-gestützter Inhaltserkennung wegen irreführender Werbung.

Die ethische Grenze: Wann wird die Vermenschlichung von KI-Texten riskant?

Die meisten Anwendungen von KI-gestützten Humanisierungssystemen sind legal. Die meisten stellen auch keinen Betrug dar. Es kommt auf den Kontext an.

Eine legitime Nutzung sieht folgendermaßen aus: Ein Kleinunternehmer lässt einen mit ChatGPT erstellten Blogbeitrag durch einen Humanizer laufen, um den geschäftsmäßigen Tonfall abzumildern. Anschließend bearbeitet er den Beitrag vor der Veröffentlichung. Ein Autor, dessen Muttersprache nicht Englisch ist, verwendet einen Humanizer ähnlich wie eine Grammatikprüfung. Ziel ist es, die Formulierung zu verfeinern, ohne die Bedeutung zu verändern. Ein Marketingteam paraphrasiert interne Produkttexte. Keine dieser Anwendungen verstößt gegen Richtlinien oder Verträge. Keine der Anwendungen gibt vor, etwas anderes zu sein, als es ist.

Der riskante Einsatz ist akademischer Natur. Die meisten Universitäten verbieten die unerlaubte Nutzung von KI in Lehrveranstaltungen. Immer mehr verbieten mittlerweile sogar KI-generierte Texte. Das Turnitin-Update vom August 2025 führte eine Schutzfunktion ein, die die häufigsten Muster solcher Texterkenner erkennt und umgeht. Das Einreichen von KI-generiertem Text in einer Aufgabe, die Originalität verlangt, gilt als akademisches Fehlverhalten. Dies ist gemäß den meisten institutionellen Richtlinien so. Es gilt unabhängig davon, ob die Erkennungsmethode funktioniert oder nicht. Das Fehlverhalten besteht in der Täuschung über die Urheberschaft. Die Umgehung ist lediglich die Methode.

Der kommerzielle Verlagswesen ist ein undurchsichtiger Bereich. Die New York Times beendete im Januar 2026 die Zusammenarbeit mit dem freien Kritiker Alex Preston. Eine Untersuchung ergab, dass seine Buchrezensionen KI-generierte Absätze enthielten, die einem Artikel des Guardian entnommen waren. Auch die Washington Post erlebte im Dezember 2025 einen ähnlichen Vorfall. Eine interne KI-Podcast-Funktion verbreitete gefälschte Zitate. Semafors Untersuchung brachte die Geschichte ans Licht. Beide Redaktionen verbieten den Einsatz von KI nicht gänzlich. Sie untersagen jedoch den nicht offengelegten Einsatz von KI, wenn das Publikum vernünftigerweise erwarten würde, dass die Texte von Menschen verfasst wurden.

Ein ethisch sichererer Standard sieht folgendermaßen aus: Wenn es die Leserschaft interessiert, dass der Text KI-gestützt erstellt wurde, sollte dies offengelegt werden. Ist die Verwendung von KI in der Aufgabenstellung untersagt, sollte der Text nicht durch einen Sprachvervollständiger geleitet werden, um dies zu verschleiern. Kein wirklich unerkennbares KI-Tool kann diese ethische Frage umgehen. Selbst wenn unerkennbare KI bei der Formulierung helfen kann: Wenn Sie einen Sprachvervollständiger verwenden, um weniger formell zu klingen oder um Formulierungen in Ihrem eigenen Entwurf zu korrigieren, bewegen Sie sich im akademischen und beruflichen Kontext eher im Bereich des Lektorats. Die meisten Richtlinien enthalten dazu weniger Vorgaben.

Die politische Ausrichtung verschiebt sich von der Erkennung hin zur Herkunftsnachverfolgung. C2PA steht für Coalition for Content Provenance and Authenticity (Koalition für Inhaltsherkunft und -authentizität). Sie bettet kryptografische Inhaltsnachweise in Bilder und Videos ein. OpenAI trat dem Lenkungsausschuss im Mai 2024 bei. Das Unternehmen fügt DALL-E 3-Ausgaben nun standardmäßig Nachweise hinzu. Adobe, Microsoft, Google, BBC, NYT und Sony sind ebenfalls Mitglieder. Die C2PA-Spezifikation wird als ISO-Standard beschleunigt vorangetrieben. Für Text sind vergleichbare Wasserzeichenstandards in großem Umfang noch nicht implementiert. Bis diese verfügbar sind, geht der Wettlauf zwischen Umgehung und Erkennung weiter.