IA non rilevabile: ChatGPT Humanizer vs Strumenti di rilevamento dell’IA

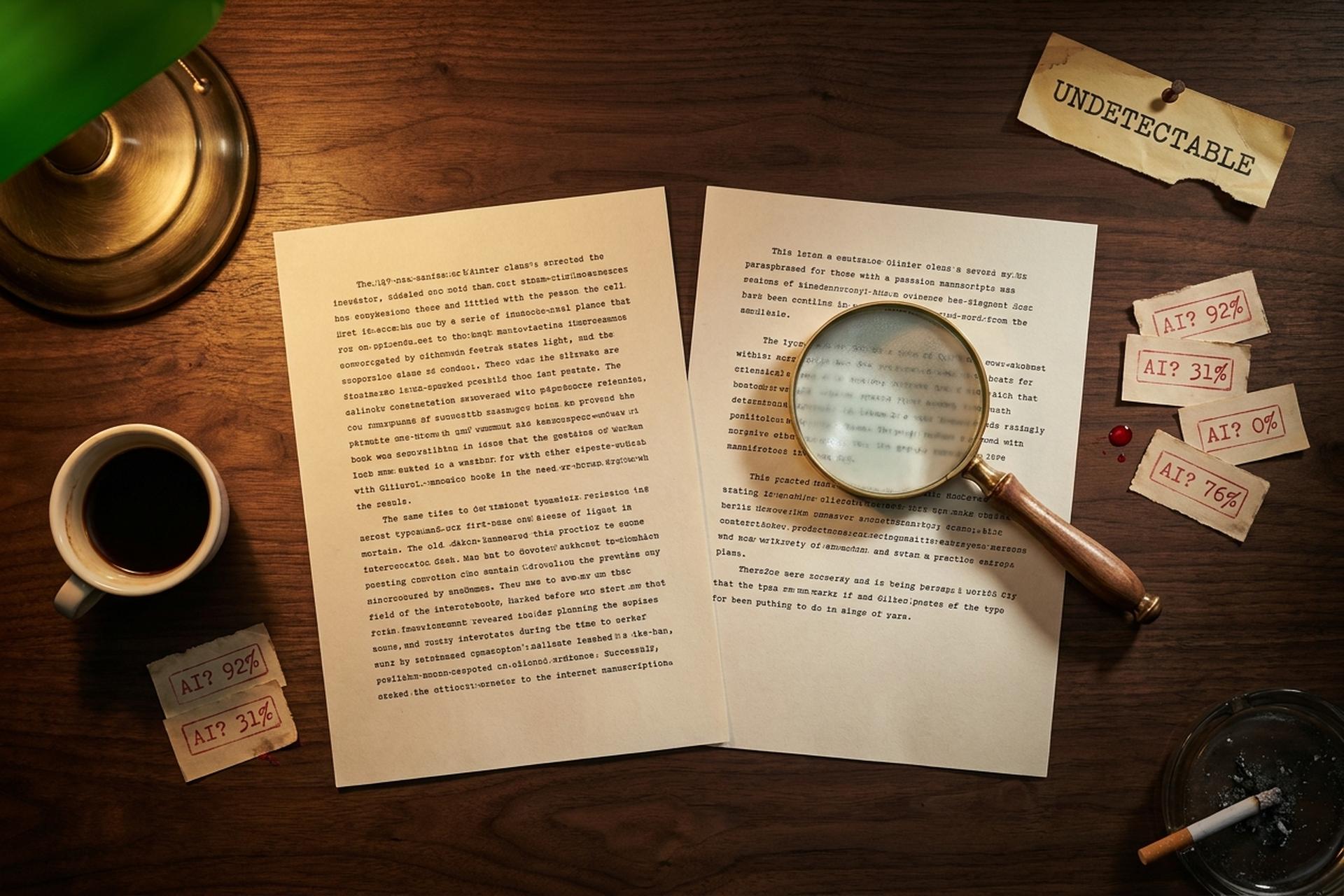

Un insegnante incolla il tema di uno studente su Turnitin. Il risultato è: 92% generato dall'IA. Lo studente giura di averlo scritto lui. Entrambi potrebbero avere ragione. Entrambi potrebbero avere torto. Benvenuti nella caotica corsa agli armamenti da miliardi di dollari per stabilire chi ha effettivamente scritto qualcosa online nel 2026.

La parola chiave "IA non rilevabile" è al centro di questa battaglia. Si riferisce a una categoria di prodotti, piccola ma in rapida crescita, chiamata "umanizzatori IA". Questi strumenti prendono l'output di ChatGPT o Gemini e lo riscrivono. L'obiettivo è impedire a software di rilevamento come Turnitin, GPTZero e Originality.ai di segnalarlo come testo generato automaticamente. Oltre venti aziende operano in questo settore. Il marchio più importante, Undetectable.ai, dichiara 11 milioni di utenti con un team di 34 persone autofinanziato. Dall'altra parte, i software di rilevamento elaborano centinaia di milioni di dati all'anno. Come ha dimostrato un accordo con la FTC del 2025, entrambe le parti tendono a esagerare le reali capacità dei propri software. Questa guida analizza ogni aspetto: cosa sono gli strumenti di IA non rilevabile, come funzionano i software di rilevamento, il mercato attuale, perché alcuni tentativi di elusione hanno successo e altri falliscono, gli scandali dei falsi positivi che rendono tribunali e università scettici nei confronti dei sistemi di rilevamento e il confine etico che è facile oltrepassare.

Cos'è l'IA non rilevabile? La categoria degli umanizzatori spiegata.

"IA non rilevabile" è un'espressione che indica un software in grado di riscrivere i contenuti generati dall'intelligenza artificiale. L'obiettivo: impedire che i sistemi di rilevamento la riconoscano come IA. Questi prodotti sono noti con diversi nomi: umanizzatori di IA, bypassatori di IA, riscrittori anti-rilevamento. La maggior parte si presenta come uno strumento di bypass per la scrittura accademica e SEO. Si interpongono tra l'utente e i sistemi di controllo dell'IA. L'utente incolla il testo da ChatGPT nello strumento, l'umanizzatore lo parafrasa e la nuova versione dovrebbe superare i controlli anti-IA di Turnitin, GPTZero, Copyleaks o ZeroGPT. I fornitori definiscono questo processo "flusso di lavoro bypass-rilevamento-da-IA".

La categoria ha avuto un'esplosione nel 2023, dopo il lancio di ChatGPT che ha reso la produzione di testi generati dall'IA estremamente semplice e i modelli di rilevamento dell'IA altrettanto semplici da reperire. Nel giro di un anno, decine di prodotti di umanizzazione erano già online. La maggior parte sono semplici livelli di parafrasi basati su modelli linguistici open source. I migliori addestrano un sistema di umanizzazione basato sull'IA, irrintracciabile, su testi umani e sulle modalità di errore di specifici rilevatori. I peggiori si limitano a rimescolare i sinonimi e a spezzare le frasi.

Gli utilizzi pubblicizzati sono molteplici. Creatori di contenuti e professionisti del marketing umanizzano le bozze di blog generate dall'IA per evitare che il traffico SEO provenga dai motori di ricerca, senza però che lo stile di scrittura risulti robotico. Gli autori non madrelingua inglese utilizzano un umanizzatore IA gratuito per rendere le loro bozze più naturali e fluide. Gli utenti accademici (il gruppo controverso) li usano per mascherare l'uso non autorizzato dell'IA, a volte al limite del plagio. I team di assistenza clienti li utilizzano talvolta per trasformare l'output dell'IA in qualcosa di più umano e colloquiale, simile a ciò che una persona direbbe realmente. Il confine tra la correzione legittima e la frode accademica è proprio il punto in cui si concentrano la maggior parte delle controversie, e il modo in cui l'IA non rilevabile potrebbe essere utilizzata in entrambi i contesti è il fulcro della disputa. I fornitori presentano le funzionalità degli strumenti di IA non rilevabile come un modo per aumentare la produttività, mentre i critici le considerano un'infrastruttura per imbrogliare.

| Termine comune | Cosa significa |

|---|---|

| Umanizzatore basato sull'IA | Strumento che riscrive il testo tramite intelligenza artificiale per farlo sembrare umano. |

| Strumento per aggirare l'IA / strumento per aggirare il rilevatore | Lo stesso prodotto, incorniciato contro i rilevatori |

| riscrittore anti-rilevamento | Stesso prodotto, incorniciato per l'utilizzo SEO |

| rilevatore di intelligenza artificiale | Strumento che segnala il testo generato dall'IA |

| Filigrana | Segnale statistico incorporato nell'output dell'IA |

| Provenienza / Credenziali di contenuto | Registrazione crittografica della provenienza del contenuto (C2PA) |

Come i rilevatori di intelligenza artificiale segnalano e riscrivono il testo ChatGPT

Per eludere un sistema di rilevamento, bisogna sapere cosa cerca. I moderni sistemi di rilevamento basati sull'intelligenza artificiale si affidano a una serie di segnali che tendono a distinguere la scrittura automatica da quella umana.

La perplessità è il fattore più citato. GPTZero, il rilevatore destinato ai consumatori lanciato all'inizio del 2023, definisce la perplessità il suo "misuratore di sorpresa". I modelli linguistici scelgono la parola successiva più probabile. Un testo prevedibile e a bassa perplessità appare come generato da una macchina. Gli esseri umani, soprattutto quando si annoiano o si frustrano a metà frase, inseriscono scelte lessicali insolite che aumentano la perplessità.

Poi c'è la frammentarietà. La scrittura umana tende a variare notevolmente in lunghezza e complessità delle frasi all'interno di un paragrafo. Un breve frammento. Poi una lunga frase tortuosa con tre proposizioni. Poi una frase incisiva di quattro parole. L'output di LLM è più uniforme: le frasi si raggruppano intorno alle 14-22 parole e rimangono tali. I rilevatori misurano questa varianza.

Al secondo posto troviamo la frequenza degli N-grammi. Frasi specifiche ("approfondire", "vibrante arazzo", "nel panorama odierno in rapida evoluzione") compaiono molto più spesso dopo il 2023 rispetto a prima. I rilevatori mantengono librerie di modelli di questi segnali generati dall'IA, e le librerie più grandi vengono aggiornate costantemente.

Infine, un classificatore neurale ottimizzato. La maggior parte degli strumenti moderni di rilevamento dei contenuti integra un modello BERT o RoBERTa-class in aggiunta alle statistiche. Questi algoritmi di apprendimento automatico sono progettati per distinguere i passaggi scritti dall'IA da quelli scritti da esseri umani. Vengono addestrati su testi etichettati, sia umani che generati dall'IA. L'output è un punteggio di probabilità per i contenuti generati dall'IA. GPTZero ora include sette componenti separate: profili stilometrici, ricerca web in tempo reale, analisi della struttura delle frasi e modelli di lunghezza e complessità che contribuiscono al punteggio.

Alcuni rilevatori cercano anche le filigrane. SynthID di Google incorpora un segnale statistico nel testo Gemini. OpenAI ha validato internamente una filigrana per ChatGPT (Wall Street Journal, agosto 2024) ma non l'ha ancora rilasciata. Secondo un sondaggio condotto da OpenAI tra gli utenti, circa il 30% di ChatGPT ha dichiarato che utilizzerebbe meno il prodotto se i propri output fossero contrassegnati da una filigrana. L'applicazione di filigrane alle immagini è più avanzata: OpenAI è entrata a far parte di C2PA nel maggio 2024 e ora allega le credenziali di contenuto agli output DALL-E 3 per impostazione predefinita.

Come funziona l'IA non rilevabile "dietro le quinte".

Gli strumenti di umanizzazione attaccano gli stessi segnali che i rilevatori analizzano, ma al contrario. Ogni strumento è progettato per annullare ciò che il rilevatore ha segnalato. La strategia di marketing si basa sempre su una variante di "un'IA non rilevabile è un riscrittore avanzato che trasforma l'IA in una scrittura dal suono naturale". I fornitori competono per affermare di essere tra i più precisi strumenti di riscrittura dell'IA o tra i più precisi strumenti di rilevamento dell'IA, a seconda del lato della corsa agli armamenti in cui si trovano.

Un tipico processo di produzione inizia in modo semplice. Il testo di input viene elaborato da un parafrasatore online basato sull'intelligenza artificiale. Il modello è ottimizzato per la scrittura umana. Aumenta la perplessità inserendo scelte lessicali inaspettate per umanizzare il testo. Varia la struttura delle frasi per rompere l'uniformità tipica delle raffiche di parole. Sostituisce gli n-grammi segnalati con frasi meno comuni. I fornitori affermano che il loro strumento può trasformare l'output dell'IA per renderlo più umano. Sostengono che sfugga ai controlli anti-IA pur mantenendo il significato originale. Ma produce davvero contenuti di alta qualità? La risposta varia enormemente da prodotto a prodotto. Alcuni promettono di rendere il testo irrintracciabile con un solo clic. Le affermazioni di marketing e la promessa di un testo irrintracciabile non sempre corrispondono alla realtà.

Nel 2023, l'Università del Maryland ha pubblicato il documento teorico più solido sull'argomento. Il team, guidato da Soheil Feizi, ha condotto una ricerca preliminare intitolata "Can AI-Generated Text be Reliably Detected?" (arXiv:2303.11156), in cui veniva avanzata un'affermazione di grande rilievo: un parafrasatore neurale leggero, applicato a un modello linguistico, è in grado di eludere qualsiasi metodo di rilevamento. Filigrane, classificatori neurali, rilevamento zero-shot: tutti quanti. La dichiarazione di Feizi nel comunicato stampa dell'Università del Maryland è stata diretta: "Dovremmo semplicemente abituarci al fatto che non saremo in grado di stabilire con certezza se un documento è stato scritto da un'intelligenza artificiale o da un essere umano".

I migliori strumenti di umanizzazione del testo vanno oltre. Si addestrano contro specifici rilevatori. Il team di sviluppo prende un dataset di testo generato dall'IA da ChatGPT, lo elabora con Turnitin o GPTZero e addestra il parafrasatore a minimizzare il punteggio prodotto dal rilevatore. L'obiettivo è rendere il testo generato dall'IA sufficientemente umano da eludere il classificatore e superare il rilevamento dell'IA. Si tratta essenzialmente di un addestramento avversariale al contrario. L'utente ottiene uno dei tanti strumenti di scrittura basati sull'IA, ottimizzato per battere uno specifico avversario, e la presentazione di marketing per ognuno di essi è una versione di "l'IA non rilevabile riscrive la tua bozza in qualcosa che non verrà rilevato dai controlli IA". I fornitori affermano che la riscrittura rende il contenuto non rilevabile e spesso pubblicizzano che il risultato supera costantemente il rilevamento dell'IA. Questo è anche il motivo per cui i tassi di elusione variano enormemente tra i rilevatori per lo stesso output di umanizzazione. In pratica, l'IA non rilevabile aiuta a ridurre il punteggio, ma raramente lo azzera. Le affermazioni di marketing secondo cui lo strumento trasforma il testo generato dall'IA in una scrittura umana dal suono naturale di solito esagerano la coerenza.

Il compromesso è la qualità. Le recensioni degli utenti su DitchNet e su r/WritingWithAI di Reddit segnalano ripetutamente la stessa lamentela. Gli umanizzatori tendono a inserire frasi di riempimento come "Penso che..." o "Dalla mia esperienza". Frasi del genere vengono inserite dove non c'entrano nulla. I collegamenti tra le frasi si interrompono. Alcuni passaggi appiattiscono il tono di voce del brand. Un recensore ha valutato l'output del livello gratuito "circa 5 su 10 per i contenuti rivolti al pubblico". Un umanizzatore può far scendere il punteggio di un rilevatore dal 99% al 50%. Ma se poi la scrittura risulta strana, il vantaggio è puramente teorico.

Il mercato: Undetectable.ai, BypassGPT, QuillBot e altri

Il leader di mercato è Undetectable.ai. Qui, l'IA è uno strumento, non solo un servizio. La piattaforma combina un umanizzatore basato sull'IA che non può essere rilevato, un rilevatore gratuito e un'estensione per Chrome. L'azienda è stata fondata nel gennaio 2023. I fondatori sono Christian Perry, Devan Leos e Bars Juhasz. Ben Miller si è unito in seguito come COO. La sede legale si trova al 1309 di Coffeen Avenue a Sheridan, Wyoming. I comunicati stampa menzionano anche una sede a Boise, Idaho. Undetectable.ai è autofinanziata. Non sono stati resi noti finanziamenti di venture capital. Secondo PR Newswire, l'azienda ha raggiunto 11 milioni di utenti entro novembre 2024, ovvero 18 mesi dopo il lancio. GetLatka ha stimato per Undetectable.ai un fatturato annuo ricorrente (ARR) di 3,7 milioni di dollari nel settembre 2025. L'azienda conta circa 34 dipendenti. Tracxn ha segnalato un'offerta di fusione e acquisizione non confermata nell'aprile 2025.

Il panorama competitivo è ampio e segmentato in base al prezzo:

| Attrezzo | Fondatore/genitore | Piano di ingresso | Piano superiore | Notevole |

|---|---|---|---|---|

| Undetectable.ai | Cristiano Perry | 9,99 $/mese | Illimitato | 11 milioni di utenti (novembre 2024) |

| StealthGPT | Jozef Gherman | 14,99 $/mese | 29,99 $/mese + 4,99 $ di supplemento | Ricavi pari a 2,2 milioni di dollari (dicembre 2023) |

| BypassGPT | HIX.AI | 6,99 $/mese | 29,99 $/mese | Livello gratuito limitato |

| Bypass HIX | HIX.AI | 20 crediti gratuiti | 49,99 $/mese illimitato | Posizionamento premium |

| Umanizzatore di QuillBot | Learneo (società madre di Course Hero) | 4,17 dollari al mese (annuo) | — | Oltre 50 milioni di utenti nella suite QuillBot |

| Frasi | indipendente | Testo gratuito di 550 parole | 12,99 $/mese illimitato | Fatturazione annuale |

| Walter scrive sull'IA | indipendente | Circa 13 dollari al mese (annuale) | Circa 25 dollari al mese | Posizionamento premium |

Undetectable.ai si propone come una soluzione completa che integra rilevamento e umanizzazione in un'unica dashboard. Il suo sistema di rilevamento vanta un'accuratezza del 99% e "un rilevamento del 100% in studi sottoposti a revisione paritaria". Il suo sistema di umanizzazione si basa su un sistema di punteggio multi-rilevatore, che testa l'output contemporaneamente su circa otto modelli di rilevamento prima di restituire un risultato. L'estensione per Chrome e la copertura in 50 lingue rappresentano un vero punto di forza.

Il leader di categoria nel campo della creazione di contenuti tramite intelligenza artificiale è QuillBot, di proprietà di Learneo (la stessa società madre di Course Hero). La suite di scrittura di QuillBot è utilizzata da oltre 50 milioni di persone e l'AI Humanizer è solo una delle sue numerose funzionalità. L'AI Detector, integrato in QuillBot, supporta fino a 1.200 parole per scansione gratuitamente, con un massimo di sei scansioni al giorno. Entrambi i prodotti sono molto apprezzati dagli studenti, ed è proprio per questo che le università ora monitorano specificamente l'utilizzo di QuillBot.

Il mercato, in termini di dimensioni, è esiguo rispetto alla sua visibilità. L'intelligenza artificiale generativa nel suo complesso rappresentava un settore da 59 miliardi di dollari nel 2025 (Statista). Il mercato dei rilevatori basati sull'IA è di per sé molto più piccolo. Secondo MarketsandMarkets, si aggirava intorno agli 0,58 miliardi di dollari nel 2025, con una proiezione di 2,06 miliardi di dollari entro il 2030. Il segmento degli strumenti di "umanizzazione" è ancora più piccolo e frammentato. Non esiste una cifra aggregata. Una stima dal basso verso l'alto, basata sui ricavi dichiarati da 30 strumenti monitorati, colloca l'intero settore tra i 50 e i 150 milioni di dollari di fatturato annuo ricorrente.

I sistemi di umanizzazione basati sull'intelligenza artificiale riescono davvero a eludere i sistemi di rilevamento?

In breve: a volte, con alcuni rivelatori, con un notevole costo in termini di qualità.

La risposta più completa deriva da test indipendenti. Originality.ai, a sua volta fornitore di sistemi di rilevamento, ha condotto un esperimento controllato sull'umanizzatore di Undetectable.ai. Sia il testo originale di ChatGPT che la versione umanizzata hanno ottenuto un punteggio del 100% di intelligenza artificiale su Originality.ai, con la stessa affidabilità. Writer.com ha mostrato variazioni minime (dal 6% al 3%). GPTZero è sceso dal 100% al 91%. L'effetto di bypass è stato marginale, nella migliore delle ipotesi, sui sistemi di rilevamento più potenti.

Una revisione più approfondita effettuata nel 2026 da Aithor ha prodotto questa tabella, elaborando l'output di Undetectable.ai attraverso quattro rilevatori:

| Rivelatore | Punteggio IA originale | Dopo umanizzatore | Risultato |

|---|---|---|---|

| GPTZero | 97% | 72% | Parzialmente aggirato |

| Originality.ai | 99% | 81% | Non aggirato |

| Copyleaks | Segnalato | Segnalato | Non aggirato |

| ZeroGPT | 94% | 61% | Parzialmente aggirato |

Lo schema si ripete in tutte le recensioni. ZeroGPT e GPTZero sono più facili da abbandonare. Originality.ai e Copyleaks tendono a rimanere. Non è una coincidenza. Originality.ai è stato creato specificamente per il testo parafrasato da avversari, e i suoi benchmark interni (pubblicati nel documento di Pangram presentato al JAIT di gennaio 2026) mostrano un tasso di rilevamento di circa il 97% sui campioni parafrasati da QuillBot.

Le affermazioni dei fornitori sull'accuratezza delle informazioni raramente reggono al vaglio di test indipendenti.

| Rivelatore | Reclamo del fornitore | Test indipendenti |

|---|---|---|

| Turnitin | Precisione del 98%, meno dell'1% di falsi positivi | Circa l'85% di tasso di richiamo (ammesso dallo stesso responsabile prodotto di Turnitin); segnalati come casi generati dall'IA sovrastimati |

| Originality.ai | "Leader del settore" | Forte nell'IA pura, cala nell'IA avversaria |

| Fughe di notizie | 99,12% | Circa il 50% del testo parafrasato da QuillBot |

| GPTZero | "Multistrato a 7 componenti" | 1-2% di falsi positivi nei saggi pre-IA |

| Winston AI | 99,98% | Variabile: 100% sul post del blog, 3% sull'estratto dell'e-book |

| Classificatore OpenAI | n / a | Richiamo del 26% al momento della chiusura nel luglio 2023 |

Nessun rilevatore è perfetto in queste condizioni. I fornitori che affermano il contrario tendono a pubblicare risultati ottenuti con benchmark ristretti, confrontandoli con contenuti non rilevabili generati dall'intelligenza artificiale in condizioni controllate.

Il caso più eclatante è quello del classificatore AI di OpenAI. L'azienda lo ha lanciato nel gennaio 2023, per poi disattivarlo silenziosamente il 20 luglio dello stesso anno. Il motivo: un tasso di veri positivi del 26%. La stessa OpenAI ha ammesso che il modello era "inaffidabile". Non ha ancora rilasciato un sostituto. La sua ricerca sulla filigrana digitale, validata internamente con un'accuratezza del 99,9% secondo il Wall Street Journal, è rimasta inedita a due anni e mezzo di distanza.

Falsi positivi: quando i rilevatori di IA segnalano la scrittura umana

La notizia più importante per il periodo 2024-2026 è che i rilevatori basati sull'intelligenza artificiale falliscono miseramente anche nella direzione opposta.

James Zou di Stanford e il suo team hanno pubblicato "GPT detectors are biased against non-native English writers" su Patterns (luglio 2023, arXiv:2304.02819). Hanno analizzato i temi del TOEFL di studenti non madrelingua inglese utilizzando sette principali sistemi di rilevamento. I sistemi hanno segnalato il 61,22% di questi temi come generati dall'intelligenza artificiale. Gli stessi sistemi hanno segnalato una percentuale quasi nulla di temi scritti da studenti americani di terza media. Il pregiudizio ha una semplice ragione tecnica. La minore diversità lessicale e la sintassi più semplice nell'inglese come seconda lingua appaiono "simili all'IA" agli occhi dei sistemi di valutazione basati sulla perplessità. Il danno è concreto. Colpisce più duramente gli studenti internazionali proprio negli istituti che utilizzano questi strumenti.

Il rapporto del 2024 di Common Sense Media sui danni causati dal rilevamento tramite intelligenza artificiale ha ampliato il quadro. Circa il 10% degli adolescenti in generale ha dichiarato di essere stato falsamente accusato di utilizzare l'IA. La percentuale sale al 20% tra gli adolescenti neri, contro il 7% per gli studenti bianchi e il 10% per gli studenti ispanici. L'impatto sproporzionato è riconducibile ai pregiudizi noti presenti nei modelli linguistici sottostanti, oltre che al modo in cui gli insegnanti reagiscono quando uno strumento segnala uno studente.

Il caso più eclatante di disastro accademico si verificò alla Texas A&M-Commerce nel maggio 2023. Il docente di agraria, il dottor Jared Mumm, incollò i temi degli studenti in ChatGPT e chiese al sistema se li avesse scritti lui stesso. ChatGPT rispose di sì a tutti. (Come sempre, si dimostrò molto utile.) Mumm bocciò quindi metà della classe. L'università fece marcia indietro pochi giorni dopo. Gli studenti usarono la cronologia delle versioni di Google Docs per dimostrare di aver scritto i temi da soli. Il Washington Post, la NBC News, Rolling Stone e Inside Higher Ed si occuparono tutti della vicenda.

Le istituzioni più grandi hanno iniziato a disattivare completamente la funzione di rilevamento dell'IA di Turnitin. UCLA, UC San Diego, Cal State LA e Vanderbilt l'hanno disattivata, citando i falsi positivi e l'impatto sproporzionato sugli studenti internazionali. Il solo sistema della California State University ha speso 1,1 milioni di dollari in software di rilevamento dell'IA nel periodo 2024-2025. La spesa totale del sistema pubblico californiano ha superato i 15 milioni di dollari.

Poi, nell'agosto del 2025, la FTC ha sferrato il colpo decisivo. Workado, la nuova entità proprietaria di "AI Content Detector" di Content at Scale, pubblicizzava un'accuratezza del 98%. Gli investigatori della FTC hanno scoperto che l'accuratezza effettiva sui contenuti di carattere generale era del 53%. Il modello era stato addestrato esclusivamente su testi accademici e le sue prestazioni peggioravano drasticamente su qualsiasi altro tipo di contenuto. L'ordinanza di consenso del 28 agosto 2025 imponeva a Workado di interrompere le affermazioni infondate. L'ordinanza prevedeva anche l'invio di avvisi, redatti dalla FTC, ai clienti esistenti. Si è trattato della prima azione coercitiva della FTC contro un fornitore di sistemi di rilevamento basati sull'intelligenza artificiale per pubblicità ingannevole.

Il confine etico: quando umanizzare il testo dell'IA diventa rischioso

La maggior parte degli utilizzi di un umanizzatore basato sull'IA sono legali. Nella maggior parte dei casi non si tratta nemmeno di imbroglio. Dipende dal contesto.

Un utilizzo legittimo si presenta in questo modo. Il titolare di una piccola impresa fa passare un post del blog scritto con ChatGPT attraverso un software di "umanizzazione". Vuole ammorbidire il tono aziendale. Poi lo modifica prima di pubblicarlo. Uno scrittore non madrelingua inglese usa un software di "umanizzazione" come userebbe un correttore grammaticale. L'obiettivo è affinare la formulazione senza alterarne il significato. Un team di marketing parafrasa le descrizioni interne di un prodotto. Nessuno di questi casi viola una politica o un contratto. Nessuno di questi casi finge che il lavoro sia qualcosa che non è.

L'uso rischioso è di natura accademica. La maggior parte delle università vieta l'uso non autorizzato dell'IA nei corsi. Un numero crescente di atenei ora vieta specificamente gli strumenti di umanizzazione basati sull'IA. L'aggiornamento di Turnitin dell'agosto 2025 ha introdotto una funzione di contrasto mirata ai modelli di umanizzazione più comuni. Presentare un testo umanizzato tramite IA in un compito che richiede un lavoro originale costituisce disonestà accademica. Questo vale per la maggior parte delle normative istituzionali, indipendentemente dal fatto che il sistema di rilevamento rilevi o meno l'illecito. La disonestà consiste nell'inganno sulla paternità del testo. Il metodo di elusione è semplicemente quello utilizzato.

L'editoria commerciale rappresenta un ambito più oscuro. Il New York Times ha interrotto la collaborazione con il critico freelance Alex Preston nel gennaio 2026. Un'indagine aveva rivelato la presenza di paragrafi generati dall'intelligenza artificiale nelle sue recensioni di libri, parafrasati da un articolo del Guardian. Anche il Washington Post ha avuto un episodio simile nel dicembre 2025. Una funzionalità interna di un podcast basata sull'IA conteneva citazioni inventate. L'inchiesta di Semafor ha portato alla luce la notizia. Nessuna delle due redazioni vieta completamente l'uso dell'IA. Entrambe vietano l'uso non dichiarato dell'IA quando il pubblico si aspetterebbe ragionevolmente che il testo sia stato scritto da un essere umano.

Un approccio etico più sicuro potrebbe essere il seguente. Se il pubblico potrebbe essere interessato al fatto che il testo sia stato elaborato con l'ausilio dell'IA, è bene specificarlo. Se il compito assegnato vieta l'uso dell'IA, non utilizzare un software di umanizzazione per mascherare il fatto. Nessuno strumento di IA veramente impercettibile permette di evitare questo dilemma etico, nemmeno quando un'IA impercettibile può migliorare la formulazione. Se si utilizza un software di umanizzazione per rendere il testo meno formale o per correggere la formulazione in L2 nella propria bozza, ci si avvicina maggiormente all'aspetto della revisione in contesti accademici e professionali. La maggior parte delle normative in materia non si pronuncia in merito.

L'orientamento politico si sta spostando verso la provenienza dei contenuti piuttosto che verso il rilevamento. C2PA è l'acronimo di Coalition for Content Provenance and Authenticity (Coalizione per la provenienza e l'autenticità dei contenuti). Incorpora credenziali crittografiche nei contenuti di immagini e video. OpenAI è entrata a far parte del comitato direttivo nel maggio 2024. L'azienda ora allega le credenziali di default agli output DALL-E 3. Adobe, Microsoft, Google, BBC, NYT e Sony sono tutti membri. La specifica C2PA sta procedendo rapidamente verso l'adozione come standard ISO. Per il testo, gli standard equivalenti di watermarking rimangono irrisolti su larga scala. Fino a quando non saranno disponibili, la corsa agli armamenti tra elusione e rilevamento continua.