Unstable Diffusion AI: NSFW Unzensierte Stable Diffusion Fork

Wer im letzten Jahr nach „Unstable Diffusion AI“ gesucht hat, ist wahrscheinlich auf eine Flut widersprüchlicher Ergebnisse gestoßen. Manche beschreiben eine Discord-Community, die innerhalb von 50.000 Mitgliedern im November 2022 auf rund 97.000 im Dezember und dann auf über 300.000 in Drittanbieter-Verzeichnissen bis 2025 angewachsen ist. Andere beschreiben eine elegante, kostenpflichtige Web-App mit einer kostenlosen Version und vier benannten Modellen. Verwirrend ist, dass beides real ist, beide den gleichen Namen tragen und beide auf derselben Idee basieren: Man nehme die stabile Diffusion, entferne die Sicherheitsmechanismen und lasse das Internet generieren, was es will.

Dieser Leitfaden bringt Klarheit in die Materie. Wir erklären, was Unstable Diffusion AI im Jahr 2026 tatsächlich ist, wie es sich zu Stable Diffusion von Stability AI verhält, die Geschichte des Kickstarter-Verbots im Dezember 2022, die Modellpalette, die Preise, die noch offenen ethischen Fragen und die Alternativen, die es bereits überholt haben. Ziel ist eine verständliche Erklärung für interessierte Außenstehende, kein Werbetext.

Was instabile Diffusions-KI im Jahr 2026 tatsächlich ist

Der Name „Unstable Diffusion“ umfasst mehrere sich überschneidende Dinge, die häufig verwechselt werden. Ursprünglich handelt es sich um eine Community, die im August 2022 als Reddit-Thread begann und fast umgehend zu Discord wechselte, wo sie sich zu einem zentralen Anlaufpunkt für unzensierte Stable-Diffusion-Ergebnisse und feinabgestimmte Gewichtungen entwickelte. Die öffentlichen Gesichter des Projekts sind CEO Arman Chaudhry und Co-Administratorin AshleyEvelyn, die unter dem Dach der Muttergesellschaft Equilibrium AI arbeiten.

Diese Discord-Community hat die kostenpflichtige Webplattform unstability.ai ins Leben gerufen. Diese bietet Abonnements für vier firmeneigene Fine-Tune-Algorithmen (Merlin, Echo, Izanagi, Pan) an, die mit einem kuratierten Datensatz von über 30 Millionen Bildern mit erotischem Inhalt trainiert wurden. Es handelt sich um dasselbe Projekt, nicht um eine Kopie. Die Verwirrung entsteht durch einen separaten Online-Shop von BasedLabs, der unstability.ai unter dem Namen „Unstable Diffusion“ in seinem Tools-Verzeichnis führt, wodurch beide Namen in denselben Suchergebnissen erscheinen.

Eine dritte Verwendung des Namens ist eher ungenau und journalistisch: Jede Open-Source-Fork oder Feinabstimmung von Stable Diffusion, die Inhalte mit nicht jugendfreiem Inhalt erzeugen kann, unabhängig vom Entwickler. Diese dritte Bedeutung hat an Bedeutung verloren, da die Community mittlerweile auf Weiterentwicklungen wie Pony Diffusion V6 XL und FLUX-basierte Feinabstimmungen umgestiegen ist, die strukturell nichts mit dem Unstable Diffusion-Team zu tun haben. In diesem Leitfaden werden wir daher immer genau angeben, welche Unstable Diffusion-Version gemeint ist, wenn eine Zahl, ein Preis oder ein Modellname nur für eine davon gilt.

Instabile vs. stabile Diffusion: Zwei Modelle

Kurz zur Erinnerung: Stable Diffusion ist ein Text-zu-Bild-Modell, das im August 2022 von Stability AI, CompVis und Runway als Open Source veröffentlicht wurde. Es handelt sich um ein Diffusionsmodell. Das bedeutet, es beginnt mit zufälligem Rauschen und entrauscht dieses schrittweise, gesteuert durch Ihre Texteingabe. Version 1.4 lief auf einer handelsüblichen GPU mit 10 GB VRAM. Die Lizenz war sehr freizügig. Diese Offenheit ist der Grund für die schnelle Verbreitung des Modells und die Existenz jeglicher Abspaltungen, einschließlich Unstable Diffusion.

Stable Diffusion wurde standardmäßig mit einem CLIP-basierten NSFW-Filter und einem Trainingsdatensatz ausgeliefert, der laut Stability AI selbst nur etwa 2,9 % Inhalte für Erwachsene enthielt. Das Basismodell konnte also theoretisch Nacktheit generieren. Allerdings war sein Verständnis der menschlichen Anatomie in diesen Kontexten ungenau, und der Filter störte die Darstellung ohnehin meist.

Am 24. November 2022 erschien dann Stable Diffusion 2.0. Mit dieser Version wurden viele nicht jugendfreie Inhalte komplett aus den Trainingsdaten entfernt. Die Community reagierte empört. Emad Mostaque, der damalige CEO von Stability AI, versuchte, dies zu erklären. Man könne Kinder und nicht jugendfreie Inhalte nicht im selben offenen Modell haben, argumentierte er, da diese Kombination den Weg für kinderpornografisches Material ebne. Die Community hörte nur noch Zensur. Innerhalb weniger Wochen kursierten im Internet unzählige Pipelines und optimierte Checkpoints, die die von Stability entfernten Inhalte wiederherstellen sollten.

Unstable Diffusion ist der sichtbarste Teil dieser Gegenbewegung. Das Discord-Team konzentrierte sich darauf, von Freiwilligen kuratierte Datensätze mit nicht jugendfreien Inhalten zu sammeln und Stable Diffusion in Richtungen zu optimieren, die Stability AI niemals angehen würde. Das Produkt unstability.ai folgte derselben Logik, verpackte sie jedoch in eine gehostete Webanwendung mit kostenpflichtigen Tarifen. Im Kern basiert es jedoch auf derselben latenten Diffusionsarchitektur. Was sich ändert, sind der Datensatz, die Sicherheitsebene und das darauf aufgesetzte Geschäftsmodell.

Die Ursprünge von Discord, das Kickstarter-Verbot und der Patreon-Wechsel

Das Unstable Diffusion-Subreddit ging im August 2022 online, nur wenige Wochen nachdem Stable Diffusion 1.4 als Open Source veröffentlicht worden war. Fast über Nacht verlagerte sich die Aktivität auf Discord. Laut einem TechCrunch-Profil vom 17. November 2022 hatte der Server bereits rund 50.000 Mitglieder. Sechs Wochen später waren es über 97.000. Drittanbieter-Discord-Tracker berichteten 2025 von bis zu 344.000 Mitgliedern, diese Zahlen stammen jedoch von Verzeichnissen und nicht von Discord selbst, weshalb sie als unsicher gelten.

Eine Patreon-Seite ging am 13. September 2022 online. Ende 2022 erreichte sie einen monatlichen Höchstwert von rund 2.500 US-Dollar. Danach stagnierte sie. Im April 2026 verzeichnete Graphtreon monatliche Einnahmen von etwa 1.998 US-Dollar, generiert von 149 zahlenden Unterstützern. Damit belegte sie Platz 336 im Graphtreon-Ranking für „Adult Writing“. Das sind 20 Prozent weniger als der Höchstwert von 2022, obwohl der Markt für KI-generierte Inhalte für Erwachsene seitdem auf geschätzte 2,5 Milliarden US-Dollar innerhalb eines Online-Marktes für Erwachsenenunterhaltung von rund 73,6 Milliarden US-Dollar angewachsen ist. Die Geschichte lautet also nicht mehr „Der Pionier dominiert den Markt“, sondern „Der Pionier stagniert langsam“.

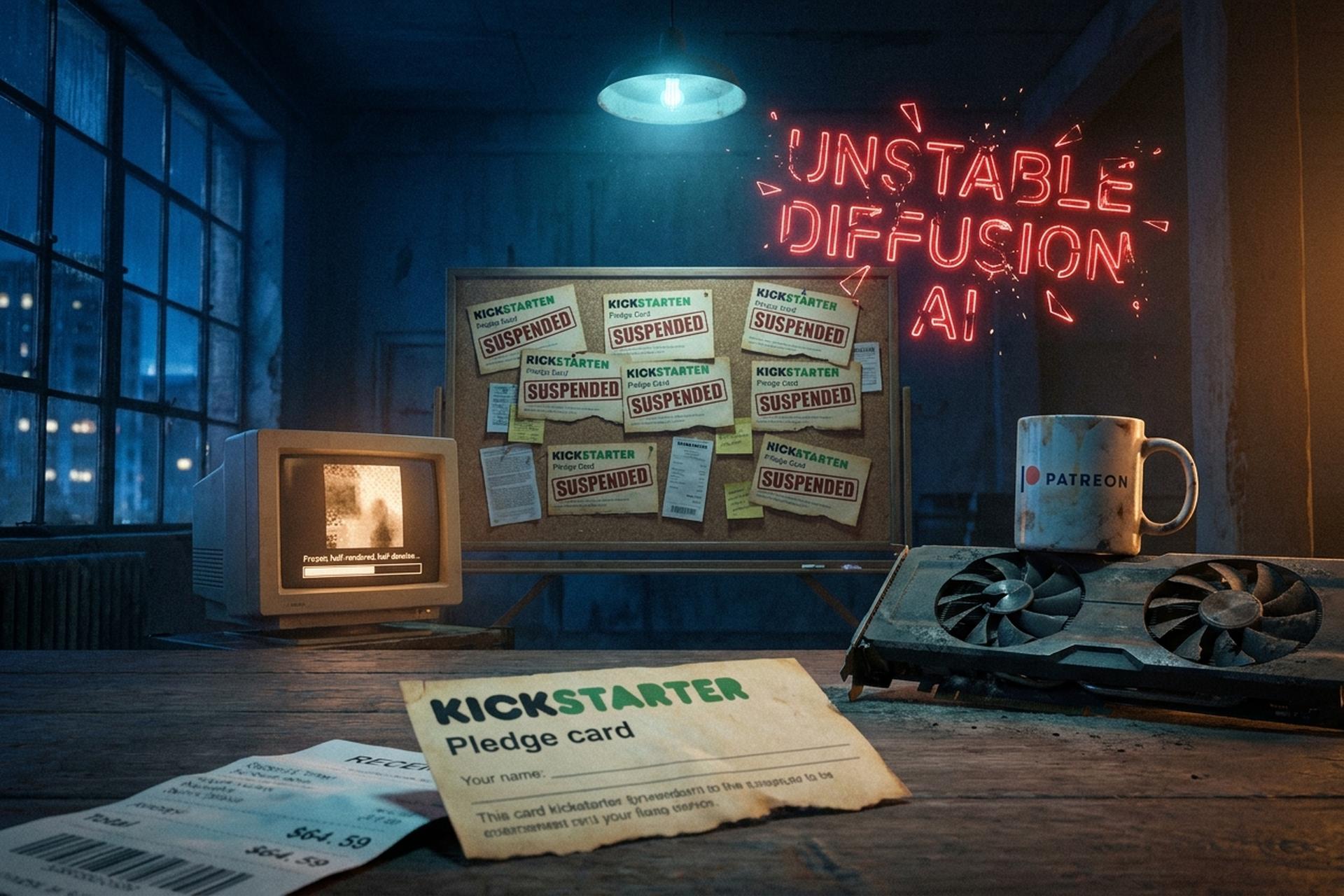

Das Kickstarter-Kapitel ist unvergessen. Die Kampagne startete im Dezember 2022 mit einem Ziel von 25.000 US-Dollar und erreichte dieses innerhalb eines Tages. Bis zum 21. Dezember 2022, als Kickstarter die Kampagne beendete, hatten 867 Unterstützer rund 56.000 US-Dollar zugesagt. Kickstarter-CEO Everette Taylor erklärte dazu: „Kickstarter muss und wird immer an der Seite kreativer Arbeit und der Menschen dahinter stehen.“ Das Alles-oder-Nichts-Modell bedeutete, dass jeder gespendete Dollar zurückerstattet wurde. Arman Chaudhrys Antwort war unmissverständlich: „Kickstarters Nachgeben gegenüber einer lauten Gruppe von Künstlern enttäuscht uns zwar, aber wir und unsere Unterstützer werden nicht nachgeben.“

Das Team kehrte zu Patreon zurück und fügte direkte Spenden via Stripe hinzu. Insgesamt kamen so vielleicht 26.000 US-Dollar zusammen. Doch die eigentliche Sensation ereignete sich erst Jahre später. Am 23. Mai 2025 stellten Visa und Mastercard die Zusammenarbeit mit CivitAI, dem größten Portal für KI-Checkpoints mit nicht jugendfreien Inhalten, ein, und die Seite wechselte zu Kryptowährungen wie USDC und ETH. Dasselbe Muster wiederholte sich 2022 bei Unstable Diffusion – drei Jahre später, aber in einem um ein Vielfaches größeren Ausmaß.

Die folgende Tabelle fasst die Finanzierungsgeschichte von Unstable Diffusion zusammen.

| Datum | Quelle | Menge | Status |

|---|---|---|---|

| 13. September 2022 | Patreon-Start | bis zu ca. 2.500 US-Dollar/Monat bis Ende 2022 | Aktiv |

| Dezember 2022 | Kickstarter | 56.000 US-Dollar von 867 Unterstützern (Ziel: 25.000 US-Dollar) | Ausgesetzt am 21. Dezember 2022; Rückerstattung |

| 2023 | Stripe-Direktspenden | kumulativ ca. 26.000 US-Dollar | Aktiv |

| April 2026 | Patreon heute | ~1.998 $/Monat von 149 Kunden | Aktiv, Platz 336 im Bereich Erwachsenenliteratur |

| 2023–2026 | unstability.ai-Abonnements | Nicht offengelegt | Aktive kreditbasierte Stufen |

Wie das instabile Diffusionsmodell nicht jugendfreie Bilder erzeugt

Im Hintergrund nutzen beide Varianten von Unstable Diffusion dieselbe latente Diffusionspipeline wie die Basisversion von Stable Diffusion. Der Benutzer gibt eine Eingabeaufforderung ein. Der Text wird zu einem Embedding, das das Modell auf einen Bereich seines gelernten Bildraums verweist. Anschließend entrauscht das Modell iterativ ein zufälliges latentes Bild, Schritt für Schritt, bis es der Eingabeaufforderung ausreichend genau entspricht, um den Vorgang zu beenden. Die Erzeugung des endgültigen Bildes erfordert typischerweise 20 bis 50 Entrauschungsschritte, abhängig von der gewählten Voreinstellung für Geschwindigkeit versus Qualität.

Wenn die Architektur also dieselbe ist, was unterscheidet sie dann tatsächlich von der Basis-Stable-Diffusion? Drei Dinge, ungefähr in dieser Reihenfolge ihrer Wichtigkeit.

Zunächst zum Datensatz. Stability AI wurde hauptsächlich auf jugendfreie Inhalte optimiert und entfernte einen Großteil der Bilder mit explizitem Inhalt aus seinem Trainingskorpus. Das Team von Unstable Diffusion hat einen Datensatz mit über 30 Millionen Bildern mit explizitem Inhalt erstellt und pflegt diesen, der durch freiwillige Kuratierung zusammengetragen wurde. Dadurch werden die Lücken in der Anatomie- und Genreabdeckung geschlossen, in denen Stability Diffusion von Haus aus Schwächen aufwies.

Zweitens der Filter. Stable Diffusion-Checkpoints von Stability AI enthalten standardmäßig einen CLIP-basierten Sicherheitsklassifikator, der unsichere Ausgaben kennzeichnet und unkenntlich macht. Unstable Diffusion-Derivate entfernen diesen Klassifikator oder deaktivieren ihn. Auf unstability.ai wird der Standardfilter durch eine Altersverifizierung ersetzt, die nur dann aktiviert wird, wenn der Nutzer explizit nach Inhalten für Erwachsene fragt. Alle jugendfreien Inhalte werden einfach abgespielt.

Drittens, die Schutzmechanismen. Selbst die liberalsten Forks versuchen, eindeutig illegale Inhalte zu blockieren. Die gängige Richtlinie: Alles, was Minderjährige oder nicht einwilligende Personen zeigt, wird sofort und anschließend erneut moderiert. In der Praxis? Hängt vom Betreiber ab. Manche moderieren rigoros, andere eher weniger.

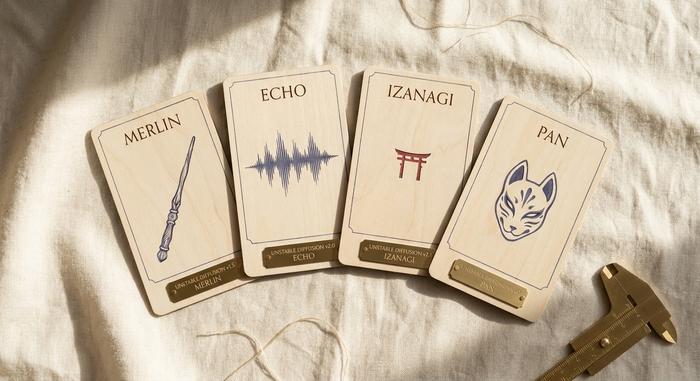

Im Modellangebot: Merlin, Echo, Izanagi, Pan

Die Markenproduktpalette ist größtenteils eine Eigenkreation von unstability.ai, stellt aber aktuell das bekannteste Aushängeschild der Marke dar. Anstelle von Versionsnummern wie „Stable Diffusion 1.5“ oder „SDXL 1.0“ gruppiert die Plattform ihre Checkpoints nach stilistischer Ausrichtung.

| Modell | Entwickelt für | Anmerkungen |

|---|---|---|

| Merlin | Universalgenerator | Standardoption, ausgewogener Realismus und Stilisierung |

| Echo | Fotorealistische Porträts und Produktaufnahmen | Am besten geeignet für die Darstellung von menschlichen Abbildern und Hautdetails. |

| Izanagi | Anime- und Manga-Kunst | Ausgerichtet auf illustrierte und stilisierte Referenzen |

| Pfanne | Anthropomorphe und Fellkunst | Ein Nischenprodukt, aber von der Community stark nachgefragt. |

Es gibt auch eine Reihe paralleler Geschwindigkeitsstufen. Unstable Diffusion v2.6 ist die standardmäßige, auf Geschwindigkeit optimierte Version mit 6 bis 8 Sekunden pro Bild. Unstable Diffusion XL benötigt 12 bis 15 Sekunden für höhere Auflösungen. Unstable Diffusion Photoreal eignet sich für Porträtaufnahmen. Keine dieser Versionen basiert direkt auf den ursprünglichen Feinabstimmungen der Discord-Community, obwohl das Marketing stark auf die gemeinsame Marke setzt. Um die Ausgabequalität zu beurteilen, empfiehlt sich ein direkter Vergleich mit der Basisversion von SDXL oder einem ähnlich optimierten, gängigen CivitAI-Checkpoint.

Preise, Guthaben und Plattformzugang für Kreative

Die Preisgestaltung der Webplattform unstability.ai folgt dem üblichen SaaS-Muster. Es gibt eine kostenlose Version mit täglichen Credits, kostenpflichtige Versionen, die unbegrenzte Generierungen und die kommerzielle Nutzung ermöglichen, sowie eine Premium-Version, die zusätzlich eine private Generierungshistorie bietet. Die Generierungsgeschwindigkeit ist durch einen monatlich wiederaufgefüllten „Fast Credits“-Pool begrenzt.

| Stufe | Kosten / Monat | Tagesguthaben | Schnelle Gutschriften / Monat | Kommerzielle Nutzung |

|---|---|---|---|---|

| Frei | 0 € | Begrenzte Tageszulage | Keiner | NEIN |

| Basic | 14,99 $ | 150 | 1.000 | NEIN |

| Prämie | 29,99 $ | Unbegrenzt | 3.000 | Ja |

| Pro | 59,99 $ | Unbegrenzt | 6.000 | Ja (private Daten) |

Der Discord-Zugang für die ursprüngliche Community ist separat. Die Teilnahme an Discord ist weiterhin kostenlos, der Server fungiert jedoch als Chat-Server und nicht als Backend für die Modellgenerierung. Modelle, die in der Community trainiert oder geteilt werden, laufen in der Regel lokal auf der eigenen GPU des Nutzers, mithilfe von Tools wie AUTOMATIC1111s Stable Diffusion WebUI, ComfyUI oder InvokeAI, oder werden zum Download auf Checkpoint-Hubs wie CivitAI hochgeladen. Es gibt keine zentrale Bezahlschranke innerhalb der Community.

Für die meisten Kreativen, die sich 2026 damit befassen, stehen praktisch drei Wege zur Wahl: Entweder sie schließen ein Abonnement für eine gehostete, unzensierte Plattform ab, sie führen einen offenen Checkpoint lokal auf einer 12- oder 16-GB-Grafikkarte aus oder sie nutzen eine Plattform ähnlich CivitAI, die viele optimierte Modelle mit einem großzügigen Gratis-Kontingent und einem zusätzlichen Guthabensystem bündelt. Jeder dieser Wege bringt Kompromisse in Bezug auf Datenschutz, Geschwindigkeit, Modellvielfalt und Inhaltsrichtlinien mit sich.

Kontroverse um unzensierte KI-Inhalte: Ethik und CSAM

Man kann nicht ernsthaft über instabile Diffusion schreiben, ohne die ethische Dimension zu berücksichtigen. Drei Probleme tauchen immer wieder auf. Jedes davon ist mit einem realen Vorfall verbunden.

Nehmen wir zunächst das Thema nicht einvernehmlicher Bildmaterial. Der prägende Fall ist der Atrioc-Skandal vom 30. Januar 2023. Der Twitch-Streamer Brandon Ewing enthüllte versehentlich während seines Livestreams einen Browser-Tab. Der Tab? Eine kostenpflichtige Website, die Deepfake-Pornos seiner Kolleginnen verkaufte: Pokimane, QTCinderella, Maya Higa und Sweet Anita. Er entschuldigte sich am nächsten Tag vor laufender Kamera. Berichten zufolge überwies er außerdem 60.000 US-Dollar, um die Kosten für die rechtlichen Schritte gegen die betroffenen Streamer zu decken. Twitch aktualisierte im März 2023 stillschweigend seine Nutzungsbedingungen, um die Erstellung von Deepfake-Inhalten dauerhaft zu unterbinden. Dieser eine Vorfall trug mehr dazu bei, die Verbreitung von Open-Source-Software in den Mainstream-Medien zu bringen als jede technische Debatte zuvor.

Nun zum Problem mit dem Datensatz. Im Dezember 2023 analysierte das Stanford Internet Observatory den LAION-5B-Trainingsdatensatz mit PhotoDNA. Dabei wurden 1.008 verifizierte Bilder von sexuellem Kindesmissbrauch darin identifiziert. LAION-5B war derselbe Datensatz, mit dem Stable Diffusion 1.5 trainiert wurde. LAION zog ihn zurück und veröffentlichte im August 2024 eine bereinigte Version, Re-LAION-5B. Das Problem: Jedes Modell, das mit dem Originaldatensatz trainiert wurde, ist von dieser Kontamination betroffen – auch SD 1.5. Dasselbe gilt für das gesamte NSFW-Feinabstimmungssystem, das darauf aufbaut. Einige Forks haben die Arbeit geleistet, das Modell neu zu trainieren oder die bereinigten Bilder zu entfernen. Andere haben einfach weiterveröffentlicht. Wenn Sie ein solcher Datensatz kaufen, überprüfen Sie, mit welchem Datensatz ein bestimmter Checkpoint tatsächlich trainiert wurde. Verlassen Sie sich nicht auf die Angaben des Anbieters.

Das dritte Problem ist die regulatorische Unsicherheit. Alle großen Zahlungsdienstleister stufen KI-generierte Bilder für Erwachsene im Jahr 2026 als risikoreich ein. Der Zahlungsdienstleister von CivitAI stellte den Dienst am 23. Mai 2025 aufgrund nicht jugendfreier Inhalte ein, woraufhin die Website über Nacht auf Kryptowährungen umstieg. Stability AI aktualisierte seine Nutzungsrichtlinien am 31. Juli 2025 und untersagte die Erstellung expliziter Bilder mit seinen aktuellen Modellen. Die neue Richtlinie gilt jedoch nicht rückwirkend für SD 1.5 und SDXL, die weiterhin das Rückgrat der Community für nicht jugendfreie Inhalte bilden. Das EU-KI-Gesetz und eine wachsende Zahl von US-Bundesstaatengesetzen schreiben nun eine Offenlegungspflicht vor, wenn KI-generierte Inhalte realistische Menschen darstellen. Wer heute unzensierte KI kommerziell nutzt, agiert also in einem rechtlichen Rahmen, der zum Zeitpunkt der Einführung von Unstable Diffusion noch nicht existierte.

Diese Entwicklungen zerstören die Technologie nicht. Sie bedeuten lediglich, dass die Personen, die sie entwickeln, hosten und nutzen, nun mit Fragen der Einwilligung, der Datenqualität und der Offenlegung konfrontiert sind, die in der frühen Phase weitgehend ignoriert wurden.

Alternativen zur instabilen Diffusion im Jahr 2026: FLUX, Pony, Kling

Instabile Diffusion steht nicht mehr im Mittelpunkt. Die Modell- und Plattformlandschaft hat sich seit dem Discord-Skandal von 2022 grundlegend verändert. Diejenigen, die 2026 ernsthaft und unzensiert an KI arbeiten wollen, suchen zunächst nach anderen Ansätzen. Die vielversprechendsten Alternativen lassen sich in drei Kategorien einteilen.

Kategorie 1: Unzensierte Checkpoints mit offenem Gewicht, die Sie auf Ihrem eigenen Rechner ausführen. Pony Diffusion V6 XL erschien im Januar 2024 bei CivitAI und etablierte sich schnell als Standard-SDXL-Feinabstimmung für NSFW-Inhalte. Es wurde vollständig außerhalb der Unstable-Diffusion-Pipeline entwickelt und vertrieben. Pony und sein neuerer Ableger Illustrious dominieren nun das Genre der stilisierten Erwachseneninhalte. Anime-basierte Checkpoints und verschiedene SDXL-Feinabstimmungen füllen dieselbe Nische mit unterschiedlicher Ästhetik. Für eine komfortable Ausführung benötigen Sie eine lokale GPU mit mindestens 12 GB VRAM.

Zweiter Bereich: die nächste Generation von Basismodellen. FLUX.1 von Black Forest Labs erschien im August 2024 und setzte neue Maßstäbe für schnelle Anpassung und Fotorealismus. Die Open-Wight-Variante FLUX.1-dev zog innerhalb weniger Wochen explizite LoRA-Bilder aus der Community an. Stability AI veröffentlichte Stable Diffusion 3 im Februar 2024 und das größere Stable Diffusion 3.5 im Oktober 2024. Die bekannten Anatomiefehler von SD3 bremsten die Akzeptanz in der unzensierten Community. Stability AI selbst hat sich zurückgezogen. Emad Mostaque trat am 23. März 2024 aufgrund finanzieller Schwierigkeiten zurück. Das Policy-Update vom Juli 2025 verbietet nun offiziell die explizite Generierung von Daten auf den aktuellen Modellen.

Kategorie drei: Video. Die Ära der generativen KI, die sich ausschließlich auf Bilder konzentrierte, ist teilweise vorbei. Kling, Runway Gen-3 und Gen-4, OpenAIs Sora und Googles Veo haben die Grenzen des Machbaren im Videobereich erweitert, und einige ermöglichen Inhalte für Erwachsene mit Altersverifizierung auf externen Plattformen. Unstable Diffusion hat diesen Schritt im Videobereich nie vollzogen. Dies ist mit ein Grund dafür, dass seine kulturelle Bedeutung seit 2023 stillschweigend abgenommen hat.

Die folgende Tabelle vergleicht die wichtigsten Optionen.

| Werkzeug | Typ | Lokal oder gehostet | NSFW-fähig | Am besten geeignet für |

|---|---|---|---|---|

| Instabile Diffusion (Discord) | Gemeinschaft + Kontrollpunkte | Lokal | Ja | Kostenlos, zum Selbermachen |

| Unstability.ai | Webplattform | Gehostet | Ja (beschränkt) | Einfaches, unzensiertes Hosting |

| Pony Diffusion v6 + | Kontrollpunkt öffnen | Lokal | Ja | Stilisierte Kunst für Erwachsene |

| FLUX.1-dev | Basismodell + Feinabstimmungen | Lokal oder gehostet | Mit Feinabstimmung | Beste Qualität der Ära 2024 |

| SDXL + CivitAI-Checkpoints | Basis + Gemeinschaft | Lokal oder gehostet | Mit Feinabstimmung | Vielfalt der Stile |

| Kling 2.0 | Videogenerator | Gehostet | Begrenzte, abgeschlossene Anlage | Kurze, unzensierte Clips |

Die richtige Wahl hängt von der Leistung Ihrer Grafikkarte, Ihren Prioritäten (Hosting oder Eigenbau) und davon ab, ob Sie Fotos oder Videos benötigen. Keine dieser Lösungen kann das ursprüngliche Unstable Diffusion-Erlebnis vollständig ersetzen. Der Markt ist fragmentiert, und die Marke ist nicht mehr so dominant wie im Kickstarter-Jahr.