Was ist Viggle AI? Das Meme-Tool und Animationswerkzeug, das viral ging

Jemand hat eine Figur aus einem Stockfoto in einen Fortnite-Tanz eingefügt, und es sah … gut aus. Nicht nur „gut für KI“, sondern richtig gut. Flüssige Bewegungen. Physik, die Sinn ergab. Das Gewicht der Figur verlagerte sich beim Drehen natürlich, ihre Kleidung bewegte sich wie echter Stoff, und das Ganze dauerte vielleicht zwei Minuten. Das Video ging Anfang 2024 auf Twitter viral, und innerhalb einer Woche sprach jeder über Viggle AI.

Ich sah den Clip, hielt ihn für gezieltes Marketingmaterial und probierte es selbst aus. Ich lud ein Foto hoch, wählte eine Tanzbewegungsvorlage und wartete etwa 90 Sekunden. Das Ergebnis war zwar nicht perfekt, aber wirklich beeindruckend. Die Figur auf meinem Foto tanzte. In 3D. Mit realistischer Physik. Kostenlos. Auf einem Discord-Bot. In diesem Moment wurde mir klar, dass dieses Tool sich vom üblichen KI-Video-Hype abhebt.

Viggle wuchs innerhalb eines Jahres von null auf 1,6 Millionen Discord-Mitglieder. Es wurde 2024 zur treibenden Kraft hinter der Hälfte aller KI-Meme-Inhalte in sozialen Medien. Die dahinterstehende Technologie, ein Modell namens JST-1, das tatsächlich 3D-Physik versteht, anstatt nur 2D-Pixel zu analysieren, stellt eine echte Innovation im Bereich KI-Video dar. Dieser Artikel erklärt, was Viggle ist, wie JST-1 funktioniert, wie man das Tool Schritt für Schritt anwendet und wie es sich im Vergleich zu den etablierten Anbietern von KI-Videogenerierung schlägt.

Was Viggle AI ist und warum es wichtig ist

Viggle AI ist eine Plattform für Charakteranimationen, die ein Standbild einer Person oder Figur in Bewegung versetzt. Nicht auf die ruckartige Art, wie es die meisten KI-Tools mit Zoomen und Schwenken auf einem Foto tun. Viggle generiert echte 3D-Bewegung. Die Figur dreht sich, geht, tanzt, springt, und die Bewegung berücksichtigt physikalische Gesetze: Schwerkraft, Gewichtsverlagerung, Stofffall und Impuls.

Das Unternehmen wurde von einem Team mit Erfahrung in Computer Vision und 3D-Modellierung gegründet. Sie entwickelten JST-1 (Joint Space-Time) und beschreiben es als „das erste Video-3D-Grundlagenmodell mit fundiertem physikalischem Verständnis“. Diese Aussage verdient nähere Betrachtung, denn sie unterscheidet Viggle von allen anderen Anbietern in seiner Kategorie.

Die meisten KI-Videotools (Runway Gen-3, Pika, Kling) generieren Videos, indem sie anhand des vorherigen Frames vorhersagen, wie der nächste aussehen soll. Sie arbeiten im zweidimensionalen Pixelraum. Das Ergebnis sieht gut aus, solange sich eine Figur nicht seitwärts dreht, mit einem Objekt interagiert oder sich auf eine Weise bewegt, die in den Trainingsdaten nicht abgedeckt ist. Dann wird es seltsam: Gliedmaßen scheinen durch den Körper hindurchzugehen, Proportionen verschieben sich, die Schwerkraft scheint außer Kraft gesetzt zu sein.

JST-1 verfolgt einen anderen Ansatz. Es rekonstruiert eine 3D-Darstellung der Figur aus dem Eingabebild, erkennt deren Skelettstruktur und animiert dieses 3D-Modell anschließend nach physikalischen Gesetzen, bevor das finale 2D-Video gerendert wird. Die Figur besitzt Volumen, Gewicht und Gelenke. Beim Tanzen stoßen sich die Füße mit der richtigen Kraft vom Boden ab. Bei Drehungen verschiebt sich die Perspektive korrekt, da das Modell weiß, dass die Figur neben einer Vorderseite auch eine Rückseite hat.

Ist das Ergebnis perfekt? Nein. Komplexe Szenen erzeugen immer noch Artefakte. Interaktionen mehrerer Charaktere sind unzuverlässig. Und das Modell funktioniert am besten mit Cartoon- und Anime-Charakteren, weniger mit fotorealistischen Menschen. Aber für die Animation einzelner Charaktere aus einem Standbild liefert Viggle Ergebnisse, die ich bei keinem anderen Consumer-Tool in dieser Preisklasse gesehen habe. Und es ist kostenlos.

So verwenden Sie Viggle AI: Eine Schritt-für-Schritt-Anleitung

Viggle läuft an zwei Stellen: als Web-App und als Discord-Bot. Der Discord-Bot wurde zuerst entwickelt und ist nach wie vor die primäre Schnittstelle für die Community. Im Folgenden wird die Funktionsweise der einzelnen Kernfunktionen erklärt.

Mix: Das Hauptereignis

Mix war der Schlüssel zum viralen Erfolg von Viggle. Man gibt zwei Eingaben: ein Bild einer Figur und ein Video mit Bewegung. Viggle extrahiert die Figur aus dem Bild, ordnet sie der Bewegung im Video zu und rendert das Ergebnis.

Schritt für Schritt: Öffne die Viggle-Web-App oder Discord. Verwende den Befehl `/mix`. Lade ein klares Bild einer Person hoch (eine Person, gut sichtbarer Körper, gute Beleuchtung). Lade ein kurzes Video mit der gewünschten Bewegung hoch (Tanz, Gehen, Geste). Wähle deinen Hintergrund: Greenscreen, Weiß oder Original. Klicke auf „Generieren“. Warte 60–120 Sekunden. Du erhältst ein Video, in dem deine Person die Bewegung aus dem Referenzclip ausführt.

Die Ergebnisse hängen stark von Ihren Eingaben ab. Klare Charakterbilder mit sichtbaren Gliedmaßen eignen sich am besten. Unordentliche Hintergründe, verdeckte Körperteile oder extreme Winkel verwirren das Modell. Bewegte Videos funktionieren am besten, wenn sie eine einzelne Person mit klaren, deutlichen Bewegungen zeigen. Subtile Gesten sind schwieriger zu erfassen als große Tanzbewegungen.

Bewegung: Animation mit erhaltenem Hintergrund

Move funktioniert ähnlich wie Mix, behält aber den ursprünglichen Hintergrund der Figur bei. Laden Sie ein Bild und ein Video der Figur hoch, und das System animiert die Figur, wobei die Szene, in der sie sich befindet, erhalten bleibt. Das ist nützlich, wenn Kontext gewünscht ist: eine Person am Schreibtisch, die plötzlich zu tanzen beginnt, oder eine Person im Park, die winkt.

Ideen entwickeln und stilisieren

Ideate generiert Videokonzepte anhand von Textvorgaben. Beschreiben Sie Ihre Wünsche, und das Modell erstellt ein Video. Mit Stylize können Sie den visuellen Stil einer bestehenden Figur oder Animation ändern. Beide Funktionen sind experimenteller als Mix and Move, und die Ergebnisse sind weniger vorhersehbar.

Der Befehl /character

So können Sie eine dauerhafte Figur erstellen, die Sie in mehreren Animationen wiederverwenden können. Laden Sie ein Bild einmal hoch, speichern Sie es als Figur und verwenden Sie es in zukünftigen Mixen, ohne es jedes Mal erneut hochladen zu müssen. Für Content-Ersteller, die eine wiederkehrende Figur (ein Maskottchen, einen Avatar, eine Markenfigur) erstellen, spart dies viel Zeit.

Viggle-Preisgestaltung: Was ist kostenlos und was kostet Geld

Viggle verwendet ein Freemium-Modell, und das kostenlose Angebot ist im Vergleich zu den meisten KI-Videotools überraschend großzügig.

| Besonderheit | Frei | Prämie |

|---|---|---|

| Generationen pro Tag | Begrenzt (variiert) | Höhere Grenzwerte |

| Warteschlangenpriorität | Standard (kann langsam sein) | Prioritätsverarbeitung |

| Videolänge | Bis zu 30 Sekunden | Bis zu 30 Sekunden |

| Auflösung | Standard | Höhere Qualität |

| Wasserzeichen | Ja | ENTFERNT |

| Kommerzielle Rechte | Ja (lizenzfrei) | Ja (lizenzfrei) |

| Mehrere Zeichen | Nur Vorlagen | Mehr Optionen |

Die Regelungen zu den kommerziellen Rechten sind bemerkenswert. Viggle gibt an, dass die generierten Inhalte „komplett lizenzfrei“ sind und die „uneingeschränkten kommerziellen Nutzungsrechte für jedes erstellte Video“ gelten. Das ist ungewöhnlich. Die meisten KI-Videoplattformen beschränken die kommerzielle Nutzung entweder in den kostenlosen Tarifen oder erheben Gebühren für Unternehmenslizenzen. Viggle hingegen erlaubt die Nutzung der erstellten Videos für Marketing, soziale Medien oder jeden anderen kommerziellen Zweck ohne zusätzliche Kosten.

Die Preise für das Premium-Abo haben sich im Laufe der Zeit geändert und variieren je nach Region. Aktuelle Preise finden Sie direkt auf viggle.ai. Bei meiner letzten Überprüfung kostete das kostenpflichtige Abo unter 20 US-Dollar pro Monat und beinhaltete hauptsächlich das Entfernen von Wasserzeichen, eine höhere Priorität in der Warteschlange und ein erhöhtes tägliches Generierungslimit.

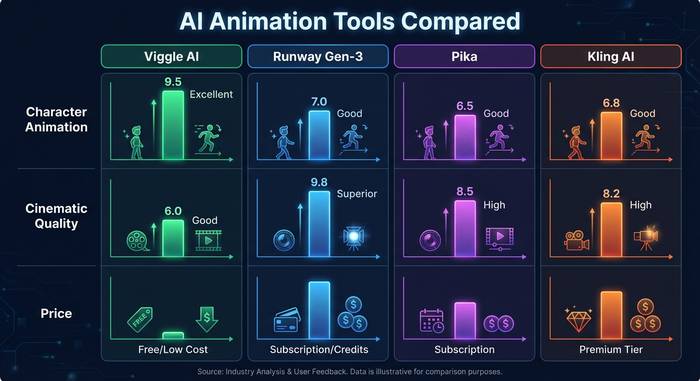

Viggle vs Runway vs Pika vs Kling: Wo passt es hin?

Der Markt für KI-gestützte Videogenerierung ist rasant gewachsen. Hier ist Viggles Position im Vergleich zu den Tools, mit denen es am häufigsten verglichen wird.

| Werkzeug | Am besten bei | Physik/3D | Preisgestaltung | Charakteranimation |

|---|---|---|---|---|

| Viggle AI | Animationen einzelner Charaktere, Memes | JST-1 (3D-Physik) | Kostenlos + kostenpflichtig | Exzellent |

| Startbahn Gen-3 | Kinoreife Videogenerierung | 2D-Pixelvorhersage | 12-76 $/Monat | Mäßig |

| Pika | Kurze, stilisierte Clips | 2D-Pixelvorhersage | Kostenlos + 8,58 $/Monat | Basic |

| Kling AI | Längeres Video, Lippensynchronisation | 2D mit einigen 3D-Elementen | Kostenlos + kostenpflichtig | Gut |

| Animate Anyone (Open Source) | Poseübertragung in Forschungsqualität | 2D-Diffusion | Kostenlos (selbst gehostet) | Gut, aber technisch |

Viggle will nicht mit Runway in Sachen Filmqualität konkurrieren. Es will auch nicht Pika für schnelle Social-Media-Clips ersetzen. Sein Spezialgebiet ist die Charakteranimation: ein Standbild einer Person oder Figur überzeugend zum Leben erwecken. Genau hier verschafft JST-1s physikalisches Verständnis einen Vorteil, den pixelbasierte Tools nicht bieten können.

Viggles Schwäche: Es kann im Gegensatz zu Runway oder Pika keine Videos von Grund auf neu generieren. Man benötigt ein Eingangsbild und eine Bewegungsreferenz. Es handelt sich um Animation, nicht um Generierung. Die Ausgabelänge ist auf 30 Sekunden begrenzt. Aktuell funktioniert es am besten mit illustrierten oder Cartoon-Figuren. Fotorealistische Menschen wirken mitunter unnatürlich, da die 3D-Rekonstruktion subtile Ungenauigkeiten in Gesichtszügen und Hautstruktur erzeugt.

Wo Viggle punktet: Die Bewegungsqualität ist in dieser Preisklasse unübertroffen. Eine kostenlose Viggle-Generierung mit guten Eingabedaten erzeugt physikalisch überzeugendere Bewegungen als ein Runway-Abonnement für 76 US-Dollar pro Monat für Charakteranimationen. Das liegt daran, dass Viggles Modell den dreidimensionalen Raum tatsächlich versteht, während andere ihn anhand zweidimensionaler Muster erraten.

Wofür man Viggle tatsächlich einsetzen kann: Anwendungsfälle aus der Praxis

Der Meme-Ansatz brachte Viggle 1,6 Millionen Discord-Mitglieder ein, aber es gibt auch praktischere Anwendungsmöglichkeiten.

Content-Ersteller nutzen es, um ihre Avatare oder Online-Persönlichkeiten für soziale Medien zu animieren. Ein YouTuber mit einem Cartoon-Avatar kann diesen in Videos tanzen, winken oder reagieren lassen, ohne einen Animator zu beauftragen. TikTok-Nutzer erstellen aus Fotos Charaktere, die trendige Tänze aufführen. Die kurze Bearbeitungszeit von unter zwei Minuten pro Clip ermöglicht die tägliche Produktion animierter Inhalte.

Kleinunternehmen und Marketingfachleute nutzen es für schnelle Werbeanimationen. Ein Restaurant kann beispielsweise ein Foto seines Maskottchens nehmen und es in einer Social-Media-Anzeige tanzen lassen. Ein E-Commerce-Unternehmen kann eine Produktfigur für einen Story-Highlight animieren. Dank der kostenlosen Nutzung und der kommerziellen Lizenzierung ist es auch für Unternehmen zugänglich, die sich keine Motion-Design-Studios leisten können.

Indie-Spieleentwickler und Storyboard-Zeichner nutzen es für Prototypen. Bevor sie in vollständige Animationen investieren, können sie testen, wie eine Figur in Bewegung wirkt. Stimmt die Pose? Vermittelt die Bewegung die Emotion? Viggle liefert eine schnelle, aber grobe Antwort.

Bildung ist ein Anwendungsfall, den ich so nicht erwartet hätte, aber er leuchtet ein. Lehrer und Kursentwickler verwenden Maskottchen und animieren sie für Erklärvideos. Das ist viel ansprechender als ein statisches Bild in einer Präsentation. Eine Figur, die gestikuliert und dabei die Photosynthese erklärt, fesselt die Aufmerksamkeit eines Zwölfjährigen länger als Text und Pfeile. Ich habe Sprachlehrer auf TikTok gesehen, die Viggle nutzen, um animierte Figuren Begrüßungen aus verschiedenen Kulturen demonstrieren zu lassen. Kreativ, mit geringem Aufwand – und es funktioniert.

Einschränkungen und Dinge, auf die man achten sollte

Viggle ist beeindruckend, hat aber auch klare Grenzen.

Menschliche Bilder werden unterstützt, das Modell wurde jedoch eindeutig für illustrierte Charaktere optimiert. Fotorealistische Ergebnisse sind uneinheitlich. Gesichter wirken mitunter unnatürlich. Hände verbessern sich zwar, bleiben aber die Schwachstelle aller existierenden KI-Videotools.

Die 30-Sekunden-Beschränkung bedeutet, dass Sie keine längeren Inhalte erstellen können. Für alles, was über einen kurzen Clip hinausgeht, müssen Sie mehrere Versionen zusammenfügen.

Datenschutz ist ein berechtigtes Anliegen. Sie laden Bilder und Videos in einen Cloud-Dienst hoch. Im Subreddit zum Thema Datenschutz gab es einen Thread über die Datenpraktiken von Viggle. Obwohl das Unternehmen Inhaltsmoderation und C2PA-Metadaten-Tagging zur Nachverfolgbarkeit implementiert hat, sollten Sie gut überlegen, bevor Sie sensible persönliche Fotos hochladen. Insbesondere Fotos anderer Personen ohne deren Einwilligung. Das Potenzial für Deepfakes ist offensichtlich, und die ethische Verantwortung liegt beim Nutzer.

Keine API bedeutet keine automatisierten Arbeitsabläufe. Wer Viggle in ein Produkt integrieren oder Hunderte von Animationen programmatisch generieren möchte, hat derzeit Pech gehabt. Alles läuft manuell über die Web-App oder Discord.

Es gibt bisher auch keine mobile App, die den vollen Funktionsumfang bietet. Zwar existiert die iOS-App, diese ist jedoch eine vereinfachte Version mit Fokus auf Meme-Vorlagen anstatt des vollständigen Mix/Move-Workflows. Die Discord-Abhängigkeit, die zwar zum Aufbau der Community beigetragen hat, stellt für Nutzer ohne Discord ein Hindernis dar. Einem Server beitreten, Slash-Befehle lernen und in einer öffentlichen Warteschlange warten zu müssen, ist keine gewohnte Software-Erfahrung. Die Web-App ist zwar hilfreich, befindet sich aber noch in der Entwicklung und bietet nicht alle Funktionen.