Qu’est-ce que Viggle AI ? L’outil de création de mèmes et d’animation qui est devenu viral.

Quelqu'un a intégré un personnage issu d'une photo libre de droits dans une danse de Fortnite, et le résultat était… réussi. Pas juste « réussi pour une IA », non. Vraiment réussi. Des mouvements fluides. Une physique crédible. Le poids du personnage se déplaçait naturellement lorsqu'il tournait, ses vêtements bougeaient comme du vrai tissu, et le tout a été réalisé en deux minutes à peine. Cette vidéo a fait le buzz sur Twitter début 2024, et en une semaine, tout le monde parlait de Viggle AI.

J'ai vu la vidéo, j'ai supposé qu'il s'agissait d'un contenu marketing soigneusement sélectionné, et j'ai voulu l'essayer moi-même. J'ai importé une photo, choisi un modèle d'animation de danse, et attendu environ 90 secondes. Le résultat était imparfait, mais vraiment impressionnant. Le personnage de ma photo dansait. En 3D. Avec une physique réaliste. Gratuitement. Grâce à un bot Discord. C'est à ce moment-là que j'ai compris que cet outil était différent des vidéos d'IA habituelles, souvent galvaudées.

Viggle est passé de zéro à 1,6 million de membres sur Discord en moins d'un an. En 2024, il est devenu le moteur de la moitié des contenus humoristiques générés par l'IA sur les réseaux sociaux. La technologie sous-jacente, un modèle appelé JST-1 qui comprend la physique 3D et non pas seulement la reconnaissance de pixels 2D, représente une véritable innovation dans le domaine de la vidéo par IA. Cet article explique ce qu'est Viggle, comment fonctionne JST-1, comment utiliser l'outil étape par étape et comment il se compare aux leaders de la génération vidéo par IA.

Qu'est-ce que Viggle AI et pourquoi est-ce important ?

Viggle AI est une plateforme d'animation de personnages qui transforme une image fixe d'une personne ou d'un personnage en mouvement. Contrairement à la plupart des outils d'IA qui se contentent de zoomer et de faire un panoramique approximatif sur une photo, Viggle génère de véritables mouvements 3D. Le personnage tourne, marche, danse, saute, et ces mouvements respectent les lois de la physique : gravité, transfert de poids, drapé des vêtements, inertie.

L'entreprise a été fondée par une équipe spécialisée en vision par ordinateur et modélisation 3D. Ils ont conçu JST-1 (Joint Space-Time), qu'ils décrivent comme « le premier modèle de base vidéo-3D intégrant une véritable compréhension de la physique ». Cette affirmation mérite d'être analysée, car c'est ce qui distingue Viggle de tous les autres produits de sa catégorie.

La plupart des outils vidéo IA (Runway Gen-3, Pika, Kling) génèrent des vidéos en prédisant l'apparence de l'image suivante à partir de la précédente. Ils fonctionnent dans un espace pixel 2D. Le résultat est satisfaisant jusqu'à ce qu'un personnage doive se tourner de côté, interagir avec un objet ou effectuer un mouvement non prévu par les données d'entraînement. C'est alors que des anomalies apparaissent : les membres traversent le corps, les proportions se modifient et la gravité semble ne plus fonctionner.

JST-1 adopte une approche différente. Il reconstruit une représentation 3D du personnage à partir de l'image d'entrée, comprend sa structure squelettique, puis anime ce modèle 3D selon les lois de la physique avant de générer la sortie vidéo 2D finale. Le personnage possède un volume, un poids et des articulations. Lorsqu'il danse, ses pieds prennent appui sur le sol avec la force adéquate. Lorsqu'il tourne, la perspective est correcte car le modèle reconnaît que le personnage a un dos, et pas seulement un devant.

Le résultat est-il parfait ? Non. Les scènes complexes présentent encore des artefacts. Les interactions entre plusieurs personnages sont aléatoires. De plus, le modèle fonctionne mieux avec des personnages de dessins animés et d'anime qu'avec des humains photoréalistes. Cependant, pour l'animation d'un seul personnage à partir d'une image fixe, Viggle produit des résultats que je n'ai vus égalés par aucun autre logiciel grand public à ce prix. Qui plus est, gratuit.

Comment utiliser Viggle AI : guide étape par étape

Viggle fonctionne sur deux plateformes : une application web et un bot Discord. Ce dernier, développé en premier, reste l’interface principale pour la communauté. Voici le fonctionnement de chaque fonctionnalité essentielle.

Mix : l'événement principal

C'est Mix qui a permis à Viggle de devenir viral. Il suffit de lui fournir deux éléments : une image de personnage et une vidéo animée. Viggle extrait le personnage de l'image, le superpose à l'animation de la vidéo et génère le résultat.

Étape par étape : ouvrez l’application web Viggle ou Discord. Utilisez la commande /mix. Importez une image nette d’un personnage (une personne, corps visible, bon éclairage). Importez une courte vidéo du mouvement souhaité (une danse, une marche, un geste). Choisissez votre arrière-plan : fond vert, blanc ou original. Cliquez sur « Générer ». Patientez 60 à 120 secondes. Vous obtiendrez une vidéo de votre personnage reproduisant le mouvement de la vidéo de référence.

Les résultats dépendent fortement de vos données d'entrée. Les images de personnages nettes, avec des membres visibles, donnent les meilleurs résultats. Les arrière-plans chargés, les parties du corps partiellement masquées ou les angles de vue extrêmes perturbent le modèle. Les vidéos animées fonctionnent mieux lorsqu'elles montrent une seule personne effectuant des mouvements clairs et distincts. Les gestes subtils sont plus difficiles à reproduire que les chorégraphies amples.

Déplacer : animer en conservant l'arrière-plan

Move est similaire à Mix, mais conserve le décor d'origine du personnage. Importez une image et une vidéo du personnage, et le système l'anime tout en préservant le contexte de la scène. Pratique pour conserver le contexte : une personne à son bureau qui se met soudainement à danser, un personnage dans un parc qui fait un signe de la main.

Concevoir et styliser

Ideate génère des concepts vidéo à partir de descriptions textuelles. Décrivez ce que vous souhaitez et le modèle produit une vidéo. Stylize vous permet de modifier le style visuel d'un personnage ou d'une animation existante. Ces deux outils sont plus expérimentaux que Mix and Move, et leurs résultats sont moins prévisibles.

La commande /character

Cela vous permet de créer un personnage persistant réutilisable dans plusieurs animations. Importez une image une seule fois, enregistrez-la comme personnage et utilisez-la dans vos futures créations sans avoir à la réimporter à chaque fois. Pour les créateurs de contenu qui développent un personnage récurrent (une mascotte, un avatar, une figure emblématique), c'est un gain de temps considérable.

Tarification Viggle : ce qui est gratuit et ce qui est payant

Viggle utilise un modèle freemium et son offre gratuite est étonnamment généreuse comparée à la plupart des outils vidéo IA.

| Fonctionnalité | Gratuit | Prime |

|---|---|---|

| Générations par jour | Limité (variable) | Limites supérieures |

| Priorité dans la file d'attente | Standard (peut être lent) | Traitement prioritaire |

| Durée de la vidéo | Jusqu'à 30 secondes | Jusqu'à 30 secondes |

| Résolution | Standard | Qualité supérieure |

| Filigrane | Oui | Supprimé |

| droits commerciaux | Oui (sans redevance) | Oui (sans redevance) |

| Plusieurs personnages | Modèles uniquement | Plus d'options |

Le point concernant les droits commerciaux est remarquable. Viggle affirme que le contenu généré est « totalement libre de droits » et que vous disposez de « droits d'utilisation commerciale complets pour chaque vidéo créée ». C'est inhabituel. La plupart des plateformes vidéo IA limitent l'utilisation commerciale dans leurs versions gratuites ou facturent des licences pour entreprises. Viggle vous permet d'utiliser le contenu produit à des fins marketing, sur les réseaux sociaux ou à toute autre fin commerciale sans frais supplémentaires.

Les tarifs premium ont évolué et varient selon les régions. Consultez directement viggle.ai pour connaître les tarifs actuels. Lors de ma dernière vérification, l'abonnement payant coûtait moins de 20 $ par mois et proposait principalement la suppression des filigranes, une priorité accrue dans la file d'attente et une augmentation des limites de génération quotidiennes.

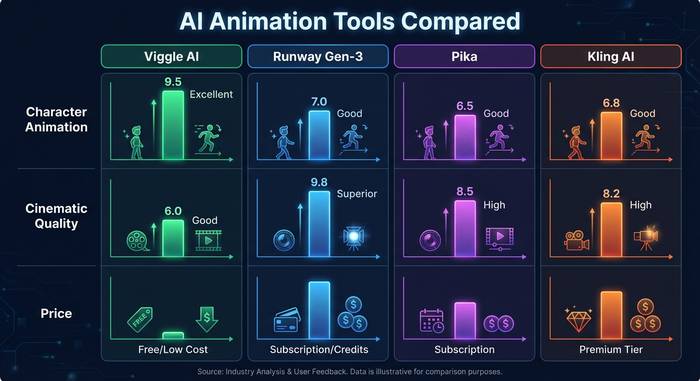

Viggle contre Runway contre Pika contre Kling : où se situe-t-il ?

Le marché de la génération vidéo par IA a rapidement explosé. Voici où se situe Viggle par rapport aux outils auxquels on le compare le plus souvent.

| Outil | Meilleur en | Physique/3D | Tarification | Animation de personnages |

|---|---|---|---|---|

| Viggle AI | Animation d'un seul personnage, mèmes | JST-1 (physique 3D) | Gratuit + payant | Excellent |

| Piste Gen-3 | génération de vidéos cinématographiques | Prédiction de pixels 2D | 12-76 $/mois | Modéré |

| Pika | Clips rapides et stylisés | Prédiction de pixels 2D | Gratuit + 8 à 58 $/mois | Basique |

| Kling IA | Vidéo plus longue, synchronisation labiale | 2D avec quelques éléments 3D | Gratuit + payant | Bien |

| Animer n'importe qui (source libre) | Transfert de pose de qualité recherche | diffusion 2D | Gratuit (auto-hébergé) | Bien, mais technique. |

Viggle ne cherche pas à rivaliser avec Runway en termes de qualité cinématographique. Il ne prétend pas remplacer Pika pour la création de clips rapides pour les réseaux sociaux. Son créneau, c'est l'animation de personnages : animer une personne ou un personnage à partir d'une image fixe de manière convaincante. Dans ce domaine précis, la compréhension de la physique par le JST-1 lui confère un avantage incomparable par rapport aux outils basés sur les pixels.

Le point faible de Viggle : contrairement à Runway ou Pika, il ne peut pas générer de vidéo à partir de zéro. Il nécessite une image d'entrée et une référence de mouvement. Il s'agit d'animation, et non de génération. La durée de la vidéo est limitée à 30 secondes. De plus, il fonctionne actuellement mieux avec des personnages illustrés ou de dessins animés. Les personnages humains photoréalistes peuvent parfois présenter un aspect étrange, la reconstruction 3D créant de subtiles imperfections au niveau des traits du visage et du grain de peau.

Le point fort de Viggle : la qualité de ses animations est inégalée à ce prix. Une génération Viggle gratuite, avec des données d'entrée de qualité, produit des mouvements plus réalistes qu'un abonnement Runway à 76 $ par mois pour l'animation de personnages. En effet, le modèle de Viggle appréhende l'espace 3D, contrairement aux autres qui se basent sur des motifs 2D.

À quoi sert réellement Viggle : cas d’utilisation concrets

C’est grâce à l’utilisation de mèmes que Viggle a atteint 1,6 million de membres sur Discord, mais il existe des applications plus pratiques.

Les créateurs de contenu l'utilisent pour animer leur avatar ou leur personnage sur les réseaux sociaux. Un YouTubeur possédant un avatar de personnage de dessin animé peut faire danser, saluer ou réagir ce personnage dans ses vidéos sans faire appel à un animateur. Les créateurs TikTok font exécuter des danses populaires à leurs personnages à partir de photos. Le temps de production, inférieur à deux minutes par clip, permet de créer du contenu animé quotidiennement.

Les petites entreprises et les spécialistes du marketing l'utilisent pour créer rapidement des animations promotionnelles. Un restaurant peut prendre une photo de sa mascotte et la faire danser dans une publicité sur les réseaux sociaux. Une marque de commerce électronique peut animer un personnage représentant un produit pour mettre en avant ses caractéristiques. La gratuité et la licence commerciale le rendent accessible aux entreprises qui n'ont pas les moyens de faire appel à des studios de motion design.

Les développeurs de jeux indépendants et les storyboarders l'utilisent pour le prototypage. Avant d'investir dans une animation complète, ils peuvent tester l'apparence d'un personnage en mouvement. La pose est-elle réussie ? Le mouvement traduit-il l'émotion ? Viggle donne une réponse rapide et approximative.

L'éducation est un cas d'utilisation auquel je ne m'attendais pas, mais qui est pourtant pertinent. Les enseignants et les créateurs de cours utilisent une mascotte animée pour leurs vidéos explicatives. C'est bien plus captivant qu'une image fixe dans une présentation. Un personnage qui gesticule tout en expliquant la photosynthèse retient l'attention d'un enfant de 12 ans bien plus longtemps qu'un texte et des flèches. J'ai vu des professeurs de langues sur TikTok utiliser Viggle pour créer des personnages animés illustrant les salutations dans différentes cultures. Créatif, simple et efficace.

Limites et points de vigilance

Viggle est impressionnant, mais il a de réelles limites.

Les images humaines sont prises en charge, mais le modèle a clairement été optimisé pour les personnages illustrés. Le rendu photoréaliste est inégal. Les visages peuvent parfois paraître étranges. Les mains s'améliorent, mais restent le point faible de tous les outils vidéo d'IA.

La limite de 30 secondes vous empêche de créer du contenu long. Pour tout contenu plus long qu'une courte vidéo, vous devrez assembler plusieurs séquences.

Le respect de la vie privée est une préoccupation légitime. Vous téléchargez des images et des vidéos sur un service cloud. Le subreddit dédié à la confidentialité a abordé les pratiques de Viggle en matière de données. Bien que l'entreprise ait mis en place une modération de contenu et un étiquetage des métadonnées C2PA pour assurer la traçabilité, il est important de bien réfléchir avant de télécharger des photos personnelles sensibles, surtout celles d'autres personnes sans leur consentement. Le risque de falsification est évident et la responsabilité éthique incombe à l'utilisateur.

L'absence d'API signifie l'impossibilité d'automatiser les flux de travail. Si vous souhaitez intégrer Viggle à un produit ou générer des centaines d'animations par programmation, ce n'est pas possible pour le moment. Tout doit être fait manuellement via l'application web ou Discord.

Il n'existe pas encore d'application mobile offrant l'ensemble des fonctionnalités. L'application iOS existe, mais il s'agit d'une version simplifiée axée sur les modèles de mèmes plutôt que sur le flux de travail complet de Mix/Move. De plus, la dépendance à Discord, bien qu'ayant contribué à la construction de la communauté, représente un frein pour les utilisateurs qui n'utilisent pas Discord. Devoir rejoindre un serveur, apprendre les commandes slash et patienter dans une file d'attente publique n'est pas une expérience utilisateur classique. L'application web apporte une solution, mais elle est encore en développement et certaines fonctionnalités lui manquent.