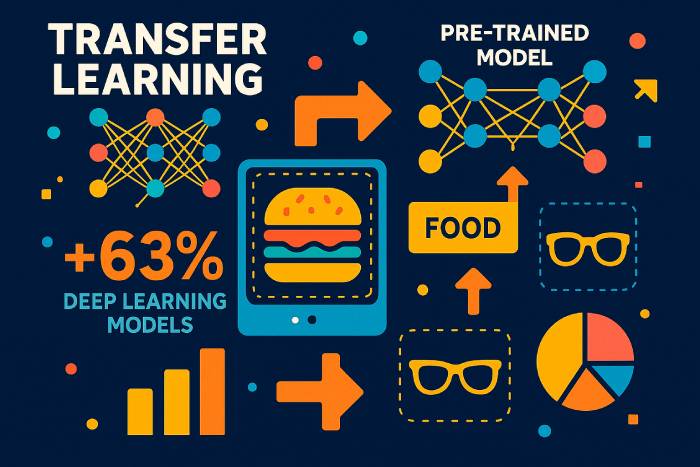

یادگیری انتقالی در یادگیری عمیق و شبکههای عصبی

یادگیری انتقالی یک تکنیک یادگیری ماشینی است که در آن یک مدل یادگیری که برای یک کار آموزش دیده است، برای تسریع و بهبود عملکرد در یک کار مرتبط، مجدداً مورد استفاده قرار میگیرد. به جای آموزش یک شبکه عصبی عمیق از ابتدا روی یک مجموعه داده جدید، یادگیری انتقالی به توسعهدهندگان این امکان را میدهد تا دانشی را که یک مدل قبلاً در یک محیط آموخته است، مجدداً مورد استفاده قرار دهند و آن را در محیط دیگری به کار گیرند. با انجام این کار، مدل آموزش دیده روی یک مسئله میتواند تعمیمپذیری را در مسئله دیگر بهبود بخشد - به خصوص زمانی که دادههای برچسبگذاری شده برای کار جدید محدود باشد.

در یادگیری ماشینی مدرن، این رویکرد به محرکی برای پیشرفت یادگیری ماشینی تبدیل شده است. یادگیری عمیق به مجموعه دادههای عظیم، سختافزارهای سطح بالا و چرخههای آموزشی طولانی نیاز دارد. یادگیری انتقالی - نوعی انتقال دانش - با اجازه دادن به مدلی که روی مجموعه دادههای بزرگی مانند ImageNet آموزش دیده است، به عنوان پایهای برای یک مدل جدید، این هزینهها را کاهش میدهد. این استراتژی به طور گسترده در بینایی کامپیوتر، پردازش زبان طبیعی، یادگیری تقویتی و بسیاری از موسسات تحقیقاتی که تکنیکهای یادگیری ماشینی را بررسی میکنند، استفاده میشود.

یادگیری انتقالی شامل استفاده مجدد از لایهها، ویژگیها یا کل معماری مدل است، به طوری که وظیفه جدید میتواند از بازنماییهای آموختهشده شروع شود، نه از یک صفحه خالی. از آنجا که لایههای اولیه شبکههای عصبی کانولوشنی، ویژگیهای جهانی مانند لبهها و بافتها را یاد میگیرند و لایههای اولیه مدلهای زبانی، دستور زبان و ساختار را یاد میگیرند، این بخشها به خوبی در وظایف و دامنههای مختلف منتقل میشوند.

مزایای یادگیری انتقالی در یادگیری ماشین

مدلهای یادگیری ماشین اغلب به حجم عظیمی از دادههای برچسبگذاریشده وابسته هستند. جمعآوری و برچسبگذاری چنین مجموعه دادههایی پرهزینه و کند است. یادگیری انتقالی با اجازه دادن به توسعهدهندگان برای استفاده از مدلهای از پیش آموزشدیده به جای ساخت شبکه از ابتدا، این مشکل را برطرف میکند. مزایای یادگیری انتقالی عبارتند از:

• استفاده کارآمدتر از دادههای آموزشی، به ویژه هنگامی که دادههای برچسبگذاری شده کمیاب هستند.

• فرآیند یادگیری سریعتر و کاهش هزینه محاسباتی.

• عملکرد بهتر در وظایف جدید زیرا لایههای اولیه الگوهایی را ثبت میکنند که به خوبی منتقل میشوند.

• پشتیبانی از کاربردهای یادگیری در حوزههایی که مدلها میتوانند مورد استفاده قرار گرفته و تطبیق داده شوند.

از آنجایی که یادگیری ماشینی به بخش جداییناپذیر صنایع مختلف از مراقبتهای بهداشتی گرفته تا امور مالی تبدیل میشود، توانایی اعمال یادگیری انتقالی به طور فزایندهای اهمیت پیدا میکند. مدلهای آموزشدیده روی یک مجموعه داده بزرگ را میتوان با نرخ یادگیری کم تنظیم کرد تا در یک کار جدید اما مرتبط عملکرد خوبی داشته باشند.

نحوه عملکرد یادگیری انتقالی در مدلهای یادگیری عمیق

یادگیری انتقالی با برداشتن بخشهایی از یک مدل از پیش آموزشدیده - معمولاً استخراجکنندههای ویژگی عمومی - و استفاده مجدد از آنها برای یک کار جدید کار میکند. این شامل مراحلی مانند موارد زیر است:

یک مدل از پیش آموزشدیده انتخاب کنید. مدلی که روی یک مجموعه داده بزرگ (مثلاً ImageNet، مجموعه دادههای متنی بزرگ یا مجموعه دادههای صوتی) آموزش دیده است، به عنوان مدل پایه عمل میکند.

لایههایی که دانش عمومی را در بر میگیرند، مسدود کنید. این لایهها بدون تغییر باقی میمانند زیرا قبلاً نمایشهای مفید را آموختهاند.

لایههای باقیمانده را به دقت تنظیم کنید. لایههای بعدی با نرخ یادگیری پایین روی مجموعه داده جدید دوباره آموزش داده میشوند و به وظیفه جدید اجازه میدهند بدون بازنویسی یادگیری مدل، خود را وفق دهد.

یک مدل را برای پیشبینی در مورد وظیفه مربوطه آموزش دهید. فقط بخشی از مدل باید تنظیم شود که به طور چشمگیری تلاش برای آموزش را کاهش میدهد.

این رویکرد یادگیری مشابه یادگیری انتقالی استقرایی است، که در آن دانش آموخته شده در یک کار به بهبود تعمیم در کار دیگر کمک میکند. در یادگیری انتقالی انتقالی، کار ثابت میماند اما مجموعه دادهها تغییر میکند. در تنظیمات یادگیری بدون نظارت، یادگیری انتقالی میتواند به مدلها کمک کند تا از یک دامنه بدون برچسب به دامنه دیگر سازگار شوند.

تنظیم دقیق: لایههای منجمد در مقابل لایههای قابل آموزش در مدلهای از پیش آموزشدیده

لایههای اولیه شبکههای عصبی عمیق، ویژگیهای جهانی را ثبت میکنند. از آنجا که این ویژگیها به ندرت به یک مجموعه داده خاص وابسته هستند، میتوانند ثابت بمانند. لایههای عمیقتر و مختص به یک وظیفه - به ویژه در شبکههای عصبی کانولوشن - برای طبقهبندی دستههای جدید، تشخیص اشیاء جدید یا پردازش الگوهای متنی جدید، به دقت تنظیم شدهاند.

انتخاب لایههایی که باید فریز شوند به موارد زیر بستگی دارد:

• وظیفه جدید چقدر به وظیفه اولیه شباهت دارد.

• مجموعه داده جدید چقدر بزرگ یا کوچک است.

• اینکه آیا نرخ یادگیری کمی مورد نیاز است یا بازآموزی کامل.

فریز کردن لایههای زیاد روی یک کار نامرتبط ممکن است باعث عملکرد ضعیف شود که به عنوان انتقال منفی شناخته میشود. اما تنظیم دقیق لایههای زیاد روی یک مجموعه داده کوچک ممکن است باعث بیشبرازش شود. تحقیقات زیادی، از جمله بررسی مقالات یادگیری انتقال از کنفرانس بینالمللی یادگیری ماشین، به بررسی چگونگی متعادل کردن این عوامل میپردازد.

کاربردهای یادگیری انتقالی در بینایی کامپیوتر و پردازش زبان طبیعی

یادگیری انتقالی در یادگیری عمیق محبوب است زیرا در حوزههای بیشماری کاربرد دارد:

یادگیری انتقالی برای بینایی کامپیوتر

یادگیری انتقالی برای بینایی کامپیوتر از شبکههای عصبی کانولوشنی آموزشدیده روی مجموعه دادههای بزرگ استفاده میکند. مدلی که روی یک وظیفه طبقهبندی تصویر - مانند سگها در مقابل گربهها - آموزش دیده است، میتواند دستههای جدید را با حداقل تنظیمات طبقهبندی کند. بسیاری از آموزشها نحوه استفاده از یادگیری انتقالی با TensorFlow و Keras را برای تطبیق مدلهای تصویر از پیش آموزشدیده با وظایف جدید نشان میدهند.

یادگیری انتقالی برای پردازش زبان طبیعی

مدلهای زبانی که بر روی پیکرههای متنی عظیم آموزش دیدهاند، به طرز فوقالعادهای خوب انتقال میدهند. یک مدل از پیش آموزشدیده، دستور زبان، بافت و معناشناسی را ثبت میکند که سپس میتواند برای تحلیل احساسات، ترجمه، خلاصهسازی یا طبقهبندی متن خاص دامنه تنظیم شود.

کاربردهای یادگیری انتقالی در یادگیری تقویتی

سیستمهای یادگیری تقویتی عمیق اغلب عاملها را در شبیهسازیها از قبل آموزش میدهند. دانش به دست آمده در محیطهای شبیهسازی شده به کاربردهای دنیای واقعی منتقل میشود و ایمنی را بهبود میبخشد و هزینه را کاهش میدهد.

یادگیری چندوظیفهای به عنوان شکلی از یادگیری انتقالی

وقتی یک شبکه عصبی واحد چندین وظیفه مرتبط - مانند تشخیص اشیا و قطعهبندی تصویر - را انجام میدهد، دانش بین وظایف مختلف به اشتراک گذاشته میشود. این شکل از انتقال، تعمیمپذیری را افزایش میدهد.

رویکردهای مختلف یادگیری انتقالی

بسته به رابطه بین وظایف منبع و هدف، روشهای مختلف یادگیری انتقالی وجود دارد:

۱. استفاده از مدلی که برای یک کار آموزش دیده است برای کار دیگر

مدلهای عمیق را روی مجموعه دادهای با دادههای برچسبگذاریشده فراوان آموزش دهید، سپس یادگیری انتقالی را روی مجموعه دادههای کوچکتر اعمال کنید.

۲. استفاده از مدلهای از پیش آموزشدیده در یادگیری عمیق

این رایجترین شکل یادگیری انتقالی است. مدلهایی مانند مدلهای Keras یا TensorFlow شامل معماریهایی هستند که روی ImageNet یا پیکرههای متنی بزرگ آموزش دیدهاند.

۳. یادگیری بازنمایی و استخراج ویژگی

به جای استفاده از لایه خروجی، از لایههای میانی برای استخراج نمایشهای عمومی استفاده میشود. سپس این ویژگیها میتوانند با استفاده از الگوریتمهای یادگیری سنتی به یک مدل کوچکتر برای طبقهبندی وارد شوند.

یادگیری بازنمایی به کاهش اندازه مجموعه دادهها، هزینه محاسباتی و زمان آموزش کمک میکند.

چه زمانی از یادگیری انتقالی در یادگیری ماشین استفاده کنیم؟

یادگیری انتقالی زمانی بیشترین اثربخشی را دارد که:

• داده های آموزشی برچسب گذاری شده کافی برای آموزش یک مدل یادگیری عمیق از ابتدا وجود ندارد.

• یک شبکه از پیش آموزش دیده برای یک دامنه مشابه وجود دارد.

• هر دو وظیفه، فرمت ورودی یکسانی را به اشتراک میگذارند.

یادگیری انتقالی فقط زمانی خوب کار میکند که وظایف به هم مرتبط باشند. اگر وظایف خیلی متفاوت باشند، ممکن است انتقال منفی رخ دهد و دقت را کاهش دهد.

مثالها و کاربردهای یادگیری انتقالی

یادگیری انتقالی در مدلهای زبانی

یک مدل زبانی از پیش آموزشدیده میتواند با گویشهای جدید، واژگان تخصصی یا موضوعات خاص یک حوزه تطبیق داده شود.

یادگیری انتقالی در مدلهای بینایی کامپیوتر

مدلی که در یک دامنه (مثلاً عکسهای واقعی) آموزش دیده است، میتواند با استفاده مجدد از فیلترهای کانولوشن عمومی، برای دامنه دیگری (مثلاً اسکنهای پزشکی) تنظیم دقیق شود.

یادگیری انتقالی در شبکههای عصبی عمیق

معماریهای عصبی عمیق میتوانند ساختارها، وزنها یا نمایشها را بین وظایف به اشتراک بگذارند تا هزینه آموزش را کاهش دهند.

بینشهای آماری ۲۰۲۵ در مورد پذیرش آموزش انتقالی

گزارشهای اخیر صنعت در سال ۲۰۲۵ نشان میدهد که یادگیری انتقالی با چه سرعتی در حال تبدیل شدن به یک تکنیک اصلی یادگیری ماشین است:

• طبق معیار جهانی بهرهوری هوش مصنوعی ۲۰۲۵، شرکتهایی که از یادگیری انتقالی استفاده میکنند، در مقایسه با آموزش شبکه از ابتدا، به طور متوسط ۶۲ درصد زمان آموزش را کاهش میدهند.

• یک مطالعه مشترک توسط MIT و OpenAI (2025) نشان داد که 78٪ از کل مدلهای جدید یادگیری عمیق که در تولید به کار گرفته میشوند، به مدلهای از پیش آموزشدیده به عنوان پایه و اساس خود متکی هستند.

• در بینایی کامپیوتر، ۸۵٪ از سیستمهای طبقهبندی تصویر اکنون از یادگیری انتقالی به جای چرخههای آموزش کامل استفاده میکنند، که عمدتاً به دلیل اندازه و پیچیدگی مجموعه دادههای مدرن است.

• نظرسنجی صنعت پردازش زبان طبیعی (NLP) در سال ۲۰۲۵ گزارش میدهد که سازمانهایی که یادگیری انتقالی را برای مدلهای زبانی اتخاذ میکنند، به طور متوسط ۷۰ درصد از نیاز به دادههای برچسبگذاری شده را کاهش میدهند.

• ارائهدهندگان خدمات ابری تخمین میزنند که استفاده از شبکههای عصبی عمیق از پیش آموزشدیده، هزینههای محاسبات GPU را ۴۰ تا ۵۵ درصد کاهش میدهد و توسعه هوش مصنوعی را برای شرکتهای کوچکتر قابل دسترستر میکند.

• تحقیقات ارائه شده در کنفرانس بینالمللی یادگیری ماشینی ۲۰۲۵ (ICML) نشان میدهد که یادگیری انتقالی، تعمیم مدل را زمانی که وظایف حداقل شباهت دامنه متوسطی دارند، ۲۳ تا ۳۴ درصد بهبود میبخشد.

این آمار نشان میدهد که یادگیری انتقالی فقط یک رویکرد یادگیری نظری نیست - بلکه اکنون استراتژی غالب یادگیری عمیق در صنایع است.

مطالعات موردی دنیای واقعی از یادگیری انتقالی (۲۰۲۴-۲۰۲۵)

خودروسازی (تسلا، ۲۰۲۵)

تسلا پس از تنظیم دقیق Vision Transformers که از قبل روی مجموعههای ویدیویی عظیم آموزش داده شده بود، از بهبود ۳۷ درصدی در پایداری تشخیص اشیا خبر داد. یادگیری انتقالی به سیستم اجازه داد تا سریعتر با موارد نادر مانند الگوهای آب و هوایی غیرمعمول و بازتابهای شبانه سازگار شود.

تصویربرداری مراقبتهای بهداشتی (گزارش هوش مصنوعی پزشکی اتحادیه اروپا ۲۰۲۵)

بیمارستانهایی که از یادگیری انتقالی برای تحلیل MRI و اشعه ایکس استفاده میکنند، نیاز به دادههای برچسبگذاری شده را بیش از ۸۰ درصد کاهش داده و دقت تشخیص بیماریهای نادر را بهبود بخشیدهاند.

پردازش زبان طبیعی چندزبانه (مایکروسافت و OpenAI، ۲۰۲۵)

یک مدل زبان چندزبانه که از قبل برای زبان انگلیسی آموزش دیده و برای زبانهای کممنبع تنظیم شده بود، نسبت به مدلهایی که از ابتدا آموزش دیده بودند، 3 برابر دقت بهتری داشت.

درک بصری از خطوط لوله یادگیری انتقالی

از آنجایی که تصاویر را نمیتوان مستقیماً در اینجا نشان داد، نمودارهای مفهومی زیر روند کار را روشن میکنند:

۱. «یادگیری انتقالی قبل در مقابل بعد»

• قبل از: مدل از وزنهای تصادفی شروع میشود و به میلیونها مثال برچسبگذاری شده نیاز دارد.

• بعد از: مدل از ویژگیهای عمومی از پیش آموزشدیده شروع میکند → فقط لایههای نهایی نیاز به تنظیم دقیق دارند.

۲. نمودار لایههای منجمد در مقابل لایههای قابل آموزش

• لایههای اولیه CNN/Transformer: ثابت (استخراج لبهها، شکلها، الگوهای گرامری).

• لایههای بعدی: تنظیم دقیق میشوند (با دستهها یا دامنههای متنی جدید سازگار میشوند).

۳. نمودار خط لوله آموزش

مجموعه دادهها → مدل از پیش آموزشدیده → لایههای ثابت → تنظیم دقیق → ارزیابی.

مرور مقایسهای انواع یادگیری انتقالی

یادگیری انتقالی استقرایی

زمانی استفاده میشود که وظایف متفاوت هستند اما مجموعه دادهها مشابه هستند. برای وظایف طبقهبندی جدید عالی است.

یادگیری انتقالی ترارسانایی

وظایف ثابت میمانند، اما دامنهها متفاوت هستند - که اغلب برای تطبیق دامنه استفاده میشود.

یادگیری انتقالی بدون نظارت

زمانی مؤثر است که هر دو مجموعه داده عمدتاً حاوی دادههای بدون برچسب باشند.

یک مقایسه ساختاریافته به خوانندگان کمک میکند تا بفهمند چه زمانی از هر روش استفاده کنند.

معماریهای مدرن مسلط بر یادگیری انتقالی (۲۰۲۵)

ترانسفورماتورهای بینایی (ViT)

اکنون در اکثر سناریوهای انتقال، از CNNهای کلاسیک بهتر عمل میکنند؛ در سال ۲۰۲۵ توسط ۹۵٪ از مدلهای بینایی جدید پذیرفته میشوند.

مدلهای بنیادی (Gemini، LLaMA-3، Qwen-VL)

این سیستمهای چندوجهی از پیش آموزشدیده اکنون نقطه شروع پیشفرض برای موارد زیر هستند:

• طبقهبندی متن

• شرح تصویر

• استدلال چندوجهی

مدلهای لبه سبک

برای دستگاههای تلفن همراه/اینترنت اشیا بهینه شده است و امکان تنظیم دقیق روی دستگاه را فراهم میکند.

اشتباهات و مشکلات رایج در یادگیری انتقالی

• فریز کردن لایههای زیاد منجر به underfitting روی دامنههای جدید میشود.

• تنظیم بیش از حد با نرخ یادگیری بالا، وزنهای از پیش آموزشدیده را از بین میبرد.

• استفاده از مجموعه دادههای بیکیفیت باعث انتقال منفی میشود.

• قالبهای ورودی (اندازهها، کانالها، توکنسازی) نامتناسب، دقت را کاهش میدهند.

• نادیده گرفتن تغییر دامنه منجر به شکنندگی در استقرار در دنیای واقعی میشود.

نحوه انتخاب مدل از پیش آموزش دیده مناسب (راهنمای ۲۰۲۵)

• برای بینایی کامپیوتر: ViT، CLIP، ConvNeXt، EfficientNet-V2.

• برای NLP: LLM های سبک GPT، LLaMA-3، Mistral، Qwen.

• برای وظایف چندوجهی: Gemini-Vision، OpenCLIP، Florence-2.

• برای دستگاههای لبه: MobileNet-V3، EfficientNet-Lite.

معیارها:

• شباهت وظایف منبع/هدف

• اندازه مجموعه داده

• محاسبه بودجه

• سازگاری ورودی مدل

چگونه موفقیت آموزش انتقالی را ارزیابی کنیم

یک چارچوب ارزیابی قوی شامل موارد زیر است:

• مقایسه پایه با مدلی که از ابتدا آموزش دیده است.

• بهبود دقت و F1 در مجموعه داده هدف.

• کاهش استفاده از دادههای برچسبگذاریشده.

• صرفهجویی در زمان آموزش.

• پایداری تحت آزمونهای تغییر دامنه.

پیشبینیها برای سالهای ۲۰۲۶-۲۰۲۷

• خطوط لوله تنظیم دقیق خودکار در TensorFlow و PyTorch به استاندارد تبدیل خواهند شد.

• یادگیری انتقالی بر استقرار هوش مصنوعی لبهای (edge-AI) غالب خواهد بود.

• پیشآموزش خودنظارتی، نیاز به مجموعه دادههای برچسبگذاریشده را بیش از پیش کاهش خواهد داد.

• تطبیق دامنه از طریق سیستمهای فرایادگیری و یادگیری برای یادگیری، خودکار خواهد شد.

آینده یادگیری انتقالی در یادگیری عمیق

با گسترش یادگیری ماشینی در هر صنعتی، اکثر سازمانها برای اتخاذ سیستمهای پیشرفته هوش مصنوعی به یادگیری انتقالی متکی خواهند بود. شرکتهای کمی ظرفیت جمعآوری مجموعه دادههای برچسبگذاریشده عظیم یا آموزش یک مدل از ابتدا را دارند. در عوض، آنها یادگیری انتقالی را بر روی مدلهای از پیش آموزشدیده اعمال میکنند و آنها را با محیطها و وظایف خود تطبیق میدهند.

یادگیری انتقالی - یک تکنیک یادگیری که در آن یک مدل از دانش آموخته شده در یک حوزه برای بهبود عملکرد در حوزه دیگر استفاده میکند - به تقویت نسل بعدی برنامههای یادگیری عمیق ادامه خواهد داد. این تکنیک به عنوان یکی از مهمترین تکنیکها در یادگیری ماشین و یک عامل کلیدی در هوش مصنوعی قابل دسترس و مقیاسپذیر شناخته میشود.